En bref

La technologie de génération vidéo par IA franchit aujourd'hui une étape décisive depuis sa création : la synchronisation audiovisuelle. D'ici 2026, les meilleurs générateurs vidéo par IA ne produiront plus de clips muets nécessitant un doublage manuel. Ils produiront des effets sonores correspondant aux actions à l'écran, une musique de fond synchronisée avec l'ambiance visuelle et des dialogues synchronisés avec les mouvements des lèvres dans plusieurs langues, le tout dans un seul pipeline de génération. Ce guide couvre : les trois types principaux de génération audiovisuelle par IA (effets sonores, musique, synchronisation labiale) ; un workflow complet en six étapes pour créer des clips musicaux par IA à partir de zéro ; huit scénarios d'application concrets, des clips musicaux d'artistes indépendants à la visualisation de podcasts ; cinq modèles de prompts prêts à l'emploi ; une comparaison complète de tous les outils compatibles avec l'audio ; ainsi que des techniques avancées telles que la synchronisation du BPM et la synchronisation émotionnelle. Si votre contenu vidéo nécessite du son, ce qui est le cas de pratiquement toutes les productions vidéo, cela représente l'avancée la plus significative dans le domaine de la vidéo IA depuis la génération de texte en vidéo. Commencez dès maintenant à créer des clips musicaux IA -->

Le passage des vidéos IA muettes à une synchronisation labiale parfaite représente le plus grand bond en avant en matière de qualité dans l'histoire du contenu généré par l'IA. Des tâches qui nécessitaient autrefois des semaines de travail de la part des équipes de post-production hollywoodiennes peuvent désormais être réalisées à l'aide d'un seul pipeline génératif.

La révolution audio dans la vidéo IA

Pendant longtemps, les vidéos générées par l'IA sont restées un média fondamentalement incomplet. La qualité d'image s'est améliorée à un rythme remarquable, passant de clips flous de quelques secondes au début de l'année 2024 à des séquences d'une minute au réalisme photographique à la fin de l'année 2025. Cependant, toutes ces vidéos partageaient une même contrainte : elles étaient muettes.

L'ère du cinéma muet : de 2024 à début 2025

La première génération d'outils vidéo basés sur l'IA (Runway Gen-2, Pika 1.0 et les premières versions de Keeling) ne pouvait générer que des séquences vidéo. Il n'y avait ni piste audio, ni effets sonores, ni musique. Le résultat était un fichier MP4 purement visuel, qui nécessitait un doublage, un mixage et une synchronisation manuels dans un flux de travail d'édition distinct. Il ne s'agissait pas d'un inconvénient mineur, mais d'un écart fondamental entre les capacités de production de l'IA et les attentes du public.

La perception humaine de la vidéo est profondément multimodale. Les recherches en neurosciences démontrent systématiquement que l'audio contribue à hauteur de 50 % ou plus à l'impact émotionnel de toute expérience vidéo. Une prise de vue cinématographique, aussi photoréaliste soit-elle, semblerait plate et artificielle sans le bruit du vent, le chant des oiseaux ou une bande sonore envoûtante. Un personnage qui parle sans émettre de son, dont les lèvres bougent silencieusement, plonge directement dans la vallée dérangeante. L'« ère du silence » de la vidéo IA signifie que chaque clip généré nécessite un travail de post-production important pour paraître complet.

Pour les créateurs professionnels, cela implique de maintenir deux flux de travail distincts pour la génération visuelle et la production audio, ce qui double à la fois le temps et les compétences nécessaires. Pour les créateurs amateurs, cela signifie que les vidéos générées par l'IA semblent toujours inachevées : impressionnantes en tant que démonstrations techniques, mais inutilisables en tant que contenu final.

2025-2026 : La fusion du son et de l'image

Les avancées technologiques se font par étapes. Veo 3 de Google a annoncé des capacités natives de génération audio, démontrant qu'un seul modèle peut produire simultanément une vidéo et un son synchronisés. Il ne s'agit pas d'un son superposé à la vidéo pendant la post-production, mais plutôt d'un son généré comme partie intégrante de la sortie vidéo, avec des sons ambiants correspondant précisément à l'action à l'écran.

À peu près à la même période, Seedance 2.0 (développé par l'équipe Seed de ByteDance) a lancé une suite audio complète comprenant trois fonctionnalités distinctes : la génération d'effets sonores (SFX) par IA synchronisés avec le contenu vidéo, la génération de bandes sonores par IA adaptées à l'ambiance visuelle et la technologie de synchronisation labiale par IA qui associe les sons vocaux aux mouvements de la bouche des personnages (prenant en charge huit langues, dont le chinois). Pika a présenté sa fonctionnalité Sound Effects pour les sons ambiants de base. Les vannes des fonctionnalités audio sont désormais grandes ouvertes.

Ce changement est important car il transforme la vidéo IA de « matériel visuel nécessitant une post-production manuelle » en « format média complet et prêt à être publié ». L'écart entre les « clips générés par l'IA » et le « contenu vidéo fini » s'est réduit, passant de plusieurs heures de montage à quelques minutes de génération.

Importance particulière pour les créateurs chinois : cette transformation offre de plus grandes opportunités aux créateurs nationaux. Des plateformes telles que Douyin, Kuaishou et Bilibili ont favorisé le développement d'un vaste écosystème créatif pour les clips musicaux courts. Si les musiciens indépendants ont su se constituer un public sur NetEase Cloud Music et QQ Music, ils manquent souvent de contenu visuel à la hauteur de leur qualité musicale. Les clips musicaux générés par l'IA comblent directement cette lacune : les producteurs amateurs qui créent de la musique de qualité professionnelle sur leur ordinateur portable peuvent désormais créer des clips musicaux tout aussi soignés à l'aide de l'IA.

Pourquoi l'audio est la dernière pièce du puzzle

Prenons l'exemple du flux de production d'un créateur de contenu Bilibili, d'un créateur Xiaohongshu ou d'un musicien indépendant :

- Concept -- De quoi parle la vidéo ?

- Visuels -- À quoi ressemble la vidéo ?

- Audio -- Comment est le son de la vidéo ?

- Synchronisation -- Les visuels et l'audio sont-ils synchronisés ?

- Finition -- Est-elle prête à être diffusée ?

En 2025, les outils vidéo basés sur l'IA avaient efficacement résolu les étapes 1 et 2. Les étapes 3 et 4 restaient entièrement manuelles. Grâce à des générateurs dotés de capacités audio, les étapes 1 à 4 pouvaient désormais être réalisées à l'aide d'un seul outil. L'étape 5, la touche finale, reste la seule étape manuelle, bien que sa nécessité diminue à mesure que la qualité du résultat s'améliore.

Pour la production de clips musicaux, cela représente un changement révolutionnaire. Un musicien indépendant qui n'aurait jamais pu se permettre les coûts de production traditionnels d'un clip musical peut désormais en créer un. Un créateur Bilibili produisant de la musique lo-fi peut créer des accompagnements visuels pour chaque morceau. Une équipe marketing peut produire des publicités pour des produits avec des bandes sonores parfaitement adaptées sans avoir à engager de compositeurs ou à acheter de la musique protégée par des droits d'auteur.

Le paysage actuel des outils dotés de capacités audio

En février 2026, trois plateformes dominent le secteur de la vidéo générée par IA avec audio intégré :

- Seedance 2.0 : la solution audiovisuelle la plus complète. Prend en charge la génération d'effets sonores, la création de bandes sonores/musicales alimentées par l'IA et la synchronisation labiale multilingue (8 langues, dont le chinois). Convient aussi bien aux flux de travail texte-vidéo qu'image-vidéo. En tant que produit ByteDance, directement accessible en Chine sans VPN, prend en charge Alipay/WeChat Pay. Ce guide fera principalement référence à cette plateforme.

- Google Veo 3 : puissantes capacités de génération audio native, y compris les sons ambiants et les effets atmosphériques. Les résultats sont impressionnants, même s'il ne dispose pas du contrôle granulaire de Seedance sur les types et les styles audio. **Nécessite un VPN pour être utilisé en Chine. ** Pour une comparaison détaillée, consultez Comparaison approfondie entre Seedance et Veo 3.

- Pika 2.0 : génération d'effets sonores de base. Limité aux effets sonores ambiants – pas de génération de musique ni de synchronisation labiale. Va dans la bonne direction, mais n'est pas une solution audio complète. Nécessite un VPN.

Les autres outils de l'écosystème — Keeling, Runway et Conch AI — restent principalement axés sur la production visuelle pure au moment de la rédaction de cet article, mais ils devraient bientôt suivre le mouvement. Pour une comparaison plus large de tous les générateurs, veuillez vous référer à The Complete 2026 AI Video Generator Comparison.

Options supplémentaires pour les utilisateurs nationaux -- Outils de génération musicale par IA : Au-delà des capacités audio des vidéos IA, il existe en Chine des plateformes dédiées à la génération musicale par IA qui méritent d'être explorées : SkyMusic (produite par Kunlun Wanwei, excellente pour la génération de paroles en chinois) et NetEase Tianyin (produite par NetEase, intégrée à l'écosystème NetEase Cloud Music). Ces outils peuvent servir de processus de création musicale autonomes, la musique générée pouvant ensuite être importée dans Seedance comme référence audio pour la production vidéo.

Les trois principaux types de génération audiovisuelle par IA

Tous les systèmes audio basés sur l'IA ne se valent pas. Cette technologie englobe trois capacités fondamentalement distinctes, chacune servant des objectifs créatifs différents et fonctionnant selon des mécanismes techniques différents. Il est essentiel de comprendre ces distinctions pour choisir l'approche la mieux adaptée à votre projet.

La génération d'effets sonores par IA effectue une analyse image par image du contenu vidéo, identifie les actions et les environnements qui produisent des sons, puis synthétise les formes d'onde audio correspondantes. Le résultat final est un son ambiant lié de manière organique au contenu visuel.

Type 1 : Effets sonores IA (SFX)

La génération de sons par IA produit automatiquement des sons ambiants et d'action qui correspondent au contenu visuel. Lorsqu'un personnage marche sur un chemin de gravier, vous entendrez le crissement des pas sur les cailloux. Lorsque les vagues viennent se briser contre les rochers, vous entendrez le bruit de la mer. Lorsque les moteurs des voitures vrombissent dans une scène de rue, vous entendrez le bruit des moteurs.

Comment fonctionne Seedance Sound Generation : le modèle d'IA analyse le contenu visuel de la vidéo générée (en identifiant les objets, les actions, les environnements et les interactions physiques) et produit une bande sonore accompagnant la vidéo avec des effets sonores correspondants. Il ne s'agit pas simplement d'associer le mot « océan » à un clip vidéo d'archives montrant des vagues. Le modèle génère un son unique en réponse à des caractéristiques visuelles spécifiques : l'intensité des vagues, leur distance par rapport à la caméra, la présence de vent et les propriétés acoustiques de l'environnement.

Sound Generation est spécialisé dans le traitement des types de sons suivants :

- Sons ambiants atmosphériques (vent, pluie, tonnerre, sons de la forêt, circulation urbaine)

- Sons d'interaction physique (bruits de pas sur différentes surfaces, ouverture/fermeture de portes, placement d'objets)

- Sons naturels (écoulement de l'eau, chant des oiseaux, chant des insectes, bruissement des feuilles)

- Sons mécaniques (moteurs, fonctionnement de machines, pression sur des boutons, bourdonnements électroniques)

- Sons d'impact (collisions, éclaboussures, bris, effondrements)

Techniques pour suggérer des sons à l'aide d'indications : même lorsque vous utilisez l'IA de conversion de texte en vidéo (/blog/text-to-video-ai-complete-guide), vous pouvez influencer la sortie audio en décrivant les éléments produisant des sons dans les indications visuelles. « La pluie martelant un toit en tôle » produit un son de pluie plus intense que « une douce bruine sur un jardin ». Le son des pas provenant de « lourdes bottes piétinant une grille métallique » diffère complètement de celui de « pieds nus sur du sable chaud ». Les descriptions visuelles déterminent la génération audio, donc décrire des scènes riches sur le plan acoustique permet d'obtenir des paysages sonores plus complexes.

Limites actuelles : la génération sonore excelle dans les sons ambiants et naturels, mais peut rencontrer des difficultés avec les paysages sonores complexes et multicouches (tels qu'un restaurant animé où se mêlent conversations, cliquetis de couverts, bruits de cuisine et musique d'ambiance). Elle gère également mieux les sons organiques que les caractéristiques audio hautement spécifiques et identifiables (le bruit du moteur d'un modèle de voiture particulier, le cri d'une espèce d'oiseau spécifique).

Type deux : musique et bandes sonores générées par l'IA

La génération musicale par IA crée des musiques de fond, des bandes originales et des partitions originales pour vos vidéos qui correspondent parfaitement au contenu visuel, à l'ambiance et au rythme. Il ne s'agit pas simplement d'ajouter une musique générique libre de droits : l'IA génère des compositions originales sur mesure, adaptées aux images.

Contrôle du style : vous pouvez orienter le style musical à l'aide d'indications et de paramètres de génération. Une large gamme de styles est prise en charge :

- Film Orchestral : Cordes grandioses, cuivres et percussions, idéal pour les paysages épiques ou les scènes dramatiques

- Dynamic Electronic : Synthés et rythmes vibrants, idéaux pour les contenus au rythme rapide, les présentations de produits ou les réseaux sociaux

- Musique d'ambiance/atmosphérique : Textures douces, sons superposés et basses soutenues, parfaits pour les contenus méditatifs, les présentations immobilières ou les images de nature au ralenti

- Hip-hop lo-fi : Des rythmes emblématiques, chaleureux et légèrement désaccordés, associés au craquement du vinyle, idéaux pour les contenus liés à l'étude ou à la concentration

- Tension/Suspense : Cordes dissonantes, percussions profondes et urgence croissante superposée, parfaites pour les bandes-annonces et les films promotionnels

- Folk/ acoustique : guitare, piano et instruments organiques, adapté aux contenus personnalisés et intimes

- Style traditionnel chinois/ancien : guzheng, flûte, pipa et autres instruments traditionnels chinois, adapté aux contenus vidéo de style traditionnel chinois et aux clips musicaux de style ancien -- Il s'agit de la direction stylistique la plus distinctive dans la création de clips musicaux chinois par IA.

Différents styles musicaux produisent des caractéristiques de forme d'onde nettement différentes. La génération de bandes sonores par IA s'adapte non seulement au genre, mais aligne également la courbe d'énergie, synchronisant l'intensité de la musique avec l'action visuelle tout au long de la vidéo.

Adaptation de la durée : la musique générée par l'IA s'adaptera à la durée de votre vidéo. Un clip de 5 secondes recevra une phrase musicale cohérente de 5 secondes. Une vidéo de 30 secondes recevra un morceau structuré avec une introduction, un développement et une conclusion. Cela élimine le problème courant du fondu manuel d'entrée/sortie de la musique d'archive qui n'est jamais conçue pour la durée spécifique de votre vidéo.

Différences par rapport aux outils musicaux IA autonomes : vous connaissez peut-être déjà les générateurs musicaux IA dédiés tels que Suno ou Udio, qui créent des morceaux de musique autonomes à partir de suggestions textuelles. Bien que ces outils produisent une musique excellente, ils manquent de conscience visuelle : ils ne savent pas à quoi ressemble votre vidéo, quand surviennent les moments visuels clés ou comment l'ambiance évolue au sein du métrage. La génération de bandes sonores par IA dans des outils vidéo tels que Seedance fonctionne de manière fondamentalement différente, car la musique est générée en réponse au contenu visuel. La musique s'intensifie à mesure que les scènes deviennent plus dramatiques, son rythme s'aligne sur les mouvements à l'écran et son atmosphère correspond à l'ambiance de chaque scène.

En d'autres termes, les outils musicaux IA autonomes et les générateurs vidéo IA sont complémentaires. Un flux de travail robuste consiste d'abord à générer une piste dans Suno ou Udio (ou des alternatives nationales telles que SkyMusic ou NetEase Tianyin), puis à utiliser ce fichier audio comme référence pour générer une vidéo dans Seedance. Le générateur vidéo IA créera des visuels adaptés à la structure de la musique. Nous détaillerons ce flux de travail dans le tutoriel étape par étape ci-dessous.

Type trois : synchronisation labiale et parole générées par l'IA

La génération de synchronisation labiale par IA présente les exigences techniques les plus élevées parmi les trois types audio. Elle associe l'audio vocal, qu'il soit téléchargé ou généré, aux mouvements des lèvres d'un personnage, créant ainsi l'effet visuel d'un personnage à l'écran qui parle ou chante.

Prise en charge multilingue : Seedance 2.0 prend en charge la synchronisation labiale dans huit langues, dont le chinois, l'anglais, le japonais, le coréen, l'espagnol, le français, l'allemand et le portugais. Cela va au-delà du simple doublage audio : le modèle ajuste la forme de la bouche, les mouvements de la mâchoire et les micro-expressions faciales des personnages afin de les adapter aux caractéristiques vocales de chaque langue. La forme de la bouche pour la voyelle « o » en chinois diffère de celle de la voyelle « O » en anglais, tandis que la voyelle « u » en japonais varie également de celle en anglais. Une synchronisation labiale précise doit tenir compte de ces distinctions linguistiques.

L'importance pratique du doublage chinois : pour les créateurs nationaux, le doublage chinois permet aux personnages générés par l'IA d'interpréter vos chansons en mandarin standard ou de reproduire fidèlement les paroles rapides des clips de musique rap. Cela représente un immense potentiel créatif au sein des communautés de reprises musicales et d'anime de TikTok et Bilibili : les chanteurs virtuels générés par l'IA apparaissent comme un nouveau format de contenu.

La synchronisation labiale par IA transforme un personnage visuellement réaliste mais silencieux en une présence vocale. Cette technologie ajuste non seulement la forme de la bouche, mais module également la position de la mâchoire, la tension des joues et les micro-expressions faciales subtiles afin de les aligner sur les phonèmes de la parole.

Comment ça marche : le processus commence par une référence audio, soit un enregistrement vocal que vous téléchargez, soit un discours généré par l'IA. Le modèle analyse le contenu phonétique de l'audio (quels sons sont produits à quels moments) et génère les mouvements des lèvres et les expressions faciales correspondants image par image. Pour obtenir des résultats optimaux, l'audio doit présenter un discours clair, à un rythme modéré, avec un minimum de bruit de fond.

Scénarios d'application :

- Humains numériques et personnages virtuels : créez des animateurs IA parlants pour les chaînes Bilibili/YouTube, les formations en entreprise ou le service client.

- Personnages animés : donnez la parole à des personnages animés générés par IA sans synchronisation labiale image par image.

- Doublage multilingue : Générer des versions synchronisées des lèvres de contenus audiovisuels existants dans d'autres langues, en faisant correspondre le nouvel audio aux mouvements de la bouche des personnages.

- Performances dans des clips musicaux : Synchroniser les performances visuelles des chanteurs avec les pistes vocales pour créer des effets de performance authentiques dans les clips musicaux.

- Visualisation de podcasts et de livres audio : Transformer du contenu audio pur en média visuel mettant en scène des personnages qui parlent.

Limites actuelles — évaluation honnête : la synchronisation labiale reste le plus récent et le moins abouti des trois types audiovisuels. Bien que des progrès significatifs aient été réalisés, certains défis persistent. Les discours rapides dépassent parfois la capacité du modèle à générer des mouvements labiaux correspondants, ce qui entraîne une légère désynchronisation. Les angles faciaux extrêmes (profils latéraux, angles ascendants prononcés) réduisent la précision de la synchronisation labiale en raison du nombre réduit de repères visibles au niveau de la bouche. Les discours avec des accents prononcés ou des caractéristiques vocales inhabituelles peuvent donner des résultats moins précis que les schémas de discours standard. Pour les chansons chinoises au rythme extrêmement rapide, comme le rap, la précision de la synchronisation peut être inférieure à celle des chansons au rythme standard. Bien que la technologie progresse rapidement, il est important de fixer des attentes raisonnables : en 2026, la synchronisation labiale excelle dans les scénarios de discours standard, mais reste en cours de développement pour les cas limites.

Guide étape par étape : créer des clips musicaux IA à partir de zéro

En suivant ce processus en six étapes, vous pouvez créer un clip vidéo complet à l'aide de l'IA, avec un son et des images synchronisés, de la conception à la réalisation finale. Que vous soyez un musicien indépendant réalisant votre premier clip vidéo, un créateur de contenu Bilibili développant une chaîne axée sur la musique ou un spécialiste du marketing produisant des vidéos de marque, ce processus est applicable.

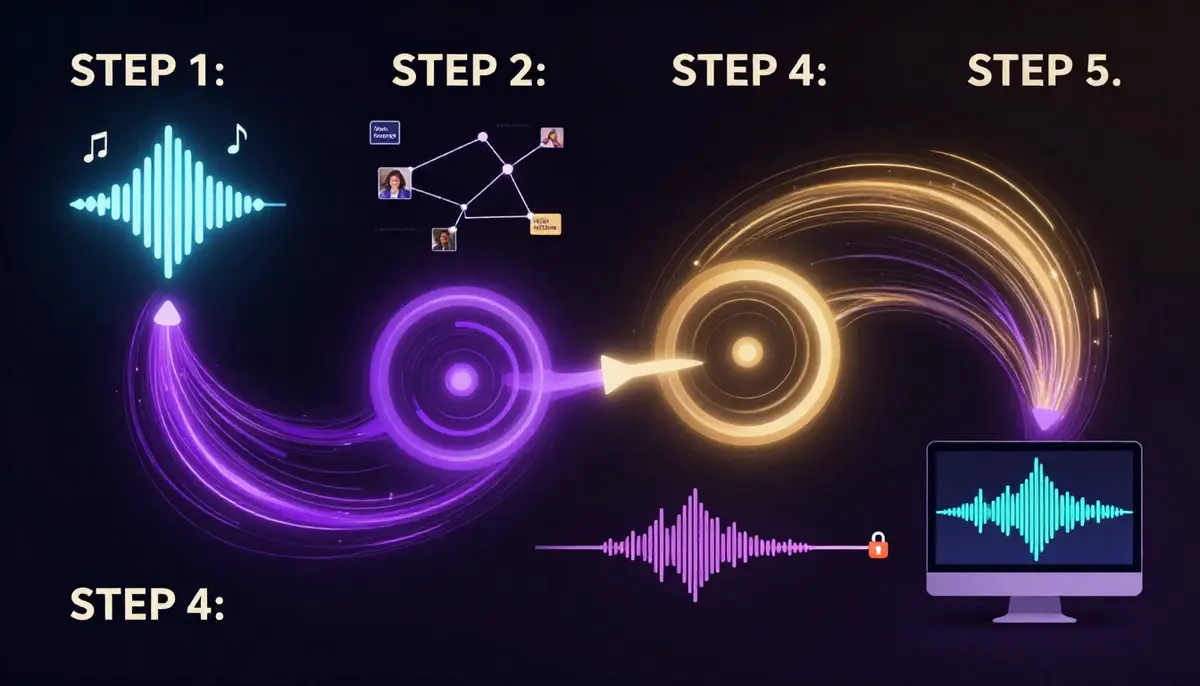

Un workflow complet de création de clips musicaux par IA, de la source audio au résultat final. Chaque étape s'appuie sur la précédente, la synchronisation audiovisuelle étant automatiquement réalisée pendant la génération.

Première étape : préparez votre musique ou votre source audio

Chaque clip vidéo commence par la musique. Vous avez trois possibilités :

Option A — Utilisation de votre propre musique : si vous êtes musicien ou possédez des morceaux sous licence, préparez vos fichiers audio. Les formats pris en charge sont généralement MP3, WAV et AAC. Pour obtenir des résultats optimaux, utilisez des versions master ou mixées de haute qualité (et non des extraits compressés issus de streaming). Un son clair et bien séparé donne des résultats de synchronisation labiale supérieurs à ceux obtenus avec des fichiers fortement compressés.

Option B — Générer de la musique avec l'IA en premier lieu : utilisez des générateurs de musique IA autonomes pour créer des morceaux originaux. Parmi les outils étrangers, on peut citer Suno et Udio ; au niveau national, pensez à SkyMusic (excellent pour générer des paroles en chinois, prend en charge plusieurs styles musicaux chinois) ou NetEase Tianyin (intégré à l'écosystème NetEase Cloud Music). Décrivez le style, l'ambiance, le tempo et l'arrangement que vous souhaitez pour générer plusieurs versions, puis sélectionnez celle qui correspond le mieux à votre concept visuel. Enregistrez localement.

Option C — Contrôle IA complet : si vous ne disposez pas d'une source audio spécifique et souhaitez que l'IA génère simultanément des éléments visuels et audio, ignorez la préparation audio et utilisez directement la fonction de génération de bande-son intégrée à Seedance. Dans ce cas, votre invite visuelle influencera le résultat musical. Il s'agit de l'approche la plus rapide, mais elle offre moins de contrôle sur l'effet musical précis.

Conseil aux musiciens : si vous souhaitez que les visuels réagissent à des moments précis de la musique (ralentissement du tempo, changement de tonalité, entrée vocale), notez ces moments dans le temps. Vous utiliserez ces informations dans vos invites et pourrez générer des segments qui s'alignent sur la structure de la chanson.

Deuxième étape : créer des repères visuels pour accompagner la musique

Vos repères visuels doivent représenter des images qui complètent naturellement le son. Il ne s'agit pas d'illustrer mot à mot les paroles, mais plutôt de créer une atmosphère visuelle qui amplifie le contenu émotionnel de la musique.

Adapter le style musical au style visuel :

| Style musical | Direction visuelle | Mots-clés |

|---|---|---|

| Orchestral cinématographique | Paysages immenses, ciels spectaculaires, ampleur épique | « vaste », « majestueux », « travelling lent », « qualité IMAX » |

| Lo-fi / Relaxation | Tons doux, intérieurs confortables, bruine, éclairage chaleureux | « pastel », « flou artistique », « chaleureux », « mouvement doux » |

| Électronique dynamique | Coupes rapides, néons, urbain, plans dynamiques | « vibrant », « dynamique », « néons », « rythme rapide » |

| Ballade lyrique | Gros plans intimes, lumière de bougie, ralenti | « intime », « faible profondeur de champ », « tons chauds » |

| Sombre/Dramatique | Ombres, contraste élevé, tension, palette de couleurs minimaliste | « éclairage dramatique », « silhouette », « contraste élevé » |

| Style chinois/ancien | Paysages, pavillons et tours, éléments à l'encre de Chine, pétales tombants | « Paysage chinois », « style de peinture à l'encre », « architecture traditionnelle », « éthéré » |

| Rap/Hip-hop | Scènes de rue, graffitis, paysages nocturnes, halos de phares de voiture | « urbain », « culture de rue », « enseignes au néon », « caméra à l'épaule dynamique » |

Pour connaître toutes les techniques de prompt, veuillez consulter le Guide des prompts Seedance. Principes fondamentaux pour les prompts de clips musicaux : décrivez des mouvements qui semblent naturels au rythme de votre chanson. Les morceaux rapides nécessitent des visuels dynamiques, tandis que les chansons plus lentes exigent des mouvements réguliers et gracieux.

Troisième étape : sélectionner le mode audio

Lorsque vous générez dans Seedance, sélectionnez le mode audio approprié en fonction de votre projet :

Mode Effets sonores (SFX) : idéal lorsque votre vidéo comporte des éléments environnementaux ou d'action distincts nécessitant des sons ambiants authentiques. Une voiture roulant sous la pluie doit produire le son d'une voiture sous la pluie. Les scènes océaniques doivent comporter le bruit des vagues. Le mode SFX génère automatiquement ces sons en fonction des séquences vidéo.

Mode Musique/Bande sonore : idéal lorsque vous souhaitez que la musique de fond générée par l'IA complète le contenu visuel. Utilisez ce mode lorsqu'il n'existe aucune piste préenregistrée et que vous souhaitez que l'outil crée des bandes sonores originales. Vous pouvez influencer le style à l'aide d'indications visuelles : un paysage urbain cyberpunk néon générera une musique totalement différente d'un lever de soleil tranquille à la montagne.

Mode voix/synchronisation labiale : idéal lorsque votre vidéo met en scène des personnages qui parlent ou chantent et que vous avez besoin d'une synchronisation audio avec les mouvements de la bouche. Téléchargez votre piste vocale ou votre enregistrement vocal, et l'IA générera des mouvements labiaux correspondants pour le personnage.

Approche combinée : pour une expérience vidéo musicale optimale, envisagez un flux de travail en plusieurs étapes. Commencez par générer une vidéo de base avec des images et de la musique à l'aide du mode bande sonore. Si des effets sonores ambiants doivent être superposés à la musique, utilisez le mode SFX lors d'une deuxième étape ou ajoutez-les pendant la post-production. Si les personnages doivent chanter, traitez cela à l'aide du mode synchronisation labiale sur la piste vocale.

Étape 4 : Télécharger les documents de référence (facultatif, mais fortement recommandé)

Les entrées de référence peuvent considérablement améliorer la qualité et la précision du résultat. Pour la production de clips musicaux, les types de référence suivants sont particulièrement utiles :

Fichier audio de référence : téléchargez votre morceau de musique. L'IA l'utilisera comme squelette audio pour la vidéo, générant des visuels qui répondent au contenu musical. Il s'agit de la référence la plus influente dans la production de clips musicaux.

Image de référence : téléchargez une image statique qui définit le style visuel souhaité. Il peut s'agir d'une pochette d'album, d'une capture d'écran d'un tableau d'ambiance, d'une image tirée d'un clip vidéo existant que vous appréciez ou d'une image générée par IA qui reflète l'esthétique souhaitée. La fonctionnalité text-to-video de Seedance utilise cette référence pour garantir la cohérence visuelle.

Vidéo de référence : si vous possédez une vidéo musicale dont vous souhaitez imiter les mouvements de caméra, le rythme de montage ou le style visuel, téléchargez-la comme référence. L'IA apprendra les schémas de mouvement, le timing des transitions et la composition visuelle à partir de votre référence tout en générant du contenu original.

Étape 5 : Générer et ajuster la synchronisation audiovisuelle

Cliquez sur « Générer » pour que l'IA produise le résultat initial. Lors de la révision, portez une attention particulière à la précision de la synchronisation labiale :

Points clés à vérifier :

- L'énergie musicale correspond-elle à l'énergie visuelle ? Un crescendo orchestral dramatique doit coïncider avec un moment visuellement dramatique, et non avec une scène statique.

- Le timing des effets sonores est-il précis ? Les bruits de pas doivent se faire entendre lorsque le pied touche le sol. Les sons d'impact doivent correspondre aux collisions visuelles.

- La synchronisation labiale est-elle convaincante ? Observez la bouche des personnages à une vitesse de visionnage normale. Les légères divergences au niveau des images sont invisibles à vitesse normale, mais visibles au ralenti, et votre public regarde à vitesse normale.

- L'atmosphère générale est-elle cohérente ? La palette de couleurs visuelles, la tonalité et l'arrangement musicaux, ainsi que le rythme doivent collectivement transmettre le même récit émotionnel.

Si la synchronisation pose problème : régénérez après avoir modifié l'invite. Si la musique s'avère trop intense pour les visuels, intégrez des éléments dynamiques supplémentaires dans l'invite visuelle. Si les visuels s'avèrent trop rapides pour une chanson lente, incluez des termes suggérant le tempo tels que « lent », « doux » ou « délibéré » dans l'invite. L'IA répondra à ces indications rythmiques.

Étape 6 : Exporter les fichiers audio et vidéo complets

Une fois satisfait, exportez le clip vidéo terminé. Le résultat est un fichier unique contenant les pistes vidéo et audio déjà synchronisées. Il n'est donc pas nécessaire d'aligner manuellement l'audio dans l'éditeur.

Remarques concernant l'exportation :

- Format : MP4 (vidéo H.264 + audio AAC) est la norme universelle acceptée sur toutes les plateformes

- Résolution : exportez à la résolution la plus élevée disponible. Pour les clips musicaux, 1080p est la résolution minimale requise ; 2K ou 4K est préférable.

- Format d'image : 16:9 pour Bilibili/YouTube et la distribution standard de clips musicaux ; 9:16 pour Douyin, Kuaishou, Xiaohongshu et Instagram Reels ; 1:1 pour WeChat Moments et le fil Instagram

- Qualité audio : assurez-vous que les paramètres d'exportation préservent la fidélité audio. Si des fichiers maîtres de haute qualité sont téléchargés, l'exportation doit maintenir ce niveau de fidélité.

Étapes facultatives après l'exportation : bien que les clips musicaux générés par IA puissent être publiés directement, vous pouvez ajouter quelques touches finales dans un éditeur vidéo : cartons de titre, sous-titres des paroles, logos d'artistes/labels, transitions entre les sections ou étalonnage des couleurs. Les outils courants tels que CapCut, DaVinci Resolve ou Premiere sont parfaitement adaptés à cette touche finale. Avant de publier sur Bilibili, n'oubliez pas d'ajouter des sous-titres et une image de couverture, car ils sont essentiels pour l'algorithme de recommandation de Bilibili.

Créez dès maintenant votre premier clip vidéo IA -->

8 principaux scénarios d'application de la vidéo musicale basée sur l'IA

La génération de clips musicaux par IA n'est pas une technologie à usage unique. La fusion de la création visuelle avec l'audio synchronisé ouvre des possibilités créatives dans divers types de contenus et secteurs d'activité. Vous trouverez ci-dessous huit scénarios d'application spécifiques, chacun accompagné de conseils opérationnels ciblés.

Huit scénarios d'application distincts pour la génération de clips musicaux par IA, chacun avec des styles visuels, des exigences audio et des publics cibles uniques. La même technologie de base s'adapte à des orientations créatives totalement différentes.

- Clip vidéo d'un musicien indépendant

Opportunité : Les musiciens indépendants sont depuis longtemps confrontés à une disparité douloureuse : l'écart entre la qualité musicale et le calibre du contenu visuel qui l'accompagne. Un producteur amateur peut créer des morceaux raffinés et prêts à être commercialisés sur un ordinateur portable, mais la production d'un clip vidéo correspondant coûte généralement entre 2 000 et 15 000 livres sterling. Même le tournage le plus basique représente une dépense importante. La génération de clips vidéo par IA a complètement éliminé cet obstacle financier.

Une valeur unique en Chine : la scène musicale indépendante nationale (hip-hop, électronique, traditionnelle chinoise, folk) s'est épanouie ces dernières années. Le nombre d'artistes indépendants sur NetEase Cloud Music et QQ Music ne cesse d'augmenter, mais la grande majorité de leurs œuvres ne proposent que de l'audio, sans clips vidéo. Sur la plateforme musicale Bilibili, les soumissions avec des visuels de haute qualité bénéficient d'une pondération de recommandation nettement plus élevée que celles qui ne proposent que des pistes audio et des pochettes statiques. Les clips vidéo générés par l'IA permettent à tous les musiciens indépendants de créer des œuvres visuelles.

Procédure : Téléchargez le morceau terminé sur Seedance en tant que référence audio. Composez des repères visuels qui capturent l'arc émotionnel de la chanson – pas une illustration scène par scène des paroles, mais des images qui évoquent les mêmes sentiments. La pop psychédélique se prête à des visuels doux, éthérés et flottants. Les compositions lo-fi s'accordent bien avec des scènes urbaines chaleureuses et nostalgiques. La musique électronique expérimentale convient aux visuels abstraits et surréalistes. La musique de style chinois complète les paysages à l'encre de Chine, l'architecture ancienne et les scènes de pétales tombants.

Meilleures pratiques pour les clips musicaux autonomes : lorsqu'une chanson comporte des sections distinctes, envisagez une production segmentée. Créez un style visuel pour les couplets, un autre pour le refrain et un troisième pour le pont. Assemblez-les ensuite à l'aide de transitions dans un logiciel de montage tel que ShineVideo ou DaVinci Resolve. Chaque section possède sa propre identité visuelle, tandis que la musique assure la continuité.

Attentes raisonnables : d'ici 2026, les clips musicaux générés par l'IA excelleront dans les directions visuelles stylisées, atmosphériques et abstraites. Ils seront moins efficaces pour les clips musicaux narratifs ou basés sur la performance qui nécessitent des acteurs spécifiques pour exécuter des mouvements chorégraphiés ou des tournages dans des lieux réels particuliers. Tirez parti des atouts de l'IA : atmosphère, surréalisme et poésie visuelle.

- Vidéos lyriques

Opportunités : les vidéos lyriques sont devenues un format de diffusion standard, souvent lancées avant ou en même temps que les clips officiels. Elles stimulent le streaming, répondent aux attentes des auditeurs intéressés par les paroles et constituent le premier point de contact visuel avec les nouveaux morceaux. La production traditionnelle de vidéos lyriques nécessite la conception de graphiques animés, l'animation de texte et des visuels d'arrière-plan. L'IA simplifie ce processus en le réduisant à des invites et des superpositions de texte.

Procédure : générez des boucles visuelles atmosphériques qui correspondent à l'ambiance de la chanson. Après l'exportation, ajoutez des superpositions de paroles dans ShineVideo, After Effects ou Canva Video. L'IA s'occupe de l'arrière-plan visuel, vous vous occupez de la typographie.

Meilleure pratique : utilisez des mouvements de caméra lents et fluides qui ne détournent pas l'attention du texte. Évitez les scènes visuellement encombrées : les paroles doivent rester clairement lisibles sur le fond. Créez des visuels en utilisant une palette de couleurs qui offre un bon contraste avec la couleur du texte que vous avez choisie. Lorsque vous publiez des vidéos de paroles sur Bilibili et NetEase Cloud Music, n'oubliez pas de synchroniser les téléchargements sur les plateformes musicales correspondantes afin d'obtenir une double exposition.

- Vidéos musicales en arrière-plan sur Bilibili/YouTube

Opportunités : « Musique lo-fi pour étudier », « Bruits de pluie pour dormir », « Musique de méditation » : les chaînes Bilibili et YouTube ont généré un nombre considérable de vues grâce à une formule simple : un son de qualité associé à une boucle visuelle. Certaines des plus grandes chaînes musicales de YouTube sont entièrement basées sur ce modèle. Les sections « Livestreams d'étude » et « Bruit blanc » de Bilibili sont tout aussi populaires. L'IA a rendu la création simultanée de contenu audio et visuel remarquablement simple.

Méthode : générez une scène visuelle en boucle : une pièce confortable avec de la pluie qui tombe derrière la fenêtre, une ville illuminée la nuit et un personnage animé assis à un bureau. Accompagnez-la d'une musique lo-fi ou ambiante générée par l'IA. Pour l'optimisation YouTube, exportez dans un format 16:9 avec une résolution minimale de 1080p, en intégrant des mots-clés pertinents dans le titre, la description et les balises. Pour Bilibili, ajoutez des balises telles que « apprentissage », « bruit blanc » ou « aide au sommeil », et sélectionnez la catégorie appropriée pour la soumission.

Modèle de revenus : les chaînes YouTube les plus populaires peuvent gagner entre 5 000 et 50 000 dollars par mois (environ 3 600 à 36 000 livres sterling) uniquement grâce aux revenus publicitaires. Si les incitations financières offertes aux créateurs par Bilibili sont relativement modestes, la monétisation est possible grâce aux frais d'adhésion premium, au partage des revenus des conférences et aux placements publicitaires. La clé réside dans la régularité des mises à jour : des publications régulières et la constitution d'une bibliothèque de contenus permettent à l'algorithme de fonctionner efficacement. Le contenu généré par l'IA permet à un seul créateur de maintenir un rythme de publication quotidien.

4. TikTok/Kuaishou/Xiaohongshu Vidéos musicales courtes

Opportunités : TikTok, Kuaishou, Xiaohongshu, Instagram Reels, TikTok et YouTube Shorts accordent tous une grande importance aux contenus vidéo accompagnés de musique. Les publications avec audio génèrent systématiquement un engagement nettement plus élevé que les publications sans son ou uniquement textuelles. Pour les marques et les créateurs, produire régulièrement des contenus vidéo courts avec bande-son relève d'un marathon incessant. L'IA réduit les cycles de production de plusieurs heures à quelques minutes seulement.

Mode de fonctionnement : générez une vidéo verticale (9:16) de 5 à 15 secondes et activez le mode bande sonore. L'IA produira simultanément les visuels et la musique correspondante. Si vous souhaitez utiliser de la musique populaire provenant de la plateforme, générez d'abord les visuels, puis ajoutez une musique de fond tendance dans l'éditeur natif TikTok/Kuaishou. Si vous souhaitez un son original, laissez l'IA réaliser l'ensemble du projet.

Recommandations pour les plateformes nationales de vidéos courtes :

- Douyin : les 1 à 2 premières secondes doivent comporter un élément visuel accrocheur. Utilisez des mots qui ont un impact visuel immédiat : révélations dramatiques, couleurs vives ou mouvements inattendus. Douyin est configuré par défaut pour activer le son, la qualité audio est donc cruciale dès la première image.

- Kuaishou : Kelin (développé par Kuaishou) s'intègre naturellement à l'écosystème Kuaishou. Si Kuaishou est votre plateforme principale, envisagez un flux de travail combiné : générez des visuels dans Kelin et ajoutez de l'audio dans Seedance.

- Xiaohongshu : les vidéos verticales 9:16 accompagnées d'une musique d'ambiance fonctionnent particulièrement bien sur Xiaohongshu. Les contenus vidéo musicaux artistiques, thérapeutiques et axés sur l'ASMR s'alignent particulièrement bien avec la base d'utilisateurs de Xiaohongshu.

- Visualisation du podcast

** Opportunité : les créateurs de podcasts sont confrontés à un défi en matière de distribution. Leur contenu est purement audio, mais les plateformes grand public (Bilibili, YouTube, Douyin, Xiaohongshu) donnent la priorité à la vidéo. La « visualisation de podcasts », c'est-à-dire la représentation visuelle dynamique du contenu audio, résout ce problème en donnant au matériel audio une forme visuelle adaptée aux plateformes vidéo. La visualisation traditionnelle des podcasts nécessite des logiciels d'animation graphique et des compétences en conception. L'IA génère automatiquement ces éléments.

Mode de fonctionnement : téléchargez votre clip audio podcast sur Seedance. L'IA génère des visuels dynamiques en réponse à l'audio : l'intensité, le rythme et les changements de tonalité de la voix produisent des changements visuels correspondants. Vous pouvez également composer une invite visuelle représentant le thème de votre podcast, et l'IA générera une boucle visuelle atmosphérique pour accompagner l'audio.

Stratégie Bilibili : Bilibili s'est imposé comme l'une des plus grandes plateformes de vidéos longues en Chine, où de nombreux podcasteurs de renom publient désormais des versions vidéo de leur contenu. Un accompagnement visuel généré par l'IA transforme les podcasts audio purs en vidéos compatibles avec Bilibili avec un minimum d'effort. Même de simples boucles visuelles fonctionnent nettement mieux pour l'algorithme de recommandation de Bilibili qu'une vignette statique.

- Bande sonore publicitaire du produit

Opportunité : les vidéos de produits accompagnées d'une musique adaptée obtiennent des taux de conversion nettement supérieurs à ceux des vidéos de produits sans son. Cependant, l'obtention d'une licence pour l'utilisation commerciale d'une musique coûte entre 500 et 5 000 RMB par morceau, tandis que la commande de compositions personnalisées auprès de compositeurs s'avère encore plus coûteuse. Les bandes sonores générées par l'IA éliminent à la fois les coûts et les complexités liées aux droits d'auteur : la musique générée est originale et utilisable à des fins commerciales.

Procédure : générez du contenu visuel en suivant le workflow vidéo produit, puis activez le mode bande-son pour ajouter une musique adaptée. Pour les présentations de produits haut de gamme, générez une musique orchestrale ou ambiante cinématographique. Pour les lancements de produits dynamiques, générez une musique électronique énergique. L'IA adapte automatiquement l'énergie musicale au contenu visuel.

Avantage en matière de droits d'auteur : l'un des principaux avantages de la musique générée par l'IA de Seedance est que le résultat est original et n'est pas échantillonné à partir de morceaux existants protégés par des droits d'auteur. Cela élimine le risque de plaintes pour violation des droits d'auteur liées à l'utilisation de musique reconnaissable dans les publicités. Dans le cadre du forfait payant, vous conservez les droits d'utilisation commerciale du résultat généré, ce qui vous permet de l'utiliser dans des publicités sans frais supplémentaires liés aux droits d'auteur. Lorsque vous publiez des vidéos de produits sur des plateformes de commerce électronique telles que Taobao, JD.com et Douyin Shop, vous n'avez donc pas à vous soucier du retrait de contenu pour cause de violation des droits d'auteur sur la musique.

- Bandes-annonces de jeux et d'applications

Opportunité : les bandes-annonces de jeux et les vidéos de présentation d'applications reposent largement sur la synchronisation audiovisuelle. Les pauses dramatiques avant l'apparition du boss, la progression par étapes du compte à rebours, les sons percutants des compétences puissantes : tous ces moments se situent à la croisée du son et de l'image. Les bandes-annonces générées par l'IA permettent aux développeurs de jeux indépendants et aux créateurs d'applications d'atteindre une qualité de production équivalente à celle des studios AAA.

Mode de fonctionnement : réglez le mode de bande sonore sur « Cinématographique » ou « Drame » pour générer des séquences visuelles spectaculaires et dynamiques. Rédigez des invites décrivant l'action, l'impact et le spectacle visuel. Téléchargez des captures d'écran du jeu ou des illustrations conceptuelles comme images de référence afin de maintenir la cohérence visuelle avec le produit réel. Superposez des éléments d'interface utilisateur, des séquences de gameplay et des annotations textuelles pendant la post-production.

Focus audio : les bandes-annonces de jeux vidéo représentent l'une des applications les plus critiques en matière de qualité audio. La bande-son doit créer une tension progressive, atteindre son apogée au moment opportun et se terminer de manière satisfaisante. Si la composition initiale de l'IA ne correspond pas au rythme de votre bande-annonce, régénérez-la ou utilisez des outils musicaux IA autonomes pour créer un morceau sur mesure, puis importez-le comme référence audio. Lorsque vous publiez des bandes-annonces de jeux sur des plateformes telles que TapTap, la section jeux de Bilibili ou WeGame, une synchronisation audiovisuelle de haute qualité est primordiale pour capter l'attention des utilisateurs.

8. Bande-annonce des moments forts du mariage et de l'événement

Opportunité : les vidéos d'événements personnels (mariages, remises de diplômes, anniversaires, fêtes) représentent les contenus vidéo les plus émouvants créés par les utilisateurs. Le coût d'une vidéographie professionnelle pour un événement varie généralement entre 500 et 3 000 £ au Royaume-Uni. Beaucoup possèdent des centaines de photos d'événements, mais ne disposent pas de séquences vidéo. L'IA peut transformer ces images en bandes-annonces cinématographiques accompagnées d'une musique évocatrice, créant ainsi des résultats de qualité professionnelle à partir de photos prises avec un téléphone portable.

Méthode : sélectionnez vos 10 à 20 meilleures photos de l'événement. Utilisez les fonctionnalités d'image-vidéo de Seedance pour insuffler à chaque image un mouvement subtil : zooms délicats, déplacements doux de l'objectif et effets de lumière changeants. Activez le mode bande sonore et décrivez l'ambiance émotionnelle que vous souhaitez créer : « chaleureuse, émouvante, guitare acoustique et piano, ambiance première danse de mariage ». L'IA générera une vidéo pour chaque clip avec une musique assortie. Assemblez-les pour créer un montage complet à l'aide de l'application d'édition.

Pourquoi cela fonctionne si bien : les photos d'événements ont intrinsèquement une forte charge émotionnelle pour les personnes qui y figurent. L'ajout d'un léger mouvement leur donne vie. Associées à une musique émouvante, elles atteignent une qualité cinématographique. Cette combinaison transforme les diaporamas photo en quelque chose qui ressemble à un véritable film, pour un coût quasi nul par rapport à l'embauche d'un vidéaste après l'événement. Le partage de telles compilations sur WeChat Moments ou TikTok donne de bien meilleurs résultats que de simples mises en page de photos en neuf cases.

Modèle de prompt pour vidéo musicale générée par IA

Les cinq modèles de prompts suivants sont conçus pour des styles spécifiques de clips musicaux. Chaque ensemble comprend des prompts visuels, des styles audio recommandés et des paramètres de génération. Copiez-les et utilisez-les directement, en les ajustant si nécessaire pour des projets spécifiques.

Remarque : tous les mots-clés sont conservés dans leur version originale anglaise, car la compréhension des mots-clés anglais par Seedance est la plus stable. Chaque modèle est accompagné de notes explicatives en chinois.

Modèle n° 1 : Clip vidéo cinématographique

Indice visuel :

A silhouette walking through neon rain on a deserted downtown street

at midnight. Puddles on the asphalt reflect towering LED billboards

in magenta, cyan, and gold. Steam rises from a subway grate, curling

through the neon light. The camera tracks slowly behind the figure,

maintaining a medium-wide shot. Rain streaks catch the colored light

like falling sparks. The figure pauses at a crosswalk, head tilted

upward toward the glowing signs. Cinematic anamorphic lens with

horizontal flares. Blade Runner atmosphere. Moody, contemplative,

visually rich. 4K ultra-realistic.Minuit. Une silhouette traverse les rues désertes du centre-ville sous une pluie de néons. Les flaques d'eau sur l'asphalte reflètent les immenses panneaux publicitaires LED aux couleurs magenta, cyan et or. De la vapeur s'échappe des bouches d'aération du métro, tourbillonnant dans la lueur des néons. La caméra suit lentement la silhouette depuis derrière. Objectif anamorphique, atmosphère à la Blade Runner.

Style audio recommandé : synthwave cinématographique ou musique électronique ambiante. Basses pulsées sombres superposées à des nappes de synthé éthérées. Tempo lent (70-85 BPM). Évoque l'ambiance de Vangelis rencontre M83.

Paramètres : format 16:9. Durée de 10 secondes. Mode bande sonore activé. Résolution maximale disponible.

Scénarios adaptés : clips musicaux atmosphériques pour la musique électronique, synth-pop ou indie. Également applicable aux courts métrages cinématographiques d'ambiance et aux vidéos d'image de marque. Particulièrement adapté à la section musicale de Bilibili et au contenu musical électronique.

Modèle n° 2 : Lo-fi rêveur

Indice visuel :

Soft pastel clouds drifting over a quiet city at twilight, seen

through the rain-speckled window of a cozy apartment. A desk lamp

casts warm amber light over a cluttered workspace with vinyl records,

a steaming mug, and scattered handwritten notes. Raindrops trace

slow paths down the window glass. The city lights beyond are soft,

blurred circles of warm white and gentle orange. Camera holds a

static medium shot with extremely shallow depth of field focused on

the raindrops. The background city breathes with gentle, slow

ambient motion. Warm, nostalgic, intimate. Film grain. 24fps

cinematic quality.Au crépuscule, de doux nuages pastel dérivent au-dessus de la ville tranquille, visibles à travers les fenêtres striées de pluie d'un appartement confortable. Une lampe de bureau diffuse une lumière ambrée et chaleureuse, éclairant un établi recouvert de disques vinyles, une tasse fumante et des notes manuscrites éparpillées. Des gouttes de pluie coulent lentement le long de la vitre. Les lumières lointaines de la ville apparaissent comme des halos doux et flous, d'un blanc chaud et d'un orange pâle. Chaleur, nostalgie, intimité.*

Style audio recommandé : hip-hop lo-fi. Craquements de vinyle, accords de piano légèrement désaccordés, rythmes de grosse caisse et de caisse claire doux, basse chaleureuse. Tempo : 70-80 BPM. Esthétique Chillhop Records.

Paramètres : format 16:9 ou 1:1. Durée de 10 secondes (conçu pour être lu en boucle). Mode bande sonore : lo-fi/ambient. Idéal pour les livestreams lo-fi sur Bilibili et YouTube lorsqu'il est lu en boucle.

Scénarios adaptés : chaînes musicales lo-fi, contenus destinés à l'étude, à la concentration ou à l'aide au sommeil, visuels de playlists relaxantes et publications atmosphériques sur Xiaohongshu. Ce type de contenu jouit d'une grande popularité dans les catégories « livestreams d'étude » et « bruit blanc » de Bilibili.

Modèle trois : haute énergie

Indice visuel :

Fast-paced montage of urban sports and street culture. A skateboarder

launches off a concrete ledge in slow motion, wheels spinning, body

twisted mid-air. Quick cut to a BMX rider grinding a rail with

sparks flying. Cut to a basketball spinning on a fingertip against

a graffiti-covered wall. Each scene is lit by harsh, directional

afternoon sun creating sharp shadows. Colors are high-contrast and

saturated: electric blue sky, warm concrete orange, vivid graffiti

greens and pinks. Dynamic handheld camera with intentional shake.

Rapid scene transitions. 120fps slow-motion bursts within fast

editing. GoPro meets professional sports broadcast. 4K ultra-sharp.Interprétation chinoise : Montage rapide sur les sports urbains et la culture de rue. Plans au ralenti de skateurs s'élançant depuis des marches en béton, roues tournantes, corps virevoltant dans les airs. Coups rapides sur des cyclistes BMX effectuant des grinds sur des rails, étincelles volant dans tous les sens. Plan sur un ballon de basket tournant sur le bout des doigts devant un mur couvert de graffitis. Couleurs saturées à fort contraste. Travail dynamique à la caméra à l'épaule, transitions rapides entre les scènes.

Style audio recommandé : hip-hop énergique ou musique électronique. Basses 808 puissantes, charlestons trap, synthés agressifs. Tempo : 130-150 BPM. Style de production Travis Scott. Les styles de rap nationaux conviennent également très bien.

Paramètres : 9:16 (TikTok/Kuaishou/Reels) ou 16:9 (Bilibili/YouTube). Durée : 5 à 10 secondes. Activez le mode SFX pour les sons d'impact. Superposez une bande-son énergique.

Scénarios adaptés : contenu lié aux marques sportives, publicités pour les boissons énergisantes, chaînes consacrées aux sports extrêmes et contenu flashy/teaser sur les réseaux sociaux. Fonctionne particulièrement bien sous les hashtags « sport » et « tendances » de TikTok.

Modèle quatre : chanson lyrique

Indice visuel :

A single candle flickering in darkness on a weathered wooden table.

The flame casts warm, dancing golden light across the surface,

illuminating the grain and scratches in the old wood. A person's

hand slowly enters frame from the right, fingers gently hovering

near the flame without touching it. The hand trembles slightly. The

background is pure darkness with the faintest suggestion of a

window. The camera executes an imperceptibly slow push-in toward

the flame. Extreme shallow depth of field. The flame is razor-sharp

while even the fingertips soften into bokeh. Warm amber and deep

shadow color palette. Intimate, vulnerable, deeply human. 4K

photorealistic. 24fps film cadence.Description en anglais : Une seule bougie vacille sur une table en bois patinée par le temps dans l'obscurité. La flamme projette une lueur dorée, chaude et dansante, sur le plateau de la table, illuminant les veines et les rayures du bois vieilli. Une main entre lentement dans le cadre par la droite, les doigts flottant doucement à côté de la flamme sans la toucher. La main tremble très légèrement. Profondeur de champ extrêmement faible. La flamme est nettement définie, tandis que le bout des doigts s'estompe dans un flou. Une palette de couleurs aux tons ambrés chauds et aux ombres profondes. Intimité, fragilité, profonde humanité.

Style audio recommandé : ballades au piano ou guitare acoustique accompagnées d'un subtil accompagnement de cordes. Tonalités mineures. Tempo extrêmement lent (55-65 BPM). Production rappelant Adele ou Bon Iver. Arrangements épurés où l'espace et le silence deviennent eux-mêmes des éléments musicaux. Les compositions de style folk chinois conviendraient également parfaitement.

Paramètres : format 16:9. Durée : 10 secondes. Mode bande sonore : émotionnel/original. Résolution maximale disponible. Ce modèle est conçu pour créer un impact émotionnel, et non pour offrir un spectacle visuel.

Scénarios adaptés : clips musicaux de ballades, films commémoratifs/hommages, scènes cinématographiques dramatiques, récits émotionnels de marques et visuels de séries acoustiques. Dans les catégories folk/chansons d'amour sur NetEase Cloud Music et QQ Music, ce style visuel correspond parfaitement aux attentes du public.

Modèle n° 5 : Vintage/Rétro

Indice visuel :

VHS-style footage of a summer road trip along a coastal highway.

A vintage convertible with sun-faded red paint cruises along a

winding cliffside road above a sparkling ocean. The driver's arm

hangs out the window, hand surfing the wind. Palm trees line the

inland side of the road. The footage has authentic VHS artifacts:

horizontal tracking lines, slight color bleeding at edges, warm

oversaturated hues shifted toward orange and teal, subtle scan-line

texture, and occasional tracking glitches. Shot from a following car

at the same speed, steady tracking shot. Late afternoon golden light.

The ocean glitters intensely in the background. Nostalgic, carefree,

endless summer. 480p upscaled aesthetic, 4:3 aspect ratio within a

16:9 frame with black side bars.Séquence vidéo de type VHS d'un road trip estival sur la côte. Une décapotable vintage à la peinture rouge délavée roule sur une route au sommet d'une falaise, avec l'océan scintillant en contrebas. Le bras du conducteur passe par la fenêtre, la main surfant sur le vent. Les images présentent des artefacts VHS authentiques : lignes de suivi horizontales, légères bavures de couleur sur les bords et tons chauds sursaturés tirant vers l'orange et le cyan. Nostalgique, insouciant, éternel été.

Style audio recommandé : surf rock indépendant ou dream pop. Guitares saturées de réverbération, lignes de basse entraînantes, tambourin clair. Tempo : 110-120 BPM. Imaginez une rencontre entre les Beach Boys et Tame Impala. Vous pouvez également opter pour une direction plus électronique avec des synthés vaporwave/rétro. La pop rétro chinoise (telle que la City Pop) conviendrait également parfaitement.

Paramètres : format 16:9 (intégrant l'esthétique VHS 4:3). Durée de 10 secondes. Mode bande sonore : rétro/indie. Ce modèle adopte délibérément une esthétique visuelle lo-fi. Ne générez pas à la résolution maximale puis n'appliquez pas d'effets VHS ; laissez plutôt l'IA créer naturellement le look vintage.

Scénarios adaptés : clips musicaux nostalgiques/rétro, visuels pour playlists estivales, contenu de marque d'inspiration vintage, séquences de films sur le passage à l'âge adulte et contenu de style rétro sur Xiaohongshu. L'esthétique vintage reste très populaire parmi les jeunes créateurs chinois, avec un volume important de contenu tagué « film-like » (cinématographique) et « rétro » apparaissant sur Xiaohongshu et Bilibili.

Comparaison des meilleurs outils de création de vidéos musicales basés sur l'IA

Tous les générateurs de vidéos IA ne possèdent pas de fonctionnalités audio, et parmi ceux qui en ont, les fonctionnalités varient considérablement. Vous trouverez ci-dessous une comparaison directe de tous les outils pertinents pour la production de clips musicaux en février 2026.

Le paysage audiovisuel en 2026. Seedance 2.0 est en tête en termes de fonctionnalités, tandis que chaque concurrent possède des atouts spécifiques. Le choix approprié dépend de votre scénario d'utilisation principal.

Tableau comparatif

| Outil | Génération sonore | Bande sonore | Synchronisation labiale | Meilleure qualité vidéo | Idéal pour | Prix de départ | Disponible en Chine | |------|:---:|:---:|:---:|---|-- -|---|:---:| | Seedance 2.0 | Pris en charge | Pris en charge | Pris en charge (8 langues) | 2K, 2 minutes max. | Production MV complète | Version gratuite disponible | Directement utilisable | | Google Veo 3 | Prise en charge | Partielle | Non prise en charge | 1080p | Scènes audio ambiantes | Via les outils d'IA de Google | VPN requis | | Pika 2.0 | Basique | Non pris en charge | Non pris en charge | 1080p | Ajout d'effets sonores simples | Version gratuite disponible | VPN requis | | Kaiber | Non pris en charge | Non pris en charge (avec audio téléchargé) | Non pris en charge | 1080p | Visualisation musicale pour les morceaux téléchargés | Environ 10 $/mois (environ 7,20 £) | VPN requis | | Suno + Seedance | Via Seedance | Via Suno | Via Seedance | 2K (Seedance) | Meilleure combinaison musique IA + vidéo IA | Suno gratuit + Seedance gratuit | Seedance directement disponible | | SkyMusic + Seedance | Via Seedance | Via SkyMusic | Via Seedance | 2K (Seedance) | Meilleure combinaison chinoise de musique et vidéo IA entièrement en chinois | SkyMusic gratuit + Seedance gratuit | Entièrement accessible en Chine |

Seedance 2.0 : la solution audiovisuelle la plus complète

Seedance est la seule plateforme qui prend en charge les trois types de génération audiovisuelle (effets sonores, musique de fond et synchronisation labiale) dans un seul outil. Pour les créateurs de clips musicaux, cela signifie que vous pouvez générer des visuels atmosphériques avec des paysages sonores ambiants, ajouter des accompagnements musicaux assortis et synchroniser les performances vocales avec les lèvres des personnages, le tout sans quitter la plateforme.

Principales caractéristiques de la production MV :

- Trois modes audio (effets sonores, musique, voix) sélectionnables par génération

- 8 langues avec synchronisation labiale (y compris le chinois), prenant en charge la distribution multilingue de MV

- Entrée de référence audio : téléchargez votre morceau pour générer des visuels synchronisés avec la musique

- Plusieurs formats d'image, y compris 9:16 pour les contenus MV courts

- Durée maximale de génération de 2 minutes, couvrant des segments de chanson entiers

- Conversion d'image en vidéo : animez des pochettes d'album ou des concepts statiques

Avantages exclusifs pour les utilisateurs nationaux :

- Développé par ByteDance, accessible directement en Chine sans VPN

- Prend en charge Alipay/WeChat Pay, aucune barrière pour les mises à niveau payantes

- La synchronisation labiale chinoise est essentielle pour la création de clips musicaux nationaux

- Toutes les fonctionnalités sont disponibles dans la version gratuite

Positionnement : Seedance est la solution intégrée ultime pour les créateurs qui souhaitent réaliser l'intégralité de leur production de clips musicaux à l'aide d'un seul outil. Sa combinaison d'images de haute qualité et de fonctionnalités audio complètes reste inégalée.

Créez dès maintenant votre clip vidéo avec Seedance 2.0 -->

Google Veo 3 : un son puissant et naturel

Veo 3 génère des vidéos avec un son natif, intégrant des bruits ambiants, des bruits atmosphériques et un certain accompagnement musical. La qualité audio est impressionnante : les données d'entraînement et l'échelle du modèle de Google produisent un paysage sonore riche et nuancé. Les scènes de plage sonnent vraiment comme des plages, avec des vagues à la bonne distance, un vent à la bonne intensité et des cris d'oiseaux marins à des intervalles plausibles.

Avantage : Fidélité audio environnementale. Veo 3 offre les paysages sonores les plus authentiques de sa catégorie.

Limites dans la production de clips musicaux : Veo 3 ne dispose pas du contrôle audio granulaire offert par Seedance. Vous ne pouvez pas choisir entre les modes effets sonores/musique/voix, il n'y a pas de fonctionnalité de synchronisation labiale et vous ne pouvez pas télécharger vos propres pistes audio comme référence. Pour la production de clips musicaux, ce manque de flexibilité limite Veo 3 à des vidéos d'ambiance/environnementales accompagnées d'audio, plutôt qu'à la création de clips musicaux structurés. De plus, l'accès depuis le territoire national nécessite un VPN, ce qui représente un obstacle supplémentaire. Pour une comparaison détaillée des fonctionnalités, veuillez vous référer à Seedance vs Veo 3 In-Depth Comparison.

Pika 2.0 : Effets sonores de base

La fonctionnalité Effets sonores de Pika ajoute des sons ambiants aux vidéos générées. Il s'agit d'un ajout utile à ce qui était auparavant un outil purement visuel, même si ses capacités restent limitées par rapport à Seedance et Veo 3. La génération d'effets sonores couvre les sons environnementaux de base (bruits de pas, bruits d'eau, bruits de vent, impacts simples), mais ne permet pas de générer de musique ni de synchroniser les lèvres.

Avantages : ajoute des effets sonores simples à de courts clips. Si vous avez besoin d'une scène de pluie de cinq secondes avec des sons de pluie correspondants, Pika peut s'en charger.

Limitations : pas de génération musicale, pas de synchronisation labiale et pas de prise en charge du téléchargement de références audio. Pour la production de clips musicaux, Pika seul ne suffit pas : il doit être associé à des outils audio externes pour obtenir un résultat optimal. Nécessite un VPN.

Kaiber : spécialiste en visualisation musicale

Kaiber utilise une approche différente des autres outils de cette liste. Plutôt que de générer de l'audio à partir d'une vidéo, il crée une vidéo à partir d'un fichier audio. Vous téléchargez un morceau de musique, et Kaiber génère des animations visuelles abstraites et stylisées qui réagissent au contenu musical : des images qui pulsent au rythme de la musique, des couleurs qui changent en fonction des variations harmoniques et une intensité qui correspond au volume.

Avantages : Visualisation abstraite de la musique. Si votre objectif est de créer des visuels psychédéliques, abstraits et réactifs au rythme pour un morceau de musique électronique, Kaiber est fait sur mesure pour cela.

Limitations : Kaiber ne génère pas de son — il nécessite le téléchargement de fichiers audio. Le rendu vidéo est très stylisé (abstrait/artistique) plutôt que photoréaliste. Il ne peut pas créer de scènes narratives, de personnages ou d'environnements réalistes. Pour la production complète de clips musicaux nécessitant des visuels authentiques, Kaiber est un outil de niche plutôt qu'une solution complète. Nécessite un VPN.

Collaboration entre Suno / SkyMusic et Seedance : l'essence de deux mondes

Pour les créateurs qui souhaitent contrôler au maximum les aspects musicaux et visuels de leur travail, le flux de travail le plus performant consiste à associer un générateur de musique IA professionnel à un générateur de vidéo IA professionnel.

Programmation de l'édition internationale -- Suno + Seedance :

- Créez votre morceau dans Suno : décrivez le genre, l'ambiance, le tempo et l'arrangement. Suno produit des morceaux de musique complets et de haute qualité, en incorporant des voix si nécessaire.

- Téléchargez le morceau sur Seedance en tant que référence audio : Le générateur vidéo IA crée des visuels qui réagissent à la structure musicale : les scènes s'intensifient pendant les crescendos musicaux et s'apaisent pendant les passages plus calmes.

- Utilisez la génération de synchronisation labiale si nécessaire : si le morceau Suno comprend des voix et que vous souhaitez que les personnages chantent, utilisez le mode de synchronisation labiale de Seedance pour faire correspondre les mouvements de la bouche à la piste vocale.

Pack édition nationale -- SkyMusic + Seedance :

Cette combinaison offre aux créateurs chinois le flux de travail de bout en bout le plus fluide pour la création de clips musicaux basés sur l'IA. Les deux plateformes sont directement accessibles depuis la Chine, sans nécessiter de VPN.

- Générez votre morceau dans SkyMusic : SkyMusic excelle particulièrement dans la génération de paroles chinoises et prend en charge divers genres musicaux chinois, notamment le rap, la pop et les styles d'inspiration classique.

- Téléchargez votre morceau sur Seedance en tant que référence audio : Seedance génère des visuels correspondants en fonction du contenu musical.

- Synchronisation labiale en chinois : utilisez la fonctionnalité de synchronisation labiale en chinois de Seedance pour que les personnages interprètent vos paroles chinoises avec précision.

L'avantage de ce flux de travail est que vous bénéficiez de la qualité musicale d'une IA musicale professionnelle combinée aux capacités visuelles et de synchronisation d'une IA vidéo professionnelle. Le compromis est un flux de travail à deux outils plutôt qu'une solution à outil unique. Pour les créateurs qui recherchent des résultats de qualité professionnelle, cette étape supplémentaire en vaut largement la peine.

Avancé : techniques pour obtenir une synchronisation labiale précise

Une fois que vous maîtriserez le flux de travail fondamental, les techniques avancées suivantes vous aideront à atteindre un niveau de coordination audiovisuelle dans vos clips musicaux qui marque la différence entre un travail professionnel et amateur.

La synchronisation avancée ne consiste pas simplement à générer simultanément l'audio et la vidéo. Elle implique d'aligner consciemment le rythme visuel, l'ambiance et la structure avec la composition musicale afin d'obtenir une expérience audiovisuelle homogène.

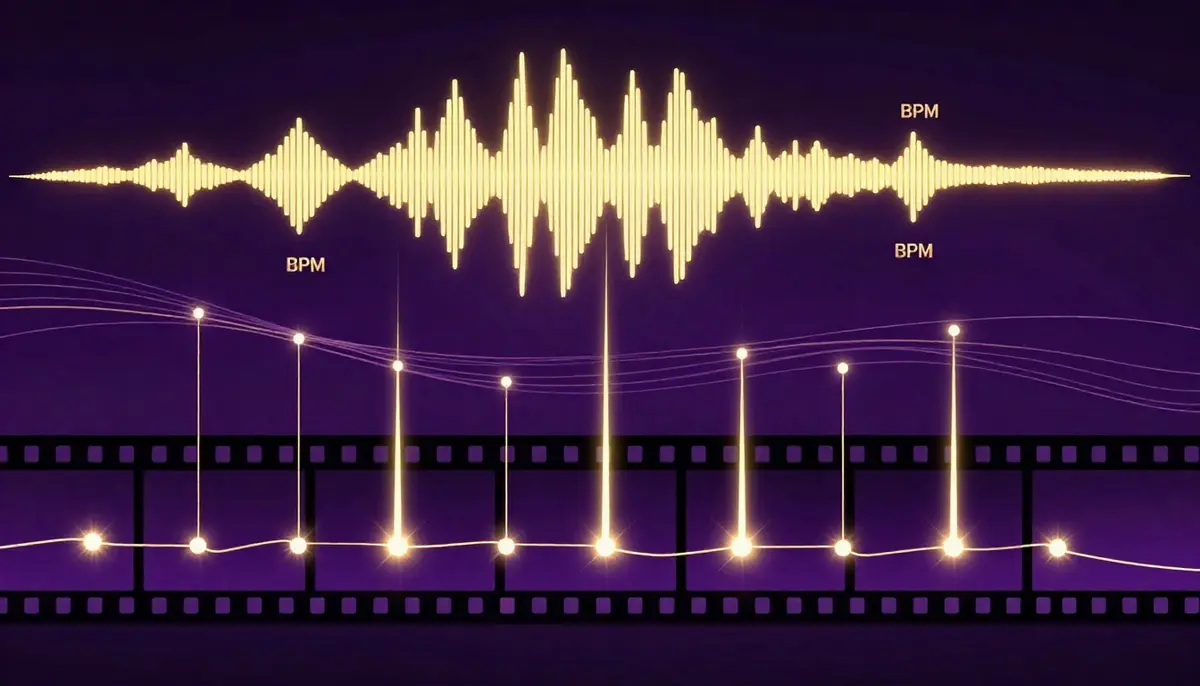

Correspondance BPM : aligner le rythme visuel sur le tempo musical

Le BPM (battements par minute) est le rythme cardiaque de tout morceau musical. Lorsque votre contenu visuel évolue en synchronisation avec le rythme de la musique, l'effet produit est délibéré et professionnel. Lorsque les deux ne sont pas synchronisés, on a l'impression que deux éléments sans rapport l'un avec l'autre sont joués simultanément.

Comment obtenir une correspondance BPM :

- Déterminez le BPM de votre morceau : la plupart des DAW (Ableton, Logic, FL Studio) affichent automatiquement le BPM. Les outils de détection de BPM en ligne sont tout aussi efficaces. Plages courantes : lo-fi (70-85 BPM), pop (100-130 BPM), EDM (120-150 BPM), drum and bass (160-180 BPM).

- Traduisez le BPM en vitesse de mouvement visuel : à 120 BPM, il y a exactement deux battements par seconde. Les mouvements de caméra, les transitions de scène et les coupes visuelles qui se produisent toutes les demi-secondes donneront l'impression d'être synchronisés avec le rythme.

- Utiliser un langage suggestif du rythme : pour les morceaux à 130 BPM, utilisez des termes tels que « rapide », « énergique », « transitions dynamiques ». Pour les morceaux à 70 BPM, optez pour « lent », « fluide », « dérive douce ». L'IA interprète ces indications rythmiques et ajuste le tempo visuel en conséquence.

- Réglage fin en post-production : si le rythme visuel de l'IA est proche mais pas parfaitement synchronisé avec le rythme, effectuez des ajustements dans votre éditeur vidéo. Accélérez ou ralentissez les segments de 5 à 10 % pour aligner les événements visuels sur les marqueurs de rythme. Ce réglage fin fait une différence visible. ShineVideo et DaVinci Resolve prennent tous deux en charge ces ajustements de vitesse précis.

Synchronisation émotionnelle : passages musicaux associés à des ambiances visuelles

Les clips musicaux professionnels ne présentent pas une esthétique visuelle uniforme tout au long de la vidéo. Ils changent d'ambiance pour s'aligner sur l'évolution émotionnelle de la chanson. La génération par IA vous permet de créer ces transitions en générant des segments distincts à l'aide de différentes invites visuelles.

La transposition de la structure musicale en atmosphère visuelle :

| Section chanson | Caractéristiques musicales | Direction visuelle | |-------- -|---------|---------| | Intro | Éparse, progressive | Visuels minimalistes, tons sourds, ralenti. Établit l'atmosphère. | | Couplet | Narratif, énergie moyenne | Scènes axées sur l'histoire, tempo modéré, palette de couleurs chaudes ou neutres | | Pré-refrain | Progression en couches | Mouvements de caméra intensifiés, saturation des couleurs accentuée, complexité visuelle accrue | | Refrain | Énergie/émotion maximale | Visuels les plus dramatiques, couleurs les plus vives, plans dynamiques, spectacle visuel à grande échelle | | Pont | Transition/réflexion | Style visuel complètement distinct. Nouvelle palette de couleurs. Mouvement plus lent. | | Coda | Convergence, fondu | Retour au style visuel de l'intro avec un sentiment de résolution. Adoucissement. Fondu. |

Générez des invites distinctes pour chaque paragraphe individuellement, puis modifiez-les et assemblez-les. Cette approche segmentée donne un résultat plus dynamique qui complète mieux la musique par rapport à la génération d'un seul fragment long.

Génération par segment : créez des visuels distincts pour les sections refrain, couplet et pont.

S'appuyant sur le concept de synchronisation émotionnelle, la technique pratique de génération segmentée consiste à créer des segments vidéo IA indépendants pour chaque passage musical, qui sont ensuite assemblés dans l'éditeur de timeline.

Flux de travail :

- Analysez la structure de la chanson. Marquez les timestamps pour chaque section (Couplet 1 : 0:00-0:30, Refrain 1 : 0:30-0:55, Couplet 2 : 0:55-1:25, etc.)

- Écrivez des repères visuels uniques pour chaque section. Maintenez la continuité visuelle grâce à des descripteurs stylistiques cohérents (palettes de couleurs identiques, mots-clés visuels communs) tout en variant les scènes, les plans et les niveaux d'énergie

- Créez des clips distincts pour chaque section dans Seedance. Alignez la durée des clips sur le timing des sections

- Importez tous les clips dans un éditeur vidéo (ShineVideo, DaVinci Resolve, Premiere). Alignez chaque clip avec la section musicale correspondante.

- Ajoutez des transitions entre les sections : des fondus enchaînés pour des transitions fluides, des coupes nettes pour des changements dramatiques et des panoramiques rapides pour des transitions énergiques.

- Exportez la timeline assemblée comme votre clip vidéo final.

Cette méthode vous offre un contrôle optimal sur la relation entre le son et les images. Bien qu'elle implique une charge de travail plus importante que la génération en un seul passage, le résultat est nettement plus dynamique et mieux adapté à la musique.

Vidéo de référence : Utilisation des styles de clips musicaux existants comme source d'inspiration

Si vous appréciez le style visuel, les mouvements de caméra ou le rythme de montage d'un clip vidéo existant, vous pouvez l'utiliser comme référence pour guider la génération de l'IA.

Comment utiliser la référence MV :

- Sélectionnez un clip vidéo ou une vidéo qui incarne le style visuel que vous souhaitez.

- Téléchargez-le comme vidéo de référence dans Seedance.

- L'IA analyse les mouvements de caméra, la composition, la palette de couleurs, le rythme de montage et la dynamique des mouvements de la référence.

- Le résultat généré hérite de ces éléments stylistiques tout en créant un contenu entièrement original.

Cette technique s'avère particulièrement utile lorsque les clients ou les collaborateurs disent : « Je veux le style de cette vidéo ». Vous pouvez alors utiliser directement leur référence comme point de départ, plutôt que d'essayer de traduire leur vision en langage prompt.

Remarque importante : l'IA génère un contenu visuel original inspiré du style de référence. Elle ne reproduit pas la vidéo de référence. Le résultat est un contenu unique partageant des éléments stylistiques avec la référence.

Foire aux questions

L'IA peut-elle vraiment générer un clip vidéo complet ?

Certainement, mais il faut comprendre ce que signifie « complet » en 2026. L'IA peut générer des clips vidéo avec un son synchronisé (y compris des effets sonores, une musique de fond et des voix synchronisées) qui ont un aspect et un son professionnels. Pour les clips musicaux atmosphériques, stylisés ou abstraits d'une durée de 30 secondes à 2 minutes, les productions générées par l'IA peuvent en effet être diffusées directement. Pour les clips musicaux plus longs, axés sur le récit et nécessitant des acteurs spécifiques et une chorégraphie complexe, l'IA excelle dans la production de séquences brutes de haute qualité, même si elle bénéficie considérablement du montage, du séquençage et de la post-production humains. Cette technologie doit être considérée comme un outil de production prenant en charge 80 à 90 % de la charge de travail, plutôt que comme un substitut en un clic à toute une équipe de production.

Quel est le meilleur générateur de clips musicaux basé sur l'IA pour 2026 ?

Seedance 2.0 est le générateur de clips musicaux basé sur l'IA le plus complet de 2026. Il intègre de manière unique les trois fonctionnalités audiovisuelles essentielles dans un seul outil : la génération d'effets sonores, la création de bandes sonores par IA et la synchronisation labiale multilingue (dans huit langues, dont le chinois). Il est associé à une génération visuelle de haute qualité (résolution jusqu'à 2K, durée de 2 minutes). Les utilisateurs chinois bénéficient d'avantages supplémentaires : en tant que produit ByteDance, Seedance est directement accessible en Chine et prend en charge Alipay et WeChat Pay. Google Veo 3 excelle dans le domaine de l'audio ambiant, mais ne propose pas de synchronisation labiale et nécessite un VPN. Pika n'offre que des effets sonores basiques. Kaiber est spécialisé dans la visualisation musicale abstraite.

Faut-il avoir sa propre musique pour créer des clips vidéo IA ?