In breve

Text-to-Video AI è una tecnologia di intelligenza artificiale che genera automaticamente video a partire da descrizioni testuali. Basta inserire una descrizione e l'IA produce un videoclip con effetti di movimento, illuminazione e movimenti di camera. Entro il 2026, sfruttando l'architettura Diffusion Transformer (DiT), questa tecnologia si è evoluta da un prototipo sperimentale sfocato a una qualità quasi cinematografica. Questa guida copre i principi tecnici, un tutorial pratico in cinque fasi, dieci modelli di prompt replicabili, un'analisi comparativa di otto strumenti, sei principali scenari di applicazione e i limiti reali che è necessario comprendere.Prova gratuitamente la generazione di video da testo →

AI da testo a video: da una singola descrizione a filmati di qualità cinematografica, l'AI rende possibile la conversione da "testo a video".

Che cos'è l'IA text-to-video?

L'intelligenza artificiale text-to-video si riferisce a una categoria di tecnologia di intelligenza artificiale che genera automaticamente contenuti video da descrizioni testuali. Si descrive una scena (una donna che passeggia sotto la pioggia, un prodotto che ruota su un espositore, un drone che sorvola una catena montuosa) e il modello di intelligenza artificiale produce un video clip altamente realistico con movimenti naturali, illuminazione ed effetti fisici.

Il concetto di base è semplice: input di testo, output video. Tuttavia, la tecnologia sottostante è tutt'altro che semplice. I moderni sistemi di conversione da testo a video utilizzano reti neurali addestrate su miliardi di set di dati abbinati "video-testo", apprendendo le relazioni statistiche tra descrizioni linguistiche e movimento visivo. Quando si scrive "un gatto salta su un tavolo", il modello attinge alle sue conoscenze accumulate sui gatti, sulla fisica del salto, sulle superfici dei tavoli e sulla gravità per generare un video plausibile.

2026: dall'esperimento allo strumento di produttività

L'intelligenza artificiale text-to-video ha superato la soglia della capacità "pronta per la produzione" nel 2025-2026. I primi sistemi del 2022-2023 erano in grado di produrre solo frammenti fugaci, sfocati e fisicamente inverosimili. I modelli odierni, invece, generano video con risoluzione 2K, accuratezza fisica, movimenti naturali e qualità cinematografica, della durata di 5-15 secondi. Questo salto di qualità trasforma il text-to-video da una curiosità di ricerca a uno strumento pratico:

- Creatori di contenuti: ottenete B-roll, sequenze introduttive e risorse per i social media senza una telecamera

- Operatori di marketing: Produci in serie varianti di annunci pubblicitari e dimostrazioni di prodotti

- Educatori: Visualizza concetti astratti

- Piccole e medie imprese: Evita i costi elevati della produzione video professionale

- Chiunque: Se sai scrivere, puoi realizzare video

La soglia per la creazione di video si è abbassata da "possedere una videocamera e saperla usare" a "creare una descrizione accattivante".

Evoluzione tecnologica: da GAN a DiT

Comprendere la tecnologia alla base può aiutarti a creare prompt migliori e a selezionare strumenti più adatti. Di seguito è riportata l'evoluzione tecnologica in tre generazioni dell'IA text-to-video.

Tre generazioni di evoluzione tecnologica: GAN (2020-2022) → Modelli di diffusione (2023-2024) → Diffusion Transformers / DiT (2025-2026).

Prima generazione: l'era GAN (2020-2022)

Le reti generative avversarie (GAN) sono state la prima architettura a dimostrare la fattibilità della conversione da "testo a video". Due reti neurali vengono sottoposte a un addestramento avversario: il generatore crea fotogrammi video mentre il discriminatore ne valuta l'autenticità. Tuttavia, i risultati erano a bassa risoluzione (256×256), di breve durata (2-4 secondi) e fisicamente non plausibili. Gli oggetti subiscono deformazioni imprevedibili, i tratti del viso risultano distorti e la coerenza temporale è gravemente compromessa. Tra i risultati degni di nota figurano CogVideo e NUWA.

Seconda generazione: l'era dei modelli di diffusione (2023-2024)

Il modello di diffusione ha rivoluzionato il panorama. Non utilizza più l'addestramento antagonistico, ma apprende invece un processo di "denoising inverso", partendo dal rumore puro e denoising progressivo fino a ottenere un video coerente sotto la guida testuale. Questo approccio offre un salto di qualità: risoluzione più alta (fino a 1080p), durata più lunga (4-10 secondi) e migliore allineamento testo-immagine.

Sora di OpenAI (rilasciato nel febbraio 2024) dimostra che i modelli di diffusione possono generare video incredibilmente fotorealistici. Runway Gen-2/Gen-3, Pika e Stable Video Diffusion appartengono tutti a questa generazione.

Terza generazione: DiT — Trasformatore a diffusione (2025–2026)

Le architetture più avanzate attualmente combinano processi di diffusione con l'architettura Transformer (la stessa architettura alla base di GPT e BERT). I modelli DiT elaborano i video come una sequenza di patch spazio-temporali, ottenendo:

- Migliore coerenza temporale: i trasformatori eccellono nella modellazione delle dipendenze a lungo raggio tra i fotogrammi

- Maggiore risoluzione: Output nativo 2K (Seedance 2.0 raggiunge 2048×1080)

- Maggiore accuratezza fisica: Movimenti, gravità e fluidodinamica più realistici

- Migliore comprensione del testo: Allineamento significativamente migliorato tra le descrizioni dei prompt e gli output visivi

- Input multimodale: alcuni modelli DiT possono accettare contemporaneamente input di immagini, video e audio

Seedance 2.0, Google Veo 3 e Keeling 3.0 utilizzano tutti l'architettura DiT. Questo è il motivo per cui la generazione di video da testo nel 2026 presenta una differenza qualitativa rispetto a quella del 2024.

Da testo a video vs Da immagine a video

Questi due approcci sono complementari piuttosto che competitivi:

| Dimensione | Testo-video (T2V) | Immagine-video (I2V) | |------|------------------|----------------- -| | Input | Solo descrizione testuale | Fotografia + descrizione del movimento | | Libertà creativa | Massima — L'IA determina tutti gli elementi visivi | Limitata dall'immagine di origine | | Controllabilità | Minima — Dipende dall'accuratezza del prompt | Massima — Ancoraggi visivi disponibili | | Scenari adatti | Esplorazione di concetti, contenuti originali | Esposizione di prodotti, animazione di foto, abbinamento di stili | | Prevedibilità | Bassa — Lo stesso prompt produce risultati diversi ogni volta | Alta — Il risultato corrisponde sempre all'immagine di origine |

La maggior parte dei flussi di lavoro professionali utilizza entrambi gli approcci: prima si impiega il T2V per esplorare concetti creativi, poi si perfeziona il risultato con l'I2V per un controllo preciso. Per un'analisi dettagliata della generazione di immagini in video, consulta la nostra Guida completa all'intelligenza artificiale per la conversione da immagine a video.

Tutorial in 5 passaggi: Creare il tuo primo video AI

Quella che segue è una guida passo passo alla creazione di contenuti testuali-video partendo da zero, utilizzando Seedance 2.0 come piattaforma dimostrativa. I principi di base sono applicabili a qualsiasi strumento.

Dalla creazione immediata al risultato finale: cinque passaggi per completare il tuo primo video AI.

Passaggio 1: definire gli obiettivi del video

Prima di scrivere il prompt, stabilisci innanzitutto:

- Tipo: filmati B-roll, dimostrazioni di prodotti, contenuti per social media, creazioni artistiche o narrazioni?

- Durata: 5 secondi per i test, 10-15 secondi per il risultato finale

- Formato: 16:9 per YouTube / Bilibili, 9:16 per Douyin / Kuaishou / Xiaohongshu, 1:1 per WeChat Moments

- Stile: cinematografico, documentario, animazione, pubblicità commerciale o artistico

Definire obiettivi chiari impedisce lo spreco delle quote di generazione in esperimenti ambigui.

Fase 2: Creazione di prompt di testo di alta qualità

Il prompt è l'essenza della generazione di testo-video. Utilizza la seguente formula:

[Soggetto] + [Azione/Movimento] + [Ambientazione] + [Stile] + [Movimento della telecamera] + [Illuminazione]

Prompt inadeguato: "Un cane che corre"

Buon suggerimento: "Un golden retriever che corre in un prato illuminato dal sole, fiori selvatici che ondeggiano nella brezza. Il pelo del cane ondeggia a ogni falcata. La telecamera lo segue a livello del suolo. Luce calda dell'ora dorata con ombre lunghe. Profondità di campo cinematografica, qualità 4K."

Principi fondamentali:

- Il movimento deve essere specifico: "ruota lentamente la testa" anziché "ruota"

- Descrivere i movimenti della telecamera: "la telecamera si avvicina" o "ripresa aerea con drone"

- Creare l'atmosfera: illuminazione, gradazione dei colori, atmosfera

- Evitare contraddizioni: non richiedere contemporaneamente "azione veloce" e "rallentatore"

- Non richiedere testo/interfaccia utente: il modello attuale ha difficoltà a rendere leggibile il testo all'interno delle riprese video

Nota: è consigliabile comporre i prompt in inglese, anche quando si utilizzano strumenti nazionali (come KeLing, TongYi WanXiang o Hunyuan Video). Questo perché la maggior parte dei modelli è stata addestrata su set di dati in lingua inglese più estesi.

Per un sistema di tecniche di prompt più completo, consulta la Guida alla scrittura di prompt e 10 prompt video AI davvero efficaci.

Passaggio 3: selezionare Strumenti e parametri

Seleziona una piattaforma (vedi tabella comparativa sotto), quindi configura:

- Modello: utilizzare l'ultimo modello disponibile (ad esempio, Seedance 2.0, non 1.0)

- Risoluzione: minimo 1080p; optare per 2K ove disponibile

- Durata: Provare inizialmente con 5 secondi, estendere se soddisfacente

- Formato: Adeguare alla piattaforma di distribuzione

- Valore seed (se disponibile): Bloccare il seed per un'iterazione coerente

Fase 4: Generazione e revisione

Fai clic su Genera e attendi 60-180 secondi (a seconda dello strumento). Quando esamini il risultato, presta attenzione a:

- ✅ Il movimento corrisponde alla descrizione?

- ✅ Il soggetto è coerente in tutto il filmato (nessuna distorsione)?

- ✅ La fisica è plausibile (gravità, fluidi, tessuti)?

- ✅ Il movimento della telecamera è fluido?

- ❌ Ci sono artefatti, sfarfallii o distorsioni?

- ❌ C'è un effetto uncanny valley sui volti/mani?

Fase 5: Ottimizzazione iterativa

Il primo tentativo raramente è perfetto. Metodi di ottimizzazione:

- Modifica il prompt: aggiungi dettagli nei punti in cui l'IA ha commesso un errore

- Modifica solo una variabile alla volta: non riscrivere l'intero prompt

- Sperimenta con semi diversi: lo stesso prompt può produrre risultati completamente diversi

- Estendi la durata: una volta soddisfatto della versione da 5 secondi, prova con 10-15 secondi

- Aggiungi audio: se supportato dallo strumento (Seedance, Veo 3), incorpora effetti sonori o musica di sottofondo

Esempi di iterazioni rapide: V1 (prompt di base) → V2 (aggiunta di descrizioni di movimento e illuminazione) → V3 (specifiche cinematografiche complete). Ogni ciclo di perfezionamento migliora significativamente la qualità dell'immagine.

10 modelli di prompt per la generazione di video da testo

I seguenti modelli possono essere copiati e utilizzati direttamente. Sono stati testati su Seedance 2.0 e sono compatibili con la maggior parte delle piattaforme più diffuse.

1. Ritratto cinematografico

A close-up of a young woman with flowing dark hair, her face illuminated by warm golden hour sunlight filtering through a window. She slowly turns her head toward the camera, a subtle smile forming. Soft bokeh background of a cozy interior. Camera holds steady with a slight push-in. Warm amber lighting, shallow depth of field, 4K cinematic quality.

Scenari adatti: social media, personal branding, creazione artistica

- Vetrina dei prodotti

A sleek wireless headphone rotating slowly on a matte black pedestal. Soft studio lighting creates clean highlights on the brushed metal surface. Camera orbits 180 degrees at eye level. Minimalist white background, no shadows. Smooth continuous motion, commercial product photography quality.

Scenari adatti: pagine di dettaglio dei prodotti e-commerce, marketing dei prodotti, video delle immagini principali su Taobao/JD.com

- Natura cinematografica

An epic aerial drone shot over a misty mountain valley at sunrise. Golden light breaks through layered clouds, illuminating a winding river below. Camera pushes forward slowly, revealing the vast landscape. Volumetric fog drifts between peaks. IMAX cinematography quality, hyper-detailed.

Adatto per: video introduttivi su YouTube/Bilibili, contenuti di viaggio, salvaschermi, canali di meditazione

4. Strada urbana

A neon-lit Tokyo alley at night after rain. Wet cobblestones reflect vivid pink, teal, and amber neon signs. A lone figure walks away from camera, umbrella in hand. Steam rises from a street vent. Camera follows at a distance, tracking shot. Film noir atmosphere, anamorphic lens flare.

Scenari adatti: video musicali, filmati B-roll d'atmosfera, contenuti in stile cyberpunk

- Stile anime

An anime warrior princess with flowing silver hair stands on a cliff edge overlooking a fantasy kingdom. Her cape billows dramatically in the wind. She raises a glowing sword that emits blue energy particles. Cherry blossom petals drift past. Camera slowly orbits. Studio Ghibli meets Ufotable quality animation.

Scenari adatti: contenuti animati, canali di videogiochi, narrazioni fantasy

6. Cibo e bevande

Extreme macro close-up of rich dark coffee being poured in slow motion into a pristine ceramic cup. Individual droplets and tiny splashes frozen mid-air. Wisps of steam curl elegantly upward. Warm side lighting reveals the liquid's amber transparency. Cinnamon stick and scattered beans visible in soft focus foreground.

Scenari adatti: marketing per ristoranti, food blogger, pubblicità di bevande

- Moda ed editoria

A model in a flowing white silk gown walks confidently down a dark runway. Multiple flash strobes create sharp geometric light patterns. The fabric billows with perfect physics. Camera at a low angle, slight slow motion. High fashion editorial aesthetic, Vogue magazine quality.

Scenari adatti: marchi di moda, contenuti di bellezza, articoli editoriali

- Fantascienza e fantasy

A massive spaceship emerges from hyperspace above a ringed planet. Blue energy dissipates around the hull as the vessel decelerates. Tiny fighter escorts flank its sides. Camera pulls back to reveal the scale against the planet. Volumetric space dust and distant star field. Hollywood VFX quality.

Scenari applicabili: contenuti di intrattenimento, canali di fantascienza, visualizzazione di concetti

- Sport e azione

A basketball player at the peak of a slam dunk, frozen in mid-air. Time resumes in slow motion — sweat droplets fly, the ball compresses against the rim, arena spotlights create dramatic lens flare. Camera shoots from below looking up. ESPN broadcast quality, hyper-detailed.

Adatto per: contenuti sportivi, marchi sportivi, raccolte di momenti salienti

- Arte astratta (Astratta e artistica)

Liquid gold and deep indigo ink collide in slow motion inside a glass sphere. The fluids intertwine in mesmerizing fractal patterns. Tiny bubbles catch light. Camera slowly rotates around the sphere. Pure black background. Macro photography meets fluid dynamics simulation. Meditative, hypnotic pace.

Scenari adatti: immagini di sfondo, video musicali, installazioni artistiche, salvaschermi

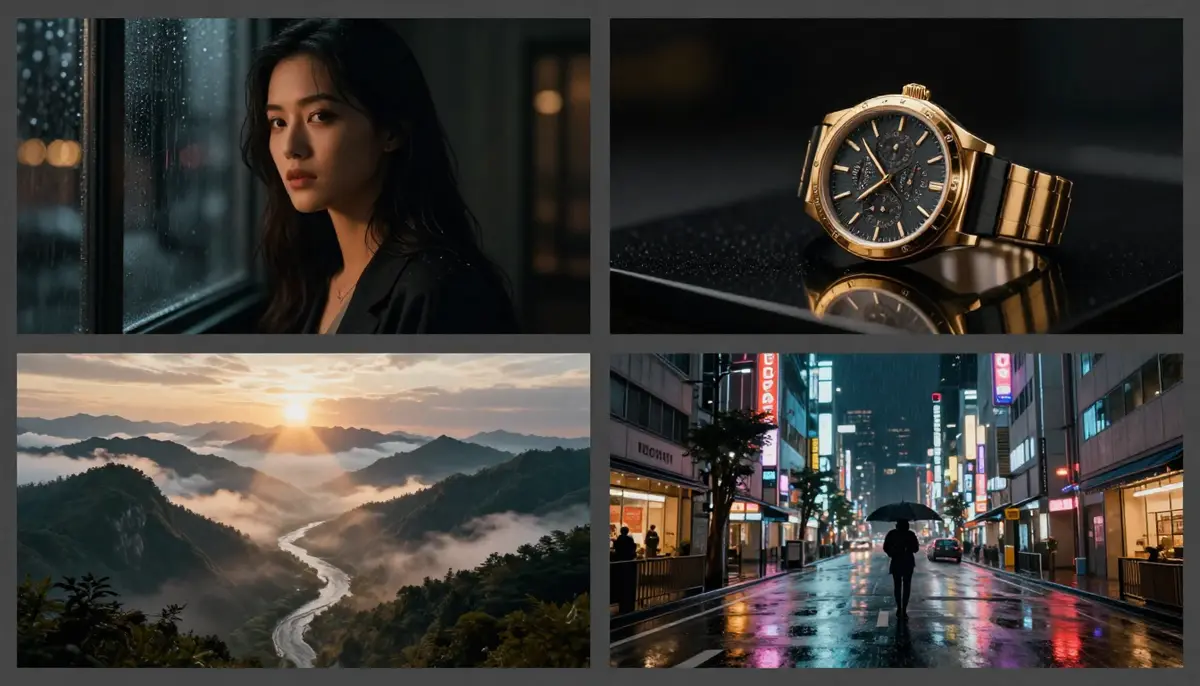

Il risultato effettivo di quattro dei dieci modelli sopra riportati: ogni prompt genera immagini dallo stile distintivo e di qualità cinematografica a partire da testo semplice.

Riepilogo 2026: confronto tra 8 strumenti di conversione da testo a video

Abbiamo testato otto piattaforme mainstream utilizzando lo stesso prompt ("Un golden retriever che corre in un prato soleggiato, fiori selvatici che ondeggiano, qualità cinematografica 4K"), valutandole in base a cinque parametri. Tutti i test sono stati completati nel febbraio 2026.

| Strumento | Risoluzione massima | Durata massima | Versione gratuita | Audio | Utilizzo ottimale | Valutazione della qualità dell'immagine | |------|----------|---------|--------|------|-------- -|---------| | Seedance 2.0 | 2K (2048×1080) | 15 secondi | ✅ Quota giornaliera gratuita | ✅ Effetti sonori + musica + sincronizzazione labiale | Creazione multimodale | 9,2/10 | | Google Veo 3 | 4K (limitato) | 8 secondi | ✅ Quota AI Studio | ✅ Audio nativo | Fusione audiovisiva | 9,0/10 | | Sora 2 | 1080p | 20 secondi | ❌ Richiede ChatGPT Plus | ❌ | Video basato su testi lunghi | 8,8/10 | | Keling 3.0 | 1080p | 20+ secondi | ✅ Crediti di registrazione gratuiti | ⚠️ Limitato | Video lunghi, ottimo rapporto qualità-prezzo | 8,5/10 | | Runway Gen-4 | 1080p | 10 secondi | ✅ 125 crediti | ❌ | Flusso di lavoro di editing professionale | 8,5/10 | | Pika 2.0 | 1080p | 10 secondi | ✅ Quota giornaliera gratuita | ⚠️ Solo effetti sonori | Principianti, effetti divertenti | 8,0/10 | | Luma Dream Machine | 1080p | 5 secondi | ✅ Generazione gratuita | ❌ | Scene 3D, iterazione rapida | 7,8/10 | | Snail AI (MiniMax) | 1080p | 6 secondi | ✅ Gratuito ogni giorno | ❌ | Velocità di generazione più rapida | 7,5/10 |

Avviso importante per gli utenti nazionali: Seedance 2.0, KeLing 3.0 e Haier AI sono direttamente accessibili dalla Cina continentale. Sora 2 richiede un abbonamento a ChatGPT Plus (VPN necessaria). Google Veo 3 richiede l'accesso tramite Google AI Studio (VPN necessaria). Runway, Pika e Luma richiedono tutti un accesso alla rete dall'estero.

Alternative nazionali: Tongyi Wanshang (Alibaba), Hunyuan Video (Tencent) e Qingying (filiale di ByteDance) offrono anch'essi funzionalità di generazione di video da testo, con quote di utilizzo gratuito variabili.

Conclusioni principali:

- Migliore qualità complessiva dell'immagine: Seedance 2.0 (2K nativo + ingresso quad-mode + audio)

- Migliori capacità audio: Seedance 2.0 e Google Veo 3

- Migliore versione gratuita: Seedance 2.0 (accesso gratuito alla risoluzione 2K, nessuna carta di credito richiesta)

- Durata video gratuita più lunga: Keeling 3.0 (oltre 20 secondi)

- Più adatto ai principianti: Pika 2.0 (interfaccia semplicissima, effetti divertenti)

Per un confronto più dettagliato, consulta Il confronto completo dei migliori generatori di video AI per il 2026. Per concentrarti esclusivamente sui piani gratuiti, consulta Una recensione comparativa dei generatori di video AI gratuiti.

6 scenari applicativi chiave

- Contenuti dei social media

Crea brevi video accattivanti per Douyin, Kuaishou, Xiaohongshu, Bilibili e YouTube Shorts. L'intelligenza artificiale elimina completamente la necessità di riprese, montaggio e post-produzione.

Specifiche consigliate: formato 9:16, durata 5-15 secondi, con un forte impatto visivo nel primo secondo.

- Marketing e pubblicità

Produci in serie varianti di materiale pubblicitario. Testa diversi concetti visivi utilizzando diversi prompt prima di impegnarti con il budget di produzione formale. Genera versioni di test A/B in pochi minuti.

Configurazione consigliata: compatibilità multiformato su più piattaforme. Abbinalo alle funzionalità audio di Seedance per produrre filmati pubblicitari completi.

3. Istruzione e formazione

Visualizzazione di concetti astratti difficili o impossibili da cogliere: strutture molecolari, eventi storici, concetti matematici, processi scientifici. Il video AI rende visibile l'invisibile.

Configurazione consigliata: per ottenere risultati didattici ottimali, abbina un prompt che articoli con precisione il concetto a un audio narrato.

- Intrattenimento e narrativa

I registi indipendenti e gli sceneggiatori utilizzano la tecnologia text-to-video per la visualizzazione dei concetti, la creazione di storyboard e persino la produzione finale di cortometraggi. Questa tecnologia democratizza la realizzazione cinematografica.

Configurazione consigliata: includere indicazioni dettagliate sulla direzione della telecamera e sulle specifiche di illuminazione nel prompt per ottenere una qualità cinematografica.

- Video dei prodotti e-commerce

Trasforma le descrizioni dei prodotti in video dimostrativi. Ciò risulta particolarmente utile per i rivenditori con centinaia di SKU che non possono girare video individuali per ogni prodotto. Per informazioni dettagliate sui flussi di lavoro dell'e-commerce, consulta la Guida ai video di e-commerce con IA.

Specifiche consigliate: Fotografia di prodotto con illuminazione da studio. Formato 1:1 per le pagine dei dettagli del prodotto, 16:9 per YouTube/Bilibili, 9:16 per TikTok/Xiaohongshu.

6. Creazione di contenuti per YouTube / Bilibili

Genera filmati B-roll, sequenze di apertura, commenti visivi e brevi video completi. I creatori migliorano l'efficienza della produzione di contenuti con i video AI. Per il flusso di lavoro completo dei creatori YouTube, consulta la Guida per i creatori YouTube sui video AI.

Configurazione consigliata: mantenere la coerenza visiva in tutte le istruzioni per rafforzare il riconoscimento del marchio.

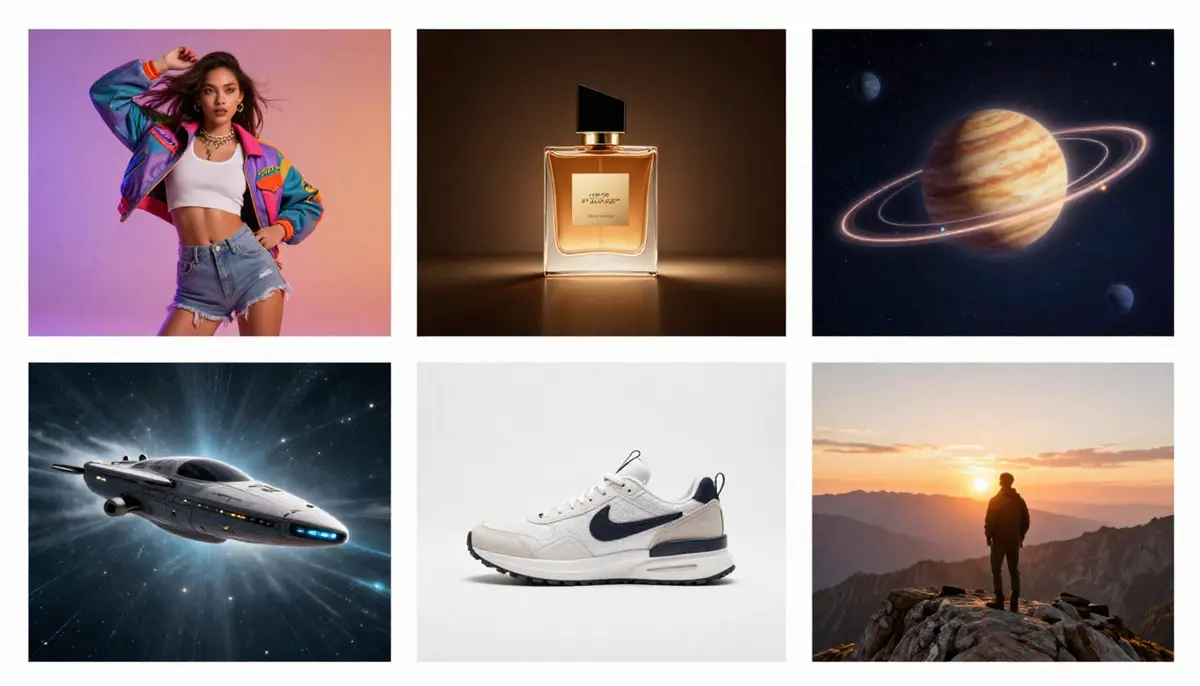

Sei applicazioni pratiche dell'IA text-to-video: dai brevi video sui social media alle demo di prodotti e-commerce, fino alla visualizzazione di concetti didattici.

Da testo a video o da immagine a video: quando usare l'uno o l'altro?

Questa è una delle domande più frequenti poste dai nuovi utenti. La risposta dipende dai materiali che avete a disposizione e dalle vostre esigenze.

Due percorsi verso l'intelligenza artificiale video: la generazione da testo a video parte dal testo scritto, mentre la generazione da immagine a video parte da fotografie esistenti.

Scenari per la generazione di testo-video (T2V):

- Desideri creare contenuti completamente nuovi (senza immagini di riferimento)

- Desideri la massima libertà creativa

- Stai conducendo un'esplorazione concettuale o un brainstorming visivo

- Hai bisogno di scene astratte o non fotografabili (fantascienza, fantasy, microscopiche/macroscopiche)

- Desideri iterare rapidamente: cambiando un prompt si ottiene una scena completamente diversa

Scenari per la generazione di video da immagini (I2V):

- Si possiede una fotografia specifica che richiede una trasformazione dinamica

- Si richiede un output che corrisponda esattamente agli effetti visivi esistenti

- Si stanno convertendo immagini di prodotti in video di prodotti

- Si richiede coerenza dei personaggi (stessa persona in tutte le scene)

- Si desiderano risultati più prevedibili e controllabili

Best practice — Combinazione di entrambi gli approcci:

- Utilizzare la generazione da testo a video per esplorare direzioni creative

- Selezionare il fotogramma ottimale come immagine di riferimento

- Utilizzare la generazione da immagine a video per ottenere una versione finale raffinata e controllabile

Per un flusso di lavoro completo sulla generazione di video da immagini, consulta la Guida completa all'intelligenza artificiale per la conversione da immagini a video.

Limiti attuali — Una valutazione onesta

L'intelligenza artificiale text-to-video del 2026 è impressionante, ma ancora lontana dalla perfezione. Di seguito sono riportati i settori in cui attualmente eccelle e quelli che rimangono ancora difficili da affrontare.

Ben fatto

- Video brevi (5-15 secondi): qualità dell'immagine vicina agli standard cinematografici

- Scene con soggetto singolo: una persona, un animale, un oggetto: risultati eccellenti

- Natura e paesaggi: resa eccezionale della fluidodinamica, degli effetti meteorologici e atmosferici

- Contenuti stilizzati: Animazione, film noir, fantascienza: conversione dello stile altamente affidabile

- Dimostrazioni di rotazione dei prodotti: movimento semplice dei prodotti con buona coerenza

- Movimenti della telecamera: panoramica, zoom, carrellata, riprese in movimento: ben controllati

Ancora difficile

- Mani e dita: dita in eccesso, gesti poco plausibili e deformità delle dita rimangono comuni

- Rendering del testo: il testo leggibile nei video si rivela inaffidabile: le lettere appaiono distorte, i caratteri deformati

- Interazioni complesse tra più persone: Le strette di mano tra due persone, i balli di coppia o i combattimenti spesso mostrano una disorganizzazione degli arti

- Narrazione estesa (>30 secondi): Il mantenimento della coerenza della scena per periodi prolungati si degrada

- Fisica precisa: Rimbalzo preciso della palla, acqua che si riversa in contenitori specifici — la fisica è approssimativa, non esatta*⦁NLBR⦁* Coerenza facciale a lungo termine: I tratti del viso possono subire sottili cambiamenti tra i fotogrammi, in particolare su periodi di tempo prolungati.

Andamento dei progressi

Ciascuna di queste limitazioni sarà notevolmente migliorata entro il 2026 rispetto al 2024. Il ritmo di miglioramento è esponenziale. Il rendering manuale passerà da "sempre errato" a "generalmente accurato". La coerenza facciale passerà da "inizio a deviare dopo 2 secondi" a "rimanere stabile per 10-15 secondi". Il rendering del testo passerà da "illeggibile" a "occasionalmente leggibile". Si prevede che questi aspetti continueranno a migliorare rapidamente tra il 2026 e il 2027.

Domande frequenti

Qual è la migliore IA di conversione da testo a video per il 2026?

Seedance 2.0 è leader nella qualità complessiva dell'immagine con risoluzione nativa 2K, input quad-modale e generazione audio integrata. Google Veo 3 eccelle nella fusione audiovisiva e nella simulazione fisica. Sora 2 offre la durata di generazione singola più lunga (20 secondi). La scelta "migliore" dipende dai requisiti specifici: risoluzione, audio, durata o prezzo. Gli utenti domestici possono anche prendere in considerazione Keeling 3.0 (ottimo rapporto qualità-prezzo, video lunghi) e Tongyi Wanxiang (integrato con l'ecosistema Alibaba).

Esiste un'intelligenza artificiale gratuita per la conversione da testo a video?

Sì. Seedance 2.0 offre una quota giornaliera gratuita senza richiedere una carta di credito. Pika 2.0 fornisce una generazione giornaliera gratuita. Keiling 3.0 concede una quota di iscrizione. Google Veo 3 offre quote gratuite tramite AI Studio. Anche Conch AI fornisce una quota giornaliera gratuita. Per i dettagli, consulta Confronto tra generatori di video AI gratuiti.

Quanto possono essere lunghi i video generati dall'intelligenza artificiale sulla base di un testo?

La maggior parte degli strumenti genera contenuti con incrementi di 5-15 secondi. Sora 2 può produrre fino a 20 secondi. Keeling 3.0 supporta oltre 20 secondi. Per contenuti più lunghi, è possibile generare più segmenti e unirli utilizzando software di editing come Kinevision, Premiere Pro o DaVinci Resolve.

L'intelligenza artificiale text-to-video è in grado di ottenere immagini di livello professionale?

In un arco di tempo compreso tra 5 e 15 secondi, è fattibile. L'output di Seedance 2.0 e Veo 3 è spesso indistinguibile dalle riprese professionali nei clip brevi. Per i progetti più lunghi, i video AI sono più efficaci se utilizzati come componente del materiale (B-roll, riprese di transizione, effetti visivi), piuttosto che come parte integrante della produzione.

Come creare prompt efficaci per la generazione di video da testo?

Segui la formula: Soggetto + Azione + Ambientazione + Stile + Telecamera + Illuminazione. Le descrizioni dei movimenti devono essere specifiche, i movimenti della telecamera chiaramente definiti e l'atmosfera distintamente stabilita. Evita contraddizioni e astieniti dal richiedere elementi di testo/interfaccia utente. Ripeti progressivamente da semplice a complesso. Per ulteriori dettagli, consulta la Guida alla scrittura dei prompt.

Qual è superiore: la generazione da testo a video o da immagine a video?

Applicazioni diverse. Il testo-video offre la massima libertà creativa quando non è disponibile alcun materiale di riferimento. L'immagine-video offre un maggiore controllo quando esiste un punto di partenza visivo specifico. La maggior parte dei professionisti utilizza entrambi gli approcci: il testo-video per il lavoro esplorativo e l'immagine-video per la rifinitura.

I video generati dal testo dell'IA possono essere utilizzati per scopi commerciali?

La maggior parte dei piani a pagamento garantisce i diritti commerciali. La versione a pagamento di Seedance 2.0 include tutti i diritti commerciali ed è priva di filigrana. I termini di servizio variano a seconda delle piattaforme; si prega di verificare le politiche specifiche prima dell'uso. In Cina, l'uso commerciale dei contenuti generati dall'intelligenza artificiale non è attualmente soggetto ad alcuna restrizione normativa esplicita, anche se è consigliabile monitorare gli aggiornamenti delle Misure provvisorie per l'amministrazione dei servizi di intelligenza artificiale generativa.

L'intelligenza artificiale text-to-video sostituirà gli editori?

Non sostituirà, ma piuttosto trasformerà i ruoli. L'IA gestisce la generazione di contenuti, creando risorse visive originali a partire da descrizioni. Gli editori umani gestiscono la narrazione, il ritmo, la risonanza emotiva, la coerenza del marchio e le decisioni creative che richiedono il giudizio umano. Entro il 2026, il flusso di lavoro più efficace sarà la generazione tramite IA + l'editing umano.

Inizia a creare video con testo

Entro il 2026, l'intelligenza artificiale text-to-video sarà pronta per applicazioni professionali. Passata in soli quattro anni da esperimenti GAN sfocati a risultati DiT quasi cinematografici, questa tecnologia è ora in grado di gestire contenuti social media, dimostrazioni di prodotti, visualizzazioni didattiche ed esplorazioni creative.

Il modo migliore per imparare è iniziare a generare. Scrivi un prompt, guarda i risultati e ripeti.

Trasforma il tuo primo paragrafo in un video: prova Seedance gratuitamente →

Desideri una maggiore precisione di controllo? Prova la generazione di immagini in video →

Vuoi approfondire le tecniche di prompt? Leggi la nostra Guida alla scrittura di prompt →