In breve

Il modo più efficace per creare video con l'intelligenza artificiale non è semplicemente inserire una descrizione negli strumenti di conversione da testo a video. Invece, iniziate con un'immagine preparata con cura.

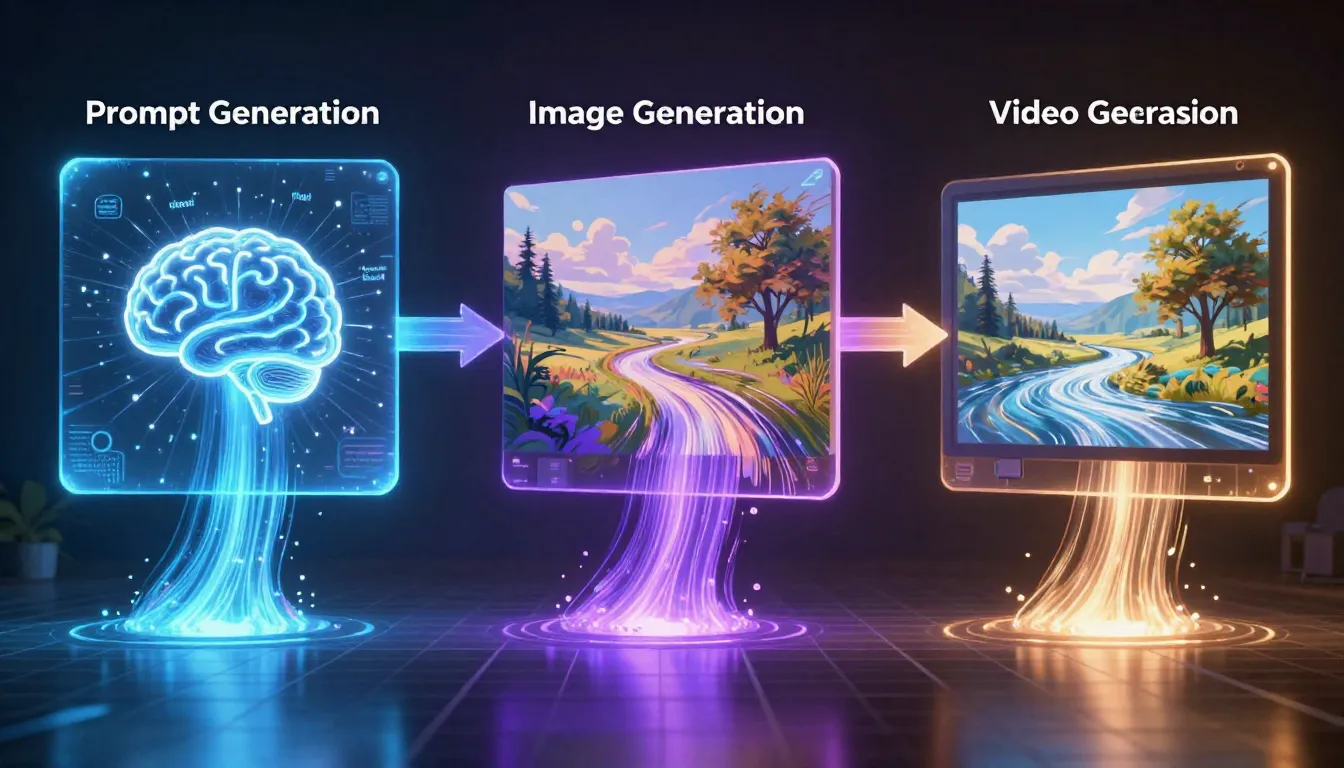

Il processo in tre fasi — prompt → immagine → video — produce risultati di gran lunga superiori rispetto alla sola generazione di testo in video. Innanzitutto, crea un prompt di livello professionale. Utilizza questo prompt per generare un'immagine con una composizione precisa. Quindi inserisci questa immagine come primo fotogramma in un generatore di video. Il risultato: ottieni un controllo preciso sul contenuto visivo, sull'atmosfera dell'illuminazione, sui dettagli compositivi e sul punto di partenza del movimento.

Seedance è l'unico strumento che integra tutte e tre le fasi in un'unica piattaforma: l'Image Prompt Generator ti aiuta a creare prompt professionali, Text-to-Image genera immagini di riferimento di alta qualità e Image-to-Video trasforma le immagini in videoclip cinematografici. Non è necessario cambiare strumento, né scaricare e ricaricare: dall'ispirazione al prodotto finito, tutto avviene in un unico flusso continuo.

Passaggio 1: Generare prompt → | Passaggio 2: Generare immagine → | Passaggio 3: Generare video →

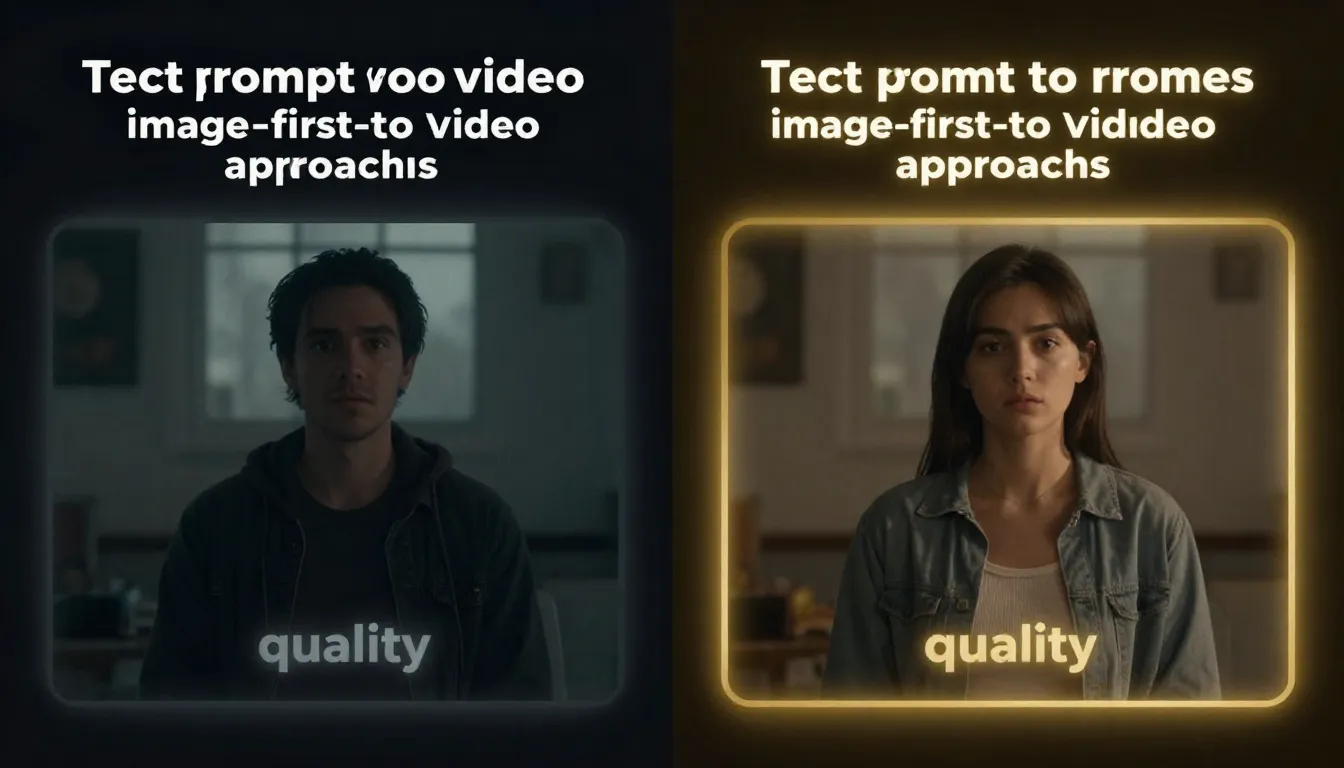

Sinistra: generazione di video da testo puro — composizione casuale, immagini incontrollabili. Destra: pipeline che privilegia le immagini — prima si perfezionano le immagini, poi si aggiunge il movimento; composizione precisa, qualità costante.

Perché "prima l'immagine, poi il video" è molto più efficace della conversione da testo a video

Chi ha utilizzato Wensheng Video conosce bene questa esperienza: si scrive una descrizione dettagliata, che include soggetto, illuminazione, angolazione della telecamera e composizione, ma il filmato generato dall'intelligenza artificiale non ha nulla a che vedere con la propria visione. I personaggi guardano nella direzione sbagliata, l'illuminazione è piatta, le composizioni sembrano generate in modo casuale e i ruoli non corrispondono alla descrizione.

Non si tratta di un difetto di uno strumento specifico, bensì di un limite strutturale intrinseco all'approccio "da testo a video".

I limiti intrinseci della creazione di contenuti basati su video

Wensheng Video richiede che l'IA svolga contemporaneamente due compiti estremamente impegnativi: generare immagini e generare movimento. Il modello deve interpretare il testo, determinare l'aspetto di ogni pixel, comporre la scena, impostare luci e ombre, stabilire la posizione della telecamera e quindi generare un movimento coerente sulla base di tutti questi elementi, il tutto a partire da un unico testo.

Il risultato è che ogni dimensione è fuori controllo:

- Composizione casuale. Scrivi "una donna in piedi in mezzo alla strada", ma lei finisce nella parte sinistra dell'immagine, con metà dell'inquadratura dominata da edifici non richiesti.

- **Personaggi incoerenti. ** La struttura del viso, l'abbigliamento, l'acconciatura e le proporzioni del corpo variano a ogni generazione. L'IA fornisce "interpretazioni creative", non le tue specifiche.

- **Illuminazione incontrollata. ** Anche specificando "ora dorata, illuminazione laterale calda da sinistra" si ottengono risultati estremamente incoerenti. L'interpretazione dell'IA delle descrizioni dell'illuminazione rimane fondamentalmente vaga.

- Inquadratura inaffidabile. Primi piani, campi medi, campi lunghi: gli strumenti di conversione da testo a video interpretano questi termini con estrema instabilità. Se si richiede un primo piano estremo, viene fornito un campo lungo.

Per gli esperimenti creativi esplorativi, questa incertezza può essere parte del divertimento. Ma se avete bisogno di risultati professionali controllati e affidabili, diventa un difetto fatale.

Il vantaggio principale della priorità dell'immagine

TuSheng Video ha completamente ribaltato questa equazione. Non è più necessario che l'IA generi contemporaneamente immagini e movimento; invece, è possibile separare i due compiti:

- Inizia con l'immagine. Soggetto, composizione, illuminazione, colore, inquadratura: hai il pieno controllo e puoi ripetere il processo fino a raggiungere la perfezione.

- Quindi aggiungi il movimento. L'unico compito dell'IA è animare la tua inquadratura perfetta. Non deve decifrare descrizioni vaghe né prendere decisioni compositive, ma genera movimento a partire dai tuoi punti di riferimento visivi concreti.

Questa separazione di obiettivi produce risultati superiori sotto ogni punto di vista:

- Composizione bloccata. Il soggetto rimane esattamente dove lo hai posizionato.

- Coerenza dei personaggi. I tratti del viso, l'abbigliamento e le proporzioni rimangono identici all'immagine originale.

- **Illuminazione e ombre preservate. ** La direzione della luce, la texture e la temperatura del colore sono completamente ereditate dall'immagine.

- Inquadratura fissa. La posizione della fotocamera e il punto di vista rimangono coerenti con l'impostazione originale dell'immagine.

Per illustrare meglio: il text-to-video è simile a descrivere una scena di un film al telefono e dare istruzioni a qualcuno affinché la riprenda. L'image-to-video, invece, è come mostrare una fotografia a qualcuno e dire: "Dai vita a questa immagine". Il secondo approccio produce risultati più controllabili e di qualità superiore, poiché l'IA riceve riferimenti visivi concreti anziché descrizioni testuali astratte.

L'effetto moltiplicatore della qualità

I vantaggi sono cumulativi. Un fotogramma iniziale accuratamente realizzato migliora ogni aspetto del video:

- Maggiore coerenza temporale — Il modello possiede ancore visive di alta qualità per mantenere la coerenza durante tutta la sequenza.

- Migliore qualità del movimento — Il modello estrae con precisione informazioni relative alla profondità, all'illuminazione e allo spazio da immagini sorgente nitide.

- Maggiore coerenza stilistica — I sistemi cromatici, le atmosfere e l'estetica sono direttamente incorporati nelle immagini, senza lasciare spazio all'interpretazione testuale.

- Tasso di imperfezioni ridotto — Il modello parte da dati visivi puliti e ad alta risoluzione, anziché sintetizzare tutto dal rumore.

I video generati con il primo fotogramma di alta qualità dimostrano una significativa superiorità rispetto ai video generati esclusivamente con testo con prompt identici in termini di qualità visiva, continuità temporale e appeal estetico. Non si tratta di una distinzione sottile, ma rappresenta il divario tra "dimostrazioni di IA divertenti" e "contenuti utilizzabili a livello professionale".

Per approfondimenti su come progettare immagini specifiche per la generazione di video, consulta la Guida alla progettazione del primo e dell'ultimo fotogramma.

Pipeline creativa AI in tre fasi

Il flusso di lavoro completo è suddiviso in tre fasi, ciascuna delle quali si basa su quella precedente. Qualsiasi fase gestita con negligenza comprometterà il risultato finale. Comprendere il contributo di ciascuna fase e dove investire tempo è fondamentale per produrre video AI di alta qualità in modo costante.

Fase uno: generazione di prompt

Tutto inizia con il prompt. Prompt mediocri → immagini mediocri → video mediocri. Prompt eccezionali → immagini straordinarie → video straordinari. La qualità del prompt è la variabile più importante nella qualità del risultato finale, ed è anche la fase in cui si investe meno nella maggior parte dei flussi di lavoro.

Il problema della scrittura manuale dei prompt. La maggior parte delle persone affronta la scrittura dei prompt come se si trattasse di parole chiave di ricerca: brevi, vaghe e incentrate esclusivamente sull'argomento. "Un orologio di lusso, sfondo scuro". Questo dice all'IA cosa disegnare, ma non le indica come disegnarlo. Il modello riempie gli spazi vuoti con valori predefiniti: illuminazione piatta, composizione centrata, nessun dettaglio atmosferico, nessuna direzione stilistica.

Soluzione: generazione di prompt assistita dall'intelligenza artificiale. Il generatore di prompt espande le tue idee di massima in prompt professionali che coprono argomenti, ambiente, illuminazione, colore, composizione, stile e miglioramenti della qualità dell'immagine. La differenza nella qualità del risultato tra un prompt manuale di 10 parole e un prompt generato di 100 parole rappresenta un salto di qualità.

Il [Generatore di prompt per immagini] (/image-prompt-generator) di Seedance fa proprio questo. Basta inserire una breve descrizione, ad esempio "pubblicità di orologi di lusso, drammatica e cupa", selezionare uno stile (fotorealistico, cinematografico, illustrativo, ecc.) e l'IA genera istantaneamente un prompt professionale completo. L'intero processo richiede solo pochi secondi e costa 2 crediti per ogni prompt. Per una guida completa alla generazione di prompt, consulta la Guida al generatore di prompt per immagini AI.

Perché questo passaggio è così importante. Il prompt è il DNA dell'intera pipeline. Determina lo stile, l'atmosfera, la composizione e il livello massimo di qualità di tutto ciò che segue. Dedicare cinque minuti alla messa a punto del prompt prima di generare le immagini può far risparmiare trenta minuti di modifiche iterative su risultati mediocri in un secondo momento.

Fase due: generazione dell'immagine

Dopo aver ricevuto le indicazioni professionali, il passo successivo consiste nel generare l'immagine che fungerà da fotogramma iniziale del video. Qui si passa dal testo alle immagini, segnando la fase in cui è necessario investire la maggior parte del tempo di iterazione.

Dal prompt all'immagine. Incolla il prompt generato nello strumento di conversione da testo a immagine e clicca su "Genera". Valuta il risultato: la composizione è adatta per un video? L'illuminazione è sufficientemente stratificata? Il soggetto appare corretto? La scena trasmette un senso di profondità?

Se disponi già di un'immagine di riferimento o desideri perfezionare i risultati di generazione esistenti, image-to-image è lo strumento che fa per te. Carica la tua immagine esistente e descrivi le modifiche desiderate: questo strumento è particolarmente potente per le iterazioni compositive: regola l'illuminazione, aggiungi effetti atmosferici o modifica il contenuto della scena senza partire da zero. Per una guida completa al flusso di lavoro Image-to-Image, consulta la Guida AI Image-to-Image.

Immagini di design per uso video. Non tutte le immagini visivamente accattivanti sono adatte come fotogramma iniziale per un video. Quando si generano immagini per uso pipeline, tenere presenti i seguenti principi di composizione:

- Lascia uno spazio negativo nella direzione del movimento. Se un personaggio si muove da sinistra a destra, posizionalo leggermente a destra dell'inquadratura.

- Includi livelli di profondità. Le immagini con elementi distinti in primo piano, medio piano e sfondo creano effetti di parallasse migliori e movimenti della telecamera più naturali nel video.

- **Considera la direzione del movimento della telecamera. ** Se si prevede di utilizzare il movimento "push", assicurarsi che la composizione sia buona sia nell'inquadratura attuale che in un'inquadratura più stretta centrata sul soggetto.

- Evitare grandi blocchi di testo o motivi simmetrici. Tali elementi sono difficili da animare in modo naturale e possono facilmente produrre artefatti.

- **Utilizzare un'illuminazione direzionale. ** Un'illuminazione direzionale forte con ombre visibili produce un effetto video più cinematografico rispetto a un'illuminazione piatta.

Principio fondamentale: dedica tempo alla realizzazione delle immagini giuste. Ogni minuto speso per perfezionare le immagini ti farà risparmiare molto più tempo nella fase di generazione del video. Un primo fotogramma impeccabile significa che il tuo video sarà utilizzabile fin dal primo tentativo. Un primo fotogramma imperfetto potrebbe richiedere più rigenerazioni (ognuna delle quali consuma crediti e tempo) senza garantire un risultato soddisfacente.

Prima di iniziare la generazione del video, ripeti le immagini 3-5 volte. Non si tratta di perfezionismo, ma di efficienza.

Per una guida completa alla generazione di immagini da testo (comprese le tecniche di prompting e il confronto tra strumenti), consulta La guida completa all'IA per la generazione di immagini da testo. Per una panoramica dei migliori strumenti di generazione di immagini, consulta I migliori generatori di immagini IA per il 2026.

Genera la tua immagine → | Ottimizza immagine-immagine →

Fase tre: generazione del video

Questa è la fase in cui raccogli i frutti del tuo lavoro. Le immagini rifinite che hai perfezionato costituiscono il punto di partenza per i tuoi videoclip animati.

Carica un'immagine come primo fotogramma. Carica l'immagine generata nello strumento [Image-to-Video] di Seedance. Lo strumento recupera le immagini direttamente dalla cronologia di generazione, senza bisogno di scaricarle e ricaricarle.

Guida il movimento con le parole. Scrivi una descrizione del movimento che desideri ottenere, senza descrivere gli elementi visivi (l'immagine è già stata elaborata). Concentrati su:

- Movimento della telecamera: "dolly lento in entrata" 、panoramica delicata verso sinistra、orbita fluida attorno al soggetto

- Azione del soggetto: "la donna gira lentamente la testa"、i petali cadono verso il basso、il vapore sale dalla tazza

- Movimento dell'ambiente: "le nuvole si spostano lentamente", "l'acqua increspa verso l'esterno", "le foglie ondeggiano dolcemente nella brezza"

- ** Atmosfera**: "atmosfera drammatica", "atmosfera sognante ed eterea", "ritmo cinematografico"

Genera e rivedi. L'IA riceve le tue indicazioni relative all'immagine e al movimento, producendo segmenti video che iniziano esattamente dal primo fotogramma e si sviluppano secondo le tue istruzioni di movimento. Poiché sei tu a controllare il punto di partenza visivo, il risultato è prevedibile e coerente. La qualità video eredita la qualità dell'immagine: un primo fotogramma chiaro, ben illuminato e composto con precisione si traduce direttamente in un video chiaro, ben illuminato e composto con precisione.

Per tecniche avanzate di controllo del movimento e abbinamento del primo/ultimo fotogramma, consultare la Guida alla progettazione del primo e dell'ultimo fotogramma. Per un'introduzione completa all'IA Image-to-Video, consultare la Guida all'IA Image-to-Video.

Pipeline in tre fasi in azione: trasformare brevi descrizioni in suggerimenti professionali, trasformare i suggerimenti in immagini di alta qualità e convertire le immagini in video dinamici. Ogni fase amplifica la qualità di quella precedente.

Vantaggio Seedance: completamento in tre fasi, tutto in un unico posto

Oggi, la maggior parte dei creatori che mettono insieme questa pipeline stanno assemblando tre o quattro strumenti. Usano ChatGPT o Claude per scrivere prompt di immagini, passano a Midjourney o Tongyi Wansheng per la generazione di immagini, scaricano l'immagine, aprono Ke Ling o Runway, quindi la caricano per generare il video. Ogni passaggio comporta un'interfaccia diversa, account diversi, sistemi di fatturazione diversi e vincoli diversi.

Questo flusso di lavoro frammentato non è solo fastidioso, ma compromette attivamente la qualità.

Come il cambio di strumenti compromette la qualità

Ogni volta che un'immagine viene trasferita tra strumenti diversi, si verifica un degrado. Il ciclo di download-upload introduce artefatti di compressione. Le conversioni di formato (da PNG a JPG, da WebP a PNG) alterano i valori dei colori. La risoluzione può essere ricampionata. I metadati relativi alla generazione dell'immagine, informazioni che avrebbero potuto aiutare il modello video a produrre risultati superiori, vengono completamente eliminati.

Oltre alla qualità dei dati, c'è anche un sovraccarico cognitivo. Ogni strumento ha una propria sintassi di prompt, impostazioni di output distinte e opzioni di proporzioni variabili. Si spreca tempo a familiarizzare nuovamente con le interfacce invece di dedicarlo alle iterazioni creative.

Tubazioni integrate

Seedance elimina ogni tipo di attrito offrendo tutte e tre le fasi all'interno di un'unica piattaforma:

1. Generatore di prompt per immagini (/image-prompt-generator). Inserisci il tuo concetto creativo, seleziona uno dei 12 stili disponibili e ricevi un prompt professionale completo. I prompt generati sono ottimizzati per il modello di generazione di immagini Seedance, ma sono ugualmente adatti a qualsiasi strumento di pittura AI.

2. Da testo a immagine e da immagine a immagine (/text-to-image | /image-to-image). Genera immagini da prompt o apporta modifiche mirate a immagini esistenti. Produci rapidamente più varianti. Una volta trovata la composizione giusta, sei pronto per passare direttamente alla fase successiva.

- Da immagine a video Seleziona qualsiasi immagine pregenerata dalla tua libreria e inviala direttamente al generatore di video. Non sono necessari download, upload o conversioni di formato. Le immagini ad alta risoluzione vengono trasferite senza perdita di qualità.

Perché l'integrazione produce risultati superiori?

Non si tratta solo di una funzione di comodità; l'integrazione produce risultati davvero superiori:

- Zero perdite di trasmissione. Le immagini vengono trasferite a piena risoluzione tra le fasi, senza compressione o ricampionamento.

- Ecosistema di modelli coerente. I modelli di generazione di immagini e video sono calibrati per garantire una compatibilità intrinseca. Le immagini prodotte dal modello di conversione da testo a immagine di Seedance sono intrinsecamente adatte al modello video di Seedance.

- **Sistema di crediti unificato. ** Non è necessario mantenere tre abbonamenti separati. I crediti sono universali per tutti e tre gli strumenti, rendendo l'allocazione del budget semplice e trasparente.

- Cicli di iterazione più rapidi. Il tempo che intercorre tra "Voglio modificare questa immagine" e "Sto guardando il nuovo video" si riduce da minuti spesi per cambiare strumento a pochi secondi di integrazione perfetta.

- **Mantieni il flusso creativo. ** Rimani all'interno di un'unica interfaccia per preservare il contesto del tuo pensiero. Concentrati sul concetto creativo stesso, non sulla gestione dei file o sulla navigazione degli strumenti.

Francamente parlando: è possibile utilizzare perfettamente ChatGPT per scrivere prompt, Midjourney o Tongyi Wansheng per la generazione di immagini e Keling o Runway per la creazione di video per costruire una pipeline di alta qualità. Molti professionisti fanno proprio questo. Il vantaggio di Seedance non risiede in una singola fase che supera di gran lunga i concorrenti, ma nella sua integrazione che elimina l'attrito che induce la maggior parte dei creatori ad abbandonare il processo a metà strada. Il miglior flusso di lavoro è quello che si porta a termine dall'inizio alla fine.

Seedance integra la generazione di prompt, immagini e video in un'unica piattaforma. Dall'ideazione al video finito, non è necessario cambiare strumenti, scaricare file o gestire più account.

Guida pratica completa: 3 casi di studio reali

La teoria è utile, ma è la pratica che porta risultati. Di seguito sono riportati tre esercizi completi relativi alla pipeline, ciascuno corrispondente a diversi obiettivi creativi, stili distinti e proporzioni diverse. Seguili per creare la tua prima pipeline completa.

Caso 1: Pubblicità cinematografica di un prodotto

Obiettivo: Realizzare uno spot pubblicitario di cinque secondi per un orologio di lusso da inserire nella pagina di presentazione del prodotto.

Fase uno — Generazione di prompt

Apri il Generatore di prompt per immagini e inserisci il tuo concetto.

Input: "pubblicità di orologi di lusso, drammatica e cupa"

Seleziona stile: Fotorealistico

Prompt generato:

A luxury men's wristwatch resting on a slab of dark emperador marble,

shot from a low three-quarter angle. Dramatic studio lighting: a single

hard key light from the upper left creates sharp reflections on the

polished steel case and sapphire crystal. The watch face shows 10:10

with luminous indices glowing faintly. Deep shadows pool around the

base, enhancing the sense of weight and prestige. Background is pure

black, fading to subtle charcoal gradient. Microscopic dust particles

float in the key light beam. Color palette: silver, deep charcoal,

amber highlights from the lume. Photorealistic product photography,

8K resolution, razor-sharp detail on every dial marking and link.Creare manualmente questo prompt richiederebbe almeno 10-15 minuti. Un generatore di prompt lo realizza in pochi secondi, coprendo tutte e sette le dimensioni dei prompt professionali: soggetto, ambiente, illuminazione, colore, composizione, stile e qualità dell'immagine.

Fase due — Generazione dell'immagine

Incolla il prompt generato in text-to-image. Genera con un rapporto di aspetto 16:9 per adattarsi ai fotogrammi video orizzontali.

Primo rendering: la composizione complessiva è valida, anche se la superficie in marmo riflette leggermente troppo, distogliendo l'attenzione dall'orologio.

Iterazione: Ottimizza utilizzando Image-to-Image. Carica l'immagine generata inizialmente con il prompt: "Riduci l'intensità del riflesso sulla superficie del marmo. Aumenta la nitidezza dei dettagli del quadrante dell'orologio. Rendi leggermente più intenso il gradiente dello sfondo."

Seconda ripresa: l'orologio è al centro della scena, immerso in un gioco drammatico di luci e ombre, con una composizione stratificata. Pronti per passare alla fase video.

Fase tre — Generazione video

Invia le immagini rifinite a Image-to-Video.

Suggerimenti per l'esercizio:

The camera executes a slow, smooth orbiting movement around the watch,

revealing different angles of the case and bracelet. The key light

shifts subtly as the camera moves, creating dynamic reflections across

the polished surfaces. Dust particles drift slowly through the light

beam. Cinematic, premium commercial pacing. Steady, professional

camera movement.(La telecamera ruota lentamente e con fluidità attorno all'orologio, mostrando diversi angoli della cassa e del cinturino. Mentre l'inquadratura si sposta, la fonte di luce principale cambia leggermente posizione, creando riflessi dinamici sulle superfici lucide. Le particelle di polvere fluttuano delicatamente nel fascio di luce. Ritmo cinematografico, pubblicità di alta qualità. Movimento della telecamera fluido e professionale.)

Risultati attesi: una presentazione raffinata del prodotto della durata di 5 secondi, che inizia con un fotogramma composto meticolosamente e ruota dolcemente attorno all'orologio. Illuminazione drammatica, dettagli nitidi e texture di alta qualità si trasferiscono senza soluzione di continuità dall'immagine originale a ogni fotogramma del video.

Caso 1: Pubblicità di orologi di lusso. Da una breve descrizione concettuale di cinque parole a un video di cinque secondi sul prodotto: un processo in tre fasi che garantisce risultati di livello commerciale.

Caso 2: Contenuti di viaggio sui social media

Obiettivo: Realizzare un video verticale che riprenda l'alba in un santuario giapponese per TikTok/Instagram Reels.

Fase uno — Generazione di prompt

Apri il Generatore di prompt immagine.

Input: "Tempio giapponese all'alba, mattina tranquilla"

Seleziona stile: Fotorealistico

Prompt generato:

A traditional Japanese wooden temple (Kiyomizu-dera style) nestled

among ancient cedar trees, photographed at dawn. Golden sunrise light

filters through morning mist, casting long warm shadows across the

temple's wooden veranda. Cherry blossom branches frame the upper

portion of the composition, with delicate pink petals catching the

first light. A stone lantern stands in the foreground left, moss-

covered and weathered. The temple roof's curved eaves are silhouetted

against a sky transitioning from deep indigo to warm peach and gold.

Subtle mist hovers at ground level among the trees. Photorealistic

landscape photography, golden hour lighting, serene and contemplative

atmosphere, high dynamic range, rich natural color palette.Fase due — Generazione dell'immagine

Incolla in Text-to-Image. Impostazioni chiave: Genera in formato verticale 9:16, adatto per TikTok e Instagram Reels.

Prima bozza: l'atmosfera è stupenda, ma i rami dei ciliegi in fiore sono posizionati troppo in alto nell'inquadratura, lasciando troppo spazio vuoto nella parte inferiore.

Iterazione: dopo aver leggermente modificato il prompt e aggiunto la descrizione "rami di ciliegio in fiore che si estendono dagli angoli superiori destro e sinistro, riempiendo il terzo superiore della cornice verticale", la seconda generazione ha posizionato perfettamente i fiori di ciliegio come cornice naturale per la composizione.

La composizione si presta perfettamente al video verticale: il santuario attira lo sguardo al centro dell'inquadratura, mentre i fiori di ciliegio nella parte superiore creano interesse visivo. Le lanterne di pietra e la nebbia in primo piano conferiscono profondità. Questa inquadratura offre la possibilità di movimento su più livelli.

Fase tre — Generazione video

Invia a Image-to-Video.

Suggerimenti per l'esercizio:

Gentle cherry blossom petals drift slowly downward through the frame.

Morning mist shifts and swirls at ground level among the trees. Two

birds fly across the sky in the background. The sunrise light gradually

intensifies, warming the scene. A subtle breeze moves the cherry

blossom branches slightly. Peaceful, meditative atmosphere. Slow,

contemplative pacing.I petali dei fiori di ciliegio fluttuano delicatamente nell'inquadratura. La nebbia mattutina scorre dolcemente sul terreno tra gli alberi. Due uccelli volano nel cielo sullo sfondo. La luce dell'alba si intensifica gradualmente, riscaldando l'intera scena. Una leggera brezza muove i rami dei ciliegi in fiore. Un'atmosfera tranquilla e meditativa. Un ritmo lento e contemplativo.

Risultati finali: un video verticale suggestivo della durata di 4 secondi, perfetto per TikTok e Instagram Reels. I fiori di ciliegio fluttuano naturalmente, mentre la nebbia mattutina aggiunge profondità e movimento. Gli uccelli sullo sfondo creano sottili punti focali. I toni caldi e dorati dell'immagine originale permeano ogni fotogramma del video.

Caso di studio 3: Narrazione del marchio – Abbinamento del primo e dell'ultimo fotogramma

Obiettivo: Realizzare un video di sei secondi che descriva la trasformazione del caffè dalla quiete del primo mattino al trambusto di un locale pieno di clienti.

Questo caso utilizza due volte la pipeline, generando una coppia di immagini che comprendono il primo e l'ultimo fotogramma per fornire al modello video due punti di riferimento visivi per definire l'arco narrativo. Per un'analisi approfondita di questa tecnica, consultare la Guida alla progettazione del primo e dell'ultimo fotogramma.

Fase uno — Due suggerimenti

Genera due serie di prompt dal generatore di prompt per immagini.

Primo fotogramma: "Una caffetteria vuota, immersa nella luce del primo mattino, con calde tonalità ambrate."

Prompt generato per il primo fotogramma:

Interior of an artisanal coffee shop in the early morning, before

opening. Warm amber sunlight streams through large front windows,

casting long golden rectangles across worn hardwood floors. Exposed

brick walls, a polished wooden counter with a brass espresso machine,

and empty mismatched chairs around small tables. A chalkboard menu

hangs behind the counter. Dust motes float in the sunbeams. The space

feels warm, inviting, and full of potential. Shot at eye level from

just inside the entrance. Photorealistic interior photography, warm

color palette, golden hour tones, cozy atmosphere.Immagine finale: "Una caffetteria affollata in una calda mattinata, con i clienti che si godono il loro caffè."

Messaggio generato nell'ultimo fotogramma:

The same artisanal coffee shop, now alive with morning activity.

Diverse customers sit at tables -- some reading, some talking, some

working on laptops. A barista behind the counter steams milk, creating

a plume of white steam. Coffee cups and pastries fill the tables. Warm

morning light still streams through the windows but is supplemented by

the warm glow of pendant lights. The atmosphere is bustling but cozy,

full of quiet energy and the warmth of community. Shot from the same

eye-level position just inside the entrance. Photorealistic interior

photography, warm tones, lively atmosphere.Fase due — Due immagini

Genera il primo fotogramma in text-to-image con un rapporto di aspetto 16:9. Ripeti l'operazione fino a quando il caffè vuoto appare caldo e accogliente, immerso nella calda luce dorata del mattino.

Il fotogramma finale utilizza la generazione [immagine-immagine]. Carica il fotogramma iniziale come immagine di riferimento e utilizza il prompt del fotogramma finale. Questo passaggio è fondamentale: l'utilizzo del fotogramma iniziale come riferimento garantisce la coerenza visiva. L'architettura, l'arredamento, la direzione dell'illuminazione e le combinazioni di colori rimangono coerenti tra i fotogrammi, con l'unica aggiunta di figure e attività.

Ripeti l'operazione sull'ultimo fotogramma per assicurarti che l'ospite appaia naturale e che il barista sia posizionato dietro il bancone. È fondamentale che entrambe le immagini sembrino riprese nello stesso luogo in momenti diversi, non in due luoghi separati.

Fase tre — Generazione video

Carica il primo fotogramma su Image-to-Video. Sulle piattaforme che supportano il riferimento al fotogramma finale, carica contemporaneamente anche il fotogramma finale.

Suggerimenti per l'esercizio:

Time-lapse style transition. The empty coffee shop gradually fills

with people arriving -- customers entering, sitting down, a barista

beginning to work. Morning light shifts slowly. The scene transitions

from quiet solitude to warm, bustling community. Smooth, cinematic

pacing. The camera position remains fixed.(Transizione in stile time-lapse. Un caffè vuoto si riempie gradualmente di clienti che arrivano: i clienti entrano, prendono posto e il barista inizia a lavorare. La luce del mattino cambia leggermente. La scena evolve da una tranquilla solitudine a una calda e vivace atmosfera comunitaria. Ritmo fluido e cinematografico. La telecamera rimane fissa.)

Risultato: una storia del marchio della durata di sei secondi racconta un arco narrativo completo: il risveglio di una caffetteria. La scena iniziale crea un'atmosfera tranquilla e accogliente. La scena finale presenta lo stato desiderato. Le transizioni generate dall'intelligenza artificiale collegano le due scene: le porte si aprono, i clienti prendono posto, i baristi accendono le macchine per l'espresso e le tazze di caffè appaiono sui tavoli. Il messaggio del marchio è discreto ma potente: questo è un luogo dove ci si sente a casa.

Caso 3: Narrazione del marchio che abbina le immagini di apertura e chiusura. L'intelligenza artificiale genera una transizione time-lapse tra due punti di riferimento visivi: dalla quiete dell'alba al calore della comunità.

Tecniche di ottimizzazione delle condutture

Dopo aver prodotto centinaia di video attraverso questo processo, i seguenti cinque principi hanno avuto il maggiore impatto sulla qualità del risultato finale.

Suggerimento 1: dedica l'80% del tuo tempo alle immagini

Questa è l'ottimizzazione più importante. La qualità dell'immagine è il collo di bottiglia dell'intero processo. Un'immagine perfetta produrrà un video utilizzabile già alla prima generazione. Un'immagine mediocre, per quanto ben realizzati possano essere i prompt di movimento, produrrà solo un video mediocre.

La ripartizione del tempo dovrebbe essere approssimativamente la seguente:

- Generazione di prompt: 5% (il generatore impiega pochi secondi, mentre la scrittura a mano richiede diversi minuti)

- Generazione e iterazione di immagini: 80% (generare, valutare, perfezionare, rigenerare fino a ottenere la scena perfetta)

- Generazione di video: 15% (caricare, scrivere prompt di movimento, generare)

La maggior parte dei principianti segue la sequenza al contrario: dedica dieci secondi a un'immagine, poi genera video uno dopo l'altro, sperando di trovarne uno valido. Gli utenti esperti dedicano dieci minuti a un'immagine e ottengono un buon video già dopo i primi tentativi. Quest'ultimo approccio produce risultati migliori con meno crediti e meno tempo.

Prima di iniziare la generazione del video, ripeti le immagini da tre a cinque volte. Non si tratta di perfezionismo, ma di efficienza.

Suggerimento 2: Progettato per il movimento

Una fotografia piacevole e un buon fotogramma video non sono la stessa cosa. Quando si generano immagini per le pipeline, immaginate come apparirà la scena quando prenderà vita.

Lascia uno spazio negativo nella direzione del movimento principale. Se una figura si muove da sinistra a destra, evita di centrarla: posizionala leggermente a destra per lasciare spazio al movimento. Se la telecamera si sposta verso sinistra, assicurati che il lato sinistro dell'inquadratura contenga contenuti visivamente accattivanti.

Componi le inquadrature in base alla direzione della telecamera. Le inquadrature in avanzamento sono più efficaci quando il dettaglio più interessante occupa il centro dell'inquadratura. Le inquadrature panoramiche richiedono un interesse visivo su tutta la larghezza dell'inquadratura. Le inquadrature circolari richiedono soggetti tridimensionali con profondità, piuttosto che soggetti piatti.

Evita composizioni simmetriche complesse. Sebbene la simmetria perfetta possa essere sorprendente nelle fotografie, essa pone delle difficoltà nella generazione dei video. L'intelligenza artificiale fatica a mantenere una simmetria precisa tra i fotogrammi, causando fastidiosi tremolii. Le composizioni asimmetriche con un flusso visivo naturale producono video più fluidi.

Incorporare indicazioni di profondità. Le immagini che presentano elementi sovrapposti a distanze variabili (oggetti in primo piano, soggetti in secondo piano e ambienti sullo sfondo) forniscono all'IA informazioni sulla profondità, traducendosi in effetti di parallasse migliorati e movimenti della telecamera più naturali.

Per una guida completa sulla progettazione di immagini specifiche per i video, consulta la Guida alla progettazione del primo e dell'ultimo fotogramma.

Tecnica 3: mantenere proporzioni costanti durante l'intero processo

Il disallineamento delle proporzioni tra immagini e fotogrammi video costituisce uno degli errori più diffusi nella pipeline, che inevitabilmente compromette la qualità del risultato finale.

- 16:9 per i video in formato orizzontale (YouTube, presentazioni, pagine di destinazione dei siti web)

- 9:16 per i video in formato verticale (TikTok, Instagram Reels, YouTube Shorts)

- 1:1 per i video quadrati (Instagram Stories, alcuni annunci sui social media)

Imposta le proporzioni durante la generazione dell'immagine anziché lasciarle alla fase di creazione del video. Se generi un'immagine quadrata 1:1 e poi provi a creare un video 16:9, il modello video dovrà riempire i lati da zero e la qualità di questo contenuto generato sarà inferiore al resto del fotogramma. Genera le immagini con le proporzioni del video finale sin dall'inizio.

Suggerimento 4: mantieni uno stile coerente nelle istruzioni in tutte le fasi

Le parole chiave stilistiche nei prompt delle immagini e gli indizi di movimento nei prompt dei video devono parlare lo stesso linguaggio visivo. Qualsiasi incongruenza tra i due comporterà sottili problemi di qualità nel risultato finale.

Se la tua immagine di riferimento include "illuminazione cinematografica, drammatica, atmosfera malinconica", il riferimento al movimento video dovrebbe utilizzare un linguaggio compatibile: "movimento cinematografico della telecamera, atmosfera drammatica, ritmo malinconico". Evita di abbinare immagini drammatiche e cinematografiche a riferimenti al movimento come "giocoso, vivace, energico": i conflitti tonali confonderanno il modello e ridurranno la coerenza.

Riferimento rapido — Tabella di corrispondenza degli stili:

| Stile dell'immagine | Linguaggio di prompt del movimento abbinato |

|---|---|

| Cinematografico, drammatico | "Movimento cinematografico della telecamera, ritmo drammatico, lento e deliberato" |

| Luminoso, commerciale, pulito | "Movimento fluido e professionale, ritmo costante, transizioni pulite" |

| Sognante, etereo, morbido | "Movimento delicato e fluttuante, atmosfera sognante, lento scorrere" |

| Energico, dinamico | "Movimento dinamico della telecamera, ritmo energico, tagli veloci" |

| Documentaristico, naturale | "Sensazione di ripresa a mano, movimento naturale, ritmo osservativo" |

Suggerimento 5: salva i tuoi modelli di pipeline migliori

Quando una pipeline prompt → immagine → video produce risultati soddisfacenti, salva l'intera pipeline:

- Prompt immagine (testo originale)

- Impostazioni stile selezionate

- Impostazioni generazione immagine (proporzioni, modello, numero seed, ecc.)

- Prompt movimento video

- Impostazioni generazione video (durata, risoluzione)

Questa pipeline funge da modello. Hai bisogno di creare video simili per prodotti diversi? Sostituisci il soggetto nell'immagine e rigenera. Hai bisogno di scene diverse con lo stesso stile? Mantieni le parole chiave dello stile e sostituisci la descrizione del soggetto.

Nel corso del tempo, creerai una libreria completa di pipeline su misura per diversi obiettivi creativi: pubblicità di prodotti, contenuti per i social media, narrazioni di marca, filmati B-roll, animazione di personaggi. Ogni nuovo progetto parte da una base collaudata piuttosto che da zero.

Confronto tra strumenti alternativi nelle diverse fasi

Seedance fornisce una pipeline integrata, ma è anche possibile creare questo flusso di lavoro utilizzando strumenti separati. Di seguito è riportato un confronto sincero di ciascuna fase.

Fase uno: generazione di prompt

| Strumento | Ideale per | Descrizione |

|---|---|---|

| Seedance Image Prompt Generator | Pipeline integrata, 12 stili predefiniti | 2 crediti per prompt. Output diretto allo strumento Seedance Image. |

| ChatGPT / GPT-4 | Prompt personalizzati | Richiede copia-incolla manuale. Nessun preset di stile. Più flessibile per istruzioni complesse. |

| Claude | Prompt raffinati e dettagliati | Eccelle nell'esecuzione di brief creativi complessi. Nessuna integrazione per la generazione di immagini. |

| Tongyi Qianwen | Ottimizzato per contesti cinesi | Comprensione più naturale delle descrizioni in cinese. Adatto agli utenti domestici. Richiede l'integrazione manuale con strumenti a valle. |

Fase due: generazione dell'immagine

| Strumento | Ideale per | Note |

|---|---|---|

| Seedance Text-to-Image / Image-to-Image | Integrazione pipeline, flusso di lavoro video-first | Immagini trasferite direttamente alla fase video senza alcuna perdita di qualità. |

| Midjourney | Qualità artistica, espressività estetica | Produce risultati eccezionali. Richiede l'utilizzo tramite Discord o interfaccia web. Scaricabile manualmente all'interno delle pipeline. |

| Tongyi Wanshang | Facile da usare in cinese, accesso stabile a livello nazionale | Sviluppato da Alibaba, eccelle nella comprensione delle descrizioni in cinese. Adatto agli utenti nazionali senza VPN. |

| DALL-E 3 | Fedeltà ai prompt, rendering testuale | Eccelle nell'esecuzione letterale di prompt complessi. Controllo stilistico limitato. |

| Stable Diffusion | Controllo completo, generazione locale | Massima flessibilità. Richiede la configurazione di un ambiente tecnico. Adatto per lavori di grande volume. |

Fase tre: generazione del video

| Strumento | Ideale per | Descrizione |

|---|---|---|

| Seedance Image-to-Video | Pipeline integrata, qualità costante | Trasferimento immagini senza interruzioni, supporto diretto per l'input del primo fotogramma. |

| Kling 3.0 | Lunga durata, alta qualità | Genera fino a 2 minuti per esecuzione. Ottima qualità del movimento. Di Kuaishou, accessibile in Cina. |

| Jimeng AI | Ecosistema cinese, facile da usare | Di ByteDance, profondamente integrato con l'ecosistema TikTok. Ideale per la creazione di video di breve durata. |

| Runway Gen-4 | Controllo di precisione, pennelli di movimento | La modalità Director supporta percorsi personalizzati della telecamera. Interfaccia professionale. Prezzo più elevato. |

| Pika 2.0 | Facile da imparare, sperimentazione rapida | Interfaccia minimalista. Adatto ai principianti. Controllo limitato dei dettagli di movimento. |

Francamente: È certamente possibile creare una pipeline di alta qualità utilizzando ChatGPT per la scrittura di prompt, Midjourney per la generazione di immagini e Keeling per la produzione di video. Molti professionisti fanno proprio questo. Il vantaggio di Seedance non sta nel superare i concorrenti in una singola fase, ma nell'eliminare gli attriti attraverso l'integrazione, nel mantenere la qualità in tutte le fasi e nel fondere tre flussi di lavoro separati in uno solo. Per i creatori che producono video AI frequentemente, il tempo risparmiato rimanendo all'interno di un'unica piattaforma ammonta a diverse ore ogni settimana.

Per un confronto dettagliato degli strumenti di generazione video, consulta Confronto tra i migliori generatori video AI 2026.

Errori comuni nella pipeline

Di seguito sono riportati i cinque errori più comuni riscontrati durante la configurazione di una pipeline prompt → immagine → video. Ognuno di essi ha una soluzione semplice.

Errore 1: saltare completamente la fase dell'immagine

Manifestazione specifica: conversione diretta del testo in video, bypassando completamente la generazione di immagini.

Perché è problematico: si perde completamente il controllo sulla composizione. Il modello video determina tutto: contenuto visivo, inquadratura delle scene e punti di partenza della telecamera. I risultati sono imprevedibili, con una bassa probabilità che corrispondano all'intenzione creativa al primo tentativo.

Come risolvere il problema: genera sempre un'immagine del primo fotogramma, anche se ritieni che il tuo prompt di testo sia sufficientemente dettagliato. I 30 secondi impiegati per generare un'immagine possono farti risparmiare molteplici generazioni di video non riuscite.

Errore 2: Utilizzo di immagini stock senza valutazione

Manifestazione specifica: scaricare casualmente un'immagine da Internet o selezionarne una da una libreria di immagini stock, quindi inserirla direttamente nel processo di generazione del video senza valutarne l'idoneità come fotogramma iniziale.

Perché è problematico: molte fotografie sono pensate per essere viste in modo statico, non in movimento. Il ritaglio è troppo stretto e non lascia spazio al movimento della telecamera. I soggetti sono centrati, limitando le opzioni di inquadratura. L'illuminazione è piatta, con conseguenti effetti video poco brillanti. I file JPEG altamente compressi introducono artefatti.

Come risolvere il problema: prima di utilizzare qualsiasi immagine, valutarla in base al principio "progettata per il movimento". Un approccio migliore consiste nell'utilizzare pipeline specifiche per generare un fotogramma chiave.

Errore 3: rapporto di aspetto non corrispondente

Manifestazioni specifiche: Generazione di immagini quadrate e successiva creazione di video in formato 16:9, oppure utilizzo di immagini panoramiche per produrre video verticali.

Perché causa danni significativi: i modelli video ritagliano le immagini (con conseguente perdita dei contenuti accuratamente progettati) oppure riempiono le nuove proporzioni con contenuti generati da zero (con bordi aggiuntivi di qualità inferiore).

Come risolvere: Determinare le proporzioni finali del video prima di generare le immagini. Generare le immagini in base a tali proporzioni.

Errore 4: messaggi video eccessivamente descrittivi

Manifestazione specifica: Il video descrive contemporaneamente sia la scena che il suo movimento: "Un orologio di lusso su marmo scuro con un'illuminazione drammatica, la telecamera ruota lentamente e i riflessi di luce danzano sulla superficie".

Perché questo è problematico: la descrizione visiva potrebbe essere in conflitto con il contenuto dell'immagine. Se l'orologio è raffigurato su marmo bianco ma il prompt specifica marmo scuro, il modello riceve segnali contraddittori. Nella migliore delle ipotesi, la descrizione visiva diventa ridondante; nella peggiore, induce il modello a tentare di modificare il primo fotogramma accuratamente progettato.

Come creare: i suggerimenti video dovrebbero descrivere solo il movimento, le angolazioni della telecamera e l'atmosfera. Le immagini sono già state renderizzate. Ricordate questo principio: le immagini trasmettono "ciò che si vede", mentre i suggerimenti video dettano "come si muove".

Errore 5: Affrettarsi a generare video senza iterare attraverso le immagini

Manifestazione specifica: Generazione di un'immagine e suo inserimento diretto nella generazione video, anche quando presenta difetti evidenti, quali una composizione leggermente distorta, piccole imperfezioni o un'illuminazione non ottimale.

Perché l'impatto è maggiore: il video amplifica ogni difetto dell'immagine originale. Una piccola imperfezione in una fotografia diventa un difetto persistente e mobile in 120 fotogrammi in movimento. Una composizione leggermente decentrata diventa evidentemente sbagliata quando il movimento della telecamera attira l'attenzione sull'inquadratura. Ogni difetto di una fotografia diventa più evidente, non meno, nel video.

Come risolvere il problema: considera la fase dell'immagine come un punto di controllo della qualità. Non passare alla fase video finché l'immagine non è davvero soddisfacente. Ripeti l'operazione 3-5 volte. Usa la generazione da immagine a immagine per riparazioni mirate. L'output video non può superare la qualità dell'immagine sorgente.

Domande frequenti

Perché utilizzare l'intermediazione delle immagini invece di convertire direttamente il testo in video?

La generazione di video da testo richiede che l'IA crei simultaneamente sia immagini che movimenti dal testo, il che significa che hai un controllo minimo sulla composizione, l'aspetto dei personaggi, l'illuminazione e l'inquadratura. L'approccio "image-first" separa questi due compiti: si perfezionano le immagini durante la fase di creazione delle immagini, quindi si istruisce l'IA ad aggiungere solo il movimento. Ciò produce risultati più prevedibili e di qualità superiore, poiché l'IA riceve riferimenti visivi concreti invece di interpretare un testo ambiguo. La differenza è particolarmente evidente in scenari professionali che richiedono composizioni specifiche, palette di colori del marchio o un design coerente dei personaggi.

Qual è il processo completo per creare video AI da zero?

Il processo completo comprende tre fasi. Fase uno: utilizzare un generatore di prompt AI (come Image Prompt Generator di Seedance) per espandere il proprio concetto in un prompt immagine dettagliato. Fase due: utilizzare questo prompt all'interno di uno strumento di conversione da testo a immagine (come Text-to-Image di Seedance) per generare immagini di riferimento di alta qualità, ripetendo l'operazione fino a quando non si è soddisfatti. Fase tre: caricare l'immagine su un generatore di immagini in video (come image-to-video di Seedance), scrivere un prompt che descriva solo il movimento (movimento della telecamera e azioni del soggetto) e generare il video. L'intero processo richiede dai 5 ai 15 minuti, a seconda del numero di iterazioni necessarie durante la fase di immagine.

Quanti crediti costa l'intera pipeline su Seedance?

I costi variano a seconda della configurazione, ma un tipico ciclo di elaborazione comporta generalmente: generazione di prompt a 2 crediti, generazione di immagini a 4-8 crediti per iterazione (prevedendo 3-5 iterazioni, pari a 12-40 crediti) e generazione di video a 10-30 crediti (a seconda della durata e della risoluzione). Dall'ideazione al video finito, il costo totale varia generalmente da 25 a 70 crediti. Ciò rappresenta un risparmio significativo rispetto all'utilizzo di tre strumenti separati con tre abbonamenti separati.

È possibile utilizzare immagini generate da altri strumenti per creare video in Seedance?

Certamente. Lo strumento [Image-to-Video] di Seedance accetta qualsiasi immagine caricata, non è necessario che sia stata generata da Seedance. È possibile creare immagini utilizzando Midjourney, DALL-E, Tongyi Wanshang, Stable Diffusion o qualsiasi altro strumento e caricarle come primo fotogramma. Il vantaggio della pipeline integrata risiede nell'eliminazione della fase di download-upload, sebbene questa non sia obbligatoria. Quando si utilizzano immagini esterne, si consiglia il formato PNG con una risoluzione di 1024x1024 o superiore per evitare che gli artefatti di compressione influenzino l'output video.

Quale rapporto di aspetto deve essere utilizzato per le immagini?

Assicurati sempre che le proporzioni dell'immagine corrispondano al formato video finale. 16:9 per i video in formato orizzontale (YouTube, presentazioni, incorporamenti nei siti web), 9:16 per i video in formato verticale (TikTok, Instagram Reels, YouTube Shorts), 1:1 per i video quadrati (feed Instagram, alcuni annunci social). Genera immagini con le proporzioni corrette fin dall'inizio. Non generare immagini quadrate e poi aspettarti che gli strumenti video le convertano in 16:9: questo comporterà il ritaglio della composizione o l'aggiunta di contenuti generati dall'intelligenza artificiale ai bordi, compromettendo in entrambi i casi la qualità.

Come creare coppie di fotogrammi chiave?

Genera due fotogrammi utilizzando pipeline separate. Il primo fotogramma segue il flusso di lavoro standard: genera prompt, crea immagini e ripeti fino a ottenere un risultato soddisfacente. Il fotogramma finale utilizza image-to-image, caricando il primo fotogramma come immagine di riferimento e descrivendo le modifiche nello stato finale. Ciò garantisce la coerenza visiva (stessa posizione, stessa direzione dell'illuminazione, stessa combinazione di colori) e allo stesso tempo consente di ottenere il cambiamento narrativo desiderato (tempi, attività o stati d'animo diversi). Carica entrambi i fotogrammi su un generatore di video e lascia che l'IA crei la transizione. Per una guida completa a questa tecnica, consulta la Guida alla progettazione del primo e dell'ultimo fotogramma.

Questo flusso di lavoro è adatto per contenuti commerciali?

Adatto. La pipeline in tre fasi è stata adottata dai marchi di e-commerce per i video dei prodotti, dai team di marketing per le risorse pubblicitarie, dalle agenzie immobiliari per le presentazioni immobiliari e dalle agenzie di contenuti per la produzione di social media. I video generati dall'intelligenza artificiale della durata di 5-15 secondi con fotogrammi iniziali di alta qualità soddisfano ora gli standard professionali per i contenuti digitali. La chiave del successo commerciale sta nell'investire tempo nella fase di immagine: un fotogramma iniziale raffinato si traduce direttamente in un video raffinato. Per contenuti commerciali di durata più lunga o di livello televisivo, i video generati dall'intelligenza artificiale vengono sempre più utilizzati per l'ideazione creativa e la visualizzazione in anteprima, mentre la produzione finale viene ancora completata con metodi tradizionali per garantire il massimo controllo.

Cosa si deve fare se l'immagine generata presenta delle imperfezioni?

Non procedere con la generazione del video. Le imperfezioni dell'immagine sorgente saranno amplificate nel video: una mano leggermente distorta in un'immagine statica diventa una mano notevolmente deformata in una sequenza di movimento di 120 fotogrammi. Pre-elaborare l'immagine. Utilizzare [immagine-immagine] per rigenerare le aree problematiche preservando il resto della composizione. Per difetti gravi (figure umane deformate, geometrie non plausibili), rigenerare completamente l'immagine con un prompt modificato per aggirare il problema. Gli elementi soggetti a difetti includono le mani (specificare "mani lungo i fianchi" o "mani in tasca" per evitare pose complesse delle dita), il testo (evitare di includere testo nelle immagini generate) e i riflessi (semplificare le superfici riflettenti nei prompt). Procedere alla produzione del video solo quando l'immagine è perfetta.

Inizia a costruire il tuo percorso creativo

Il processo in tre fasi (prompt → immagine → video) rimane il metodo più affidabile per produrre video AI di alta qualità nel 2026. Separa il controllo creativo necessario (come deve apparire la scena) dalla capacità generativa desiderata (come deve muoversi), ottenendo video in linea con la propria visione piuttosto che con ipotesi casuali dell'AI.

Ogni buon video inizia con una buona immagine. Ogni buona immagine inizia con un buon suggerimento. Prepara bene le basi e tutto il resto verrà da sé.

Fase uno: generare prompt → — Trasforma i concetti in prompt di immagini di livello professionale utilizzando il generatore di prompt AI di Seedance.

Fase due: Generare immagine → — Genera e perfeziona in modo iterativo il fotogramma iniziale perfetto per il tuo video.

Fase tre: Generare video → — Trasforma le immagini in video dinamici caratterizzati da movimento, angolazioni della telecamera e atmosfera.

Padroneggiare la tecnica del primo fotogramma → — Prendi il controllo della creazione dei tuoi video AI imparando a progettare fotogrammi di riferimento.

Ulteriori approfondimenti: Guida all'IA Image-to-Video | Guida alla progettazione del primo e dell'ultimo fotogramma | Guida completa all'IA Text-to-Image | Guida all'IA da immagine a immagine | Guida al generatore di prompt di immagini IA | I migliori generatori di immagini IA del 2026 | I migliori generatori di video AI per il 2026*