In breve

La tecnologia di generazione video basata sull'intelligenza artificiale sta superando la soglia più significativa dalla sua nascita: la sincronizzazione audiovisiva. Entro il 2026, i migliori generatori di video basati sull'intelligenza artificiale non produrranno più clip mute che richiedono il doppiaggio manuale. Produrranno effetti sonori che si adattano alle azioni sullo schermo, musica di sottofondo sincronizzata con le atmosfere visive e dialoghi sincronizzati con il movimento delle labbra in più lingue, il tutto in un unico processo di generazione. Questa guida tratta: I tre tipi principali di generazione audiovisiva basata sull'intelligenza artificiale (effetti sonori, colonne sonore, sincronizzazione labiale); Un flusso di lavoro completo in sei fasi per la creazione di video musicali basati sull'intelligenza artificiale partendo da zero; Otto scenari di applicazione nel mondo reale, dai video musicali di artisti indipendenti alla visualizzazione di podcast; Cinque modelli di prompt pronti all'uso; Un confronto completo di tutti gli strumenti con funzionalità audio; Inoltre, tecniche avanzate come la corrispondenza BPM e la sincronizzazione emotiva. Se i tuoi contenuti video richiedono l'audio, il che comprende praticamente tutta la produzione video, questo rappresenta il progresso più significativo nell'ambito dei video basati sull'intelligenza artificiale dopo la generazione di video da testo. Inizia subito a creare video musicali basati sull'intelligenza artificiale -->

Il passaggio dai video AI muti alla perfetta sincronizzazione labiale rappresenta il salto di qualità più significativo nella storia dei contenuti generati dall'intelligenza artificiale. Compiti che un tempo richiedevano settimane di lavoro da parte dei team di post-produzione di Hollywood possono ora essere realizzati all'interno di un unico processo generativo.

La rivoluzione audio nei video basati sull'intelligenza artificiale

Per un periodo piuttosto lungo, i video generati dall'intelligenza artificiale sono rimasti un mezzo fondamentalmente incompleto. La qualità delle immagini è migliorata a un ritmo notevole: dai clip sfocati della durata di pochi secondi all'inizio del 2024 alle sequenze di un minuto con realismo fotografico alla fine del 2025. Tuttavia, tutti questi video avevano un limite in comune: erano muti.

L'era del cinema muto: dal 2024 all'inizio del 2025

La prima generazione di strumenti video basati sull'intelligenza artificiale, Runway Gen-2, Pika 1.0 e le prime versioni di Keeling, era in grado di generare solo filmati. Non c'erano tracce audio, effetti sonori o musica. Il risultato era un file MP4 puramente visivo, che richiedeva doppiaggio, missaggio e sincronizzazione manuali in un flusso di lavoro di editing separato. Non si trattava di un inconveniente minore, ma di un divario fondamentale tra le capacità di produzione dell'intelligenza artificiale e le aspettative del pubblico.

La percezione umana dei video è profondamente multimodale. La ricerca nel campo delle neuroscienze dimostra costantemente che l'audio contribuisce per il 50% o più all'impatto emotivo di qualsiasi esperienza video. Una ripresa cinematografica di un paesaggio, per quanto fotorealistica, risulterebbe piatta e artificiale senza il suono del vento, il canto degli uccelli o una colonna sonora crescente. Un personaggio che parla senza emettere alcun suono, con le labbra che si muovono silenziosamente, precipita direttamente nella "uncanny valley" (la valle dell'inquietudine). L'"era del silenzio" dei video generati dall'intelligenza artificiale significa che ogni clip generata richiede un ampio lavoro di post-produzione per apparire completa.

Per i creatori professionisti, ciò richiede il mantenimento di due flussi di lavoro separati per la generazione visiva e la produzione audio, raddoppiando sia il tempo che le competenze necessarie. Per i creatori ordinari, ciò significa che i video generati dall'IA sembrano perennemente incompleti: impressionanti come dimostrazioni tecniche, ma inutilizzabili come contenuti finali.

2025-2026: Convergenza tra suono e immagine

Le innovazioni arrivano per gradi. Veo 3 di Google ha annunciato funzionalità native di generazione audio, dimostrando come un unico modello possa produrre contemporaneamente video e suoni sincronizzati. Non si tratta di audio sovrapposto al video in fase di post-produzione, bensì di audio generato come parte integrante dell'output video, con suoni ambientali che corrispondono esattamente all'azione sullo schermo.

Nello stesso periodo, Seedance 2.0 (sviluppato dal team Seed di ByteDance) ha rilasciato una suite audio completa che comprende tre funzionalità distinte: generazione di effetti sonori (SFX) basati sull'intelligenza artificiale sincronizzati con i contenuti video, generazione di colonne sonore basate sull'intelligenza artificiale in linea con le atmosfere visive e tecnologia di sincronizzazione labiale basata sull'intelligenza artificiale che mappa l'audio del parlato ai movimenti della bocca dei personaggi (con supporto per otto lingue, compreso il cinese). Pika ha introdotto la sua funzione Sound Effects per la creazione di paesaggi sonori ambientali di base. La diga dell'innovazione audio è finalmente crollata.

Questo cambiamento è significativo perché trasforma i video generati dall'intelligenza artificiale da "materiale visivo che richiede una post-produzione manuale" a "un formato multimediale completo e pronto per la pubblicazione". Il divario tra "clip generate dall'intelligenza artificiale" e "contenuti video finiti" si è ridotto da ore di editing a pochi minuti di generazione.

Significato speciale per i creatori cinesi: questa trasformazione offre maggiori opportunità ai creatori nazionali. Piattaforme come Douyin, Kuaishou e Bilibili hanno favorito la nascita di un vasto ecosistema creativo per i video musicali di breve durata. Sebbene i musicisti indipendenti abbiano conquistato un pubblico su NetEase Cloud Music e QQ Music, spesso non dispongono di contenuti visivi all'altezza della loro qualità musicale. I video musicali generati dall'intelligenza artificiale colmano direttamente questa lacuna: i produttori che realizzano musica di livello professionale sui loro laptop possono ora creare video musicali altrettanto curati utilizzando l'intelligenza artificiale.

Perché l'audio è l'ultimo tassello del puzzle

Prendiamo ad esempio il flusso di lavoro di produzione dei contenuti di un creatore di contenuti Bilibili, di un creatore Xiaohongshu o di un musicista indipendente:

- Concetto -- Di cosa tratta il video?

- Immagini -- Che aspetto ha il video?

- Audio -- Come suona il video?

- Sincronizzazione -- Le immagini e l'audio sono sincronizzati?

- Rifinitura -- È pronto per essere pubblicato?

Entro il 2025, gli strumenti video basati sull'intelligenza artificiale avevano risolto efficacemente i passaggi 1 e 2. I passaggi 3 e 4 rimanevano interamente manuali. Grazie ai generatori dotati di funzionalità audio, ora era possibile completare i passaggi da 1 a 4 con un unico strumento. La fase 5, ovvero la rifinitura finale, rimane l'unica fase manuale, anche se la sua necessità diminuisce con il miglioramento della qualità del risultato.

Per la produzione di video musicali, questo rappresenta un cambiamento rivoluzionario. Un musicista indipendente che prima non poteva permettersi i costi di produzione tradizionali di un video musicale ora può realizzarne uno. Un creatore di Bilibili che produce musica lo-fi può creare accompagnamenti visivi per ogni brano. Un team di marketing può produrre pubblicità di prodotti con colonne sonore perfettamente abbinate senza dover assumere compositori o acquistare musica protetta da copyright.

Il panorama attuale degli strumenti con funzionalità audio

A febbraio 2026, tre piattaforme sono leader nel settore dei video generati dall'intelligenza artificiale con audio integrato:

- Seedance 2.0: la soluzione audiovisiva più completa. Supporta la generazione di effetti sonori, la creazione di colonne sonore/musica basata sull'intelligenza artificiale e il lip-syncing multilingue (8 lingue, compreso il cinese). Adatto sia per flussi di lavoro da testo a video che da immagine a video. Essendo un prodotto ByteDance, è accessibile direttamente in Cina senza VPN e supporta Alipay/WeChat Pay. Questa guida farà riferimento principalmente a questa piattaforma.

- Google Veo 3: potenti funzionalità di generazione audio native, inclusi suoni ambientali ed effetti atmosferici. I risultati sono impressionanti, anche se manca il controllo granulare di Seedance sui tipi e gli stili audio. **Richiede una VPN per l'uso all'interno della Cina. ** Per un confronto dettagliato, consultare Seedance vs Veo 3 Confronto approfondito.

- Pika 2.0: Generazione di effetti sonori di base. Limitato agli effetti sonori ambientali, senza generazione di musica o supporto per il lip-sync. Va nella giusta direzione, ma non è una soluzione audio completa. Richiede una VPN.

Altri strumenti all'interno dell'ecosistema — Keeling, Runway e Conch AI — rimangono principalmente focalizzati sulla produzione di output puramente visivi al momento della stesura di questo articolo, anche se si prevede che seguiranno a breve l'esempio. Per un confronto più ampio di tutti i generatori, si prega di fare riferimento a The Complete 2026 AI Video Generator Comparison.

Opzioni aggiuntive per gli utenti domestici - Strumenti di generazione musicale basati sull'intelligenza artificiale: oltre alle funzionalità audio dei video basati sull'intelligenza artificiale, vale la pena esplorare le piattaforme dedicate alla generazione musicale basate sull'intelligenza artificiale presenti in Cina: SkyMusic (prodotto da Kunlun Wanwei, eccellente nella generazione di testi in cinese) e NetEase Tianyin (prodotto da NetEase, integrato con l'ecosistema NetEase Cloud Music). Questi strumenti possono funzionare come processi di creazione musicale autonomi, con la musica generata successivamente importata in Seedance come materiale di riferimento audio per la produzione video.

Tre principali tipi di generazione audiovisiva basata sull'intelligenza artificiale

Non tutti gli audio AI sono uguali. Questa tecnologia comprende tre funzionalità fondamentalmente distinte, ciascuna delle quali serve a scopi creativi diversi e opera attraverso meccanismi tecnici diversi. Comprendere queste distinzioni è fondamentale per selezionare l'approccio giusto per il proprio progetto.

La generazione di effetti sonori tramite IA esegue un'analisi fotogramma per fotogramma dei contenuti video, identificando le azioni e gli ambienti che producono suoni, quindi sintetizza le forme d'onda audio corrispondenti. Il risultato finale è un audio ambientale organicamente collegato al contenuto visivo.

Tipo uno: effetti sonori AI (SFX)

La generazione di effetti sonori tramite IA produce automaticamente suoni ambientali e di azione che si adattano al contenuto sullo schermo. Quando i personaggi camminano su un sentiero di ghiaia, sentirai il rumore dei passi sulle pietre. Quando le onde si infrangono contro le rocce, sentirai il rumore del mare. Quando i motori delle auto rombano in una scena di strada, sentirai il rumore dei motori.

Come funziona Seedance Sound Generation: il modello di intelligenza artificiale analizza il contenuto visivo del video generato, identificando oggetti, azioni, ambienti e interazioni fisiche, e produce una colonna sonora di accompagnamento con effetti sonori corrispondenti. Non si tratta semplicemente di abbinare la parola "oceano" a un filmato di repertorio che mostra le onde. Il modello genera un audio unico che risponde a caratteristiche visive specifiche: l'intensità delle onde, la loro distanza dalla telecamera, la presenza del vento e le proprietà acustiche dell'ambiente.

Sound Generation è specializzata nell'elaborazione dei seguenti tipi di suoni:

- Suoni ambientali atmosferici (vento, pioggia, tuoni, suoni della foresta, traffico urbano)

- Suoni di interazione fisica (passi su varie superfici, apertura/chiusura di porte, posizionamento di oggetti)

- Suoni naturali (scorrere dell'acqua, canto degli uccelli, frinire degli insetti, fruscio delle foglie)

- Suoni meccanici (motori, funzionamento di macchinari, pressione di pulsanti, ronzii elettronici)

- Suoni di impatto (collisioni, schizzi, frantumazioni, crolli)

Tecniche per suggerire i suoni attraverso i prompt: anche quando si utilizza l'intelligenza artificiale text-to-video, è possibile influenzare l'output audio descrivendo gli elementi che producono suoni all'interno dei prompt visivi. "Pioggia che batte su un tetto di lamiera" produce un audio di pioggia più intenso rispetto a "leggera pioggerellina su un giardino". L'audio dei passi di "stivali pesanti che calpestano una griglia metallica" è completamente diverso da quello di "piedi nudi sulla sabbia calda". Le descrizioni visive guidano la generazione dell'audio, quindi rappresentare scene ricche dal punto di vista acustico produce paesaggi sonori più ricchi.

Limiti attuali: la generazione del suono eccelle nei suoni ambientali e naturali, ma può avere difficoltà con paesaggi sonori complessi e multistrato (come un ristorante affollato con conversazioni sovrapposte, rumore di posate, rumori di cucina e musica di sottofondo). Gestisce anche meglio i suoni organici rispetto alle caratteristiche audio altamente specifiche e identificabili (il suono del motore di un particolare modello di auto, il canto di una specifica specie di uccello).

Tipo due: musica e colonne sonore generate dall'intelligenza artificiale

La generazione di musica tramite IA crea musica di sottofondo, colonne sonore e brani originali per i tuoi video che si adattano perfettamente al contenuto visivo, all'atmosfera e al ritmo. Non si tratta semplicemente di aggiungere musica generica esente da diritti d'autore: l'IA genera composizioni originali su misura per il filmato.

Controllo dello stile: è possibile guidare lo stile musicale tramite suggerimenti e impostazioni di generazione. È supportata un'ampia gamma di stili:

- Film Orchestral: Grandi archi, ottoni e percussioni, ideali per paesaggi epici o scene drammatiche

- Dynamic Electronic: Sintetizzatori e ritmi vibranti, ideali per contenuti dal ritmo serrato, presentazioni di prodotti o social media

- Musica ambient/atmosferica: Texture morbide, toni stratificati e bassi sostenuti, perfetti per contenuti meditativi, presentazioni di immobili o filmati naturalistici al rallentatore

- Hip-hop lo-fi: Iconici ritmi caldi e leggermente stonati abbinati al crepitio del vinile, ideali per contenuti di studio/concentrazione

- Tensione/Suspense: Archi dissonanti, percussioni profonde e urgenza crescente stratificata, perfetti per trailer e video promozionali

- Folk/ Acoustic: chitarra, pianoforte e strumenti organici, adatto a contenuti personalizzati e intimi

- Traditional Chinese/Ancient Style: guzheng, dizi, pipa e altri strumenti tradizionali cinesi, adatto a contenuti video in stile tradizionale cinese e video musicali in stile antico -- Rappresenta la direzione stilistica più distintiva nella creazione di video musicali con IA cinese.

Stili musicali diversi producono caratteristiche delle forme d'onda nettamente diverse. La generazione di colonne sonore tramite IA non solo si adatta al genere, ma allinea anche la curva di energia, sincronizzando l'intensità della musica con l'azione visiva in tutto il video.

Adattamento della durata: la musica generata dall'intelligenza artificiale si adatterà alla durata del tuo video. Una clip di 5 secondi riceverà una frase musicale coerente di 5 secondi. Un video di 30 secondi riceverà un brano strutturato con introduzione, sviluppo e conclusione. Questo elimina il problema comune di dover sfumare manualmente la musica di repertorio che non è stata progettata per la durata specifica del tuo video.

Differenze rispetto agli strumenti musicali AI autonomi: forse conosci già generatori musicali AI dedicati come Suno o Udio, che creano brani musicali autonomi a partire da prompt di testo. Sebbene questi strumenti producano musica eccellente, mancano di consapevolezza visiva: non hanno alcuna conoscenza dell'aspetto del tuo video, dei momenti visivi chiave o dei cambiamenti di atmosfera all'interno del filmato. La generazione di colonne sonore AI all'interno di strumenti video come Seedance funziona in modo fondamentalmente diverso, poiché la musica viene generata in risposta al contenuto visivo. La colonna sonora si intensifica man mano che le immagini diventano più drammatiche, il suo ritmo si allinea con il movimento sullo schermo e la sua atmosfera si adatta all'umore di ogni scena.

In altre parole, gli strumenti musicali AI autonomi e i generatori di video AI sono complementari. Un flusso di lavoro solido prevede innanzitutto la generazione di una traccia all'interno di Suno o Udio (o alternative nazionali come SkyMusic e NetEase Tianyin), quindi l'inserimento di questo file audio in Seedance come materiale di riferimento per generare il video. Il generatore di video AI creerà immagini che rispondono alla struttura della musica. Descriveremo questo flusso di lavoro in dettaglio nel tutorial passo passo riportato di seguito.

Tipo tre: sincronizzazione labiale e sintesi vocale basate sull'intelligenza artificiale

La generazione di sincronizzazione labiale tramite IA presenta i requisiti tecnici più complessi tra i tre tipi di audio. Essa mappa l'audio vocale, sia esso caricato o generato, ai movimenti labiali di un personaggio, creando l'effetto visivo del personaggio sullo schermo che parla o canta.

Supporto multilingue: Seedance 2.0 supporta il lip-syncing in otto lingue, tra cui cinese, inglese, giapponese, coreano, spagnolo, francese, tedesco e portoghese. Questo va oltre il semplice doppiaggio audio: il modello regola la forma della bocca dei personaggi, i movimenti della mascella e le microespressioni facciali per adattarsi alle caratteristiche vocali di ciascuna lingua. La forma della bocca per la vocale "o" cinese è diversa da quella della "O" inglese, mentre la vocale "u" giapponese varia rispetto alla "u" inglese. Una sincronizzazione labiale accurata deve tenere conto di queste differenze linguistiche.

Il significato pratico del lip-syncing cinese: per i creatori nazionali, il lip-syncing cinese consente ai personaggi generati dall'intelligenza artificiale di eseguire le vostre canzoni in mandarino standard o di adattarsi con precisione ai rapidi testi cinesi nei video musicali rap. Ciò racchiude un immenso potenziale creativo all'interno delle comunità di cover song e anime di TikTok e Bilibili: i cantanti virtuali generati dall'intelligenza artificiale stanno emergendo come un nuovo formato di contenuti.

Il lip-syncing basato sull'intelligenza artificiale trasforma un personaggio visivamente realistico ma silenzioso in una presenza vocale. Questa tecnologia non solo regola la forma della bocca, ma modifica anche la posizione della mascella, la tensione delle guance e le sottili microespressioni facciali per adattarle ai fonemi del discorso.

Come funziona: il processo inizia con un riferimento audio, ovvero una registrazione vocale caricata dall'utente o un discorso generato dall'intelligenza artificiale. Il modello analizza il contenuto fonetico dell'audio (quali suoni vengono prodotti in quali momenti) e genera le corrispondenti forme delle labbra e i movimenti facciali fotogramma per fotogramma. Per ottenere risultati ottimali, l'audio dovrebbe presentare un discorso chiaro, a velocità moderata e con un rumore di fondo minimo.

Scenari di applicazione:

- Esseri umani digitali e avatar virtuali: creazione di host AI parlanti per canali Bilibili/YouTube, formazione aziendale o assistenza clienti

- Personaggi animati: doppiaggio di personaggi animati generati dall'IA senza sincronizzazione labiale fotogramma per fotogramma

- Doppiaggio multilingue: Generare versioni sincronizzate di contenuti audiovisivi esistenti in altre lingue, abbinando il nuovo audio ai movimenti della bocca dei personaggi

- Esibizioni in video musicali: Sincronizzare le esibizioni visive dei cantanti con le tracce vocali per creare autentici effetti di esibizione in video musicali

- Visualizzazione di podcast e audiolibri: Trasformare contenuti audio puri in media visivi con personaggi parlanti

Limiti attuali — valutazione onesta: il lip-syncing rimane il più giovane e meno maturo dei tre tipi audiovisivi. Sebbene siano stati compiuti progressi significativi, permangono alcune sfide. Il parlato veloce a volte supera la capacità del modello di generare movimenti labiali corrispondenti, causando una leggera desincronizzazione. Angoli facciali estremi (profili laterali, angoli ripidi verso l'alto) riducono la precisione del lip-sync a causa del minor numero di punti di riferimento visibili della bocca. Il parlato con accenti pronunciati o caratteristiche vocali insolite può produrre risultati meno precisi rispetto ai modelli di parlato standard. Per le canzoni cinesi con un ritmo estremamente rapido, come il rap, la precisione della sincronizzazione può essere inferiore rispetto al canto a ritmo standard. Sebbene la tecnologia stia avanzando rapidamente, è importante fissare aspettative ragionevoli: nel 2026 il lip-sync eccellerà negli scenari di parlato standard, ma rimarrà in fase di sviluppo per i casi limite.

Tutorial passo passo: Creare video musicali con l'intelligenza artificiale partendo da zero

Seguendo questo flusso di lavoro in sei fasi, è possibile creare un video musicale completo con audio e immagini sincronizzati, dall'ideazione alla realizzazione finale. Questo processo è applicabile sia che siate musicisti indipendenti alle prese con il vostro primo video musicale, creatori di contenuti Bilibili che stanno costruendo un canale dedicato alla musica, o esperti di marketing che producono video per marchi.

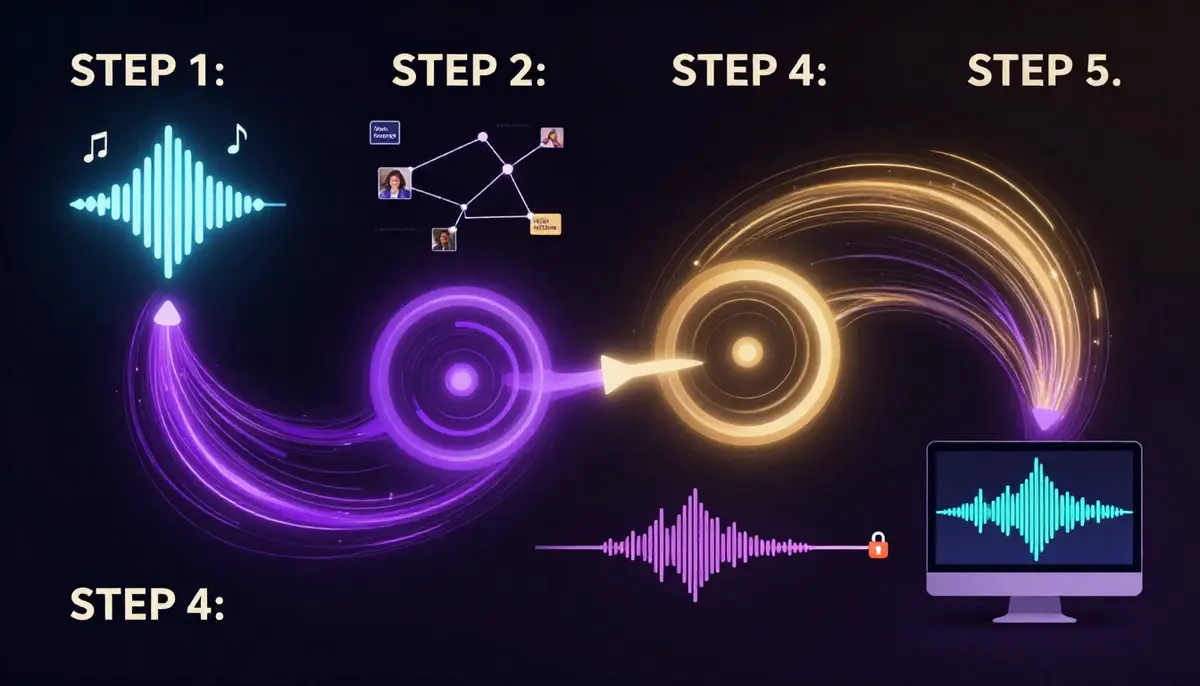

Un flusso di lavoro completo per la creazione di video musicali basati sull'intelligenza artificiale, dalla sorgente audio al prodotto finito. Ogni fase si basa su quella precedente, con sincronizzazione audiovisiva ottenuta automaticamente durante la generazione.

Fase uno: preparare la musica o la fonte audio

Ogni video musicale inizia con la musica. Hai tre possibilità:

Opzione A — Utilizzo della propria musica: se sei un musicista o possiedi brani con licenza, prepara i tuoi file audio. I formati supportati includono in genere MP3, WAV e AAC. Per ottenere risultati ottimali, utilizza versioni master o mix di alta qualità (non riproduzioni compresse in streaming). Un audio pulito e ben separato produce risultati di sincronizzazione labiale superiori rispetto ai file fortemente compressi.

Opzione B — Generare musica con l'AI: utilizzare generatori di musica AI autonomi per creare brani originali. Tra gli strumenti disponibili all'estero figurano Suno e Udio; a livello nazionale, si consiglia SkyMusic (eccellente nella generazione di testi in cinese, supporta diversi stili musicali cinesi) o NetEase Tianyin (integrato con l'ecosistema NetEase Cloud Music). Descrivere lo stile, l'atmosfera, il tempo e l'arrangiamento desiderati per generare più versioni, selezionando quella che meglio si adatta al proprio concetto visivo. Salvare localmente.

Opzione C — Controllo AI completo: se non disponi di una sorgente audio specifica e desideri che l'AI generi contemporaneamente immagini e audio, salta la preparazione dell'audio e affidati direttamente alla generazione della colonna sonora integrata in Seedance. In questo scenario, il tuo prompt visivo influenzerà il risultato musicale. Questo rappresenta l'approccio più rapido, anche se offre un controllo minore sull'effetto musicale preciso.

Consiglio per i musicisti: se desiderate che le immagini rispondano a momenti specifici della musica (un calo di tempo, un cambio di tonalità, l'entrata della voce), annotate questi timestamp. Utilizzerete queste informazioni nei vostri prompt e potrete generare segmenti in linea con la struttura della canzone.

Fase due: Creazione di stimoli visivi a complemento della musica

Le immagini dovrebbero rappresentare in modo naturale il contenuto dell'audio. Non si tratta di illustrare parola per parola il testo della canzone, ma piuttosto di creare un'atmosfera visiva che amplifichi il contenuto emotivo della musica.

Abbinare lo stile musicale allo stile visivo:

| Stile musicale | Direzione visiva | Parole chiave |

|---|---|---|

| Orchestra cinematografica | Paesaggi vasti, cieli drammatici, scala epica | "vasto", "maestoso", "dolly lento", "qualità IMAX" |

| Lo-fi / Relax | Toni morbidi, interni accoglienti, pioggerellina, luci calde | "pastello", "messa a fuoco morbida", "caldo", "movimento delicato" |

| Elettronica dinamica | Tagli rapidi, neon, urbano, riprese dinamiche | "vibrante", "dinamico", "neon", "veloce" |

| Ballata lirica | Primo piano intimo, luce di candela, slow motion | "intimo", "profondità di campo ridotta", "toni caldi" |

| Cupo/Drammatico | Ombre, contrasto elevato, tensione, tavolozza di colori minimalista | "illuminazione drammatica", "silhouette", "contrasto elevato" |

| Stile cinese/antico | Paesaggi, padiglioni e torri, elementi dipinti a inchiostro, petali che cadono | "Paesaggio cinese", "stile pittura a inchiostro", "architettura tradizionale", "etereo" |

| Rap/Hip-hop | Scene di strada, graffiti, paesaggi notturni, aloni dei fari delle auto | "urbano", "cultura di strada", "insegne al neon", "dinamico a mano libera" |

Per tecniche complete relative ai prompt, consultare la Guida ai prompt Seedance. Principi fondamentali per i prompt dei video musicali: descrivere movimenti che risultino naturali rispetto al ritmo della canzone. I brani allegri richiedono immagini dinamiche, mentre le canzoni più lente richiedono movimenti costanti e aggraziati.

Fase tre: selezionare la modalità audio

Quando generi in Seedance, seleziona la modalità audio appropriata in base al tuo progetto:

Modalità Effetti sonori (SFX): ideale quando il video presenta elementi ambientali o d'azione distinti che richiedono suoni ambientali autentici. Un'auto che guida sotto la pioggia dovrebbe suonare come un'auto sotto la pioggia. Le scene oceaniche dovrebbero presentare il suono delle onde. La modalità SFX genera automaticamente questi suoni in base al filmato.

Modalità Musica/Colonna sonora: ideale quando desideri che l'IA generi musica di sottofondo che accompagni i contenuti visivi. Utilizzala quando non sono disponibili brani già pronti e desideri che lo strumento crei colonne sonore originali. Puoi influenzare lo stile attraverso suggerimenti visivi: un paesaggio urbano cyberpunk al neon genererà musica completamente diversa da un tranquillo tramonto in montagna.

Modalità voce/sincronizzazione labiale: ideale quando il video presenta personaggi che parlano o cantano e occorre sincronizzare l'audio con i movimenti della bocca. Carica la traccia vocale o la registrazione vocale e l'IA genererà i movimenti labiali corrispondenti per il personaggio.

Approccio combinato: per un'esperienza video musicale più completa, prendete in considerazione un flusso di lavoro multi-passaggio. Innanzitutto, generate un video di base con immagini e musica utilizzando la modalità colonna sonora. Se è necessario sovrapporre effetti sonori ambientali alla musica, utilizzate la modalità SFX in un secondo passaggio o aggiungeteli durante la post-produzione. Se i personaggi devono cantare, elaborate il tutto utilizzando la modalità sincronizzazione labiale sulla traccia vocale.

Fase quattro: Caricare materiali di riferimento (facoltativo ma vivamente consigliato)

Gli input di riferimento possono migliorare significativamente la qualità e l'accuratezza dell'output. Per la produzione di video musicali, i seguenti tipi di riferimento sono particolarmente utili:

File audio di riferimento: carica il tuo brano musicale. L'IA lo utilizzerà come scheletro audio per il video, generando immagini che rispondono al contenuto musicale. Questo è il riferimento più influente nella produzione di MV.

Immagine di riferimento: carica un'immagine statica che definisca lo stile visivo desiderato. Potrebbe trattarsi della copertina di un album, uno screenshot di una moodboard, un fotogramma di un video musicale esistente che ti piace o un'immagine generata dall'intelligenza artificiale che cattura l'estetica desiderata. La funzione [text-to-video] di Seedance utilizza questo riferimento per mantenere la coerenza visiva.

Video di riferimento: se disponi di un video musicale esistente di cui desideri emulare i movimenti della telecamera, il ritmo di montaggio o lo stile visivo, caricalo come riferimento. L'IA imparerà i modelli di movimento, i tempi di transizione e la composizione visiva dal tuo riferimento mentre genera contenuti originali.

Fase cinque: generare e regolare la sincronizzazione audiovisiva

Clicca su "Genera" per ottenere il risultato iniziale dall'IA. Durante la revisione, presta particolare attenzione alla precisione della sincronizzazione labiale:

Punti chiave:

- L'energia musicale corrisponde all'energia visiva? Un crescendo orchestrale drammatico dovrebbe coincidere con un momento visivamente drammatico, non con una scena statica.

- La tempistica degli effetti sonori è accurata? I passi dovrebbero verificarsi quando il piede entra in contatto con il suolo. I suoni di impatto devono corrispondere alle collisioni visive.

- Il sincronismo labiale è convincente? Osservate le bocche dei personaggi a velocità di visione normale. Piccole discrepanze a livello di fotogramma sono invisibili a velocità normale, ma visibili al rallentatore, mentre il pubblico guarda a velocità normale.

- L'atmosfera generale è coerente? La tavolozza dei colori visivi, la tonalità e l'arrangiamento musicale e il ritmo devono trasmettere collettivamente la stessa narrazione emotiva.

Se la sincronizzazione risulta problematica: rigenerare dopo aver modificato il prompt. Se la musica risulta troppo intensa per le immagini, incorporare elementi più dinamici nel prompt visivo. Se le immagini risultano troppo veloci per una canzone lenta, includere nel prompt termini che suggeriscono il tempo, come "lento", "delicato" o "deliberato". L'IA risponderà a questi segnali ritmici.

Passaggio sei: esportare i file audio e video completi

Una volta soddisfatto, esporta il video musicale finito. Il risultato è un unico file contenente tracce video e audio già sincronizzate, eliminando la necessità di allineare manualmente l'audio all'interno dell'editor.

Note sull'esportazione:

- Formato: MP4 (video H.264 + audio AAC) è lo standard universale accettato su tutte le piattaforme

- Risoluzione: esportare alla massima risoluzione disponibile. Per i video musicali, 1080p è il requisito minimo; 2K o 4K sono preferibili.

- Formato: 16:9 per Bilibili/YouTube e distribuzione MV standard; 9:16 per Douyin, Kuaishou, Xiaohongshu e Instagram Reels; 1:1 per WeChat Moments e feed Instagram

- Qualità audio: assicurarsi che le impostazioni di esportazione preservino la fedeltà audio. Se vengono caricati file master di alta qualità, l'esportazione dovrebbe mantenere questo livello di fedeltà.

Passaggi facoltativi dopo l'esportazione: sebbene i video musicali generati dall'intelligenza artificiale possano essere pubblicati direttamente, potresti voler aggiungere alcuni ritocchi finali in un editor video: titoli, sottotitoli dei testi, loghi dell'artista/etichetta, transizioni tra le sezioni o color grading. Strumenti domestici comunemente utilizzati come CapCut, DaVinci Resolve o Premiere sono particolarmente adatti per questa rifinitura finale. Prima di pubblicare su Bilibili, ricordati di aggiungere i sottotitoli e un'immagine di copertina: sono fondamentali per l'algoritmo di raccomandazione della piattaforma.

Crea subito il tuo primo video musicale con l'intelligenza artificiale -->

8 principali scenari di applicazione dei video musicali basati sull'intelligenza artificiale

La generazione di video musicali tramite IA non è una tecnologia monouso. La fusione della creazione visiva con l'audio sincronizzato apre nuove possibilità creative in diversi tipi di contenuti e settori. Di seguito sono riportati otto scenari applicativi specifici, ciascuno accompagnato da una guida operativa mirata.

Otto scenari applicativi distinti per la generazione di video musicali con IA, ciascuno con stili visivi, requisiti audio e destinatari unici. La stessa tecnologia di base si adatta a direzioni creative completamente diverse.

- Musicista indipendente Video musicale

Opportunità: i musicisti indipendenti hanno a lungo dovuto fare i conti con una dolorosa disparità, ovvero il divario tra la qualità musicale e il livello dei contenuti visivi che l'accompagnano. Un produttore musicale che lavora nella propria camera da letto può creare brani raffinati e pronti per essere pubblicati su un laptop, ma la produzione di un video musicale adeguato costa tradizionalmente tra le 2.000 e le 15.000 sterline. Anche le riprese più semplici hanno un prezzo elevato. La generazione di video musicali tramite IA ha eliminato completamente questa barriera di costo.

Valore unico in Cina: negli ultimi anni, la scena musicale indipendente nazionale (hip-hop, elettronica, ispirata alla tradizione cinese, folk) ha conosciuto una grande fioritura. Il numero di artisti indipendenti su NetEase Cloud Music e QQ Music continua a crescere, ma la stragrande maggioranza delle loro opere esiste solo sotto forma di tracce audio senza video musicali di accompagnamento. Sulla piattaforma musicale Bilibili, i contributi con immagini di alta qualità ricevono un peso di raccomandazione significativamente più alto rispetto a quelli che comprendono solo audio abbinato a copertine statiche. Gli MV basati sull'intelligenza artificiale consentono a ogni musicista indipendente di creare opere visive.

Procedura: Carica il brano completato su Seedance come riferimento audio. Componi segnali visivi che catturino l'arco emotivo della canzone: non un'illustrazione scena per scena del testo, ma immagini che evocano gli stessi sentimenti. Il pop psichedelico si presta a immagini morbide, eteree e fluttuanti. Le composizioni lo-fi si abbinano bene a scene urbane calde e nostalgiche. La musica elettronica sperimentale si adatta a immagini astratte e surreali. La musica in stile cinese si abbina bene a paesaggi dipinti a inchiostro, architettura antica e scene di petali che cadono.

Best practice per i video musicali autonomi: se una canzone presenta sezioni distinte, prendete in considerazione una produzione segmentata. Create uno stile visivo per le strofe, un altro per il ritornello e un terzo per il bridge. Quindi assemblate questi segmenti utilizzando le transizioni in un software di editing come ShineVideo o DaVinci Resolve. Ogni sezione possiede una propria identità visiva, mentre la musica garantisce la continuità.

Aspettative ragionevoli: entro il 2026, i video musicali generati dall'intelligenza artificiale eccelleranno in direzioni visive stilizzate, atmosferiche e astratte. Saranno meno efficaci per i video musicali narrativi o basati sulle performance che richiedono attori specifici che eseguono azioni coreografate o quelli girati in particolari luoghi del mondo reale. Sfruttate i punti di forza dell'intelligenza artificiale: atmosfera, surrealismo e poesia visiva.

- Video con testi delle canzoni

Opportunità: i video con i testi delle canzoni sono diventati un formato di pubblicazione standard, spesso lanciati prima o insieme ai video musicali ufficiali. Incrementano gli ascolti in streaming, soddisfano gli ascoltatori interessati ai testi e fungono da primo punto di contatto visivo per i nuovi brani. La produzione tradizionale di video con i testi richiede la progettazione di grafica animata, animazioni di testo e immagini di sfondo. L'intelligenza artificiale semplifica questo processo riducendolo a prompt + sovrapposizioni di testo.

Procedura: genera loop visivi suggestivi che si adattino all'atmosfera della canzone. Dopo l'esportazione, aggiungi il testo della canzone sovrapposto utilizzando app come ShineVideo, After Effects o Canva Video. L'intelligenza artificiale si occupa dello sfondo visivo, tu ti occupi della tipografia.

Best practice: utilizza movimenti della telecamera lenti e fluidi che non competano con il testo per attirare l'attenzione. Evita scene visivamente disordinate: i testi devono rimanere chiaramente leggibili sullo sfondo. Crea immagini utilizzando una combinazione di colori che offra un buon contrasto con il colore del testo scelto. Quando pubblichi video con testi delle canzoni su Bilibili e NetEase Cloud Music, ricordati di sincronizzare i caricamenti con le piattaforme musicali corrispondenti per ottenere una doppia visibilità.

- Video musicali con sottofondo musicale su Bilibili/YouTube

Opportunità: "Musica lo-fi per studiare", "suoni della pioggia per dormire", "musica per meditare": canali su Bilibili e YouTube che generano un numero enorme di visualizzazioni grazie a una formula semplice: audio di qualità abbinato a un loop visivo. Alcuni dei canali musicali più grandi di YouTube sono costruiti interamente su questo modello. Le sezioni "live streaming per studiare" e "rumore bianco" di Bilibili sono altrettanto popolari. L'intelligenza artificiale rende la creazione simultanea di audio e immagini straordinariamente semplice.

Metodo: genera una scena visiva in loop: una stanza accogliente con la pioggia che cade fuori dalla finestra, lo skyline di una città di notte e un personaggio animato seduto a una scrivania. Accompagnare con musica lo-fi o ambient generata dall'intelligenza artificiale. Per l'ottimizzazione su YouTube, esportare in formato 16:9 con una risoluzione minima di 1080p, incorporando parole chiave pertinenti nel titolo, nella descrizione e nei tag. Per Bilibili, aggiungere tag come "apprendimento", "rumore bianco" o "aiuto per dormire" e selezionare la categoria appropriata per l'invio.

Modello di guadagno: i canali YouTube di alto livello possono guadagnare da 5.000 a 50.000 dollari al mese (circa 3.600-36.000 sterline) solo grazie agli introiti pubblicitari. Sebbene gli incentivi per i creatori di Bilibili siano relativamente modesti, la monetizzazione è possibile grazie alle quote di iscrizione premium, alla condivisione dei ricavi delle conferenze e al posizionamento pubblicitario. La chiave sta negli aggiornamenti costanti: caricare regolarmente i contenuti e creare una libreria di contenuti permette all'algoritmo di funzionare in modo efficace. I contenuti generati dall'intelligenza artificiale rendono possibile per un singolo creatore mantenere un ritmo di pubblicazione giornaliero.

4. TikTok/Kuaishou/Xiaohongshu Video musicali brevi

Opportunità: TikTok, Kuaishou, Xiaohongshu, Instagram Reels, TikTok e YouTube Shorts danno tutti grande priorità ai contenuti video con musica. I post con audio ottengono costantemente un coinvolgimento significativamente più elevato rispetto ai post silenziosi o solo testuali. Per i brand e i creator, produrre costantemente contenuti video brevi con colonne sonore rappresenta una maratona di contenuti senza sosta. L'intelligenza artificiale comprime i cicli di produzione da ore a pochi minuti.

Modalità di funzionamento: genera un video verticale (9:16) della durata di 5-15 secondi e attiva la modalità colonna sonora. L'IA produrrà contemporaneamente le immagini e la musica corrispondente. Se desideri utilizzare musica popolare dalla piattaforma, genera prima le immagini, quindi aggiungi la musica di sottofondo di tendenza all'interno dell'editor nativo di TikTok/Kuaishou. Se desideri un audio originale, lascia che sia l'IA a completare l'intero pacchetto.

Raccomandazioni per le piattaforme nazionali di video brevi:

- Douyin: i primi 1-2 secondi devono presentare un elemento visivo accattivante. Utilizzate parole che abbiano un impatto visivo immediato: rivelazioni drammatiche, colori vivaci o movimenti inaspettati. Douyin è impostato di default con l'audio attivato, quindi la qualità audio è fondamentale fin dal primo fotogramma.

- Kuaishou: Kelin (sviluppato da Kuaishou) si integra naturalmente con l'ecosistema Kuaishou. Se Kuaishou è la tua piattaforma principale, prendi in considerazione un flusso di lavoro combinato: genera immagini in Kelin e aggiungi l'audio in Seedance.

- Xiaohongshu: I video verticali 9:16 abbinati a musica d'atmosfera funzionano eccezionalmente bene su Xiaohongshu. I contenuti artistici, terapeutici e orientati all'ASMR dei video musicali generati dall'intelligenza artificiale si adattano perfettamente alla base di utenti di Xiaohongshu.

- Visualizzazione podcast

** Opportunità: i creatori di podcast devono affrontare una sfida legata alla distribuzione. I loro contenuti sono puramente audio, ma le piattaforme mainstream (Bilibili, YouTube, TikTok, Xiaohongshu) danno la priorità ai video. La "visualizzazione dei podcast", ovvero la rappresentazione visiva dinamica dei contenuti audio, risolve questo problema conferendo al materiale audio una forma visiva adatta alle piattaforme video. La visualizzazione tradizionale dei podcast richiede software di grafica animata e competenze di progettazione. L'IA genera automaticamente questi elementi.

Modalità di funzionamento: carica il tuo clip audio podcast su Seedance. L'intelligenza artificiale genera immagini dinamiche in risposta all'audio: i cambiamenti di intensità, ritmo e tonalità all'interno del discorso producono trasformazioni visive corrispondenti. In alternativa, componi un prompt visivo che rappresenti il tema del tuo podcast, consentendo all'intelligenza artificiale di generare un loop visivo d'atmosfera che accompagni l'audio.

Strategia Bilibili: Bilibili è emersa come una delle più grandi piattaforme di video di lunga durata della Cina, con numerosi podcaster di spicco che ora pubblicano lì le versioni video dei loro contenuti. Un accompagnamento visivo generato dall'intelligenza artificiale trasforma i podcast puramente audio in video compatibili con Bilibili con il minimo sforzo. Anche semplici loop visivi funzionano significativamente meglio per l'algoritmo di raccomandazione di Bilibili rispetto a una miniatura statica.

- Colonna sonora pubblicitaria del prodotto

Opportunità: i video dei prodotti accompagnati da musica adeguata ottengono tassi di conversione significativamente più elevati rispetto ai video dei prodotti senza audio. Tuttavia, la licenza per l'uso commerciale della musica costa dai 500 ai 5.000 RMB per brano, mentre commissionare compositori per colonne sonore personalizzate risulta ancora più costoso. Le colonne sonore generate dall'intelligenza artificiale eliminano sia i costi che le complessità legate al copyright: la musica generata è originale e utilizzabile a fini commerciali.

Procedura: generare contenuti visivi seguendo il flusso di lavoro dei video dei prodotti, quindi attivare la modalità colonna sonora per aggiungere musica corrispondente. Per le presentazioni di prodotti premium, generare musica orchestrale o ambientale cinematografica. Per i lanci di prodotti dinamici, generare musica elettronica energica. L'IA abbina automaticamente l'energia della musica al contenuto visivo.

Vantaggio in termini di copyright: uno dei principali vantaggi della musica generata dall'intelligenza artificiale di Seedance è che il risultato è originale, non campionato da brani esistenti protetti da copyright. Ciò elimina il rischio di reclami relativi al copyright associati all'uso di musica riconoscibile nelle pubblicità. Con il piano a pagamento, si acquisiscono i diritti di utilizzo commerciale del risultato generato, che può quindi essere utilizzato nelle pubblicità senza costi aggiuntivi per il copyright. Quando pubblichi video di prodotti su piattaforme di e-commerce come Taobao, JD.com e Douyin Shop, non devi preoccuparti che i contenuti vengano rimossi a causa di violazioni del copyright musicale.

- Trailer di giochi e applicazioni

Opportunità: i trailer dei giochi e i video di anteprima delle app si basano in larga misura sulla sincronizzazione audiovisiva. Le pause drammatiche prima della rivelazione dei boss, la progressione stratificata dei countdown, i suoni d'impatto delle abilità potenti: questi momenti esistono all'intersezione tra suono e immagini. I trailer generati dall'intelligenza artificiale consentono agli sviluppatori di giochi indipendenti e ai creatori di app di raggiungere una qualità di produzione pari a quella degli studi AAA.

Metodo di funzionamento: imposta la modalità della colonna sonora su "Cinematic" o "Drama" per generare sequenze visive drammatiche e ad alta energia. Componi suggerimenti che descrivono l'azione, l'impatto e gli spettacoli visivi. Carica screenshot del gioco o concept art come immagini di riferimento per mantenere la coerenza visiva con il prodotto reale. Sovrapponi elementi dell'interfaccia utente, filmati di gameplay e annotazioni di testo durante la post-produzione.

Focus sull'audio: i trailer dei giochi rappresentano una delle applicazioni più critiche per la qualità audio. La colonna sonora deve creare tensione in modo progressivo, raggiungere il culmine al momento giusto e concludersi in modo soddisfacente. Se la composizione iniziale dell'IA non riesce a seguire il ritmo del trailer, rigenerarla o utilizzare strumenti musicali IA autonomi per creare una traccia personalizzata, quindi importarla come riferimento audio. Quando si pubblicano trailer di giochi su piattaforme come TapTap, la sezione giochi di Bilibili o WeGame, una sincronizzazione audiovisiva di alta qualità è fondamentale per catturare l'attenzione degli utenti.

8. Reel con i momenti salienti del matrimonio e dell'evento

Opportunità: i video di eventi personali – matrimoni, lauree, anniversari, compleanni – rappresentano i contenuti video più emozionanti creati dalle persone. La videografia professionale di eventi costa in genere da 500 a 3.000 sterline nel Regno Unito. Molti possiedono centinaia di foto di tali occasioni, ma non dispongono di filmati. L'intelligenza artificiale può trasformare queste fotografie in filmati cinematografici accompagnati da musica evocativa, ottenendo risultati di livello professionale da scatti realizzati con il cellulare.

Metodo: seleziona le tue 10-20 fotografie migliori dell'evento. Utilizza le funzionalità di conversione da immagine a video di Seedance per infondere a ciascuna immagine un movimento delicato: zoom sottili, sfocature morbide dell'obiettivo e luci mutevoli. Attiva la modalità colonna sonora e descrivi il tono emotivo desiderato: "caldo, emozionante, chitarra acustica e pianoforte, atmosfera da primo ballo di nozze". L'intelligenza artificiale genererà un video per ogni clip con musica abbinata. Assemblali in un filmato completo utilizzando l'app di editing.

Perché funziona così bene: le fotografie degli eventi hanno intrinsecamente un profondo peso emotivo per le persone che vi sono ritratte. Aggiungendo un leggero movimento si dà loro vita. Abbinandole a una musica che si adatta al sentimento, sembrano quasi un film. Questa combinazione trasforma una presentazione di foto in qualcosa che sembra un vero e proprio filmato, praticamente senza alcun costo rispetto all'assunzione di un videografo dopo l'evento. Condividere tali compilation su WeChat Moments o TikTok produce risultati di gran lunga migliori rispetto a un semplice collage di foto a nove riquadri.

Modello di prompt per video musicali con IA

I seguenti cinque modelli di prompt sono stati progettati per stili specifici di video musicali. Ogni set include prompt visivi, stili audio consigliati e parametri di generazione. Copia e utilizza direttamente, adattandoli secondo necessità ai progetti specifici.

Nota: tutte le parole di prompt sono mantenute nella loro versione originale inglese, poiché la comprensione dei prompt in inglese da parte di Seedance è più stabile. Ogni modello è accompagnato da note esplicative in cinese.

Modello uno: video musicale cinematografico

Segnale visivo:

A silhouette walking through neon rain on a deserted downtown street

at midnight. Puddles on the asphalt reflect towering LED billboards

in magenta, cyan, and gold. Steam rises from a subway grate, curling

through the neon light. The camera tracks slowly behind the figure,

maintaining a medium-wide shot. Rain streaks catch the colored light

like falling sparks. The figure pauses at a crosswalk, head tilted

upward toward the glowing signs. Cinematic anamorphic lens with

horizontal flares. Blade Runner atmosphere. Moody, contemplative,

visually rich. 4K ultra-realistic.Mezzanotte. Una sagoma attraversa le strade deserte del centro città sotto una pioggia di luci al neon. Le pozzanghere sull'asfalto riflettono giganteschi cartelloni pubblicitari a LED nei colori magenta, ciano e oro. Il vapore sale dalle bocchette della metropolitana, vorticando nella luce al neon. La telecamera segue lentamente la figura da dietro. Obiettivo anamorfico, atmosfera alla Blade Runner.

Stile audio consigliato: synthwave cinematografico o musica elettronica ambient. Linee di basso cupe e pulsanti sovrapposte a pad sintetizzati eterei. Tempo lento (70-85 BPM). Evoca l'atmosfera di Vangelis incontra M83.

Parametri: formato 16:9. Durata 10 secondi. Modalità colonna sonora attivata. Risoluzione massima disponibile.

Scenari adatti: video musicali suggestivi per musica elettronica, synth-pop o indie. Adatto anche per cortometraggi cinematografici e video di immagine del marchio. Particolarmente adatto per la sezione musicale di Bilibili e i contenuti di musica elettronica.

Modello due: Lo-fi sognante

Segnale visivo:

Soft pastel clouds drifting over a quiet city at twilight, seen

through the rain-speckled window of a cozy apartment. A desk lamp

casts warm amber light over a cluttered workspace with vinyl records,

a steaming mug, and scattered handwritten notes. Raindrops trace

slow paths down the window glass. The city lights beyond are soft,

blurred circles of warm white and gentle orange. Camera holds a

static medium shot with extremely shallow depth of field focused on

the raindrops. The background city breathes with gentle, slow

ambient motion. Warm, nostalgic, intimate. Film grain. 24fps

cinematic quality.Al tramonto, morbide nuvole color pastello attraversano la città silenziosa, visibili attraverso le finestre rigate dalla pioggia di un accogliente appartamento. Una lampada da tavolo diffonde una calda luce ambrata, illuminando un tavolo da lavoro ricoperto di dischi in vinile, una tazza fumante e appunti scritti a mano sparsi qua e là. Le gocce di pioggia scivolano lentamente lungo il vetro della finestra. Le luci lontane della città appaiono come aloni morbidi e sfocati di un bianco caldo e di un arancione pallido. Calore, nostalgia, intimità.*

Stile audio consigliato: hip-hop lo-fi. Crepitio del vinile, accordi di pianoforte leggermente stonati, ritmi morbidi di cassa e rullante, basso caldo. Tempo: 70-80 BPM. Estetica Chillhop Records.

Parametri: rapporto di aspetto 16:9 o 1:1. Durata di 10 secondi (progettato per il looping). Modalità colonna sonora: lo-fi/ambient. Ideale per live streaming lo-fi su Bilibili e YouTube quando riprodotto in loop.

Scenari adatti: canali musicali lo-fi, contenuti per lo studio/la concentrazione/il sonno, playlist rilassanti e post suggestivi su Xiaohongshu. Questi contenuti godono di notevole popolarità nelle categorie "live streaming di studio" e "rumore bianco" di Bilibili.

Modello tre: Alta energia

Segnale visivo:

Fast-paced montage of urban sports and street culture. A skateboarder

launches off a concrete ledge in slow motion, wheels spinning, body

twisted mid-air. Quick cut to a BMX rider grinding a rail with

sparks flying. Cut to a basketball spinning on a fingertip against

a graffiti-covered wall. Each scene is lit by harsh, directional

afternoon sun creating sharp shadows. Colors are high-contrast and

saturated: electric blue sky, warm concrete orange, vivid graffiti

greens and pinks. Dynamic handheld camera with intentional shake.

Rapid scene transitions. 120fps slow-motion bursts within fast

editing. GoPro meets professional sports broadcast. 4K ultra-sharp.Interpretazione cinese: un montaggio frenetico di sport urbani e cultura di strada. Riprese al rallentatore di skateboarder che si lanciano da gradini di cemento, ruote che girano, corpi che si contorcono a mezz'aria. Stacco veloce su ciclisti BMX che sfrecciano sui binari, scintille che volano. Stacco su una palla da basket che gira sulle dita davanti a un muro ricoperto di graffiti. Colori saturi ad alto contrasto. Riprese dinamiche con telecamera a mano, rapidi cambi di scena.

Stile audio consigliato: hip-hop energico o musica elettronica. Bassi 808 pesanti, hi-hat trap, synth aggressivi. Tempo: 130-150 BPM. Stile di produzione Travis Scott. Anche gli stili rap nazionali sono molto adatti.

Parametri: 9:16 (TikTok/Kuaishou/Reels) o 16:9 (Bilibili/YouTube). Durata 5-10 secondi. Attiva la modalità SFX per effetti sonori d'impatto. Sovrapponi una colonna sonora ad alta energia.

Scenari adatti: contenuti relativi a marchi sportivi, pubblicità di bevande energetiche, canali dedicati agli sport estremi e contenuti social media provocatori/teaser. Ottimi risultati con i tag "sport" e "trend" di TikTok.

Modello quattro: Canzone lirica

Segnale visivo:

A single candle flickering in darkness on a weathered wooden table.

The flame casts warm, dancing golden light across the surface,

illuminating the grain and scratches in the old wood. A person's

hand slowly enters frame from the right, fingers gently hovering

near the flame without touching it. The hand trembles slightly. The

background is pure darkness with the faintest suggestion of a

window. The camera executes an imperceptibly slow push-in toward

the flame. Extreme shallow depth of field. The flame is razor-sharp

while even the fingertips soften into bokeh. Warm amber and deep

shadow color palette. Intimate, vulnerable, deeply human. 4K

photorealistic. 24fps film cadence.Descrizione in inglese: Una singola candela tremola su un tavolo di legno consumato dall'usura nel buio. La fiamma proietta un caldo bagliore dorato e danzante sul piano del tavolo, illuminando le venature e i graffi del legno invecchiato. Una mano entra lentamente nell'inquadratura da destra, con le dita che si librano delicatamente accanto alla fiamma senza toccarla. La mano trema leggermente. Profondità di campo estremamente ridotta. La fiamma è nitidamente definita, mentre le punte delle dita si sfumano in una sfocatura. Una tavolozza di calde tonalità ambrate e ombre profonde. Intimità, fragilità, profonda umanità.

Stile audio consigliato: ballate al pianoforte o chitarra acustica accompagnate da un delicato accompagnamento di archi. Tonalità minori. Tempo estremamente lento (55-65 BPM). Produzione che ricorda Adele o Bon Iver. Arrangiamenti essenziali in cui lo spazio e il silenzio diventano essi stessi elementi musicali. Anche gli stili folk cinesi sarebbero perfettamente adatti.

Parametri: formato 16:9. Durata 10 secondi. Modalità colonna sonora: Emotiva/Originale. Risoluzione massima disponibile. Questo modello è progettato per avere un impatto emotivo, non visivo.

Scenari adatti: video musicali di ballate, film commemorativi/tributi, scene cinematografiche drammatiche, narrazioni emotive di marchi e immagini di serie unplugged. Nelle categorie folk/canzoni d'amore su NetEase Cloud Music e QQ Music, questa estetica visiva si allinea perfettamente alle aspettative degli ascoltatori.

Modello cinque: Vintage/Nostalgico

Segnale visivo:

VHS-style footage of a summer road trip along a coastal highway.

A vintage convertible with sun-faded red paint cruises along a

winding cliffside road above a sparkling ocean. The driver's arm

hangs out the window, hand surfing the wind. Palm trees line the

inland side of the road. The footage has authentic VHS artifacts:

horizontal tracking lines, slight color bleeding at edges, warm

oversaturated hues shifted toward orange and teal, subtle scan-line

texture, and occasional tracking glitches. Shot from a following car

at the same speed, steady tracking shot. Late afternoon golden light.

The ocean glitters intensely in the background. Nostalgic, carefree,

endless summer. 480p upscaled aesthetic, 4:3 aspect ratio within a

16:9 frame with black side bars.Interpretazione cinese: una scena in stile VHS di un viaggio estivo lungo la costa. Una decappottabile vintage con la vernice rossa sbiadita percorre una strada sulla scogliera, con l'oceano scintillante sotto di essa. Il braccio del conducente sporge dal finestrino, con la mano che sfiora il vento. Il filmato presenta autentici artefatti VHS: linee di tracciamento orizzontali, sottili sbavature di colore ai bordi e toni caldi saturi che virano verso l'arancione e il ciano. Nostalgico, spensierato, eterno estate.

Stile audio consigliato: indie surf rock o dream pop. Chitarre ricche di riverbero, linee di basso vivaci, tamburello brillante. Tempo: 110-120 BPM. Immaginate un incontro tra i Beach Boys e i Tame Impala. In alternativa, una direzione più elettronica con synth vaporwave/retro. Anche il pop retrò cinese (come il City Pop) sarebbe perfettamente adatto.

Parametri: formato 16:9 (che incorpora l'estetica VHS 4:3). Durata di 10 secondi. Modalità colonna sonora: Retro/Indie. Questo modello abbraccia deliberatamente l'estetica visiva lo-fi: non generare alla massima risoluzione e poi applicare effetti VHS; lascia invece che sia l'IA a creare in modo nativo il look vintage.

Scenari adatti: video musicali nostalgici/retrò, immagini per playlist estive, contenuti di marca di ispirazione vintage, sequenze di film sul passaggio all'età adulta e contenuti in stile retrò su Xiaohongshu. L'estetica vintage continua a essere molto popolare tra i giovani creatori cinesi, con un volume considerevole di contenuti contrassegnati con i tag "film-like" e "retrò" che appaiono su Xiaohongshu e Bilibili.

Confronto tra i migliori strumenti per la creazione di video musicali con IA

Non tutti i generatori di video basati sull'intelligenza artificiale dispongono di funzionalità audio e, tra quelli che ne sono dotati, le caratteristiche variano notevolmente. Di seguito è riportato un confronto diretto di tutti gli strumenti rilevanti per la produzione di video musicali a febbraio 2026.

Il panorama delle funzionalità audiovisive nel 2026. Seedance 2.0 è leader in termini di completezza funzionale, mentre ogni concorrente possiede punti di forza specifici. La scelta corretta dipende dal vostro scenario di utilizzo principale.

Tabella comparativa

| Strumento | Generazione audio | Colonna sonora | Sincronizzazione labiale | Massima qualità video | Ideale per | Prezzo di partenza | Disponibile in Cina | |------|:---:|:---:|:---:|---|-- -|---|:---:| | Seedance 2.0 | Supportato | Supportato | Supportato (8 lingue) | 2K, max 2 minuti | Produzione MV completa | Versione gratuita disponibile | Utilizzabile direttamente | | Google Veo 3 | Supportato | Parzialmente | Non supportato | 1080p | Scene audio ambientali | Tramite strumenti AI di Google | VPN richiesta | | Pika 2.0 | Base | Non supportato | Non supportato | 1080p | Aggiunta di semplici effetti sonori | Versione gratuita disponibile | VPN richiesta | | Kaiber | Non supportato | Non supportato (utilizzando audio caricato) | Non supportato | 1080p | Visualizzazione musicale per brani caricati | Circa 10 $/mese (circa 72 £) | VPN richiesta | | Suno + Seedance | Tramite Seedance | Tramite Suno | Tramite Seedance | 2K (Seedance) | La migliore combinazione di musica AI + video AI | Suno gratuito + Seedance gratuito | Seedance direttamente disponibile | | SkyMusic + Seedance | Tramite Seedance | Tramite SkyMusic | Tramite Seedance | 2K (Seedance) | La migliore combinazione cinese di musica AI + video AI | SkyMusic gratuito + Seedance gratuito | Completamente accessibile in Cina |

Seedance 2.0: la soluzione audiovisiva più completa

Seedance è l'unica piattaforma che supporta tutti e tre i tipi di generazione audiovisiva - effetti sonori, musica di sottofondo e sincronizzazione labiale - all'interno di un unico strumento. Per i creatori di video musicali, ciò significa che è possibile generare immagini suggestive con paesaggi sonori ambientali, aggiungere accompagnamenti musicali abbinati e sincronizzare le performance vocali con il movimento delle labbra dei personaggi, il tutto senza uscire dalla piattaforma.

Caratteristiche principali della produzione MV:

- Tre modalità audio (effetti sonori, musica, voce) selezionabili per generazione

- Sincronizzazione labiale in 8 lingue (incluso il cinese), con supporto alla distribuzione multilingue dei video musicali

- Input di riferimento audio: carica la tua traccia per generare immagini sincronizzate con la musica

- Rapporti di aspetto multipli, incluso 9:16 per contenuti video musicali di breve durata

- Durata massima di generazione di 2 minuti, che copre intere sezioni della canzone

- Conversione da immagine a video: anima le copertine degli album o i concetti statici

Vantaggi esclusivi per gli utenti nazionali:

- Sviluppato da ByteDance, accessibile direttamente dalla Cina senza VPN

- Supporta Alipay/WeChat Pay, nessun ostacolo per gli aggiornamenti a pagamento

- Il lip-sync cinese è fondamentale per la creazione di video musicali nazionali

- Funzionalità complete disponibili anche nella versione gratuita

Posizionamento: Seedance è la soluzione integrata definitiva per i creatori che desiderano completare l'intero processo di produzione dei propri video musicali con un unico strumento. La sua combinazione di immagini di alta qualità e funzionalità audio complete rimane senza rivali.

Crea subito il tuo video musicale con Seedance 2.0 -->

Google Veo 3: potente audio nativo

Veo 3 genera video con audio nativo, incorporando suoni ambientali, rumori atmosferici e un certo grado di accompagnamento musicale. La qualità audio è impressionante: i dati di addestramento e la scala del modello di Google producono paesaggi sonori ricchi e stratificati. Le scene sulla spiaggia suonano davvero come spiagge, con onde alla giusta distanza, vento alla giusta intensità e richiami di uccelli marini a intervalli plausibili.

Vantaggio: fedeltà audio ambientale. Veo 3 offre i paesaggi sonori più autentici della sua categoria.

Limiti nella produzione di MV: Veo 3 non dispone del controllo audio granulare presente in Seedance. Non è possibile selezionare tra le modalità effetti sonori/musica/voce, non è disponibile la funzione di sincronizzazione labiale e non è possibile caricare le proprie tracce audio come riferimento. Per la produzione di MV, questa mancanza di flessibilità nell'input limita Veo 3 alla creazione di video atmosferici/ambientali con audio di accompagnamento, piuttosto che alla creazione di video musicali strutturati. Inoltre, l'accesso dall'Italia richiede una VPN, il che rappresenta un ostacolo maggiore all'utilizzo. Per un confronto dettagliato delle caratteristiche, consultare Seedance vs Veo 3 In-Depth Comparison.

Pika 2.0: Effetti sonori di base

La funzione Effetti sonori di Pika aggiunge audio ambientale ai video generati. Si tratta di un'utile aggiunta a quello che in precedenza era uno strumento puramente visivo, anche se le sue capacità rimangono limitate rispetto a Seedance e Veo 3. La generazione di effetti sonori copre i suoni ambientali di base (passi, rumori dell'acqua, rumori del vento, semplici impatti), ma non include la generazione di musica e la sincronizzazione labiale.

Vantaggi: aggiunge semplici effetti sonori a brevi clip. Se avete bisogno di una scena di pioggia di cinque secondi con i relativi suoni, Pika può occuparsene.

Limitazioni: nessuna generazione di musica, nessuna sincronizzazione labiale e nessun supporto per il caricamento di riferimenti audio. Per la produzione di video musicali, Pika da solo non è sufficiente: deve essere combinato con strumenti audio esterni per ottenere il massimo effetto. Richiede una VPN.

Kaiber: Specialista nella visualizzazione della musica

Kaiber utilizza un approccio diverso rispetto agli altri strumenti presenti in questo elenco. Anziché generare audio da video, crea video da audio. È sufficiente caricare un brano musicale e Kaiber genera animazioni visive astratte e stilizzate che rispondono al contenuto musicale: fotogrammi che pulsano al ritmo della musica, colori che cambiano con le variazioni armoniche e intensità mappata in base al volume.

Vantaggi: Visualizzazione astratta della musica. Se il tuo obiettivo è creare immagini psichedeliche, astratte e sensibili al ritmo per un brano di musica elettronica, Kaiber è fatto apposta per questo scopo.

Limiti: Kaiber non genera audio, ma richiede il caricamento di file audio. L'output video è altamente stilizzato (astratto/artistico) piuttosto che fotorealistico. Non è in grado di creare scene narrative, personaggi o ambienti realistici. Per la produzione completa di video musicali che richiedono immagini autentiche, Kaiber è uno strumento di nicchia piuttosto che una soluzione completa. Richiede una VPN.

Suno / SkyMusic + Seedance Collaboration: L'essenza di due mondi

Per i creatori che desiderano il massimo controllo sia sugli aspetti musicali che visivi del proprio lavoro, il flusso di lavoro più potente consiste nel combinare un generatore musicale AI professionale con un generatore video AI professionale.

Formazione dell'edizione internazionale -- Suno + Seedance:

- Crea la tua traccia con Suno: descrivi il genere, l'atmosfera, il tempo e l'arrangiamento. Suno produce tracce musicali complete e di alta qualità, incorporando anche le parti vocali, se richiesto.

- Carica la traccia su Seedance come riferimento audio: Il generatore di video AI crea immagini che rispondono alla struttura della musica: le scene si intensificano durante i crescendo musicali e si attenuano durante i passaggi più tranquilli.

- Utilizza la generazione di sincronizzazione labiale, se necessario: se il brano Suno include la voce e desideri che i personaggi cantino, utilizza la modalità di sincronizzazione labiale di Seedance per abbinare i movimenti della bocca alla traccia vocale.

Pacchetto edizione nazionale -- SkyMusic + Seedance:

Questa combinazione offre ai creatori cinesi il flusso di lavoro end-to-end più fluido per la realizzazione di video musicali basati sull'intelligenza artificiale: entrambe le piattaforme sono direttamente accessibili dalla Cina, senza bisogno di VPN.

- Crea la tua traccia con SkyMusic: SkyMusic eccelle in particolare nella generazione di testi in cinese e supporta diversi generi musicali cinesi, tra cui rap, pop e musica classica.

- Carica il tuo brano su Seedance come riferimento audio: Seedance genera immagini corrispondenti in base al contenuto musicale.

- Sincronizzazione labiale cinese: utilizza la funzione di sincronizzazione labiale cinese di Seedance per far cantare ai personaggi i tuoi testi in cinese con precisione.

Il vantaggio di questo flusso di lavoro è che si ottiene la qualità musicale dell'IA musicale professionale combinata con le capacità visive e di sincronizzazione dell'IA video professionale. Il compromesso è un flusso di lavoro con due strumenti anziché una soluzione con un unico strumento. Per i creatori che perseguono risultati di livello professionale, questo passo in più è assolutamente utile.

Avanzato: tecniche per ottenere la sincronizzazione labiale

Una volta acquisita padronanza del flusso di lavoro fondamentale, le seguenti tecniche avanzate ti aiuteranno a raggiungere un livello di coordinamento audiovisivo nei tuoi video musicali che segna la linea di demarcazione tra il lavoro professionale e quello amatoriale.

La sincronizzazione avanzata non consiste semplicemente nel generare audio e video insieme. Implica l'allineamento consapevole del ritmo visivo, dell'atmosfera e della struttura con la composizione musicale per ottenere un'esperienza audiovisiva unificata.

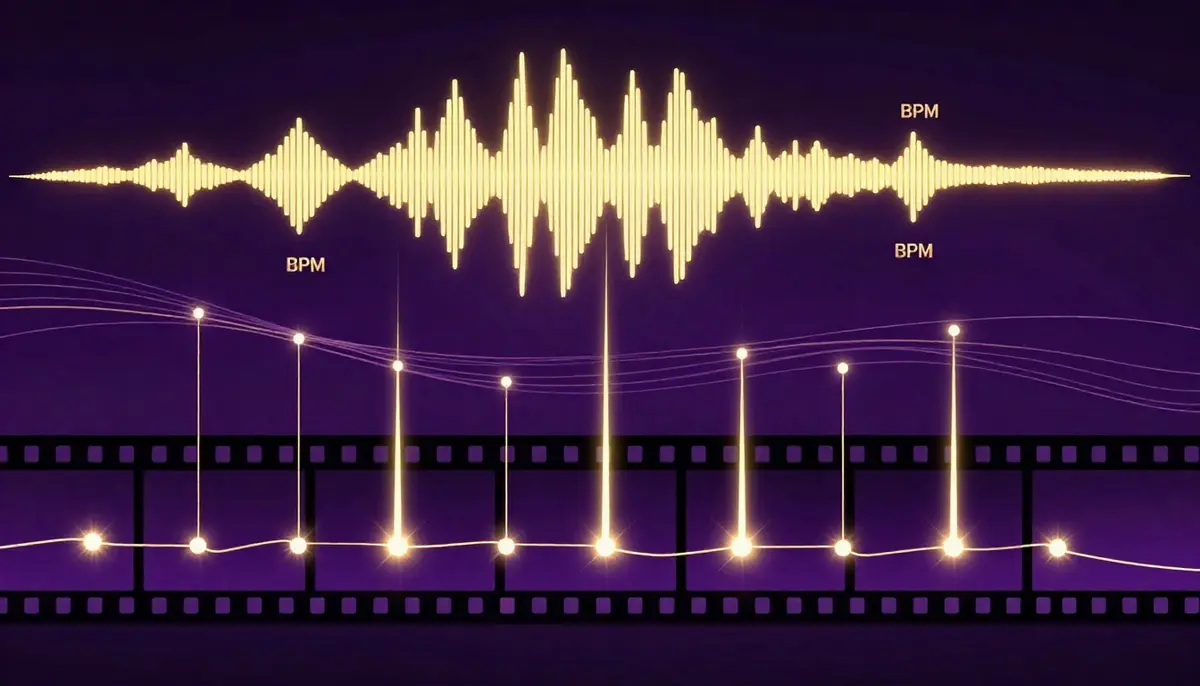

BPM Matching: allineamento del ritmo visivo con il tempo musicale

Il BPM (battiti al minuto) è il battito cardiaco di qualsiasi brano musicale. Quando i contenuti visivi si muovono in sincronia con il ritmo della musica, l'effetto risulta deliberato e professionale. Quando i due elementi non sono sincronizzati, sembra che due cose non correlate vengano riprodotte contemporaneamente.

Come ottenere la corrispondenza BPM:

- Determina il BPM della tua traccia: la maggior parte dei DAW (Ableton, Logic, FL Studio) visualizza automaticamente il BPM. Gli strumenti di rilevamento del BPM online sono altrettanto efficaci. Intervalli comuni: lo-fi (70-85 BPM), pop (100-130 BPM), EDM (120-150 BPM), drum and bass (160-180 BPM).

- Traduci il BPM in velocità di movimento visivo: a 120 BPM, ci sono esattamente due battiti al secondo. I movimenti della telecamera, le transizioni di scena e i tagli visivi che si verificano ogni mezzo secondo sembreranno sincronizzati con il ritmo.

- Utilizza un linguaggio suggestivo del ritmo: per i brani a 130 BPM, usa termini come "veloce", "energico", "transizioni dinamiche". Per i brani a 70 BPM, opta per "lento", "fluido", "delicato". L'IA interpreta questi segnali ritmici e regola il tempo visivo di conseguenza.

- Messa a punto in post-produzione: se il ritmo visivo dell'IA è vicino ma non perfettamente sincronizzato con il battito, apportate delle modifiche nel vostro editor video. Accelerate o decelerate i segmenti del 5-10% per fissare gli eventi visivi ai marcatori di battito. Questa messa a punto fa una differenza visibile. Sia ShineVideo che DaVinci Resolve supportano regolazioni di velocità così precise.

Sincronizzazione emotiva: brani musicali abbinati ad atmosfere visive

I video musicali professionali non mantengono un'estetica visiva coerente per tutta la durata del filmato. Cambiano atmosfera per allinearsi all'arco emotivo della canzone. La generazione AI consente di creare queste transizioni generando segmenti distinti utilizzando prompt visivi vari.

La mappatura dalla struttura musicale all'atmosfera visiva:

| Sezione canzone | Caratteristiche musicali | Direzione visiva | |-------- -|---------|---------| | Intro | Sparsa, graduale | Immagini minimaliste, toni smorzati, rallentatore. Creazione dell'atmosfera. | | Strofa | Narrativa, energia media | Scene guidate dalla trama, tempo moderato, tavolozza di colori caldi o neutri | | Pre-ritornello | Progressione stratificata | Movimenti di camera intensificati, saturazione dei colori accentuata, maggiore complessità visiva | | Ritornello | Energia/emozione al culmine | Immagini più drammatiche, colori più audaci, riprese dinamiche, spettacolo visivo su larga scala | | Bridge | Transizione/riflessione | Stile visivo completamente distinto. Nuova tavolozza di colori. Movimento più lento. | | Coda | Convergenza, dissolvenza | Ritorno allo stile visivo dell'introduzione con un senso di risoluzione. Ammorbidimento. Dissolvenza. |

Genera prompt separati per ogni paragrafo individualmente, quindi modificali e uniscili insieme. Questo approccio segmentato produce un risultato più dinamico che si integra meglio con la musica rispetto alla generazione di un unico frammento lungo.

Generazione basata sui segmenti: crea immagini distinte per il ritornello, le strofe e il bridge.

Basandosi sul concetto di sincronizzazione emotiva, la tecnica pratica della generazione segmentata prevede la creazione di segmenti video AI indipendenti per ogni passaggio musicale, che vengono successivamente assemblati all'interno dell'editor della timeline.

Flusso di lavoro:

- Analizza la struttura della canzone. Segna i timestamp per ogni sezione (Verso 1: 0:00-0:30, Ritornello 1: 0:30-0:55, Verso 2: 0:55-1:25, ecc.)

- Scrivi suggerimenti visivi unici per ogni sezione. Mantieni la continuità visiva attraverso descrittori stilistici coerenti (schemi di colori identici, parole chiave di qualità visiva condivise) variando scene, riprese e livelli di energia

- Genera clip separate per ogni sezione all'interno di Seedance. Allinea la durata delle clip con i tempi delle sezioni

- Importa tutte le clip in un editor video (ShineVideo, DaVinci Resolve, Premiere). Allinea ogni clip alla sezione musicale corrispondente.

- Aggiungi transizioni tra le sezioni: dissolvenze incrociate per transizioni fluide, tagli netti per cambiamenti drammatici e panoramiche rapide per transizioni ad alta energia.

- Esporta la timeline assemblata come video musicale finale.

Questo metodo consente il massimo controllo sul rapporto tra suono e immagini. Sebbene comporti un carico di lavoro maggiore rispetto alla generazione a passaggio singolo, il risultato è notevolmente più dinamico e meglio allineato con la musica.

Video di riferimento: utilizzo degli stili dei video musicali esistenti come input

Se esiste un video musicale di cui ammiri lo stile visivo, i movimenti di macchina o il ritmo di montaggio, puoi utilizzarlo come riferimento per guidare la generazione dell'IA.

Come utilizzare il MV di riferimento:

- Seleziona un video musicale o un videoclip che incarni lo stile visivo desiderato.

- Caricalo come video di riferimento all'interno di Seedance.

- L'IA analizza il movimento della telecamera, la composizione, la combinazione di colori, il ritmo di montaggio e le dinamiche di movimento del video di riferimento.

- Il risultato generato eredita questi elementi stilistici creando al contempo contenuti completamente originali.

Questa tecnica si rivela particolarmente utile quando i clienti o i collaboratori dicono: "Voglio lo stesso stile di quel video". È possibile utilizzare direttamente il loro riferimento come input, invece di cercare di tradurre la loro visione in un linguaggio immediato.

Nota importante: l'IA genera contenuti visivi originali ispirati allo stile di riferimento. Non replica né riproduce il video di riferimento. Il risultato è un contenuto unico che condivide elementi stilistici con il riferimento.

Domande frequenti

L'intelligenza artificiale è davvero in grado di generare un video musicale completo?

Certamente, ma bisogna comprendere il significato di "completo" nel 2026. L'IA è in grado di generare videoclip con audio sincronizzato, inclusi effetti sonori, musica di sottofondo e voci sincronizzate, che hanno un aspetto e un suono professionali. Per video musicali atmosferici, stilizzati o astratti della durata compresa tra 30 secondi e 2 minuti, i risultati generati dall'intelligenza artificiale possono essere effettivamente pubblicati direttamente. Per video musicali più lunghi e narrativi che richiedono attori specifici e coreografie complesse, l'intelligenza artificiale eccelle nella produzione di filmati grezzi di alta qualità, anche se beneficia in modo significativo del montaggio, del sequencing e della post-produzione umani. Questa tecnologia è meglio intesa come uno strumento di produzione che gestisce l'80-90% del carico di lavoro, piuttosto che come un sostituto con un solo clic di un intero team di produzione.

Qual è il miglior generatore di video musicali basato sull'intelligenza artificiale per il 2026?

Seedance 2.0 è il generatore di video musicali basato sull'intelligenza artificiale più completo del 2026. Integra in modo unico tutte e tre le funzionalità audiovisive principali in un unico strumento: generazione di effetti sonori, creazione di colonne sonore basate sull'intelligenza artificiale e sincronizzazione labiale multilingue (in otto lingue, compreso il cinese). — abbinato a una generazione visiva di alta qualità (risoluzione fino a 2K, durata di 2 minuti). Gli utenti cinesi beneficiano di ulteriori vantaggi: essendo un prodotto ByteDance, Seedance è direttamente accessibile in Cina e supporta Alipay e WeChat Pay. Google Veo 3 eccelle nell'audio ambientale, ma non dispone di sincronizzazione labiale e richiede una VPN. Pika offre solo effetti sonori di base. Kaiber è specializzato nella visualizzazione di musica astratta.

È necessario avere la propria musica per creare video musicali con l'intelligenza artificiale?

Non è necessario. Hai tre opzioni. Innanzitutto, utilizza la funzione di generazione della colonna sonora integrata in Seedance per consentire all'IA di creare contemporaneamente immagini e musica. In secondo luogo, utilizza generatori di musica IA gratuiti (come Suno a livello internazionale o alternative nazionali come SkyMusic e NetEase Tianyin) per creare composizioni originali, quindi importale in Seedance come riferimenti audio. In terzo luogo, carica i tuoi brani musicali originali o con licenza. Tutti e tre gli approcci producono risultati audiovisivi completi. La scelta dipende dal grado di controllo che desideri esercitare sul risultato musicale.

Come viene utilizzata la sincronizzazione labiale basata sull'intelligenza artificiale nei video musicali?

L'analisi della sincronizzazione labiale basata sull'intelligenza artificiale esamina il contenuto audio delle tracce vocali, identificando quali fonemi si verificano in specifici momenti temporali, e genera le corrispondenti forme della bocca, posizioni della mascella e microespressioni facciali dei personaggi video. Per il canto, ciò significa che la bocca del personaggio si apre maggiormente per le note alte e le vocali, si restringe per le consonanti e mantiene l'allineamento temporale con il ritmo vocale. Seedance supporta la sincronizzazione labiale in otto lingue (incluso il cinese), con un vocabolario della bocca adattato al sistema fonetico di ciascuna lingua. La sincronizzazione labiale cinese consente ai personaggi AI di eseguire testi cinesi con precisione, sbloccando un immenso potenziale creativo per le comunità di cover song e anime di Bilibili. I risultati ottimali si ottengono con tracce vocali chiare, caratterizzate da un tempo moderato e da un'interferenza strumentale di fondo minima.

La musica generata dall'intelligenza artificiale può essere utilizzata a fini commerciali?