W skrócie

Tekst-do-wideo AI to technologia sztucznej inteligencji, która automatycznie generuje filmy na podstawie opisów tekstowych. Po wprowadzeniu opisu sztuczna inteligencja tworzy klip wideo zawierający ruch, efekty świetlne i ruchy kamery. Do 2026 r., dzięki wykorzystaniu architektury Diffusion Transformer (DiT), technologia ta ewoluowała od niewyraźnego prototypu eksperymentalnego do jakości zbliżonej do kinowej. Niniejszy przewodnik obejmuje zasady techniczne, pięciostopniowy praktyczny samouczek, dziesięć powtarzalnych szablonów poleceń, analizę porównawczą ośmiu narzędzi, sześć głównych scenariuszy zastosowań oraz rzeczywiste ograniczenia, które należy zrozumieć. Wypróbuj generowanie tekstu do wideo za darmo →

Tekst do wideo AI: Od pojedynczego opisu do materiału filmowego o kinowej jakości – sztuczna inteligencja sprawia, że „tekst do wideo” staje się rzeczywistością.

Czym jest sztuczna inteligencja zamieniająca tekst na wideo?

Sztuczna inteligencja typu „text-to-video” odnosi się do kategorii technologii sztucznej inteligencji, która automatycznie generuje treści wideo na podstawie opisów tekstowych. Opisujesz scenę – kobietę spacerującą w deszczu, produkt obracający się na stojaku ekspozycyjnym, drona szybującego nad pasmem górskim – a model sztucznej inteligencji tworzy bardzo realistyczny klip wideo z naturalnym ruchem, oświetleniem i efektami fizycznymi.

Podstawowa koncepcja jest prosta: wprowadzanie tekstu, wyjście wideo. Jednak technologia, na której się opiera, nie jest wcale taka prosta. Nowoczesne systemy zamiany tekstu na wideo wykorzystują sieci neuronowe, które zostały wytrenowane na miliardach zestawów danych zawierających pary „wideo-tekst”, ucząc się statystycznych powiązań między opisami językowymi a ruchem wizualnym. Kiedy piszesz „kot wskakuje na stół”, model wykorzystuje zgromadzoną wiedzę na temat kotów, fizyki skoku, powierzchni stołu i grawitacji, aby wygenerować wiarygodny film.

2026: Od eksperymentu do narzędzia zwiększającego produktywność

Technologia AI przekształcająca tekst w wideo przekroczyła próg gotowości produkcyjnej w latach 2025–2026. Wczesne systemy z lat 2022–2023 mogły generować jedynie krótkie, rozmyte i fizycznie nieprawdopodobne klipy. Dzisiejsze modele generują jednak filmy w rozdzielczości 2K, charakteryzujące się fizyczną dokładnością, naturalną animacją ruchu i kinową jakością, trwające od 5 do 15 sekund. Ten skok sprawia, że technologia zamiany tekstu na wideo przestaje być ciekawostką badawczą, a staje się praktycznym narzędziem:

- Twórcy treści: Uzyskaj materiały filmowe, sekwencje intro i zasoby mediów społecznościowych bez użycia kamery

- Marketerzy: Masowo produkuj różne wersje reklam i prezentacje produktów

- Nauczyciele: Wizualizuj abstrakcyjne pojęcia

- Małe i średnie przedsiębiorstwa: Unikaj wysokich kosztów profesjonalnej produkcji wideo

- Każdy: Jeśli potrafisz pisać, możesz tworzyć filmy

Próg tworzenia filmów obniżył się z „posiadania kamery i umiejętności montażu” do „tworzenia atrakcyjnego opisu”.

Ewolucja technologiczna: od GAN do DiT

Zrozumienie podstawowej technologii może pomóc w tworzeniu lepszych poleceń i wyborze bardziej odpowiednich narzędzi. Poniżej przedstawiono trzy generacje ewolucji technologicznej sztucznej inteligencji tekst-wideo.

Trzy generacje ewolucji technologicznej: GAN (2020–2022) → Modele dyfuzyjne (2023–2024) → Transformatory dyfuzyjne / DiT (2025–2026).

Pierwsza generacja: era GAN (2020–2022)

Sieci generatywne typu GAN (Generative Adversarial Networks) były pierwszą architekturą, która wykazała wykonalność konwersji „tekst-wideo”. Dwie sieci neuronowe przechodzą szkolenie oparte na rywalizacji — generator tworzy klatki wideo, a dyskryminator ocenia ich autentyczność. Jednak wyniki miały niską rozdzielczość (256×256), były krótkotrwałe (2–4 sekundy) i fizycznie nieprawdopodobne. Obiekty ulegają nieprzewidywalnym deformacjom, rysy twarzy ulegają zniekształceniu, a spójność czasowa jest poważnie naruszona. Reprezentatywne osiągnięcia obejmują CogVideo i NUWA.

Druga generacja: era modeli dyfuzji (2023–2024)

Model dyfuzyjny zasadniczo zmienił krajobraz. Porzuca on trening oparty na rywalizacji na rzecz procesu „odwrotnego usuwania szumów” — zaczynając od czystego szumu i stopniowo usuwając go, aby uzyskać spójny obraz wideo oparty na tekście. Takie podejście zapewnia jakościowy skok: wyższą rozdzielczość (do 1080p), dłuższy czas trwania (4–10 sekund) i lepsze dopasowanie tekstu do obrazu.

Sora firmy OpenAI (wydana w lutym 2024 r.) pokazała, że modele dyfuzyjne mogą generować niezwykle fotorealistyczne filmy. Runway Gen-2/Gen-3, Pika i Stable Video Diffusion należą do tej generacji.

Trzecia generacja: DiT — transformator dyfuzyjny (2025–2026)

Najbardziej zaawansowane architektury łączą obecnie procesy dyfuzji z architekturą Transformer (tą samą architekturą, na której opierają się GPT i BERT). Modele DiT przetwarzają wideo jako sekwencję fragmentów czasowo-przestrzennych, osiągając:

- Poprawiona spójność czasowa: Transformatory doskonale radzą sobie z modelowaniem zależności długoterminowych między klatkami

- Wyższa rozdzielczość: Natywna rozdzielczość 2K (Seedance 2.0 osiąga 2048×1080)

- Zwiększona dokładność fizyczna: Bardziej realistyczny ruch, grawitacja i dynamika płynów

- Lepsze rozumienie tekstu: Znacznie lepsze dopasowanie opisów poleceń do wyników wizualnych

- Wprowadzanie wielomodalne: Niektóre modele DiT mogą jednocześnie akceptować dane wejściowe w postaci obrazów, filmów i dźwięku

Seedance 2.0, Google Veo 3 i Keeling 3.0 wykorzystują architekturę DiT. Dlatego generowanie tekstu do wideo w 2026 r. wykazuje jakościową różnicę w porównaniu z 2024 r.

Tekst do wideo a obraz do wideo

Te dwa podejścia raczej się uzupełniają niż konkurują ze sobą:

| Wymiar | Tekst do wideo (T2V) | Obraz do wideo (I2V) | |------|------------------|----------------- -| | Dane wejściowe | Tylko opis tekstowy | Zdjęcie + opis ruchu | | Swoboda twórcza | Najwyższa — AI określa wszystkie elementy wizualne | Ograniczona przez obraz źródłowy | | Kontrolowalność | Niższa — zależy od dokładności podpowiedzi | Wyższa — dostępne są wizualne punkty odniesienia | | Odpowiednie scenariusze | Badanie koncepcji, oryginalna treść | Prezentacja produktu, animacja zdjęć, dopasowanie stylu | | Przewidywalność | Niska — to samo polecenie daje za każdym razem inne wyniki | Wysoka — wynik jest zawsze zgodny z obrazem źródłowym |

Większość profesjonalnych procesów wykorzystuje oba podejścia: najpierw stosuje się T2V do eksploracji kreatywnych koncepcji, a następnie udoskonala się wynik za pomocą I2V w celu uzyskania precyzyjnej kontroli. Szczegółowe informacje na temat generowania obrazów na podstawie wideo można znaleźć w naszym kompletnym przewodniku po sztucznej inteligencji w zakresie obrazów na podstawie wideo.

5-etapowy samouczek: Tworzenie pierwszego filmu AI

Poniżej znajduje się przewodnik krok po kroku dotyczący tworzenia treści tekstowo-wideo od podstaw przy użyciu Seedance 2.0 jako platformy demonstracyjnej. Podstawowe zasady mają zastosowanie do każdego narzędzia.

Od szybkiego tworzenia do końcowego efektu: pięć kroków do ukończenia pierwszego filmu AI.

Krok 1: Określ cele filmu

Przed napisaniem podpowiedzi należy najpierw ustalić:

- Typ: materiał filmowy B-roll, prezentacje produktów, treści w mediach społecznościowych, dzieła artystyczne lub narracja?

- Czas trwania: 5 sekund do testów, 10–15 sekund do ostatecznej wersji

- Proporcje obrazu: 16:9 dla YouTube / Bilibili, 9:16 dla Douyin / Kuaishou / Xiaohongshu, 1:1 dla WeChat Moments

- Styl: filmowy, dokumentalny, animowany, reklamowy lub artystyczny

Określenie jasnych celów zapobiega marnowaniu limitów generowanych na niejasne eksperymenty.

Krok 2: Tworzenie wysokiej jakości podpowiedzi tekstowych

Podpowiedź jest istotą generowania tekstu do wideo. Zastosuj następujący wzór:

[Temat] + [Akcja/Ruch] + [Sceneria] + [Styl] + [Ruch kamery] + [Oświetlenie]

Słabe podpowiedzi: „Biegnący pies”

Dobry pomysł: „Golden retriever biegnący po słonecznej łące, na której kołyszą się na wietrze polne kwiaty. Futro psa faluje przy każdym kroku. Kamera śledzi scenę z poziomu ziemi. Ciepłe oświetlenie o złocistej barwie z długimi cieniami. Kinowa płytka głębia ostrości, jakość 4K.

Kluczowe zasady:

- Ruch musi być konkretny: „powoli obraca głowę” zamiast „obraca”

- Opisz pracę kamery: „kamera zbliża się” lub „ujęcie z drona”

- Stwórz atmosferę: Oświetlenie, gradacja kolorów, atmosfera

- Unikaj sprzeczności: Nie proś jednocześnie o „szybką akcję” i „zwolnione tempo”

- Nie proś o tekst/interfejs użytkownika: Obecny model ma trudności z renderowaniem czytelnego tekstu w klatkach wideo

Uwaga: Zaleca się tworzenie poleceń w języku angielskim, nawet w przypadku korzystania z narzędzi krajowych (takich jak KeLing, TongYi WanXiang lub Hunyuan Video), ponieważ większość modeli została przeszkolona na bardziej rozbudowanych zestawach danych w języku angielskim.

Aby uzyskać bardziej kompleksowy system technik tworzenia podpowiedzi, zapoznaj się z Przewodnikiem po tworzeniu podpowiedzi oraz 10 naprawdę skutecznych podpowiedzi do filmów AI.

Krok 3: Wybierz narzędzia i parametry

Wybierz platformę (zobacz tabelę porównawczą poniżej), a następnie skonfiguruj:

- Model: Wykorzystaj najnowszy dostępny model (np. Seedance 2.0, a nie 1.0)

- Rozdzielczość: Minimum 1080p; wybierz 2K, jeśli jest dostępne

- Czas trwania: Początkowo przetestuj 5 sekund, przedłuż, jeśli wynik jest zadowalający

- Proporcje obrazu: Dopasuj do platformy dystrybucyjnej

- Wartość początkowa (jeśli dostępna): Zablokuj wartość początkową, aby zapewnić spójną iterację

Krok 4: Generowanie i przeglądanie

Kliknij Generuj i poczekaj 60–180 sekund (w zależności od narzędzia). Podczas przeglądania wyników zwróć uwagę na:

- ✅ Czy ruch jest zgodny z opisem?

- ✅ Czy obiekt jest spójny w całym ujęciu (bez deformacji)?

- ✅ Czy fizyka jest wiarygodna (grawitacja, płyny, tkaniny)?

- ✅ Czy ruch kamery jest płynny?

- ❌ Czy występują artefakty, migotanie lub zniekształcenia?

- ❌ Czy na twarzach/rękach występuje efekt niesamowitej doliny?

Krok 5: Optymalizacja iteracyjna

Pierwsza próba rzadko jest idealna. Metody optymalizacji:

- Dostosuj polecenie: Dodaj szczegóły tam, gdzie sztuczna inteligencja popełniła błąd

- Zmieniaj tylko jedną zmienną na raz: Nie przepisuj całego polecenia

- Eksperymentuj z różnymi nasionami: ten sam prompt może dać zupełnie różne wyniki

- Wydłuż czas trwania: gdy będziesz zadowolony z wersji 5-sekundowej, spróbuj 10–15 sekund

- Dodaj dźwięk: jeśli narzędzie to obsługuje (Seedance, Veo 3), dodaj efekty dźwiękowe lub muzykę w tle

Przykłady iteracji podpowiedzi: V1 (podpowiedź podstawowa) → V2 (dodanie opisów ruchu i oświetlenia) → V3 (pełna specyfikacja kinowa). Każdy cykl udoskonalania znacznie poprawia jakość obrazu.

10 szablonów podpowiedzi do generowania tekstu do wideo

Poniższe szablony można kopiować i używać bezpośrednio. Zostały one przetestowane w Seedance 2.0 i są kompatybilne z większością popularnych platform.

1. Portret filmowy

A close-up of a young woman with flowing dark hair, her face illuminated by warm golden hour sunlight filtering through a window. She slowly turns her head toward the camera, a subtle smile forming. Soft bokeh background of a cozy interior. Camera holds steady with a slight push-in. Warm amber lighting, shallow depth of field, 4K cinematic quality.

Odpowiednie scenariusze: media społecznościowe, budowanie marki osobistej, twórczość artystyczna

- Prezentacja produktów

A sleek wireless headphone rotating slowly on a matte black pedestal. Soft studio lighting creates clean highlights on the brushed metal surface. Camera orbits 180 degrees at eye level. Minimalist white background, no shadows. Smooth continuous motion, commercial product photography quality.

Odpowiednie scenariusze: strony szczegółów produktów w sklepach internetowych, marketing produktów, główne filmy wideo na Taobao/JD.com.

- Kino przyrody

An epic aerial drone shot over a misty mountain valley at sunrise. Golden light breaks through layered clouds, illuminating a winding river below. Camera pushes forward slowly, revealing the vast landscape. Volumetric fog drifts between peaks. IMAX cinematography quality, hyper-detailed.

Odpowiednie dla: filmów wprowadzających na YouTube/Bilibili, treści podróżniczych, wygaszaczy ekranu, kanałów medytacyjnych

4. Ulica miejska

A neon-lit Tokyo alley at night after rain. Wet cobblestones reflect vivid pink, teal, and amber neon signs. A lone figure walks away from camera, umbrella in hand. Steam rises from a street vent. Camera follows at a distance, tracking shot. Film noir atmosphere, anamorphic lens flare.

Odpowiednie scenariusze: teledyski, klimatyczne ujęcia B-roll, treści w stylu cyberpunkowym

- Styl anime

An anime warrior princess with flowing silver hair stands on a cliff edge overlooking a fantasy kingdom. Her cape billows dramatically in the wind. She raises a glowing sword that emits blue energy particles. Cherry blossom petals drift past. Camera slowly orbits. Studio Ghibli meets Ufotable quality animation.

Odpowiednie dla: treści animowanych, kanałów poświęconych grom, opowieści fantasy

6. Żywność i napoje

Extreme macro close-up of rich dark coffee being poured in slow motion into a pristine ceramic cup. Individual droplets and tiny splashes frozen mid-air. Wisps of steam curl elegantly upward. Warm side lighting reveals the liquid's amber transparency. Cinnamon stick and scattered beans visible in soft focus foreground.

Odpowiednie scenariusze: marketing produktów spożywczych i napojów, blogerzy kulinarni, reklamy napojów

- Moda i publikacje

A model in a flowing white silk gown walks confidently down a dark runway. Multiple flash strobes create sharp geometric light patterns. The fabric billows with perfect physics. Camera at a low angle, slight slow motion. High fashion editorial aesthetic, Vogue magazine quality.

Odpowiednie scenariusze: marki modowe, treści dotyczące urody, artykuły redakcyjne

- Science fiction i fantasy

A massive spaceship emerges from hyperspace above a ringed planet. Blue energy dissipates around the hull as the vessel decelerates. Tiny fighter escorts flank its sides. Camera pulls back to reveal the scale against the planet. Volumetric space dust and distant star field. Hollywood VFX quality.

Przykładowe zastosowania: treści rozrywkowe, kanały science fiction, wizualizacja koncepcji

- Sport i akcja

A basketball player at the peak of a slam dunk, frozen in mid-air. Time resumes in slow motion — sweat droplets fly, the ball compresses against the rim, arena spotlights create dramatic lens flare. Camera shoots from below looking up. ESPN broadcast quality, hyper-detailed.

Odpowiednie dla: treści sportowych, marek sportowych, kompilacji najważniejszych wydarzeń

- Sztuka abstrakcyjna (abstrakcyjna i artystyczna)

Liquid gold and deep indigo ink collide in slow motion inside a glass sphere. The fluids intertwine in mesmerizing fractal patterns. Tiny bubbles catch light. Camera slowly rotates around the sphere. Pure black background. Macro photography meets fluid dynamics simulation. Meditative, hypnotic pace.

Odpowiednie scenariusze: tła wizualne, teledyski, instalacje artystyczne, wygaszacze ekranu

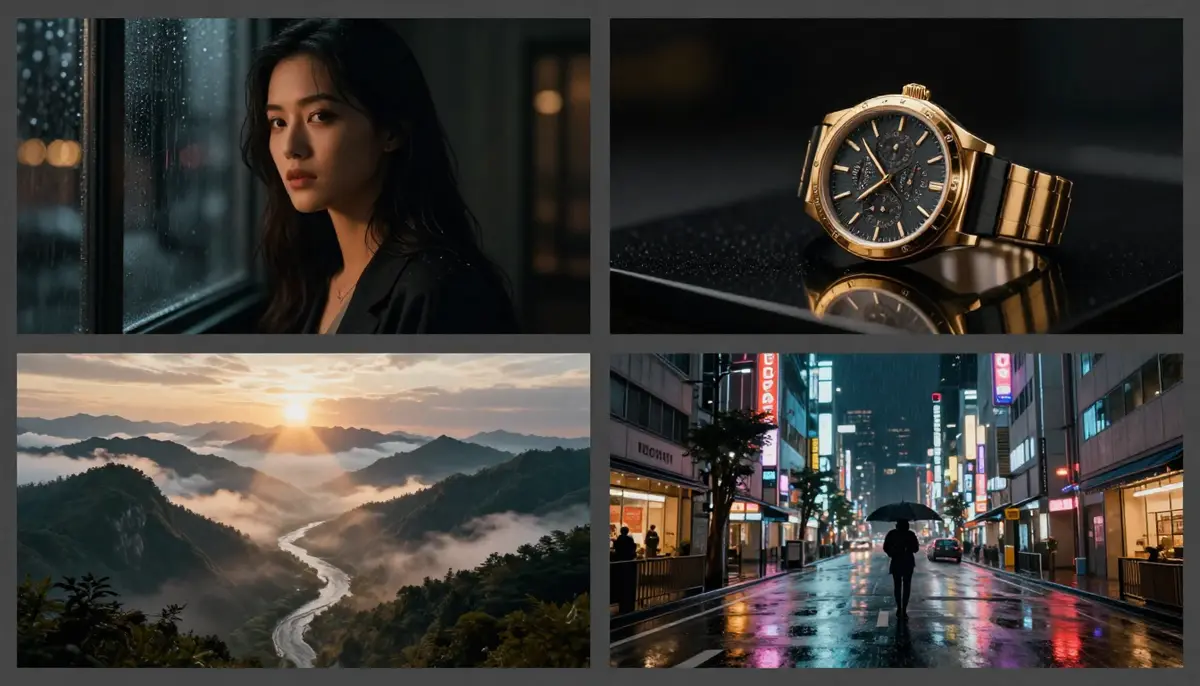

Rzeczywisty wynik z czterech z dziesięciu powyższych szablonów — każdy z nich generuje charakterystyczne wizualizacje o kinowej jakości na podstawie zwykłego tekstu.

2026: Porównawczy przegląd ośmiu narzędzi do generowania tekstu do wideo

Przetestowaliśmy osiem popularnych platform, używając tego samego polecenia („Golden retriever biegnący po słonecznej łące, kołyszące się polne kwiaty, kinowa jakość 4K”), oceniając je w pięciu wymiarach. Wszystkie testy zostały zakończone w lutym 2026 roku.

| Narzędzie | Maksymalna rozdzielczość | Maksymalny czas trwania | Wersja bezpłatna | Audio | Najlepsze zastosowanie | Ocena jakości obrazu | |------|----------|---------|--------|------|-------- -|---------| | Seedance 2.0 | 2K (2048×1080) | 15 sekund | ✅ Codzienny bezpłatny limit | ✅ Efekty dźwiękowe + muzyka + synchronizacja ruchu warg | Tworzenie multimodalne | 9,2/10 | | Google Veo 3 | 4K (ograniczone) | 8 sekund | ✅ Limit AI Studio | ✅ Natywny dźwięk | Fuzja audiowizualna | 9,0/10 | | Sora 2 | 1080p | 20 sekund | ❌ Wymaga ChatGPT Plus | ❌ | Wideo oparte na długim tekście | 8,8/10 | | Keling 3.0 | 1080p | Ponad 20 sekund | ✅ Darmowe kredyty za rejestrację | ⚠️ Ograniczone | Długie filmy, dobry stosunek jakości do ceny | 8,5/10 | | Runway Gen-4 | 1080p | 10 sekund | ✅ 125 kredytów | ❌ | Profesjonalny proces edycji | 8,5/10 | | Pika 2.0 | 1080p | 10 sekund | ✅ Codzienny bezpłatny limit | ⚠️ Tylko efekty dźwiękowe | Początkujący, zabawne efekty | 8,0/10 | | Luma Dream Machine | 1080p | 5 sekund | ✅ Bezpłatne generowanie | ❌ | Sceny 3D, szybka iteracja | 7,8/10 | | Snail AI (MiniMax) | 1080p | 6 sekund | ✅ Codzienny bezpłatny limit | ❌ | Najszybsza prędkość generowania | 7,5/10 |

Ważna informacja dla użytkowników krajowych: Seedance 2.0, KeLing 3.0 i Haier AI są bezpośrednio dostępne w Chinach kontynentalnych. Sora 2 wymaga subskrypcji ChatGPT Plus (konieczne jest użycie VPN). Google Veo 3 wymaga dostępu przez Google AI Studio (konieczne jest użycie VPN). Runway, Pika i Luma wymagają połączenia z siecią zagraniczną.

Alternatywy krajowe: Tongyi Wanxiang (Alibaba), Hunyuan Video (Tencent) i Qingying (spółka zależna ByteDance) również oferują funkcje generowania tekstu do wideo, z różnymi limitami bezpłatnego użytkowania.

Najważniejsze wnioski:

- Najlepsza ogólna jakość obrazu: Seedance 2.0 (natywna rozdzielczość 2K + cztery tryby wejścia + audio)

- Najlepsze możliwości audio: Seedance 2.0 i Google Veo 3

- Najlepsza wersja darmowa: Seedance 2.0 (bezpłatny dostęp do rozdzielczości 2K, nie wymaga karty kredytowej)

- Najdłuższy czas trwania bezpłatnego wideo: Keeling 3.0 (ponad 20 sekund)

- Najbardziej odpowiedni dla początkujących: Pika 2.0 (najprostszy interfejs, zabawne efekty)

Aby uzyskać bardziej szczegółowe porównanie, zapoznaj się z artykułem Kompletne porównanie najlepszych generatorów wideo AI na rok 2026. Jeśli interesują Cię wyłącznie bezpłatne plany, zapoznaj się z artykułem Porównawcza recenzja bezpłatnych generatorów wideo AI.

6 kluczowych scenariuszy zastosowań

- Treści w mediach społecznościowych

Twórz przyciągające wzrok krótkie filmy dla serwisów Douyin, Kuaishou, Xiaohongshu, Bilibili i YouTube Shorts. Dzięki sztucznej inteligencji nie musisz już zajmować się filmowaniem, montażem ani postprodukcją.

Zalecane specyfikacje: proporcje obrazu 9:16, czas trwania 5–15 sekund, z efektownym początkiem w ciągu pierwszej sekundy.

- Marketing i reklama

Masowa produkcja różnych wersji materiałów reklamowych. Testowanie wielu koncepcji wizualnych przy użyciu różnych podpowiedzi przed podjęciem decyzji o formalnym budżecie produkcyjnym. Generowanie wersji testowych A/B w ciągu kilku minut.

Zalecana konfiguracja: Kompatybilność z wieloma formatami na wielu platformach. W połączeniu z funkcjami audio Seedance umożliwia tworzenie kompletnych filmów reklamowych.

3. Edukacja i szkolenia

Wizualizacja abstrakcyjnych pojęć, które są trudne lub niemożliwe do uchwycenia: struktury molekularne, wydarzenia historyczne, pojęcia matematyczne, procesy naukowe. Wideo AI sprawia, że to, co niewidzialne, staje się widzialne.

Zalecana konfiguracja: Aby uzyskać optymalne wyniki nauczania, połącz komunikat dokładnie opisujący daną koncepcję z nagraniem audio.

- Rozrywka i narracja

Niezależni filmowcy i twórcy scenariuszy wykorzystują technologię zamiany tekstu na wideo do wizualizacji koncepcji, tworzenia scenariuszy, a nawet do ostatecznej produkcji filmów krótkometrażowych. Technologia ta demokratyzuje proces tworzenia filmów.

Zalecana konfiguracja: Aby uzyskać kinową jakość, w instrukcji należy zawrzeć szczegółowe informacje dotyczące ustawienia kamery i oświetlenia.

- Filmy dotyczące produktów w handlu elektronicznym

Zamień opisy produktów na filmy pokazujące ich działanie. To szczególnie przydatne dla sprzedawców detalicznych, którzy mają setki produktów i nie mogą nakręcić osobnego filmu dla każdego z nich. Szczegółowe informacje na temat procesów e-commerce znajdziesz w Przewodniku po filmach e-commerce z wykorzystaniem sztucznej inteligencji.

Zalecane specyfikacje: Fotografia produktowa z oświetleniem studyjnym. Proporcje 1:1 dla stron z szczegółami produktu, 16:9 dla YouTube/Bilibili, 9:16 dla TikTok/Xiaohongshu.

6. Tworzenie treści na YouTube / Bilibili

Twórz materiały filmowe B-roll, sekwencje intro, komentarze wizualne i kompletne krótkie filmy. Twórcy mogą zwiększyć wydajność produkcji treści dzięki wideo AI. Pełny opis procesu tworzenia treści na YouTube można znaleźć w Przewodniku dla twórców YouTube dotyczącym wideo AI.

Zalecana konfiguracja: Zachowaj spójność wizualną we wszystkich kanałach w ramach każdego komunikatu, aby budować rozpoznawalność marki.

Sześć praktycznych zastosowań sztucznej inteligencji w przekształcaniu tekstu na wideo — od krótkich filmów w mediach społecznościowych po prezentacje produktów w handlu elektronicznym i wizualizację koncepcji edukacyjnych.

Tekst do wideo a obraz do wideo: kiedy używać którego?

To jedno z najczęściej zadawanych pytań przez nowych użytkowników. Odpowiedź zależy od tego, jakie materiały masz do dyspozycji i czego potrzebujesz.

Dwie ścieżki do tworzenia filmów AI: Generowanie filmów na podstawie tekstu rozpoczyna się od tekstu pisanego, natomiast generowanie filmów na podstawie obrazów rozpoczyna się od istniejących zdjęć.

Scenariusze dla funkcji Text-to-Video (T2V): – Tworzysz całkowicie nową treść (bez obrazów referencyjnych)

- Pragniesz maksymalnej swobody twórczej

- Prowadzisz badania koncepcyjne lub wizualną burzę mózgów

- Potrzebujesz scen abstrakcyjnych lub niemożliwych do sfotografowania (science fiction, fantasy, mikroskopijne/makroskopijne)

- Chcesz szybko powtarzać proces — zmiana podpowiedzi powoduje powstanie zupełnie innej sceny

Scenariusze generowania filmów na podstawie obrazów (I2V):

- Posiadasz konkretną fotografię wymagającą dynamicznej transformacji

- Potrzebujesz wyniku dokładnie odpowiadającego istniejącym efektom wizualnym

- Konwertujesz zdjęcia produktów na filmy produktowe

- Potrzebujesz spójności postaci (ta sama osoba we wszystkich scenach)

- Pragniesz bardziej przewidywalnych i kontrolowanych wyników

Najlepsza praktyka — połączenie obu podejść:

- Wykorzystaj generowanie tekstu do wideo, aby zbadać kreatywne kierunki

- Wybierz optymalną klatkę jako obraz referencyjny

- Wykorzystaj generowanie obrazu do wideo, aby uzyskać dopracowaną, kontrolowaną wersję końcową

Aby uzyskać informacje na temat kompleksowego procesu generowania filmów na podstawie obrazów, zapoznaj się z Kompletnym przewodnikiem po sztucznej inteligencji w zakresie przekształcania obrazów w filmy.

Obecne ograniczenia — szczera ocena

Technologia AI przekształcająca tekst w wideo z 2026 roku jest imponująca, ale daleka od doskonałości. Poniżej przedstawiono obszary, w których obecnie osiąga najlepsze wyniki, oraz te, które nadal stanowią wyzwanie.

Dobra robota

- Krótkie filmy (5–15 sekund): Jakość obrazu zbliżona do standardów kinowych

- Sceny z jednym obiektem: Jedna osoba, jedno zwierzę, jeden przedmiot — doskonałe wyniki

- Przyroda i krajobrazy: Doskonałe odwzorowanie dynamiki płynów, pogody i efektów atmosferycznych

- Stylizowana treść: Animacje, film noir, science fiction — wysoce niezawodna konwersja stylu

- Prezentacje obrotowe produktów: Prosty ruch produktu o dobrej spójności

- Ruchy kamery: Panoramowanie, zoom, dolly, ujęcia z jazdy — dobrze kontrolowane

Nadal trudne

- Ręce i palce: Nadliczbowe palce, nieprawdopodobne gesty i deformacje paliczków pozostają powszechne

- Renderowanie tekstu: Czytelny tekst w filmach okazuje się niewiarygodny — litery są zniekształcone, a znaki wypaczone

- Złożone interakcje między wieloma osobami: Uścisk dłoni między dwiema osobami, wspólny taniec lub walka często powodują pomieszanie kończyn

- Długie narracje (>30 sekund): Utrzymanie spójności sceny przez dłuższy czas pogarsza się

- Precyzyjna fizyka: Precyzyjne odbicie piłki, wlewanie wody do określonych pojemników — fizyka jest przybliżona, a nie dokładna

- Długotrwała spójność twarzy: Cechy twarzy mogą ulegać subtelnym zmianom między klatkami, szczególnie w przypadku długich okresów czasu.

Trend postępu

Każde z tych ograniczeń zostanie znacznie poprawione do 2026 r. w porównaniu z 2024 r. Tempo poprawy jest wykładnicze. Renderowanie rąk przejdzie od „zawsze nieprawidłowego” do „ogólnie dokładnego”. Spójność twarzy zmieni się z „zaczynającej się zmieniać po 2 sekundach” na „pozostającą stabilną przez 10–15 sekund”. Renderowanie tekstu przejdzie od „nieczytelne” do „czasami czytelne”. Oczekuje się, że problemy te będą nadal szybko ulegać poprawie w latach 2026–2027.

Często zadawane pytania

Która sztuczna inteligencja do zamiany tekstu na wideo będzie najlepsza w 2026 roku?

Seedance 2.0 przoduje pod względem ogólnej jakości obrazu dzięki natywnej rozdzielczości 2K, czterokanałowemu wejściu i zintegrowanemu generowaniu dźwięku. Google Veo 3 wyróżnia się w zakresie fuzji audiowizualnej i symulacji fizycznej. Sora 2 oferuje najdłuższy czas trwania pojedynczej generacji (20 sekund). „Najlepszy” wybór zależy od konkretnych wymagań — rozdzielczości, dźwięku, czasu trwania lub ceny. Użytkownicy domowi mogą również rozważyć Keeling 3.0 (wysoka jakość w stosunku do ceny, długie filmy) i Tongyi Wanxiang (zintegrowany z ekosystemem Alibaba).

Czy istnieje darmowa sztuczna inteligencja do zamiany tekstu na wideo?

Tak. Seedance 2.0 oferuje dzienny bezpłatny limit bez konieczności podawania danych karty kredytowej. Pika 2.0 zapewnia codzienną bezpłatną generację. Ke Ling 3.0 przyznaje limit przy rejestracji. Google Veo 3 oferuje bezpłatne limity za pośrednictwem AI Studio. Conch AI zapewnia również dzienny bezpłatny limit. Szczegółowe informacje można znaleźć w artykule Porównanie bezpłatnych generatorów wideo AI.

Jak długie mogą być filmy AI generowane na podstawie tekstu?

Większość narzędzi generuje treści w odstępach co 5–15 sekund. Sora 2 może wygenerować do 20 sekund. Keeling 3.0 obsługuje ponad 20 sekund. W przypadku dłuższych treści można wygenerować wiele segmentów i połączyć je za pomocą oprogramowania do edycji, takiego jak Kuaishou, Premiere Pro lub DaVinci Resolve.

Czy sztuczna inteligencja przekształcająca tekst w wideo może osiągnąć profesjonalną jakość obrazu?

W ciągu 5–15 sekund jest to wykonalne. Wyniki uzyskane przy użyciu Seedance 2.0 i Veo 3 często nie różnią się od profesjonalnych materiałów filmowych w krótkich klipach. W przypadku dłuższych projektów wideo AI najlepiej wykorzystać jako element materiału filmowego (b-roll, ujęcia przejściowe, efekty wizualne), a nie jako całość produkcji.

Jak tworzyć skuteczne podpowiedzi do generowania tekstu do wideo?

Postępuj zgodnie z formułą: Temat + Akcja + Sceneria + Styl + Ujęcie + Oświetlenie. Opisy ruchu powinny być konkretne, ruchy kamery jasno określone, a atmosfera wyraźnie ustalona. Unikaj sprzeczności i powstrzymaj się od prośby o elementy tekstowe/UI. Powtarzaj stopniowo od prostych do złożonych. Więcej szczegółów znajdziesz w Przewodniku po pisaniu podpowiedzi.

Co jest lepsze: generowanie tekstu do wideo czy obrazu do wideo?

Różne zastosowania. Funkcja „tekst do wideo” zapewnia maksymalną swobodę twórczą, gdy nie ma dostępnych materiałów referencyjnych. Funkcja „obraz do wideo” zapewnia większą kontrolę, gdy istnieje konkretny punkt wyjścia wizualny. Większość profesjonalistów korzysta z obu podejść — stosując funkcję „tekst do wideo” do prac eksploracyjnych, a funkcję „obraz do wideo” do udoskonalania.

Czy filmy generowane przez sztuczną inteligencję mogą być wykorzystywane do celów komercyjnych?

Większość płatnych planów zapewnia prawa komercyjne. Płatna wersja Seedance 2.0 obejmuje pełne prawa komercyjne i nie zawiera znaków wodnych. Warunki świadczenia usług różnią się w zależności od platformy; przed użyciem należy zapoznać się z konkretnymi zasadami. W Chinach komercyjne wykorzystanie treści generowanych przez sztuczną inteligencję nie podlega obecnie żadnym wyraźnym ograniczeniom regulacyjnym, jednak zaleca się monitorowanie aktualizacji tymczasowych środków dotyczących zarządzania usługami generatywnej sztucznej inteligencji.

Czy sztuczna inteligencja zamieniająca tekst na wideo zastąpi redaktorów?

Nie zastąpi to ról, a raczej je przekształci. Sztuczna inteligencja zajmuje się generowaniem treści — tworzeniem oryginalnych zasobów wizualnych na podstawie opisów. Ludzcy redaktorzy zarządzają narracją, tempem, rezonansem emocjonalnym, spójnością marki i decyzjami kreatywnymi wymagającymi ludzkiej oceny. Do 2026 r. najskuteczniejszym sposobem pracy będzie generowanie treści przez sztuczną inteligencję + edycja przez człowieka.

Zacznij tworzyć filmy z tekstem

Do 2026 r. sztuczna inteligencja typu „text-to-video” będzie gotowa do profesjonalnych zastosowań. W ciągu zaledwie czterech lat technologia ta przeszła niezwykłą transformację, ewoluując od niewyraźnych eksperymentów GAN do niemal kinowych wyników DiT. Niezależnie od tego, czy potrzebujesz treści do mediów społecznościowych, prezentacji produktów, wizualizacji edukacyjnych czy kreatywnych poszukiwań, technologia „text-to-video” spełni Twoje oczekiwania.

Najlepszym sposobem nauki jest rozpoczęcie tworzenia. Napisz polecenie, sprawdź wyniki i powtarzaj.

Zmień swój pierwszy akapit w film – wypróbuj Seedance za darmo →

Szukasz większej precyzji sterowania? Wypróbuj generowanie obrazów do filmów →

Chcesz pogłębić swoją wiedzę na temat technik tworzenia podpowiedzi? Przeczytaj nasz przewodnik po tworzeniu podpowiedzi →