Auf einen Blick

Die Technologie zur Erzeugung von KI-Videos überschreitet die bedeutendste Schwelle seit ihrer Einführung: die audiovisuelle Synchronisation. Bis 2026 werden die besten KI-Videogeneratoren keine stummen Clips mehr ausgeben, die manuell vertont werden müssen. Sie werden Soundeffekte produzieren, die zu den Aktionen auf dem Bildschirm passen, Hintergrundmusik, die mit der visuellen Stimmung synchronisiert ist, und lippensynchrone Sprache in mehreren Sprachen – alles innerhalb einer einzigen Generierungspipeline. Dieser Leitfaden behandelt: Die drei Kernarten der KI-Audiovisuellen-Generierung (Soundeffekte, Musikkomposition, Lippensynchronisation); Einen vollständigen sechsstufigen Workflow zur Erstellung von KI-Musikvideos von Grund auf; Acht Anwendungsbeispiele aus der Praxis, von Musikvideos unabhängiger Künstler bis hin zur Visualisierung von Podcasts; Fünf gebrauchsfertige Prompt-Vorlagen; Einen umfassenden Vergleich aller audiofähigen Tools; Sowie fortgeschrittene Techniken wie BPM-Anpassung und emotionale Synchronisation. Wenn Ihre Videoinhalte Ton erfordern – was praktisch alle Videoproduktionen umfasst –, stellt dies den bedeutendsten Fortschritt im Bereich KI-Videos seit der Text-zu-Video-Generierung dar. Beginnen Sie jetzt mit der Erstellung von KI-Musikvideos -->

Der Übergang von stummen KI-Videos zu perfekter Lippensynchronisation stellt den bedeutendsten Qualitätssprung in der Geschichte KI-generierter Inhalte dar. Aufgaben, für die Hollywood-Postproduktionsteams früher wochenlang arbeiten mussten, können nun innerhalb einer einzigen generativen Pipeline erledigt werden.

Die Audio-Revolution in KI-Videos

Lange Zeit waren KI-generierte Videos ein grundlegend unvollständiges Medium. Die Bildqualität verbesserte sich zwar rasant – von verschwommenen, wenige Sekunden langen Clips Anfang 2024 zu minutengenauen Sequenzen mit fotografischem Realismus Ende 2025 –, doch alle diese Videos hatten eine Einschränkung gemeinsam: Sie waren stumm.

Die Stummfilmära: 2024 bis Anfang 2025

Die erste Generation von KI-Videotools – Runway Gen-2, Pika 1.0 und frühe Versionen von Keeling – konnte nur Videomaterial generieren. Es gab keinen Soundtrack, keine Soundeffekte, keine Musik. Das Ergebnis war eine rein visuelle MP4-Datei, die in einem separaten Bearbeitungsworkflow manuell synchronisiert, abgemischt und synchronisiert werden musste. Dies war keine geringfügige Unannehmlichkeit, sondern eine grundlegende Lücke zwischen den Produktionsmöglichkeiten der KI und den Erwartungen des Publikums.

Die menschliche Wahrnehmung von Videos ist zutiefst multimodal. Neurowissenschaftliche Forschungen zeigen immer wieder, dass Audio zu 50 % oder mehr zur emotionalen Wirkung eines Videoerlebnisses beiträgt. Eine filmische Landschaftsaufnahme, wie fotorealistisch sie auch sein mag, würde ohne das Rauschen des Windes, Vogelgezwitscher oder eine mitreißende Filmmusik flach und künstlich wirken. Eine Figur, die ohne Ton spricht – deren Lippen sich lautlos bewegen – stürzt direkt in die Uncanny Valley. Die „Stummfilmära” der KI-Videos bedeutet, dass jeder generierte Clip umfangreiche Nachbearbeitungsarbeiten erfordert, um vollständig zu wirken.

Für professionelle Kreative bedeutet dies, dass sie zwei separate Arbeitsabläufe für die visuelle Generierung und die Audioproduktion aufrechterhalten müssen, was sowohl den Zeit- als auch den Qualifikationsaufwand verdoppelt. Für Amateur-Kreative bedeutet dies, dass KI-generierte Videos sich immer unvollendet anfühlen – beeindruckend als technische Demonstrationen, aber unbrauchbar als endgültiger Inhalt.

2025–2026: Die Verschmelzung von Ton und Bild

Durchbrüche kommen in Etappen. Googles Veo 3 hat native Audioerzeugungsfunktionen angekündigt und damit gezeigt, dass ein einziges Modell gleichzeitig synchronisierte Videos und Töne produzieren kann. Dabei handelt es sich nicht um Audio, das während der Postproduktion über das Video gelegt wird, sondern um Audio, das als integraler Bestandteil der Videoausgabe erzeugt wird, wobei die Umgebungsgeräusche genau auf die Handlung auf dem Bildschirm abgestimmt sind.

Etwa zur gleichen Zeit veröffentlichte Seedance 2.0 (entwickelt vom Seed-Team von ByteDance) eine umfassende Audio-Suite mit drei unterschiedlichen Funktionen: AI-Soundeffektgenerierung (SFX), synchronisiert mit Videoinhalten, AI-Soundtrackgenerierung, abgestimmt auf visuelle Stimmungen, und AI-Lippensynchronisationstechnologie, die Sprachaufnahmen den Mundbewegungen der Charaktere zuordnet (unterstützt acht Sprachen, darunter Chinesisch). Pika führte seine Soundeffekt-Funktion für grundlegende Umgebungsgeräusche ein. Die Schleusen für Audiofunktionen sind nun vollständig geöffnet.

Diese Veränderung ist von großer Bedeutung, da sie KI-Videos von „visuellem Material, das manuell nachbearbeitet werden muss“ in „ein vollständiges, veröffentlichungsfertiges Medienformat“ verwandelt. Die Lücke zwischen „KI-generierten Clips“ und „fertigen Videoinhalten“ hat sich von stundenlanger Bearbeitung auf nur wenige Minuten Generierungszeit verringert.

Besondere Bedeutung für chinesische Kreative: Diese Transformation bietet einheimischen Kreativen größere Chancen. Plattformen wie Douyin, Kuaishou und Bilibili haben ein riesiges kreatives Ökosystem für kurze Musikvideos geschaffen. Unabhängige Musiker haben sich zwar auf NetEase Cloud Music und QQ Music ein Publikum aufgebaut, doch oft fehlt es ihnen an visuellen Inhalten, die ihrer musikalischen Qualität entsprechen. KI-generierte Musikvideos schließen diese Lücke – Produzenten, die in ihren Schlafzimmern auf Laptops professionelle Musik produzieren, können nun auch mit Hilfe von KI professionelle Musikvideos erstellen.

Warum Audio das letzte Puzzleteil ist

Nehmen wir als Beispiel den Workflow zur Erstellung von Inhalten eines Bilibili-Content-Erstellers, eines Xiaohongshu-Erstellers oder eines unabhängigen Musikers:

- Konzept – Worum geht es in dem Video?

- Bildmaterial – Wie sieht das Video aus?

- Ton – Wie klingt das Video?

- Synchronisation – Sind Bild und Ton synchron?

- Feinschliff – Ist es bereit für die Veröffentlichung?

Bis 2025 hatten KI-Videotools die Schritte 1 und 2 effektiv gelöst. Die Schritte 3 und 4 blieben vollständig manuell. Mit Generatoren, die über Audiofunktionen verfügen, konnten die Schritte 1 bis 4 nun mit einem einzigen Tool durchgeführt werden. Schritt 5 – der letzte Schliff – bleibt die einzige manuelle Phase, obwohl seine Notwendigkeit mit der Verbesserung der Ausgabequalität abnimmt.

Für die Produktion von Musikvideos bedeutet dies einen revolutionären Wandel. Ein unabhängiger Musiker, der sich die traditionellen Produktionskosten für Musikvideos niemals hätte leisten können, kann nun selbst eines erstellen. Ein Bilibili-Creator, der Lo-Fi-Musik produziert, kann zu jedem Track eine visuelle Begleitung erstellen. Ein Marketingteam kann Produktwerbung mit perfekt abgestimmten Soundtracks produzieren, ohne Komponisten beauftragen oder urheberrechtlich geschützte Musik erwerben zu müssen.

Der aktuelle Stand der Tools mit Audiofunktionen

Im Februar 2026 sind drei Plattformen führend im Bereich KI-generierter Videos mit integriertem Audio:

- Seedance 2.0: Die umfassendste audiovisuelle Lösung. Unterstützt die Erzeugung von Soundeffekten, die KI-gestützte Erstellung von Soundtracks/Musik und mehrsprachige Lippensynchronisation (8 Sprachen, darunter Chinesisch). Geeignet sowohl für Text-zu-Video- als auch für Bild-zu-Video-Workflows. Als Produkt von ByteDance direkt in China ohne VPN zugänglich, unterstützt Alipay/WeChat Pay. Dieser Leitfaden bezieht sich in erster Linie auf diese Plattform.

- Google Veo 3: Leistungsstarke native Audioerstellungsfunktionen, einschließlich Umgebungsgeräuschen und atmosphärischen Effekten. Die Ergebnisse sind beeindruckend, allerdings fehlt die detaillierte Kontrolle über Audiotypen und -stile, die Seedance bietet. **Erfordert ein VPN für die Nutzung innerhalb Chinas. ** Eine detaillierte Gegenüberstellung finden Sie unter Seedance vs. Veo 3 – Ausführlicher Vergleich.

- Pika 2.0: Grundlegende Soundeffektgenerierung. Beschränkt auf Umgebungsgeräusche – keine Musikgenerierung oder Lippensynchronisation. Geht in die richtige Richtung, ist aber keine vollständige Audiolösung. Erfordert VPN.

Andere Tools innerhalb des Ökosystems – Keeling, Runway und Conch AI – konzentrieren sich zum Zeitpunkt der Erstellung dieses Artikels weiterhin in erster Linie auf die reine visuelle Ausgabe, es wird jedoch erwartet, dass sie in Kürze nachziehen werden. Einen umfassenderen Vergleich aller Generatoren finden Sie unter The Complete 2026 AI Video Generator Comparison.

Zusätzliche Optionen für inländische Nutzer – KI-Tools zur Musikgenerierung: Über die Audiofunktionen in KI-Videos hinaus gibt es in China spezielle KI-Plattformen zur Musikgenerierung, die einen Blick wert sind: SkyMusic (produziert von Kunlun Wanwei, besonders geeignet für die Generierung chinesischer Songtexte) und NetEase Tianyin (produziert von NetEase, integriert in das NetEase Cloud Music-Ökosystem). Diese Tools können als eigenständige Musikproduktionsprozesse fungieren, wobei die generierte Musik anschließend als Audio-Referenzmaterial für die Videoproduktion in Seedance importiert wird.

Die drei wichtigsten Arten der audiovisuellen KI-Generierung

Nicht alle KI-Audios sind gleich. Diese Technologie umfasst drei grundlegend unterschiedliche Funktionen, die jeweils unterschiedlichen kreativen Zwecken dienen und über unterschiedliche technische Mechanismen funktionieren. Das Verständnis dieser Unterschiede ist entscheidend für die Auswahl des richtigen Ansatzes für Ihr Projekt.

Die KI-Soundeffektgenerierung führt eine Frame-für-Frame-Analyse des Videoinhalts durch, identifiziert Aktionen und Umgebungen, die Geräusche erzeugen, und synthetisiert dann passende Audio-Wellenformen. Das Endergebnis ist ein Umgebungsgeräusch, das organisch mit dem visuellen Inhalt verknüpft ist.

Typ 1: KI-Soundeffekte (SFX)

Die KI-Soundgenerierung erzeugt automatisch Umgebungs- und Action-Sounds, die zum Bildschirminhalt passen. Wenn Charaktere über einen Kiesweg laufen, hört man Schritte, die auf den Steinen knirschen. Wenn Wellen gegen Felsen schlagen, hört man das Rauschen des Meeres. Wenn in einer Straßenszene Automotoren dröhnen, hört man das Motorengeräusch.

So funktioniert die Seedance-Soundgenerierung: Das KI-Modell analysiert den visuellen Inhalt des generierten Videos – es identifiziert Objekte, Handlungen, Umgebungen und physische Interaktionen – und erzeugt einen begleitenden Soundtrack mit entsprechenden Soundeffekten. Dabei handelt es sich nicht einfach darum, „Ozean” mit einem Stock-Clip von Wellen abzugleichen. Das Modell generiert einzigartige Audiodaten, die auf bestimmte visuelle Merkmale reagieren: die Intensität der Wellen, ihre Entfernung von der Kamera, das Vorhandensein von Wind und die akustischen Eigenschaften der Umgebung.

Sound Generation ist auf die Verarbeitung der folgenden Soundtypen spezialisiert: – Umgebungsgeräusche (Wind, Regen, Donner, Waldgeräusche, Stadtverkehr) – Geräusche physischer Interaktion (Schritte auf verschiedenen Oberflächen, Öffnen/Schließen von Türen, Platzieren von Gegenständen) – Naturgeräusche (Wasserfließen, Vogelgezwitscher, Insektengezirpe, Rascheln von Blättern) – Mechanische Geräusche (Motoren, Maschinenbetrieb, Tastendrücke, elektronisches Summen) – Aufprallgeräusche (Kollisionen, Spritzer, Zerbrechen, Einstürze)

Techniken zur Andeutung von Geräuschen durch Eingabeaufforderungen: Selbst bei Verwendung von Text-zu-Video-KI können Sie die Audioausgabe beeinflussen, indem Sie geräuschverursachende Elemente in visuellen Eingabeaufforderungen beschreiben. „Regen, der auf ein Blechdach prasselt“ erzeugt ein intensiveres Regengeräusch als „sanfter Nieselregen im Garten“. Das Geräusch von Schritten „schwerer Stiefel, die auf einem Metallgitter stampfen“ unterscheidet sich völlig von dem „barfuß auf warmem Sand“. Visuelle Beschreibungen steuern die Audioerzeugung, sodass die Darstellung akustisch reichhaltiger Szenen komplexere Klanglandschaften erzeugt.

Aktuelle Einschränkungen: Die Klangerzeugung eignet sich hervorragend für Umgebungs- und Naturgeräusche, kann jedoch bei komplexen, vielschichtigen Klanglandschaften (z. B. in einem belebten Restaurant mit sich überschneidenden Gesprächen, klapperndem Besteck, Küchenlärm und Hintergrundmusik) Schwierigkeiten haben. Außerdem kann sie organische Geräusche besser verarbeiten als sehr spezifische, identifizierbare Audioeigenschaften (z. B. den Motorensound eines bestimmten Automodells oder den Ruf einer bestimmten Vogelart).

Typ 2: KI-Musik und Soundtracks

Die KI-Musikgenerierung erstellt Hintergrundmusik, Soundtracks und Originalpartituren für Ihre Videos, die perfekt zum visuellen Inhalt, zur Stimmung und zum Rhythmus passen. Dabei handelt es sich nicht einfach um das Hinzufügen generischer lizenzfreier Musik – die KI generiert maßgeschneiderte Originalkompositionen, die auf das Filmmaterial zugeschnitten sind.

Stilsteuerung: Sie können den Musikstil durch Eingabeaufforderungen und Generierungseinstellungen steuern. Es wird eine Vielzahl von Stilen unterstützt:

- Film Orchestral: Grandioser Streichersound, Blechbläser und Percussion, ideal für epische Landschaften oder dramatische Szenen

- Dynamic Electronic: Lebhafte Synthesizer und Beats, ideal für rasante Inhalte, Produktpräsentationen oder soziale Medien

- Ambient/Atmospheric Music: Weiche Texturen, vielschichtige Klänge und anhaltende Bässe, perfekt für meditative Inhalte, Immobilienpräsentationen oder Zeitlupenaufnahmen aus der Natur

- Lo-Fi-Hip-Hop: Kultige, warme, leicht verstimmte Beats gepaart mit Vinyl-Knistern, ideal für Lern-/Konzentrationsinhalte

- Spannung/Suspense: Dissonante Streicher, tiefe Percussion und vielschichtige, eskalierende Dringlichkeit, perfekt für Trailer und Werbefilme

- Folk/ Akustik: Gitarre, Klavier und organische Instrumente, geeignet für personalisierte, intime Inhalte

- Traditioneller chinesischer/antiker Stil: Guzheng, Flöte, Pipa und andere traditionelle chinesische Instrumente, geeignet für traditionelle chinesische Videoinhalte und Musikvideos im antiken Stil – Dies ist die markanteste stilistische Richtung innerhalb der chinesischen KI-Musikvideoproduktion.

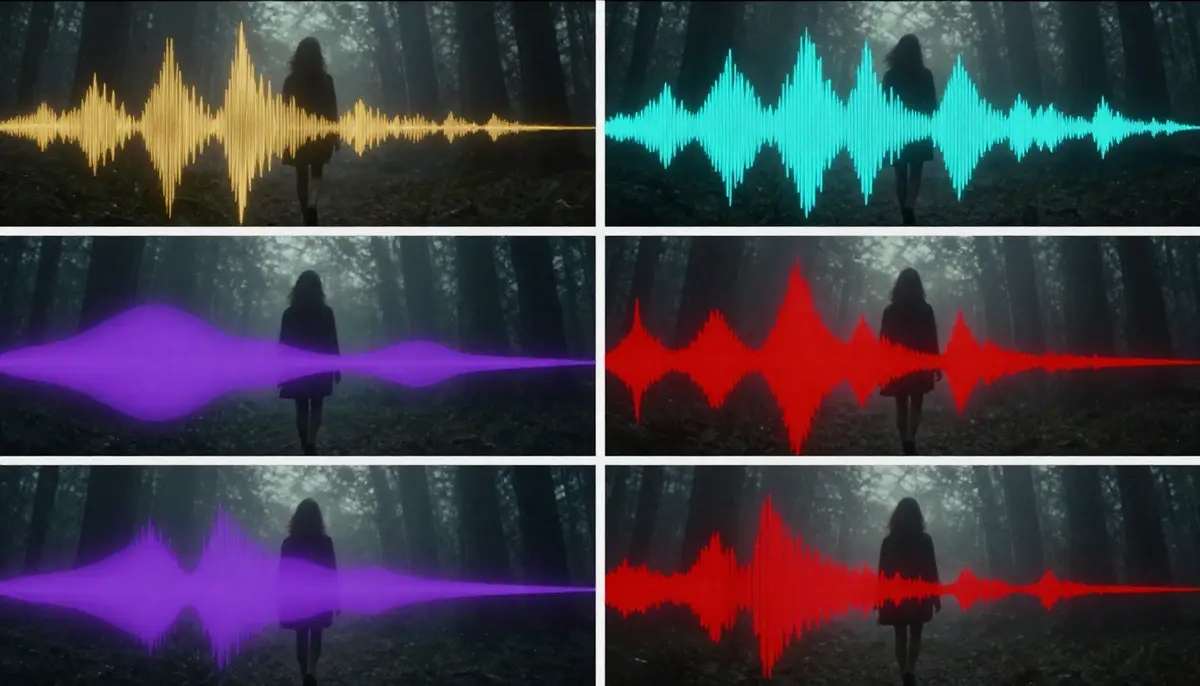

Unterschiedliche Musikstile erzeugen deutlich unterschiedliche Wellenformcharakteristika. Die KI-Soundtrack-Generierung passt nicht nur das Genre an, sondern gleicht auch die Energiekurve an und synchronisiert die Intensität der Musik mit der visuellen Handlung im gesamten Video.

Daueranpassung: Die KI-generierte Musik passt sich der Ausgabedauer Ihres Videos an. Ein 5-Sekunden-Clip erhält eine zusammenhängende 5-Sekunden-Phrase. Ein 30-Sekunden-Video erhält ein strukturiertes Stück mit Einleitung, Entwicklung und Schluss. Dadurch entfällt das häufige Problem, dass Sie Stock-Musik, die nicht für Ihre spezifische Videolänge konzipiert wurde, manuell ein- und ausblenden müssen.

Unterschiede zu eigenständigen KI-Musiktools: Vielleicht kennen Sie bereits spezielle KI-Musikgeneratoren wie Suno oder Udio, die aus Textvorgaben eigenständige Musiktitel erstellen. Diese Tools produzieren zwar hervorragende Musik, aber ihnen fehlt das visuelle Bewusstsein – sie wissen nicht, wie Ihr Video aussieht, wann wichtige visuelle Momente auftreten oder wie sich die Stimmung innerhalb des Filmmaterials verändert. Die KI-Soundtrack-Generierung in Videotools wie Seedance funktioniert grundlegend anders, da die Musik als Reaktion auf den visuellen Inhalt erzeugt wird. Die Musik wird intensiver, wenn die Bilder dramatischer werden, ihr Rhythmus passt sich den Bewegungen auf dem Bildschirm an und ihre Atmosphäre entspricht der Stimmung der jeweiligen Szene.

Mit anderen Worten: Eigenständige KI-Musiktools und KI-Videogeneratoren ergänzen sich gegenseitig. Ein robuster Workflow umfasst zunächst die Erstellung eines Tracks in Suno oder Udio (oder inländischen Alternativen wie SkyMusic oder NetEase Tianyin) und anschließend die Eingabe dieser Audiodatei in Seedance als Referenz, um ein Video zu erstellen. Der KI-Videogenerator erstellt dann Bilder, die auf die Struktur der Musik reagieren. Wir werden diesen Workflow im folgenden Schritt-für-Schritt-Tutorial detailliert beschreiben.

Typ 3: KI-Lippensynchronisation und Sprache

Die KI-Lippensynchronisation stellt von den drei Audioarten die höchsten technischen Anforderungen. Sie ordnet Sprachaufnahmen – egal ob hochgeladen oder generiert – den Lippenbewegungen einer Figur zu und erzeugt so den visuellen Effekt, dass die Figur auf dem Bildschirm spricht oder singt.

Mehrsprachige Unterstützung: Seedance 2.0 unterstützt die Lippensynchronisation in acht Sprachen, darunter Chinesisch, Englisch, Japanisch, Koreanisch, Spanisch, Französisch, Deutsch und Portugiesisch. Dies geht über das reine Synchronisieren von Audio hinaus – das Modell passt die Mundformen, Kieferbewegungen und Mikroausdrücke der Gesichter der Charaktere an die stimmlichen Eigenschaften der jeweiligen Sprache an. Die Mundform für den chinesischen Vokal „o“ unterscheidet sich vom englischen „O“, während der japanische Vokal „u“ ebenfalls vom englischen „u“ abweicht. Eine genaue Lippensynchronisation muss diese sprachlichen Unterschiede berücksichtigen.

Die praktische Bedeutung des chinesischen Lippensynchronisierens: Für einheimische Kreative ermöglicht das chinesische Lippensynchronisieren, dass KI-generierte Charaktere Ihre Songs in Standard-Mandarin singen oder sich präzise an schnelle chinesische Texte in Rap-Musikvideos anpassen. Dies birgt ein immenses kreatives Potenzial innerhalb der Cover-Song- und Anime-Communities von TikTok und Bilibili – virtuelle KI-Sänger entwickeln sich zu einem neuen Content-Format.

KI-Lippensynchronisation verwandelt eine visuell lebensechte, aber stumme Figur in eine stimmliche Präsenz. Diese Technologie passt nicht nur die Mundform an, sondern modifiziert auch die Kieferposition, die Spannung der Wangen und subtile Mikroausdrücke im Gesicht, um sie an die Sprachphoneme anzupassen.

So funktioniert es: Der Prozess beginnt mit einer Audio-Referenz – entweder einer von Ihnen hochgeladenen Sprachaufnahme oder einer KI-generierten Sprache. Das Modell analysiert den phonetischen Inhalt der Audioaufnahme (welche Laute zu welchen Zeitpunkten erzeugt werden) und generiert Frame für Frame die entsprechenden Lippen- und Gesichtsbewegungen. Für optimale Ergebnisse sollte die Audioaufnahme eine klare, moderat gesprochene Sprache mit minimalen Hintergrundgeräuschen enthalten.

Anwendungsszenarien:

- Digitale Menschen und virtuelle Avatare: Erstellen Sie sprechende KI-Moderatoren für Bilibili-/YouTube-Kanäle, Unternehmensschulungen oder den Kundenservice

- Animierte Charaktere: Verleihen Sie KI-generierten animierten Charakteren eine Stimme, ohne Frame für Frame die Lippensynchronisation anzupassen

- Mehrsprachige Synchronisation: Erstellen Sie lippensynchrone Versionen bestehender audiovisueller Inhalte in anderen Sprachen, indem Sie neue Audiodaten an die Mundbewegungen der Figuren anpassen

- Musikvideo-Auftritte: Synchronisieren Sie die visuellen Darbietungen von Sängern mit Gesangsspuren, um authentische Musikvideo-Effekte zu erzielen

- Podcast- und Hörbuch-Visualisierung: Verwandeln Sie reine Audioinhalte in visuelle Medien mit sprechenden Figuren

Aktuelle Einschränkungen – ehrliche Einschätzung: Die Lippensynchronisation ist die jüngste und am wenigsten ausgereifte der drei audiovisuellen Arten. Obwohl bereits erhebliche Fortschritte erzielt wurden, bestehen weiterhin gewisse Herausforderungen. Schnelle Sprache übersteigt gelegentlich die Fähigkeit des Modells, passende Lippenbewegungen zu generieren, was zu einer leichten Desynchronisation führt. Extreme Gesichtswinkel (Seitenprofile, extreme Aufwärtswinkel) verringern die Genauigkeit der Lippensynchronisation, da weniger Mundmarkierungen sichtbar sind. Sprache mit ausgeprägten Akzenten oder ungewöhnlichen Stimmmerkmalen kann zu weniger präzisen Ergebnissen führen als Standard-Sprachmuster. Bei chinesischen Liedern mit extrem schneller Sprachausgabe, wie z. B. Rap, kann die Synchronisationsgenauigkeit geringer sein als bei Gesang mit normalem Tempo. Obwohl die Technologie rasante Fortschritte macht, ist es wichtig, realistische Erwartungen zu haben – die Lippensynchronisation im Jahr 2026 funktioniert in Standard-Sprachszenarien hervorragend, befindet sich jedoch für Randfälle noch in der Entwicklung.

Schritt-für-Schritt-Anleitung: KI-Musikvideos von Grund auf erstellen

Mit diesem sechsstufigen Arbeitsablauf können Sie ein komplettes KI-Musikvideo mit synchronisierten Audio- und Bildelementen vom Konzept bis zur Fertigstellung erstellen. Dieser Prozess eignet sich sowohl für unabhängige Musiker, die ihr erstes Musikvideo erstellen, als auch für Bilibili-Content-Ersteller, die einen musikorientierten Kanal aufbauen, oder für Marketingfachleute, die Markenvideos produzieren.

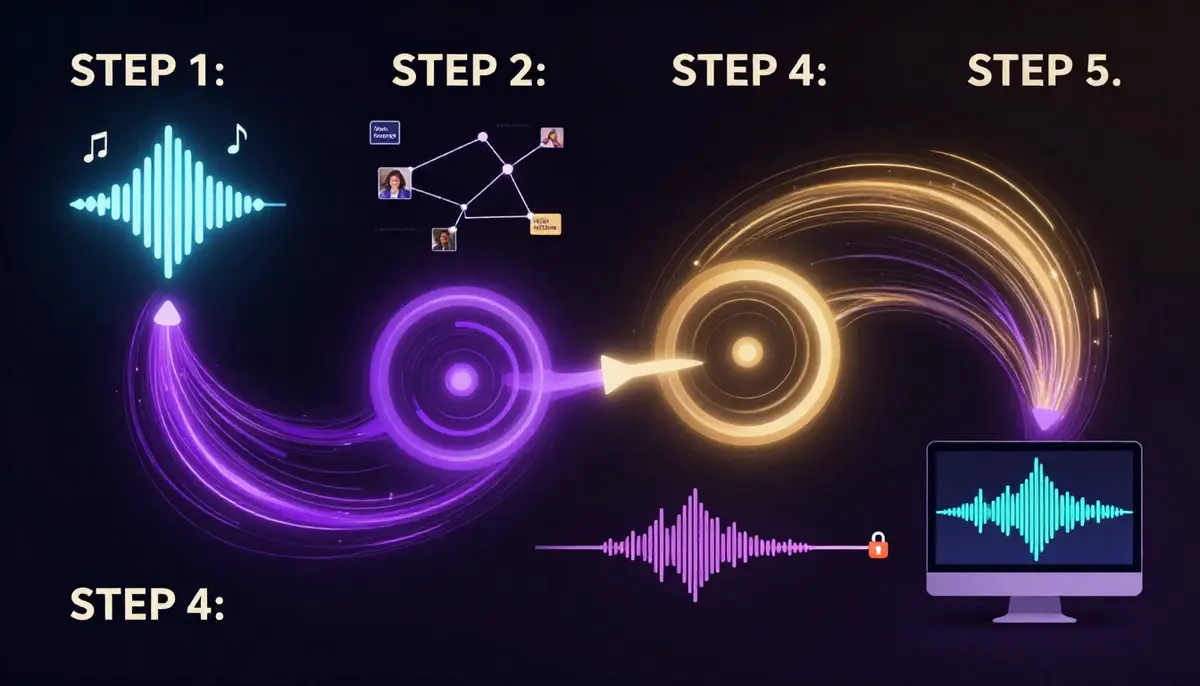

Ein vollständiger AI-Musikvideo-Workflow von der Audioquelle bis zum fertigen Ergebnis. Jeder Schritt baut auf dem vorherigen auf, wobei die audiovisuelle Synchronisation während der Erstellung automatisch erfolgt.

Schritt 1: Bereiten Sie Ihre Musik oder Audioquelle vor.

Jedes Musikvideo beginnt mit der Musik. Sie haben drei Möglichkeiten:

Option A – Eigene Musik verwenden: Wenn Sie Musiker sind oder über lizenzierte Titel verfügen, bereiten Sie Ihre Audiodateien vor. Zu den unterstützten Formaten gehören in der Regel MP3, WAV und AAC. Um optimale Ergebnisse zu erzielen, verwenden Sie hochwertige Master- oder Mix-Versionen (keine komprimierten Streaming-Rips). Saubere, gut getrennte Audiodateien liefern eine überlegene Lippensynchronisationsgenauigkeit im Vergleich zu stark komprimierten Dateien.

Option B – Musik mit KI erstellen: Verwenden Sie eigenständige KI-Musikgeneratoren, um originelle Tracks zu erstellen. Zu den Tools aus Übersee gehören Suno und Udio; im Inland sollten Sie SkyMusic (hervorragend geeignet für die Generierung chinesischer Texte, unterstützt mehrere chinesische Musikstile) oder NetEase SkySound (integriert in das NetEase Cloud Music-Ökosystem) in Betracht ziehen. Beschreiben Sie den gewünschten Stil, die Stimmung, das Tempo und das Arrangement, um mehrere Versionen zu generieren, und wählen Sie diejenige aus, die am besten zu Ihrem visuellen Konzept passt. Speichern Sie die Datei lokal.

Option C – Vollständige KI-Steuerung: Wenn Sie keine bestimmte Audioquelle haben und möchten, dass die KI sowohl Bildmaterial als auch Audio gleichzeitig generiert, überspringen Sie die Audio-Vorbereitung und verlassen Sie sich direkt auf die integrierte Soundtrack-Generierung von Seedance. In diesem Szenario beeinflusst Ihre visuelle Eingabe die musikalische Ausgabe. Dies ist der schnellste Ansatz, bietet jedoch weniger Kontrolle über den genauen musikalischen Effekt.

Hinweis für Musiker: Wenn Sie möchten, dass die Visuals auf bestimmte Momente in der Musik reagieren – einen Tempowechsel, einen Tonartwechsel, einen Gesangseinstieg – notieren Sie sich diese Zeitstempel. Sie werden diese Informationen in Ihren Eingabeaufforderungen verwenden und können Segmente generieren, die sich an der Struktur des Songs orientieren.

Schritt 2: Visuelle Impulse als Ergänzung zur Musik gestalten

Ihre visuellen Hinweise sollten Bilder darstellen, die den Ton auf natürliche Weise ergänzen. Es geht nicht darum, die Liedtexte Wort für Wort zu illustrieren, sondern vielmehr darum, eine visuelle Atmosphäre zu schaffen, die den emotionalen Gehalt der Musik verstärkt.

Musikalischen Stil mit visuellem Stil abstimmen:

| Musikstil | Visuelle Ausrichtung | Stichworte |

|---|---|---|

| Filmische Orchestermusik | Weite Landschaften, dramatischer Himmel, epische Dimensionen | „weit“, „majestätisch“, „langsame Kamerafahrt“, „IMAX-Qualität“ |

| Lo-Fi / Entspannung | Sanfte Töne, gemütliche Innenräume, Nieselregen, warme Beleuchtung | „Pastell“, „Weichzeichner“, „warm“, „sanfte Bewegung“ |

| Dynamische Elektronik | Schnelle Schnitte, Neon, urban, dynamische Aufnahmen | „lebhaft”, „dynamisch”, „Neon”, „rasant” |

| Lyrische Ballade | Intime Nahaufnahmen, Kerzenlicht, Zeitlupe | „intim”, „geringe Tiefenschärfe”, „warme Töne” |

| Dunkel/dramatisch | Schatten, hoher Kontrast, Spannung, minimalistische Farbpalette | „dramatische Beleuchtung“, „Silhouette“, „hoher Kontrast“ |

| Chinesischer/antiker Stil | Landschaften, Pavillons und Türme, Tuschemalerei-Elemente, fallende Blütenblätter | „Chinesische Landschaft“, „Tuschemalerei-Stil“, „traditionelle Architektur“, „ätherisch“ |

| Rap/Hip-Hop | Straßenszenen, Graffiti, Nachtlandschaften, Scheinwerferhalos | „urban“, „Straßenkultur“, „Neonreklamen“, „dynamische Handkamera“ |

Umfassende Informationen zu Prompt-Techniken finden Sie im Seedance Prompt Guide. Grundprinzipien für Musikvideo-Prompts: Beschreiben Sie Bewegungen, die sich natürlich zum Rhythmus Ihres Songs anfühlen. Schnellere Tracks erfordern dynamische Bilder, während langsamere Songs gleichmäßige, anmutige Bewegungen verlangen.

Schritt 3: Audiomodus auswählen

Wählen Sie beim Erstellen in Seedance den für Ihr Projekt geeigneten Audiomodus aus:

Soundeffektmodus (SFX): Ideal, wenn Ihr Video bestimmte Umgebungs- oder Actionelemente enthält, die authentische Umgebungsgeräusche erfordern. Ein Auto, das durch Regen fährt, sollte wie ein Auto im Regen klingen. Meereszenen sollten das Rauschen der Wellen enthalten. Der SFX-Modus generiert diese Geräusche automatisch auf Grundlage des Videomaterials.

Musik-/Soundtrack-Modus: Ideal, wenn Sie möchten, dass die KI Hintergrundmusik generiert, die den visuellen Inhalt ergänzt. Verwenden Sie diesen Modus, wenn keine vorgefertigten Titel verfügbar sind und Sie möchten, dass das Tool originelle Soundtracks erstellt. Sie können den Stil durch visuelle Eingaben beeinflussen – eine neonfarbene Cyberpunk-Stadtlandschaft erzeugt ganz andere Musik als ein ruhiger Sonnenaufgang in den Bergen.

Stimm-/Lippensynchronisationsmodus: Ideal, wenn in Ihrem Video Figuren sprechen oder singen und Sie eine Synchronisation des Tons mit den Mundbewegungen benötigen. Laden Sie Ihre Gesangsspur oder Sprachaufnahme hoch, und die KI generiert passende Lippenbewegungen für die Figur.

Kombinierter Ansatz: Für ein möglichst umfassendes Musikvideo-Erlebnis sollten Sie einen mehrstufigen Workflow in Betracht ziehen. Erstellen Sie zunächst mit dem Soundtrack-Modus ein Basisvideo mit Bildmaterial und Musik. Wenn Umgebungsgeräusche über die Musik gelegt werden sollen, verwenden Sie den SFX-Modus in einem zweiten Durchgang oder fügen Sie sie während der Postproduktion hinzu. Wenn Charaktere singen sollen, bearbeiten Sie dies mit dem Lippensynchronisationsmodus auf der Gesangsspur.

Schritt 4: Referenzmaterialien hochladen (optional, aber dringend empfohlen)

Referenzeingaben können die Qualität und Genauigkeit der Ausgabe erheblich verbessern. Für die Produktion von Musikvideos sind die folgenden Referenztypen besonders nützlich:

Audio-Referenzdatei: Laden Sie Ihren Musiktitel hoch. Die KI verwendet ihn als Audio-Grundgerüst für das Video und generiert Bilder, die auf den musikalischen Inhalt reagieren. Dies ist die wichtigste Referenz bei der Produktion von Musikvideos.

Referenzbild: Laden Sie ein statisches Bild hoch, das Ihren gewünschten visuellen Stil widerspiegelt. Dies kann ein Albumcover, ein Screenshot eines Moodboards, ein Frame aus einem bestehenden Musikvideo, das Ihnen gefällt, oder ein KI-generiertes Bild sein, das Ihre gewünschte Ästhetik einfängt. Die Text-zu-Video-Funktion von Seedance verwendet diese Referenz, um die visuelle Konsistenz zu gewährleisten.

Referenzvideo: Wenn Sie ein bestehendes Musikvideo haben, dessen Kamerabewegungen, Schnittrhythmus oder visueller Stil Sie nachahmen möchten, laden Sie es als Referenz hoch. Die KI lernt Bewegungsmuster, Übergangszeiten und visuelle Komposition aus Ihrer Referenz, während sie originelle Inhalte generiert.

Schritt 5: Audiovisuelle Synchronisation generieren und anpassen

Klicken Sie auf „Generieren“, damit die KI die erste Ausgabe erstellt. Achten Sie bei der Überprüfung besonders auf die Genauigkeit der Lippensynchronisation:

Wichtige Punkte: – Passt die musikalische Energie zur visuellen Energie? Ein dramatisches Crescendo im Orchester sollte mit einem visuell dramatischen Moment zusammenfallen, nicht mit einer statischen Szene. – Ist das Timing der Soundeffekte korrekt? Schritte sollten zu hören sein, wenn der Fuß den Boden berührt. Aufprallgeräusche sollten mit visuellen Kollisionen übereinstimmen.

- Ist die Lippensynchronisation überzeugend? Beobachten Sie die Münder der Figuren bei normaler Wiedergabegeschwindigkeit. Geringfügige Abweichungen auf Frame-Ebene sind bei normaler Geschwindigkeit nicht sichtbar, aber in Zeitlupe – und Ihr Publikum sieht sich den Film in normaler Geschwindigkeit an.

- Ist die Gesamtatmosphäre stimmig? Die visuelle Farbpalette, die musikalische Tonalität und das Arrangement sowie der Rhythmus sollten gemeinsam dieselbe emotionale Erzählung vermitteln.

Wenn die Synchronisation Probleme bereitet: Generieren Sie nach der Änderung der Eingabeaufforderung eine neue Version. Sollte die Musik für die visuellen Elemente zu intensiv sein, fügen Sie dynamischere Elemente in die visuelle Eingabeaufforderung ein. Sollten die visuellen Elemente für einen langsamen Song zu schnell sein, fügen Sie Tempoangaben wie „langsam“, „sanft“ oder „bedächtig“ in die Eingabeaufforderung ein. Die KI reagiert auf diese rhythmischen Angaben.

Schritt 6: Exportieren Sie die vollständigen Audio- und Videodateien.

Wenn Sie zufrieden sind, exportieren Sie das fertige Musikvideo. Die Ausgabe ist eine einzelne Datei, die sowohl Video- als auch Audiospuren enthält, die bereits synchronisiert sind – wodurch die manuelle Audioausrichtung innerhalb des Editors entfällt.

Hinweise zum Export:

- Format: MP4 (H.264-Video + AAC-Audio) ist der universelle Standard, der auf allen Plattformen akzeptiert wird

- Auflösung: Exportieren Sie mit der höchstmöglichen Auflösung. Für Musikvideos ist 1080p die Mindestanforderung; 2K oder 4K sind vorzuziehen.

- Seitenverhältnis: 16:9 für Bilibili/YouTube und die Standardverteilung von Musikvideos; 9:16 für Douyin, Kuaishou, Xiaohongshu und Instagram Reels; 1:1 für WeChat Moments und Instagram-Feed

- Audioqualität: Stellen Sie sicher, dass die Exporteinstellungen die Audioqualität bewahren. Wenn hochwertige Master-Dateien hochgeladen werden, sollte der Export dieses Qualitätsniveau beibehalten.

Optionale Schritte nach dem Export: Obwohl KI-generierte Musikvideos direkt veröffentlicht werden können, möchten Sie vielleicht mit einem Video-Editor noch letzte Feinheiten hinzufügen: Titelkarten, Liedtext-Untertitel, Künstler-/Label-Logos, Übergänge zwischen den Abschnitten oder Farbkorrekturen. Gängige inländische Tools wie CapCut, DaVinci Resolve oder Premiere eignen sich gut für diesen letzten Schliff. Bevor Sie Ihr Video auf Bilibili veröffentlichen, denken Sie daran, Untertitel und ein Titelbild hinzuzufügen – diese sind für den Empfehlungsalgorithmus von Bilibili von entscheidender Bedeutung.

Erstellen Sie jetzt Ihr erstes KI-Musikvideo -->

8 wichtige Anwendungsszenarien für KI-Musikvideos

Die Erstellung von KI-Musikvideos ist keine Einzwecktechnologie. Die Verschmelzung von visueller Gestaltung mit synchronisiertem Audio eröffnet kreative Möglichkeiten für verschiedene Arten von Inhalten und Branchen. Im Folgenden finden Sie acht konkrete Anwendungsszenarien, jeweils begleitet von gezielten Anwendungshinweisen.

Acht unterschiedliche Anwendungsszenarien für die Erstellung von KI-Musikvideos, jedes mit einzigartigen visuellen Stilen, Audioanforderungen und Zielgruppen. Dieselbe Kerntechnologie passt sich völlig unterschiedlichen kreativen Richtungen an.

- Musikvideo eines unabhängigen Musikers

Chance: Unabhängige Musiker haben seit langem mit einer schmerzhaften Diskrepanz zu kämpfen – der Kluft zwischen musikalischer Qualität und der Qualität visueller Inhalte. Ein Schlafzimmerproduzent kann auf seinem Laptop ausgefeilte, veröffentlichungsreife Tracks produzieren, doch die Produktion eines passenden Musikvideos kostet traditionell zwischen 2.000 und 15.000 Pfund. Selbst die einfachsten Dreharbeiten sind mit hohen Kosten verbunden. Die KI-basierte Musikvideoproduktion hat diese Kostenbarriere vollständig beseitigt.

Einzigartiger Wert in China: Die heimische Independent-Musikszene (Hip-Hop, Elektronik, traditionell chinesisch inspirierte Musik, Folk) hat in den letzten Jahren einen Aufschwung erlebt. Die Zahl der Independent-Künstler auf NetEase Cloud Music und QQ Music wächst weiter, doch die überwiegende Mehrheit ihrer Werke existiert ausschließlich als Audiotitel ohne begleitende Musikvideos. Auf der Musikplattform Bilibili erhalten Beiträge mit hochwertigen Visuals eine deutlich höhere Empfehlungsgewichtung als solche, die nur Audio und statische Cover bieten. KI-Musikvideos ermöglichen es jedem unabhängigen Musiker, visuelle Werke zu schaffen.

Vorgehensweise: Laden Sie den fertigen Track als Audio-Referenz auf Seedance hoch. Komponieren Sie visuelle Hinweise, die den emotionalen Bogen des Songs einfangen – keine Szene-für-Szene-Illustration der Texte, sondern Bilder, die dieselben Gefühle hervorrufen. Psychedelic Pop eignet sich für weiche, ätherische und schwebende Visuals. Lo-Fi-Kompositionen passen gut zu warmen, nostalgischen Stadtszenen. Experimentelle elektronische Musik eignet sich für abstrakte, surreale Bilder. Musik im chinesischen Stil ergänzt Tuschelandschaften, alte Architektur und Szenen mit fallenden Blütenblättern.

Bewährte Verfahren für eigenständige Musikvideos: Wenn ein Song verschiedene Abschnitte enthält, sollten Sie eine segmentierte Produktion in Betracht ziehen. Erstellen Sie einen visuellen Stil für die Strophen, einen anderen für den Refrain und einen dritten für die Bridge. Fügen Sie diese dann mithilfe von Übergängen in einer Bearbeitungssoftware wie ShineVideo oder DaVinci Resolve zusammen. Jeder Abschnitt hat seine eigene visuelle Identität, während die Musik für Kontinuität sorgt.

Realistische Erwartungen: Bis 2026 werden KI-generierte Musikvideos in stilistischen, atmosphärischen und abstrakten visuellen Richtungen herausragende Leistungen erbringen. Bei narrativen oder performancebasierten Musikvideos, die bestimmte Schauspieler erfordern, die choreografierte Aktionen ausführen, oder Dreharbeiten an bestimmten realen Orten, werden sie weniger effektiv sein. Nutzen Sie die Stärken der KI: Atmosphäre, Surrealismus und visuelle Poesie.

- Lyric-Videos

Chancen: Lyric-Videos sind mittlerweile ein gängiges Veröffentlichungsformat – oft werden sie vor oder gleichzeitig mit offiziellen Musikvideos veröffentlicht. Sie steigern die Streaming-Zugriffszahlen, richten sich an Hörer, die sich vor allem für die Texte interessieren, und dienen als erster visueller Kontaktpunkt für neue Titel. Die traditionelle Produktion von Lyric-Videos erfordert Motion-Graphics-Design, Textanimationen und Hintergrundbilder. KI vereinfacht dies auf Eingabeaufforderungen + Textüberlagerungen.

Funktionsweise: Erstellen Sie atmosphärische visuelle Loops, die zur Stimmung des Songs passen. Fügen Sie nach dem Export in剪映, After Effects oder Canva Video Textüberlagerungen mit den Liedtexten hinzu. Die KI kümmert sich um den visuellen Hintergrund, Sie kümmern sich um die Typografie.

Best Practice: Verwenden Sie langsame, sanfte Kamerabewegungen, die nicht mit dem Text um Aufmerksamkeit konkurrieren. Vermeiden Sie visuell überladene Szenen – die Liedtexte müssen vor dem Hintergrund klar lesbar bleiben. Erstellen Sie Bilder mit einem Farbschema, das einen guten Kontrast zur gewählten Textfarbe bildet. Wenn Sie Lyric-Videos auf Bilibili und NetEase Cloud Music veröffentlichen, denken Sie daran, die Uploads mit den entsprechenden Musikplattformen zu synchronisieren, um eine doppelte Präsenz zu erzielen.

- Bilibili/YouTube-Hintergrundmusikvideos

Chancen: „Lo-Fi-Musik zum Lernen“, „Regenrausch zum Einschlafen“, „Meditationsmusik“ – Kanäle auf Bilibili und YouTube erzielen mit einer einfachen Formel enorme Zugriffszahlen: hochwertige Audioaufnahmen gepaart mit einer visuellen Schleife. Einige der größten Musikkanäle auf YouTube basieren vollständig auf diesem Modell. Die Bereiche „Livestreams zum Lernen“ und „Weißes Rauschen“ auf Bilibili sind ebenso beliebt. Dank KI ist es bemerkenswert einfach, Audio- und Videomaterial gleichzeitig zu erstellen.

Methode: Erstellen Sie eine sich wiederholende visuelle Szene – einen gemütlichen Raum, vor dessen Fenster Regen fällt, eine nächtliche Skyline und eine animierte Figur, die an einem Schreibtisch sitzt. Begleiten Sie dies mit erweiterter, KI-generierter Lo-Fi- oder Ambient-Musik. Für die YouTube-Optimierung exportieren Sie das Video im Seitenverhältnis 16:9 mit einer Auflösung von mindestens 1080p und fügen Sie relevante Schlüsselwörter in den Titel, die Beschreibung und die Tags ein. Für Bilibili fügen Sie Tags wie „Lernen”, „Weißes Rauschen” oder „Schlafhilfe” hinzu und wählen Sie die passende Kategorie für die Einreichung aus.

Einnahmemodell: Top-YouTube-Kanäle können allein durch Werbeeinnahmen monatlich zwischen 5.000 und 50.000 US-Dollar (ca. 3.600 bis 36.000 Pfund) verdienen. Die Anreize für Creator bei Bilibili sind zwar vergleichsweise geringer, aber die Monetarisierung ist durch Premium-Mitgliedsbeiträge, Umsatzbeteiligungen bei Konferenzen und Werbeplatzierungen möglich. Der Schlüssel liegt in regelmäßigen Updates: Durch regelmäßige Uploads und den Aufbau einer Inhaltsbibliothek kann der Algorithmus effektiv funktionieren. KI-generierte Inhalte machen es einem einzelnen Creator möglich, einen täglichen Posting-Rhythmus aufrechtzuerhalten.

4. TikTok/Kuaishou/Xiaohongshu Kurzvideos Musikvideos

Chancen: TikTok, Kuaishou, Xiaohongshu, Instagram Reels, TikTok und YouTube Shorts legen alle großen Wert auf Videoinhalte mit Musik. Beiträge mit Audio erzielen durchweg deutlich mehr Interaktion als Beiträge ohne Ton oder reine Textbeiträge. Für Marken und Creator ist die kontinuierliche Produktion kurzer Videoinhalte mit Soundtracks ein unerbittlicher Content-Marathon. KI verkürzt die Produktionszyklen von Stunden auf wenige Minuten.

Funktionsweise: Erstellen Sie ein 5-15 Sekunden langes vertikales Video (9:16) und aktivieren Sie den Soundtrack-Modus. Die KI erzeugt gleichzeitig die Bilder und die passende Musik. Wenn Sie beliebte Musik von der Plattform verwenden möchten, erstellen Sie zunächst die Bilder und fügen Sie dann im nativen TikTok/Kuaishou-Editor trendige Hintergrundmusik hinzu. Wenn Sie Original-Audio wünschen, lassen Sie die KI das gesamte Paket fertigstellen.

Empfehlungen für inländische Kurzvideo-Plattformen:

- Douyin: Die ersten 1–2 Sekunden müssen einen visuellen Aufhänger enthalten. Verwenden Sie Stichworte, die mit einer sofortigen visuellen Wirkung beginnen – dramatische Enthüllungen, kräftige Farben oder unerwartete Bewegungen. Douyin ist standardmäßig auf Ton eingestellt, daher ist die Audioqualität vom ersten Bild an entscheidend.

- Kuaishou: Kelin (entwickelt von Kuaishou) fügt sich nahtlos in das Kuaishou-Ökosystem ein. Wenn Kuaishou Ihre primäre Plattform ist, sollten Sie einen kombinierten Workflow in Betracht ziehen: Erstellen Sie die Bilder in Kelin und fügen Sie den Ton in Seedance hinzu.

- Xiaohongshu: Vertikale Videos im Format 9:16 gepaart mit atmosphärischer Musik erzielen auf Xiaohongshu außergewöhnlich gute Ergebnisse. Künstlerische, therapeutische und ASMR-orientierte KI-Musikvideoinhalte passen außergewöhnlich gut zur Nutzerbasis von Xiaohongshu.

- Podcast-Visualisierung

** Chance: Podcast-Ersteller stehen vor einer Herausforderung hinsichtlich der Verbreitung. Ihre Inhalte bestehen ausschließlich aus Audio, doch die gängigen Plattformen (Bilibili, YouTube, Douyin, Xiaohongshu) geben Videos den Vorrang. Die „Podcast-Visualisierung“ – die dynamische visuelle Darstellung von Audioinhalten – löst dieses Problem, indem sie Audiomaterial eine visuelle Form verleiht, die für Videoplattformen geeignet ist. Die herkömmliche Podcast-Visualisierung erfordert Motion-Graphics-Software und Designkenntnisse. KI generiert diese automatisch.

Funktionsweise: Laden Sie Ihren Podcast-Audioclip auf Seedance hoch. Die KI generiert dynamische Visualisierungen als Reaktion auf den Ton – Veränderungen in Intensität, Rhythmus und Tonhöhe innerhalb der Sprache erzeugen entsprechende visuelle Transformationen. Alternativ können Sie eine visuelle Eingabe komponieren, die das Thema Ihres Podcasts repräsentiert, und die KI generiert einen atmosphärischen visuellen Loop, der den Ton begleitet.

Bilibili-Strategie: Bilibili hat sich zu einer der größten Plattformen für Langform-Videos in China entwickelt, auf der zahlreiche prominente Podcaster nun Videoversionen ihrer Inhalte veröffentlichen. Eine KI-generierte visuelle Begleitung verwandelt reine Audio-Podcasts mit minimalem Aufwand in Bilibili-kompatible Videos. Selbst einfache visuelle Loops schneiden im Empfehlungsalgorithmus von Bilibili deutlich besser ab als statische Miniaturansichten.

- Produktwerbung-Soundtrack

Chance: Produktvideos mit passender Musik erzielen deutlich höhere Konversionsraten als Produktvideos ohne Ton. Die Lizenzierung von Musik für die kommerzielle Nutzung kostet jedoch zwischen 500 und 5.000 RMB pro Titel, während die Beauftragung von Komponisten für maßgeschneiderte Soundtracks sogar noch teurer ist. KI-generierte Soundtracks beseitigen sowohl Kosten als auch urheberrechtliche Komplikationen – die generierte Musik ist originell und kommerziell nutzbar.

Vorgehensweise: Erstellen Sie visuelle Inhalte gemäß dem Produktvideo-Workflow und aktivieren Sie dann den Soundtrack-Modus, um passende Musik hinzuzufügen. Für Premium-Produktpräsentationen erstellen Sie cineastische Orchester- oder Ambient-Musik. Für dynamische Produkteinführungen erstellen Sie energiegeladene elektronische Musik. Die KI passt das Energieniveau der Musik automatisch an die visuellen Inhalte an.

Vorteil beim Urheberrecht: Ein wesentlicher Vorteil der KI-generierten Musik von Seedance besteht darin, dass die Ausgabe originell ist – sie wird nicht aus bestehenden urheberrechtlich geschützten Titeln gesampelt. Dadurch entfällt das Risiko von Urheberrechtsbeschwerden, die mit der Verwendung erkennbarer Musik in Werbungen verbunden sind. Im Rahmen des kostenpflichtigen Tarifs behalten Sie die kommerziellen Nutzungsrechte für die generierte Ausgabe, sodass Sie diese ohne zusätzliche Urheberrechtsgebühren in Werbungen verwenden können. Wenn Sie Produktvideos auf E-Commerce-Plattformen wie Taobao, JD.com und Douyin Shop platzieren, müssen Sie sich keine Sorgen machen, dass Inhalte aufgrund von Urheberrechtsverletzungen in Bezug auf Musik entfernt werden.

- Spiel- und Anwendungstrailer

Chance: Spieletrailer und App-Vorschauvideos sind stark auf die Synchronisation von Bild und Ton angewiesen. Dramatische Pausen vor dem Auftauchen des Endgegners, mehrstufige Countdowns, die Soundeffekte mächtiger Fähigkeiten – diese Momente entstehen an der Schnittstelle zwischen Ton und Bild. Mit KI-generierten Trailern können Indie-Spieleentwickler und App-Entwickler eine Produktionsqualität erreichen, die mit der von AAA-Studios vergleichbar ist.

Funktionsweise: Stellen Sie den Soundtrack-Modus auf „Cinematic“ oder „Drama“, um dramatische, energiegeladene Bildsequenzen zu erzeugen. Verfassen Sie Anweisungen, die die Handlung, die Wirkung und das visuelle Spektakel beschreiben. Laden Sie Screenshots aus dem Spiel oder Konzeptzeichnungen als Referenzbilder hoch, um die visuelle Konsistenz mit dem tatsächlichen Produkt zu gewährleisten. Überlagern Sie UI-Elemente, Gameplay-Aufnahmen und Textanmerkungen während der Postproduktion.

Audio im Fokus: Spieletrailer sind eine der wichtigsten Anwendungen für Audioqualität. Der Soundtrack muss nach und nach Spannung aufbauen, genau im richtigen Moment seinen Höhepunkt erreichen und zufriedenstellend ausklingen. Sollte die ursprüngliche Komposition der KI nicht zum Rhythmus Ihres Trailers passen, generieren Sie sie neu oder verwenden Sie eigenständige KI-Musiktools, um einen maßgeschneiderten Track zu erstellen, und importieren Sie diesen dann als Audio-Referenz. Bei der Veröffentlichung von Spieletrailern auf Plattformen wie TapTap, Bilibili's Gaming-Bereich oder WeGame ist eine hochwertige audiovisuelle Synchronisation von entscheidender Bedeutung, um die Aufmerksamkeit der Nutzer zu gewinnen.

8. Hochzeits- und Event-Highlights

Chance: Persönliche Veranstaltungsvideos – Hochzeiten, Abschlussfeiern, Jubiläen, Geburtstage – sind die emotional bewegendsten Videoinhalte, die Menschen erstellen. Professionelle Veranstaltungsvideos kosten in der Regel zwischen 500 und 3.000 Pfund im Inland. Viele besitzen Hunderte von Fotos von solchen Anlässen, aber keine Videoaufnahmen. KI kann diese Fotos in filmische Highlight-Reels mit stimmungsvoller Musik verwandeln und aus Handy-Schnappschüssen professionelle Ergebnisse erzielen.

Vorgehensweise: Wählen Sie Ihre 10 bis 20 besten Veranstaltungsfotos aus. Nutzen Sie die Bild-zu-Video-Funktionen von Seedance, um jedes Bild mit subtilen Bewegungen zu versehen: sanfte Zooms, leichte Objektivverschiebungen und wechselnde Lichteffekte. Aktivieren Sie den Soundtrack-Modus und beschreiben Sie die gewünschte emotionale Stimmung: „warm, emotional, Akustikgitarre und Klavier, Gefühl des ersten Hochzeitstanzes“. Die KI generiert für jeden Clip ein Video mit passender Musik. Fügen Sie diese mit der Bearbeitungs-App zu einem kompletten Highlight-Reel zusammen.

Warum es so gut funktioniert: Eventfotos haben für die darauf abgebildeten Personen von Natur aus eine große emotionale Bedeutung. Durch das Hinzufügen subtiler Bewegungen werden sie zum Leben erweckt. In Kombination mit passender Musik erreichen sie fast schon Kinoqualität. Diese Kombination verwandelt eine Foto-Diashow in etwas, das sich wie ein echter Film anfühlt – und das praktisch ohne Kosten im Vergleich zur Beauftragung eines Videografen nach der Veranstaltung. Das Teilen solcher Zusammenstellungen auf WeChat Moments oder TikTok erzielt weitaus bessere Ergebnisse als ein einfaches Raster aus neun Fotos.

Vorlage für KI-Musikvideo-Prompt

Die folgenden fünf Prompt-Vorlagen wurden für bestimmte Musikvideo-Stile entwickelt. Jedes Set enthält visuelle Prompts, empfohlene Audio-Stile und Generierungsparameter. Kopieren Sie diese und verwenden Sie sie direkt, wobei Sie sie je nach Bedarf für bestimmte Projekte anpassen können.

Hinweis: Alle Eingabeaufforderungen bleiben im englischen Original, da Seedance englische Eingabeaufforderungen am besten versteht. Jede Vorlage wird von Erläuterungen in chinesischer Sprache begleitet.

Vorlage 1: Filmisches Musikvideo

Visuelles Signal:

A silhouette walking through neon rain on a deserted downtown street

at midnight. Puddles on the asphalt reflect towering LED billboards

in magenta, cyan, and gold. Steam rises from a subway grate, curling

through the neon light. The camera tracks slowly behind the figure,

maintaining a medium-wide shot. Rain streaks catch the colored light

like falling sparks. The figure pauses at a crosswalk, head tilted

upward toward the glowing signs. Cinematic anamorphic lens with

horizontal flares. Blade Runner atmosphere. Moody, contemplative,

visually rich. 4K ultra-realistic.Mitternacht. Eine Silhouette durchquert die verlassenen Straßen der Innenstadt unter einem Neonregen. Pfützen auf dem Asphalt reflektieren riesige LED-Werbetafeln in Magenta, Cyan und Gold. Dampf steigt aus den U-Bahn-Schächten auf und wirbelt im Neonlicht herum. Die Kamera folgt langsam hinter der Figur her. Anamorphotisches Breitbildobjektiv, eine Atmosphäre wie in Blade Runner.

Empfohlener Audio-Stil: Cinematic Synthwave oder Ambient-Elektronikmusik. Dunkle, pulsierende Basslines, unterlegt mit ätherischen Synth-Pads. Langsames Tempo (70–85 BPM). Erzeugt ein Gefühl wie bei Vangelis meets M83.

Parameter: Seitenverhältnis 16:9. Dauer 10 Sekunden. Soundtrack-Modus aktiviert. Maximal verfügbare Auflösung.

Geeignete Szenarien: Atmosphärische Musikvideos für elektronische Musik, Synth-Pop oder Indie-Musik. Auch für filmische Kurzfilme und Imagevideos von Marken geeignet. Besonders gut geeignet für den Musikbereich von Bilibili und Inhalte mit elektronischer Musik.

Vorlage Zwei: Verträumtes Lo-Fi

Visuelles Signal:

Soft pastel clouds drifting over a quiet city at twilight, seen

through the rain-speckled window of a cozy apartment. A desk lamp

casts warm amber light over a cluttered workspace with vinyl records,

a steaming mug, and scattered handwritten notes. Raindrops trace

slow paths down the window glass. The city lights beyond are soft,

blurred circles of warm white and gentle orange. Camera holds a

static medium shot with extremely shallow depth of field focused on

the raindrops. The background city breathes with gentle, slow

ambient motion. Warm, nostalgic, intimate. Film grain. 24fps

cinematic quality.In der Abenddämmerung ziehen sanfte pastellfarbene Wolken über die ruhige Stadt, gesehen durch die regennassen Fenster einer gemütlichen Wohnung. Eine Schreibtischlampe wirft einen warmen bernsteinfarbenen Schein und beleuchtet eine Werkbank, auf der sich Vinylplatten, eine dampfende Tasse und verstreute handschriftliche Notizen stapeln. Regentropfen laufen langsam die Fensterscheibe hinunter. Die Lichter der Stadt erscheinen in der Ferne als weiche, verschwommene Halos in warmem Weiß und blassem Orange. Wärme, Nostalgie, Intimität.*

Empfohlener Audio-Stil: Lo-Fi-Hip-Hop. Vinyl-Knistern, leicht verstimmte Klavierakkorde, sanfte Kick-Snare-Rhythmen, warmer Bass. Tempo: 70–80 BPM. Ästhetik von Chillhop Records.

Parameter: Seitenverhältnis 16:9 oder 1:1. Dauer: 10 Sekunden (für Looping konzipiert). Soundtrack-Modus: Lo-Fi/Ambient. Ideal für Lo-Fi-Livestreams auf Bilibili und YouTube, wenn sie geloopt werden.

Geeignete Szenarien: Lo-Fi-Musikkanäle, Inhalte zum Lernen/Konzentrieren/Einschlafen, entspannende Playlist-Visuals und atmosphärische Beiträge auf Xiaohongshu. Solche Inhalte erfreuen sich großer Beliebtheit in den Kategorien „Study Live” und „White Noise” von Bilibili.

Vorlage 3: Hohe Energie

Visuelles Signal:

Fast-paced montage of urban sports and street culture. A skateboarder

launches off a concrete ledge in slow motion, wheels spinning, body

twisted mid-air. Quick cut to a BMX rider grinding a rail with

sparks flying. Cut to a basketball spinning on a fingertip against

a graffiti-covered wall. Each scene is lit by harsh, directional

afternoon sun creating sharp shadows. Colors are high-contrast and

saturated: electric blue sky, warm concrete orange, vivid graffiti

greens and pinks. Dynamic handheld camera with intentional shake.

Rapid scene transitions. 120fps slow-motion bursts within fast

editing. GoPro meets professional sports broadcast. 4K ultra-sharp.Chinesische Interpretation: Eine rasante Montage aus urbanen Sportarten und Straßenkultur. Zeitlupenaufnahmen von Skateboardern, die sich von Betonstufen abstoßen, ihre Räder drehen und sich in der Luft drehen. Schneller Schnitt zu BMX-Fahrern, die über Geländer grinden und Funken sprühen lassen. Schnitt zu einem Basketball, der vor einer Graffiti-Wand auf den Fingerspitzen dreht. Kontrastreiche, gesättigte Farben. Dynamische Handkameraführung, schnelle Szenenübergänge.

Empfohlener Audio-Stil: Energiegeladener Hip-Hop oder elektronische Musik. Schwere 808-Bässe, Trap-Hi-Hats, aggressive Synth-Stabs. Tempo: 130–150 BPM. Produktionsstil von Travis Scott. Auch heimische Rap-Stile sind sehr gut geeignet.

Parameter: 9:16 (TikTok/Kuaishou/Reels) oder 16:9 (Bilibili/YouTube). Dauer: 5–10 Sekunden. SFX-Modus für Soundeffekte aktivieren. Mit energiegeladener Musik unterlegen.

Geeignete Szenarien: Inhalte von Sportmarken, Werbung für Energy-Drinks, Extremsportkanäle und auffällige/Teaser-artige Social-Media-Inhalte. Funktioniert besonders gut unter den TikTok-Tags „Sport“ und „Trends“.

Vorlage Vier: Liedtext

Visuelles Signal:

A single candle flickering in darkness on a weathered wooden table.

The flame casts warm, dancing golden light across the surface,

illuminating the grain and scratches in the old wood. A person's

hand slowly enters frame from the right, fingers gently hovering

near the flame without touching it. The hand trembles slightly. The

background is pure darkness with the faintest suggestion of a

window. The camera executes an imperceptibly slow push-in toward

the flame. Extreme shallow depth of field. The flame is razor-sharp

while even the fingertips soften into bokeh. Warm amber and deep

shadow color palette. Intimate, vulnerable, deeply human. 4K

photorealistic. 24fps film cadence.Englische Beschreibung: Eine einzelne Kerze flackert in der Dunkelheit auf einem verwitterten Holztisch. Die Flamme wirft einen warmen, tanzenden goldenen Schein über die Tischplatte und beleuchtet die Maserung und Kratzer des alten Holzes. Eine Hand kommt langsam von rechts ins Bild, die Finger schweben sanft neben der Flamme, ohne sie zu berühren. Die Hand zittert ganz leicht. Extrem geringe Schärfentiefe. Die Flamme ist scharf abgebildet, während die Fingerspitzen verschwommen sind. Eine Palette warmer Bernsteintöne und tiefer Schatten. Intimität, Zerbrechlichkeit, tiefe Menschlichkeit.

Empfohlener Audio-Stil: Klavierballaden oder Akustikgitarre mit dezenter Streicherbegleitung. Moll-Tonarten. Extrem langsames Tempo (55–65 BPM). Produktion im Stil von Adele oder Bon Iver. Sparsame Arrangements, bei denen Raum und Stille selbst zu musikalischen Elementen werden. Auch von chinesischer Volksmusik inspirierte Stile wären perfekt geeignet.

Parameter: Seitenverhältnis 16:9. Dauer: 10 Sekunden. Soundtrack-Modus: Emotional/Original. Maximal verfügbare Auflösung. Diese Vorlage ist eher auf emotionale Wirkung als auf visuelle Effekte ausgelegt.

Geeignete Szenarien: Balladen-Musikvideos, Gedenk-/Tributfilme, dramatische Filmszenen, emotionale Markengeschichten und Visuals für Unplugged-Serien. Innerhalb der Kategorien Folk/Liebeslieder auf NetEase Cloud Music und QQ Music entspricht diese visuelle Ästhetik perfekt den Erwartungen der Hörer.

Vorlage 5: Vintage/Nostalgisch

Visuelles Signal:

VHS-style footage of a summer road trip along a coastal highway.

A vintage convertible with sun-faded red paint cruises along a

winding cliffside road above a sparkling ocean. The driver's arm

hangs out the window, hand surfing the wind. Palm trees line the

inland side of the road. The footage has authentic VHS artifacts:

horizontal tracking lines, slight color bleeding at edges, warm

oversaturated hues shifted toward orange and teal, subtle scan-line

texture, and occasional tracking glitches. Shot from a following car

at the same speed, steady tracking shot. Late afternoon golden light.

The ocean glitters intensely in the background. Nostalgic, carefree,

endless summer. 480p upscaled aesthetic, 4:3 aspect ratio within a

16:9 frame with black side bars.VHS-ähnliches Filmmaterial einer Sommerreise entlang der Küste. Ein Oldtimer-Cabrio mit verblasster roter Lackierung fährt eine Straße entlang einer Klippe entlang, unter ihm glitzert das Meer. Der Arm des Fahrers streckt sich aus dem Fenster, seine Hand surft im Wind. Das Filmmaterial weist authentische VHS-Artefakte auf: horizontale Bildstreifen, subtile Farbverläufe an den Rändern und übersättigte warme Töne, die ins Orange und Cyan übergehen. Nostalgisch, unbeschwert, ewiger Sommer.

Empfohlener Audio-Stil: Indie-Surf-Rock oder Dream Pop. Hallige Gitarren, hüpfende Basslinien, helle Tamburine. Tempo: 110–120 BPM. Stellen Sie sich eine Mischung aus den Beach Boys und Tame Impala vor. Alternativ auch eine eher elektronische Richtung mit Vaporwave/Retro-Synthesizern. Chinesischer Retro-Pop (wie City Pop) wäre ebenfalls perfekt geeignet.

Parameter: Seitenverhältnis 16:9 (unter Einbeziehung der 4:3-VHS-Ästhetik). Dauer: 10 Sekunden. Soundtrack-Modus: Retro/Indie. Diese Vorlage setzt bewusst auf eine Lo-Fi-Optik – generieren Sie nicht mit maximaler Auflösung und wenden Sie dann VHS-Effekte an, sondern lassen Sie die KI den Vintage-Look nativ erstellen.

Geeignete Szenarien: Nostalgische/Retro-Musikvideos, Visuals für Sommer-Playlists, Vintage-inspirierte Markeninhalte, Coming-of-Age-Filmsequenzen und Inhalte im Retro-Stil auf Xiaohongshu. Die Vintage-Ästhetik erfreut sich bei jungen Kreativen in China nach wie vor großer Beliebtheit, sodass auf Xiaohongshu und Bilibili eine beträchtliche Menge an Inhalten mit den Tags „filmähnlich” und „Retro” zu finden ist.

Vergleich der besten Tools zur Erstellung von KI-Musikvideos

Nicht alle KI-Videogeneratoren verfügen über Audiofunktionen, und bei denen, die dies tun, variieren die Funktionen erheblich. Nachfolgend finden Sie einen direkten Vergleich aller Tools, die für die Produktion von Musikvideos relevant sind (Stand: Februar 2026).

Die audiovisuelle Funktionslandschaft im Jahr 2026. Seedance 2.0 führt in puncto funktionaler Vollständigkeit, während jeder Mitbewerber über eindeutige Vorteile verfügt. Die richtige Wahl hängt von Ihrem zentralen Anwendungsszenario ab.

Vergleichstabelle

| Tool | Soundgenerierung | Soundtrack | Lippensynchronisation | Höchste Videoqualität | Am besten geeignet für | Startpreis | In China erhältlich | |------|:---:|:---:|:---:|---|-- -|---|:---:| | Seedance 2.0 | Unterstützt | Unterstützt | Unterstützt (8 Sprachen) | 2K, max. 2 Minuten | Vollständige MV-Produktion | Kostenlose Version verfügbar | Direkt verwendbar | | Google Veo 3 | Unterstützt | Teilweise | Nicht unterstützt | 1080p | Umgebungsgeräusche | Über Google-KI-Tools | VPN erforderlich | | Pika 2.0 | Basic | Nicht unterstützt | Nicht unterstützt | 1080p | Einfache Hinzufügung von Soundeffekten | Kostenlose Version verfügbar | VPN erforderlich | | Kaiber | Nicht unterstützt | Nicht unterstützt (bei Verwendung von hochgeladenem Audio) | Nicht unterstützt | 1080p | Musikvisualisierung für hochgeladene Titel | Ca. 10 $/Monat (ca. 72 £) | VPN erforderlich | | Suno + Seedance | Über Seedance | Über Suno | Über Seedance | 2K (Seedance) | Beste Kombination aus KI-Musik und KI-Video | Suno kostenlos + Seedance kostenlos | Seedance direkt verfügbar | | SkyMusic + Seedance | Über Seedance | Über SkyMusic | Über Seedance | 2K (Seedance) | Chinas führende vollständig chinesische KI-Musik + KI-Video-Kombination | SkyMusic kostenlos + Seedance kostenlos | Vollständig innerhalb Chinas zugänglich |

Seedance 2.0: Die umfassendste audiovisuelle Lösung

Seedance ist die einzige Plattform, die alle drei Arten der audiovisuellen Generierung – Soundeffekte, Hintergrundmusik und Lippensynchronisation – in einem einzigen Tool unterstützt. Für Musikvideo-Ersteller bedeutet dies, dass Sie atmosphärische Visuals mit Umgebungsgeräuschen generieren, passende Musikbegleitung hinzufügen und Gesangsdarbietungen mit den Lippen der Charaktere synchronisieren können, ohne die Plattform verlassen zu müssen.

Wichtige Funktionen der MV-Produktion:

- Drei Audiomodi (Soundeffekte, Musik, Sprache) wählbar bei der Erstellung

- 8 Sprachen mit Lippensynchronisation (einschließlich Chinesisch), unterstützt die Verbreitung mehrsprachiger Musikvideos

- Audio-Referenzeingabe: Laden Sie Ihren Track hoch, um mit der Musik synchronisierte Visualisierungen zu erstellen

- Mehrere Seitenverhältnisse, darunter 9:16 für kurze Musikvideoinhalte

- Maximale Generierungsdauer von 2 Minuten, die ganze Songabschnitte abdeckt

- Bild-zu-Video-Konvertierung: Animieren Sie Albumcover oder statische Konzepte

Exklusive Vorteile für Nutzer im Inland: – Entwickelt von ByteDance, direkt in China ohne VPN zugänglich – Unterstützt Alipay/WeChat Pay, keine Hindernisse für kostenpflichtige Upgrades – Chinesische Lippensynchronisation ist entscheidend für die Erstellung von Musikvideos im Inland – Vollständige Funktionalität auch in der kostenlosen Version verfügbar

Positionierung: Seedance ist die ultimative integrierte Lösung für Kreative, die ihre gesamte Musikvideo-Produktionspipeline mit einem einzigen Tool abwickeln möchten. Die Kombination aus hochwertigen visuellen Effekten und umfassenden Audiofunktionen ist nach wie vor unübertroffen.

Erstellen Sie jetzt Ihr Musikvideo mit Seedance 2.0 -->

Google Veo 3: Leistungsstarkes natives Audio

Veo 3 generiert Videos mit nativem Audio, das Umgebungsgeräusche, atmosphärische Geräusche und eine gewisse musikalische Untermalung enthält. Die Audioqualität ist beeindruckend – die Trainingsdaten und die Modellgröße von Google erzeugen reichhaltige, vielschichtige Klanglandschaften. Strandaufnahmen klingen wirklich wie Strände, mit Wellen in der richtigen Entfernung, Wind in der richtigen Intensität und Seevogelrufen in plausiblen Abständen.

Vorteil: Umweltgetreue Klangwiedergabe. Veo 3 liefert die authentischsten Klanglandschaften seiner Klasse.

Einschränkungen bei der MV-Produktion: Veo 3 verfügt nicht über die detaillierten Audioeinstellungen, die Seedance bietet. Sie können nicht zwischen Soundeffekten, Musik und Sprachmodi wählen, es gibt keine Lippensynchronisation und Sie können keine eigenen Audiospuren als Referenz hochladen. Bei der MV-Produktion beschränkt diese mangelnde Flexibilität bei der Eingabe Veo 3 auf atmosphärische/Umgebungsvideos mit Begleitaudio, anstatt strukturierte Musikvideos zu erstellen. Darüber hinaus ist für den Zugriff aus dem Inland ein VPN erforderlich, was eine höhere Einstiegshürde darstellt. Eine detaillierte Vergleichsübersicht der Funktionen finden Sie unter Seedance vs. Veo 3 – Ausführlicher Vergleich.

Pika 2.0: Grundlegende Soundeffekte

Die Soundeffekt-Funktion von Pika fügt den erstellten Videos Umgebungsgeräusche hinzu. Dies ist eine nützliche Ergänzung zu dem bisher rein visuellen Tool, auch wenn seine Möglichkeiten im Vergleich zu Seedance und Veo 3 begrenzt bleiben. Die SFX-Generierung umfasst grundlegende Umgebungsgeräusche – Schritte, Wassergeräusche, Windgeräusche, einfache Schläge –, aber es fehlen Musikgenerierung und Lippensynchronisation.

Vorteile: Fügt kurzen Clips einfache Soundeffekte hinzu. Wenn Sie eine fünfsekündige Regenszene mit passenden Regengeräuschen benötigen, ist Pika genau das Richtige für Sie.

Einschränkungen: Keine Musikgenerierung, keine Lippensynchronisation und keine Unterstützung für das Hochladen von Audio-Referenzen. Für die Produktion von Musikvideos reicht Pika allein nicht aus – es muss mit externen Audio-Tools kombiniert werden, um den vollen Effekt zu erzielen. Erfordert ein VPN.

Kaiber: Spezialist für Musikvisualisierung

Kaiber verfolgt einen anderen Ansatz als die anderen Tools in dieser Liste. Anstatt Audio aus Video zu generieren, erstellt es Video aus Audio. Sie laden einen Musiktitel hoch, und Kaiber generiert abstrakte, stilisierte visuelle Animationen, die auf den musikalischen Inhalt reagieren – Bilder, die im Takt pulsieren, Farben, die sich mit harmonischen Veränderungen verschieben, und Intensität, die der Lautstärke zugeordnet ist.

Vorteile: Abstrakte Musikvisualisierung. Wenn Sie psychedelische, abstrakte, auf den Beat reagierende Visualisierungen für einen elektronischen Musiktitel erstellen möchten, ist Kaiber genau das Richtige für Sie.

Einschränkungen: Kaiber generiert keine Audiodaten – es müssen Audiodateien hochgeladen werden. Die Videoausgabe ist eher stilisiert (abstrakt/künstlerisch) als fotorealistisch. Es können keine narrativen Szenen, Charaktere oder realistischen Umgebungen erstellt werden. Für die vollständige Produktion von Musikvideos, die authentische Bilder erfordern, ist Kaiber eher ein Nischenwerkzeug als eine Komplettlösung. Erfordert ein VPN.

Suno / SkyMusic + Seedance Zusammenarbeit: Die Essenz zweier Welten

Für Kreative, die maximale Kontrolle über die musikalischen und visuellen Aspekte ihrer Arbeit suchen, besteht der leistungsstärkste Workflow darin, einen professionellen KI-Musikgenerator mit einem professionellen KI-Videogenerator zu kombinieren.

International Edition Line-up – Suno + Seedance:

- Erstellen Sie Ihren Track in Suno: Beschreiben Sie das Genre, die Stimmung, das Tempo und das Arrangement. Suno produziert vollständige, hochwertige Musiktitel, bei Bedarf auch mit Gesang.

- Laden Sie den Track als Audio-Referenz auf Seedance hoch: Der KI-Videogenerator erstellt Visualisierungen, die auf die Struktur der Musik reagieren – Szenen intensivieren sich während musikalischer Crescendi und klingen während ruhigeren Passagen ab.

- Verwenden Sie bei Bedarf die Lippensynchronisation: Sollte der Suno-Track Gesang enthalten und Sie möchten, dass die Charaktere singen, verwenden Sie den Lippensynchronisationsmodus von Seedance, um die Mundbewegungen an den Gesangstrack anzupassen.

Inlandsausgabe-Bundle – SkyMusic + Seedance:

Diese Kombination bietet chinesischen Kreativen den nahtlosesten End-to-End-Workflow für KI-Musikvideos – beide Plattformen sind direkt in China zugänglich und erfordern kein VPN.

- Erstellen Sie Ihren Track mit SkyMusic: SkyMusic zeichnet sich besonders bei der Erstellung chinesischer Songtexte aus und unterstützt verschiedene chinesische Musikgenres, darunter Rap, Pop und klassische Musik.

- Laden Sie Ihren Track als Audio-Referenz auf Seedance hoch: Seedance generiert passende Visuals basierend auf dem musikalischen Inhalt.

- Chinesische Lippensynchronisation: Nutzen Sie die chinesische Lippensynchronisationsfunktion von Seedance, damit die Charaktere Ihre chinesischen Texte präzise wiedergeben.

Der Vorteil dieses Workflows besteht darin, dass Sie die musikalische Qualität professioneller Musik-KI in Kombination mit den visuellen und Synchronisationsfunktionen professioneller Video-KI erhalten. Der Nachteil ist, dass Sie statt einer Ein-Tool-Lösung einen Zwei-Tool-Workflow verwenden müssen. Für Kreative, die professionelle Ergebnisse erzielen möchten, lohnt sich dieser zusätzliche Schritt jedoch auf jeden Fall.

Fortgeschritten: Techniken zur Erzielung von Lippensynchronisation

Sobald Sie den grundlegenden Arbeitsablauf beherrschen, helfen Ihnen die folgenden fortgeschrittenen Techniken dabei, ein Maß an audiovisueller Koordination in Ihren Musikvideos zu erreichen, das den Unterschied zwischen professionellen und amateurhaften Arbeiten ausmacht.

Bei der erweiterten Synchronisation geht es nicht nur darum, Audio und Video zusammen zu erzeugen. Es geht darum, den visuellen Rhythmus, die Stimmung und die Struktur bewusst auf die musikalische Komposition abzustimmen, um ein einheitliches audiovisuelles Erlebnis zu erzielen.

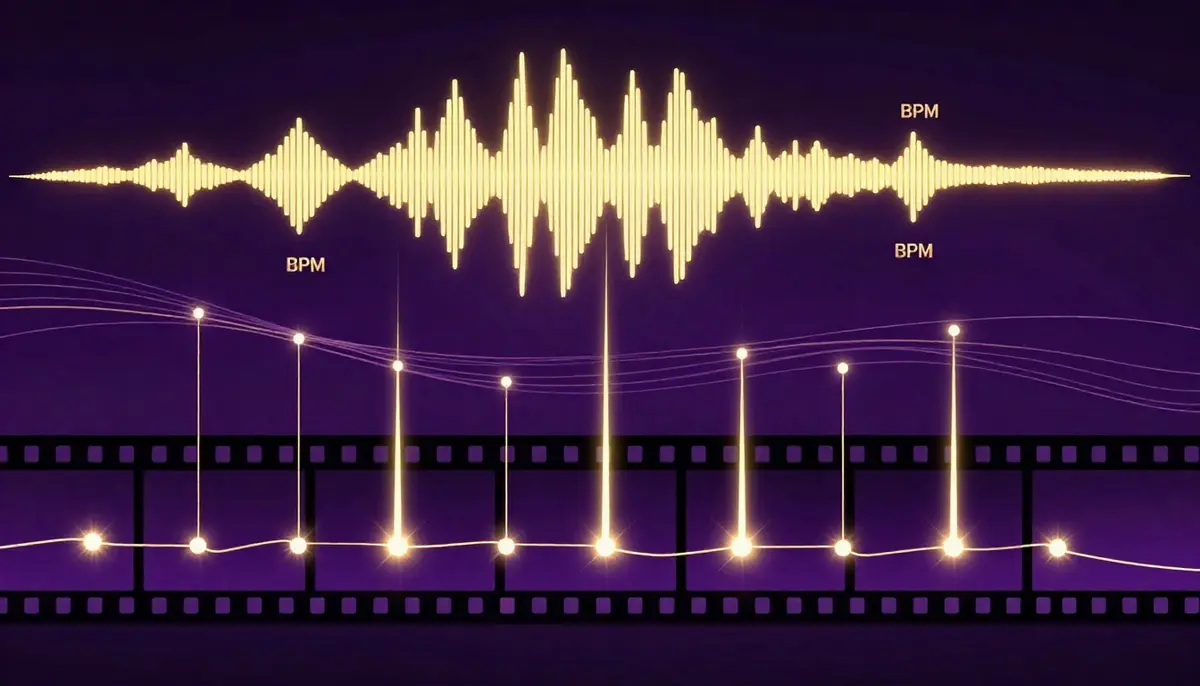

BPM-Anpassung: Angleichung des visuellen Rhythmus an das musikalische Tempo

BPM (Beats per Minute) ist der Herzschlag jedes Musikstücks. Wenn Ihre visuellen Inhalte synchron zum Rhythmus der Musik laufen, wirkt der Effekt bewusst und professionell. Wenn beide nicht aufeinander abgestimmt sind, wirkt es, als würden zwei unabhängige Dinge gleichzeitig abgespielt.

So erreichen Sie eine BPM-Anpassung:

- Bestimmen Sie die BPM Ihres Tracks: Die meisten DAWs (Ableton, Logic, FL Studio) zeigen die BPM automatisch an. Online-Tools zur BPM-Erkennung sind ebenso effektiv. Gängige Bereiche: Lo-Fi (70–85 BPM), Pop (100–130 BPM), EDM (120–150 BPM), Drum and Bass (160–180 BPM).

- Übersetzen Sie die BPM in visuelle Bewegungsgeschwindigkeit: Bei 120 BPM gibt es genau zwei Schläge pro Sekunde. Kamerabewegungen, Szenenübergänge und visuelle Schnitte, die alle halbe Sekunde auftreten, wirken wie an den Beat gebunden.

- Verwenden Sie rhythmische Stichworte: Verwenden Sie für Tracks mit 130 BPM Begriffe wie „schnell“, „energetisch“ und „dynamische Übergänge“. Für Tracks mit 70 BPM wählen Sie „langsam“, „fließend“ und „sanft“. Die KI interpretiert diese rhythmischen Stichworte und passt das visuelle Tempo entsprechend an.

- Feinabstimmung in der Postproduktion: Wenn der visuelle Rhythmus der KI dem Beat nahe kommt, aber nicht perfekt mit ihm synchron ist, nehmen Sie Anpassungen in Ihrem Video-Editor vor. Beschleunigen oder verlangsamen Sie Segmente um 5–10 %, um visuelle Ereignisse an Beat-Marker anzupassen. Diese Feinabstimmung macht einen sichtbaren Unterschied. Sowohl ShineVideo als auch DaVinci Resolve unterstützen solche präzisen Geschwindigkeitsanpassungen.

Emotionale Synchronisation: Musikalische Passagen, die visuellen Stimmungen zugeordnet sind

Professionelle Musikvideos haben nicht durchgehend eine einheitliche visuelle Ästhetik. Sie wechseln die Stimmung, um sich dem emotionalen Verlauf des Songs anzupassen. Mit KI-Generierung kannst du diese Übergänge erstellen, indem du mithilfe verschiedener visueller Eingaben unterschiedliche Segmente generierst.

Die Übertragung von musikalischer Struktur auf visuelle Atmosphäre:

| Song-Abschnitt | Musikalische Merkmale | Visuelle Gestaltung | |-------- -|---------|---------| | Intro | Spärlich, allmählich | Minimalistische Bilder, gedämpfte Töne, Zeitlupe. Schafft Atmosphäre. | | Strophe | Narrativ, mittlere Energie | Story-getriebene Szenen, moderates Tempo, warme oder neutrale Farbpalette | | Pre-Chorus | Mehrschichtige Progression | Intensivierte Kamerabewegungen, erhöhte Farbsättigung, gesteigerte visuelle Komplexität | | Refrain | Höhepunkt der Energie/Emotion | Dramatischste Bilder, kräftigste Farben, dynamische Aufnahmen, visuelles Spektakel in vollem Umfang | | Bridge | Übergang/Reflexion | Völlig anderer visueller Stil. Neue Farbpalette. Langsamere Bewegung. | | Coda | Konvergenz, Ausblenden | Rückkehr zum visuellen Stil des Intros mit einem Gefühl der Auflösung. Weicher. Ausblenden. |

Erstellen Sie für jeden Absatz in separaten Segmenten individuelle Eingabeaufforderungen, bearbeiten Sie diese und fügen Sie sie anschließend zusammen. Dieser segmentierte Ansatz führt zu einem dynamischeren Ergebnis, das besser zur Musik passt als die Erstellung eines einzigen langen Fragments.

Segmentbasierte Generierung: Erstellen Sie unterschiedliche Visualisierungen für Refrain, Strophe und Bridge.

Aufbauend auf dem Konzept der emotionalen Synchronisation umfasst die praktische Technik der segmentierten Generierung die Erstellung unabhängiger KI-Videosegmente für jede Musikpassage, die anschließend im Timeline-Editor zusammengesetzt werden.

Arbeitsablauf:

- Analysieren Sie die Songstruktur. Markieren Sie die Zeitstempel für jeden Abschnitt (Strophe 1: 0:00-0:30, Refrain 1: 0:30-0:55, Strophe 2: 0:55-1:25 usw.)

- Schreiben Sie für jeden Abschnitt einzigartige visuelle Hinweise. Sorgen Sie für visuelle Kontinuität durch einheitliche stilistische Beschreibungen (identische Farbschemata, gemeinsame visuelle Qualitätsmerkmale), während Sie Szenen, Aufnahmen und Energieniveaus variieren

- Erstellen Sie separate Clips für jeden Abschnitt innerhalb von Seedance. Passen Sie die Clip-Dauer an die Zeitangaben der Abschnitte an

- Importieren Sie alle Clips in einen Video-Editor (ShineVideo, DaVinci Resolve, Premiere). Richten Sie jeden Clip auf den entsprechenden Musikabschnitt aus.

- Fügen Sie Übergänge zwischen den Abschnitten hinzu: Überblendungen für sanfte Übergänge, harte Schnitte für dramatische Wechsel und schnelle Schwenks für energiegeladene Übergänge.

- Exportieren Sie die zusammengesetzte Zeitleiste als Ihr endgültiges Musikvideo.

Diese Methode bietet Ihnen die größte Kontrolle über das Verhältnis zwischen Ton und Bild. Sie ist zwar mit einem höheren Arbeitsaufwand verbunden als die Single-Pass-Generierung, das Ergebnis ist jedoch deutlich dynamischer und besser auf die Musik abgestimmt.

Referenzvideo: Verwendung bestehender Musikvideostile als Input

Wenn es ein bestehendes Musikvideo gibt, dessen visueller Stil, Kamerabewegungen oder Schnittrhythmus Ihnen gefallen, können Sie es als Referenz verwenden, um die KI bei der Erstellung anzuleiten.

Verwendung der Referenz-MV:

- Wählen Sie ein Musikvideo oder einen Videoclip aus, der Ihren gewünschten visuellen Stil verkörpert.

- Laden Sie es als Referenzvideo in Seedance hoch.

- Die KI analysiert die Kamerabewegungen, die Komposition, die Farbschemata, den Schnittrhythmus und die Bewegungsdynamik der Referenz.

- Ihr generiertes Ergebnis übernimmt diese Stilelemente und schafft gleichzeitig völlig originelle Inhalte.

Diese Technik erweist sich als besonders nützlich, wenn Kunden oder Mitarbeiter sagen: „Ich möchte das Gefühl dieses Videos“ – Sie können ihre Referenz direkt als Input verwenden, anstatt zu versuchen, ihre Vision in Prompt-Sprache zu übersetzen.

Wichtiger Hinweis: Die KI generiert originelle visuelle Inhalte, die vom Referenzstil inspiriert sind. Sie kopiert oder reproduziert das Referenzvideo nicht. Das Ergebnis ist ein einzigartiger Inhalt, der stilistische Elemente mit der Referenz teilt.

Häufig gestellte Fragen

Kann KI wirklich ein komplettes Musikvideo erstellen?

Sicherlich, aber man muss die Bedeutung von „vollständig“ im Jahr 2026 verstehen. KI kann Videoclips mit synchronisiertem Ton – einschließlich Soundeffekten, Hintergrundmusik und lippensynchronen Gesangspassagen – generieren, die professionell aussehen und klingen. Für atmosphärische, stilisierte oder abstrakte Musikvideos mit einer Länge von 30 Sekunden bis 2 Minuten können KI-generierte Ergebnisse tatsächlich direkt veröffentlicht werden. Bei längeren, narrativen Musikvideos, die bestimmte Schauspieler und komplexe Choreografien erfordern, eignet sich KI hervorragend für die Produktion von hochwertigem Rohmaterial, profitiert jedoch erheblich von menschlicher Bearbeitung, Sequenzierung und Postproduktion. Diese Technologie lässt sich am besten als Produktionswerkzeug verstehen, das 80 bis 90 % der Arbeitslast übernimmt, und nicht als Ersatz für ein gesamtes Produktionsteam mit einem einzigen Klick.

Welcher ist der beste KI-Musikvideogenerator für 2026?

Seedance 2.0 ist der umfassendste KI-Musikvideogenerator für 2026. Er vereint auf einzigartige Weise alle drei audiovisuellen Kernfunktionen in einem einzigen Tool: Soundeffektgenerierung, KI-Soundtrack-Erstellung und mehrsprachige Lippensynchronisation (in acht Sprachen, darunter Chinesisch). — gepaart mit hochwertiger Bildgenerierung (bis zu 2K-Auflösung, 2 Minuten Dauer). Chinesische Nutzer profitieren zusätzlich: Als Produkt von ByteDance ist Seedance direkt in China zugänglich und unterstützt Alipay und WeChat Pay. Google Veo 3 zeichnet sich durch Umgebungsgeräusche aus, bietet jedoch keine Lippensynchronisation und erfordert ein VPN. Pika bietet nur grundlegende Soundeffekte. Kaiber ist auf die Visualisierung abstrakter Musik spezialisiert.

Muss man eigene Musik haben, um KI-Musikvideos zu erstellen?

Nicht notwendig. Sie haben drei Möglichkeiten. Erstens können Sie die integrierte Soundtrack-Generierung von Seedance nutzen, damit die KI gleichzeitig Bilder und Musik erstellt. Zweitens können Sie kostenlose KI-Musikgeneratoren (wie Suno international oder inländische Alternativen wie SkyMusic und NetEase Tianyin) verwenden, um Originalkompositionen zu erstellen, und diese dann als Audio-Referenzen in Seedance importieren. Drittens können Sie Ihre eigenen Original- oder lizenzierten Musiktitel hochladen. Alle drei Ansätze liefern vollständige audiovisuelle Ergebnisse. Ihre Wahl hängt davon ab, wie viel Kontrolle Sie über die musikalischen Effekte haben möchten.

Wie wird KI-Lippensynchronisation in Musikvideos eingesetzt?

Die KI-Lippensynchronisationsanalyse untersucht den Audioinhalt von Gesangsspuren – indem sie identifiziert, welche Phoneme zu bestimmten Zeitpunkten auftreten – und generiert entsprechende Mundformen, Kieferpositionen und Mikroausdrücke im Gesicht der Videofiguren. Beim Singen bedeutet dies, dass sich der Mund der Figur bei hohen Tönen und Vokalen weiter öffnet, bei Konsonanten schmaler wird und zeitlich mit dem Gesangsrhythmus übereinstimmt. Seedance unterstützt die Lippensynchronisation in acht Sprachen (einschließlich Chinesisch) und passt sein Mundvokabular an das phonetische System jeder Sprache an. Die chinesische Lippensynchronisation ermöglicht es KI-Charakteren, chinesische Texte präzise wiederzugeben, was ein immenses kreatives Potenzial für die Cover-Song- und Anime-Communities von Bilibili eröffnet. Optimale Ergebnisse werden mit klaren Gesangsspuren mit moderatem Tempo und minimaler instrumentaler Interferenz erzielt.

Kann KI-generierte Musik kommerziell genutzt werden?

Auf der Seedance-Plattform ja. Die innerhalb von Seedance generierte Musik ist ein origineller, von KI erstellter Inhalt – sie ist weder gesampelt noch von urheberrechtlich geschützten Titeln abgeleitet. Im Rahmen des kostenpflichtigen Abonnements behalten Sie die kommerziellen Nutzungsrechte für die generierten Inhalte, einschließlich der Audiokomponente. Das bedeutet, dass Sie KI-generierte Musikvideos auf Bilibili/YouTube monetarisieren, in kommerziellen Werbespots verwenden und auf verschiedenen Plattformen verbreiten können, ohne sich um Urheberrechtsverletzungen sorgen zu müssen.

Wichtige Überlegungen zum rechtlichen Rahmen in China: Gemäß den vorläufigen Maßnahmen Chinas zur Verwaltung generativer KI-Dienste muss bei der Nutzung von KI-generierten Inhalten für kommerzielle Aktivitäten unbedingt sichergestellt werden, dass diese Inhalte nicht die geistigen Eigentumsrechte anderer verletzen. Darüber hinaus kann es in bestimmten Fällen erforderlich sein, Inhalte als KI-generiert zu kennzeichnen. Es ist ratsam, sich vor einer groß angelegten kommerziellen Nutzung mit den aktuellen politischen Anforderungen vertraut zu machen. Überprüfen Sie immer die spezifischen Nutzungsbedingungen der von Ihnen verwendeten Tools, da die Lizenzbestimmungen je nach Plattform variieren.

Wie lang können KI-Musikvideos sein?

Seedance unterstützt die Erstellung von Clips mit einer Länge von bis zu 2 Minuten. Für längere Musikvideos empfehlen wir einen segmentierten Ansatz: Erstellen Sie separate Clips für verschiedene Abschnitte des Songs (Strophen, Refrains, Brücken) und fügen Sie diese anschließend in einem Video-Editor zusammen. Ein 3-4-minütiger Song erfordert in der Regel 3-6 unabhängig voneinander erstellte Segmente. Dieser segmentierte Ansatz liefert tatsächlich bessere Ergebnisse als eine einzige erweiterte Erstellung, da jedes Segment seine eigene optimierte visuelle Eingabeaufforderung erhält.

Wie ist die Audioqualität in KI-generierten Musikvideos?