Oversikt

AI-videogenereringsteknologi krysser den viktigste terskelen siden oppstarten: audiovisuell synkronisering. Innen 2026 vil de beste AI-videogeneratorene ikke lenger produsere lydløse klipp som krever manuell dubbing. De vil produsere lydeffekter som samsvarer med handlingene på skjermen, bakgrunnsmusikk synkronisert med visuelle stemninger og leppesynkronisert tale som støtter flere språk – alt i en enkelt genereringsprosess. Denne guiden dekker: De tre hovedtypene av AI-audiovisual generering (lydeffekter, musikkkomponering, leppesynkronisering); En komplett seks-trinns arbeidsflyt for å lage AI-musikkvideoer fra bunnen av; Åtte virkelige bruksscenarier, fra indieartisters musikkvideoer til podcast-visualisering; Fem bruksklare maler; En omfattende sammenligning av alle lydkompatible verktøy; Pluss avanserte teknikker som BPM-tilpasning og emosjonell synkronisering. Hvis videoinnholdet ditt krever lyd – noe som omfatter praktisk talt all videoproduksjon – representerer dette den viktigste utviklingen innen AI-video siden tekst-til-video-generering. Begynn å lage AI-musikkvideoer nå -->

Overgangen fra lydløse AI-videoer til perfekt leppesynkronisering representerer det største kvalitetsspranget i historien til AI-generert innhold. Oppgaver som tidligere krevde flere ukers arbeid av Hollywoods etterproduksjonsteam, kan nå utføres innenfor en enkelt generativ prosess.

Lydrevolusjonen i AI-video

I lang tid var AI-genererte videoer et fundamentalt ufullstendig medium. Bildekvaliteten forbedret seg i et bemerkelsesverdig tempo – fra uskarpe sekunders lange klipp tidlig i 2024 til minuttlange sekvenser med fotografisk realisme mot slutten av 2025. Men alle disse videoene hadde én begrensning: de var lydløse.

Den stille æra: 2024 til tidlig 2025

Den første generasjonen av AI-videoverktøy – Runway Gen-2, Pika 1.0 og tidlige versjoner av Keeling – kunne bare generere videomateriale. Det var ingen lydspor, ingen lydeffekter, ingen musikk. Resultatet var en rent visuell MP4-fil som krevde manuell dubbing, miksing og synkronisering i en separat redigeringsprosess. Dette var ikke en mindre ulempe, men et grunnleggende gap mellom AI-ens produksjonskapasitet og publikums forventninger.

Menneskets oppfatning av video er dypt multimodal. Nevrovitenskapelig forskning viser konsekvent at lyd bidrar med 50 % eller mer av den emosjonelle effekten i enhver videoopplevelse. Et kinematisk landskapsbilde, uansett hvor fotorealistisk det er, vil føles flatt og kunstig uten lyden av vind, fuglesang eller en svulmende lydspor. En karakter som snakker uten lyd – med lepper som beveger seg lydløst – faller rett inn i den uhyggelige dalen. Den «stille æraen» av AI-video betyr at hvert generert klipp krever omfattende etterproduksjonsarbeid for å fremstå som komplett.

For profesjonelle skapere innebærer dette at de må opprettholde to separate arbeidsflyter for visuell generering og lydproduksjon, noe som dobler både tids- og kompetansekravene. For vanlige skapere betyr det at AI-genererte videoer alltid føles uferdige – imponerende som tekniske demonstrasjoner, men ubrukelige som endelig innhold.

2025–2026: Fusjonen av lyd og bilde

Gjennombrudd kommer i etapper. Googles Veo 3 har kunngjort innebygde lydgenereringsfunksjoner, som viser at en enkelt modell kan produsere synkronisert video og lyd samtidig. Dette er ikke lyd som legges over videoen under etterproduksjonen – lyden genereres snarere som en integrert del av videoutgangen, med omgivelseslyder som passer nøyaktig til handlingen på skjermen.

Omtrent samtidig lanserte Seedance 2.0 (utviklet av ByteDances Seed-team) en omfattende lydpakke med tre forskjellige funksjoner: AI-lydeffektgenerering (SFX) synkronisert med videoinnhold, AI-lydsporgenerering tilpasset visuelle stemninger og AI-leppesynkroniseringsteknologi som tilpasser tale til karakterenes munnbevegelser (støtter åtte språk, inkludert kinesisk). Pika introduserte sin lydeffektfunksjon for grunnleggende omgivelseslyder. Nå er slusene for lydfunksjoner helt åpnet.

Denne endringen er viktig fordi den forvandler AI-video fra «visuelt materiale som krever manuell etterproduksjon» til «et komplett medieformat som er klart for publisering». Gapet mellom «AI-genererte klipp» og «ferdig videoinnhold» har blitt redusert fra timer med redigering til bare noen få minutter med generering.

Spesiell betydning for kinesiske skapere: Denne transformasjonen gir større muligheter for innenlandske skapere. Plattformer som Douyin, Kuaishou og Bilibili har fostret et stort kreativt økosystem for korte musikkvideoer. Mens uavhengige musikere har bygget opp et publikum på NetEase Cloud Music og QQ Music, mangler de ofte visuelt innhold som står i forhold til deres musikalske kvalitet. AI-genererte musikkvideoer fyller dette tomrommet – produsenter som lager profesjonell musikk på bærbare datamaskiner, kan nå lage like polerte musikkvideoer ved hjelp av AI.

Hvorfor lyd er den siste brikken i puslespillet

Ta for eksempel arbeidsflyten for innholdsproduksjon hos en Bilibili-innholdsskaper, Xiaohongshu-skaper eller uavhengig musiker:

- Konsept – Hva handler videoen om?

- Visuelt inntrykk – Hvordan ser videoen ut?

- Lyd -- Hvordan høres videoen ut?

- Synkronisering -- Er bildene og lyden synkronisert?

- Finpuss -- Er den klar for utgivelse?

Innen 2025 hadde AI-videoverktøy effektivt løst trinn 1 og 2. Trinn 3 og 4 forble helt manuelle. Med generatorer som hadde lydfunksjoner, kunne trinn 1 til 4 nå fullføres med ett enkelt verktøy. Trinn 5 – den siste finpussen – er fortsatt det eneste manuelle trinnet, selv om nødvendigheten av dette avtar etter hvert som kvaliteten på resultatet forbedres.

For produksjon av musikkvideoer betyr dette en revolusjonerende endring. En uavhengig musiker som aldri ville hatt råd til tradisjonelle produksjonskostnader for musikkvideoer, kan nå lage en selv. En Bilibili-skaper som produserer lo-fi-musikk, kan lage visuelle akkompagnementer til hvert spor. Et markedsføringsteam kan produsere produktreklamer med perfekt tilpassede lydspor uten å måtte ansette komponister eller kjøpe opphavsrettsbeskyttet musikk.

Det nåværende landskapet av lydkompatible verktøy

Per februar 2026 er det tre plattformer som leder feltet innen AI-genererte videoer med integrert lyd:

- Seedance 2.0: Den mest omfattende audiovisuelle løsningen. Støtter generering av lydeffekter, AI-drevet lydspor-/musikkoppretting og flerspråklig leppesynkronisering (8 språk, inkludert kinesisk). Egnet for både tekst-til-video- og bilde-til-video-arbeidsflyter. Som et ByteDance-produkt er det direkte tilgjengelig i Kina uten VPN, og støtter Alipay/WeChat Pay. Denne guiden vil primært referere til denne plattformen.

- Google Veo 3: Kraftige innebygde lydgenereringsfunksjoner, inkludert omgivelseslyder og atmosfæriske effekter. Resultatene er imponerende, selv om det mangler Seedances detaljerte kontroll over lydtyper og stiler. **Krever VPN for bruk i Kina. ** For en detaljert sammenligning, se Seedance vs Veo 3 In-Depth Comparison.

- Pika 2.0: Grunnleggende generering av lydeffekter. Begrenset til omgivelseslyder – ingen musikkgenerering eller leppesynkronisering. Går i riktig retning, men er ikke en komplett lydløsning. Krever VPN.

Andre verktøy i økosystemet — Keeling, Runway og Conch AI — er foreløpig hovedsakelig fokusert på ren visuell produksjon, men det forventes at de snart vil følge etter. For en bredere sammenligning av alle generatorer, se The Complete 2026 AI Video Generator Comparison.

Ekstra alternativer for innenlandske brukere – AI-verktøy for musikkgenerering: I tillegg til lydfunksjonene i AI-videoer finnes det dedikerte AI-plattformer for musikkgenerering i Kina som er verdt å utforske: SkyMusic (produsert av Kunlun Wanwei, med enestående funksjoner for generering av kinesiske sangtekster) og NetEase Tianyin (produsert av NetEase, integrert med NetEase Cloud Music-økosystemet). Disse verktøyene kan fungere som frittstående musikkproduksjonsprosesser, hvor den genererte musikken deretter importeres til Seedance som lydreferansemateriale for videoproduksjon.

Tre hovedtyper av AI-basert audiovisuell generering

Ikke all AI-lyd er lik. Denne teknologien omfatter tre fundamentalt forskjellige funksjoner, som hver tjener forskjellige kreative formål og fungerer gjennom forskjellige tekniske mekanismer. Det er avgjørende å forstå disse forskjellene for å velge riktig tilnærming til prosjektet ditt.

AI-lydeffekter genereres ved å analysere videoinnholdet bilde for bilde, identifisere handlinger og miljøer som produserer lyd, og deretter syntetisere matchende lydbølgeformer. Det endelige resultatet er omgivelseslyd som er organisk knyttet til det visuelle innholdet.

Type én: AI-lydeffekter (SFX)

AI-lydgenerering produserer automatisk omgivelses- og actionlyder som passer til innholdet på skjermen. Når karakterene går langs en grusvei, hører du fotspor som knaser på steinene. Når bølgene slår mot steinene, hører du lyden av havet. Når bilmotorer brøler i en gatescene, hører du motorstøyen.

Slik fungerer Seedance Sound Generation: AI-modellen analyserer det visuelle innholdet i den genererte videoen – identifiserer objekter, handlinger, miljøer og fysiske interaksjoner – og produserer et tilhørende lydspor med tilsvarende lydeffekter. Dette er ikke bare et spørsmål om å matche «hav» med et arkivklipp av bølger. Modellen genererer unik lyd som reagerer på spesifikke visuelle egenskaper: bølgenes intensitet, avstanden til kameraet, tilstedeværelsen av vind og miljøets akustiske egenskaper.

Sound Generation spesialiserer seg på behandling av følgende lydtyper:

- Omgivelseslyder (vind, regn, torden, skoglyder, bytrafikk)

- Fysiske interaksjonslyder (fotspor på ulike overflater, dører som åpnes/lukkes, plassering av gjenstander)

- Naturlyder (vannstrøm, fuglesang, insektsyng, raslende blader)

- Mekaniske lyder (motorer, maskindrift, knappetrykk, elektronisk brumming)

- Slaglyder (kollisjoner, sprut, knusing, sammenbrudd)

Teknikker for å antyde lyd gjennom instruksjoner: Selv når du bruker tekst-til-video-AI, kan du påvirke lydutgangen ved å beskrive lydproduserende elementer i visuelle instruksjoner. «Regn som hamrer mot et blikk tak» gir mer intens regnlyd enn «lett duskregn i en hage». Fottrinnslyden fra «tunge støvler som tramper på et metallgitter» er helt annerledes enn «bare føtter på varm sand». Visuelle beskrivelser styrer lydgenereringen, så å skildre akustisk rike scener gir mer komplekse lydlandskap.

Nåværende begrensninger: Lydgenerering er utmerket for omgivelseslyder og naturlige lyder, men kan ha problemer med komplekse, flerlags lydlandskap (for eksempel en travel restaurant med overlappende samtaler, klirrende bestikk, kjøkkenstøy og bakgrunnsmusikk). Den håndterer også organiske lyder bedre enn svært spesifikke, identifiserbare lydkarakteristika (motorlyden til en bestemt bilmodell, sangen til en bestemt fugleart).

Type to: AI-musikk og lydspor

AI-musikkgenerering skaper bakgrunnsmusikk, lydspor og originale partiturer til videoene dine som passer perfekt til det visuelle innholdet, stemningen og rytmen. Dette er ikke bare å legge til generisk royaltyfri musikk – AI-en genererer skreddersydde originale komposisjoner som er tilpasset opptakene.

Stilkontroll: Du kan styre den musikalske stilen gjennom instruksjoner og genereringsinnstillinger. Et bredt spekter av stiler støttes:

- Film Orchestral: Storslåtte strykere, messingblåsere og perkusjon, ideelt for episke landskap eller dramatiske scener

- Dynamic Electronic: Levende synths og beats, ideelt for innhold med høyt tempo, produktpresentasjoner eller sosiale medier

- Ambient/Atmospheric Music: Myke teksturer, lagdelte toner og vedvarende bass, perfekt for meditativt innhold, eiendomspresentasjoner eller naturfilmer i sakte film

- Lo-fi Hip-hop: Ikoniske, varme, litt falske beats kombinert med vinylknising, ideelt for studie-/fokusinnhold

- Spenning/Suspense: Dissonante strykere, dype perkusjonsinstrumenter og lagdelte, eskalerende toner, perfekt for trailere og reklamefilmer

- Folk/ akustisk: Gitar, piano og organiske instrumenter, egnet for personlig, intimt innhold

- Tradisjonell kinesisk/gammel stil: Guzheng, fløyte, pipa og andre tradisjonelle kinesiske instrumenter, egnet for tradisjonelt kinesisk videoinnhold og musikkvideoer i gammel stil -- Dette representerer den mest særegne stilistiske retningen innen kinesisk AI-musikkvideoproduksjon.

Ulike musikalske stiler gir tydelig forskjellige bølgeformkarakteristika. AI-lydsporsgenerering tilpasser seg ikke bare sjangeren, men justerer også energikurven, slik at intensiteten i musikken synkroniseres med den visuelle handlingen gjennom hele videoen.

Varighetsmatching: AI-generert musikk vil matche varigheten på videoen din. Et 5 sekunders klipp får en sammenhengende 5 sekunders musikalsk frase. En 30 sekunders video får et strukturert stykke med introduksjon, utvikling og avslutning. Dette eliminerer det vanlige problemet med manuelt å fade inn/ut arkivmusikk som aldri ble designet for din spesifikke videolengde.

Forskjeller fra frittstående AI-musikkverktøy: Du er kanskje allerede kjent med dedikerte AI-musikkgeneratorer som Suno eller Udio, som lager frittstående musikkspor fra tekstprompter. Selv om disse verktøyene produserer utmerket musikk, mangler de visuell bevissthet – de har ingen kunnskap om hvordan videoen din ser ut, når viktige visuelle øyeblikk oppstår eller hvordan stemningen endrer seg i opptakene. AI-lydsporsgenerering i videoverktøy som Seedance fungerer fundamentalt annerledes, da musikken genereres som respons på det visuelle innholdet. Musikken intensiveres når scenene blir mer dramatiske, rytmen tilpasses bevegelsene på skjermen, og stemningen samsvarer med stemningen i hver scene.

Med andre ord, frittstående AI-musikkverktøy og AI-videogeneratorer utfyller hverandre. En robust arbeidsflyt innebærer først å generere et spor i Suno eller Udio (eller innenlandske alternativer som SkyMusic eller NetEase Tianyin), og deretter bruke den lydfilen som referanseinngang for å generere video i Seedance. AI-videogeneratoren vil lage bilder som reagerer på musikkens struktur. Vi skal detaljere denne arbeidsflyten i den trinnvise veiledningen nedenfor.

Type tre: AI-leppesynkronisering og tale

AI-leppesynkronisering stiller de strengeste tekniske kravene av de tre lydtypene. Den tilpasser tale-lyd – enten den er lastet opp eller generert – til karakterens leppebevegelser, og skaper en visuell effekt av at karakteren på skjermen snakker eller synger.

Flerspråklig støtte: Seedance 2.0 støtter leppesynkronisering på åtte språk, inkludert kinesisk, engelsk, japansk, koreansk, spansk, fransk, tysk og portugisisk. Dette går utover ren lyddubbing – modellen justerer karakterenes munnformer, kjevebevegelser og mikrouttrykk i ansiktet for å matche stemmeegenskapene til hvert språk. Munnformen for den kinesiske vokalen «o» er forskjellig fra den engelske «O», mens den japanske vokalen «u» også varierer fra den engelske «u». Nøyaktig leppesynkronisering må ta hensyn til disse språklige forskjellene.

Den praktiske betydningen av kinesisk leppesynkronisering: For innenlandske skapere gjør kinesisk leppesynkronisering det mulig for AI-genererte karakterer å fremføre sangene dine på standard mandarin eller å matche raske kinesiske tekster i rap-musikkvideoer nøyaktig. Dette har et enormt kreativt potensial innenfor TikTok og Bilibilis cover- og anime-miljøer – virtuelle AI-sangere er i ferd med å bli et nytt innholdsformat.

AI-leppesynkronisering forvandler en visuelt naturtro, men lydløs karakter til en stemme. Denne teknologien justerer ikke bare munnen, men også kjeveposisjonen, kinnspenningen og subtile mikrouttrykk i ansiktet for å matche talefonemene.

Slik fungerer det: Prosessen starter med en lydreferanse – enten en stemmeopptak du laster opp eller AI-generert tale. Modellen analyserer det fonetiske innholdet i lyden (hvilke lyder som produseres på hvilke tidspunkter) og genererer tilsvarende leppebevegelser og ansiktsuttrykk bilde for bilde. For å oppnå optimale resultater bør lyden inneholde klar tale i moderat tempo med minimalt med bakgrunnsstøy.

Anvendelsesscenarier:

- Digitale mennesker og virtuelle avatarer: Lag snakkende AI-verter for Bilibili/YouTube-kanaler, bedriftsopplæring eller kundeservice

- Animerte figurer: Gi stemme til AI-genererte animerte figurer uten frame-for-frame-leppesynkronisering

- Flerspråklig dubbing: Generer leppesynkroniserte versjoner av eksisterende audiovisuelt innhold på andre språk, og tilpass ny lyd til karakterenes munnbevegelser

- Musikkvideoopptredener: Synkroniser sangernes visuelle opptredener med vokalspor for å skape autentiske musikkvideoeffekter

- Podcast- og lydbokvisualisering: Forvandle rent lydinnhold til visuelle medier med snakkende karakterer

Nåværende begrensninger — ærlig vurdering: Lip-sync er den yngste og minst modne av de tre audiovisuelle typene. Selv om det er gjort betydelige fremskritt, gjenstår det visse utfordringer. Rask tale overskrider av og til modellens kapasitet til å generere matchende leppebevegelser, noe som resulterer i en liten desynkronisering. Ekstreme ansiktsvinkler (sideprofiler, ekstreme oppadgående vinkler) reduserer lip-sync-nøyaktigheten på grunn av færre synlige munnlandemerker. Tale med uttalt aksent eller uvanlige stemmeegenskaper kan gi mindre nøyaktige resultater enn standard talemønstre. For kinesiske sanger med ekstremt rask levering, for eksempel rap, kan synkroniseringsnøyaktigheten være lavere enn for sang med standard tempo. Selv om teknologien utvikler seg raskt, er det viktig å ha rimelige forventninger – i 2026 fungerer leppesynkronisering utmerket i standard talescenarier, men er fortsatt under utvikling for spesielle tilfeller.

Trinnvis veiledning: Lage AI-musikkvideoer fra bunnen av

Ved å følge denne seks-trinns arbeidsflyten kan du lage en komplett AI-musikkvideo med synkronisert lyd og bilde, fra idé til ferdig produkt. Denne prosessen kan brukes uansett om du er en uavhengig musiker som lager din første musikkvideo, en Bilibili-innholdsskaper som bygger en musikkdrevet kanal eller en markedsfører som produserer merkevarevideoer.

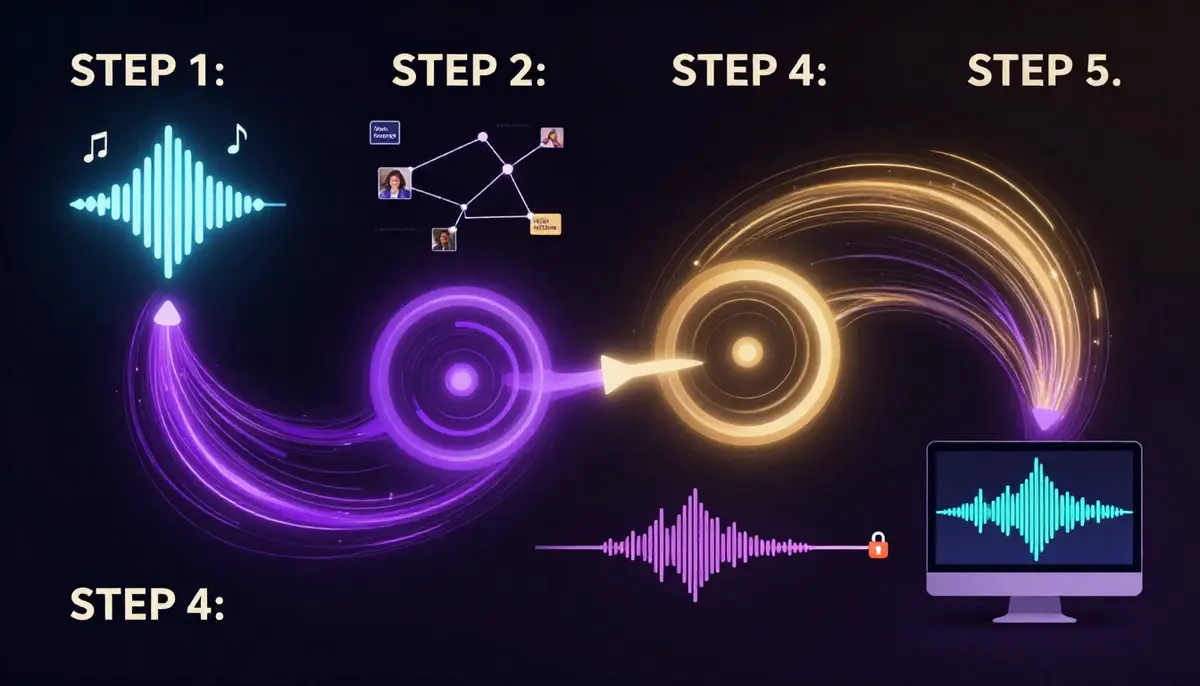

En komplett AI-musikkvideo-arbeidsflyt fra lydkilde til ferdig produkt. Hvert trinn bygger på det forrige, og audiovisuell synkronisering oppnås automatisk under genereringen.

Trinn 1: Forbered musikken eller lydkilden din

Hver musikkvideo begynner med musikken. Du har tre muligheter:

Alternativ A – Bruke din egen musikk: Hvis du er musiker eller har lisensierte spor, må du forberede lydfilene dine. Støttede formater inkluderer vanligvis MP3, WAV og AAC. For optimale resultater bør du bruke master- eller miksversjoner av høy kvalitet (ikke komprimerte streaming-ripper). Ren, godt separert lyd gir bedre synkronisering av lepper og munn enn sterkt komprimerte filer.

Alternativ B — Lag musikk med AI først: Bruk frittstående AI-musikkgeneratorer til å lage originale spor. Utenlandske verktøy inkluderer Suno og Udio; innenlands kan du vurdere SkyMusic (utmerket til å generere kinesiske tekster, støtter flere kinesiske musikkstiler) eller NetEase Tianyin (integrert med NetEase Cloud Music-økosystemet). Beskriv ønsket stil, stemning, tempo og arrangement. Generer flere versjoner og velg den som passer best til ditt visuelle konsept. Lagre lokalt.

Alternativ C – Full AI-kontroll: Hvis du mangler en spesifikk lydkilde og ønsker at AI-en skal generere både bilder og lyd samtidig, kan du hoppe over lydforberedelsen og stole direkte på Seedances innebygde lydsporsgenerering. I dette scenariet vil den visuelle prompten påvirke det musikalske resultatet. Dette er den raskeste tilnærmingen, men gir mindre kontroll over den nøyaktige musikalske effekten.

Råd til musikere: Hvis du ønsker at bildene skal reagere på bestemte øyeblikk i musikken – et tempoendring, en toneartendring, en vokalinnsats – noter ned disse tidspunktene. Du vil bruke denne informasjonen i dine instruksjoner og kan generere segmenter som passer til sangens struktur.

Trinn to: Lage visuelle signaler som utfyller musikken

De visuelle signalene dine bør skildre bilder som utfyller lyden på en naturlig måte. Det handler ikke om å illustrere tekstene ord for ord, men heller om å skape en visuell atmosfære som forsterker det emosjonelle innholdet i musikken.

Tilpasse musikalsk stil til visuell stil:

| Musikkstil | Visuell retning | Nøkkelord |

|---|---|---|

| Filmisk orkester | Vidstrakte landskap, dramatisk himmel, episk skala | «vidstrakt», «majestetisk», «langsom dolly», «IMAX-kvalitet» |

| Lo-fi / Avslapning | Myke toner, koselige interiører, duskregn, varm belysning | «pastell», «myk fokus», «varm», «mild bevegelse» |

| Dynamisk elektronisk | Raske kutt, neon, urbant, dynamiske bilder | «levende», «dynamisk», «neon», «hurtig tempo» |

| Lyrisk ballade | Intime nærbilder, levende lys, sakte film | «intim», «lav dybdeskarphet», «varme toner» |

| Mørk/dramatisk | Skygger, høy kontrast, spenning, minimalistisk fargepalett | «dramatisk belysning», «silhuett», «høy kontrast» |

| Kinesisk/gammel stil | Landskap, paviljonger og tårn, elementer i tusj, fallende blomsterblader | «Kinesisk landskap», «blekkmaleristil», «tradisjonell arkitektur», «eterisk» |

| Rap/Hip-hop | Gatebilder, graffiti, nattlandskap, billykter | «urban», «gatekultur», «neonskilt», «dynamisk håndholdt» |

For omfattende teknikker for prompting, se Seedance Prompt Guide. Grunnleggende prinsipper for prompting i musikkvideoer: beskriv bevegelser som føles naturlige i forhold til sangens rytme. Raske låter krever dynamiske bilder, mens langsommere sanger krever jevne, elegante bevegelser.

Trinn tre: Velg lydmodus

Når du genererer i Seedance, velger du riktig lydmodus basert på prosjektet ditt:

Lydeffektmodus (SFX): Ideell når videoen din inneholder tydelige miljø- eller actionelementer som krever autentiske omgivelseslyder. En bil som kjører gjennom regn skal høres ut som en bil i regn. Havscener skal inneholde lyden av bølger. SFX-modus genererer automatisk disse lydene basert på videomaterialet.

Musikk-/lydspormodus: Ideell når du ønsker AI-generert bakgrunnsmusikk som supplement til visuelt innhold. Bruk denne når det ikke finnes ferdige spor og du ønsker at verktøyet skal lage originale lydspor. Du kan påvirke stilen gjennom visuelle instruksjoner – et neonbelagt cyberpunk-bybilde vil generere musikk som er helt annerledes enn en rolig soloppgang i fjellet.

Stemme-/leppesynkroniseringsmodus: Ideell når videoen din inneholder figurer som snakker eller synger, og du trenger lyd som er synkronisert med munnbevegelsene. Last opp vokalsporet eller stemmeopptaket ditt, så genererer AI-en matchende leppebevegelser for figuren.

Kombinert tilnærming: For å få en mest mulig omfattende musikkvideoopplevelse, bør du vurdere en arbeidsflyt med flere trinn. Først genererer du en grunnleggende video med bilder og musikk ved hjelp av lydspormodus. Hvis det er behov for å legge omgivelseslydeffekter over musikken, bruker du SFX-modus i et andre trinn eller legger dem til under etterproduksjonen. Hvis karakterene skal synge, behandler du dette ved hjelp av leppesynkroniseringsmodus på vokalsporet.

Trinn fire: Last opp referansemateriale (valgfritt, men sterkt anbefalt)

Referanseinnganger kan forbedre kvaliteten og nøyaktigheten av utdataene betydelig. For produksjon av musikkvideoer er følgende typer referanser spesielt nyttige:

Lydreferansefil: Last opp musikksporet ditt. AI-en vil bruke det som lydskjelett for videoen og generere bilder som responderer på det musikalske innholdet. Dette er den mest innflytelsesrike referansen i MV-produksjon.

Referansebilde: Last opp et statisk bilde som viser den visuelle stilen du ønsker. Dette kan være et albumomslag, et skjermbilde av et moodboard, et bilde fra en eksisterende musikkvideo du liker, eller et AI-generert bilde som fanger den estetiske stilen du ønsker. Seedances tekst-til-video-funksjon bruker denne referansen for å opprettholde visuell konsistens.

Referansevideo: Hvis du har en eksisterende musikkvideo med kamerabevegelser, redigeringsrytme eller visuell stil som du ønsker å etterligne, kan du laste den opp som referanse. AI-en vil lære bevegelsesmønstre, overgangstiming og visuell komposisjon fra referansen din mens den genererer originalt innhold.

Trinn fem: Generer og juster audiovisuell synkronisering

Klikk på «Generer» for å få AI-en til å produsere det første resultatet. Under gjennomgangen må du være spesielt oppmerksom på nøyaktigheten av leppesynkroniseringen:

Viktige kontrollpunkter:

- Stemmer den musikalske energien overens med den visuelle energien? Et dramatisk orkesterkrescendo bør sammenfalle med et visuelt dramatisk øyeblikk, ikke en statisk scene.

- Er timingen av lydeffektene nøyaktig? Fottrinn bør høres når foten kommer i kontakt med bakken. Sammenstøtlyder bør samsvare med visuelle kollisjoner.

- Er leppesynkroniseringen overbevisende? Observer karakterenes munner ved normal visningshastighet. Mindre avvik på rammenivå er usynlige ved normal hastighet, men synlige i sakte film – og publikum ser på ved normal hastighet.

- Er den generelle atmosfæren sammenhengende? Den visuelle fargepaletten, musikalsk tonalitet og arrangement, samt rytme bør samlet formidle den samme emosjonelle fortellingen.

Hvis synkroniseringen viser seg å være problematisk: Generer på nytt etter å ha endret instruksjonen. Hvis musikken viser seg å være for intens for bildene, kan du innlemme mer dynamiske elementer i den visuelle instruksjonen. Hvis bildene viser seg å være for raske for en langsom sang, kan du inkludere tempoangivelser som «langsom», «myk» eller «bevisst» i instruksjonen. AI-en vil reagere på disse rytmiske angivelsene.

Trinn seks: Eksporter de komplette lyd- og videofilene

Når du er fornøyd, eksporterer du den ferdige musikkvideoen. Resultatet er en enkelt fil som inneholder både video- og lydspor som allerede er synkronisert – slik at du slipper å justere lyden manuelt i redigeringsprogrammet.

Eksportmerknader:

- Format: MP4 (H.264 video + AAC lyd) er den universelle standarden som aksepteres på alle plattformer

- Oppløsning: Eksporter med høyest mulig oppløsning. For musikkvideoer er 1080p minimumskravet; 2K eller 4K er å foretrekke.

- Bildeforhold: 16:9 for Bilibili/YouTube og standard MV-distribusjon; 9:16 for Douyin, Kuaishou, Xiaohongshu og Instagram Reels; 1:1 for WeChat Moments og Instagram-feed

- Lydkvalitet: Sørg for at eksportinnstillingene bevarer lydkvaliteten. Hvis masterfiler av høy kvalitet lastes opp, bør eksporten opprettholde dette kvalitetsnivået.

Valgfrie trinn etter eksport: Selv om AI-genererte musikkvideoer kan publiseres direkte, kan det være lurt å legge til noen siste finpuss i et videoredigeringsprogram: tittelkort, tekstundertekster, artist-/label-logoer, seksjonsoverganger eller fargegradering. Vanlige verktøy som CapCut, DaVinci Resolve eller Premiere er godt egnet for denne siste finpussen. Før du publiserer på Bilibili, må du huske å legge til undertekster og et forsidebilde – disse er avgjørende for Bilibilis anbefalingsalgoritme.

Lag din første AI-musikkvideo nå -->

8 viktige bruksområder for AI-musikkvideoer

Generering av musikkvideoer ved hjelp av AI er ikke en teknologi med ett enkelt formål. Fusjonen av visuell skapelse og synkronisert lyd åpner for kreative muligheter på tvers av ulike innholdstyper og bransjer. Nedenfor følger åtte konkrete anvendelsesscenarier, hver med målrettet veiledning for bruk.

Åtte forskjellige bruksscenarier for generering av AI-musikkvideoer, hver med unike visuelle stiler, lydkrav og målgrupper. Den samme kjerneteknologien tilpasser seg helt forskjellige kreative retninger.

- Uavhengig musiker Musikkvideo

Mulighet: Uavhengige musikere har lenge slitt med en smertefull forskjell – gapet mellom musikalsk kvalitet og kvaliteten på det tilhørende visuelle innholdet. En produsent som jobber hjemmefra kan lage polerte, utgivelsesklar spor på en bærbar PC, men å produsere en tilhørende musikkvideo koster tradisjonelt mellom 2000 og 15 000 pund. Selv den mest grunnleggende innspillingen medfører betydelige kostnader. AI-generering av musikkvideoer har fullstendig eliminert denne kostnadsbarrieren.

Unik verdi i Kina: Den innenlandske uavhengige musikkscenen (hiphop, elektronisk, tradisjonell kinesisk, folkemusikk) har blomstret de siste årene. Antallet uavhengige artister på NetEase Cloud Music og QQ Music fortsetter å vokse, men de aller fleste av deres verk inneholder kun lyd, uten musikkvideoer. På Bilibilis musikkplattform får innleveringer med høy kvalitet på det visuelle betydelig høyere anbefalingsvekt enn de som kun inneholder lydspor og statiske omslag. AI-musikkvideoer gir alle uavhengige musikere muligheten til å lage visuelle verk.

Fremgangsmåte: Last opp den ferdige låten til Seedance som en lydreferanse. Lag visuelle signaler som fanger sangens følelsesmessige bue – ikke en scene-for-scene-illustrasjon av teksten, men bilder som vekker de samme følelsene. Psykedelisk pop egner seg godt til myke, eteriske, svevende bilder. Lo-fi-komposisjoner passer godt sammen med varme, nostalgiske urbane scener. Eksperimentell elektronisk musikk passer til abstrakte, surrealistiske bilder. Kinesisk musikk komplementerer landskap malt med tusj, gammel arkitektur og scener med fallende blomsterblader.

Beste praksis for frittstående musikkvideoer: Hvis en sang har tydelige seksjoner, bør du vurdere segmentert produksjon. Lag én visuell stil for versene, en annen for refrenget og en tredje for broen. Sett deretter sammen disse segmentene ved hjelp av overganger i redigeringsprogramvare som ShineVideo eller DaVinci Resolve. Hver seksjon har sin egen visuelle identitet, mens musikken gir kontinuitet.

Rimelige forventninger: Innen 2026 vil AI-genererte musikkvideoer utmerke seg i stiliserte, atmosfæriske og abstrakte visuelle retninger. De vil fungere mindre effektivt for narrative eller performance-baserte musikkvideoer som krever spesifikke skuespillere for å utføre koreograferte bevegelser eller filming på bestemte steder i den virkelige verden. Utnytt AI-teknologiens styrker: atmosfære, surrealisme og visuell poesi.

- Tekstvideoer

Muligheter: Tekstvideoer har blitt et standardformat for utgivelser – ofte lansert før eller samtidig med offisielle musikkvideoer. De øker antall avspillinger, tilfredsstiller lyttere som er interessert i tekstene, og fungerer som det første visuelle kontaktpunktet for nye låter. Tradisjonell produksjon av tekstvideoer krever design av bevegelige grafiske elementer, tekstanimasjon og bakgrunnsbilder. AI forenkler dette til instruksjoner + tekstoverlegg.

Fremgangsmåte: Lag atmosfæriske visuelle løkker som passer til sangens stemning. Etter eksport, legg til tekstoverlegg i剪映, After Effects eller Canva Video. AI håndterer den visuelle bakgrunnen, du håndterer typografien.

Beste praksis: Bruk langsomme, jevne kamerabevegelser som ikke konkurrerer om oppmerksomheten med teksten. Unngå visuelt rotete scener – tekstene må være tydelig lesbare mot bakgrunnen. Lag bilder ved hjelp av et fargevalg som gir god kontrast til den valgte tekstfargen. Når du publiserer tekstvideoer på Bilibili og NetEase Cloud Music, må du huske å synkronisere opplastinger til de tilsvarende musikkplattformene for å oppnå dobbel eksponering.

- Bilibili/YouTube bakgrunnsmusikkvideoer

Muligheter: «Lo-fi-musikk for studier», «regnljud for søvn», «meditasjonsmusikk» – kanaler på Bilibili og YouTube som genererer enorme visninger gjennom en enkel formel: lyd av høy kvalitet kombinert med en visuell loop. Noen av YouTubes største musikkkanaler er bygget helt på denne modellen. Bilibilis «studielivestreams» og «hvit støy»-seksjoner er like populære. AI gjør det bemerkelsesverdig enkelt å lage både lyd og bilder samtidig.

Metode: Lag en visuell scene som går i loop – et koselig rom med regn utenfor vinduet, en bysilhuett om natten og en animert figur som sitter ved et skrivebord. Ledsag med utvidet AI-generert lo-fi- eller ambientmusikk. For YouTube-optimalisering, eksporter i 16:9-bildeforhold med minimum 1080p-oppløsning, og inkluder relevante nøkkelord i tittelen, beskrivelsen og taggene. For Bilibili, legg til tagger som «læring», «hvit støy» eller «søvnhjelp», og velg riktig kategori for innsending.

Inntektsmodell: De beste YouTube-kanalene kan tjene mellom 5 000 og 50 000 dollar i måneden (ca. 3 600 til 36 000 pund) utelukkende gjennom annonseinntekter. Selv om Bilibilis insentiver til innholdsskapere er relativt lavere, er det mulig å tjene penger gjennom premiummedlemskontingent, inntektsdeling fra konferansemedlemskap og annonseplasseringer. Nøkkelen ligger i jevnlige oppdateringer: regelmessige opplastinger og oppbygging av et innholdsbibliotek gjør at algoritmen kan fungere effektivt. AI-generert innhold gjør det mulig for en enkelt skaper å opprettholde en daglig publiseringsrytme.

4. TikTok/Kuaishou/Xiaohongshu korte musikkvideoer

Muligheter: TikTok, Kuaishou, Xiaohongshu, Instagram Reels, TikTok og YouTube Shorts prioriterer alle videoinnhold med musikk høyt. Innlegg med lyd genererer gjennomgående betydelig høyere engasjement enn innlegg uten lyd eller kun med tekst. For merkevarer og skapere er det å produsere kort videoinnhold med lydspor en ubarmhjertig innholdsmaraton. AI komprimerer produksjonssyklusene fra timer til bare minutter.

Fremgangsmåte: Lag en 5–15 sekunders vertikal (9:16) video og aktiver lydspormodus. AI-en vil samtidig produsere bildene og tilhørende musikk. Hvis du ønsker å bruke populær musikk fra plattformen, må du først lage bildene og deretter legge til populær bakgrunnsmusikk i den innebygde TikTok/Kuaishou-redigereren. Hvis du ønsker original lyd, kan du la AI-en fullføre hele pakken.

Anbefalinger for innenlandske plattformer for korte videoer:

- Douyin: De første 1–2 sekundene må inneholde en visuell hook. Bruk ord som gir umiddelbar visuell effekt – dramatiske avsløringer, sterke farger eller uventede bevegelser. Douyin har lyd på som standard, så lydkvaliteten er avgjørende fra første bilde.

- Kuaishou: Ke Ling (Kuaishous AI-verktøy) samarbeider naturlig med Kuaishou-økosystemet. Hvis Kuaishou er din primære plattform, bør du vurdere en kombinert arbeidsflyt: generer bilder i Ke Ling og legg til lyd i Seedance.

- Xiaohongshu: Vertikale videoer i formatet 9:16 kombinert med stemningsfull musikk fungerer svært godt på Xiaohongshu. Kunstnerisk, terapeutisk og ASMR-orientert AI-musikkvideoinnhold passer svært godt til Xiaohongshus brukerbase.

- Podcast-visualisering

** Mulighet: Podcast-skapere står overfor en distribusjonsutfordring. Innholdet deres er rent lydbasert, men de store plattformene (Bilibili, YouTube, Douyin, Xiaohongshu) prioriterer video. «Podcast-visualisering» – den dynamiske visuelle representasjonen av lydinnhold – løser dette ved å gi lydmaterialet en visuell form som passer til videoplattformer. Tradisjonell podcast-visualisering krever programvare for bevegelig grafikk og designferdigheter. AI genererer disse automatisk.

Funksjonsmåte: Last opp lydklippet fra podcasten din til Seedance. AI-en genererer dynamiske bilder som reagerer på lyden – intensitet, rytme og tonale endringer i talen gir tilsvarende visuelle endringer. Alternativt kan du komponere en visuell prompt som representerer temaet for podcasten din, og AI-en vil generere en atmosfærisk visuell loop som følger lyden.

Bilibili-strategi: Bilibili har blitt en av Kinas største plattformer for lange videoer, og mange kjente podkastere publiserer nå videoversjoner av innholdet sitt der. Et AI-generert visuelt akkompagnement forvandler rene lydpodcaster til Bilibili-kompatible videoer med minimal innsats. Selv enkle visuelle løkker fungerer betydelig bedre for Bilibilis anbefalingsalgoritme enn statiske miniatyrbilder.

- Produktreklame-lydspor

Mulighet: Produktvideoer med passende musikk oppnår betydelig høyere konverteringsfrekvenser enn produktvideoer uten lyd. Lisensiering av musikk til kommersiell bruk koster imidlertid opptil 500–5000 RMB per spor, mens det er enda dyrere å bestille spesialkomponerte lydspor fra komponister. AI-genererte lydspor eliminerer både kostnadene og kompleksiteten knyttet til opphavsrett – den genererte musikken er original og kan brukes kommersielt.

Fremgangsmåte: Lag visuelt innhold ved å følge arbeidsflyten for produktvideoer, og aktiver deretter lydspormodus for å legge til passende musikk. For presentasjoner av premiumprodukter kan du lage filmisk orkestermusikk eller ambientmusikk. For dynamiske produktlanseringer kan du lage energisk elektronisk musikk. AI tilpasser automatisk energien i musikken til det visuelle innholdet.

Fordel med opphavsrett: En viktig fordel med Seedances AI-genererte musikk er at resultatet er originalt – ikke hentet fra eksisterende spor med opphavsrett. Dette eliminerer risikoen for klager knyttet til opphavsrett ved bruk av gjenkjennelig musikk i reklamer. Med et betalt abonnement beholder du kommersielle bruksrettigheter for det genererte resultatet, slik at det kan brukes i reklamer uten ekstra opphavsrettsgebyrer. Når du legger ut produktvideoer på e-handelsplattformer som Taobao, JD.com og Douyin Shop, betyr dette at du ikke trenger å bekymre deg for at innholdet blir fjernet på grunn av brudd på musikkopphavsretten.

- Spill- og applikasjonstrailere

Mulighet: Spilltrailere og forhåndsvisningsvideoer for apper er svært avhengige av synkronisering mellom lyd og bilde. Dramatiske pauser før bossen avsløres, lagdelte nedtellingssekvenser, lyden av kraftige ferdigheter – disse øyeblikkene finnes i skjæringspunktet mellom lyd og bilde. AI-genererte trailere gjør det mulig for uavhengige spillutviklere og apputviklere å oppnå en produksjonskvalitet på nivå med AAA-studioer.

Fremgangsmåte: Sett lydspormodus til «Cinematic» eller «Drama» for å generere dramatiske, energiske visuelle sekvenser. Lag instruksjoner som beskriver handling, effekt og visuelle opplevelser. Last opp skjermbilder fra spillet eller konseptkunst som referansebilder for å opprettholde visuell konsistens med det faktiske produktet. Legg på UI-elementer, spillopptak og tekstkommentarer under etterproduksjonen.

Lydfokus: Spilltrailere er et av de viktigste bruksområdene for lydkvalitet. Lydsporet må bygge opp spenningen gradvis, nå klimaks på akkurat riktig tidspunkt og avsluttes med en tilfredsstillende løsning. Hvis AI-komposisjonen ikke passer til rytmen i traileren, kan du regenerere den eller bruke frittstående AI-musikkverktøy til å lage skreddersydde spor, og deretter importere disse som lydreferanser. Når du publiserer spilltrailere på plattformer som TapTap, Bilibilis spillseksjon eller WeGame, er høykvalitets audiovisuell synkronisering avgjørende for å fange brukernes oppmerksomhet.

8. Høydepunkter fra bryllup og arrangementer

Mulighet: Personlige begivenhetsvideoer – bryllup, eksamener, jubileer, bursdager – er det mest følelsesladede videoinnholdet som skapes av enkeltpersoner. Profesjonell begivenhetsvideografi koster vanligvis mellom 500 og 3000 pund i Storbritannia. Mange har hundrevis av fotografier fra slike anledninger, men mangler videomateriale. AI kan forvandle disse bildene til filmiske høydepunkter med stemningsfull musikk, og skape profesjonelle resultater fra mobilfotografier.

Metode: Velg ut de 10–20 beste bildene fra arrangementet. Bruk Seedances bilde-til-video-funksjoner til å gi hvert bilde subtile bevegelser: delikate zoomer, milde linsedrift og skiftende lyseffekter. Aktiver lydspormodus og beskriv den følelsesmessige tonen du ønsker: «varm, emosjonell, akustisk gitar og piano, følelsen av første dans på bryllupet». AI-en vil generere en video for hvert klipp med passende musikk. Sett dem sammen til en komplett høydepunktsreel ved hjelp av redigeringsappen.

Hvorfor det fungerer så bra: Begivenhetsbilder har iboende en dyp emosjonell betydning for dem som er avbildet på dem. Å legge til subtile bevegelser gir dem liv. Å kombinere dem med musikk som passer til stemningen, løfter dem til filmisk kvalitet. Denne kombinasjonen forvandler et bildeslideshow til noe som føles som en ekte film – tilnærmet uten kostnad sammenlignet med å ansette en videograf etter begivenheten. Å dele slike samlinger på WeChat Moments eller TikTok gir langt bedre resultater enn et enkelt rutenett med ni bilder.

Mal for AI-musikkvideo

De følgende fem malene er designet for spesifikke musikkvideostiler. Hvert sett inneholder visuelle maler, anbefalte lydstiler og genereringsparametere. Kopier og bruk direkte, og juster etter behov for spesifikke prosjekter.

Merk: Alle spørsmålene er beholdt på originalspråket engelsk, da Seedance har best forståelse av engelske spørsmål. Hver mal er ledsaget av forklarende merknader på kinesisk.

Mal 1: Filmisk musikkvideo

Visuelt signal:

A silhouette walking through neon rain on a deserted downtown street

at midnight. Puddles on the asphalt reflect towering LED billboards

in magenta, cyan, and gold. Steam rises from a subway grate, curling

through the neon light. The camera tracks slowly behind the figure,

maintaining a medium-wide shot. Rain streaks catch the colored light

like falling sparks. The figure pauses at a crosswalk, head tilted

upward toward the glowing signs. Cinematic anamorphic lens with

horizontal flares. Blade Runner atmosphere. Moody, contemplative,

visually rich. 4K ultra-realistic.Midnatt. En silhuett krysser de øde gatene i sentrum under et neonregn. Pytter på asfalten reflekterer gigantiske LED-reklameskilt i magenta, cyan og gull. Damp stiger opp fra underjordiske ventiler og virvler rundt i neonglansen. Kameraet følger langsomt etter figuren bakfra. Anamorfisk linse, Blade Runner-aktig atmosfære.

Anbefalt lydstil: Filmisk synthwave eller ambient elektronisk musikk. Mørke, pulserende basslinjer lagd med eteriske synth-pads. Langsomt tempo (70–85 BPM). Gir en følelse av Vangelis møter M83.

Parametere: Bildeformat 16:9. Varighet 10 sekunder. Lydspor-modus aktivert. Maksimal tilgjengelig oppløsning.

Egnede scenarier: Atmosfæriske musikkvideoer for elektronisk musikk, synthpop eller indie-musikk. Kan også brukes til korte filmer med kinematisk stemning og merkevarevideoer. Spesielt godt egnet for Bilibilis musikkseksjon og elektronisk musikk.

Mal to: Drømmende Lo-fi

Visuelt signal:

Soft pastel clouds drifting over a quiet city at twilight, seen

through the rain-speckled window of a cozy apartment. A desk lamp

casts warm amber light over a cluttered workspace with vinyl records,

a steaming mug, and scattered handwritten notes. Raindrops trace

slow paths down the window glass. The city lights beyond are soft,

blurred circles of warm white and gentle orange. Camera holds a

static medium shot with extremely shallow depth of field focused on

the raindrops. The background city breathes with gentle, slow

ambient motion. Warm, nostalgic, intimate. Film grain. 24fps

cinematic quality.I skumringen driver myke pastellfargede skyer over den stille byen, sett gjennom de regnvåte vinduene i en koselig leilighet. En skrivebordslampe kaster et varmt, ravfarget skinn og lyser opp en arbeidsbenk full av vinylplater, en dampende kopp og spredte håndskrevne notater. Regndråper renner sakte ned vinduskarmen. Fjerne bylys vises som myke, uskarpe glorier i varmt hvitt og blek oransje. Varme, nostalgi, intimitet.*

Anbefalt lydstil: Lo-fi hip-hop. Vinylknising, litt ustemte pianokorder, myke kick-snare-rytmer, varm bass. Tempo: 70-80 BPM. Chillhop Records-estetikk.

Parametere: Bildeforhold 16:9 eller 1:1. Varighet 10 sekunder (designet for looping). Lydspor-modus: lo-fi/ambient. Ideell for lo-fi-livestreaming på Bilibili og YouTube når den loopes.

Egnede scenarier: Lo-fi-musikkkanaler, innhold for studier/konsentrasjon/søvn, avslappende spillelister og stemningsfulle innlegg på Xiaohongshu. Slikt innhold er svært populært i Bilibilis kategorier «studielivestreams» og «hvit støy».

Mal tre: Høy energi

Visuelt signal:

Fast-paced montage of urban sports and street culture. A skateboarder

launches off a concrete ledge in slow motion, wheels spinning, body

twisted mid-air. Quick cut to a BMX rider grinding a rail with

sparks flying. Cut to a basketball spinning on a fingertip against

a graffiti-covered wall. Each scene is lit by harsh, directional

afternoon sun creating sharp shadows. Colors are high-contrast and

saturated: electric blue sky, warm concrete orange, vivid graffiti

greens and pinks. Dynamic handheld camera with intentional shake.

Rapid scene transitions. 120fps slow-motion bursts within fast

editing. GoPro meets professional sports broadcast. 4K ultra-sharp.Kinesisk tolkning: En fartsfylt montasje av urbane idretter og gatekultur. Slowmotion-opptak av skateboardere som hopper fra betongtrapper, hjul som snurrer, kropper som vrir seg i luften. Raskt kutt til BMX-syklister som grinder på rekkverk, gnister flyr. Kutt til en basketball som snurrer på fingertuppene foran en graffitivegg. Kontrastrike, mettede farger. Dynamisk håndholdt kameraarbeid, raske sceneskift.

Anbefalt lydstil: Energisk hiphop eller elektronisk musikk. Kraftig 808-bass, trap-hi-hats, aggressive synth-stabs. Tempo: 130–150 BPM. Travis Scotts produksjonsstil. Også innenlandske rapstiler passer godt.

Parametere: 9:16 (TikTok/Kuaishou/Reels) eller 16:9 (Bilibili/YouTube). Varighet på 5–10 sekunder. Aktiver SFX-modus for effektfulle lydeffekter. Legg på en energisk lydspor.

Egnede scenarier: Innhold fra sportsmerker, reklame for energidrikker, ekstremsportkanaler og flashy/teaser-stil innhold på sosiale medier. Fungerer svært godt under TikToks sports- og trend-tagger.

Mal fire: Tekstbaserte sanger

Visuelt signal:

A single candle flickering in darkness on a weathered wooden table.

The flame casts warm, dancing golden light across the surface,

illuminating the grain and scratches in the old wood. A person's

hand slowly enters frame from the right, fingers gently hovering

near the flame without touching it. The hand trembles slightly. The

background is pure darkness with the faintest suggestion of a

window. The camera executes an imperceptibly slow push-in toward

the flame. Extreme shallow depth of field. The flame is razor-sharp

while even the fingertips soften into bokeh. Warm amber and deep

shadow color palette. Intimate, vulnerable, deeply human. 4K

photorealistic. 24fps film cadence.Engelsk beskrivelse: Et enkelt lys flimrer på et værbitt trebord i mørket. Flammen kaster et varmt, dansende gyldent skinn over bordplaten og belyser årringene og riper i det gamle treverket. En hånd kommer langsomt inn i bildet fra høyre, fingrene svever forsiktig ved siden av flammen uten å berøre den. Hånden skjelver svakt. Ekstremt kort dybdeskarphet. Flammen er skarpt definert, mens fingertuppene blir myke og uskarpe. En fargepalett med varme ravfarger og dype skygger. Intimitet, skjørhet, dyp menneskelighet.

Anbefalt lydstil: Pianoballader eller akustisk gitar kombinert med subtilt strykerakkompagnement. Molltoner. Ekstremt langsomt tempo (55–65 BPM). Produksjon som minner om Adele eller Bon Iver. Sparsomme arrangementer hvor rom og stillhet i seg selv blir musikalske elementer. Kinesiske folkemusikkkomposisjoner vil også passe perfekt.

Parametere: Bildeformat 16:9. Varighet 10 sekunder. Lydspor-modus: Emosjonell/Original. Maksimal tilgjengelig oppløsning. Denne malen er designet for å gi emosjonell effekt, ikke visuelt spektakel.

Egnede scenarier: Ballademusikkvideoer, minne-/hyllestvideoer, dramatiske filmscener, emosjonelle merkevarefortellinger, unplugged-serier. Innenfor kategoriene folkemusikk/kjærlighetssanger på NetEase Cloud Music og QQ Music passer denne visuelle stilen svært godt til publikums forventninger.

Mal fem: Vintage/nostalgisk

Visuelt signal:

VHS-style footage of a summer road trip along a coastal highway.

A vintage convertible with sun-faded red paint cruises along a

winding cliffside road above a sparkling ocean. The driver's arm

hangs out the window, hand surfing the wind. Palm trees line the

inland side of the road. The footage has authentic VHS artifacts:

horizontal tracking lines, slight color bleeding at edges, warm

oversaturated hues shifted toward orange and teal, subtle scan-line

texture, and occasional tracking glitches. Shot from a following car

at the same speed, steady tracking shot. Late afternoon golden light.

The ocean glitters intensely in the background. Nostalgic, carefree,

endless summer. 480p upscaled aesthetic, 4:3 aspect ratio within a

16:9 frame with black side bars.VHS-stil opptak av en sommertur langs kysten. En gammel kabriolet med falmet rød lakk kjører langs en vei på toppen av en klippe, med det glitrende havet under. Føreren strekker armen ut gjennom vinduet og lar hånden surfe på vinden. Opptakene har autentiske VHS-artefakter: horisontale sporlinjer, subtile fargeblødninger i kantene og overmettede varme toner som skifter mot oransje og cyan. Nostalgisk, bekymringsløst, evig sommer.

Anbefalt lydstil: Indie surf rock eller dream pop. Gitarer med mye reverb, hoppende basslinjer, lyse tamburiner. Tempo: 110-120 BPM. Tenk deg The Beach Boys møter Tame Impala. Alternativt en mer elektronisk retning med vaporwave/retro synths. Kinesisk retro pop (som City Pop) ville også passe perfekt.

Parametere: Bildeformat 16:9 (med 4:3 VHS-estetikk). Varighet 10 sekunder. Lydspor-modus: Retro/Indie. Denne malen har bevisst valgt en lo-fi visuell estetikk – ikke generer med maksimal oppløsning og bruk deretter VHS-effekter; la i stedet AI-en skape det vintage-utseendet på en naturlig måte.

Egnede scenarier: Nostalgiske/retro musikkvideoer, visuelle elementer til sommerplaylister, vintage-inspirert merkevareinnhold, filmsekvenser om å bli voksen og innhold i retrostil på Xiaohongshu. Vintage-estetikk er fortsatt populært blant unge kreatører i Kina, og det finnes store mengder innhold merket med «filmaktig» og «retro» på Xiaohongshu og Bilibili.

Sammenligning av de beste verktøyene for å lage musikkvideoer med AI

Ikke alle AI-videogeneratorer har lydfunksjoner, og blant de som har det, varierer funksjonssettet betydelig. Nedenfor er en direkte sammenligning av alle verktøy som er relevante for musikkvideoproduksjon per februar 2026.

Det audiovisuelle landskapet i 2026. Seedance 2.0 er ledende når det gjelder funksjonell fullstendighet, mens hver konkurrent har sine spesifikke styrker. Det riktige valget avhenger av ditt primære bruksscenario.

Sammenligningstabell

| Verktøy | Lydgenerering | Lydspor | Leppesynkronisering | Høyeste videokvalitet | Best egnet for | Startpris | Tilgjengelig i Kina | |------|:---:|:---:|:---:|---|-- -|---|:---:| | Seedance 2.0 | Støttes | Støttes | Støttes (8 språk) | 2K, maks. 2 minutter | Full MV-produksjon | Gratis versjon tilgjengelig | Kan brukes direkte | | Google Veo 3 | Støttes | Delvis | Støttes ikke | 1080p | Omgivelseslydscener | Via Google AI-verktøy | VPN kreves | | Pika 2.0 | Grunnleggende | Ikke støttet | Ikke støttet | 1080p | Enkel tillegg av lydeffekter | Gratis versjon tilgjengelig | VPN kreves | | Kaiber | Ikke støttet | Ikke støttet (ved bruk av opplastet lyd) | Ikke støttet | 1080p | Musikkvisualisering for opplastede spor | Ca. 10 $/måned (ca. £72) | VPN kreves | | Suno + Seedance | Via Seedance | Via Suno | Via Seedance | 2K (Seedance) | Beste AI-musikk + beste AI-videokombinasjon | Suno gratis + Seedance gratis | Seedance direkte tilgjengelig | | SkyMusic + Seedance | Via Seedance | Via SkyMusic | Via Seedance | 2K (Seedance) | Kinas fremste helt kinesiske AI-musikk + AI-videokombinasjon | SkyMusic gratis + Seedance gratis | Fullt tilgjengelig i Kina |

Seedance 2.0: Den mest omfattende audiovisuelle løsningen

Seedance er den eneste plattformen som støtter alle tre typer audiovisuell generering – lydeffekter, bakgrunnsmusikk og leppesynkronisering – i ett enkelt verktøy. For musikvideoprodusenter betyr dette at du kan generere stemningsfulle bilder med omgivende lydlandskap, legge til passende musikalske akkompagnementer og synkronisere vokalprestasjoner med karakterenes lepper, alt uten å forlate plattformen.

Viktige funksjoner i MV-produksjon:

- Tre lydmoduser (lydeffekter, musikk, stemme) som kan velges ved generering

- Leppesynkronisering på 8 språk (inkludert kinesisk), som støtter flerspråklig MV-distribusjon

- Lydreferanseinngang: Last opp sporet ditt for å generere bilder synkronisert med musikken

- Flere bildeforhold, inkludert 9:16 for kortformet MV-innhold

- Maksimal genereringstid på 2 minutter, som dekker hele sangseksjoner

- Konvertering av bilder til video: animer albumomslag eller statiske konsepter

Eksklusive fordeler for innenlandske brukere:

- Utviklet av ByteDance, tilgjengelig direkte i Kina uten VPN

- Støtter Alipay/WeChat Pay, ingen hindringer for betalte oppgraderinger

- Kinesisk leppesynkronisering er avgjørende for å lage innenlandske musikkvideoer

- Full funksjonalitet tilgjengelig selv i gratisversjonen

Posisjonering: Seedance er den ultimate integrerte løsningen for skapere som ønsker å fullføre hele produksjonsprosessen for musikkvideoer i ett enkelt verktøy. Kombinasjonen av høy kvalitet på bilde og omfattende lydfunksjoner er fortsatt uovertruffen.

Lag din egen musikkvideo med Seedance 2.0 nå -->

Google Veo 3: Kraftig innebygd lyd

Veo 3 genererer videoer med naturlig lyd, som inkluderer omgivelseslyder, atmosfæriske lyder og en viss grad av musikalsk akkompagnement. Lydkvaliteten er imponerende – Googles treningsdata og modellskala gir et rikt, lagdelt lydbilde. Strandscener høres virkelig ut som strender, med bølger i riktig avstand, vind med riktig intensitet og sjøfuglrop med plausible intervaller.

Fordel: Miljøvennlig lydgjengivelse. Veo 3 leverer de mest autentiske lydbildene i sin klasse.

Begrensninger i MV-produksjon: Veo 3 mangler den detaljerte lydkontrollen som Seedance tilbyr. Du kan ikke velge mellom lydeffekter/musikk/stemmemodus, det er ingen mulighet for leppesynkronisering, og du kan ikke laste opp dine egne lydspor som referanse. For MV-produksjon begrenser denne mangelen på fleksibilitet Veo 3 til atmosfæriske/miljømessige videoer med tilhørende lyd, i stedet for strukturert musikkvideo-produksjon. Videre krever tilgang fra hjemmet et VPN, noe som utgjør en høyere inngangsbarriere. For en detaljert sammenligning av funksjoner, se Seedance vs Veo 3 In-Depth Comparison.

Pika 2.0: Grunnleggende lydeffekter

Pikas lydeffektfunksjon legger til omgivelseslyd til genererte videoer. Dette er et nyttig tillegg til det som tidligere var et rent visuelt verktøy, selv om funksjonene fortsatt er begrensede sammenlignet med Seedance og Veo 3. SFX-generering dekker grunnleggende omgivelseslyder – fotspor, vannlyder, vindlyder, enkle støt – men mangler musikkgenerering og leppesynkronisering.

Fordeler: Legger til enkle lydeffekter til korte klipp. Hvis du trenger en fem sekunders regnscene med passende regnlyder, kan Pika håndtere det.

Begrensninger: Ingen musikkgenerering, ingen leppesynkronisering og ingen støtte for opplasting av lydreferanser. For produksjon av musikkvideoer er Pika alene ikke tilstrekkelig – det må kombineres med eksterne lydverktøy for å oppnå full effekt. Krever VPN.

Kaiber: Spesialist i musikkvisualisering

Kaiber bruker en annen tilnærming enn de andre verktøyene på denne listen. I stedet for å generere lyd fra video, lager den video fra lyd. Du laster opp et musikkspor, og Kaiber genererer abstrakte, stiliserte visuelle animasjoner som reagerer på det musikalske innholdet – bilder som pulserer i takt med rytmen, farger som skifter med harmoniske endringer og intensitet som tilpasses volumet.

Fordeler: Abstrakt musikkvisualisering. Hvis målet ditt er å lage psykedeliske, abstrakte, beat-responsive bilder til et elektronisk musikkstykke, er Kaiber skreddersydd for dette formålet.

Begrensninger: Kaiber genererer ikke lyd – det krever opplastede lydfiler. Videoutgangen er svært stilisert (abstrakt/kunstnerisk) snarere enn fotorealistisk. Det kan ikke lage narrative scener, karakterer eller realistiske miljøer. For fullstendig musikkvideoproduksjon som krever autentisk filmmateriale, fungerer Kaiber som et nisjeverktøy snarere enn en komplett løsning. Krever VPN.

Suno / SkyMusic + Seedance-samarbeid: Essensen av to verdener

For skapere som ønsker maksimal kontroll over både de musikalske og visuelle aspektene av arbeidet sitt, innebærer den mest effektive arbeidsflyten å kombinere en profesjonell AI-musikkgenerator med en profesjonell AI-videogenerator.

Internasjonal utgave – Suno + Seedance:

- Generer sporet ditt i Suno: Beskriv sjanger, stemning, tempo og arrangement. Suno produserer komplette musikkspor av høy kvalitet, med vokal om ønskelig.

- Last opp sporet til Seedance som en lydreferanse: AI-videogeneratoren skaper bilder som reagerer på musikkens struktur – scenene intensiveres under musikalske crescendoer og avtar under roligere passasjer.

- Bruk leppesynkronisering om nødvendig: Hvis Suno-sporet inneholder vokal og du ønsker at karakterene skal synge, kan du bruke Seedances leppesynkroniseringsmodus for å tilpasse munnbevegelsene til vokalsporet.

Innenlandsutgavepakke – SkyMusic + Seedance:

Denne kombinasjonen gir kinesiske skapere den mest sømløse ende-til-ende-arbeidsflyten for AI-musikkvideoer — begge plattformene er direkte tilgjengelige i Kina, uten behov for VPN.

- Lag spor i SkyMusic: SkyMusic er spesielt god til å generere kinesiske tekster og støtter ulike kinesiske musikksjangre, inkludert rap, pop og klassisk-inspirerte stiler.

- Last opp sporet ditt til Seedance som en lydreferanse: Seedance genererer matchende bilder basert på det musikalske innholdet.

- Kinesisk leppesynkronisering: Bruk Seedances kinesiske leppesynkroniseringsfunksjon for å få karakterene til å fremføre de kinesiske tekstene dine med presisjon.

Fordelen med denne arbeidsflyten er at du får den musikalske kvaliteten til profesjonell musikk-AI kombinert med de visuelle og synkroniseringsmulighetene til profesjonell video-AI. Ulempen er at du må bruke to verktøy i stedet for ett. For skapere som ønsker profesjonelle resultater, er dette ekstra trinnet absolutt verdt det.

Avansert: Teknikker for å oppnå synkronisering av lepper

Når du har mestret den grunnleggende arbeidsflyten, vil følgende avanserte teknikker hjelpe deg med å oppnå et nivå av audiovisuell koordinering i musikkvideoene dine som markerer skillet mellom profesjonelt og amatørmessig arbeid.

Avansert synkronisering handler ikke bare om å generere lyd og bilde samtidig. Det innebærer å bevisst tilpasse visuell rytme, stemning og struktur til den musikalske komposisjonen for å oppnå en helhetlig audiovisuell opplevelse.

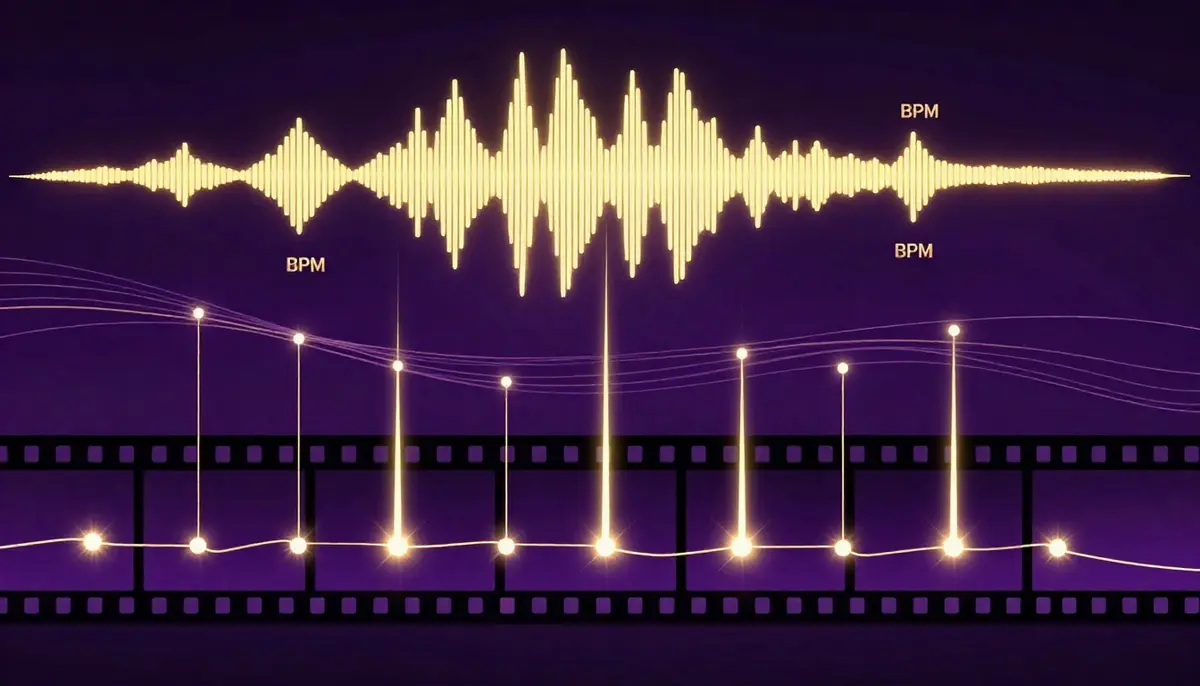

BPM-tilpasning: Tilpasse visuell rytme til musikalsk tempo

BPM (beats per minute) er hjerteslaget i ethvert musikkspor. Når det visuelle innholdet beveger seg i takt med musikkens rytme, føles effekten gjennomtenkt og profesjonell. Når de to ikke stemmer overens, føles det som om to urelaterte ting spilles av samtidig.

Hvordan oppnå BPM-tilpasning:

- Bestem sporets BPM: De fleste DAW-er (Ableton, Logic, FL Studio) viser automatisk BPM. Online BPM-deteksjonsverktøy er like effektive. Vanlige områder: lo-fi (70-85 BPM), pop (100-130 BPM), EDM (120-150 BPM), drum and bass (160-180 BPM).

- Oversett BPM til visuell bevegelseshastighet: Ved 120 BPM er det nøyaktig to slag per sekund. Kamerabevegelser, sceneoverganger og visuelle kutt som skjer hvert halve sekund, vil føles låst til takten.

- Bruk rytmesuggererende signaler: For spor med 130 BPM, bruk begreper som «rask», «energisk» og «dynamiske overganger». For spor med 70 BPM, velg «langsom», «flytende» og «mild drift». AI-en tolker disse rytmiske signalene og justerer det visuelle tempoet deretter.

- Finjustering etter produksjon: Hvis AI-ens visuelle rytme er nær, men ikke helt låst til takten, kan du gjøre justeringer i videoredigeringsprogrammet. Øk eller reduser hastigheten på segmenter med 5–10 % for å feste visuelle hendelser til taktmarkører. Denne finjusteringen gir en synlig forskjell. Både ShineVideo og DaVinci Resolve støtter slike presise hastighetsjusteringer.

Emosjonell synkronisering: Musikkpassasjer tilpasset visuelle atmosfærer

Profesjonelle musikkvideoer har ikke en gjennomgående visuell estetikk. De skifter stemning for å passe til sangens følelsesmessige bue. AI-generering gjør det mulig å lage disse overgangene ved å generere forskjellige segmenter ved hjelp av varierte visuelle instruksjoner.

Overføringen fra musikalsk struktur til visuell atmosfære:

| Sangseksjon | Musikkegenskaper | Visuell regi | |-------- -|---------|---------| | Intro | Sparsom, gradvis | Minimalistisk visuelt uttrykk, dempede toner, sakte film. Skaper atmosfære. | | Vers | Narrativ, middels energi | Historiedrevne scener, moderat tempo, varm eller nøytral fargepalett | | Pre-kor | Lagdelt progresjon | Intensiverte kamerabevegelser, økt fargemetning, økt visuell kompleksitet | | Kor | Topp energi/følelser | Mest dramatiske bilder, dristigste farger, dynamiske opptak, fullskala visuelt spektakel | | Bro | Overgang/refleksjon | Helt distinkt visuell stil. Ny fargepalett. Langsommere bevegelse. | | Coda | Konvergens, fade-out | Går tilbake til introens visuelle stil med en følelse av oppløsning. Mykgjøring. Fade-out. |

Generer separate instruksjoner for hvert avsnitt individuelt, og rediger og sett dem sammen. Denne segmenterte tilnærmingen gir et mer dynamisk resultat som passer bedre til musikken sammenlignet med å generere ett enkelt langt fragment.

Segmentbasert generering: Lag forskjellige visuelle effekter for refreng, vers og bro.

Basert på konseptet om emosjonell synkronisering innebærer den praktiske teknikken med segmentert generering å lage uavhengige AI-videosegmenter for hver musikalske passasje, som deretter settes sammen i tidslinjeeditoren.

Arbeidsflyt:

- Analyser sangstrukturen. Merk tidsstemplene for hver seksjon (Vers 1: 0:00-0:30, Refreng 1: 0:30-0:55, Vers 2: 0:55-1:25, osv.)

- Skriv unike visuelle instruksjoner for hver seksjon. Oppretthold visuell kontinuitet gjennom konsistente stilistiske beskrivelser (identiske fargevalg, felles visuelle kvalitetsnøkkelord) mens du varierer scener, opptak og energinivåer

- Lag separate klipp for hver seksjon i Seedance. Tilpass klippets varighet til seksjonens lengde

- Importer alle klippene til videoredigeringsprogramvare (ShineEdit, DaVinci Resolve, Premiere). Juster hvert klipp med den tilsvarende musikalske delen.

- Legg til overganger mellom delene: kryssfading for jevne overganger, harde kutt for dramatiske skift og raske panoreringer for overganger med høy energi.

- Eksporter den sammensatte tidslinjen som din endelige musikkvideo.

Denne metoden gir deg størst mulig kontroll over forholdet mellom lyd og bilde. Selv om det innebærer en større arbeidsbelastning enn generering i ett trinn, blir resultatene betydelig mer dynamiske og bedre tilpasset musikken.

Referansevideo: Bruke eksisterende musikkvideostiler som input

Hvis det finnes en eksisterende musikkvideo hvis visuelle stil, kamerabevegelser eller redigeringsrytme du beundrer, kan du bruke den som referanse for å veilede AI-genereringen.

Hvordan bruke referanse-MV:

- Velg en musikkvideo eller et videoklipp som gjenspeiler den visuelle stilen du ønsker.

- Last den opp som referansevideo i Seedance.

- AI-en analyserer referansens kamerabevegelser, komposisjon, fargevalg, redigeringsrytme og bevegelsesdynamikk.

- Det genererte resultatet arver disse stilistiske elementene, samtidig som det skaper helt originalt innhold.

Denne teknikken er spesielt nyttig når kunder eller samarbeidspartnere sier: «Jeg vil ha den samme følelsen som i den videoen» – du kan bruke referansen deres direkte som input, i stedet for å prøve å oversette visjonen deres til prompt-språk.

Viktig merknad: AI genererer originalt visuelt innhold inspirert av referansestilen. Det kopierer eller gjengir ikke referansevideoen. Resultatet er unikt innhold som deler stilistiske elementer med referansen.

Ofte stilte spørsmål

Kan AI virkelig generere en komplett musikkvideo?

Absolutt, men man må forstå betydningen av «fullstendig» i 2026. AI kan generere videoklipp med synkronisert lyd – inkludert lydeffekter, bakgrunnsmusikk og leppesynkronisert sang – som ser profesjonelle ut og høres profesjonelle ut. For atmosfæriske, stiliserte eller abstrakte musikkvideoer på mellom 30 sekunder og 2 minutter kan AI-genererte resultater faktisk publiseres direkte. For lengre, narrativdrevne musikkvideoer som krever spesifikke skuespillere og kompleks koreografi, er AI utmerket til å produsere råopptak av høy kvalitet, men det er en stor fordel å ha menneskelig redigering, sekvensering og etterproduksjon. Denne teknologien kan best forstås som et produksjonsverktøy som håndterer 80–90 % av arbeidsmengden, snarere enn en erstatning for et helt produksjonsteam med ett klikk.

Hvilken er den beste AI-musikkvideogeneratoren for 2026?

Seedance 2.0 er den mest omfattende AI-musikkvideogeneratoren i 2026. Den integrerer på en unik måte alle tre kjernefunksjonene for audiovisuell innhold i én enkelt plattform: generering av lydeffekter, AI-lydspor og flerspråklig leppesynkronisering (med støtte for åtte språk, inkludert kinesisk). — kombinert med visuell generering av høy kvalitet (opptil 2K-oppløsning, 2 minutters varighet). Kinesiske brukere har ytterligere fordeler: som et ByteDance-produkt er Seedance direkte tilgjengelig i Kina og støtter Alipay og WeChat Pay. Google Veo 3 utmerker seg i omgivelseslyd, men mangler leppesynkronisering og krever VPN. Pika tilbyr bare grunnleggende lydeffekter. Kaiber spesialiserer seg på abstrakt musikkvisualisering.

Må man ha sin egen musikk for å lage AI-musikkvideoer?

Det er ikke nødvendig. Du har tre alternativer. For det første kan du bruke Seedances innebygde soundtrackgenerator for å få AI-en til å lage bilder og musikk samtidig. For det andre kan du bruke gratis AI-musikkgeneratorer (som Suno internasjonalt, eller innenlandske alternativer som SkyMusic og NetEase Tianyin) for å lage originale komposisjoner, og deretter importere disse til Seedance som lydreferanser. For det tredje kan du laste opp dine egne originale eller lisensierte musikkspor. Alle tre tilnærmingene gir komplette audiovisuelle resultater. Valget ditt avhenger av hvor mye kontroll du ønsker over musikkvirkningene.

Hvordan brukes AI-leppesynkronisering i musikkvideoer?

AI-leppesynkroniseringsanalyse undersøker lydinnholdet i vokalspor – identifiserer hvilke fonemer som forekommer på bestemte tidspunkter – og genererer tilsvarende munnformer, kjeveposisjoner og mikrouttrykk i ansiktet på videokarakterer. For sang betyr dette at karakterens munn åpnes bredere under høye toner og vokaler, smalner under konsonanter og opprettholder tidsmessig samsvar med vokalrytmen. Seedance støtter leppesynkronisering på åtte språk (inkludert kinesisk) og finjusterer munnvokabularet for hvert språks fonetiske system. Kinesisk leppesynkronisering gjør det mulig for AI-figurer å fremføre kinesiske tekster med presisjon, noe som åpner for et enormt kreativt potensial for Bilibilis coverlåter og anime-fellesskap. Optimale resultater oppnås med klare vokalspor med moderat tempo og minimal instrumentell bakgrunnsforstyrrelse.

Kan AI-generert musikk brukes kommersielt?

På Seedance-plattformen, ja. Musikk generert i Seedance utgjør originalt AI-laget innhold – ikke samplet eller avledet fra opphavsrettsbeskyttede spor. Under det betalte abonnementet beholder du kommersielle bruksrettigheter for det genererte resultatet, inkludert lydkomponenten. Dette betyr at du kan tjene penger på AI-genererte musikkvideoer på Bilibili/YouTube, bruke dem i kommersielle annonser og distribuere dem på ulike plattformer uten å bekymre deg for brudd på opphavsretten.

Viktige hensyn vedrørende det kinesiske lovverket: I henhold til Kinas midlertidige tiltak for administrasjon av generative kunstig intelligens-tjenester er det ved bruk av AI-generert innhold til kommersielle aktiviteter avgjørende å sikre at slikt innhold ikke krenker andres immaterielle rettigheter. Videre kan det i spesifikke situasjoner være nødvendig å merke innholdet som AI-generert. Det anbefales å gjøre seg kjent med de nyeste policykravene før storstilt kommersiell bruk. Kontroller alltid de spesifikke vilkårene for bruk av verktøyene du benytter, da lisensbestemmelsene varierer mellom ulike plattformer.

Hvor lange kan AI-musikkvideoer være?

Seedance støtter generering av klipp på opptil 2 minutter. For lengre musikkvideoer anbefaler vi å bruke en segmentert genereringsmetode: lag separate klipp for forskjellige deler av sangen (vers, refrenger, broer), og sett dem sammen i videoredigeringsprogrammet. En sang på 3–4 minutter krever vanligvis 3–6 uavhengig genererte segmenter. Denne segmenterte tilnærmingen gir faktisk bedre resultater sammenlignet med en enkelt utvidet generering, da hvert segment får sin egen optimaliserte visuelle prompt.

Hvordan er lydkvaliteten i AI-genererte musikkvideoer?

Kvaliteten på AI-generert lyd har nå nådd en standard som er egnet for online distribusjon på alle større plattformer. Output leveres i CD-kvalitet stereo (44,1 kHz, 16-biters ekvivalent). Lyden er ren, godt mikset og fri for de merkbare artefaktene som var vanlige i tidligere AI-lydsystemer. Hvis innholdet ditt er ment for profesjonelle musikkdistribusjonsplattformer (NetEase Cloud Music, QQ Music, KuGou Music, Spotify, Apple Music), anbefales det imidlertid å behandle lydkomponenten ved hjelp av spesialiserte AI-musikkverktøy (som Suno eller SkyMusic) før du importerer den til Seedance for visuell generering. Profesjonelle musikk-AI-verktøy tilbyr for tiden litt bedre lydkvalitet sammenlignet med integrerte video-lydgeneratorer.

Hvordan forhindre audiovisuell desynkronisering?

Tre teknikker kan minimere synkroniseringsproblemer. For det første bør du holde de enkelte genererte klippene under 30 sekunder – kortere segmenter gir bedre synkronisering. For det andre bør du bruke eksplisitte rytmiske signaler i visuelle instruksjoner (f.eks. «langsom, bevisst bevegelse» for langsomme spor; «rask, energisk bevegelse» for raske spor) for å tilpasse det visuelle tempoet til lydtempoet. For det tredje, hvis det oppstår mindre tidsavvik i resultatet, finjusterer du timingen ved hjelp av videoredigeringsprogramvare – å forskyve lydsporet med 50–100 millisekunder kan korrigere merkbar desynkronisering. For å oppnå nøyaktig leppesynkronisering må du sørge for at kildelyden er ren og rytmisk tydelig, da tvetydig eller overlappende tale utgjør større utfordringer for presis AI-synkronisering.

Hvilket råd vil du gi for å publisere AI-musikkvideoer på Bilibili?

Bilibili er en av Kinas største plattformer for lange videoer og musikkvideoer, og det er flere viktige punkter å ta hensyn til når man publiserer AI-genererte musikkvideoer. For det første må man velge riktig kategori – Music Zone (musikkkompilering/coverversjoner/originalmusikk/elektronisk musikk) eller Parody Zone (hvis innholdet er humoristisk). For det andre må du lage cover og titler av høy kvalitet, da Bilibilis anbefalingsalgoritme legger stor vekt på klikkfrekvensen på coveret. For det tredje må du inkludere kinesiske undertekster/tekster, som ikke bare hjelper forståelsen, men også er standardforventningen blant Bilibili-brukere. For det fjerde må du tydelig oppgi hvilket AI-genereringsverktøy som er brukt i beskrivelsen, da Bilibili-samfunnet verdsetter åpenhet. For det femte må du utnytte Bilibilis kolonnefunksjon til å publisere medfølgende tekstbaserte MV-produksjonsveiledninger, som kan generere ekstra trafikk.

Begynn å lage AI-musikkvideoer nå

Konvergensen mellom AI-video og AI-lyd er ikke en fremtidig mulighet, men en realitet i dag. Verktøyene finnes allerede, med en kvalitet som oppfyller publiseringsstandarder for de fleste applikasjoner, og til en brøkdel av kostnaden for tradisjonell musikkvideoproduksjon.

Enten du er en uavhengig musiker som drømmer om en skikkelig musikkvideo for arbeidet ditt, en innholdsskaper som bygger en lo-fi-musikkkanal på Bilibili, et markedsføringsteam som trenger bakgrunnsmusikk til produktvideoer, eller noen som produserer videoinnhold som krever lydakkompagnement, er denne teknologien nå klar.

Neste trinn:

- Gå til Seedance Video Generation

- Last opp musikksporet ditt (eller la AI generere et)

- Skriv visuelle instruksjoner som passer til stemningen i sangen din

- Velg lydmodus (lydeffekter, lydspor eller leppesynkronisering)

- Generer din første AI-musikkvideo

- Publiser på Bilibili, TikTok, Xiaohongshu, NetEase Cloud Music

Lag din første AI-musikkvideo gratis -->

Registrer deg nå for å motta gratis kreditt. Ingen kredittkort kreves. Betalte abonnementer inkluderer innhold uten vannmerke. Full kommersiell bruksrett gis. Kan brukes direkte i Kina, støtter Alipay/WeChat Pay.

Tiden med lydløse AI-videoer er over. Alle videoer du lager fra nå av kan ha lyd, soundtrack og sjel.

Videre lesning: Hva er Seedance AI Video Generator | Seedance vs Veo 3 sammenligning | Den komplette guiden til tekst-til-video-AI | AI-videoguide for YouTube-skapere | AI-video for e-handelsproduktvideoer | Seedance Prompt Guide og eksempler | Sammenligning av de beste AI-videogeneratorene for 2026*