Oversikt

Den mest effektive måten å lage AI-videoer på er ikke bare å legge inn en beskrivelse i tekst-til-video-verktøy. I stedet bør du starte med et nøye utarbeidet bilde.

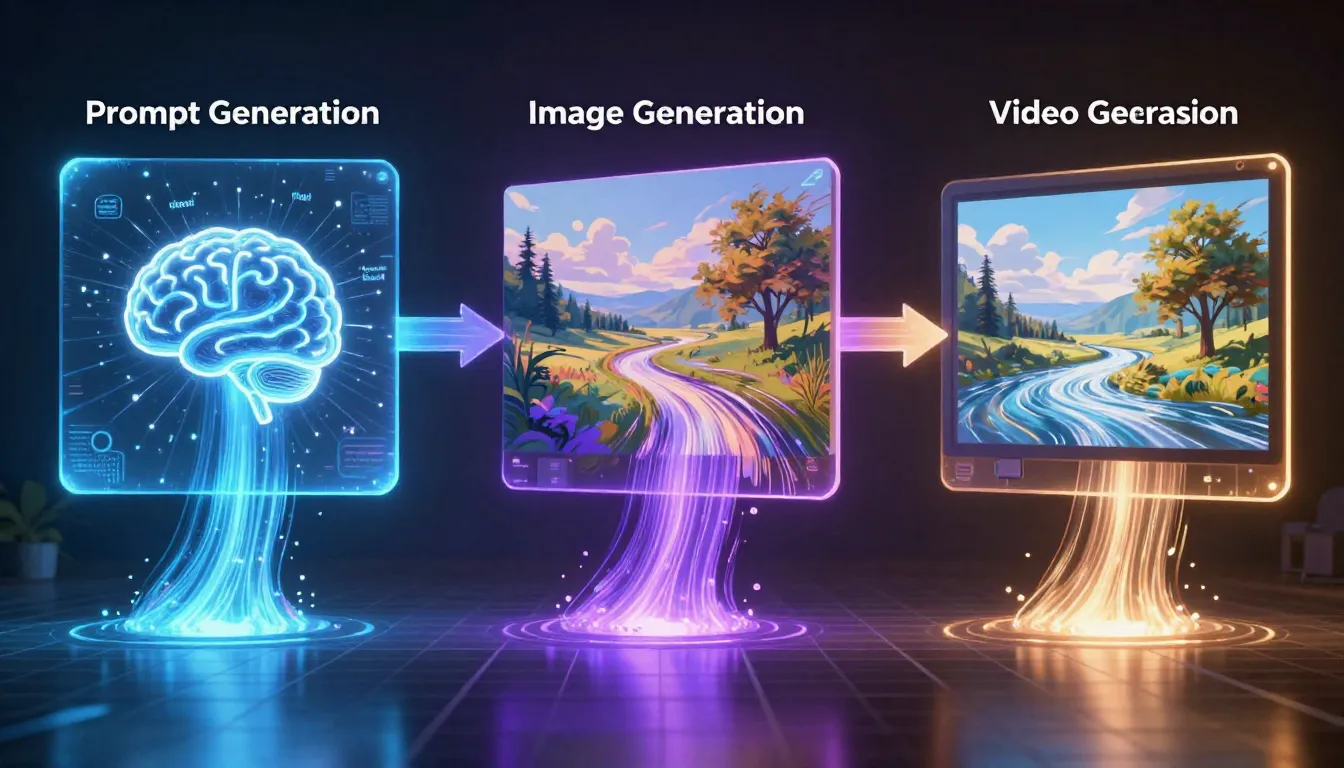

Tre-trinns prosess — prompt → bilde → video — gir resultater som langt overgår tekst-til-video-generering alene. Først lager du en profesjonell prompt. Bruk denne prompten til å generere et bilde med presis komposisjon. Deretter legger du dette bildet inn som første bilde i en videogenerator. Resultatet: du får presis kontroll over visuelt innhold, lyssetting, komposisjonsdetaljer og startpunktet for bevegelse.

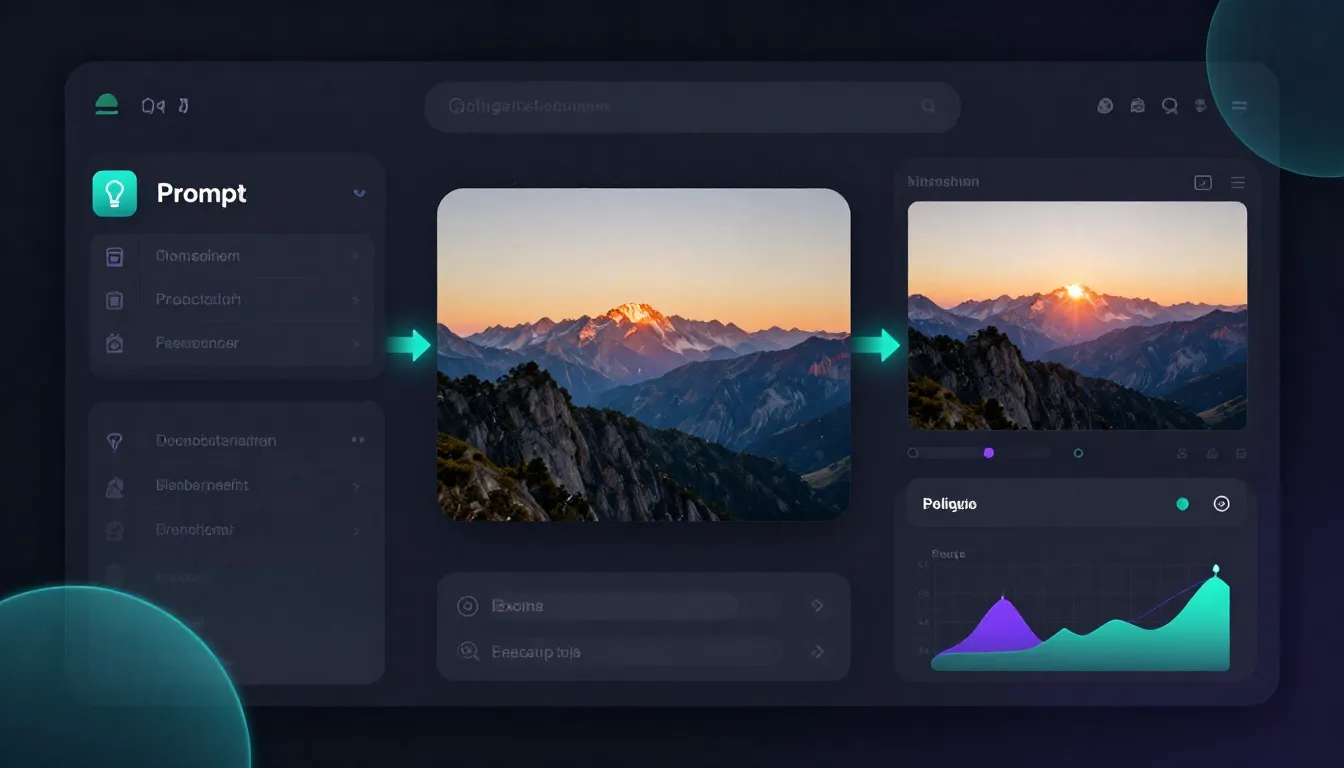

Seedance er det eneste verktøyet som integrerer alle tre trinnene i en enkelt plattform: Image Prompt Generator hjelper deg med å lage profesjonelle instruksjoner, Text-to-Image genererer referansebilder av høy kvalitet, og Image-to-Video forvandler bilder til filmiske videoklipp. Du trenger ikke bytte verktøy, laste ned og laste opp på nytt – fra inspirasjon til ferdig produkt, alt gjøres i én sømløs prosess.

Trinn 1: Generer prompt → | Trinn 2: Generer bilde → | Trinn 3: Generer video →

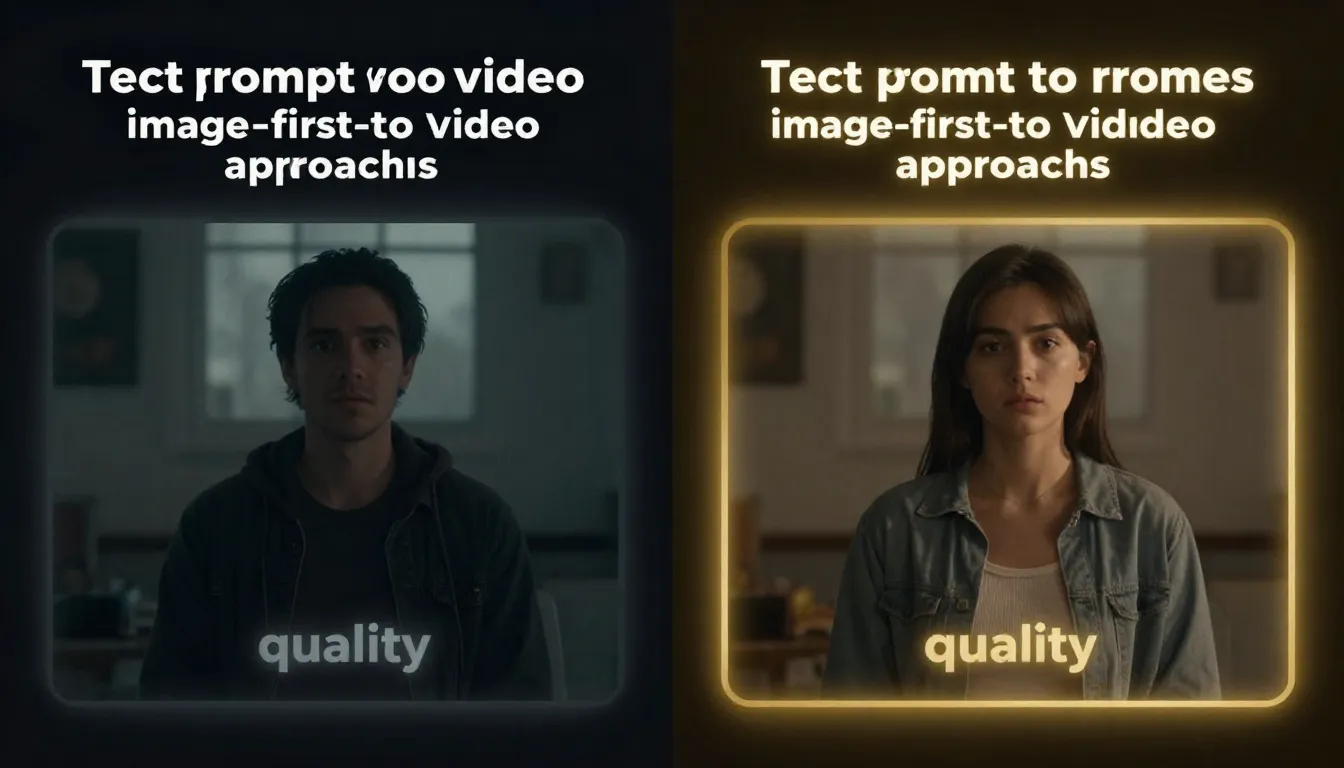

Venstre: Ren tekst-til-video-generering — tilfeldig komposisjon, ukontrollerbare bilder. Høyre: Bildet først-prosess — finpuss bildene først, legg deretter til bevegelse; presis komposisjon, jevn kvalitet.

Hvorfor «bilde først, video senere» gir langt bedre resultater enn tekst-til-video-konvertering

De som har brukt Wensheng Video kjenner til opplevelsen: du skriver en detaljert beskrivelse – som dekker tema, belysning, kameravinkel og komposisjon – men det AI-genererte opptaket ligner ikke på din visjon. Karakterene vender feil vei, belysningen er flat, komposisjonene virker tilfeldig genererte, og rollene stemmer ikke overens med beskrivelsen.

Dette er ikke en feil i et bestemt verktøy, men snarere en strukturell begrensning som er innebygd i tekst-til-video-tilnærmingen.

De iboende begrensningene ved videobasert innholdsproduksjon

Wensheng Video krever at AI utfører to ekstremt utfordrende oppgaver samtidig: generere bilder og generere bevegelse. Modellen må tolke teksten din, bestemme utseendet til hver piksel, komponere scenen, angi belysning og skygger, fastsette kameraposisjonen og deretter generere sammenhengende bevegelse basert på alt dette – alt fra en enkelt tekst.

Resultatet er at alle dimensjoner er utenfor kontroll:

- Tilfeldig komposisjon. Du skriver «en kvinne som står midt i gaten», men hun havner i venstre tredjedel, med halvparten av bildet dominert av unødvendige bygninger.

- **Inkonsekvente karakterer. ** Ansiktsstruktur, klær, frisyre og kroppsproportjoner varierer fra generasjon til generasjon. AI-en leverer «kreative tolkninger», ikke dine spesifikasjoner.

- **Ukontrollert belysning. ** Selv om du spesifiserer «gylden time, varm belysning fra venstre», gir det svært inkonsekvente resultater. AI-ens tolkning av belysningsbeskrivelser er fortsatt grunnleggende vag.

- Upålitelig innramming. Nærbilder, mellomstore bilder, helfigurbilder – tekst-til-video-verktøy tolker disse begrepene med ekstrem ustabilitet. Be om et ekstremt nærbilde, og det leverer et helfigurbilde.

For utforskende kreative eksperimenter kan denne usikkerheten være en del av moroa. Men hvis du trenger kontrollerte, pålitelige profesjonelle resultater, blir det en fatal feil.

Den viktigste fordelen med bildeprioritet

TuSheng Video har snudd denne ligningen fullstendig på hodet. Du trenger ikke lenger AI for å generere både bilder og bevegelse samtidig; i stedet skiller du de to oppgavene:

- Begynn med bildet. Motiv, komposisjon, belysning, farge, innramming – du har full kontroll og kan gjenta prosessen til du oppnår perfeksjon.

- Deretter legger du til bevegelse. AI-ens eneste oppgave er å animere det perfekte bildet ditt. Den trenger ikke å tyde vage beskrivelser eller ta kompositoriske beslutninger, men genererer i stedet bevegelse ut fra dine konkrete visuelle referansepunkter.

Denne fokusseparasjonen gir overlegne resultater på alle områder:

- Komposisjon låst. Motivet forblir nøyaktig der du plasserte det.

- Karakterkonsistens. Ansiktsdrag, antrekk og proporsjoner forblir identiske med kildebildet gjennom hele prosessen.

- **Belysning og skygger bevares. ** Lysretning, tekstur og fargetemperatur arves fullt ut fra bildet.

- Fast innramming. Kameraposisjon og synsvinkel forblir konsistente med bildets opprinnelige oppsett.

For å illustrere: tekst-til-video kan sammenlignes med å beskrive en filmscene over telefonen og be noen om å filme den. Bilde-til-video er derimot som å vise noen et fotografi og si: «Gi dette bildet liv.» Den sistnevnte tilnærmingen gir mer kontrollerbare resultater av høyere kvalitet, da AI-en mottar konkrete visuelle referanser i stedet for abstrakte tekstbeskrivelser.

Kvalitetens multiplikatoreffekt

Fordelene er kumulative. En nøye utformet åpningsramme forbedrer alle aspekter av videoen:

- Forbedret tidsmessig konsistens — Modellen har visuelle ankerpunkter av høy kvalitet for å opprettholde sammenheng gjennom hele sekvensen.

- Forbedret bevegelseskvalitet — Modellen trekker nøyaktig ut dybde, belysning og romlig informasjon fra klare kildebilder.

- Forbedret stilistisk konsistens — Fargesystemer, stemninger og estetikk er direkte innebygd i bildene, slik at det ikke er rom for tekstuell tolkning.

- Redusert feilprosent — Modellen starter med rene, høyoppløselige visuelle data i stedet for å syntetisere alt fra støy.

Høykvalitetsvideoer generert fra første bilde viser betydelig overlegenhet i forhold til videoer generert utelukkende fra tekst med identiske instruksjoner når det gjelder visuell kvalitet, tidsmessig kontinuitet og estetisk appell. Dette er ingen subtil forskjell – det representerer kløften mellom «underholdende AI-demonstrasjoner» og «profesjonelt brukbart innhold».

For en grundig gjennomgang av hvordan du designer bilder spesielt for videoproduksjon, se Veiledning for design av første og siste bilde.

Tre-trinns AI-kreativ prosess

Hele arbeidsflyten er delt inn i tre trinn, som hver bygger på det forrige. Hvis et trinn håndteres uforsiktig, vil det til slutt gå ut over det endelige resultatet. Det er viktig å forstå bidraget fra hvert trinn – og hvor man bør bruke tid – for å kunne produsere AI-video av høy kvalitet på en jevnlig basis.

Fase én: Generering av spørsmål

Alt begynner med oppgaven. Middels oppgaver → middels bilder → middels videoer. Fremragende oppgaver → fantastiske bilder → fantastiske videoer. Kvaliteten på oppgaven er den største variabelen i kvaliteten på det endelige resultatet, og det er også den fasen som det investeres minst i i de fleste arbeidsflyter.

Problemet med å skrive instruksjoner manuelt. De fleste tilnærmer seg instruksjonsskriving som om det var å lage søkeord: kortfattet, vagt og med fokus utelukkende på emnet. «Et luksuriøst klokke, mørk bakgrunn.» Dette forteller AI-en hva den skal tegne, men gir den ingen instruksjoner om hvordan den skal tegne det. Modellen fyller ut tomrommene med standardverdier – flat belysning, sentrert komposisjon, ingen atmosfæriske detaljer, ingen stilistisk retning.

Løsning: AI-assistert generering av instruksjoner. Instruksjonsgeneratoren utvider dine grove ideer til profesjonelle instruksjoner som dekker emne, miljø, belysning, farge, komposisjon, stil og forbedringer av bildekvaliteten. Forskjellen i utskriftskvalitet mellom en manuell instruksjon på 10 ord og en generert instruksjon på 100 ord representerer et kvalitativt sprang.

Seedances Image Prompt Generator gjør nettopp det. Skriv inn en kort beskrivelse, for eksempel «luksuriøs klokkereklame, mørk og dramatisk», velg en stil (fotorealistisk, filmisk, illustrativ osv.), og AI-en genererer umiddelbart en komplett profesjonell prompt. Hele prosessen tar bare noen sekunder og koster 2 kreditter per prompt. For en omfattende guide til generering av prompt, se AI Image Prompt Generator Guide.

Hvorfor dette trinnet er så viktig. Prompten er DNA-et til hele prosessen. Den bestemmer stilen, stemningen, komposisjonen og kvalitetsnivået for alt som følger etterpå. Å bruke fem minutter på å finpusse prompten før du genererer bilder, kan spare deg for tretti minutter med gjentatte justeringer av middelmådige resultater senere.

Fase to: Bildegenerering

Når du har mottatt den profesjonelle instruksen, er neste trinn å generere bildet som skal fungere som videoens åpningsbilde. Her går du over fra tekst til bilder, og markerer det stadiet hvor mest tid bør investeres i iterasjon.

Fra prompt til bilde. Lim inn den genererte prompten i tekst-til-bilde-verktøyet og klikk på «Generer». Evaluer resultatet: Er komposisjonen egnet for video? Er belysningen tilstrekkelig lagdelt? Ser motivet riktig ut? Gir scenen en følelse av dybde?

Hvis du allerede har et referansebilde eller ønsker å finjustere eksisterende genereringsresultater, er image-to-image verktøyet for deg. Last opp det eksisterende bildet ditt og beskriv de ønskede endringene – dette er spesielt effektivt for kompositoriske iterasjoner: juster belysningen, legg til atmosfæriske effekter eller endre innholdet i scenen uten å starte fra bunnen av. For en omfattende guide til Image-to-Image-arbeidsflyten, se Image-to-Image AI Guide.

Design bilder for bruk i videoer. Ikke alle visuelt tiltalende bilder egner seg som åpningsbilde for en video. Når du lager bilder for bruk i pipeline, må du huske på følgende komposisjonsprinsipper:

- La det være negativt rom i bevegelsesretningen. Hvis en karakter beveger seg fra venstre til høyre, plasser henne litt mot høyre i bildet.

- Inkluder dybdenivåer. Bilder med tydelige elementer i forgrunnen, mellomgrunnen og bakgrunnen skaper bedre parallakseffekter og mer naturlige kamerabevegelser i videoen.

- **Tenk på retningen på kamerabevegelsen. ** Hvis du planlegger å bruke «push»-bevegelse, må du sørge for at komposisjonen ser bra ut både i den nåværende beskjæringen og i en strammere beskjæring sentrert på motivet.

- Unngå store tekstblokker eller symmetriske mønstre. Slike elementer er vanskelige å animere naturlig og utsatt for artefakter.

- **Bruk retningsbestemt belysning. ** Sterk retningsbestemt belysning med synlige skygger gir en mer filmisk videoeffekt enn flat belysning.

Kjerneprinsipp: Bruk tid på å få bildene dine riktige. Hvert minutt du bruker på å perfeksjonere bildene dine, sparer deg for flere ganger så mye tid i videoproduksjonsfasen. Et feilfritt første bilde betyr at videoen din kan brukes fra første forsøk. Et feilaktig første bilde kan kreve flere regenereringer (som hver forbruker kreditt og tid) uten at det er noen garanti for et tilfredsstillende resultat.

Før du begynner å generere video, bør du gå gjennom bildene 3–5 ganger. Dette er ikke perfeksjonisme – det er effektivitet.

For en omfattende guide til tekst-til-bilde-generering (inkludert teknikker for å gi instruksjoner og sammenligning av verktøy), se Den komplette guiden til tekst-til-bilde-AI. For en oversikt over de beste verktøyene for bildegenerering, se De beste AI-bildegeneratorene for 2026.

Generer bildet ditt → | Finjuster bilde-til-bilde →

Trinn tre: Videoproduksjon

Dette er fasen hvor du høster fruktene av arbeidet ditt. De polerte bildene du har finpusset, danner utgangspunktet for dine animerte videoklipp.

Last opp et bilde som første ramme. Last opp det genererte bildet til Seedances [Image-to-Video]-verktøy. Verktøyet henter bilder direkte fra genereringshistorikken din – du trenger ikke å laste ned og laste opp på nytt.

Beskriv bevegelsen med ord. Skriv en beskrivelse av bevegelsen du ønsker – ikke beskriv det visuelle (bildet er allerede behandlet). Fokuser på:

- Kamerabevegelse: «langsom dolly inn» 、forsiktig panorering til venstre、jevn bevegelse rundt motivet

- Motivets handling: «kvinnen snur hodet sakte»、blomsterbladene faller ned、damp stiger opp fra koppen

- Bevegelse i omgivelsene: «skyene beveger seg sakte», «vannet kruser utover», «bladene svaiende forsiktig i brisen»

- ** Atmosfære**: «dramatisk atmosfære», «drømmende, eterisk kvalitet», «filmisk tempo»

Generer og gjennomgå. AI-en mottar bildene og bevegelsesinstruksjonene dine, og produserer videosegmenter som starter nøyaktig fra første bilde og utspiller seg i henhold til bevegelsesinstruksjonene dine. Siden du kontrollerer det visuelle utgangspunktet, blir resultatet forutsigbart og konsistent. Videokvaliteten arver bildekvaliteten – et klart, godt opplyst og nøyaktig komponert første bilde gir direkte et klart, godt opplyst og nøyaktig komponert video.

For avanserte teknikker for bevegelseskontroll og paring av første/siste bilde, se Veiledning for design av første og siste bilde. For en omfattende introduksjon til Image-to-Video AI, se Veiledning for Image-to-Video AI.

Tre-trinns prosess i praksis: Omform korte beskrivelser til profesjonelle instruksjoner, omform instruksjoner til bilder av høy kvalitet, og konverter bilder til dynamiske videoer. Hvert trinn forbedrer kvaliteten på det forrige.

Seedance-fordel: Tre trinn, fullføring på ett sted

I dag bruker de fleste skapere som setter sammen denne prosessen tre eller fire verktøy. De bruker ChatGPT eller Claude til å skrive bildeprompter, bytter til Midjourney eller Tongyi Wansheng for bildegenerering, laster ned bildet, åpner Ke Ling eller Runway, og laster det deretter opp for å generere video. Hvert bytte innebærer et annet grensesnitt, andre kontoer, andre faktureringssystemer og andre begrensninger.

Denne fragmenterte arbeidsflyten er ikke bare plagsom, den går aktivt ut over kvaliteten.

Hvordan bytte av verktøy går ut over kvaliteten

Hver gang et bilde overføres mellom verktøy, oppstår det forringelse. Nedlastings- og opplastingssyklusen introduserer komprimeringsartefakter. Formatkonverteringer (PNG til JPG, WebP til PNG) endrer fargeverdiene. Oppløsningen kan bli resamplert. Metadata om hvordan bildet ble generert – informasjon som kunne ha hjulpet videomodellen med å produsere bedre resultater – blir fullstendig fjernet.

I tillegg til datakvalitet er det også kognitiv overhead. Hvert verktøy har sin egen kommandosyntaks, forskjellige utdatainnstillinger og ulike alternativer for bildeforhold. Du kaster bort tid på å gjøre deg kjent med grensesnitt i stedet for å bruke den på kreative iterasjoner.

Integrert rørsystem

Seedance eliminerer all slik friksjon ved å tilby alle tre trinnene innenfor en enkelt plattform:

1. Bildegenerator (/image-prompt-generator). Skriv inn ditt kreative konsept, velg mellom 12 stiler, og motta en komplett profesjonell prompt. De genererte promptene er optimalisert for Seedance-bildegenereringsmodellen, men passer like godt for alle AI-malerverktøy.

2. Tekst til bilde og bilde til bilde (/text-to-image | /image-to-image). Generer bilder fra instruksjoner eller gjør målrettede endringer i eksisterende bilder. Produser raskt flere varianter. Når du har funnet den rette komposisjonen, er den klar til å gå videre til neste trinn.

- Bilde til video Velg et hvilket som helst forhåndsgenerert bilde fra biblioteket ditt og send det direkte til videogeneratoren. Ingen nedlastinger, ingen opplastinger, ingen formatkonverteringer nødvendig. Bilder i full oppløsning overføres uten tap.

Hvorfor gir integrering bedre resultater?

Dette er ikke bare en praktisk funksjon; integrasjon gir virkelig overlegne resultater:

- Ingen tap ved overføring. Bilder overføres i full oppløsning mellom trinnene, uten komprimering eller resampling.

- Konsistent modelløkosystem. Bild- og videogenereringsmodeller er kalibrert for innebygd kompatibilitet. Bilder produsert av Seedances tekst-til-bilde-modell er innebygd tilpasset Seedances videomodell.

- **Enhetlig kredittsystem. ** Du trenger ikke å ha tre separate abonnementer. Kredittene dine er universelle for alle tre verktøyene, noe som gjør budsjettfordelingen enkel og gjennomsiktig.

- Raskere iterasjonssykluser. Tiden fra «Jeg vil redigere dette bildet» til «Jeg ser på den nye videoen» reduseres fra minutter brukt på å bytte verktøy til bare sekunder med sømløs integrering.

- **Oppretthold den kreative flyten. ** Hold deg innenfor ett enkelt grensesnitt for å bevare tankekonteksten din. Fokuser på det kreative konseptet i seg selv, ikke på filhåndtering eller verktøynavigering.

For å være ærlig: du kan godt bruke ChatGPT til å skrive instruksjoner, Midjourney eller Tongyi Wansheng til å generere bilder og Keling eller Runway til å lage videoer for å bygge en høykvalitets pipeline. Mange profesjonelle gjør nettopp det. Seedances fordel ligger ikke i at noen enkelt trinn overgår konkurrentene – den ligger i integrasjonen som eliminerer friksjonen som får de fleste skapere til å gi opp prosessen halvveis. Den beste arbeidsflyten er den du faktisk gjennomfører fra start til slutt.

Seedance integrerer hurtiggenerering, bildegenerering og videogenerering i én enkelt plattform. Fra konsept til ferdig video er det ikke nødvendig å bytte verktøy, laste ned filer eller administrere flere kontoer.

Komplett praktisk guide: 3 case-studier fra virkeligheten

Teori er nyttig, men praksis gir resultater. Nedenfor finner du tre komplette pipeline-øvelser – hver med forskjellige kreative mål, ulike stiler og varierte bildeforhold. Følg med for å bygge din første komplette pipeline.

Tilfelle 1: Filmisk produktannonse

Mål: Produsere en fem sekunders reklamefilm for luksuriøse klokker til produktpresentasjonssiden.

Fase én — Generering av spørsmål

Åpne Image Prompt Generator og skriv inn konseptet ditt.

Inndata: «luksuriøs klokkereklame, mørk og dramatisk»

Velg stil: Fotorealistisk

Generert prompt:

A luxury men's wristwatch resting on a slab of dark emperador marble,

shot from a low three-quarter angle. Dramatic studio lighting: a single

hard key light from the upper left creates sharp reflections on the

polished steel case and sapphire crystal. The watch face shows 10:10

with luminous indices glowing faintly. Deep shadows pool around the

base, enhancing the sense of weight and prestige. Background is pure

black, fading to subtle charcoal gradient. Microscopic dust particles

float in the key light beam. Color palette: silver, deep charcoal,

amber highlights from the lume. Photorealistic product photography,

8K resolution, razor-sharp detail on every dial marking and link.Å lage denne prompten manuelt ville ta minst 10–15 minutter. En promptgenerator gjør det på få sekunder og dekker alle syv dimensjoner av profesjonelle prompter: motiv, miljø, belysning, farge, komposisjon, stil og bildekvalitet.

Fase to — Bildegenerering

Lim inn den genererte prompten i text-to-image. Generer med et sideforhold på 16:9 for å passe til liggende videorammer.

Første gjengivelse: Den generelle komposisjonen er god, men marmoroverflaten reflekterer litt for sterkt, noe som trekker oppmerksomheten bort fra klokken.

Iterasjon: Finjuster ved hjelp av Image-to-Image. Last opp det opprinnelige genererte bildet med følgende instruksjon: «Reduser intensiteten på refleksjonen i marmoroverflaten. Øk skarpheten på detaljene på urskiven. Gjør bakgrunnsgradienten litt dypere.»

Andre opptak: Klokken står i sentrum, badet i dramatisk lys og skygge, med en lagdelt komposisjon. Klar til å gå videre til videofasen.

Fase tre — Videoproduksjon

Send de polerte bildene til Image-to-Video.

Øvelsesoppgaver:

The camera executes a slow, smooth orbiting movement around the watch,

revealing different angles of the case and bracelet. The key light

shifts subtly as the camera moves, creating dynamic reflections across

the polished surfaces. Dust particles drift slowly through the light

beam. Cinematic, premium commercial pacing. Steady, professional

camera movement.(Kameraet panorerer sakte og jevnt rundt klokken, og viser forskjellige vinkler av boetten og remmen. Når kameraet beveger seg, skifter hovedlyskilden subtilt, og skaper dynamiske refleksjoner på de polerte overflatene. Støvpartikler svever forsiktig i lysstrålen. Filmisk, eksklusiv reklametempo. Jevn, profesjonell kamerabevegelse.)

Leveranser: En polert 5-sekunders produktpresentasjon – som starter med din nøye komponerte ramme, og glir jevnt rundt klokken. Dramatisk belysning, skarpe detaljer og førsteklasses teksturer går sømløst fra kildebildene gjennom hvert bilde i videoen.

Case 1: Reklamering for luksuriøse klokker. Fra en kortfattet konseptbeskrivelse på fem ord til en polert produktvideo på fem sekunder – en tre-trinns prosess som leverer resultater av kommersiell kvalitet.

Tilfelle 2: Reiseinnhold på sosiale medier

Mål: Produsere en vertikal video som fanger soloppgangen ved et japansk helligdom for TikTok/Instagram Reels.

Fase én — Generering av spørsmål

Åpne Image Prompt Generator.

Inndata: «Soloppgang ved japansk tempel, fredelig morgen»

Velg stil: Fotorealistisk

Generert prompt:

A traditional Japanese wooden temple (Kiyomizu-dera style) nestled

among ancient cedar trees, photographed at dawn. Golden sunrise light

filters through morning mist, casting long warm shadows across the

temple's wooden veranda. Cherry blossom branches frame the upper

portion of the composition, with delicate pink petals catching the

first light. A stone lantern stands in the foreground left, moss-

covered and weathered. The temple roof's curved eaves are silhouetted

against a sky transitioning from deep indigo to warm peach and gold.

Subtle mist hovers at ground level among the trees. Photorealistic

landscape photography, golden hour lighting, serene and contemplative

atmosphere, high dynamic range, rich natural color palette.Fase to — Bildegenerering

Lim inn i Tekst til bilde. Viktige innstillinger: Generer i 9:16 stående format, egnet for TikTok og Instagram Reels.

Første utkast: Atmosfæren er fantastisk, men kirsebærblomstgrenene er plassert for høyt i bildet, noe som etterlater for mye tom plass i den nedre tredjedelen.

Iterasjon: Etter å ha modifisert prompten litt og lagt til beskrivelsen «kirsebærblomstergrener som strekker seg fra øvre høyre og venstre hjørne og fyller den øvre tredjedelen av den vertikale rammen», plasserte den andre generasjonen kirsebærblomstene perfekt som en naturlig ramme for komposisjonen.

Komposisjonen egner seg perfekt til vertikal video: helligdommen trekker blikket mot midten av bildet, mens kirsebærblomstene øverst skaper visuell interesse. Steinen lanterner og tåke i forgrunnen gir dybde. Dette bildet gir mulighet for bevegelse på flere nivåer.

Fase tre — Videoproduksjon

Send til Image-to-Video.

Øvelsesoppgaver:

Gentle cherry blossom petals drift slowly downward through the frame.

Morning mist shifts and swirls at ground level among the trees. Two

birds fly across the sky in the background. The sunrise light gradually

intensifies, warming the scene. A subtle breeze moves the cherry

blossom branches slightly. Peaceful, meditative atmosphere. Slow,

contemplative pacing.Kirsebærblomsterbladene svever forsiktig gjennom bildet. Morgendisen flyter mykt over bakken mellom trærne. To fugler glir over himmelen i bakgrunnen. Soloppgangens lys blir gradvis sterkere og varmer hele scenen. En mild bris rører kirsebærblomstgrenene. En rolig, meditativ atmosfære. Et langsomt, kontemplativt rytme.

Leveranser: En 4 sekunders atmosfærisk vertikal video, perfekt egnet for TikTok og Instagram Reels. Kirsebærblomster flyter naturlig, mens morgendisen gir dybde og bevegelse. Fugler i bakgrunnen skaper subtile fokuspunkter. Kildebildets gyldne, varme toner gjennomsyrer hvert eneste bilde i videoen.

Case Study 3: Brand Narrative – Pairing the First and Last Frames

Mål: Produsere en seks sekunders merkevarefortelling som skildrer kaféens forvandling fra den stille morgenstunden til den travle, fullsatte tilstanden.

Denne saken bruker rørledningen to ganger og genererer et par bilder som består av første og siste bilde for å gi videomodellen to visuelle forankringer for å definere fortellingsbuen. For en grundig analyse av denne teknikken, se First and Last Frame Design Guide.

Fase én — To oppfordringer

Generer to sett med spørsmål fra bildespørsmålsgeneratoren.

Første bilde: «En tom kaffebar, badet i lyset fra tidlig morgen, med varme ravfarger.»

Generert prompt for første ramme:

Interior of an artisanal coffee shop in the early morning, before

opening. Warm amber sunlight streams through large front windows,

casting long golden rectangles across worn hardwood floors. Exposed

brick walls, a polished wooden counter with a brass espresso machine,

and empty mismatched chairs around small tables. A chalkboard menu

hangs behind the counter. Dust motes float in the sunbeams. The space

feels warm, inviting, and full of potential. Shot at eye level from

just inside the entrance. Photorealistic interior photography, warm

color palette, golden hour tones, cozy atmosphere.Siste bildeinnspill: «En travel kaffebar på en varm morgen, med kunder som nyter kaffen sin.»

Generert endelig rammeprompt:

The same artisanal coffee shop, now alive with morning activity.

Diverse customers sit at tables -- some reading, some talking, some

working on laptops. A barista behind the counter steams milk, creating

a plume of white steam. Coffee cups and pastries fill the tables. Warm

morning light still streams through the windows but is supplemented by

the warm glow of pendant lights. The atmosphere is bustling but cozy,

full of quiet energy and the warmth of community. Shot from the same

eye-level position just inside the entrance. Photorealistic interior

photography, warm tones, lively atmosphere.Fase to — To bilder

Generer det første bildet i tekst-til-bilde med et sideforhold på 16:9. Gjenta til den tomme kafeen fremstår som varm og innbydende, badet i rikelig gyldent morgenlys.

Den endelige rammen bruker [bilde-til-bilde]-generering. Last opp den første rammen som referansebilde og bruk den endelige rammeprompten. Dette trinnet er avgjørende – å bruke den første rammen som referanse sikrer visuell konsistens. Arkitektur, møbler, lysretning og fargevalg forblir konsistente mellom rammene, med den eneste tillegget at figurer og aktivitet inkluderes.

Gjenta det siste bildet for å sikre at gjesten fremstår naturlig og at baristaen står bak disken. Det er viktig at begge bildene fremstår som samme sted tatt på forskjellige tidspunkter, ikke to separate steder.

Fase tre — Videoproduksjon

Last opp det første bildet til Image-to-Video. På plattformer som støtter referanse til sluttbilde, last opp det siste bildet samtidig.

Øvelsesoppgaver:

Time-lapse style transition. The empty coffee shop gradually fills

with people arriving -- customers entering, sitting down, a barista

beginning to work. Morning light shifts slowly. The scene transitions

from quiet solitude to warm, bustling community. Smooth, cinematic

pacing. The camera position remains fixed.(Overgang i tidsforløpstil. En tom kafé fylles gradvis med ankommende gjester – kundene kommer inn, setter seg ned, og baristaen begynner å jobbe. Morgenlyset skifter subtilt. Scenen utvikler seg fra rolig ensomhet til en varm, livlig fellesskapsatmosfære. Jevnt, filmisk tempo. Kameraet forblir stasjonært.)

Resultat: En seks sekunders merkevarehistorie utfolder en komplett narrativ bue – oppvåkningen av en kaffebar. Åpningsbildet etablerer et rolig, innbydende rom. Sluttbildet presenterer den ønskede tilstanden. AI-genererte overganger kobler de to sammen: dører svinger opp, gjester setter seg, baristaer aktiverer espressomaskiner, og kaffekopper dukker opp på bordene. Merkevarebudskapet er diskré, men likevel kraftfullt – dette er et sted hvor man føler seg hjemme.

Eksempel 3: Merkevarefortelling som kobler sammen åpnings- og avslutningsbildene. AI genererer en tidsforløpsovergang mellom to visuelle ankere – fra morgengryets stillhet til fellesskapets varme.

Teknikker for optimalisering av rørledninger

Etter å ha produsert hundrevis av videoer gjennom denne prosessen, har følgende fem prinsipper hatt størst innvirkning på kvaliteten på resultatet.

Tips 1: Bruk 80 % av tiden din på bilder

Dette er den viktigste optimaliseringen. Bildekvaliteten er flaskehalsen gjennom hele prosessen. Et perfekt bilde vil gi en brukbar video i første generasjon. Et middelmådig bilde, uansett hvor godt utformet bevegelsesprompter er, vil bare gi en middelmådig video.

Tidsfordelingen bør være omtrent som følger:

- Promptgenerering: 5 % (generatoren tar sekunder, håndskrift tar minutter)

- Bildegenerering og iterasjon: 80 % (generer, evaluer, finjuster, regenerer til scenen er perfekt)

- Videogenerering: 15 % (last opp, skriv bevegelsesprompter, generer)

De fleste nybegynnere gjør det omvendt – de bruker ti sekunder på et bilde, og genererer deretter videoer etter hverandre, i håp om å finne en som er bra. Erfarne brukere bruker ti minutter på et bilde og får en god video etter de første par forsøkene. Den siste tilnærmingen gir bedre resultater med færre kreditter og mindre tid.

Før du begynner å generere video, gå gjennom bildene tre til fem ganger. Dette er ikke perfeksjonisme, det er effektivitet.

Tips 2: Designet for bevegelse

Et flott fotografi og et godt videobilde er ikke det samme. Når du genererer bilder for rørledninger, må du forestille deg hvordan scenen vil se ut når den blir levende.

La det være negativt rom i retning av hovedbevegelsen. Hvis en figur beveger seg fra venstre til høyre, unngå å plassere henne i midten – plasser henne litt til høyre for å gi plass til bevegelsen. Hvis kameraet panorerer mot venstre, sørg for at venstre side av bildet inneholder visuelt interessant innhold.

Komponer opptakene i henhold til kameraets retning. Push-opptak er mest effektive når det mest interessante detaljene er plassert i midten av bildet. Pan-opptak krever visuell interesse over hele bredden av bildet. Sirkulære tracking-opptak krever tredimensjonale motiver med dybde, snarere enn flate motiver.

Unngå komplekse symmetriske komposisjoner. Selv om perfekt symmetri kan være slående i fotografier, skaper det problemer for videoproduksjon. AI sliter med å opprettholde presis symmetri mellom bildene, noe som resulterer i forstyrrende rystelser. Asymmetriske komposisjoner med naturlig visuell flyt gir jevnere videoer.

Inkorporer dybdeindikatorer. Bilder med overlappende elementer i varierende avstander – forgrunnsobjekter, mellomgrunnsobjekter og bakgrunnsmiljøer – gir AI dybdeinformasjon, noe som gir forbedrede parallakseffekter og mer naturlige kamerabevegelser.

For en omfattende veiledning om utforming av bilder spesielt for video, se Veiledning for utforming av første og siste bilde.

Teknikk 3: Oppretthold konsistente sideforhold gjennom hele prosessen

Uoverensstemmende bildeforhold mellom bilder og videorammer er en av de vanligste feilene i prosessen, og fører uunngåelig til redusert utskriftskvalitet.

- 16:9 for liggende videoer (YouTube, presentasjoner, landingssider på nettsteder)

- 9:16 for stående videoer (TikTok, Instagram Reels, YouTube Shorts)

- 1:1 for kvadratiske videoer (Instagram Stories, visse annonser på sosiale medier)

Angi sideforholdet under bildegenerering i stedet for å vente til videofasen. Hvis du genererer et kvadratisk bilde med sideforholdet 1:1 og deretter prøver å lage en video med sideforholdet 16:9, må videomodellen fylle ut sidene fra bunnen av – og kvaliteten på dette genererte innholdet vil være dårligere enn resten av bildet. Generer bilder med det endelige videoens sideforhold fra starten av.

Tips 4: Oppretthold en konsistent stil i meldingene gjennom alle faser

De stilistiske nøkkelordene i bildeprompter og bevegelsessignalene i videoprompter bør ha samme visuelle språk. Enhver inkonsekvens mellom de to vil føre til subtile kvalitetsproblemer i det endelige resultatet.

Hvis bildeprompten din inneholder «filmisk, dramatisk belysning, stemningsfull atmosfære», bør videoprompten bruke kompatibelt språk: «filmisk kamerabevegelse, dramatisk atmosfære, stemningsfullt tempo». Unngå å kombinere dramatiske, filmiske bilder med bevegelsesprompter som «lekende, sprettende, energisk» – tonale konflikter vil forvirre modellen og redusere sammenhengen.

Hurtigreferanse — Stilmatche-tabell:

| Bildestil | Tilpasset bevegelse Språk |

|---|---|

| Filmisk, dramatisk | «Filmisk kamerabevegelse, dramatisk tempo, langsomt og bevisst» |

| Lys, kommersiell, ren | «Jevn, profesjonell bevegelse, jevnt tempo, rene overganger» |

| Drømmende, eterisk, myk | «Mild, svevende bevegelse, drømmende atmosfære, langsom drift» |

| Høy energi, dynamisk | «Dynamisk kamerabevegelse, energisk tempo, raske kutt» |

| Dokumentarisk, naturlig | «Håndholdt følelse, naturlig bevegelse, observasjonstempo» |

Tips 5: Lagre dine beste pipeline-maler

Når en hurtig → bilde → video-pipeline gir gode resultater, lagre hele pipelinen:

- Bildeprompt (originaltekst)

- Valgte stilinnstillinger

- Innstillinger for bildegenerering (bildeforhold, modell, seed-nummer osv.)

- Videobevegelsesprompt

- Innstillinger for videogenerering (varighet, oppløsning)

Denne prosessen fungerer som en mal. Trenger du å lage lignende videoer for forskjellige produkter? Erstatt motivet i bildeprompten og generer på nytt. Trenger du forskjellige scener i samme stil? Behold stilnøkkelordene og bytt ut motivbeskrivelsen.

Over tid vil du bygge opp et modent bibliotek med prosessrør som er skreddersydd for ulike kreative mål: produktannonser, innhold på sosiale medier, merkevarefortellinger, film-B-roll, karakteranimasjon. Hvert nye prosjekt starter fra et velprøvd fundament, ikke fra bunnen av.

Sammenligning av alternative verktøy på tvers av stadier

Seedance tilbyr en integrert pipeline, men du kan også lage denne arbeidsflyten ved hjelp av separate verktøy. Nedenfor finner du en ærlig sammenligning av hvert trinn.

Fase én: Generering av spørsmål

| Verktøy | Best egnet for | Beskrivelse |

|---|---|---|

| Seedance Image Prompt Generator | Integrert pipeline, 12 forhåndsinnstilte stiler | 2 kreditter per prompt. Direkte utdata til Seedance-bildeverktøy. |

| ChatGPT / GPT-4 | Tilpasset prompt-utvikling | Krever manuell kopiering og liming. Ingen forhåndsinnstilte stiler. Mer fleksibel for komplekse instruksjoner. |

| Claude | Raffinerte, detaljerte prompts | Utmerket til å utføre komplekse kreative oppdrag. Ingen integrering av bildegenerering. |

| Tongyi Qianwen | Optimalisert for kinesiske kontekster | Mer naturlig forståelse av kinesiske beskrivelser. Egnet for innenlandske brukere. Krever manuell integrering med nedstrømsverktøy. |

Fase to: Bildegenerering

| Verktøy | Best egnet for | Merknader |

|---|---|---|

| Seedance Text-to-Image / Image-to-Image | Pipeline-integrasjon, video-først-arbeidsflyt | Bilder overføres direkte til videostadiet uten tap av kvalitet. |

| Midjourney | Kunstnerisk kvalitet, estetisk uttrykksevne | Gir enestående resultater. Krever bruk via Discord eller webgrensesnitt. Kan lastes ned manuelt innenfor rørledninger. |

| Tongyi Wanshang | Kinesisk prompt-vennlig, stabil innenlandsk tilgang | Utviklet av Alibaba, utmerker seg ved å forstå kinesiske beskrivelser. Egnet for innenlandske brukere uten VPN. |

| DALL-E 3 | Prompt-trofasthet, tekstlig gjengivelse | Utmerket til bokstavelig utførelse av komplekse prompts. Begrenset stilistisk kontroll. |

| Stable Diffusion | Full kontroll, lokal generering | Maksimal fleksibilitet. Krever teknisk miljøoppsett. Egnet for arbeid med store volumer. |

Trinn tre: Videoproduksjon

| Verktøy | Best egnet for | Beskrivelse |

|---|---|---|

| Seedance Image-to-Video | Integrert pipeline, jevn kvalitet | Sømløs bildeoverføring, direkte støtte for første bilde-inngang. |

| Kling 3.0 | Lang varighet, høy kvalitet | Genererer opptil 2 minutter per kjøring. Sterk bevegelseskvalitet. Av Kuaishou, tilgjengelig i Kina. |

| Jimeng AI | Kinesisk økosystem, brukervennlig | Av ByteDance, dypt integrert med TikTok-økosystemet. Ideell for oppretting av korte videoer. |

| Runway Gen-4 | Presisjonskontroll, bevegelsesbørster | Director Mode støtter tilpassede kamerabaner. Profesjonelt grensesnitt. Høyere pris. |

| Pika 2.0 | Enkel oppstart, rask eksperimentering | Mest minimalistisk grensesnitt. Egnet for nybegynnere. Begrenset kontroll over bevegelsesdetaljer. |

Ærlig talt: Du kan absolutt bygge en høykvalitets pipeline ved å bruke ChatGPT til hurtig skriving, Midjourney til bildegenerering og Keeling til videoproduksjon. Mange profesjonelle gjør nettopp det. Seedances fordel ligger ikke i å overgå konkurrentene på et enkelt trinn – den ligger i å eliminere friksjon gjennom integrering, opprettholde kvalitet på tvers av trinnene og slå sammen tre separate arbeidsflyter til én. For skapere som produserer AI-videoer ofte, kan tiden som spares ved å holde seg innenfor én enkelt plattform, utgjøre flere timer hver uke.

For en detaljert sammenligning av verktøy for videoproduksjon, se Sammenligning av de beste AI-videoprodusentene i 2026.

Vanlige feil i rørledninger

Nedenfor er de fem vanligste feilene som oppstår når man setter opp en prompt → bilde → video-pipeline. Hver av dem har en enkel løsning.

Feil 1: Helt hoppe over bildetrinn

Spesifikk manifestasjon: Direkte konvertering av tekst til video, uten å gå via bildegenerering.

Hvorfor det er problematisk: Du mister all kontroll over komposisjonen. Videomodellen dikterer alt – visuelt innhold, scenebildesammensetning og kamerastartpunkter. Resultatene er uforutsigbare, og det er liten sannsynlighet for at de samsvarer med din kreative intensjon ved første forsøk.

Slik løser du problemet: Lag alltid et første bilde, selv om du mener at tekstprompten din er tilstrekkelig detaljert. De 30 sekundene du bruker på å lage et bilde, kan spare deg for flere mislykkede videoproduksjoner.

Feil 2: Bruk av arkivbilder uten vurdering

Spesifikk manifestasjon: Tilfeldig nedlasting av et bilde fra internett eller valg av et bilde fra et bildedatabase, og deretter innføring av dette direkte i videoproduksjonsprosessen uten å vurdere om det er egnet som åpningsbilde.

Hvorfor det er problematisk: Mange fotografier er laget for statisk visning, ikke bevegelse. Beskjæringen er for tett, slik at det ikke er rom for kamerabevegelser. Motivene er sentrert, noe som begrenser romfølelsen. Belysningen er flat, noe som gir kjedelige videoeffekter. Sterkt komprimerte JPEG-filer introduserer artefakter.

Slik løser du det: Før du bruker et bilde, må du først vurdere det i henhold til prinsippet «designet for bevegelse». En bedre tilnærming er å bruke rørledninger spesielt for å generere en nøkkelramme.

Feil 3: Feil bildeforhold

Spesifikke manifestasjoner: Generere kvadratiske bilder og deretter lage 16:9-videoer, eller bruke liggende bilder til å produsere stående videoer.

Hvorfor det forårsaker betydelig skade: Videomodeller beskjærer enten bildene dine (noe som resulterer i tap av innholdet du har designet med omhu) eller fyller det nye sideforholdet med innhold generert fra bunnen av (med lavere kvalitet på de tilføyde kantene).

Slik løser du problemet: Bestem det endelige bildeforholdet før du genererer bildene. Generer bildene i henhold til dette bildeforholdet.

Feil 4: Altfor beskrivende videoprompter

Spesifikk manifestasjon: Videoprompten beskriver både scenen og bevegelsen samtidig: «Et luksuriøst ur på mørk marmor med dramatisk belysning, kameraet roterer sakte og lysrefleksjoner danser over overflaten.»

Hvorfor dette er problematisk: Den visuelle beskrivelsen kan være i strid med bildeinnholdet. Hvis klokken er avbildet på hvit marmor, men instruksjonen spesifiserer mørk marmor, mottar modellen motstridende signaler. I beste fall blir den visuelle beskrivelsen overflødig, i verste fall fører det til at modellen forsøker å endre det første bildet du har designet med omhu.

Hvordan lage: Videoprompter skal bare beskrive bevegelse, kameravinkler og atmosfære. Bildene er allerede gjengitt som bilder. Husk dette prinsippet: bilder formidler «det som sees», mens videoprompter dikterer «hvordan det beveger seg».

Feil 5: Å skynde seg å generere videoer uten å gå gjennom bildene

Spesifikk manifestasjon: Generere et bilde og mate det direkte inn i videogenerering, selv når det har åpenbare feil – for eksempel en litt skjev komposisjon, mindre ufullkommenheter eller suboptimal belysning.

Hvorfor effekten er større: Video forstørrer alle feil i kildebildet. En liten ufullkommenhet i et stillbilde blir en vedvarende, bevegelig feil gjennom 120 bevegelige bilder. En komposisjon som er litt utenfor sentrum blir merkbart feil når kamerabevegelsen trekker oppmerksomheten mot rammen. Alle feil i et fotografi blir tydeligere, ikke mindre, i video.

Slik løser du det: Behandle bildestadiet som et kvalitetskontrollpunkt. Ikke gå videre til videostadiet før bildet er helt tilfredsstillende. Gjenta 3–5 ganger. Bruk bilde-til-bilde-generering for målrettede reparasjoner. Videoutgangen kan ikke overstige kvaliteten på kildebildet.

Ofte stilte spørsmål

Hvorfor bruke bildeformidling i stedet for å konvertere tekst direkte til video?

Tekst-til-video-generering krever at AI samtidig skaper både bilder og bevegelse fra tekst, noe som betyr at du har minimal kontroll over komposisjon, karakterutseende, belysning og innramming. Den bilde-først-tilnærmingen skiller disse to oppgavene: du finpusser bildene i bildefasen, og deretter instruerer du AI-en om å bare legge til bevegelse. Dette gir mer forutsigbare resultater av høyere kvalitet, da AI-en mottar konkrete visuelle referanser i stedet for å tolke tvetydig tekst. Forskjellen er spesielt uttalt i profesjonelle scenarier som krever spesifikke komposisjoner, merkevarefargepaletter eller konsistent karakterdesign.

Hva er den komplette prosessen for å lage AI-videoer fra bunnen av?

Hele prosessen består av tre trinn. Trinn én: Bruk en AI-promptgenerator (for eksempel Seedances Image Prompt Generator) for å utvide konseptet ditt til en detaljert bildeprompt. Trinn to: Bruk denne prompten i et tekst-til-bilde-verktøy (for eksempel Seedances Text-to-Image) for å generere referansebilder av høy kvalitet, og gjenta til du er fornøyd. Trinn tre: Last opp bildet til en bilde-til-video-generator (for eksempel Seedances image-to-video), skriv en prompt som bare beskriver bevegelsen (kamerabevegelse og motivets handlinger), og generer videoen. Hele prosessen tar 5–15 minutter, avhengig av hvor mange iterasjoner som er nødvendige i bildefasen.

Hvor mange kredittpoeng koster hele prosessen på Seedance?

Kostnadene varierer avhengig av konfigurasjonen, men en typisk pipeline-kjøring innebærer vanligvis: hurtig generering til 2 kreditter, bildegenerering til 4–8 kreditter per iterasjon (forutsatt 3–5 iterasjoner, tilsvarende 12–40 kreditter) og videogenerering til 10–30 kreditter (avhengig av varighet og oppløsning). Fra konsept til ferdig video varierer den totale kostnaden vanligvis fra 25 til 70 kredittpoeng. Dette representerer en betydelig besparelse sammenlignet med å bruke tre separate verktøy med tre separate abonnementer.

Kan bilder generert av andre verktøy brukes til å lage videoer i Seedance?

Absolutt. Seedances [Image-to-Video]-verktøy aksepterer alle opplastede bilder – de trenger ikke å være generert av Seedance. Du kan lage bilder ved hjelp av Midjourney, DALL-E, Tongyi Wanshang, Stable Diffusion eller andre verktøy og laste dem opp som første bilde. Fordelen med den integrerte pipelinen er at den eliminerer trinnene med nedlasting og opplasting, selv om dette ikke er obligatorisk. Når du bruker eksterne bilder, anbefaler vi PNG-format med en oppløsning på 1024x1024 eller høyere for å forhindre at komprimeringsartefakter påvirker videoutgangen.

Hvilket bildeforhold bør brukes for bilder?

Sørg alltid for at bildeformatet samsvarer med den endelige videoen. 16:9 for liggende videoer (YouTube, presentasjoner, innebygde videoer på nettsteder), 9:16 for stående videoer (TikTok, Instagram Reels, YouTube Shorts), 1:1 for kvadratiske videoer (Instagram-feed, visse sosiale annonser). Lag bilder med riktig bildeformat fra starten av. Ikke generer kvadratiske bilder og forvent at videoverktøyene konverterer dem til 16:9 – dette vil enten beskjære komposisjonen din eller legge til AI-generert innhold i kantene, noe som begge deler går ut over kvaliteten.

Hvordan lage nøkkelbildepar?

Generer to rammer ved hjelp av separate rørledninger. Den første rammen følger standard arbeidsflyt: generer instruksjoner, lag bilder og gjenta til du er fornøyd. Den endelige rammen bruker image-to-image, og laster opp den første rammen som referansebilde og beskriver endringene i den endelige tilstanden. Dette sikrer visuell konsistens – samme sted, samme lysretning, samme fargevalg – samtidig som du oppnår ønsket narrativ endring (ulike tidspunkter, aktiviteter eller stemninger). Last opp begge bildene til en videogenerator og la AI-en lage overgangen. For en omfattende guide til denne teknikken, se First and Last Frame Design Guide.

Er denne arbeidsflyten egnet for kommersielt innhold?

Egnet. Den tretrinns prosessen er blitt tatt i bruk av e-handelsmerker for produktvideoer, markedsføringsteam for reklame, eiendomsmeglere for eiendomspresentasjoner og innholdsbyråer for produksjon av innhold til sosiale medier. AI-genererte videoer på 5–15 sekunder med åpningsbilder av høy kvalitet oppfyller nå profesjonelle standarder for digitalt innhold. Nøkkelen til kommersiell suksess ligger i å investere tid i bildefasen – et raffinert åpningsbilde gir direkte et raffinert video. For lengre varighet eller kommersielt innhold av kringkastingskvalitet blir AI-video i økende grad brukt til kreativ idéutvikling og forhåndsvisning, mens den endelige produksjonen fortsatt gjennomføres ved hjelp av tradisjonelle metoder for å sikre maksimal kontroll.

Hva bør man gjøre hvis det genererte bildet har feil?

Ikke fortsett med videogenerering. Ufullkommenheter i kildebildet vil bli forsterket i videoen – en litt forvrengt hånd i et statisk bilde blir en merkbart deformert hånd i en bevegelsessekvens på 120 bilder. Forbehandle bildet. Bruk [image-to-image] til å regenerere problematiske områder mens du bevarer resten av komposisjonen. For alvorlige feil (deformerte menneskefigurer, usannsynlige geometrier) må du regenerere bildet fullstendig med en modifisert prompt for å omgå problemet. Elementer som er utsatt for feil inkluderer hender (spesifiser «hender som hviler ved siden» eller «hender i lommene» for å unngå komplekse fingerposisjoner), tekst (unngå å inkludere tekst i genererte bilder) og refleksjoner (forenkle reflekterende overflater i instruksjoner). Fortsett først med videoproduksjonen når bildet er feilfritt.

Begynn å bygge din kreative pipeline

Den tretrinnsprosessen – prompt → bilde → video – er fortsatt den mest pålitelige metoden for å produsere AI-videoer av høy kvalitet i 2026. Den skiller den kreative kontrollen du trenger (hvordan scenen skal se ut) fra den generative evnen du ønsker (hvordan den skal bevege seg), noe som resulterer i videoer som samsvarer med din visjon, i stedet for tilfeldige gjetninger fra AI-en.

Hver god video begynner med et godt bilde. Hvert godt bilde begynner med en god idé. Legg et godt grunnlag, så vil alt annet følge naturlig.

Trinn 1: Generer instruksjoner → — Forvandle konsepter til profesjonelle bildeinstruksjoner ved hjelp av Seedances AI-instruksjonsgenerator.

Trinn to: Generer bilde → — Generer og finpuss den perfekte åpningsrammen for videoen din.

Trinn tre: Generer video → — Forvandle bilder til dynamiske videoer med bevegelse, kameravinkler og atmosfære.

Mestre teknikken for første bilde → — Ta kontroll over AI-videoproduksjonen din ved å lære hvordan du designer referansebilder.

Videre lesning: AI-guide for bilde til video | Designveiledning for første og siste bilde | Komplett AI-guide for tekst til bilde | AI-guide for bilde til bilde | Guide til AI-bildegenerator | Beste AI-bildegeneratorer 2026 | Beste AI-videogeneratorer for 2026*