Översikt

Text-to-Video AI är en artificiell intelligens-teknik som automatiskt genererar videor från textbeskrivningar. Mata in en beskrivning så producerar AI:n en videoklipp med rörelse, ljuseffekter och kamerarörelser. Genom att utnyttja Diffusion Transformer (DiT)-arkitekturen har denna teknik fram till 2026 utvecklats från en oklar experimentell prototyp till en kvalitet som närmar sig filmkvalitet. Denna guide täcker de tekniska principerna, en praktisk handledning i fem steg, tio replikerbara promptmallar, en jämförande analys av åtta verktyg, sex viktiga tillämpningsscenarier och de verkliga begränsningar som du måste förstå.Upplev text-till-video-generering gratis →

Text-till-video-AI: Från en enda beskrivning till filmkvalitet – AI gör "text-till-video" till verklighet.

Vad är text-till-video-AI?

Text-till-video-AI avser en kategori av artificiell intelligens-teknik som automatiskt genererar videoinnehåll från textbeskrivningar. Du beskriver en scen – en kvinna som promenerar i regnet, en produkt som roterar på en display, en drönare som svävar över bergskedjor – och AI-modellen producerar en mycket realistisk videoklipp med naturliga rörelser, belysning och fysiska effekter.

Grundkonceptet är enkelt: textinmatning, videoutmatning. Men den underliggande tekniken är långt ifrån enkel. Moderna text-till-video-system använder neurala nätverk som tränats på miljarder parvisa dataset med ”videotext” och lär sig de statistiska sambanden mellan språkliga beskrivningar och visuell rörelse. När du skriver ”en katt hoppar upp på ett bord” använder modellen sin samlade kunskap om katter, fysiken bakom hopp, bordsskivans material och gravitation för att generera en trovärdig video.

2026: Från experiment till produktivitetsverktyg

Text-till-video-AI passerade tröskeln för "produktionsklar" kapacitet 2025–2026. De tidiga systemen från 2022–2023 kunde bara producera korta, suddiga och fysiskt osannolika klipp. Dagens modeller genererar dock videor med 2K-upplösning, fysiskt korrekta, naturligt animerade rörelser och filmisk kvalitet, med en längd på 5–15 sekunder. Detta språng förvandlar text-till-video-tekniken från en forskningskuriositet till ett praktiskt verktyg:

- Innehållsskapare: Skaffa B-roll, introsekvenser och material för sociala medier utan kamera

- Marknadsförare: Massproducera reklamvarianter och produktdemonstrationer

- Lärare: Visualisera abstrakta begrepp

- Små och medelstora företag: Undvik de höga kostnaderna för professionell videoproduktion

- Alla: Om du kan skriva kan du göra videor

Tröskeln för att skapa videor har sänkts från att "äga en kamera och kunna redigera" till att "skriva en fängslande beskrivning".

Teknisk utveckling: Från GAN till DiT

Att förstå den underliggande tekniken kan hjälpa dig att skapa bättre uppmaningar och välja mer lämpliga verktyg. Nedan visas den tekniska utvecklingen av text-till-video-AI över tre generationer.

Tre generationer av teknisk utveckling: GAN (2020–2022) → Diffusionsmodeller (2023–2024) → Diffusionstransformatorer/diffusionsbaserad bildgenerering (2025–2026).

Första generationen: GAN-eran (2020–2022)

Generativa adversariala nätverk (GAN) var den första arkitekturen som visade att det var möjligt att konvertera text till video. Två neurala nätverk genomgår adversarial träning – generatorn skapar videoramar, medan diskriminatorn bedömer deras äkthet. Resultaten var dock lågupplösta (256×256), korta (2–4 sekunder) och fysiskt osannolika. Objekt genomgår oförutsägbara deformationer, ansiktsdrag blir förvrängda och den tidsmässiga konsistensen är allvarligt komprometterad. Noterbara prestationer inkluderar CogVideo och NUWA.

Andra generationen: Diffusionsmodellernas era (2023–2024)

Diffusionsmodellen har revolutionerat landskapet. Den använder inte längre adversarial training utan lär sig istället en process för ”omvänd brusreducering” – med utgångspunkt i rent brus som successivt reduceras till en sammanhängande video med hjälp av text. Denna metod innebär ett kvalitativt språng framåt: högre upplösning (upp till 1080p), längre speltid (4–10 sekunder) och förbättrad text-bild-synkronisering.

OpenAI:s Sora (släppt i februari 2024) visade att diffusionsmodeller kan generera otroligt fotorealistiska videor. Runway Gen-2/Gen-3, Pika och Stable Video Diffusion tillhör alla denna generation.

Tredje generationen: DiT – Diffusionstransformator (2025–2026)

De mest avancerade arkitekturerna kombinerar för närvarande diffusionsprocesser med Transformer-arkitekturen (samma arkitektur som ligger bakom GPT och BERT). DiT-modeller bearbetar video som en sekvens av rumsliga och tidsmässiga patchar, vilket ger följande resultat:

- Förbättrad tidsmässig konsistens: Transformers är utmärkta för att modellera långsiktiga beroenden mellan bildrutor

- Högre upplösning: Inbyggd 2K-utgång (Seedance 2.0 uppnår 2048×1080)

- Förbättrad fysisk noggrannhet: Mer realistisk rörelse, gravitation och fluidmekanik

- Bättre textförståelse: Avsevärt förbättrad överensstämmelse mellan promptbeskrivningar och visuella utdata

- Multimodal inmatning: Vissa DiT-modeller kan samtidigt acceptera bild-, video- och ljudinmatning

Seedance 2.0, Google Veo 3 och Keeling 3.0 använder alla DiT-arkitekturen. Det är därför som text-till-video-generering 2026 uppvisar en kvalitativ skillnad jämfört med 2024.

Text-till-video kontra bild-till-video

Dessa två tillvägagångssätt kompletterar varandra snarare än konkurrerar med varandra:

| Dimension | Text-till-video (T2V) | Bild-till-video (I2V) | |------|------------------|----------------- -| | Inmatning | Endast textbeskrivning | Foto + rörelsebeskrivning | | Kreativ frihet | Högsta — AI bestämmer alla visuella element | Begränsad av källbilden | | Kontrollerbarhet | Lägre — Beroende av promptens noggrannhet | Högre — Visuella ankare tillgängliga | | Lämpliga scenarier | Konceptutforskning, originalt innehåll | Produktvisning, fotoanimation, stilmatchning | | Förutsägbarhet | Låg — Samma prompt ger olika resultat varje gång | Hög — Utgången matchar konsekvent källbilden |

De flesta professionella arbetsflöden använder båda metoderna: först används T2V för att utforska kreativa koncept, sedan förfinas resultatet med I2V för precis kontroll. För en omfattande förståelse av bild-till-video-generering, se vår Image-to-Video AI Complete Guide.

5-stegs handledning: Skapa din första AI-video

Nedan följer en steg-för-steg-guide för att skapa text-till-video-innehåll från grunden, med Seedance 2.0 som exempelplattform. De underliggande principerna gäller för alla verktyg.

Från snabb skapande till slutresultat: Fem steg för att färdigställa din första AI-video.

Steg 1: Definiera videons mål

Innan du skriver uppgiften, bestäm först:

- Typ: B-roll-film, produktdemonstrationer, innehåll för sociala medier, konstnärliga skapelser eller berättarröst?

- Längd: 5 sekunder för testning, 10–15 sekunder för slutlig produktion

- Bildformat: 16:9 för YouTube/Bilibili, 9:16 för Douyin/Kuaishou/ Xiaohongshu, 1:1 för WeChat Moments

- Stil: Film, dokumentär, animation, reklamfilm eller konstnärligt

Att fastställa tydliga mål förhindrar att generationskvoter slösas bort på tvetydiga experiment.

Steg 2: Skapa högkvalitativa textprompter

Prompt är själva essensen av text-till-video-generering. Använd följande formel:

[Ämne] + [Handling/rörelse] + [Miljö] + [Stil] + [Kamerarörelse] + [Belysning]

Dålig uppmaning: "En hund som springer"

Bra uppmaning: "En golden retriever som springer genom en solbelyst äng, vildblommor som vajer i vinden. Hundens päls böljar med varje steg. Kameran följer med på marknivå. Varmt gyllene ljus med långa skuggor. Filmisk kort skärpedjup, 4K-kvalitet."

Viktiga principer:

- Rörelsen måste vara specifik: "vänder långsamt huvudet" istället för "vänder"

- Beskriv kamerarörelser: "kameran zoomar in" eller "drönarbild från luften"

- Skapa stämning: Belysning, färgkorrigering, atmosfär

- Undvik motsägelser: Begär inte samtidigt "snabb action" och "slow motion"

- Begär inte text/UI: Den nuvarande modellen har svårt att återge läsbar text i videomaterial

Observera: Det är tillrådligt att skriva uppmaningar på engelska, även när du använder inhemska verktyg (som KeLing, Tongyi Wanxiang eller Hunyuan Video), eftersom de flesta modeller har tränats på mer omfattande engelska datamängder.

För ett mer omfattande system för promptteknik, se Prompt Writing Guide och 10 Truly Effective AI Video Prompts.

Steg 3: Välj verktyg och parametrar

Välj en plattform (se jämförelsetabellen nedan) och konfigurera sedan:

- Modell: Använd den senaste tillgängliga modellen (t.ex. Seedance 2.0, inte 1.0)

- Upplösning: Minst 1080p; välj 2K om det är tillgängligt

- Längd: Testa med 5 sekunder till en början, förläng om resultatet är tillfredsställande

- Bildformat: Anpassa efter din distributionsplattform

- Seed-värde (om tillgängligt): Lås seed-värdet för konsekvent iteration

Steg 4: Skapa och granska

Klicka på Generera och vänta i 60–180 sekunder (beroende på verktyget). När du granskar resultatet, var uppmärksam på följande:

- ✅ Stämmer rörelsen överens med beskrivningen?

- ✅ Är motivet konsekvent genom hela filmen (ingen förvrängning)?

- ✅ Är fysiken trovärdig (tyngdkraft, vätskor, tyger)?

- ✅ Är kamerarörelsen flytande?

- ❌ Finns det några artefakter, flimmer eller förvrängningar?

- ❌ Finns det någon uncanny valley-effekt på ansikten/händer?

Steg 5: Iterativ optimering

Det första försöket är sällan perfekt. Optimeringstekniker:

- Justera prompten: Lägg till detaljer där AI:n har gjort fel

- Ändra endast en variabel åt gången: Skriv inte om hela prompten

- Experimentera med olika frön: Samma prompt kan ge helt olika resultat

- Förläng varaktigheten: När du är nöjd med 5-sekundersversionen, prova 10-15 sekunder

- Inkorporera ljud: Om verktyget stöder det (Seedance, Veo 3), lägg till ljudeffekter eller bakgrundsmusik

Exempel på promptiteration: V1 (basprompt) → V2 (tillägg av rörelse- och belysningsbeskrivningar) → V3 (fullständiga filmiska specifikationer). Varje förfiningscykel förbättrar bildkvaliteten avsevärt.

10 mallar för att skapa video från text

Följande mallar kan kopieras och användas direkt. De har testats på Seedance 2.0 och är kompatibla med de flesta vanliga plattformar.

1. Filmiskt porträtt

A close-up of a young woman with flowing dark hair, her face illuminated by warm golden hour sunlight filtering through a window. She slowly turns her head toward the camera, a subtle smile forming. Soft bokeh background of a cozy interior. Camera holds steady with a slight push-in. Warm amber lighting, shallow depth of field, 4K cinematic quality.

Lämpliga scenarier: Sociala medier, personlig varumärkesprofilering, konstnärligt skapande

- Produktpresentation

A sleek wireless headphone rotating slowly on a matte black pedestal. Soft studio lighting creates clean highlights on the brushed metal surface. Camera orbits 180 degrees at eye level. Minimalist white background, no shadows. Smooth continuous motion, commercial product photography quality.

Lämpliga scenarier: Produktinformationssidor för e-handel, produktmarknadsföring, huvudbildsvideor på Taobao/JD.com

- Naturfilm

An epic aerial drone shot over a misty mountain valley at sunrise. Golden light breaks through layered clouds, illuminating a winding river below. Camera pushes forward slowly, revealing the vast landscape. Volumetric fog drifts between peaks. IMAX cinematography quality, hyper-detailed.

Lämpligt för: YouTube/Bilibili-introfilmer, reseinnehåll, skärmsläckare, meditationskanaler

4. Stadsgata

A neon-lit Tokyo alley at night after rain. Wet cobblestones reflect vivid pink, teal, and amber neon signs. A lone figure walks away from camera, umbrella in hand. Steam rises from a street vent. Camera follows at a distance, tracking shot. Film noir atmosphere, anamorphic lens flare.

Lämpliga scenarier: Musikvideor, stämningsfulla B-roll-bilder, innehåll i cyberpunk-stil

- Anime-stil

An anime warrior princess with flowing silver hair stands on a cliff edge overlooking a fantasy kingdom. Her cape billows dramatically in the wind. She raises a glowing sword that emits blue energy particles. Cherry blossom petals drift past. Camera slowly orbits. Studio Ghibli meets Ufotable quality animation.

Lämpliga scenarier: Animerat innehåll, spelkanaler, fantasyböcker

6. Mat och dryck

Extreme macro close-up of rich dark coffee being poured in slow motion into a pristine ceramic cup. Individual droplets and tiny splashes frozen mid-air. Wisps of steam curl elegantly upward. Warm side lighting reveals the liquid's amber transparency. Cinnamon stick and scattered beans visible in soft focus foreground.

Lämpliga scenarier: Marknadsföring av mat och dryck, matbloggare, dryckesreklam

- Mode & redaktionellt

A model in a flowing white silk gown walks confidently down a dark runway. Multiple flash strobes create sharp geometric light patterns. The fabric billows with perfect physics. Camera at a low angle, slight slow motion. High fashion editorial aesthetic, Vogue magazine quality.

Lämpliga scenarier: Modemärken, skönhetsinnehåll, redaktionella artiklar

- Science fiction och fantasy

A massive spaceship emerges from hyperspace above a ringed planet. Blue energy dissipates around the hull as the vessel decelerates. Tiny fighter escorts flank its sides. Camera pulls back to reveal the scale against the planet. Volumetric space dust and distant star field. Hollywood VFX quality.

Tillämpliga scenarier: Underhållningsinnehåll, science fiction-kanaler, konceptvisualisering

- Sport & action

A basketball player at the peak of a slam dunk, frozen in mid-air. Time resumes in slow motion — sweat droplets fly, the ball compresses against the rim, arena spotlights create dramatic lens flare. Camera shoots from below looking up. ESPN broadcast quality, hyper-detailed.

Lämpligt för: Sportinnehåll, sportmärken, sammanställningar av höjdpunkter

- Abstrakt konst

Liquid gold and deep indigo ink collide in slow motion inside a glass sphere. The fluids intertwine in mesmerizing fractal patterns. Tiny bubbles catch light. Camera slowly rotates around the sphere. Pure black background. Macro photography meets fluid dynamics simulation. Meditative, hypnotic pace.

Lämpliga scenarier: Bakgrundsbilder, musikvideor, konstinstallationer, skärmsläckare

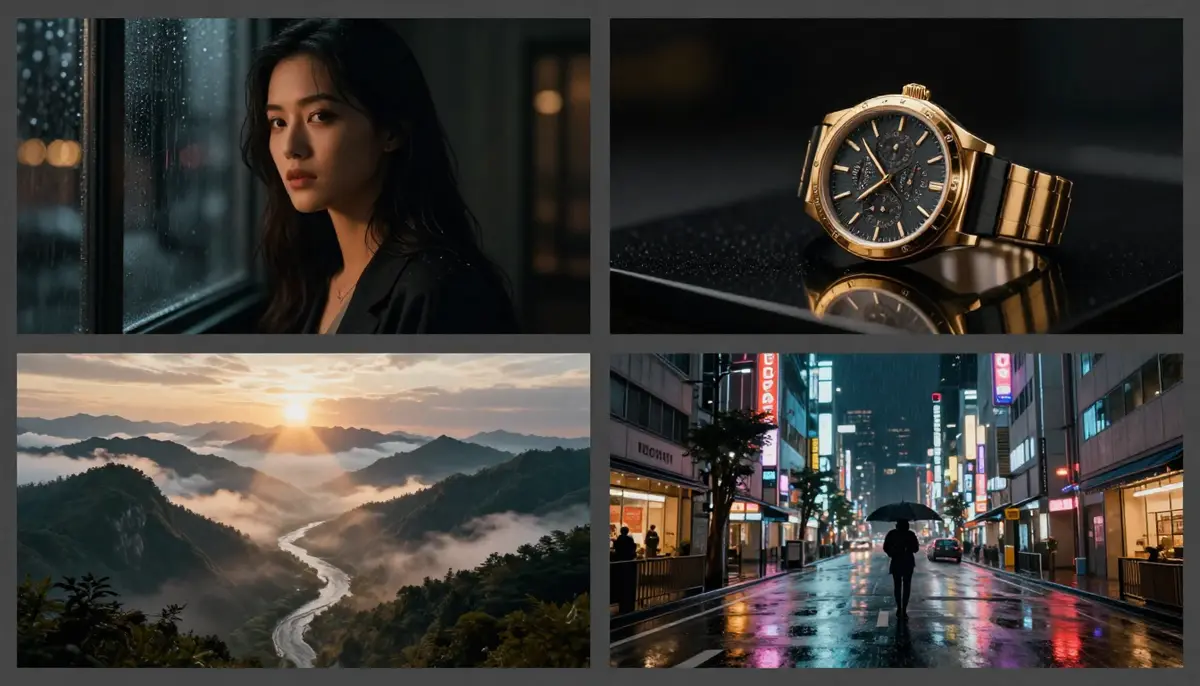

Det faktiska resultatet från fyra av de tio mallarna ovan – varje prompt genererar unika bilder i filmkvalitet från vanlig text.

Sammanfattning 2026: Jämförelse av 8 verktyg för text-till-video

Vi testade åtta vanliga plattformar med samma uppmaning ("En golden retriever som springer genom en solbelyst äng, vildblommor som vajer, filmisk 4K-kvalitet") och betygsatte dem utifrån fem kriterier. Alla tester genomfördes i februari 2026.

| Verktyg | Maximal upplösning | Maximal varaktighet | Gratisversion | Ljud | Bästa användningsområde | Bildkvalitetsbetyg | |------|----------|---------|--------|------|-------- -|---------| | Seedance 2.0 | 2K (2048×1080) | 15 sekunder | ✅ Daglig gratis kvot | ✅ Ljudeffekter + musik + läppsynkronisering | Multimodal skapande | 9,2/10 | | Google Veo 3 | 4K (begränsat) | 8 sekunder | ✅ AI Studio-kvot | ✅ Inbyggt ljud | Audiovisuell fusion | 9,0/10 | | Sora 2 | 1080p | 20 sekunder | ❌ Kräver ChatGPT Plus | ❌ | Långtextdriven video | 8,8/10 | | Keling 3.0 | 1080p | 20+ sekunder | ✅ Gratis registreringskrediter | ⚠️ Begränsad | Långa videor, prisvärd | 8,5/10 | | Runway Gen-4 | 1080p | 10 sekunder | ✅ 125 krediter | ❌ | Professionellt redigeringsflöde | 8,5/10 | | Pika 2.0 | 1080p | 10 sekunder | ✅ Daglig gratiskvot | ⚠️ Endast ljudeffekter | Nybörjare, roliga effekter | 8,0/10 | | Luma Dream Machine | 1080p | 5 sekunder | ✅ Gratis generering | ❌ | 3D-scener, snabb iteration | 7,8/10 | | Snail AI (MiniMax) | 1080p | 6 sekunder | ✅ Dagligt gratis | ❌ | Snabbaste genereringshastighet | 7,5/10 |

Viktig information för inhemska användare: Seedance 2.0, KeLing 3.0 och Haier AI är direkt tillgängliga inom Kina. Sora 2 kräver ett ChatGPT Plus-abonnemang (VPN krävs). Google Veo 3 kräver åtkomst via Google AI Studio (VPN krävs). Runway, Pika och Luma kräver alla en utländsk nätverksanslutning.

Inhemska alternativ: Tongyi Wanxiang (Alibaba), Hunyuan Video (Tencent) och Qingying (dotterbolag till ByteDance) erbjuder också funktioner för att generera text till video, med varierande gratis användningskvoter.

Viktiga slutsatser:

- Bästa bildkvalitet totalt sett: Seedance 2.0 (inbyggd 2K + fyrdubbla ingångar + ljud)

- Bästa ljudfunktioner: Seedance 2.0 och Google Veo 3

- Bästa gratisversion: Seedance 2.0 (gratis tillgång till 2K-upplösning, inget kreditkort krävs)

- Längsta gratis videolängd: Keeling 3.0 (20+ sekunder)

- Bäst lämpad för nybörjare: Pika 2.0 (enklast gränssnitt, roliga effekter)

För en mer detaljerad jämförelse, se Den fullständiga jämförelsen av de bästa AI-videogeneratorerna för 2026. För att fokusera enbart på gratisabonnemang, se En jämförande recension av gratis AI-videogeneratorer.

6 viktiga tillämpningsscenarier

- Innehåll på sociala medier

Skapa iögonfallande korta videoklipp för Douyin, Kuaishou, Xiaohongshu, Bilibili och YouTube Shorts. AI eliminerar helt behovet av filmning, redigering och efterproduktion.

Rekommenderade specifikationer: Bildformat 9:16, längd 5–15 sekunder, med en visuellt slående inledning inom den första sekunden.

- Marknadsföring och reklam

Massproducera olika varianter av reklammaterial. Testa flera visuella koncept med olika budskap innan du fastställer den formella produktionsbudgeten. Skapa A/B-testversioner på några minuter.

Rekommenderad konfiguration: Kompatibilitet med flera format på flera plattformar. Kombinera med Seedances ljudfunktioner för att producera kompletta reklamfilmer.

3. Utbildning och fortbildning

Visualisering av abstrakta begrepp som är svåra eller omöjliga att fånga: molekylära strukturer, historiska händelser, matematiska begrepp, vetenskapliga processer. AI-video gör det osynliga synligt.

Rekommenderad konfiguration: För optimala undervisningsresultat, kombinera en prompt som tydligt förklarar begreppet med berättarröst.

- Underhållning och berättande

Oberoende filmskapare och berättare använder text-till-video-teknik för att visualisera koncept, skapa storyboards och till och med för den slutliga produktionen av kortfilmer. Denna teknik demokratiserar filmskapandet.

Rekommenderad konfiguration: Inkludera detaljerade specifikationer för kamerariktning och belysning i instruktionerna för att uppnå filmkvalitet.

- Produktvideor för e-handel

Omvandla produktbeskrivningar till demonstrationsvideor. Detta är särskilt värdefullt för handlare med hundratals SKU:er som inte kan spela in individuella videor för varje produkt. För detaljerade e-handelsarbetsflöden, se AI E-commerce Video Guide.

Rekommenderade specifikationer: Produktfotografering med studiobelysning. Bildformat 1:1 för produktdetaljsidor, 16:9 för YouTube/Bilibili, 9:16 för TikTok/Xiaohongshu.

6. Skapande av innehåll för YouTube/Bilibili

Skapa B-roll-material, öppningssekvenser, visuella kommentarer och kompletta korta videor. Skapare förbättrar effektiviteten i innehållsproduktionen med AI-video. För den fullständiga arbetsflödet för YouTube-skapare, se AI Video YouTube Creators Guide.

Rekommenderad konfiguration: Upprätthåll visuell konsistens i alla uppmaningar för att skapa varumärkesigenkänning.

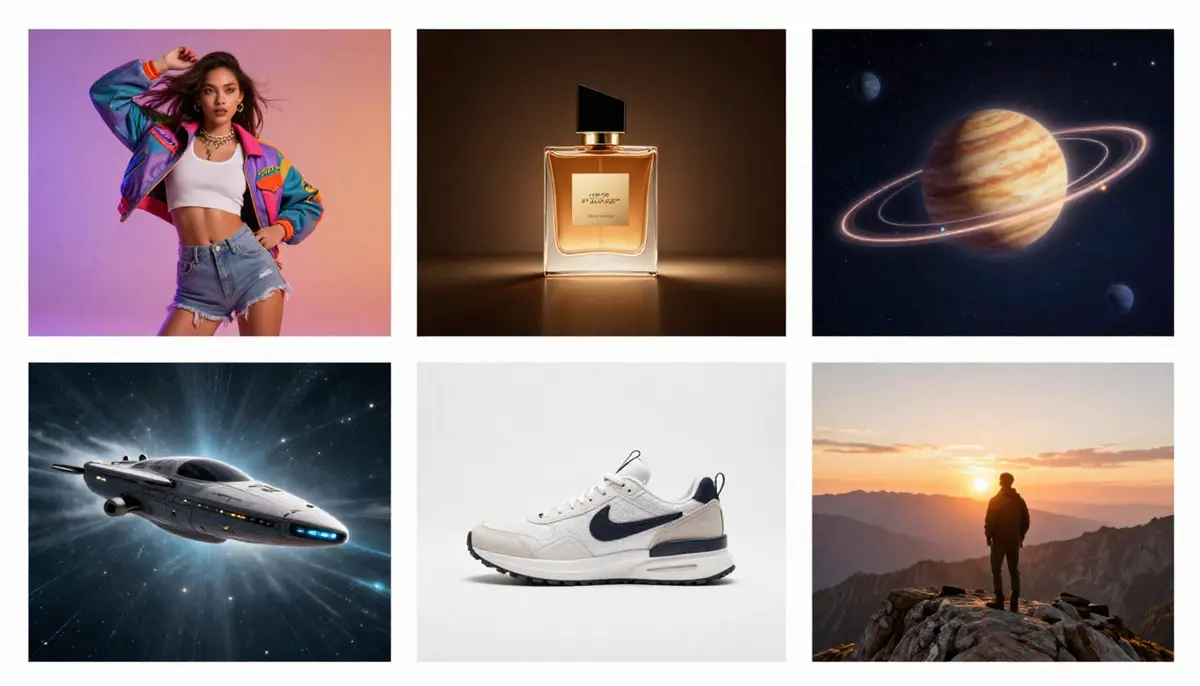

Sex praktiska tillämpningar av text-till-video-AI: från korta filmer på sociala medier till produktdemonstrationer inom e-handel och visualisering av pedagogiska koncept.

Text-till-video kontra bild-till-video: När ska man använda vilket?

Detta är en av de vanligaste frågorna från nya användare. Svaret beror på vilka material du har tillgängliga och vad du behöver.

Två vägar till AI-video: Text-till-video-generering utgår från text, medan bild-till-video-generering utgår från befintliga fotografier.

Scenarier för text-till-video (T2V):

- Du skapar helt nytt innehåll (inga referensbilder)

- Du vill ha maximal kreativ frihet

- Du utforskar koncept eller gör visuell brainstorming

- Du behöver abstrakta eller ofilmbara scener (science fiction, fantasy, mikroskopiska/makroskopiska)

- Du vill iterera snabbt – att ändra en prompt ger en helt annan scen

Scenarier för att generera videor från bilder (I2V):

- Du har ett specifikt fotografi som kräver dynamisk transformation

- Du behöver ett resultat som exakt matchar befintliga visuella effekter

- Du konverterar produktbilder till produktvideor

- Du behöver karaktärskonsistens (samma person i alla scener)

- Du vill ha mer förutsägbara och kontrollerbara resultat

Bästa praxis – kombinera båda metoderna:

- Använd text-till-video-generering för att utforska kreativa riktningar

- Välj den optimala ramen som referensbild

- Använd bild-till-video-generering för en förfinad, kontrollerbara slutversion

För en omfattande arbetsflöde för bild-till-video-generering, se Image-to-Video AI Complete Guide.

Nuvarande begränsningar – en ärlig bedömning

Text-till-video-AI från 2026 är imponerande, men långt ifrån felfri. Nedan följer de områden där den för närvarande utmärker sig och de som fortfarande är utmanande.

Bra gjort!

- Korta videoklipp (5–15 sekunder): Bildkvalitet som närmar sig filmstandard

- Scener med ett enda motiv: En person, ett djur, ett objekt – utmärkta resultat

- Natur och landskap: Enastående återgivning av fluidmekanik, väder och atmosfäriska effekter

- Stiliserat innehåll: Animation, film noir, sci-fi – mycket tillförlitlig stilkonvertering

- Produktrotationsdemonstrationer: Enkel produktrörelse med god konsistens

- Kamerarörelser: Panorerings-, zoom-, dolly- och följningsbilder – välkontrollerade

Fortfarande svårt

- Händer och fingrar: Extra fingrar, osannolika gester och deformiteter i fingrarna är fortfarande vanligt förekommande

- Textåtergivning: Läsbar text i videor är opålitlig – bokstäverna är förvrängda och tecknen är skeva

- Komplexa interaktioner mellan flera personer: Handskakningar mellan två personer, dans eller slagsmål resulterar ofta i oordnade lemrörelser

- Långare berättelser (>30 sekunder): Att upprätthålla scenens konsistens under längre perioder försämras

- Exakt fysik: Exakt bollstuds, vatten som hälls i specifika behållare – fysiken är ungefärlig, inte exakt

- Långsiktig ansiktskonsistens: Ansiktsdrag kan genomgå subtila förändringar mellan bildrutor, särskilt under längre tidsperioder

Utvecklingstrend

Var och en av dessa begränsningar kommer att förbättras avsevärt fram till 2026 jämfört med 2024. Förbättringstakten är exponentiell. Handrendering kommer att utvecklas från ”alltid felaktig” till ”generellt korrekt”. Ansiktskonsistensen kommer att förändras från ”börjar avvika efter 2 sekunder” till ”förblir stabil i 10–15 sekunder”. Textrendering kommer att utvecklas från ”oläslig” till ”ibland läsbar”. Dessa problem förväntas fortsätta att förbättras snabbt under 2026–2027.

Vanliga frågor

Vilken är den bästa AI-tekniken för text-till-video för 2026?

Seedance 2.0 är ledande när det gäller övergripande bildkvalitet med inbyggd 2K-upplösning, fyrmodal inmatning och integrerad ljudgenerering. Google Veo 3 utmärker sig inom audiovisuell fusion och fysisk simulering. Sora 2 erbjuder den längsta genereringstiden (20 sekunder). Det ”bästa” valet beror på dina specifika krav – upplösning, ljud, varaktighet eller pris. Inhemska användare kan också överväga Keeling 3.0 (högt värde för pengarna, långa videor) och Tongyi Wanxiang (integrerat med Alibaba-ekosystemet).

Finns det någon gratis AI för text-till-video?

Ja. Seedance 2.0 erbjuder en daglig gratis kvot utan krav på kreditkort. Pika 2.0 erbjuder daglig gratis generering. Keiling 3.0 ger en registreringskvot. Google Veo 3 erbjuder gratis kvoter via AI Studio. Conch AI erbjuder också en daglig gratis kvot. För mer information, se Jämförelse av gratis AI-videogeneratorer.

Hur långa kan AI-genererade videor baserade på text vara?

De flesta verktyg genererar innehåll i steg om 5–15 sekunder. Sora 2 kan producera upp till 20 sekunder. Keeling 3.0 stöder över 20 sekunder. För längre innehållskrav kan flera segment genereras och sammanfogas med hjälp av redigeringsprogram som Kinevision, Premiere Pro eller DaVinci Resolve.

Kan AI för text-till-video åstadkomma professionell bildkvalitet?

Det är möjligt inom en tidsram på 5–15 sekunder. Resultatet från Seedance 2.0 och Veo 3 är ofta omöjligt att skilja från professionellt filmmaterial i korta klipp. För längre projekt används AI-video bäst som en del av materialet (B-roll, övergångsbilder, visuella effekter) snarare än som hela produktionen.

Hur skapar man effektiva uppmaningar för text-till-video-generering?

Följ formeln: Ämne + Handling + Miljö + Stil + Bild + Belysning. Beskrivningar av rörelser ska vara specifika, kamerarörelser tydligt definierade och atmosfären noggrant fastställd. Undvik motsägelser och avstå från att begära text-/UI-element. Upprepa successivt från enkelt till komplext. För mer information, se Prompt Writing Guide.

Vilket är bäst: text-till-video eller bild-till-video-generering?

Olika tillämpningar. Text-till-video erbjuder maximal kreativ frihet när inget referensmaterial finns tillgängligt. Bild-till-video ger större kontroll när det finns en specifik visuell utgångspunkt. De flesta proffs använder båda metoderna – text-till-video för utforskande arbete och bild-till-video för finjustering.

Kan AI-textgenererade videor användas kommersiellt?

De flesta betalda planer ger kommersiella rättigheter. Den betalda versionen av Seedance 2.0 inkluderar fullständiga kommersiella rättigheter och är fri från vattenstämplar. Användarvillkoren varierar mellan olika plattformar. Kontrollera de specifika policyerna innan användning. I Kina finns det för närvarande inga uttryckliga regleringsrestriktioner för kommersiell användning av AI-genererat innehåll, men det är tillrådligt att följa uppdateringar av de tillfälliga åtgärderna för administration av generativa artificiella intelligens-tjänster.

Kommer AI för text-till-video att ersätta redaktörer?

Det kommer inte att ersätta, utan snarare förändra roller. AI hanterar innehållsgenerering – skapar originella visuella tillgångar utifrån beskrivningar. Mänskliga redaktörer hanterar berättelsen, tempot, den emotionella resonansen, varumärkets konsistens och kreativa beslut som kräver mänskligt omdöme. År 2026 kommer det mest effektiva arbetsflödet att vara AI-generering + mänsklig redigering.

Börja skapa videor med text

År 2026 kommer AI för text-till-video att vara redo för professionella tillämpningar. Denna teknik har utvecklats från suddiga GAN-experiment till nästan filmiska DiT-resultat på bara fyra år och kan nu hantera innehåll på sociala medier, produktdemonstrationer, pedagogiska visualiseringar och kreativa utforskningar.

Det bästa sättet att lära sig är att börja skapa. Skriv en prompt, se resultaten och upprepa.

Gör din första paragraf till en video – prova Seedance gratis →

Vill du ha större kontrollprecision? Prova bild-till-video-generering →

Vill du fördjupa dig i tekniker för att skriva uppmaningar? Läs vår guide för att skriva uppmaningar →