Översikt

AI-videogenereringstekniken passerar sin viktigaste milstolpe sedan starten: audiovisuell synkronisering. År 2026 kommer de bästa AI-videogeneratorerna inte längre att producera tysta klipp som kräver manuell dubbning. De kommer att producera ljudeffekter som matchar rörelserna på skärmen, bakgrundsmusik synkroniserad med visuella stämningar och läppsynkroniserat tal som stöder flera språk – allt inom en enda genereringspipeline. Denna guide täcker: De tre huvudtyperna av AI-audiovisuell generering (ljudeffekter, musikkomposition, läppsynkronisering); Ett komplett arbetsflöde i sex steg för att skapa AI-musikvideor från grunden; Åtta verkliga tillämpningsscenarier, från indieartisters musikvideor till podcastvisualisering; Fem färdiga mallar; En omfattande jämförelse av alla ljudkompatibla verktyg; Plus avancerade tekniker som BPM-matchning och emotionell synkronisering. Om ditt videoinnehåll kräver ljud – vilket omfattar praktiskt taget all videoproduktion – representerar detta den mest betydande utvecklingen inom AI-video sedan text-till-video-generering. Börja skapa AI-musikvideor nu -->

Övergången från tysta AI-videor till perfekt läppsynkronisering är det största kvalitetssprånget i historien för AI-genererat innehåll. Uppgifter som tidigare krävde veckor av arbete av Hollywoods efterproduktionsteam kan nu utföras inom en enda generativ pipeline.

Ljudrevolutionen inom AI-video

Under en lång tid var AI-genererade videor ett i grunden ofullständigt medium. Bildkvaliteten förbättrades i en remarkabel takt – från suddiga sekunderslånga klipp i början av 2024 till minutlånga sekvenser med fotografisk realism i slutet av 2025. Men alla dessa videor hade en gemensam begränsning: de var tysta.

Den tysta eran: 2024 till början av 2025

Den första generationen av AI-videoverktyg – Runway Gen-2, Pika 1.0 och tidiga versioner av Keeling – kunde endast generera videomaterial. Det fanns inga ljudspår, inga ljudeffekter, ingen musik. Resultatet var en rent visuell MP4-fil som krävde manuell dubbning, mixning och synkronisering i ett separat redigeringsflöde. Detta var inte ett mindre besvär, utan en grundläggande klyfta mellan AI:s produktionsmöjligheter och publikens förväntningar.

Människans upplevelse av video är i hög grad multimodal. Neurovetenskaplig forskning visar konsekvent att ljudet bidrar med 50 % eller mer av den emotionella effekten i alla videoupplevelser. En filmisk landskapsbild, hur fotorealistisk den än må vara, skulle kännas platt och artificiell utan ljudet av vind, fågelsång eller en svällande soundtrack. En karaktär som talar utan ljud – med läppar som rör sig tyst – hamnar direkt i det kusliga dalen. Den ”tysta eran” av AI-video innebär att varje genererad klipp kräver omfattande efterbearbetning för att verka komplett.

För professionella kreatörer innebär detta att man måste upprätthålla två separata arbetsflöden för visuell generering och ljudproduktion, vilket fördubblar både tids- och kompetensbehovet. För vanliga kreatörer innebär det att AI-genererade videor alltid känns ofärdiga – imponerande som tekniska demonstrationer, men oanvändbara som slutgiltigt innehåll.

2025–2026: Konvergens mellan ljud och bild

Genombrott kommer i etapper. Googles Veo 3 har tillkännagivit inbyggda funktioner för ljudgenerering, vilket visar hur en enda modell samtidigt kan producera synkroniserad video och ljud. Det handlar inte om ljud som läggs på videon under efterproduktionen – ljudet genereras istället som en integrerad del av videoutmatningen, med omgivningsljud som exakt matchar händelserna på skärmen.

Ungefär samtidigt släppte Seedance 2.0 (utvecklat av ByteDances Seed-team) en omfattande ljudpaket med tre olika funktioner: AI-ljudeffekter (SFX) synkroniserade med videoinnehåll, AI-soundtrack anpassade efter visuella stämningar och AI-läppsynkroniseringsteknik som mappar tal till karaktärernas munrörelser (med stöd för åtta språk, inklusive kinesiska). Pika introducerade sin ljudeffektfunktion för grundläggande omgivande ljudlandskap. Dammluckorna för ljudfunktioner har verkligen öppnats.

Denna förändring är betydelsefull eftersom den förvandlar AI-video från "visuellt material som kräver manuell efterbearbetning" till "ett komplett, publiceringsklart medieformat". Klyftan mellan "AI-genererade klipp" och "färdigt videoinnehåll" har minskat från timmar av redigering till bara några minuters generering.

Särskild betydelse för kinesiska kreatörer: Denna omvandling innebär större möjligheter för inhemska kreatörer. Plattformar som Douyin, Kuaishou och Bilibili har skapat ett stort kreativt ekosystem för korta musikvideor. Även om oberoende musiker har byggt upp en publik på NetEase Cloud Music och QQ Music, saknar de ofta visuellt innehåll som motsvarar deras musikaliska kvalitet. AI-genererade musikvideor fyller direkt denna lucka – hemmaproducenter som skapar professionell musik på sina bärbara datorer kan nu skapa lika polerade musikvideor med hjälp av AI.

Varför ljud är den sista pusselbiten

Ta till exempel arbetsflödet för innehållsproduktion hos en Bilibili-innehållsskapare, Xiaohongshu-skapare eller oberoende musiker:

- Koncept – Vad handlar videon om?

- Bild – Hur ser videon ut?

- Ljud – Hur låter videon?

- Synkronisering – Är bild och ljud synkroniserade?

- Finputsning – Är den klar för release?

År 2025 hade AI-videoverktyg effektivt löst steg 1 och 2. Steg 3 och 4 förblev helt manuella. Med generatorer som hade ljudfunktioner kunde steg 1 till 4 nu slutföras med ett enda verktyg. Steg 5 – den sista finputsningen – förblir det enda manuella steget, även om dess nödvändighet minskar i takt med att kvaliteten på resultatet förbättras.

För musikvideoproduktion innebär detta en revolutionerande förändring. En oberoende musiker som tidigare aldrig hade råd med traditionella MV-produktionskostnader kan nu skapa en egen video. En Bilibili-skapare som producerar lo-fi-musik kan skapa visuella ackompanjemang för varje spår. Ett marknadsföringsteam kan producera produktreklam med perfekt matchade ljudspår utan att behöva anlita kompositörer eller köpa upphovsrättsskyddad musik.

Den aktuella situationen för verktyg med ljudfunktioner

I februari 2026 är det tre plattformar som leder fältet inom AI-genererade videor med integrerat ljud:

- Seedance 2.0: Den mest omfattande audiovisuella lösningen. Stöder generering av ljudeffekter, AI-driven soundtrack-/musikskapande och flerspråkig läppsynkronisering (8 språk inklusive kinesiska). Lämplig för både text-till-video- och bild-till-video-arbetsflöden. Som en ByteDance-produkt är den direkt tillgänglig i Kina utan VPN och stöder Alipay/WeChat Pay. Denna guide kommer främst att referera till denna plattform.

- Google Veo 3: Kraftfulla inbyggda funktioner för ljudgenerering, inklusive omgivningsljud och atmosfäriska effekter. Resultaten är imponerande, även om det saknar Seedances detaljerade kontroll över ljudtyper och stilar. **Kräver VPN för användning inom Kina. ** För en detaljerad jämförelse, se Seedance vs Veo 3 In-Depth Comparison.

- Pika 2.0: Grundläggande generering av ljudeffekter. Begränsad till omgivande SFX – ingen musikgenerering eller läppsynkronisering. På rätt väg, men inte en komplett ljudlösning. Kräver VPN.

Andra verktyg inom ekosystemet – Keeling, Runway och Conch AI – är vid skrivande stund fortfarande främst inriktade på ren visuell output, men förväntas snart följa efter. För en mer omfattande jämförelse av alla generatorer, se The Complete 2026 AI Video Generator Comparison.

Ytterligare alternativ för inhemska användare – verktyg för AI-musikgenerering: Utöver ljudfunktionerna i AI-videor finns det dedikerade plattformar för AI-musikgenerering i Kina som är värda att utforska: SkyMusic (producerad av Kunlun Wanwei, utmärkt för generering av kinesiska texter) och NetEase Tianyin (producerad av NetEase, integrerad med NetEase Cloud Music-ekosystemet). Dessa verktyg kan fungera som fristående musikskapandeprocesser, där den genererade musiken sedan importeras till Seedance som ljudreferensmaterial för videoproduktion.

Tre huvudtyper av AI-baserad audiovisuell generering

All AI-ljud är inte likadant. Denna teknik omfattar tre fundamentalt olika funktioner, som var och en tjänar olika kreativa syften och fungerar genom olika tekniska mekanismer. Att förstå dessa skillnader är avgörande för att välja rätt tillvägagångssätt för ditt projekt.

AI-ljudeffekter genereras genom att videoklippet analyseras bildruta för bildruta, där ljudalstrande handlingar och miljöer identifieras och matchande ljudvågor syntetiseras. Slutresultatet är omgivningsljud som är organiskt kopplat till det visuella innehållet.

Typ 1: AI-ljudeffekter (SFX)

AI-ljudgenerering producerar automatiskt omgivnings- och actionljud som matchar innehållet på skärmen. När karaktärer går längs en grusväg hör du fotsteg som knastrar på stenarna. När vågor slår mot klipporna hör du havets brus. När bilmotorer vrålar i en gatumiljö hör du motorljudet.

Hur Seedance Sound Generation fungerar: AI-modellen analyserar det visuella innehållet i den genererade videon – identifierar objekt, handlingar, miljöer och fysiska interaktioner – och producerar ett ackompanjerande soundtrack med motsvarande ljudeffekter. Det handlar inte bara om att matcha "hav" med ett arkivklipp av vågor. Modellen genererar unikt ljud som svarar på specifika visuella egenskaper: vågornas intensitet, deras avstånd från kameran, förekomsten av vind och miljöens akustiska egenskaper.

Sound Generation specialiserar sig på bearbetning av följande ljudtyper: – Omgivande atmosfäriska ljud (vind, regn, åska, skogsjud, stadstrafik) – Fysiska interaktionsljud (fotsteg på olika underlag, dörrar som öppnas/stängs, placering av föremål) – Naturliga ljud (vattenflöde, fågelsång, insektskvitter, prasslande löv)

- Mekaniska ljud (motorer, maskindrift, knapptryckningar, elektroniskt surrande)

- Slagljud (kollisioner, stänk, krossande, ras)

Tekniker för att antyda ljud genom uppmaningar: Även när du använder text-till-video-AI kan du påverka ljudutmatningen genom att beskriva ljudalstrande element i visuella uppmaningar. "Regn som slår mot ett plåttak" ger ett mer intensivt regnljud än "mild duggregn i en trädgård". Fotstegsljud från "tunga stövlar som stampar på ett metallgaller" skiljer sig helt från "bara fötter på varm sand". Visuella beskrivningar styr ljudgenereringen, så att skildra akustiskt rika scener ger mer komplexa ljudlandskap.

Nuvarande begränsningar: Ljudgenereringen är utmärkt för omgivande och naturliga ljud, men kan ha svårt med komplexa, flerskiktade ljudlandskap (som en livlig restaurang med överlappande samtal, klirrande bestick, köksljud och bakgrundsmusik). Den hanterar också organiska ljud bättre än mycket specifika, identifierbara ljudegenskaper (motorsoundet från en viss bilmodell, läten från en viss fågelart).

Typ två: AI-musik och soundtrack

AI-musikgenerering skapar bakgrundsmusik, soundtrack och originalkompositioner till dina videor som passar perfekt till det visuella innehållet, stämningen och rytmen. Det handlar inte bara om att lägga till generisk royaltyfri musik – AI:n genererar skräddarsydda originalkompositioner som är anpassade till filmen.

Stilkontroll: Du kan styra den musikaliska stilen genom uppmaningar och genereringsinställningar. Ett brett utbud av stilar stöds:

- Film Orchestral: Storslagna stråkar, blås och slagverk, perfekt för episka landskap eller dramatiska scener

- Dynamic Electronic: Livliga syntar och beats, perfekt för snabba innehåll, produktpresentationer eller sociala medier

- Ambient/Atmospheric Music: Mjuka texturer, lager på lager av toner och långa basgångar, perfekt för meditativa innehåll, fastighetspresentationer eller slow motion-bilder från naturen

- Lo-fi Hip-hop: Ikoniska varma, något falska beats i kombination med vinylknaster, perfekt för studie-/fokusinnehåll

- Spänning/Suspense: Dissonanta strängar, djupa slagverk och eskalerande brådska, perfekt för trailers och reklamfilmer

- Folk/ Akustisk: Gitarr, piano och organiska instrument, lämpligt för personligt, intimt innehåll

- Traditionell kinesisk/forntida stil: Guzheng, dizi, pipa och andra traditionella kinesiska instrument, lämpligt för traditionellt kinesiskt videoinnehåll och musikvideor i forntida stil -- Detta representerar den mest distinkta stilistiska inriktningen inom kinesisk AI-musikvideoproduktion.

Olika musikstilar ger upphov till tydligt olika vågformskarakteristika. AI-generering av soundtrack matchar inte bara genren utan anpassar även energikurvan, vilket synkroniserar musikens intensitet med den visuella handlingen i videon.

Längdmatchning: AI-genererad musik matchar längden på din video. Ett 5 sekunder långt klipp får en sammanhängande 5 sekunder lång musikalisk fras. En 30 sekunder lång video får ett strukturerat stycke med introduktion, utveckling och avslutning. Detta eliminerar det vanliga problemet med att manuellt tona in/ut stockmusik som aldrig är utformad för just din videolängd.

Skillnader jämfört med fristående AI-musikverktyg: Du kanske redan är bekant med dedikerade AI-musikgeneratorer som Suno eller Udio, som skapar fristående musikspår utifrån textprompter. Dessa verktyg producerar utmärkt musik, men saknar visuell medvetenhet – de har ingen kunskap om hur din video ser ut, när viktiga visuella ögonblick inträffar eller hur stämningen skiftar inom filmen. AI-soundtrackgenerering i videoverktyg som Seedance fungerar på ett helt annat sätt, eftersom musiken genereras som svar på det visuella innehållet. Musiken intensifieras när bilderna blir mer dramatiska, dess rytm anpassas efter rörelserna på skärmen och dess atmosfär matchar stämningen i varje scen.

Med andra ord kompletterar fristående AI-musikverktyg och AI-videogeneratorer varandra. Ett robust arbetsflöde innebär att man först genererar ett spår i Suno eller Udio (eller inhemska alternativ som SkyMusic och NetEase Tianyin) och sedan använder den ljudfilen som referens för att generera video i Seedance. AI-videogeneratorn skapar bilder som svarar mot musikens struktur. Vi kommer att beskriva detta arbetsflöde i detalj i steg-för-steg-guiden nedan.

Typ tre: AI-läppsynkronisering och tal

AI-läppsynkronisering ställer de högsta tekniska kraven av de tre ljudtyperna. Den mappar talat ljud – oavsett om det är uppladdat eller genererat – till en karaktärs läpprörelser, vilket skapar en visuell effekt av att karaktären på skärmen talar eller sjunger.

Flerspråkigt stöd: Seedance 2.0 stöder läppsynkronisering på åtta språk, inklusive kinesiska, engelska, japanska, koreanska, spanska, franska, tyska och portugisiska. Detta går utöver ren ljuddubbning – modellen justerar karaktärernas munformer, käkrörelser och mikrouttryck i ansiktet för att matcha de vokala egenskaperna i varje språk. Munformen för den kinesiska vokalen "o" skiljer sig från den engelska "O", medan den japanska vokalen "u" skiljer sig från den engelska "u". Exakt läppsynkronisering måste ta hänsyn till dessa språkliga variationer.

Den praktiska betydelsen av kinesisk läppsynkronisering: För inhemska kreatörer gör kinesisk läppsynkronisering det möjligt för AI-genererade karaktärer att framföra dina låtar på standardmandarin eller exakt matcha snabba kinesiska texter i rapmusikvideor. Detta har en enorm kreativ potential inom TikTok och Bilibilis coverlåt- och anime-communityn – virtuella AI-sångare växer fram som ett nytt innehållsformat.

AI-läppsynkronisering förvandlar en visuellt verklighetstrogen men tyst karaktär till en talande närvaro. Denna teknik justerar inte bara munformen utan modifierar även käkens position, kindernas spänning och subtila mikrouttryck i ansiktet för att matcha talets fonem.

Så här fungerar det: Processen börjar med en ljudreferens – antingen en röstinspelning som du laddar upp eller AI-genererat tal. Modellen analyserar ljudets fonetiska innehåll (vilka ljud som produceras vid vilka tidpunkter) och genererar motsvarande läppformer och ansiktsrörelser bildruta för bildruta. För optimala resultat bör ljudet innehålla tydligt tal i måttlig takt med minimalt bakgrundsljud.

Användningsscenarier:

- Digitala människor och virtuella karaktärer: Skapa talande AI-värdar för Bilibili/YouTube-kanaler, företagsutbildning eller kundservice

- Animerade karaktärer: Röst-AI-genererade animerade karaktärer utan läppsynkronisering bildruta för bildruta

- Flerspråkig dubbning: Skapa läppsynkroniserade versioner av befintligt audiovisuellt innehåll på andra språk, där det nya ljudet matchar karaktärernas munrörelser.

- Musikvideoframträdanden: Synkronisera sångarnas visuella framträdanden med sångspår för att skapa autentiska musikvideoframträdandeeffekter.

- Podcast- och ljudboksvisualisering: Omvandla rent ljudinnehåll till visuella medier med talande karaktärer.

Nuvarande begränsningar – ärlig bedömning: Lipsynkning är fortfarande den yngsta och minst utvecklade av de tre audiovisuella typerna. Även om betydande framsteg har gjorts kvarstår vissa utmaningar. Snabb talhastighet överskrider ibland modellens kapacitet att generera matchande läpprörelser, vilket resulterar i en viss desynkronisering. Extrema ansiktsvinklar (sidoprofil, extrema uppåtvinklar) minskar lipsynkningsnoggrannheten på grund av färre synliga referenspunkter i munnen. Tal med uttalade accenter eller ovanliga röstegenskaper kan ge mindre exakta resultat än standardtal. För kinesiska låtar med extremt snabbt tempo, såsom rap, kan synkroniseringsnoggrannheten vara lägre än för sång med standardtempo. Även om tekniken utvecklas snabbt är det viktigt att ha rimliga förväntningar – lipsynkronisering år 2026 är utmärkt i standardscenarier men är fortfarande under utveckling för extrema fall.

Steg-för-steg-guide: Skapa AI-musikvideor från grunden

Genom att följa denna sexstegsprocess kan du skapa en komplett AI-musikvideo med synkroniserat ljud och bild, från idé till färdig produkt. Oavsett om du är en oberoende musiker som skapar din första musikvideo, en Bilibili-innehållsskapare som bygger en musikdriven kanal eller en marknadsförare som producerar varumärkesvideor, är denna process tillämplig.

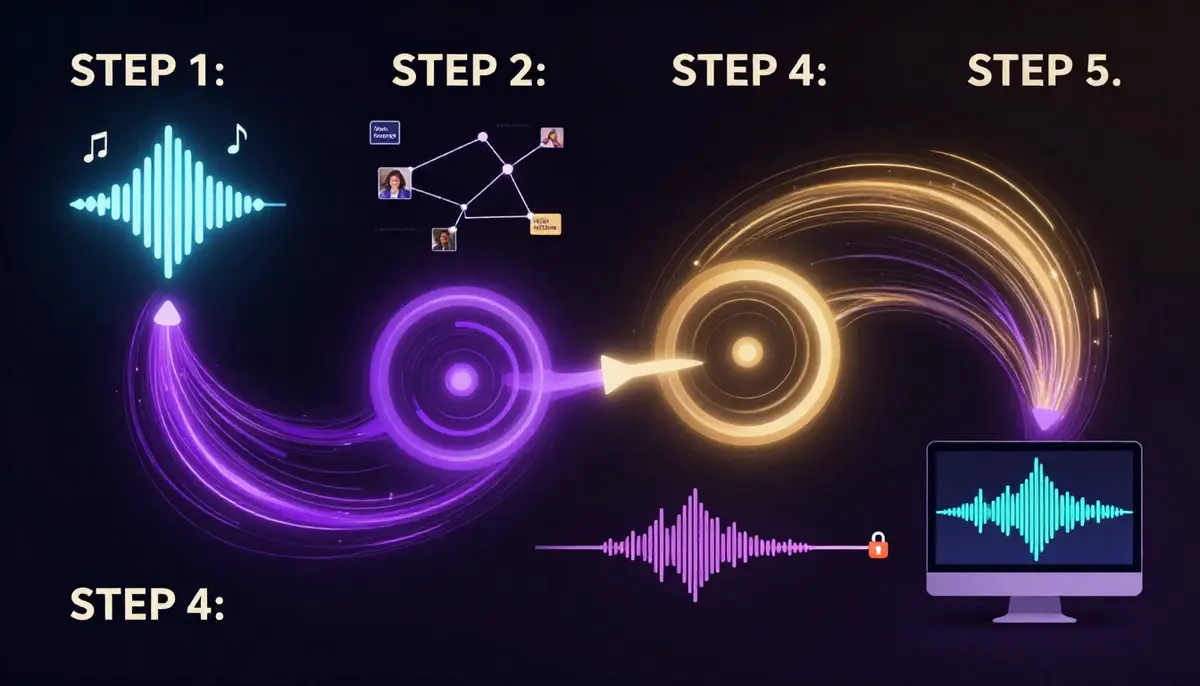

Ett komplett arbetsflöde för AI-musikvideor, från ljudkälla till färdig produkt. Varje steg bygger på det föregående, och audiovisuell synkronisering uppnås automatiskt under genereringen.

Steg 1: Förbered din musik eller ljudkälla

Varje musikvideo börjar med musiken. Du har tre alternativ:

Alternativ A – Använd din egen musik: Om du är musiker eller har licensierade låtar, förbered dina ljudfiler. Format som stöds är vanligtvis MP3, WAV och AAC. För bästa resultat, använd högkvalitativa master- eller mixversioner (inte komprimerade streaming-rippningar). Rent, välseparerat ljud ger överlägsen läppsynkronisering jämfört med kraftigt komprimerade filer.

Alternativ B – Skapa musik med AI först: Använd fristående AI-musikgeneratorer för att skapa originella låtar. Utländska verktyg inkluderar Suno och Udio. Inom landet kan du överväga SkyMusic (utmärkt för att generera kinesiska texter, stöder flera kinesiska musikstilar) eller NetEase Tianyin (integrerat med NetEase Cloud Music-ekosystemet). Beskriv önskad stil, stämning, tempo och arrangemang för att generera flera versioner och välj den som bäst matchar ditt visuella koncept. Spara lokalt.

Alternativ C – Fullständig AI-kontroll: Om du saknar en specifik ljudkälla och vill att AI ska generera både bild och ljud samtidigt, hoppa över ljudförberedelserna och förlita dig direkt på Seedances inbyggda soundtrackgenerering. I det här scenariot kommer dina visuella uppmaningar att påverka det musikaliska resultatet. Detta är det snabbaste tillvägagångssättet, men det ger mindre kontroll över den exakta musikaliska effekten.

Råd till musiker: Om du vill att bilderna ska reagera på specifika ögonblick i musiken – en beat drop, ett tonartsbyte, en sånginsats – anteckna dessa tidpunkter. Du kommer att använda denna information i dina instruktioner och kan skapa segment som passar in i låtens struktur.

Steg två: Skapa visuella ledtrådar som kompletterar musiken

Dina visuella signaler bör förmedla bilder som kompletterar ljudet på ett naturligt sätt. Det handlar inte om att illustrera texten ord för ord, utan snarare om att skapa en visuell atmosfär som förstärker musikens emotionella innehåll.

Matcha musikstil med visuell stil:

| Musikstil | Visuell inriktning | Nyckelord |

|---|---|---|

| Filmisk orkester | Vidsträckta landskap, dramatiska himlar, episk skala | "vidsträckt", "majestätisk", "långsam dolly", "IMAX-kvalitet" |

| Lo-fi / Avkoppling | Mjuka toner, mysiga interiörer, duggregn, varm belysning | "pastell", "mjuk fokus", "varm", "mild rörelse" |

| Dynamisk elektronisk | Snabba klipp, neon, urban, dynamiska bilder | "levande", "dynamisk", "neon", "snabbt tempo" |

| Lyrisk ballad | Intima närbilder, levande ljus, slow motion | "intim", "kort skärpedjup", "varma toner" |

| Mörkt/dramatiskt | Skuggor, hög kontrast, spänning, minimalistisk färgpalett | "dramatisk belysning", "silhuett", "hög kontrast" |

| Kinesisk/forntida stil | Landskap, paviljonger och torn, element i tuschteckning, fallande blomblad | "Kinesiskt landskap", "tuschmålningsstil", "traditionell arkitektur", "eterisk" |

| Rap/Hip-hop | Gatubilder, graffiti, nattlandskap, bilstrålkastares halos | "urban", "gatukultur", "neonskyltar", "dynamisk handhållen" |

För omfattande tekniker för bildtexter, se Seedance Prompting Guide. Grundläggande principer för bildtexter till musikvideor: beskriv rörelser som känns naturliga i takt med låtens rytm. Snabba låtar kräver dynamiska bilder, medan långsammare låtar kräver stadiga, graciösa rörelser.

Steg tre: Välj ljudläge

När du genererar i Seedance, välj lämpligt ljudläge utifrån ditt projekt:

Ljudeffekter (SFX)-läge: Perfekt när din video innehåller tydliga miljö- eller actionelement som kräver autentiska omgivningsljud. En bil som kör i regn ska låta som en bil i regn. Havsscener ska innehålla ljudet av vågor. SFX-läget genererar automatiskt dessa ljud baserat på videomaterialet.

Musik-/ljudspårläge: Perfekt när du vill att AI:n ska generera bakgrundsmusik som kompletterar det visuella innehållet. Använd detta när det inte finns några färdiga spår tillgängliga och du vill att verktyget ska skapa originella ljudspår. Du kan påverka stilen genom visuella uppmaningar – ett neonfärgat cyberpunk-stadslandskap genererar helt annan musik än en lugn soluppgång i bergen.

Röst-/läppsynkroniseringsläge: Perfekt när din video innehåller karaktärer som talar eller sjunger och du behöver synkronisera ljudet med munrörelserna. Ladda upp din sångspår eller röstinspelning så genererar AI:n matchande läpprörelser för karaktären.

Kombinerad metod: För en så omfattande musikvideo-upplevelse som möjligt bör du överväga ett arbetsflöde i flera steg. Börja med att skapa en grundläggande video med bild och musik med hjälp av soundtrack-läget. Om omgivande ljudeffekter behöver läggas över musiken kan du använda SFX-läget i ett andra steg eller lägga till dem under efterproduktionen. Om karaktärerna behöver sjunga kan du bearbeta detta med hjälp av läppsynkroniseringsläget på sångspåret.

Steg fyra: Ladda upp referensmaterial (valfritt men starkt rekommenderat)

Referensinmatningar kan avsevärt förbättra kvaliteten och noggrannheten hos utmatningen. För produktion av musikvideor är följande typer av referenser särskilt användbara:

Ljudreferensfil: Ladda upp ditt musikspår. AI kommer att använda det som ljudskelett för videon och generera bilder som svarar på musikens innehåll. Detta är den enskilt mest inflytelserika referensen i MV-produktion.

Referensbild: Ladda upp en statisk bild som visar den visuella stil du önskar. Det kan vara ett albumomslag, en skärmdump från ett moodboard, en bildruta från en befintlig musikvideo du gillar eller en AI-genererad bild som fångar den estetik du önskar. Seedances text-till-video-funktion använder denna referens för att upprätthålla visuell konsistens.

Referensvideo: Om du har en befintlig musikvideo vars kamerarörelser, redigeringsrytm eller visuella stil du vill efterlikna, ladda upp den som referens. AI:n kommer att lära sig rörelsemönster, övergångstider och visuell komposition från din referens medan den genererar originalt innehåll.

Steg fem: Skapa och justera audiovisuell synkronisering

Klicka på "Generera" för att låta AI:n producera det initiala resultatet. Under granskningen bör du vara särskilt uppmärksam på läppsynkroniseringens noggrannhet:

Viktiga kontrollpunkter:

- Stämmer den musikaliska energin överens med den visuella energin? Ett dramatiskt orkesterkrescendo bör sammanfalla med ett visuellt dramatiskt ögonblick, inte en statisk scen.

- Är ljudeffekternas timing korrekt? Fotsteg bör höras när foten kommer i kontakt med marken. Slagljud bör matcha visuella kollisioner.

- Är läppsynkroniseringen övertygande? Observera karaktärernas munnar vid normal visningshastighet. Mindre avvikelser på bildnivå är osynliga vid normal hastighet men blir tydliga i slow motion – och din publik tittar i normal hastighet.

- Är den övergripande atmosfären sammanhängande? Den visuella färgpaletten, musikens tonalitet och arrangemang samt rytmen bör tillsammans förmedla samma emotionella berättelse.

Om synkroniseringen visar sig vara problematisk: Generera om efter att ha modifierat prompten. Om musiken visar sig vara för intensiv för bilderna, införliva ytterligare dynamiska element i den visuella prompten. Om bilderna visar sig vara för snabba för en långsam låt, inkludera tempoangivande termer som "långsam", "mild" eller "medveten" i prompten. AI:n kommer att reagera på dessa rytmiska signaler.

Steg sex: Exportera de färdiga ljud- och videofilerna

När du är nöjd exporterar du den färdiga musikvideon. Resultatet är en enda fil som innehåller både video- och ljudspår som redan är synkroniserade – du behöver inte manuellt justera ljudet i redigeringsprogrammet.

Exportanmärkningar:

- Format: MP4 (H.264-video + AAC-ljud) är den universella standard som accepteras på alla plattformar

- Upplösning: Exportera med högsta tillgängliga upplösning. För musikvideor är 1080p minimikravet; 2K eller 4K är att föredra

- Bildformat: 16:9 för Bilibili/YouTube och standarddistribution av musikvideor; 9:16 för Douyin, Kuaishou, Xiaohongshu och Instagram Reels; 1:1 för WeChat Moments och Instagram-flödet

- Ljudkvalitet: Se till att exportinställningarna bevarar ljudkvaliteten. Om högkvalitativa masterfiler laddas upp bör exporten bibehålla denna kvalitetsnivå.

Valfria steg efter export: Även om AI-genererade musikvideor kan publiceras direkt, kanske du vill lägga till sista finputsningen i en videoredigerare: titelkort, textundertexter, artist-/skivbolagslogotyper, sektionsövergångar eller färgkorrigering. Vanliga inhemska verktyg som CapCut, DaVinci Resolve eller Premiere är väl lämpade för denna sista finputsning. Innan du publicerar på Bilibili, kom ihåg att lägga till undertexter och en omslagsbild – dessa är avgörande för Bilibilis rekommendationsalgoritm.

Skapa din första AI-musikvideo nu -->

8 viktiga användningsområden för AI-musikvideor

AI-musikvideogenerering är inte en teknik med ett enda syfte. Fusionen av visuell skapande med synkroniserat ljud öppnar upp kreativa möjligheter inom olika typer av innehåll och branscher. Nedan följer åtta specifika tillämpningsscenarier, var och en åtföljd av riktade operativa riktlinjer.

Åtta olika tillämpningsscenarier för generering av AI-musikvideor, var och en med unika visuella stilar, ljudkrav och målgrupper. Samma kärnteknologi anpassar sig till helt olika kreativa riktningar.

- Oberoende musikers musikvideo

Möjlighet: Oberoende musiker har länge brottats med en smärtsam skillnad – klyftan mellan musikalisk kvalitet och nivån på det åtföljande visuella innehållet. En sovrumsproducent kan skapa polerade, färdiga låtar på en bärbar dator, men att producera en matchande musikvideo kostar traditionellt mellan 2 000 och 15 000 pund. Även den mest grundläggande inspelningen har ett högt pris. AI-generering av musikvideor har helt eliminerat denna kostnadsbarriär.

Unikt värde i Kina: Den inhemska oberoende musikscenen (hiphop, elektronisk musik, traditionell kinesisk musik, folkmusik) har blomstrat under de senaste åren. Antalet oberoende artister på NetEase Cloud Music och QQ Music fortsätter att växa, men de allra flesta av deras verk består endast av ljud och saknar musikvideor. I Bilibilis musiksektion får bidrag med högkvalitativa bilder betydligt högre rekommendationsvikt än de som endast består av ljudspår i kombination med statiska omslag. AI-musikvideor ger alla oberoende musiker möjlighet att skapa visuella verk.

Procedur: Ladda upp den färdiga låten till Seedance som ljudreferens. Komponera visuella ledtrådar som fångar låtens känslomässiga båge – inte en scen-för-scen-illustration av texten, utan bilder som väcker samma känslor. Psykedelisk pop lämpar sig för mjuka, eteriska och svävande bilder. Lo-fi-kompositioner passar bra ihop med varma, nostalgiska urbana scener. Experimentell elektronisk musik passar abstrakt, surrealistisk bildspråk. Kinesisk musik kompletterar landskap målade med tuschteckning, forntida arkitektur och scener med fallande blomblad.

Bästa praxis för fristående musikvideor: Om en låt har tydliga avsnitt, överväg att dela upp produktionen. Skapa en visuell stil för verserna, en annan för refrängen och en tredje för bryggan. Sätt sedan ihop dem med hjälp av övergångar i redigeringsprogram som ShineVideo eller DaVinci Resolve. Varje avsnitt har sin egen visuella identitet, medan musiken skapar kontinuitet.

Rimliga förväntningar: År 2026 kommer AI-genererade musikvideor att utmärka sig inom stiliserade, atmosfäriska och abstrakta visuella riktningar. De kommer att fungera mindre effektivt för narrativa eller prestationsbaserade musikvideor som kräver specifika skådespelare för att utföra koreograferade rörelser eller filma på särskilda platser i den verkliga världen. Utnyttja AI:s styrkor: atmosfär, surrealism och visuell poesi.

- Lyrikvideor

Möjligheter: Lyric-videor har blivit ett standardformat för lanseringar – ofta släpps de före eller samtidigt med officiella musikvideor. De driver upp strömningsuppspelningar, tillgodoser lyssnare som är intresserade av texter och fungerar som den första visuella kontaktpunkten för nya låtar. Traditionell produktion av lyric-videor kräver motion graphics-design, textanimation och bakgrundsbilder. AI förenklar detta till uppmaningar + textöverlägg.

Procedur: Skapa atmosfäriska visuella loopar som matchar låtens stämning. Efter export lägger du till överlagrade texter i ShineVideo, After Effects eller Canva Video. AI sköter den visuella bakgrunden, du sköter typografin.

Bästa praxis: Använd långsamma, mjuka kamerarörelser som inte konkurrerar om uppmärksamheten med texten. Undvik visuellt röriga scener – texterna måste vara tydligt läsbara mot bakgrunden. Skapa bilder med ett färgschema som ger bra kontrast mot den valda textfärgen. När du publicerar textvideor på Bilibili och NetEase Cloud Music, kom ihåg att synkronisera uppladdningarna till motsvarande musikplattformar för att uppnå dubbel exponering.

- Bilibili/YouTube-bakgrundsmusikvideor

Möjligheter: "Lo-fi-musik för studier", "regn ljud för sömn", "meditationsmusik" – kanaler på Bilibili och YouTube som genererar massiva visningar genom en enkel formel: högkvalitativt ljud i kombination med en visuell loop. Några av YouTubes största musikkanaler är helt uppbyggda på denna modell. Bilibilis "livestreams för studier" och "vitt brus"-sektioner är lika populära. AI gör det mycket enkelt att skapa både ljud och bild samtidigt.

Metod: Skapa en loopad visuell scen – ett mysigt rum med regn som faller utanför fönstret, en stadssilhuett på natten och en animerad karaktär som sitter vid ett skrivbord. Accompagnera med långvarig AI-genererad lo-fi- eller ambientmusik. För YouTube-optimering exporterar du i bildformatet 16:9 med en upplösning på minst 1080p och införlivar relevanta nyckelord i titeln, beskrivningen och taggarna. För Bilibili lägger du till taggar som ”lärande”, ”vit brus” eller ”sömnhjälp” och väljer lämplig kategori för inlämning.

Intäktsmodell: De mest populära YouTube-kanalerna kan tjäna mellan 5 000 och 50 000 dollar per månad (cirka 3 600 till 36 000 pund) enbart från reklamintäkter. Bilibilis incitament för kreatörer är relativt blygsamma, men intäkter kan genereras genom prenumerationer på premiuminnehåll, intäktsdelning för medlemmar och reklamplaceringar. Nyckeln ligger i konsekventa uppdateringar: regelbundna uppladdningar och uppbyggnad av ett innehållsbibliotek gör att algoritmen kan fungera effektivt. AI-genererat innehåll gör det möjligt för en enskild kreatör att upprätthålla en daglig publiceringsrytm.

4. TikTok/Kuaishou/Xiaohongshu korta musikvideor

Möjligheter: TikTok, Kuaishou, Xiaohongshu, Instagram Reels, TikTok och YouTube Shorts prioriterar alla videoinnehåll med musik. Inlägg med ljud får genomgående betydligt högre engagemang än inlägg utan ljud eller som endast består av text. För varumärken och kreatörer innebär den kontinuerliga produktionen av korta videoinnehåll med ljudspår en oavbruten maraton av innehåll. AI-teknik komprimerar produktionscyklerna från timmar till bara några minuter.

Funktionssätt: Skapa en 5–15 sekunder lång vertikal video (9:16) och aktivera ljudspårläget. AI:n kommer samtidigt att producera bilderna och matchande musik. Om du vill använda populärmusik från plattformen, skapa först bilderna och lägg sedan till trendig bakgrundsmusik i TikTok/Kuaishous inbyggda redigerare. Om du vill ha originalljud, låt AI:n komplettera hela paketet.

Rekommendationer för inhemska plattformar för korta videoklipp:

- Douyin: De första 1–2 sekunderna måste innehålla en visuell hook. Använd ord som ger omedelbar visuell effekt – dramatiska avslöjanden, starka färger eller oväntade rörelser. Douyin har ljud på som standard, så ljudkvaliteten är avgörande redan från första bildrutan.

- Kuaishou: Kelin (utvecklat av Kuaishou) samverkar naturligt med Kuaishous ekosystem. Om Kuaishou är din primära plattform, överväg ett kombinerat arbetsflöde: skapa bilder i Kelin och lägg till ljud i Seedance.

- Xiaohongshu: Vertikala videor i formatet 9:16 i kombination med stämningsfull musik fungerar exceptionellt bra på Xiaohongshu. Konstnärligt, terapeutiskt och ASMR-orienterat AI-musikvideoinnehåll passar exceptionellt bra med Xiaohongshus användarbas.

- Podcastvisualisering

** Möjlighet: Podcastskapare står inför en distributionsutmaning. Deras innehåll är rent ljudbaserat, men de stora plattformarna (Bilibili, YouTube, Douyin, Xiaohongshu) prioriterar video. ”Podcastvisualisering” – den dynamiska visuella representationen av ljudinnehåll – löser detta genom att ge ljudmaterialet en visuell form som passar videoplattformar. Traditionell podcastvisualisering kräver programvara för rörlig grafik och designkunskaper. AI genererar dessa automatiskt.

Hur det fungerar: Ladda upp ditt podcast-ljudklipp till Seedance. AI-tekniken genererar dynamiska bilder som svar på ljudet – intensitet, rytm och tonförändringar i rösten ger motsvarande visuella förändringar. Alternativt kan du komponera en visuell prompt som representerar temat för din podcast, så genererar AI-tekniken en stämningsfull visuell loop som ackompanjerar ljudet.

Bilibili-strategi: Bilibili har vuxit fram som en av Kinas största plattformar för långa videoklipp, och många framstående poddare släpper nu videoversioner av sitt innehåll där. Ett AI-genererat visuellt komplement förvandlar rena ljudpoddar till Bilibili-kompatibla videoklipp med minimal ansträngning. Även enkla visuella loopar fungerar betydligt bättre för Bilibilis rekommendationsalgoritm än en statisk miniatyrbild.

- Produktreklamens soundtrack

Möjlighet: Produktvideor med passande musik uppnår betydligt högre konverteringsgrader än produktvideor utan ljud. Att licensiera musik för kommersiellt bruk kostar dock mellan 500 och 5 000 RMB per spår, medan det är ännu dyrare att anlita kompositörer för att skapa skräddarsydda soundtracks. AI-genererade soundtracks eliminerar både kostnader och upphovsrättsliga komplikationer – den genererade musiken är original och kan användas kommersiellt.

Procedur: Skapa visuellt innehåll enligt arbetsflödet för produktvideor och aktivera sedan ljudspårläget för att lägga till passande musik. För premiumproduktpresentationer kan du skapa filmisk orkestermusik eller ambientmusik. För dynamiska produktlanseringar kan du skapa energisk elektronisk musik. AI anpassar automatiskt musikens energi till det visuella innehållet.

Fördelar med upphovsrätt: En viktig fördel med Seedances AI-genererade musik är att resultatet är originellt – det är inte samplat från befintliga upphovsrättsskyddade låtar. Detta eliminerar risken för upphovsrättsliga klagomål i samband med användning av igenkännbar musik i reklam. Med det betalda abonnemanget behåller du kommersiella användningsrättigheter för det genererade resultatet, vilket gör det möjligt att använda det i reklam utan ytterligare upphovsrättsavgifter. När du lägger upp produktvideor på e-handelsplattformar som Taobao, JD.com och Douyin Shop behöver du inte oroa dig för att innehållet ska tas bort på grund av upphovsrättsintrång i musiken.

- Spel- och applikationstrailers

Möjlighet: Speltrailers och förhandsvisningsvideor för appar är starkt beroende av audiovisuell synkronisering. Dramatiska pauser innan bossen avslöjas, den lager på lager-uppbyggda nedräkningen, ljudeffekterna från kraftfulla färdigheter – dessa ögonblick existerar i skärningspunkten mellan ljud och bild. AI-genererade trailers gör det möjligt för indie-spelutvecklare och appskapare att uppnå en produktionskvalitet som är i nivå med AAA-studior.

Funktionssätt: Ställ in ljudspårläget på "Cinematic" eller "Drama" för att skapa dramatiska, energirika visuella sekvenser. Skriv uppmaningar som beskriver handling, effekt och visuella effekter. Ladda upp skärmdumpar från spelet eller konceptkonst som referensbilder för att upprätthålla visuell konsistens med den faktiska produkten. Lägg på UI-element, spelbilder och textkommentarer under efterproduktionen.

Ljudfokus: Speltrailers är ett av de viktigaste användningsområdena för ljudkvalitet. Ljudspåret måste bygga upp spänningen gradvis, nå sin höjdpunkt vid precis rätt ögonblick och avslutas med en tillfredsställande upplösning. Om AI:ns initiala komposition inte passar trailerns rytm, skapa en ny eller använd fristående AI-musikverktyg för att skapa ett skräddarsytt spår och importera det sedan som ljudreferens. När du publicerar speltrailers på plattformar som TapTap, Bilibilis spelavdelning eller WeGame är högkvalitativ audiovisuell synkronisering avgörande för att fånga användarnas uppmärksamhet.

8. Höjdpunkter från bröllop och evenemang

Möjlighet: Personliga evenemangsvideor – bröllop, examensfester, årsdagar, födelsedagar – är det mest känslomässigt berörande videoinnehållet som människor skapar. Professionell evenemangsvideografi kostar vanligtvis mellan 500 och 3 000 pund i Storbritannien. Många har hundratals evenemangsfoton men saknar videofilmer. AI kan omvandla dessa bilder till filmiska höjdpunkter med stämningsfull musik och skapa professionella resultat från mobilfoton.

Metod: Välj ut dina 10–20 bästa evenemangsfoton. Använd Seedances bild-till-video-funktioner för att ge varje bild subtila rörelser: försiktiga zoomningar, mjuka linsförskjutningar och skiftande ljuseffekter. Aktivera soundtrackläget och beskriv den emotionella ton du önskar: ”varm, emotionell, akustisk gitarr och piano, känslan av bröllopets första dans”. AI-tekniken genererar en video för varje klipp med passande musik. Sätt ihop dem till en komplett highlight-film med hjälp av redigeringsappen.

Varför det fungerar så bra: Evenemangsfotografier har i sig en djup emotionell betydelse för dem som finns med på bilderna. Genom att lägga till subtila rörelser får de liv. Om man kombinerar dem med musik som matchar stämningen höjs de till filmisk kvalitet. Denna kombination förvandlar ett bildspel till något som känns som en riktig film – till praktiskt taget ingen kostnad jämfört med att anlita en videograf efter evenemanget. Att dela sådana sammanställningar på WeChat Moments eller TikTok ger mycket bättre resultat än en enkel fotocollage med nio rutor.

Mall för AI-musikvideo

Följande fem mallar är utformade för specifika musikvideostilar. Varje uppsättning innehåller visuella mallar, rekommenderade ljudstilar och genereringsparametrar. Kopiera och använd direkt, och justera efter behov för specifika projekt.

Observera: Alla ledord ska förbli på engelska, eftersom Seedance har bäst förståelse för engelska ledord. Varje mall åtföljs av förklarande anteckningar på kinesiska.

Mall 1: Filmisk musikvideo

Visuell ledtråd:

A silhouette walking through neon rain on a deserted downtown street

at midnight. Puddles on the asphalt reflect towering LED billboards

in magenta, cyan, and gold. Steam rises from a subway grate, curling

through the neon light. The camera tracks slowly behind the figure,

maintaining a medium-wide shot. Rain streaks catch the colored light

like falling sparks. The figure pauses at a crosswalk, head tilted

upward toward the glowing signs. Cinematic anamorphic lens with

horizontal flares. Blade Runner atmosphere. Moody, contemplative,

visually rich. 4K ultra-realistic.Midnatt. En silhuett korsar de öde gatorna i stadens centrum under ett neonregn. Pölar på asfalten reflekterar gigantiska LED-skyltar i magenta, cyan och guld. Ånga stiger upp från tunnelbanans ventilationsöppningar och virvlar runt i neonskimret. Kameran följer långsamt efter figuren bakifrån. Anamorfisk lins, Blade Runner-liknande atmosfär.

Rekommenderad ljudstil: Filmisk synthwave eller ambient elektronisk musik. Mörka pulserande basgångar överlagrade med eteriska synthpads. Långsamt tempo (70–85 BPM). Framkallar känslan av Vangelis möter M83.

Parametrar: Bildformat 16:9. 10 sekunders längd. Ljudspår aktiverat. Högsta tillgängliga upplösning.

Lämpliga scenarier: Stämningsfulla musikvideor för elektronisk musik, synthpop eller indiemusik. Kan även användas för kortfilmer med filmisk stämning och varumärkesvideor. Särskilt väl lämpad för Bilibilis musiksektion och innehåll med elektronisk musik.

Mall två: Drömmande Lo-fi

Visuell ledtråd:

Soft pastel clouds drifting over a quiet city at twilight, seen

through the rain-speckled window of a cozy apartment. A desk lamp

casts warm amber light over a cluttered workspace with vinyl records,

a steaming mug, and scattered handwritten notes. Raindrops trace

slow paths down the window glass. The city lights beyond are soft,

blurred circles of warm white and gentle orange. Camera holds a

static medium shot with extremely shallow depth of field focused on

the raindrops. The background city breathes with gentle, slow

ambient motion. Warm, nostalgic, intimate. Film grain. 24fps

cinematic quality.I skymningen driver mjuka pastellfärgade moln över den tysta staden, sedda genom det regniga fönstret i en mysig lägenhet. En skrivbordslampa sprider ett varmt, bärnstensfärgat sken och belyser en arbetsbänk full av vinylskivor, en ångande mugg och utspridda handskrivna anteckningar. Regndroppar rinner långsamt nerför fönsterrutan. Stans avlägsna ljus syns som mjuka, suddiga halos i varmvitt och blekt orange. Värme, nostalgi, intimitet.*

Rekommenderad ljudstil: Lo-fi hip-hop. Vinylknaster, lätt ostämda pianokord, mjuka kick-snare-rytmer, varm bas. Tempo: 70-80 BPM. Chillhop Records-estetik.

Parametrar: Bildformat 16:9 eller 1:1. Längd 10 sekunder (avsedd för loopning). Ljudspår: lo-fi/ambient. Perfekt för lo-fi-livestreams på Bilibili och YouTube när den loopas.

Lämpliga scenarier: Lo-fi-musikkanaler, innehåll för studier/koncentration/sömnhjälp, avslappnande spellistor och stämningsfulla inlägg på Xiaohongshu. Sådant innehåll är mycket populärt inom Bilibilis kategorier "studielivestreams" och "vitt brus".

Mall tre: Hög energi

Visuell ledtråd:

Fast-paced montage of urban sports and street culture. A skateboarder

launches off a concrete ledge in slow motion, wheels spinning, body

twisted mid-air. Quick cut to a BMX rider grinding a rail with

sparks flying. Cut to a basketball spinning on a fingertip against

a graffiti-covered wall. Each scene is lit by harsh, directional

afternoon sun creating sharp shadows. Colors are high-contrast and

saturated: electric blue sky, warm concrete orange, vivid graffiti

greens and pinks. Dynamic handheld camera with intentional shake.

Rapid scene transitions. 120fps slow-motion bursts within fast

editing. GoPro meets professional sports broadcast. 4K ultra-sharp.Kinesisk tolkning: En snabb montage av urbana sporter och gatukultur. Slowmotionbilder av skateboardåkare som hoppar från betongtrappor, snurrande hjul, kroppar som vrider sig i luften. Snabb klippning till BMX-cyklister som grinder på räcken, gnistor flyger. Klippning till en basketboll som snurrar på fingertopparna framför en graffitivägg. Kontrastrika, mättade färger. Dynamiskt handhållet kameraarbete, snabba scenövergångar.

Rekommenderad ljudstil: Energisk hiphop eller elektronisk musik. Kraftfull 808-bas, trap-hi-hats, aggressiva synthstabs. Tempo: 130–150 BPM. Travis Scotts produktionsstil. Inhemska rapstilar passar också mycket bra.

Parametrar: 9:16 (TikTok/Kuaishou/Reels) eller 16:9 (Bilibili/YouTube). Längd: 5–10 sekunder. Aktivera SFX-läget för effektfulla ljudeffekter. Lägg på en energirik soundtrack.

Lämpliga scenarier: Innehåll från sportmärken, reklam för energidrycker, kanaler för extremsporter och flashigt/teaserliknande innehåll på sociala medier. Fungerar exceptionellt bra under TikToks taggar för sport och trender.

Mall fyra: Lyrisk sång

Visuell ledtråd:

A single candle flickering in darkness on a weathered wooden table.

The flame casts warm, dancing golden light across the surface,

illuminating the grain and scratches in the old wood. A person's

hand slowly enters frame from the right, fingers gently hovering

near the flame without touching it. The hand trembles slightly. The

background is pure darkness with the faintest suggestion of a

window. The camera executes an imperceptibly slow push-in toward

the flame. Extreme shallow depth of field. The flame is razor-sharp

while even the fingertips soften into bokeh. Warm amber and deep

shadow color palette. Intimate, vulnerable, deeply human. 4K

photorealistic. 24fps film cadence.Engelsk beskrivning: En ensam ljus fladdrar på ett vittrat träbord i mörkret. Flamman kastar ett varmt, dansande gyllene sken över bordsskivan och belyser åldrat träs ådring och repor. En hand kommer långsamt in i bild från höger, fingrarna svävar försiktigt bredvid flamman utan att röra den. Handen darrar ever so slightly. Extremt kort skärpedjup. Flamman är skarpt avgränsad, medan fingertopparna mjuknar till en suddighet. En palett av varma bärnstensfärger och djupa skuggor. Intimitet, skörhet, djup mänsklighet.

Rekommenderad ljudstil: Pianoballader eller akustisk gitarr i kombination med subtilt stråkackompanjemang. Molltonarter. Extremt långsamt tempo (55–65 BPM). Produktion som påminner om Adele eller Bon Iver. Sparsamma arrangemang där utrymme och tystnad i sig blir musikaliska element. Kompositioner i kinesisk folkstil skulle också passa perfekt.

Parametrar: Bildformat 16:9. Längd 10 sekunder. Ljudspår: Emotionellt/Original. Högsta tillgängliga upplösning. Denna mall är utformad för att ge emotionell effekt, inte visuell upplevelse.

Lämpliga scenarier: Balladmusikvideor, minnes-/hyllningsfilmer, dramatiska filmscener, känslomässiga varumärkesberättelser och visuella element i unplugged-serier. Inom kategorierna folk/kärlekssånger på NetEase Cloud Music och QQ Music passar denna visuella stil exceptionellt bra med publikens förväntningar.

Mall fem: Vintage/nostalgisk

Visuell ledtråd:

VHS-style footage of a summer road trip along a coastal highway.

A vintage convertible with sun-faded red paint cruises along a

winding cliffside road above a sparkling ocean. The driver's arm

hangs out the window, hand surfing the wind. Palm trees line the

inland side of the road. The footage has authentic VHS artifacts:

horizontal tracking lines, slight color bleeding at edges, warm

oversaturated hues shifted toward orange and teal, subtle scan-line

texture, and occasional tracking glitches. Shot from a following car

at the same speed, steady tracking shot. Late afternoon golden light.

The ocean glitters intensely in the background. Nostalgic, carefree,

endless summer. 480p upscaled aesthetic, 4:3 aspect ratio within a

16:9 frame with black side bars.VHS-stil filmklipp från en sommarresa längs kusten. En vintage cabriolet med blekt röd lack kör längs en väg på klippkanten, med det glittrande havet nedanför. Förarens arm sträcker sig ut genom fönstret och handen surfar i vinden. Filmen har autentiska VHS-artefakter: horisontella spårlinjer, subtila färgblödningar i kanterna och övermättade varma toner som skiftar mot orange och cyan. Nostalgiskt, bekymmerslöst, evig sommar.

Rekommenderad ljudstil: Indie surf rock eller dream pop. Reverb-dränkta gitarrer, studsande basgångar, ljus tamburin. Tempo: 110-120 BPM. Beach Boys möter Tame Impala. Alternativt en mer elektronisk riktning med vaporwave/retro-synthar. Kinesisk retro-pop (som City Pop) skulle också passa perfekt.

Parametrar: Bildformat 16:9 (med 4:3 VHS-estetik). Längd 10 sekunder. Ljudspår: Retro/Indie. Denna mall använder medvetet lo-fi-estetik – generera inte i maximal upplösning och applicera sedan VHS-effekter, utan låt AI:n skapa den vintage-looken från grunden.

Lämpliga scenarier: Nostalgiska/retro musikvideor, visuella element för sommarspellistor, vintageinspirerat varumärkesinnehåll, filmsekvenser om att bli vuxen och innehåll i retrostil på Xiaohongshu. Vintageestetik är fortsatt populärt bland Kinas unga kreatörer, med stora mängder innehåll taggat med "filmliknande" och "retro" som dyker upp på Xiaohongshu och Bilibili.

Jämförelse av de bästa verktygen för att skapa musikvideor med AI

Alla AI-videogeneratorer har inte ljudfunktioner, och bland de som har det varierar funktionerna avsevärt. Nedan följer en direkt jämförelse av alla verktyg som är relevanta för musikvideoproduktion per februari 2026.

Den audiovisuella funktionslandskapet 2026. Seedance 2.0 leder i funktionell fullständighet, medan varje konkurrent har specifika styrkor. Det rätta valet beror på ditt huvudsakliga användningsscenario.

Jämförelsetabell

| Verktyg | Ljudgenerering | Ljudspår | Läppsynkronisering | Högsta videokvalitet | Bäst lämpad för | Startpris | Tillgänglig i Kina | |------|:---:|:---:|:---:|---|-- -|---|:---:| | Seedance 2.0 | Stöds | Stöds | Stöds (8 språk) | 2K, max 2 minuter | Fullständig MV-produktion | Gratisversion tillgänglig | Direkt användbar | | Google Veo 3 | Stöds | Delvis | Stöds inte | 1080p | Omgivande ljudscener | Via Googles AI-verktyg | VPN krävs | | Pika 2.0 | Grundläggande | Stöds inte | Stöds inte | 1080p | Enkel tillägg av ljudeffekter | Gratisversion tillgänglig | VPN krävs | | Kaiber | Stöds inte | Stöds inte (med uppladdat ljud) | Stöds inte | 1080p | Musikvisualisering för uppladdade spår | Cirka 10 $/månad (cirka 7,20 £) | VPN krävs | | Suno + Seedance | Via Seedance | Via Suno | Via Seedance | 2K (Seedance) | Bästa kombinationen av AI-musik och AI-video | Suno gratis + Seedance gratis | Seedance direkt tillgängligt | | SkyMusic + Seedance | Via Seedance | Via SkyMusic | Via Seedance | 2K (Seedance) | Kinas främsta helt kinesiska AI-musik + AI-videokombination | SkyMusic gratis + Seedance gratis | Fullt tillgängligt inom Kina |

Seedance 2.0: Den mest omfattande audiovisuella lösningen

Seedance är den enda plattformen som stöder alla tre typer av audiovisuell generering – ljudeffekter, bakgrundsmusik och läppsynkronisering – i ett enda verktyg. För musikvideoproducenter innebär detta att man kan skapa stämningsfulla bilder med omgivande ljudlandskap, lägga till passande musikaliska ackompanjemang och synkronisera sångprestanda med karaktärernas läpprörelser, allt utan att lämna plattformen.

Viktiga funktioner i MV-produktion:

- Tre ljudlägen (ljudeffekter, musik, röst) som kan väljas vid generering

- 8 språk med läppsynkronisering (inklusive kinesiska), vilket stödjer distribution av MV på flera språk

- Ljudreferensinmatning: Ladda upp din låt för att generera bilder som är synkroniserade med musiken

- Flera bildförhållanden, inklusive 9:16 för korta MV-innehåll

- Maximal genereringstid på 2 minuter, som täcker hela låtsegment

- Bild-till-video-konvertering: animera albumomslag eller statiska koncept

Exklusiva fördelar för inhemska användare:

- Utvecklad av ByteDance, tillgänglig direkt i Kina utan VPN

- Stöder Alipay/WeChat Pay, inga hinder för betalda uppgraderingar

- Kinesisk läppsynkronisering är avgörande för inhemsk musikvideoproduktion

- Alla funktioner tillgängliga i gratisversionen

Positionering: Seedance är den ultimata integrerade lösningen för kreatörer som vill genomföra hela produktionsprocessen för musikvideor med ett enda verktyg. Kombinationen av högkvalitativ bild och omfattande ljudfunktioner är fortfarande oöverträffad.

Skapa din musikvideo med Seedance 2.0 nu -->

Google Veo 3: Kraftfullt inbyggt ljud

Veo 3 genererar videor med inbyggt ljud, som innehåller omgivningsljud, atmosfäriska ljud och en viss grad av musikaliskt ackompanjemang. Ljudkvaliteten är imponerande – Googles träningsdata och modellskala ger ett rikt, lagerat ljudlandskap. Strandscener låter verkligen som stränder, med vågor på rätt avstånd, vind med rätt intensitet och sjöfåglars läten med rimliga intervall.

Fördel: Miljöanpassad ljudåtergivning. Veo 3 levererar de mest autentiska ljudlandskapen i sin klass.

Begränsningar i MV-produktion: Veo 3 saknar den detaljerade ljudkontroll som finns i Seedance. Du kan inte välja mellan ljudeffekter/musik/röstlägen, det finns ingen läppsynkroniseringsfunktion och du kan inte ladda upp egna ljudspår som referens. För MV-produktion begränsar denna brist på flexibilitet Veo 3 till atmosfäriska/miljömässiga videor med ackompanjerande ljud, snarare än strukturerad musikvideoproduktion. Dessutom krävs en VPN för att få tillgång till tjänsten i hemlandet, vilket innebär en högre inträdesbarriär. För en detaljerad jämförelse av funktioner, se Seedance vs Veo 3 In-Depth Comparison.

Pika 2.0: Grundläggande ljudeffekter

Pikas ljudeffekter-funktion lägger till omgivningsljud till genererade videor. Detta är ett användbart tillägg till det som tidigare var ett rent visuellt verktyg, även om dess funktioner fortfarande är begränsade jämfört med Seedance och Veo 3. Ljudeffekterna omfattar grundläggande omgivningsljud – fotsteg, vattenljud, vindljud, enkla ljud från stötar – men saknar musikgenerering och läppsynkronisering.

Fördelar: Lägger till enkla ljudeffekter till korta klipp. Om du behöver en fem sekunder lång regnscen med passande regnljud kan Pika fixa det.

Begränsningar: Ingen musikgenerering, ingen läppsynkronisering och inget stöd för uppladdning av ljudreferenser. För produktion av musikvideor räcker det inte med Pika ensamt – det måste kombineras med externa ljudverktyg för att uppnå full effekt. Kräver VPN.

Kaiber: Specialist på musikvisualisering

Kaiber använder en annan metod än de andra verktygen på denna lista. Istället för att generera ljud från video skapar det video från ljud. Du laddar upp ett musikspår och Kaiber genererar abstrakta, stiliserade visuella animationer som reagerar på musikinnehållet – bildrutor som pulserar i takt med rytmen, färger som skiftar med harmoniska förändringar och intensitet som mappas till volym.

Fördelar: Abstrakt musikvisualisering. Om ditt mål är att skapa psykedeliska, abstrakta, beat-responsiva bilder för ett elektroniskt musikspår, är Kaiber skräddarsydd för detta ändamål.

Begränsningar: Kaiber genererar inte ljud – det krävs uppladdade ljudfiler. Videoutmatningen är mycket stiliserad (abstrakt/konstnärlig) snarare än fotorealistisk. Det går inte att skapa narrativa scener, karaktärer eller realistiska miljöer. För fullständig musikvideoproduktion som kräver autentiska bilder fungerar Kaiber som ett nischverktyg snarare än en komplett lösning. Kräver VPN.

Suno / SkyMusic + Seedance-samarbete: Essensen av två världar

För kreatörer som vill ha maximal kontroll över både de musikaliska och visuella aspekterna av sitt arbete är det mest effektiva arbetsflödet att kombinera en professionell AI-musikgenerator med en professionell AI-videogenerator.

Internationell upplaga – Suno + Seedance:

- Skapa din låt i Suno: Beskriv genre, stämning, tempo och arrangemang. Suno producerar kompletta musikspår av hög kvalitet, med sång om så önskas.

- Ladda upp låten till Seedance som ljudreferens: AI-videogeneratorn skapar bilder som svarar mot musikens struktur – scenerna intensifieras under musikaliska crescendos och avtar under lugnare passager.

- Använd läppsynkronisering om det behövs: Om Suno-spåret innehåller sång och du vill att karaktärerna ska sjunga, använd Seedances läppsynkroniseringsläge för att matcha munrörelserna med sångspåret.

Inhemskt paket – SkyMusic + Seedance:

Denna kombination erbjuder kinesiska kreatörer det mest smidiga arbetsflödet för AI-musikvideor från början till slut – båda plattformarna är direkt tillgängliga i Kina och kräver ingen VPN.

- Skapa din låt i SkyMusic: SkyMusic är utmärkt för att skapa kinesiska texter och stöder olika kinesiska musikgenrer, inklusive rap, pop och klassisk musik.

- Ladda upp din låt till Seedance som ljudreferens: Seedance genererar matchande bilder baserat på musikens innehåll.

- Kinesisk läppsynkronisering: Använd Seedances kinesiska läppsynkroniseringsfunktion för att få karaktärerna att framföra dina kinesiska texter med precision.

Fördelen med detta arbetsflöde är att du får den musikaliska kvaliteten hos professionell musik-AI i kombination med de visuella och synkroniseringsfunktionerna hos professionell video-AI. Nackdelen är att det krävs två verktyg istället för ett enda. För kreatörer som strävar efter professionella resultat är detta extra steg helt värt besväret.

Avancerat: Tekniker för att uppnå läppsynkronisering

När du har bemästrat det grundläggande arbetsflödet kommer följande avancerade tekniker att hjälpa dig att uppnå en nivå av audiovisuell koordination i dina musikvideor som markerar skillnaden mellan professionellt och amatörmässigt arbete.

Avancerad synkronisering handlar inte bara om att generera ljud och bild tillsammans. Det innebär att medvetet anpassa den visuella rytmen, stämningen och strukturen till den musikaliska kompositionen för att uppnå en enhetlig audiovisuell upplevelse.

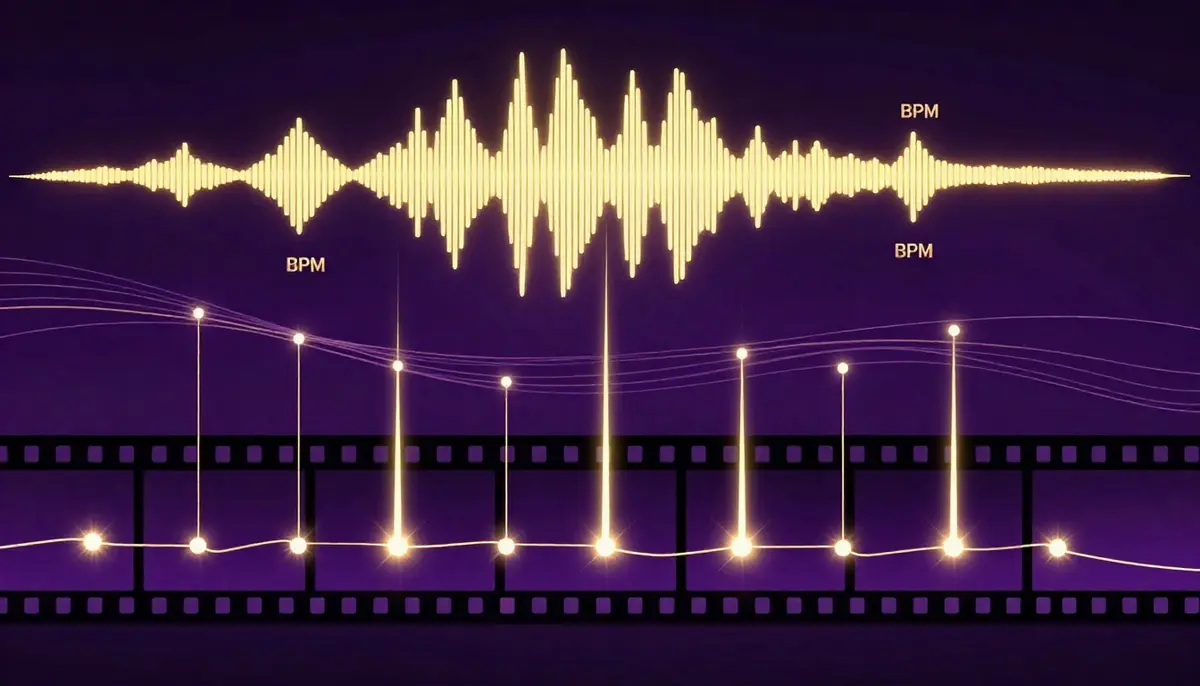

BPM-matchning: Anpassa visuell rytm till musikens tempo

BPM (beats per minute) är hjärtat i alla musikspår. När ditt visuella innehåll rör sig i synk med musikens rytm känns effekten genomtänkt och professionell. När de två inte stämmer överens känns det som två oberoende saker som spelas samtidigt.

Hur man uppnår BPM-matchning:

- Bestäm din låts BPM: De flesta DAW-program (Ableton, Logic, FL Studio) visar automatiskt BPM. Onlineverktyg för BPM-detektering är lika effektiva. Vanliga intervall: lo-fi (70–85 BPM), pop (100–130 BPM), EDM (120–150 BPM), drum and bass (160–180 BPM).

- Översätt BPM till visuell rörelsehastighet: Vid 120 BPM finns det exakt två slag per sekund. Kamerarörelser, scenövergångar och visuella klipp som sker varje halvsekund kommer att kännas låsta till takten.

- Använd rytmiskt suggestivt språk: För spår med 130 BPM, använd termer som "snabbt", "energiskt", "dynamiska övergångar". För spår med 70 BPM, välj "långsamt", "flytande", "mild drift". AI tolkar dessa rytmiska signaler och justerar det visuella tempot därefter.

- Finjustering efter produktion: Om AI:ns visuella rytm är nära men inte perfekt synkroniserad med takten, gör justeringar i din videoredigerare. Öka eller minska hastigheten på segment med 5–10 % för att fästa visuella händelser vid taktsmarkörer. Denna finjustering gör en synlig skillnad. Både ShineVideo och DaVinci Resolve stöder sådana precisa hastighetsjusteringar.

Emotionell synkronisering: Musikaliska passager kopplade till visuella atmosfärer

Professionella musikvideor har inte en genomgående enhetlig visuell estetik. De skiftar stämning för att anpassas till låtens känslomässiga båge. Med AI-generering kan du skapa dessa övergångar genom att generera distinkta segment med hjälp av olika visuella stimuli.

Översättningen från musikalisk struktur till visuell atmosfär:

| Låtsektion | Musikaliska egenskaper | Visuell inriktning | |-------- -|---------|---------| | Intro | Gles, gradvis | Minimalistisk bildspråk, dämpade toner, slow motion. Skapa atmosfär. | | Vers | Berättande, medelhög energi | Berättelsedrivna scener, måttligt tempo, varm eller neutral färgpalett | | Pre-Chorus | Lager på lager | Intensifierad kamerarörelse, ökad färgmättnad, ökad visuell komplexitet | | Chorus | Högsta energi/känsla | Mest dramatiska bilder, djärvaste färger, dynamiska tagningar, fullskaligt visuellt spektakel | | Bridge | Övergång/reflektion | Helt distinkt visuell stil. Ny färgpalett. Långsammare rörelse. | | Coda | Konvergens, uttoning | Återgår till introtets visuella stil med en känsla av upplösning. Mjukare. Uttoning. |

Skapa separata uppmaningar för varje stycke individuellt, redigera dem sedan och sätt ihop dem. Denna segmenterade metod ger ett mer dynamiskt resultat som passar bättre till musiken än om man skapar ett enda långt fragment.

Segmenterad generation: Skapa distinkta bilder för refrängen, verserna och bryggsektionerna.

Med utgångspunkt i begreppet emotionell synkronisering innebär den praktiska tekniken med segmenterad generering att man skapar oberoende AI-videosegment för varje musikpassage, som sedan sammanfogas i tidslinjeeditorn.

Arbetsflöde:

- Analysera låtens struktur. Markera tidsstämplarna för varje avsnitt (Vers 1: 0:00-0:30, Refräng 1: 0:30-0:55, Vers 2: 0:55-1:25, etc.)

- Skriv unika visuella instruktioner för varje avsnitt. Behåll den visuella kontinuiteten genom konsekventa stilistiska beskrivningar (identiska färgscheman, gemensamma nyckelord för visuell kvalitet) samtidigt som du varierar scener, tagningar och energinivåer

- Skapa separata klipp för varje avsnitt i Seedance. Anpassa klippens längd efter avsnittens tidsangivelser

- Importera alla klipp till en videoredigerare (ShineVideo, DaVinci Resolve, Premiere). Anpassa varje klipp till motsvarande musikavsnitt.

- Lägg till övergångar mellan avsnitten: crossfades för mjuka övergångar, hårda klipp för dramatiska skiftningar och snabba panoreringar för energiska övergångar.

- Exportera den sammanställda tidslinjen som din slutgiltiga musikvideo.

Denna metod ger dig största möjliga kontroll över förhållandet mellan ljud och bild. Även om det innebär en större arbetsbelastning än generering i ett steg, blir resultatet betydligt mer dynamiskt och bättre anpassat till musiken.

Referensvideo: Använda befintliga musikvideostilar som input

Om det finns en befintlig musikvideo vars visuella stil, kamerarörelser eller redigeringsrytm du beundrar, kan du använda den som referens för att styra AI:ns generering.

Hur man använder referens-MV:

- Välj en musikvideo eller ett videoklipp som förkroppsligar den visuella stil du önskar.

- Ladda upp den som referensvideo i Seedance.

- AI analyserar referensens kamerarörelser, komposition, färgschema, redigeringsrytm och rörelsedynamik.

- Det genererade resultatet ärver dessa stilistiska element samtidigt som det skapar helt originellt innehåll.

Denna teknik är särskilt användbar när kunder eller samarbetspartners säger: "Jag vill ha samma känsla som i den videon" – du kan direkt använda deras referens som input, istället för att försöka översätta deras vision till ett promptspråk.

Viktig anmärkning: AI genererar originellt visuellt innehåll inspirerat av referensstilen. Det kopierar eller reproducerar inte referensvideon. Resultatet är unikt innehåll som delar stilistiska element med referensen.

Vanliga frågor

Kan AI verkligen skapa en komplett musikvideo?

Visst, men man måste förstå innebörden av "fullständig" år 2026. AI kan generera videoklipp med synkroniserat ljud – inklusive ljudeffekter, bakgrundsmusik och läppsynkroniserad sång – som ser och låter professionella ut. För stämningsfulla, stiliserade eller abstrakta musikvideor som varar mellan 30 sekunder och 2 minuter kan AI-genererade resultat faktiskt släppas direkt. För längre, berättelsedrivna musikvideor som kräver specifika skådespelare och komplex koreografi är AI utmärkt för att producera högkvalitativt råmaterial, även om det gynnas avsevärt av mänsklig redigering, sekvensering och efterproduktion. Denna teknik förstås bäst som ett produktionsverktyg som hanterar 80–90 % av arbetsbelastningen, snarare än en ersättning för ett helt produktionsteam med ett enda klick.

Vilken är den bästa AI-musikvideogeneratorn för 2026?

Seedance 2.0 är den mest omfattande AI-musikvideogeneratorn 2026. Den integrerar på ett unikt sätt alla tre centrala audiovisuella funktioner i en enda plattform: generering av ljudeffekter, skapande av AI-soundtrack och flerspråkig läppsynkronisering (på åtta språk, inklusive kinesiska). — i kombination med högkvalitativ bildgenerering (upp till 2K-upplösning, 2 minuters längd). Kinesiska användare har ytterligare fördelar: som en ByteDance-produkt är Seedance direkt tillgängligt i Kina och stödjer Alipay och WeChat Pay. Google Veo 3 utmärker sig inom omgivningsljud men saknar läppsynkronisering och kräver VPN. Pika erbjuder endast grundläggande ljudeffekter. Kaiber specialiserar sig på abstrakt musikvisualisering.

Måste man ha sin egen musik för att skapa AI-musikvideor?

Det behövs inte. Du har tre alternativ. För det första kan du använda Seedances inbyggda soundtrackgenerator för att låta AI skapa bild och musik samtidigt. För det andra kan du använda gratis AI-musikgeneratorer (som Suno internationellt eller inhemska alternativ som SkyMusic och NetEase Tianyin) för att skapa originalkompositioner och sedan importera dessa till Seedance som ljudreferenser. För det tredje kan du ladda upp dina egna originalkompositioner eller licensierade musikspår. Alla tre metoderna ger fullständiga audiovisuella resultat. Ditt val beror på hur mycket kontroll du vill ha över musikeffekterna.

Hur används AI-läppsynkronisering i musikvideor?

AI-läppsynkroniseringsanalys undersöker ljudinnehållet i sångspår – identifierar vilka fonem som förekommer vid specifika tidpunkter – och genererar motsvarande munformer, käkpositioner och mikrouttryck i ansiktet på videokaraktärer. För sång innebär detta att karaktärens mun öppnas mer vid höga toner och vokaler, smalnar av vid konsonanter och håller tidsmässig överensstämmelse med sångrytmen. Seedance stöder läppsynkronisering på åtta språk (inklusive kinesiska), med ett munvokabulär som är anpassat till varje språks fonetiska system. Kinesisk läppsynkronisering gör det möjligt för AI-karaktärer att framföra kinesiska texter med precision, vilket öppnar upp en enorm kreativ potential för Bilibilis cover- och anime-communityn. Optimala resultat uppnås med tydliga sångspår med måttligt tempo och minimal instrumentell störning.

Kan AI-genererad musik användas kommersiellt?

På Seedance-plattformen, ja. Musik som genereras inom Seedance utgör originalt innehåll skapat av AI – inte samplat eller härlett från upphovsrättsskyddade låtar. Med det betalda abonnemanget behåller du kommersiella användningsrättigheter för det genererade resultatet, inklusive ljudkomponenten. Detta innebär att du kan tjäna pengar på AI-genererade musikvideor på Bilibili/YouTube, använda dem i kommersiella annonser och distribuera dem på olika plattformar utan att behöva oroa dig för upphovsrättsintrång.

Viktiga överväganden angående den kinesiska rättsliga kontexten: Enligt Kinas interimistiska åtgärder för administration av generativa artificiella intelligens-tjänster är det viktigt att säkerställa att AI-genererat innehåll inte kränker andras immateriella rättigheter när det används för kommersiella aktiviteter. Vidare kan det i vissa fall vara nödvändigt att märka innehållet som AI-genererat. Det är tillrådligt att bekanta sig med de senaste policykraven innan man genomför en storskalig kommersiell implementering. Kontrollera alltid de specifika användarvillkoren för de verktyg du använder, eftersom licensbestämmelserna varierar mellan olika plattformar.

Hur långa kan AI-musikvideor vara?

Seedance stöder generering av segment på upp till 2 minuters längd. För längre musikvideor rekommenderar vi att du använder en segmenterad genereringsmetod: skapa separata segment för olika delar av låten (verser, refränger, bryggor) och sätt sedan ihop dem i en videoredigerare. En låt på 3–4 minuter kräver vanligtvis 3–6 oberoende genererade segment. Denna segmenterade metod ger faktiskt bättre resultat jämfört med en enda lång generering, eftersom varje segment får sin egen optimerade visuella prompt.

Hur är ljudkvaliteten i AI-genererade musikvideor?

Kvaliteten på AI-genererat ljud har nu nått en standard som är lämplig för online-distribution på alla större plattformar. Output levereras i CD-kvalitet stereo (44,1 kHz, motsvarande 16 bitar). Det är rent, välmixat och fritt från de uttalade artefakter som ofta förknippas med tidigare AI-ljudsystem. Om ditt innehåll är avsett för professionella musikdistributionsplattformar (NetEase Cloud Music, QQ Music, KuGou Music, Spotify, Apple Music) är det dock tillrådligt att bearbeta ljudkomponenten med specialiserade AI-musikverktyg (som Suno eller SkyMusic) innan du importerar den till Seedance för visuell generering. Professionella musik-AI-verktyg erbjuder för närvarande något bättre ljudkvalitet jämfört med integrerade video-ljudgeneratorer.

Hur kan man förhindra audiovisuell desynkronisering?

Tre tekniker kan minimera synkroniseringsproblem. För det första, håll individuella genererade klipp under 30 sekunder – kortare segment upprätthåller en bättre synkronisering. För det andra, använd tydliga rytmiska signaler i visuella ledtrådar (t.ex. "långsam, medveten rörelse" för långsamma spår; "snabb, energisk rörelse" för snabba spår) för att anpassa det visuella tempot till ljudtempo. För det tredje, om mindre tidsavvikelser uppstår i resultatet, finjustera tiden med hjälp av videoredigeringsprogram – genom att flytta ljudspåret med 50–100 millisekunder kan märkbar desynkronisering korrigeras. För att få korrekt läppsynkronisering, se till att källjudet är rent och rytmiskt tydligt, eftersom tvetydigt eller överlappande tal innebär större utmaningar för precis AI-synkronisering.

Vilka råd skulle du ge för att släppa AI-musikvideor på Bilibili?

Bilibili är en av Kinas största plattformar för långa videor och musikvideor, och det finns flera viktiga punkter att tänka på när man släpper AI-genererade musikvideor. För det första, välj rätt kategori – Music Zone (musikkompilering/covers/originalmusik/elektronisk musik) eller Parody Zone (om innehållet är humoristiskt). För det andra, skapa högkvalitativa omslag och titlar, eftersom Bilibilis rekommendationsalgoritm lägger stor vikt vid klickfrekvensen på omslaget. För det tredje, inkludera kinesiska undertexter/texter, som inte bara underlättar förståelsen utan också är en självklar förväntning bland Bilibili-användare. För det fjärde, ange vilket AI-genereringsverktyg som använts i beskrivningen, eftersom Bilibilis community värdesätter transparens. För det femte, använd Bilibilis kolumnfunktion för att publicera medföljande textbaserade MV-produktionshandledningar, som kan generera ytterligare trafik.

Börja skapa AI-musikvideor nu

Konvergensen mellan AI-video och AI-ljud är inte en framtida möjlighet, utan en realitet redan idag. Verktygen finns redan, med en kvalitet som uppfyller publiceringsstandarder för de flesta tillämpningar, och till en bråkdel av kostnaden för traditionell musikvideoproduktion.

Oavsett om du är en oberoende musiker som drömmer om en riktig musikvideo för ditt verk, en innehållsskapare som bygger en lo-fi-musikkanal på Bilibili, ett marknadsföringsteam som behöver bakgrundsmusik till produktvideor eller någon som producerar videoinnehåll som kräver ljudackompanjemang, så är denna teknik nu redo för dig.

Nästa steg:

- Gå till Seedance Video Generation

- Ladda upp din musikspår (eller låt AI generera ett)

- Skriv visuella instruktioner som matchar stämningen i din låt

- Välj ljudläge (ljudeffekter, soundtrack eller läppsynkronisering)

- Skapa din första AI-musikvideo

- Publicera på Bilibili, TikTok, Xiaohongshu, NetEase Cloud Music

Skapa din första AI-musikvideo gratis -->

Registrera dig nu för att få gratis krediter. Inget kreditkort krävs. Betalda abonnemang inkluderar innehåll utan vattenstämpel. Fullständiga kommersiella användningsrättigheter. Kan användas direkt i Kina, med stöd för Alipay/WeChat Pay.

Tiden för tysta AI-videor är över. Alla videor du skapar från och med nu kan ha ljud, soundtrack och själ.

Mer information: Vad är Seedance AI Video Generator | Jämförelse mellan Seedance och Veo 3 | Den kompletta guiden till text-till-video-AI | AI-videoguide för YouTube-skapare | AI-video för e-handelsproduktvideor | Seedance Prompt Guide och exempel | Jämförelse av de bästa AI-videogeneratorerna för 2026*