Oversigt

Den mest effektive måde at skabe AI-videoer på er ikke blot at indtaste en beskrivelse i tekst-til-video-værktøjer. I stedet skal du starte med et omhyggeligt forberedt billede.

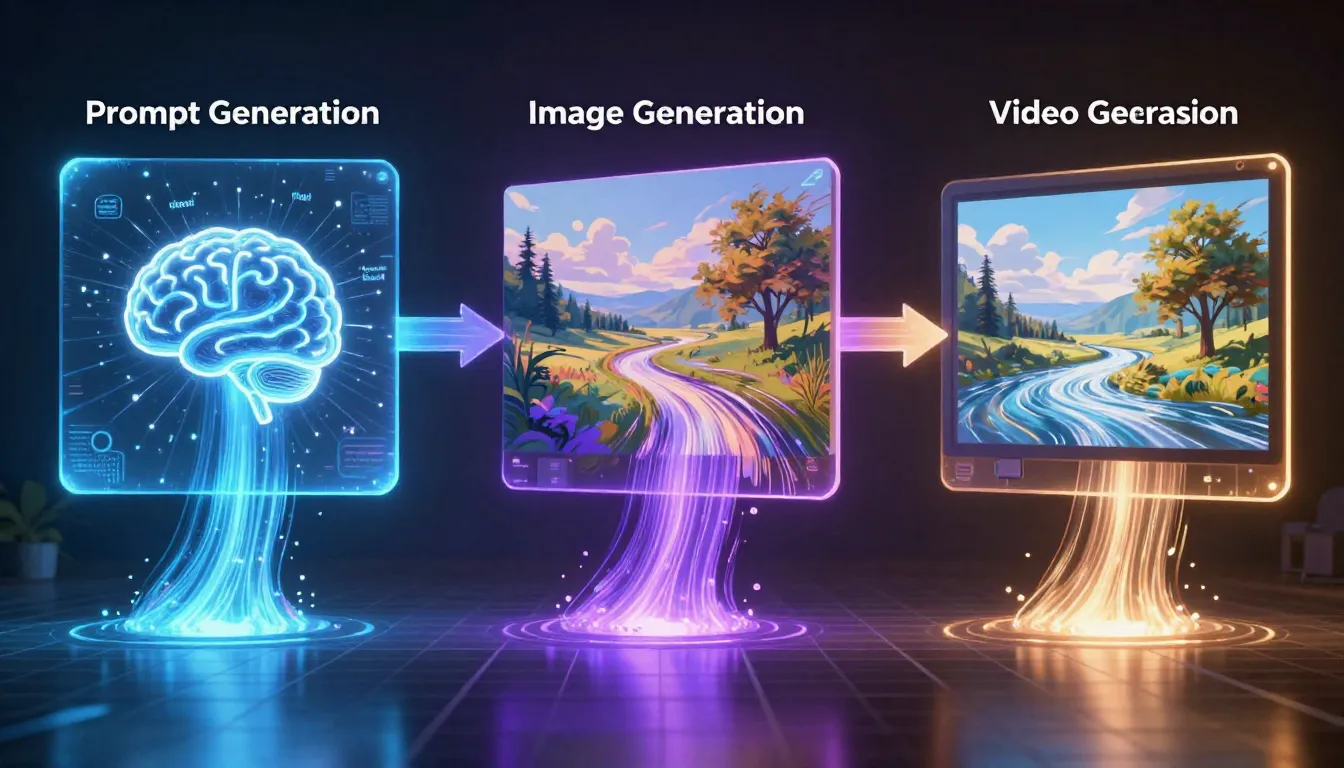

Tretrinsproces — prompt → billede → video — giver resultater, der langt overgår tekst-til-video-generering alene. Først skal du udarbejde en professionel prompt. Brug denne prompt til at generere et billede med præcis komposition. Indsæt derefter dette billede som det første billede i en videogenerator. Resultatet: Du får præcis kontrol over det visuelle indhold, lysstemningen, kompositionsdetaljerne og bevægelsens udgangspunkt.

Seedance er det eneste værktøj, der integrerer alle tre faser i en enkelt platform: Image Prompt Generator hjælper dig med at udarbejde professionelle prompts, Text-to-Image genererer referencemaler i høj kvalitet, og Image-to-Video omdanner billeder til filmiske videoklip. Du behøver ikke skifte værktøj, downloade og uploade igen – fra inspiration til færdigt værk foregår det hele i én sammenhængende proces.

Trin 1: Generer prompt → | Trin 2: Generer billede → | Trin 3: Generer video →

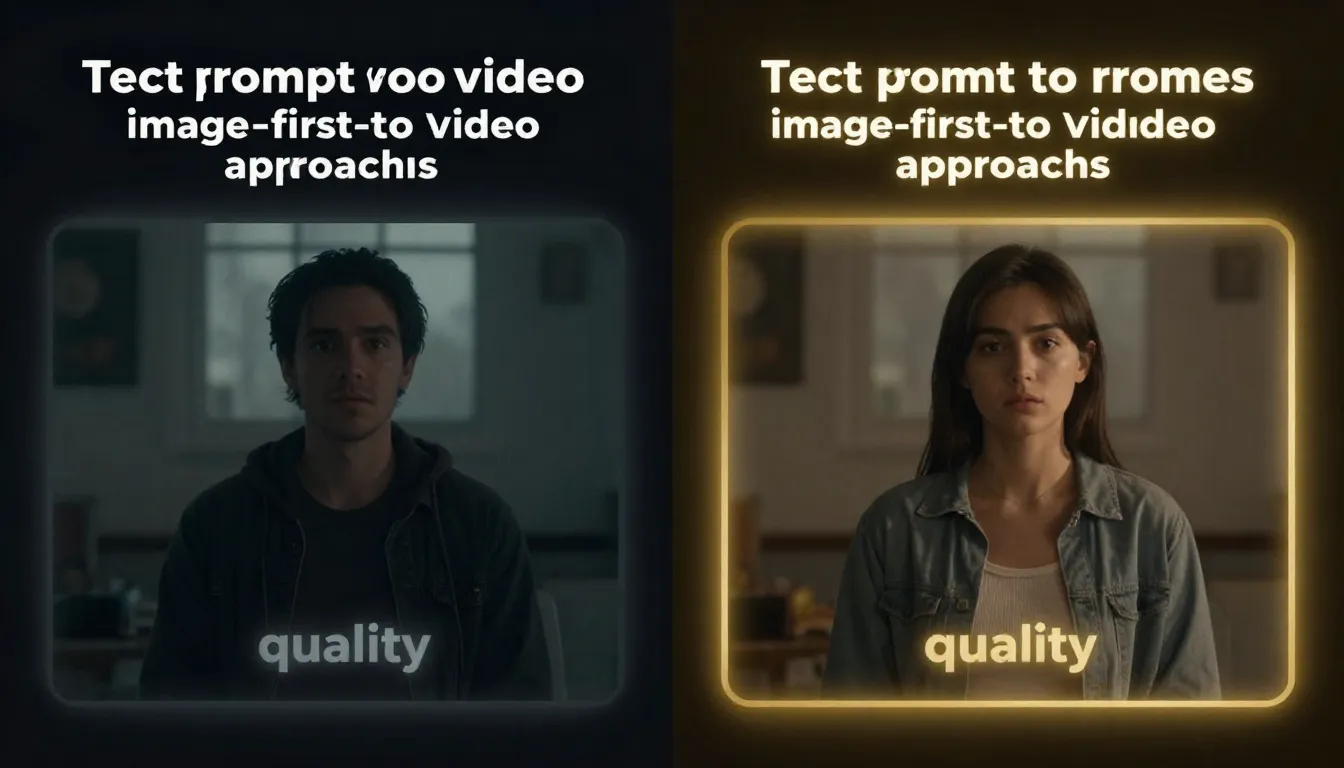

Venstre: Ren tekst-til-video-generering — tilfældig komposition, ukontrollerbare billeder. Højre: Billedførst-pipeline — finpuds først billederne, tilføj derefter bevægelse; præcis komposition, ensartet kvalitet.

Hvorfor "billede først, video senere" klarer sig langt bedre end konvertering af tekst til video

De, der har brugt Wensheng Video, kender oplevelsen: Man skriver en detaljeret beskrivelse – der dækker emne, belysning, kameravinkel og komposition – men det AI-genererede optagelse ligner slet ikke ens vision. Karaktererne vender den forkerte vej, belysningen er flad, kompositionerne virker tilfældigt genererede, og rollerne stemmer ikke overens med beskrivelsen.

Dette er ikke en fejl i et bestemt værktøj, men snarere en strukturel begrænsning, der er forbundet med tekst-til-video-metoden.

De iboende begrænsninger ved videobaseret indholdsproduktion

Wensheng Video kræver, at AI udfører to særdeles udfordrende opgaver samtidigt: generering af billeder og generering af bevægelse. Modellen skal fortolke din tekst, bestemme udseendet af hver pixel, komponere scenen, indstille belysning og skygger, fastlægge kamerapositionen og derefter generere sammenhængende bevægelse baseret på alt dette – alt sammen ud fra et enkelt stykke tekst.

Resultatet er, at alle dimensioner er uden for kontrol:

- Tilfældig komposition. Du skriver "en kvinde, der står midt på gaden", men hun ender i venstre tredjedel, hvor halvdelen af billedet domineres af unødvendige bygninger.

- **Inkonsekvente karakterer. ** Ansigtstræk, tøj, frisurer og kropsproportioner varierer fra generation til generation. AI'en leverer "kreative fortolkninger", ikke dine specifikationer.

- **Ukontrolleret belysning. ** Selv hvis du specificerer "gylden time, varm belysning fra venstre", giver det meget inkonsekvente resultater. AI'ens fortolkning af belysningsbeskrivelser forbliver grundlæggende vag.

- Upålidelig indramning. Nærbilleder, mellembilleder, helbilleder – tekst-til-video-værktøjer fortolker disse termer med ekstrem ustabilitet. Bed om et ekstremt nærbillede, og det leverer et helkropsbillede.

I forbindelse med kreative eksperimenter kan denne usikkerhed være en del af det sjove. Men hvis du har brug for kontrollerede, pålidelige og professionelle resultater, bliver det en fatal fejl.

Den vigtigste fordel ved billedprioritet

TuSheng Video har vendt denne ligning fuldstændigt på hovedet. Du behøver ikke længere AI til at generere både billeder og bevægelse samtidigt; i stedet adskiller du de to opgaver:

- Start med billedet. Motiv, komposition, belysning, farve, indramning – du har fuld kontrol og kan gentage processen, indtil du opnår perfektion.

- Tilføj derefter bevægelse. AI's eneste opgave er at animere dit perfekte billede. Den behøver ikke at tyde vage beskrivelser eller træffe kompositoriske beslutninger, men genererer i stedet bevægelse ud fra dine konkrete visuelle ankerpunkter.

Denne fokusering giver overlegne resultater på alle områder:

- Kompositionen er låst. Motivet forbliver præcis, hvor du har placeret det.

- Karakterkonsistens. Ansigtstræk, påklædning og proportioner forbliver identiske med kildebilledet gennem hele processen.

- **Belysning og skygger bevares. ** Lysretning, tekstur og farvetemperatur arves fuldt ud fra billedet.

- Fast ramme. Kameraposition og synsvinkel indstilles i henhold til billedets oprindelige komposition.

For at illustrere: tekst-til-video svarer til at beskrive en filmscene over telefonen og instruere nogen om at filme den. Billede-til-video svarer derimod til at vise nogen et fotografi og sige: "Giv dette billede liv." Den sidstnævnte tilgang giver mere kontrollerbare resultater af højere kvalitet, da AI'en modtager konkrete visuelle referencer i stedet for abstrakte tekstbeskrivelser.

Kvalitetens multiplikatoreffekt

Fordelene er kumulative. En omhyggeligt udformet indledende ramme forbedrer alle aspekter af videoen:

- Forbedret tidsmæssig konsistens — Modellen har visuelle ankre af høj kvalitet, der sikrer sammenhæng gennem hele sekvensen.

- Forbedret bevægelseskvalitet — Modellen udtrækker nøjagtigt dybde, belysning og rumlig information fra klare kildebilleder.

- Forbedret stilistisk konsistens — Farvesystemer, stemninger og æstetik er direkte indlejret i billederne, hvilket ikke efterlader plads til tekstuel fortolkning.

- Reduceret fejlprocent — Modellen starter med rene, højopløselige visuelle data i stedet for at syntetisere alt ud fra støj.

Højkvalitetsvideoer genereret af første billede viser en betydelig overlegenhed i forhold til videoer, der udelukkende er genereret af tekst med identiske prompts, hvad angår visuel kvalitet, tidsmæssig kontinuitet og æstetisk appel. Dette er ikke en subtil forskel – det repræsenterer kløften mellem "underholdende AI-demonstrationer" og "professionelt anvendeligt indhold".

For en grundig gennemgang af, hvordan man designer billeder specifikt til videoproduktion, se First and Last Frame Design Guide.

Tretrins AI-kreativ pipeline

Den komplette arbejdsgang er opdelt i tre faser, der hver bygger på den foregående. Enhver fase, der håndteres uforsigtigt, vil i sidste ende kompromittere det endelige resultat. Det er afgørende at forstå hver fases bidrag – og hvor man skal investere tid – for at kunne producere AI-videoer af høj kvalitet på en konsistent måde.

Fase 1: Generering af prompt

Alt begynder med prompten. Middelmådige prompter → middelmådige billeder → middelmådige videoer. Fremragende prompter → fantastiske billeder → fantastiske videoer. Kvaliteten af prompten er den største variabel i den endelige udskrifts kvalitet, og det er også den fase, der investeres mindst i i de fleste arbejdsgange.

Problemet med manuelt at skrive prompts. De fleste mennesker tilgår promptskrivning som udformning af søgeord: kortfattet, vagt og med fokus udelukkende på emnet. "Et luksuriøst ur, mørk baggrund." Dette fortæller AI'en, hvad den skal tegne, men giver den ingen instruktioner om, hvordan den skal tegne det. Modellen udfylder hullerne med standardværdier – flad belysning, centreret komposition, ingen atmosfæriske detaljer, ingen stilistisk retning.

Løsning: AI-assisteret promptgenerering. Promptgeneratoren udvider dine grove ideer til professionelle prompts, der dækker emne, miljø, belysning, farve, komposition, stil og forbedringer af billedkvaliteten. Forskellen i outputkvalitet mellem en manuel prompt på 10 ord og en genereret prompt på 100 ord udgør et kvalitativt spring.

Seedances Image Prompt Generator gør netop det. Indtast en kort beskrivelse, f.eks. "luksuriøs urreklame, mørk og dramatisk", vælg en stil (fotorealistisk, filmisk, illustrativ osv.), og AI'en genererer øjeblikkeligt en komplet professionel prompt. Hele processen tager kun få sekunder og koster 2 credits pr. prompt. For en omfattende guide til promptgenerering, se AI Image Prompt Generator Guide.

Hvorfor dette trin er så vigtigt. Prompten er DNA'et i hele din pipeline. Den dikterer stil, stemning, komposition og kvalitetsniveau for alt, hvad der følger efter. Ved at bruge fem minutter på at finpudse din prompt, før du genererer billeder, kan du spare tredive minutter på gentagne justeringer af middelmådige resultater senere hen.

Fase to: Billedgenerering

Når du har modtaget den professionelle prompt, er det næste trin at generere det billede, der skal fungere som videoens åbningsbillede. Her skifter du fra tekst til visuelle elementer, hvilket markerer det trin, hvor du bør investere mest tid i iteration.

Fra prompt til billede. Indsæt den genererede prompt i tekst-til-billede-værktøjet og klik på Generer. Vurder resultatet: Er kompositionen egnet til video? Er belysningen tilstrækkeligt lagdelt? Fremstår motivet korrekt? Formidler scenen en fornemmelse af dybde?

Hvis du allerede har et referencebillede eller ønsker at finjustere eksisterende genereringsresultater, er image-to-image det rette værktøj for dig. Upload dit eksisterende billede og beskriv de ønskede ændringer – dette er særligt effektivt til kompositoriske iterationer: juster belysningen, tilføj atmosfæriske effekter eller ændr scenens indhold uden at skulle starte forfra. For en omfattende guide til Image-to-Image-arbejdsgangen, se Image-to-Image AI Guide.

Design billeder til brug i videoer. Ikke alle visuelt tiltalende billeder er egnede som åbningsbilleder til videoer. Når du genererer billeder til brug i pipeline, skal du huske følgende kompositionsprincipper:

- Lad der være negativ plads i bevægelsesretningen. Hvis en karakter bevæger sig fra venstre mod højre, skal du placere hende lidt til højre i billedet.

- Inkluder dybdeniveauer. Billeder med tydelige forgrunds-, mellemgrunds- og baggrundselementer skaber bedre parallakseffekter og mere naturlige kamerabevægelser i videoen.

- **Overvej kameraets bevægelsesretning. ** Hvis du planlægger at bruge "push"-bevægelse, skal du sikre dig, at kompositionen ser godt ud både i den aktuelle beskæring og i en tættere beskæring centreret om motivet.

- Undgå store tekstblokke eller symmetriske mønstre. Sådanne elementer er vanskelige at animere naturligt og kan let skabe artefakter.

- **Brug retningsbestemt belysning. ** Stærk retningsbestemt belysning med synlige skygger giver en mere filmisk videoeffekt end flad belysning.

Grundlæggende princip: Brug tid på at få dine billeder til at se rigtige ud. Hvert minut, du bruger på at perfektionere dine billeder, sparer dig for flere gange så meget tid i videoproduktionsfasen. Et fejlfrit første billede betyder, at din video kan bruges fra første forsøg. Et fejlbehæftet første billede kan kræve flere genproduktioner (hver især forbruger kreditter og tid) uden garanti for et tilfredsstillende resultat.

Før du begynder at generere videoen, skal du gentage billederne 3-5 gange. Det er ikke perfektionisme – det er effektivitet.

For en omfattende guide til generering af tekst til billeder (inklusive promptteknikker og sammenligning af værktøjer), se Den komplette guide til tekst til billede AI. For en oversigt over de bedste værktøjer til billedgenerering, se De bedste AI-billedgeneratorer til 2026.

Generer dit billede → | Finjuster billede til billede →

Trin tre: Videoproduktion

Dette er det stadie, hvor du høster frugterne. De polerede billeder, du har finpudset, danner udgangspunktet for dine animerede videoklip.

Upload et billede som det første billede. Upload dit genererede billede til Seedances [Image-to-Video]-værktøj. Værktøjet henter billeder direkte fra din genereringshistorik – du behøver ikke at downloade og uploade dem igen.

Beskriv bevægelsen med ord. Skriv en kort beskrivelse af den ønskede bevægelse – beskriv ikke det visuelle (billedet er allerede blevet behandlet). Fokuser på:

- Kamerabevægelse: "langsom dolly ind" 、blid panorering til venstre、glidende kredsløb omkring motivet

- Motivets handling: "kvinden drejer langsomt hovedet"、kronblade falder ned、damp stiger op fra koppen

- Bevægelse i omgivelserne: "skyerne bevæger sig langsomt", "vandet kruser udad", "bladene svajer blidt i brisen"

- ** Atmosfære**: "dramatisk atmosfære", "drømmende, æterisk kvalitet", "filmisk tempo"

Generer og gennemgå. AI'en modtager dine billed- og bevægelsesinstruktioner og producerer videosegmenter, der starter præcist fra dit første billede og udfolder sig i henhold til dine bevægelsesinstruktioner. Da du styrer det visuelle udgangspunkt, er resultatet forudsigeligt og konsistent. Videokvaliteten arver billedkvaliteten – et klart, velbelyst og præcist komponeret første billede oversættes direkte til en klar, velbelyst og præcist komponeret video.

For avancerede teknikker til bevægelseskontrol og parring af første/sidste billede henvises til Designvejledning til første og sidste billede. For en omfattende introduktion til Image-to-Video AI henvises til Image-to-Video AI-vejledning.

Tretrinsproces i praksis: Omdan korte beskrivelser til professionelle prompts, omdan prompts til billeder i høj kvalitet, og konverter billeder til dynamiske videoer. Hvert trin forbedrer kvaliteten af det foregående trin.

Seedance-fordel: Tretrins, one-stop-færdiggørelse

I dag sammensætter de fleste kreative, der bruger denne pipeline, tre eller fire forskellige værktøjer. De bruger ChatGPT eller Claude til at skrive billedprompter, skifter til Midjourney eller Tongyi Wansheng for at generere billeder, downloader billedet, åbner Ke Ling eller Runway og uploader det derefter for at generere video. Hvert skift betyder en anden grænseflade, forskellige konti, forskellige faktureringssystemer og forskellige begrænsninger.

Denne fragmenterede arbejdsgang er ikke blot besværlig, den kompromitterer også aktivt kvaliteten.

Hvordan skift af værktøj kompromitterer kvaliteten

Hver gang et billede overføres mellem værktøjer, opstår der forringelse. Download-upload-cyklussen medfører komprimeringsartefakter. Formatkonverteringer (PNG til JPG, WebP til PNG) ændrer farveværdier. Opløsningen kan blive omsamplet. Metadata om, hvordan billedet blev genereret – information, der kunne have hjulpet videomodellen med at producere bedre resultater – fjernes fuldstændigt.

Ud over datakvalitet er der også kognitiv overhead. Hvert værktøj har sin egen prompt-syntaks, forskellige outputindstillinger og forskellige billedformatindstillinger. Du spilder tid på at sætte dig ind i nye grænseflader i stedet for at bruge tiden på kreative iterationer.

Integrerede rørledninger

Seedance eliminerer al sådan friktion ved at tilbyde alle tre faser inden for en enkelt platform:

1. Image Prompt Generator (/image-prompt-generator). Indtast dit kreative koncept, vælg mellem 12 stilarter, og modtag en komplet professionel prompt. De genererede prompts er optimeret til Seedance-billedgenereringsmodellen, men er lige så velegnede til ethvert AI-malerværktøj.

2. Tekst til billede og billede til billede (/text-to-image | /image-to-image). Generer billeder ud fra prompter eller foretag målrettede ændringer af eksisterende billeder. Producer hurtigt flere varianter. Når du har fundet den rigtige komposition, er den klar til at gå videre til næste trin.

- Billede til video Vælg et hvilket som helst forudgenereret billede fra dit bibliotek og send det direkte til videogeneratoren. Ingen downloads, ingen uploads, ingen formatkonvertering kræves. Billeder i fuld opløsning overføres uden tab.

Hvorfor giver integration bedre resultater?

Dette er ikke blot en praktisk funktion; integration giver virkelig overlegne resultater:

- Ingen transmissionstab. Billeder overføres i fuld opløsning mellem stadierne uden komprimering eller resampling.

- Konsistent modeløkosystem. Billed- og videogenereringsmodeller er kalibreret for indbygget kompatibilitet. Billeder produceret af Seedances tekst-til-billed-model er indbygget velegnede til Seedances videomodel.

- **Ensartet kredit-system. ** Du behøver ikke at have tre separate abonnementer. Dine kreditter er universelle på tværs af alle tre værktøjer, hvilket gør budgetallokeringen enkel og gennemsigtig.

- Hurtigere iterationscyklusser. Tiden fra "Jeg vil redigere dette billede" til "Jeg ser den nye video" reduceres fra minutter brugt på at skifte værktøj til blot sekunder med problemfri integration.

- **Bevar den kreative flow. ** Bliv inden for en enkelt grænseflade for at bevare din tankegang. Fokuser på det kreative koncept i sig selv, ikke på filhåndtering eller værktøjsnavigation.

Helt ærligt: Du kan sagtens bruge ChatGPT til at skrive prompts, Midjourney eller Tongyi Wansheng til billedgenerering og Keling eller Runway til videoproduktion for at opbygge en pipeline af høj kvalitet. Mange professionelle gør netop det. Seedances fordel ligger ikke i, at et enkelt trin overgår konkurrenterne markant – den ligger i integrationen, der eliminerer den friktion, der får de fleste kreative til at opgive processen halvvejs. Den bedste arbejdsgang er den, du rent faktisk gennemfører fra start til slut.

Seedance integrerer promptgenerering, billedgenerering og videogenerering i en enkelt platform. Fra koncept til færdig video er der ingen grund til at skifte værktøj, downloade filer eller administrere flere konti.

Komplet praktisk guide: 3 virkelige casestudier

Teori er nyttigt, men praksis giver resultater. Nedenfor finder du tre komplette pipeline-øvelser, der hver især svarer til forskellige kreative mål, forskellige stilarter og forskellige billedformater. Følg med for at opbygge din første komplette pipeline.

Eksempel 1: Filmisk produktreklame

Mål: Produce en fem sekunders reklame for luksusure til produktpræsentationssiden.

Fase 1 — Generering af prompt

Åbn Image Prompt Generator og indtast dit koncept.

Indtastning: "reklame for luksuriøst ur, mørk og dramatisk"

Vælg stil: Fotorealistisk

Genereret prompt:

A luxury men's wristwatch resting on a slab of dark emperador marble,

shot from a low three-quarter angle. Dramatic studio lighting: a single

hard key light from the upper left creates sharp reflections on the

polished steel case and sapphire crystal. The watch face shows 10:10

with luminous indices glowing faintly. Deep shadows pool around the

base, enhancing the sense of weight and prestige. Background is pure

black, fading to subtle charcoal gradient. Microscopic dust particles

float in the key light beam. Color palette: silver, deep charcoal,

amber highlights from the lume. Photorealistic product photography,

8K resolution, razor-sharp detail on every dial marking and link.Det ville tage mindst 10-15 minutter at udarbejde denne prompt manuelt. En promptgenerator klarer det på få sekunder og dækker alle syv dimensioner af professionelle prompts: emne, miljø, belysning, farve, komposition, stil og billedkvalitet.

Fase to — Billedgenerering

Indsæt den genererede prompt i tekst-til-billede. Generer i et billedformat på 16:9, så det passer til liggende videorammer.

Første rendering: Den overordnede komposition er god, men marmoroverfladen reflekterer lidt for kraftigt, hvilket distraherer opmærksomheden fra uret.

Iteration: Finjuster ved hjælp af Image-to-Image. Upload det oprindeligt genererede billede med følgende prompt: "Reducer intensiteten af marmoroverfladens refleksion. Øg skarpheden af urskivens detaljer. Gør baggrundens farveovergang lidt dybere."

Andet forsøg: Uret er i centrum, badet i dramatisk lys og skygge, med en lagdelt komposition. Klar til at gå videre til videofasen.

Trin tre — Videoproduktion

Send de polerede billeder til Image-to-Video.

Træningsopgaver:

The camera executes a slow, smooth orbiting movement around the watch,

revealing different angles of the case and bracelet. The key light

shifts subtly as the camera moves, creating dynamic reflections across

the polished surfaces. Dust particles drift slowly through the light

beam. Cinematic, premium commercial pacing. Steady, professional

camera movement.(Kameraet panorerer langsomt og jævnt rundt om uret og viser forskellige vinkler af urkassen og remmen. Når kameraet bevæger sig, skifter hovedlyskilden subtilt, hvilket skaber dynamiske refleksioner på de polerede overflader. Støvpartikler svæver blidt i lysstrålen. Filmisk, eksklusiv reklametempo. Stabil, professionel kamerabevægelse.)

Leverancer: En poleret 5-sekunders produktpræsentation – der starter med din omhyggeligt komponerede ramme, der glidende cirkler rundt om uret. Dramatisk belysning, skarpe detaljer og premium-teksturer går problemfrit fra kildebilledet gennem hver eneste ramme i videoen.

Eksempel 1: Reklame for luksusure. Fra en kort beskrivelse på fem ord til en poleret produktvideo på fem sekunder – en tredelt proces, der leverer resultater i kommerciel kvalitet.

Eksempel 2: Rejseindhold på sociale medier

Mål: Produce en lodret video, der fanger solopgangen ved et japansk helligdom til TikTok/Instagram Reels.

Fase 1 — Generering af prompt

Indtastning: "Japansk tempel ved solopgang, fredfyldt morgen"

Vælg stil: Fotorealistisk

Genereret prompt:

A traditional Japanese wooden temple (Kiyomizu-dera style) nestled

among ancient cedar trees, photographed at dawn. Golden sunrise light

filters through morning mist, casting long warm shadows across the

temple's wooden veranda. Cherry blossom branches frame the upper

portion of the composition, with delicate pink petals catching the

first light. A stone lantern stands in the foreground left, moss-

covered and weathered. The temple roof's curved eaves are silhouetted

against a sky transitioning from deep indigo to warm peach and gold.

Subtle mist hovers at ground level among the trees. Photorealistic

landscape photography, golden hour lighting, serene and contemplative

atmosphere, high dynamic range, rich natural color palette.Fase to — Billedgenerering

Indsæt i Tekst til billede. Vigtige indstillinger: Generer i 9:16 stående format, der passer til TikTok og Instagram Reels.

Første udkast: Atmosfæren er fantastisk, men kirsebærgrenene er placeret for højt i billedet, hvilket efterlader for meget tom plads i den nederste tredjedel.

Iteration: Efter en mindre ændring af prompten og tilføjelsen af beskrivelsen "kirsebærblomstergrene, der strækker sig fra det øverste højre og venstre hjørne og fylder den øverste tredjedel af den lodrette ramme", placerede anden generation kirsebærblomsterne perfekt som en naturlig ramme for kompositionen.

Kompositionen egner sig perfekt til lodret video: helligdommen trækker blikket mod midten af billedet, mens kirsebærblomsterne øverst skaber visuel interesse. Stenlanterner og tåge i forgrunden giver dybde. Dette billede giver mulighed for bevægelse på tværs af flere lag.

Trin tre — Videoproduktion

Send til Image-to-Video.

Træningsopgaver:

Gentle cherry blossom petals drift slowly downward through the frame.

Morning mist shifts and swirls at ground level among the trees. Two

birds fly across the sky in the background. The sunrise light gradually

intensifies, warming the scene. A subtle breeze moves the cherry

blossom branches slightly. Peaceful, meditative atmosphere. Slow,

contemplative pacing.Kirsebærblomsterblade svæver blidt gennem billedet. Morgendisen flyder blidt hen over jorden mellem træerne. To fugle glider hen over himlen i baggrunden. Solopgangens lys bliver gradvist stærkere og varmer hele scenen. En blid brise rører ved kirsebærgrenene. En rolig, meditativ atmosfære. Et langsomt, kontemplativt rytme.

Leverancer: En 4 sekunders atmosfærisk lodret video, der passer perfekt til TikTok og Instagram Reels. Kirsebærblomster flyver naturligt, mens morgendisen tilføjer dybde og bevægelse. Fugle i baggrunden skaber subtile fokuspunkter. Kildebilledets gyldne, varme toner gennemsyrer hver eneste frame i videoen.

Casestudie 3: Brandfortælling – sammenkobling af første og sidste ramme

Mål: At producere en seks sekunders brandfortælling, der skildrer caféens forvandling fra den stille tidlige morgen til den travle tid med fuldt hus.

I dette tilfælde anvendes pipelinen to gange, hvilket genererer et par billeder bestående af det første og sidste billede for at give videomodellen to visuelle ankre til at definere den narrative bue. For en dybdegående analyse af denne teknik henvises til First and Last Frame Design Guide.

Fase 1 – To spørgsmål

Generer to sæt prompts fra image prompt generator.

Første billedindgang: "En tom kaffebar, badet i lyset fra den tidlige morgen, med varme ravfarver."

Genereret prompt for første ramme:

Interior of an artisanal coffee shop in the early morning, before

opening. Warm amber sunlight streams through large front windows,

casting long golden rectangles across worn hardwood floors. Exposed

brick walls, a polished wooden counter with a brass espresso machine,

and empty mismatched chairs around small tables. A chalkboard menu

hangs behind the counter. Dust motes float in the sunbeams. The space

feels warm, inviting, and full of potential. Shot at eye level from

just inside the entrance. Photorealistic interior photography, warm

color palette, golden hour tones, cozy atmosphere.Sidste billedindgang: "En travl kaffebar på en varm morgen, hvor kunderne nyder deres kaffe."

Genereret slutrammeprompt:

The same artisanal coffee shop, now alive with morning activity.

Diverse customers sit at tables -- some reading, some talking, some

working on laptops. A barista behind the counter steams milk, creating

a plume of white steam. Coffee cups and pastries fill the tables. Warm

morning light still streams through the windows but is supplemented by

the warm glow of pendant lights. The atmosphere is bustling but cozy,

full of quiet energy and the warmth of community. Shot from the same

eye-level position just inside the entrance. Photorealistic interior

photography, warm tones, lively atmosphere.Fase to — To billeder

Generer det første billede i tekst-til-billede med et billedformat på 16:9. Gentag, indtil den tomme café fremstår varm og indbydende, badet i rigeligt gyldent morgenlys.

Den sidste ramme bruger [billede-til-billede]-generering. Upload den første ramme som referencebillede og brug den sidste rammeprompt. Dette trin er afgørende – ved at bruge den første ramme som reference sikres visuel konsistens. Arkitektur, indretning, lysretning og farveskemaer forbliver konsistente mellem rammerne, hvor det eneste, der tilføjes, er personer og aktivitet.

Gentag det sidste billede for at sikre, at gæsten ser naturlig ud, og at baristaen står bag disken. Det er vigtigt, at begge billeder ser ud som om de er taget på samme sted på forskellige tidspunkter og ikke to forskellige steder.

Trin tre — Videoproduktion

Upload det første billede til Image-to-Video. På platforme, der understøtter slutbilledreference, skal du uploade det sidste billede samtidigt.

Træningsopgaver:

Time-lapse style transition. The empty coffee shop gradually fills

with people arriving -- customers entering, sitting down, a barista

beginning to work. Morning light shifts slowly. The scene transitions

from quiet solitude to warm, bustling community. Smooth, cinematic

pacing. The camera position remains fixed.(Overgang i time-lapse-stil. En tom café fyldes gradvist med ankommende gæster – kunderne kommer ind, sætter sig ned, og baristaen begynder at arbejde. Morgenlyset skifter subtilt. Scenen udvikler sig fra rolig ensomhed til en varm, livlig fællesskabsstemning. Jævn, filmisk tempo. Kameraet forbliver stationært.)

Resultat: En seks sekunders brandhistorie udfolder en komplet fortælling – en kaffebar vågner til live. Den første scene skaber en rolig og indbydende atmosfære. Den sidste scene viser det ønskede resultat. AI-genererede overgange forbinder de to scener: Dørene svinger op, gæsterne sætter sig, baristaerne tænder espressomaskinerne, og kaffekopperne dukker op på bordene. Brandbudskabet er diskret, men stærkt – dette er et sted, hvor man føler sig hjemme.

Eksempel 3: Brandfortælling, der forbinder åbnings- og slutningsrammerne. AI genererer en time-lapse-overgang mellem to visuelle ankre – fra morgengryets stilhed til fællesskabets varme.

Teknikker til optimering af rørledninger

Efter at have produceret hundredvis af videoer gennem denne proces har følgende fem principper haft størst indflydelse på kvaliteten af det færdige produkt.

Tip 1: Brug 80 % af din tid på billeder

Dette er den vigtigste optimering. Billedkvaliteten er flaskehalsen i hele processen. Et perfekt billede giver en brugbar video i første generation. Et middelmådigt billede, uanset hvor veludført bevægelsesprompterne er, vil kun give en middelmådig video.

Tidsfordelingen bør groft sagt være som følger:

- Promptgenerering: 5 % (generatoren tager sekunder, håndskrift tager minutter)

- Billedgenerering og iteration: 80 % (generer, evaluer, finjuster, regenerer, indtil scenen er perfekt)

- Videogenerering: 15 % (upload, skriv bevægelsesprompter, generer)

De fleste nybegyndere gør det omvendt – de bruger ti sekunder på et billede og genererer derefter videoer efter hinanden i håb om at finde en god en. Erfarne brugere bruger ti minutter på et billede og får en god video inden for de første par forsøg. Den sidstnævnte tilgang giver bedre resultater med færre kreditter og mindre tid.

Før du begynder at generere video, skal du gentage billederne tre til fem gange. Det er ikke perfektionisme, det er effektivitet.

Tip 2: Designet til bevægelse

Et flot fotografi og et godt videobillede er ikke det samme. Når du genererer billeder til pipelines, skal du forestille dig, hvordan scenen vil se ud, når den kommer til live.

Lad negativ plads være i retning af hovedbevægelsen. Hvis en figur bevæger sig fra venstre mod højre, skal du undgå at placere hende i midten – placér hende lidt til højre for at give plads til bevægelsen. Hvis kameraet bevæger sig mod venstre, skal du sikre dig, at venstre side af billedet indeholder visuelt interessant indhold.

Komponer optagelser i henhold til kameraets retning. Push-optagelser er mest effektive, når det mest interessante motiv fylder midten af billedet. Pan-optagelser kræver visuel interesse på tværs af hele billedets bredde. Cirkulære tracking-optagelser kræver tredimensionelle motiver med dybde frem for flade motiver.

Undgå komplekse symmetriske kompositioner. Selvom perfekt symmetri kan være slående i fotografier, udgør det en udfordring for videoproduktion. AI har svært ved at opretholde præcis symmetri mellem billederne, hvilket resulterer i distraherende rystelser. Asymmetriske kompositioner med et naturligt visuelt flow giver mere jævne videoer.

Inkorporer dybdeindikatorer. Billeder med overlappende elementer i forskellige afstande – forgrundsobjekter, mellemgrundsmotiver og baggrundsmiljøer – giver AI dybdeinformation, hvilket resulterer i forbedrede parallakseffekter og mere naturlige kamerabevægelser.

For en omfattende vejledning i design af billeder specielt til video, se Vejledning i design af første og sidste billede.

Teknik 3: Bevar ensartede billedformater gennem hele processen

Uoverensstemmende billedformater mellem billeder og videorammer udgør en af de mest udbredte fejl i produktionsprocessen, hvilket uundgåeligt forringer outputkvaliteten.

- 16:9 til videoer i liggende format (YouTube, præsentationer, hjemmesidens forside)

- 9:16 til videoer i stående format (TikTok, Instagram Reels, YouTube Shorts)

- 1:1 til kvadratiske videoer (Instagram Stories, visse annoncer på sociale medier)

Indstil billedformatet under billedgenerering i stedet for at vente til videofasen. Hvis du genererer et kvadratisk billede i formatet 1:1 og derefter forsøger at oprette en video i formatet 16:9, skal videomodellen udfylde siderne fra bunden – og kvaliteten af dette genererede indhold vil være ringere end resten af billedet. Generer billeder i det endelige videos format fra starten.

Tip 4: Bevar en ensartet stil i alle faser

De stilistiske nøgleord i billedprompter og bevægelsessignaler i videoprompter skal tale det samme visuelle sprog. Enhver uoverensstemmelse mellem de to vil resultere i subtile kvalitetsproblemer i det endelige resultat.

Hvis din billedprompt indeholder "filmisk, dramatisk belysning, stemningsfuld atmosfære", skal videobevægelsesprompten bruge kompatibelt sprog: "filmisk kamerabevægelse, dramatisk atmosfære, stemningsfuldt tempo". Undgå at kombinere dramatiske, filmiske billeder med bevægelsesprompter som "legende, sprælsk, energisk" – tonale konflikter vil forvirre modellen og reducere sammenhængen.

Hurtigreference — Tabel over stiloverensstemmelse:

| Billedstil | Matchet bevægelsessprog |

|---|---|

| Filmisk, dramatisk | "Filmisk kamerabevægelse, dramatisk tempo, langsomt og velovervejet" |

| Lys, kommerciel, ren | "Jævn, professionel bevægelse, stabilt tempo, rene overgange" |

| Drømmende, æterisk, blød | "Blid, svævende bevægelse, drømmende atmosfære, langsom drift" |

| Høj energi, dynamisk | "Dynamisk kamerabevægelse, energisk tempo, hurtige klip" |

| Dokumentarisk, naturlig | "Håndholdt fornemmelse, naturlig bevægelse, observerende tempo" |

Tip 5: Gem dine bedste pipeline-skabeloner

Når en prompt → billede → video-pipeline giver gode resultater, skal du gemme hele pipelinen:

- Billedprompt (originaltekst)

- Valgte stilindstillinger

- Indstillinger for billedgenerering (billedformat, model, seed-nummer osv.)

- Videobevægelsesprompt

- Indstillinger for videogenerering (varighed, opløsning)

Denne pipeline fungerer som en skabelon. Har du brug for at oprette lignende videoer til forskellige produkter? Erstat emnet i billedprompten og generer igen. Har du brug for forskellige scener inden for samme stil? Behold stilnøgleordene og udskift emnebeskrivelsen.

Over tid vil du opbygge et veludviklet bibliotek af pipelines, der er skræddersyet til forskellige kreative mål: produktreklamer, indhold til sociale medier, brandfortællinger, film-B-roll, karakteranimation. Hvert nyt projekt starter fra et gennemprøvet fundament i stedet for fra bunden.

Sammenligning af alternative værktøjer på tværs af faser

Seedance tilbyder en integreret pipeline, men du kan også oprette denne arbejdsgang ved hjælp af separate værktøjer. Nedenfor findes en ærlig sammenligning af de enkelte trin.

Fase 1: Generering af prompt

| Værktøj | Bedst egnet til | Beskrivelse |

|---|---|---|

| Seedance Image Prompt Generator | Integreret pipeline, 12 forudindstillede stilarter | 2 kreditter pr. prompt. Direkte output til Seedance-billedværktøj. |

| ChatGPT / GPT-4 | Brugerdefineret prompt-engineering | Kræver manuel kopiering og indsættelse. Ingen forudindstillede stilarter. Mere fleksibel til komplekse instruktioner. |

| Claude | Raffinerede, detaljerede prompts | Fremragende til at udføre komplekse kreative briefs. Ingen integration af billedgenerering. |

| Tongyi Qianwen | Optimeret til kinesiske kontekster | Mere naturlig forståelse af kinesiske beskrivelser. Velegnet til indenlandske brugere. Kræver manuel integration med downstream-værktøjer. |

Fase to: Billedgenerering

| Værktøj | Bedst egnet til | Bemærkninger |

|---|---|---|

| Seedance Text-to-Image / Image-to-Image | Pipeline-integration, video-first workflow | Billeder overføres direkte til videoscenen uden tab af kvalitet. |

| Midjourney | Kunstnerisk kvalitet, æstetisk udtryk | Producerer fremragende output. Kræver betjening via Discord eller webgrænseflade. Kan downloades manuelt inden for pipelines. |

| Tongyi Wanshang | Kinesisk prompt-venlig, stabil indenlandsk adgang | Udviklet af Alibaba, fremragende til at forstå kinesiske beskrivelser. Velegnet til indenlandske brugere uden VPN. |

| DALL-E 3 | Prompt-nøjagtighed, tekstuel gengivelse | Fremragende til bogstavelig udførelse af komplekse prompts. Begrænset stilistisk kontrol. |

| Stable Diffusion | Fuld kontrol, lokal generering | Maksimal fleksibilitet. Kræver teknisk miljøopsætning. Velegnet til arbejde med store mængder. |

Trin tre: Videoproduktion

| Værktøj | Bedst egnet til | Beskrivelse |

|---|---|---|

| Seedance Image-to-Video | Integreret pipeline, ensartet kvalitet | Problemfri billedoverførsel, direkte understøttelse af første billedindgang. |

| Kling 3.0 | Lang varighed, høj kvalitet | Genererer op til 2 minutter pr. kørsel. Stærk bevægelseskvalitet. Af Kuaishou, tilgængelig i Kina. |

| Jimeng AI | Kinesisk økosystem, brugervenligt | Af ByteDance, dybt integreret med TikTok-økosystemet. Ideel til oprettelse af korte videoer. |

| Runway Gen-4 | Præcis kontrol, bevægelsesbørster | Director Mode understøtter brugerdefinerede kamerabane. Professionel grænseflade. Højere pris. |

| Pika 2.0 | Enkel onboarding, hurtig eksperimentering | Mest minimalistiske grænseflade. Velegnet til begyndere. Begrænset kontrol over bevægelsesdetaljer. |

Ærligt talt: Du kan helt sikkert opbygge en pipeline af høj kvalitet ved at bruge ChatGPT til hurtig skrivning, Midjourney til billedgenerering og Keeling til videoproduktion. Mange professionelle gør netop det. Seedances fordel ligger ikke i at overgå konkurrenterne på et enkelt trin – den ligger i at eliminere friktion gennem integration, opretholde kvaliteten på tværs af trinene og sammenlægge tre separate arbejdsgange til én. For kreative, der ofte producerer AI-videoer, giver det en tidsbesparelse på flere timer om ugen at forblive på en enkelt platform.

For en detaljeret sammenligning af videogenereringsværktøjer, se Sammenligning af de bedste AI-videogeneratorer 2026.

Almindelige fejl i pipelinen

Nedenfor er de fem mest almindelige fejl, der opstår, når man opsætter en prompt → billede → video-pipeline. Der er en enkel løsning på hver af dem.

Fejl 1: Springe billedfasen helt over

Specifik manifestation: Direkte konvertering af tekst til video, hvor billedgenerering helt omgås.

Hvorfor det er problematisk: Du mister al kontrol over kompositionen. Videomodellen dikterer alt – visuelt indhold, scenens indramning og kameraets startpunkter. Resultaterne er uforudsigelige, og sandsynligheden for, at de matcher din kreative intention ved første forsøg, er lav.

Sådan løser du problemet: Generer altid et første billede, selvom du mener, at din tekstprompt er tilstrækkelig detaljeret. De 30 sekunder, det tager at generere et billede, kan spare dig for flere mislykkede videogenereringer.

Fejl 2: Brug af stockbilleder uden evaluering

Specifik manifestation: At downloade et billede tilfældigt fra internettet eller vælge et fra et billedbibliotek og derefter indsætte det direkte i videogenereringsprocessen uden at vurdere dets egnethed som åbningsbillede.

Hvorfor det er problematisk: Mange fotografier er designet til statisk visning, ikke bevægelse. Beskæringen er for tæt, hvilket ikke giver plads til kamerabevægelser. Motiverne er centreret, hvilket begrænser mulighederne for indramning. Belysningen er flad, hvilket resulterer i kedelige videoeffekter. Højt komprimerede JPEG-filer introducerer artefakter.

Sådan løses problemet: Før du bruger et billede, skal du først vurdere det ud fra princippet om "designet til bevægelse". En bedre tilgang er at bruge pipelines specifikt til at generere en keyframe.

Fejl 3: Forkert billedformat

Specifikke manifestationer: Generering af firkantede billeder og derefter oprettelse af 16:9-videoer eller brug af liggende billeder til at producere stående videoer.

Hvorfor det forårsager betydelig skade: Videomodeller beskærer enten dine billeder (hvilket resulterer i tab af dit omhyggeligt designede indhold) eller udfylder det nye billedformat med indhold, der er genereret fra bunden (hvor de tilføjede kanter er af lavere kvalitet).

Sådan løses problemet: Bestem det endelige billedformat for videoen, inden du genererer billederne. Generer billederne i henhold til dette billedformat.

Fejl 4: Alt for beskrivende videoprompter

Specifik manifestation: Videoprompten beskriver samtidig både scenen og dens bevægelse: "Et luksuriøst ur på mørk marmor med dramatisk belysning, kameraet kredser langsomt, og lysrefleksioner danser hen over overfladen."

Hvorfor det forårsager betydelig skade: Den visuelle beskrivelse kan være i modstrid med det indhold, der er afbildet på billedet. Hvis uret vises på hvid marmor på billedet, men prompten nævner mørk marmor, modtager modellen modstridende signaler. I bedste fald bliver den visuelle beskrivelse overflødig; i værste fald får det modellen til at forsøge at ændre din omhyggeligt designede første ramme.

Sådan oprettes det: Videoprompter skal kun beskrive bevægelse, kameravinkler og atmosfære. Det visuelle er allerede gengivet som billeder. Husk dette princip: billeder formidler "det, der ses", mens videoprompter dikterer "hvordan det bevæger sig".

Fejl 5: At skynde sig at generere videoer uden at gennemgå billederne

Specifik manifestation: Generering af et billede og direkte indlæsning af det i videogenerering, selv når det udviser åbenlyse fejl – såsom let skæv komposition, mindre ufuldkommenheder eller suboptimal belysning.

Hvorfor virkningen er større: Video forstørrer alle fejl i kildebilledet. En mindre ufuldkommenhed i et stillbillede bliver til en vedvarende, bevægelig fejl på tværs af 120 bevægelsesrammer. En komposition, der er lidt ude af centrum, bliver mærkbart forkert, når kamerabevægelsen henleder opmærksomheden på billedrammen. Alle fejl i et fotografi bliver mere tydelige, ikke mindre, i video.

Sådan løses problemet: Betragt billedfasen som et kvalitetskontrolpunkt. Fortsæt ikke til videofasen, før billedet er virkelig tilfredsstillende. Gentag 3-5 gange. Brug billed-til-billed-generering til målrettede reparationer. Videoudgangen kan ikke overstige kvaliteten af kildebilledet.

Ofte stillede spørgsmål

Hvorfor bruge billedformidling i stedet for direkte at konvertere tekst til video?

Tekst-til-video-generering kræver, at AI samtidig skaber både billeder og bevægelse ud fra tekst, hvilket betyder, at du har minimal kontrol over komposition, karakterudseende, belysning og indramning. Den billedbaserede tilgang adskiller disse to opgaver: Du finpudser det visuelle i billedfasen og instruerer derefter AI'en om udelukkende at tilføje bevægelse. Dette giver mere forudsigelige resultater af højere kvalitet, da AI'en modtager konkrete visuelle referencer i stedet for at fortolke tvetydig tekst. Forskellen er særlig udtalt i professionelle scenarier, der kræver specifikke kompositioner, brandfarvepaletter eller ensartet karakterdesign.

Hvad er den komplette proces for at skabe AI-videoer fra bunden?

Den komplette proces består af tre trin. Trin 1: Brug en AI-promptgenerator (f.eks. Seedances Image Prompt Generator) til at udvide dit koncept til en detaljeret billedprompt. Trin 2: Brug denne prompt i et tekst-til-billede-værktøj (f.eks. Seedances Text-to-Image) til at generere referencenbilleder i høj kvalitet, og gentag processen, indtil du er tilfreds. Trin 3: Upload billedet til en billed-til-video-generator (f.eks. Seedances image-to-video), skriv en prompt, der kun beskriver bevægelsen (kamerabevægelse og motivets handlinger), og generer videoen. Hele processen tager 5-15 minutter, afhængigt af hvor mange gentagelser der er nødvendige i billedfasen.

Hvor mange kreditter koster den fulde pipeline på Seedance?

Omkostningerne varierer afhængigt af konfigurationen, men en typisk pipeline-kørsel indebærer generelt: hurtig generering til 2 kreditter, billedgenerering til 4-8 kreditter pr. iteration (forventet 3-5 iterationer, svarende til 12-40 kreditter) og videogenerering til 10-30 kreditter (afhængigt af varighed og opløsning). Fra koncept til færdig video varierer de samlede omkostninger generelt fra 25 til 70 kreditter. Dette udgør en betydelig besparelse i forhold til at bruge tre separate værktøjer med tre separate abonnementer.

Kan billeder genereret af andre værktøjer bruges til at oprette videoer i Seedance?

Bestemt. Seedances [Image-to-Video]-værktøj accepterer alle uploadede billeder – de behøver ikke at være genereret af Seedance. Du kan oprette billeder ved hjælp af Midjourney, DALL-E, Tongyi Wanshang, Stable Diffusion eller ethvert andet værktøj og uploade dem som det første billede. Fordelen ved den integrerede pipeline er, at download-upload-trinnet elimineres, selvom dette ikke er obligatorisk. Når du bruger eksterne billeder, anbefaler vi PNG-format med en opløsning på 1024x1024 eller højere for at forhindre, at komprimeringsartefakter påvirker videoudgangen.

Hvilket billedformat skal der bruges til billeder?

Sørg altid for, at billedformatet passer til din endelige videooutput. 16:9 til liggende videoer (YouTube, præsentationer, indlejringer på hjemmesider), 9:16 til stående videoer (TikTok, Instagram Reels, YouTube Shorts), 1:1 til firkantede videoer (Instagram-feed, visse sociale annoncer). Generer billeder i det korrekte format fra starten. Generer ikke firkantede billeder og forvent derefter, at videoværktøjer konverterer dem til 16:9 – dette vil enten beskære din komposition eller tilføje AI-genereret indhold til kanterne, hvilket begge dele forringer kvaliteten.

Hvordan opretter man keyframe-par?

Generer to billeder ved hjælp af separate pipelines. Det første billede følger standardarbejdsgangen: generer prompts, opret billeder og gentag, indtil resultatet er tilfredsstillende. Det endelige billede anvender image-to-image, hvor det første billede uploades som referencebillede, og ændringerne i den endelige tilstand beskrives. Dette sikrer visuel konsistens – samme placering, samme lysretning, samme farveskema – samtidig med at du opnår den ønskede narrative ændring (forskellige tidspunkter, aktiviteter eller stemninger). Upload begge rammer til en videogenerator, og lad AI'en skabe overgangen. For en omfattende guide til denne teknik, se First and Last Frame Design Guide.

Er denne arbejdsgang egnet til kommercielt indhold?

Egnet. Den tretrinsproces er blevet taget i brug af e-handelsbrands til produktvideoer, marketingteams til reklameaktiver, ejendomsmæglere til ejendomspræsentationer og contentbureauer til produktion af indhold til sociale medier. AI-genererede videoer på 5-15 sekunder med åbningsbilleder i høj kvalitet opfylder nu professionelle standarder for digitalt indhold. Nøglen til kommerciel succes ligger i at investere tid i billedfasen – et raffineret åbningsbillede giver direkte et raffineret video. Til længerevarende eller tv-kvalitets kommercielt indhold anvendes AI-video i stigende grad til kreativ ideudvikling og forhåndsvisning, mens den endelige produktion stadig udføres ved hjælp af traditionelle metoder for at sikre maksimal kontrol.

Hvad skal man gøre, hvis det genererede billede har fejl?

Fortsæt ikke med videogenerering. Ufuldkommenheder i kildebilledet forstærkes i videoen – en let forvrænget hånd i et statisk billede bliver til en mærkbart deformeret hånd i en bevægelsessekvens på 120 billeder. Forbehandl billedet. Brug [image-to-image] til at gengenerere problematiske områder, mens resten af kompositionen bevares. Ved alvorlige fejl (deformerede menneskefigurer, usandsynlige geometrier) skal du gengenerere billedet fuldstændigt med en ændret prompt for at omgå problemet. Elementer, der er tilbøjelige til fejl, omfatter hænder (angiv "hænderne hviler ved siden af kroppen" eller "hænderne i lommerne" for at undgå komplekse fingerstillinger), tekst (undgå at medtage tekst i genererede billeder) og refleksioner (forenkle reflekterende overflader i prompten). Fortsæt først med videoproduktionen, når billedet er fejlfrit.

Begynd at opbygge din kreative pipeline

Den tretrinsproces – prompt → billede → video – er stadig den mest pålidelige metode til at producere AI-videoer af høj kvalitet i 2026. Den adskiller den kreative kontrol, du har brug for (hvordan scenen skal se ud), fra den generative kapacitet, du ønsker (hvordan den skal bevæge sig), hvilket resulterer i videoer, der stemmer overens med din vision i stedet for tilfældige gæt fra AI'en.

Enhver god video begynder med et godt billede. Ethvert godt billede begynder med en god prompt. Læg et godt fundament, så følger alt andet naturligt.

Trin 1: Generer prompts → — Omdan koncepter til professionelle billedprompts ved hjælp af Seedances AI-promptgenerator.

Trin to: Generer billede → — Generer og finpuds gentagne gange det perfekte åbningsbillede til din video.

Trin tre: Generer video → — Omdan billeder til dynamiske videoer med bevægelse, kameravinkler og atmosfære.

Mestre teknikken med det første billede → — Få kontrol over din AI-videoproduktion ved at lære at designe referencerammer.

Yderligere læsning: AI-guide til billed-til-video | Designvejledning til første og sidste billede | Komplet AI-guide til tekst-til-billede | AI-guide til billed-til-billede | Guide til AI-billedpromptgenerator | Bedste AI-billedgeneratorer 2026 | Bedste AI-videogeneratorer til 2026*