บทคัดย่อ

AI สร้างวิดีโอจากภาพใช้เทคโนโลยีการเรียนรู้เชิงลึกที่อิงตามแบบจำลองการกระจายตัวเพื่อแปลงภาพนิ่งให้เป็นวิดีโอแบบไดนามิก ต่างจากการสร้างวิดีโอจากข้อความ คุณเพียงแค่ต้องอัปโหลดภาพถ่ายเพื่อให้ AI สร้างการเคลื่อนไหวที่สมจริง การเคลื่อนไหวของกล้อง และฟุตเทจที่มีความสอดคล้องกันตามเวลาโดยรอบ ซึ่งช่วยให้คุณควบคุมผลลัพธ์สุดท้ายได้อย่างแม่นยำยิ่งขึ้น คู่มือนี้จะครอบคลุมอย่างครบถ้วน: หลักการทางเทคนิคเบื้องหลัง AI สร้างวิดีโอจากภาพ; ประเภทของภาพที่ให้ผลลัพธ์ที่ดีที่สุด; บทแนะนำเชิงปฏิบัติ 5 ขั้นตอนในการสร้างวิดีโอแรกของคุณตั้งแต่เริ่มต้น; กรณีการใช้งานจริง 8 กรณีพร้อมตัวอย่างคำสั่ง; เทคนิคการควบคุมการเคลื่อนไหวขั้นสูง; และการเปรียบเทียบเครื่องมือหลักในตลาดปี 2026 (รวมถึงเครื่องมือที่สามารถเข้าถึงได้โดยตรงในประเทศจีน) ทดลองใช้ AI สร้างวิดีโอฟรี -->

TuSheng Video AI นำภาพถ่ายนิ่งของคุณมาสร้างการเคลื่อนไหวที่สมจริง การเคลื่อนไหวของกล้องแบบภาพยนตร์ และความต่อเนื่องของเวลา—เปลี่ยนภาพนิ่งเพียงเฟรมเดียวให้กลายเป็นคลิปวิดีโอสุดตระการตา

Tusheng Video AI คืออะไร?

เทคโนโลยี AI สร้างวิดีโอจากภาพนิ่ง คือเทคโนโลยีปัญญาประดิษฐ์ที่สามารถสร้างวิดีโอจากภาพนิ่งได้ คุณเพียงให้ภาพถ่าย—ไม่ว่าจะเป็นภาพบุคคล, ภาพสินค้า, ภาพทิวทัศน์, หรือภาพศิลปะ—และแบบจำลอง AI จะสร้างวิดีโอสั้น ๆ ขึ้นมา โดยองค์ประกอบต่าง ๆ จะเริ่มเคลื่อนไหว, กล้องจะเปลี่ยนมุมมอง, และฉากทั้งหมดจะกลายเป็นภาพเคลื่อนไหวที่มีชีวิตชีวา

โดยพื้นฐานแล้ว ระบบสร้างวิดีโอส่วนใหญ่ใช้ โมเดลการแพร่กระจายวิดีโอ เครือข่ายประสาทเทียมเหล่านี้ได้รับการฝึกฝนจากคู่ข้อมูลวิดีโอ-ภาพหลายล้านคู่ โดยเรียนรู้ความสัมพันธ์ทางสถิติระหว่างเฟรมนิ่งและการเคลื่อนไหวตามธรรมชาติที่เกิดขึ้นตามมา เมื่อได้รับภาพใหม่ โมเดลจะคาดการณ์ว่าการเคลื่อนไหวใดดูเป็นธรรมชาติที่สุดและสร้างลำดับเฟรมต่อเนื่องที่เปลี่ยนผ่านอย่างราบรื่นจากภาพถ่ายต้นฉบับ

ความแตกต่างจากข้อความเป็นวิดีโอ

Text-to-Video สร้างเนื้อหาทั้งหมดจากข้อความ AI สร้างทั้งเนื้อหาภาพและการเคลื่อนไหวพร้อมกันตามคำแนะนำข้อความของคุณ—กระบวนการที่ทรงพลังแต่คาดเดาไม่ได้ เนื่องจาก AI กำหนดลักษณะของวัตถุ องค์ประกอบของฉาก และรูปแบบการเคลื่อนไหวทั้งหมดอย่างอิสระ

Tusheng Video พลิกแนวคิดนี้กลับด้าน: คุณเป็นผู้กำหนดจุดยึดภาพ ส่วน AI รู้อยู่แล้วว่าฉากนั้นเป็นอย่างไร เพราะคุณได้แสดงให้มันเห็นโดยตรง หน้าที่เดียวของมันคือสร้างการเคลื่อนไหวที่สมจริง ซึ่งหมายความว่า:

- ควบคุมได้มากขึ้น: ภาพของคุณกำหนดหัวข้อ, การจัดองค์ประกอบ, โทนสี และสไตล์

- ลดการคาดเดา: AI ไม่ต้องการการตีความจากคำอธิบายที่ไม่ชัดเจน

- ความสม่ำเสมอที่ดีขึ้น: ผลลัพธ์ตรงกับภาพต้นฉบับอย่างใกล้ชิด

- การทำงานซ้ำที่รวดเร็วขึ้น: การปรับคำแนะนำการเคลื่อนไหวนั้นง่ายกว่าการเขียนคำอธิบายฉากใหม่ทั้งหมดมาก

ทำไมวิดีโอ TuSheng ถึงมีความสำคัญมากในปี 2026

TuSheng Video AI ได้พัฒนาจากของเล่นทดลองสู่เครื่องมือที่มีประสิทธิภาพ แบรนด์อีคอมเมิร์ซเปลี่ยนภาพสินค้าให้กลายเป็นโฆษณาเคลื่อนไหว ผู้สร้างเนื้อหาทำให้โพสต์ยอดนิยมมีชีวิตชีวาขึ้น นายหน้าอสังหาริมทรัพย์สร้างวิดีโอชมทรัพย์เสมือนจริงจากภาพถ่าย และนักการศึกษาทำให้ภาพประกอบในตำราเรียนมีชีวิตชีวา

เทคโนโลยีนี้ได้ถึงจุดเปลี่ยนสำคัญแล้ว—วิดีโอที่มีความยาว 5 ถึง 15 วินาที ซึ่งสร้างขึ้นจากภาพต้นฉบับคุณภาพสูง สามารถแยกแยะได้ยากมากจากภาพเคลื่อนไหวแบบดั้งเดิมในสถานการณ์ส่วนใหญ่ นี่คือเหตุผลที่การแปลงภาพเป็นวิดีโอได้กลายเป็นหมวดหมู่ที่เติบโตเร็วที่สุดในวงการการสร้างวิดีโอด้วยปัญญาประดิษฐ์

แนวโน้มนี้เห็นได้ชัดเจนเป็นพิเศษในตลาดจีน อัลกอริทึมบนแพลตฟอร์มต่างๆ เช่น Douyin, Xiaohongshu, Bilibili และ Kuaishou ให้ความสำคัญกับเนื้อหาวิดีโอเป็นอย่างมาก ส่งผลให้เกิดความต้องการเครื่องมือที่สามารถแปลงภาพถ่ายเป็นวิดีโอได้อย่างรวดเร็วในหมู่ผู้สร้างสรรค์เนื้อหาอย่างไม่เคยมีมาก่อน Tusheng Video AI จึงเข้ามาตอบโจทย์ช่องว่างในตลาดนี้ได้อย่างแม่นยำ

หลักการทางเทคนิคของวิดีโอ AI ของ Tusheng

การเข้าใจกระบวนการทางเทคนิคช่วยให้คุณได้ผลลัพธ์ที่ดีขึ้น เมื่อคุณทราบว่าทำไม AI ถึงมีพฤติกรรมในลักษณะนั้น คุณสามารถให้ข้อมูลที่ดีขึ้นและเขียนคำสั่งที่มีประสิทธิภาพมากขึ้นได้ นี่คือกระบวนการสี่ขั้นตอนที่เกิดขึ้นเบื้องหลัง

สี่ขั้นตอนของกระบวนการประมวลผล AI ของ Tusheng Video: การเข้ารหัสภาพ, การทำนายการเคลื่อนไหว, การสร้างเฟรม, และการปรับความราบรื่นของเวลา

ขั้นตอนที่หนึ่ง: การเข้ารหัสภาพ

ระบบ AI จะทำการวิเคราะห์ภาพที่คุณป้อนเข้ามาผ่านเครือข่ายเอนโค้ดเดอร์ (encoder network) ก่อน โดยจะบีบอัดภาพให้เป็นตัวแทนทางคณิตศาสตร์ที่มีความหนาแน่นสูง ซึ่งเรียกว่า เวกเตอร์แฝง (latent vector) ขั้นตอนนี้เปรียบเสมือนการดึง "ลายนิ้วมือ" ของภาพออกมา โดย AI จะจับโครงสร้าง สี ความลึก ตำแหน่งของวัตถุ ทิศทางของแสง และข้อมูลเชิงความหมายของภาพนั้น

การแทนค่าแบบแฝงนี้มีขนาดกะทัดรัดมากกว่าข้อมูลพิกเซลต้นฉบับอย่างมาก ทำให้การคำนวณในขั้นตอนถัดไปเป็นไปได้จริง คุณภาพของการเข้ารหัสส่งผลโดยตรงต่อผลลัพธ์ที่ได้ ภาพต้นฉบับที่มีความละเอียดสูงและคมชัดจะสร้างการแทนค่าแบบแฝงที่สมบูรณ์ยิ่งขึ้น ซึ่งนำไปสู่ผลลัพธ์วิดีโอที่มีคุณภาพเหนือกว่า

ขั้นตอนที่สอง: การทำนายการเคลื่อนไหว

นี่คือแกนหลักเชิงสร้างสรรค์ของกระบวนการทั้งหมด โมเดลการแพร่กระจายจะคาดการณ์ว่าการเคลื่อนไหวแบบใดจะดูเป็นธรรมชาติโดยอิงจากภาพต้นฉบับของคุณ โดยคำนึงถึง:

- บริบททิวทัศน์: ภาพถ่ายทะเลควรมีคลื่นซัดสาด; ภาพบุคคลควรแสดงอารมณ์บนใบหน้าอย่างละเอียด

- ข้อมูลเชิงลึก: วัตถุที่อยู่ใกล้เลนส์อาจแสดงรูปแบบการเคลื่อนไหวที่แตกต่างจากวัตถุที่อยู่ไกล

- ความสมจริงทางกายภาพ: ผมควรพลิ้วไปตามลม น้ำควรไหลลงด้านล่าง และผ้าควรทิ้งตัวตามธรรมชาติ

- ข้อความที่คุณป้อน: หากคุณระบุ "แพนช้าๆไปทางซ้าย" โมเดลจะปรับการคาดการณ์การเคลื่อนไหวให้เหมาะสมตามนั้น

โมเดลนี้ไม่ได้เพียงแค่บิดเบือนพิกเซลเท่านั้น แต่จะสร้างเนื้อหาภาพใหม่ทั้งหมดสำหรับพื้นที่ที่เพิ่งถูกเปิดเผยจากการเคลื่อนไหวของกล้องหรือวัตถุ หากกล้องแพนไปทางขวา โมเดลจะ 'เติมเต็ม' ฉากที่อยู่นอกขอบขวาของภาพต้นฉบับ

ขั้นตอนที่สาม: การสร้างกรอบ

โดยอาศัยการคาดการณ์การเคลื่อนไหว โมเดลจะสร้างลำดับของเฟรมวิดีโอขึ้นมา เฟรมแต่ละเฟรมถูกสร้างขึ้นผ่านกระบวนการแพร่กระจายย้อนกลับ—เริ่มต้นจากสัญญาณรบกวน แล้วค่อย ๆ ปรับปรุงให้ชัดเจนขึ้นเป็นภาพที่ชัดเจน ในขณะที่ยังคงความสอดคล้องกับเฟรมก่อนหน้าและภาพต้นฉบับ

Seedance 2.0 และโมเดลสมัยใหม่อื่น ๆ สร้างภาพที่อัตราเฟรมสูง (24–30 fps) พร้อมรักษาความสม่ำเสมอของพิกเซลย่อยระหว่างเฟรมได้อย่างต่อเนื่อง ซึ่งช่วยให้ผลลัพธ์ที่ได้มีความลื่นไหล ปราศจากการกระพริบ และไม่มีปัญหาภาพสั่นไหวที่มักพบในระบบรุ่นก่อนหน้า

ขั้นตอนที่สี่: การปรับเส้นโค้งให้เรียบ

ขั้นตอนสุดท้ายนี้ช่วยให้การเปลี่ยนผ่านระหว่างเฟรมที่สร้างขึ้นทั้งหมดเป็นไปอย่างราบรื่น กลไกการให้ความสนใจตามเวลาตรวจสอบให้แน่ใจว่าความสว่าง สี และการเคลื่อนไหวคงที่ตลอดทั้งวิดีโอ ป้องกันการเกิดข้อบกพร่องทางภาพที่พบบ่อย:

- การเปลี่ยนสีอย่างกะทันหันระหว่างเฟรม

- การปรากฏหรือหายไปของวัตถุอย่างไม่คาดคิด

- การเร่งหรือชะลอความเร็วของภาพเคลื่อนไหวที่ไม่เป็นธรรมชาติ

- การกะพริบของพื้นผิว

ผลลัพธ์ที่ได้คือวิดีโอที่งดงามซึ่งไหลลื่นอย่างเป็นธรรมชาติจากฟุตเทจต้นฉบับ

ทำไมบางภาพถึงดูดีกว่า?

ตอนนี้คุณคงเข้าใจแล้วว่าทำไมคุณภาพของภาพต้นทางจึงมีความสำคัญอย่างยิ่ง ภาพที่เบลอหรือมีความละเอียดต่ำจะสร้างรหัสแฝงที่มีสัญญาณรบกวนในขั้นตอนแรก ส่งผลให้โมเดลการคาดการณ์การเคลื่อนไหว (ขั้นตอนที่สอง) ได้รับข้อมูลน้อยลง ซึ่งนำไปสู่การเคลื่อนไหวที่ไม่แม่นยำและเกิดข้อผิดพลาดทางภาพมากขึ้นในผลลัพธ์สุดท้าย ในทางกลับกัน ภาพที่คมชัด มีการจัดองค์ประกอบที่ดี พร้อมด้วยข้อมูลเชิงลึกที่ชัดเจน จะช่วยให้โมเดลได้รับข้อมูลที่สมบูรณ์ ส่งผลให้วิดีโอที่ได้มีความเป็นธรรมชาติและคุณภาพสูงยิ่งขึ้น

ภาพประเภทใดที่ให้ผลลัพธ์ดีที่สุด?

ไม่ใช่ทุกภาพที่เหมาะสำหรับ TuSheng Video AI ความแตกต่างระหว่างแหล่งข้อมูลที่ดีกับแหล่งข้อมูลที่ไม่ดีอาจจะเป็นช่องว่างระหว่างวิดีโอที่น่าทึ่งกับกองฟุตเทจที่ใช้งานไม่ได้ นี่คือคู่มือที่ใช้งานได้จริง

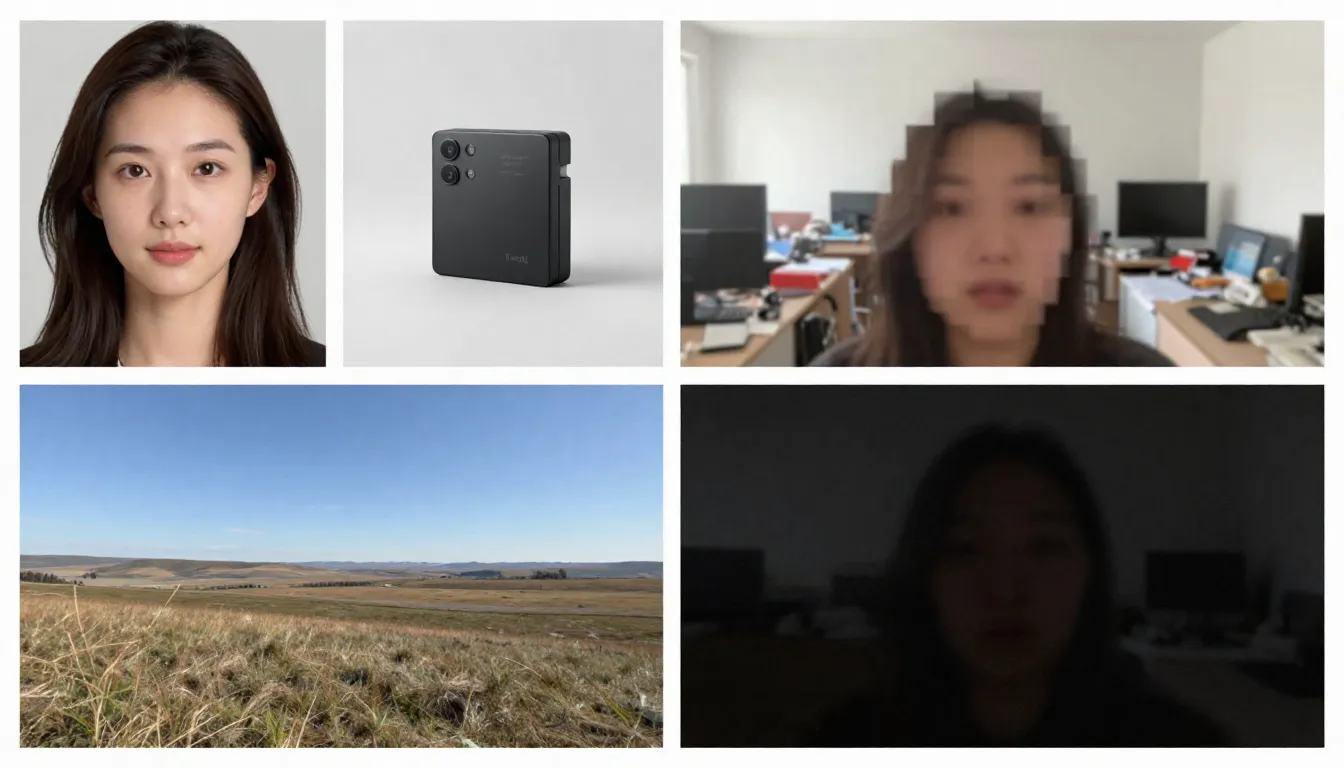

ด้านซ้ายแสดงภาพต้นฉบับที่เหมาะสม (ความละเอียดสูง, จัดองค์ประกอบดี, แสดงการเคลื่อนไหวที่เป็นธรรมชาติ) ในขณะที่ด้านขวาแสดงภาพต้นฉบับที่ไม่เหมาะสม (เบลอ, วุ่นวาย, มีองค์ประกอบที่ยากต่อการประมวลผลของ AI)

ประเภทของภาพที่เหมาะสม

ความละเอียดสูง (1024x1024 หรือสูงกว่า). จำนวนพิกเซลที่มากขึ้นช่วยให้ตัวเข้ารหัสสามารถดึงรายละเอียดได้มากขึ้น. ให้ใช้เวอร์ชันที่มีความละเอียดสูงสุดที่มีอยู่เสมอ. ความละเอียดต่ำสุดที่แนะนำ: 512x512 พิกเซล. ความละเอียดที่เหมาะสม: 1024x1024 หรือสูงกว่า.

หัวข้อชัดเจน โครงร่างแบ่งแยกอย่างชัดเจน. AI ต้องสามารถแยกแยะได้ว่าอะไรควรเคลื่อนไหวและอะไรควรคงที่ ภาพเหมือนที่บุคคลในภาพแยกออกจากพื้นหลังอย่างชัดเจนจะให้ผลลัพธ์ที่ดีกว่าฉากกลุ่มที่ซับซ้อนและวุ่นวายอย่างมาก

มีแสงสว่างเพียงพอและเปิดรับแสงอย่างถูกต้อง. ภาพที่มีแสงสว่างเพียงพอจะให้ข้อมูลสีและความลึกที่ถูกต้องสำหรับแบบ. หลีกเลี่ยงภาพที่มีการเปิดรับแสงมากเกินไปหรือน้อยเกินไปอย่างรุนแรง.

การจัดวางและการจัดองค์ประกอบตามธรรมชาติ. ภาพที่มีฉากหน้า ฉากกลาง และฉากหลังที่ชัดเจนช่วยให้ AI สามารถรับรู้ความลึกได้ดีขึ้น ซึ่งช่วยเพิ่มความสมจริงให้กับเอฟเฟ็กต์การเคลื่อนไหวของภาพและกล้อง

ภาพที่บ่งบอกถึงการเคลื่อนไหว ภาพที่บ่งบอกถึงการเคลื่อนไหว เช่น เส้นผมที่ถูกพัดโดยลม คลื่นที่กำลังจะซัดเข้าหาฝั่ง หรือบุคคลที่กำลังก้าวเดิน เป็นจุดเริ่มต้นที่ทรงพลังสำหรับโมเดลในการทำนายการเคลื่อนไหว AI สามารถเข้าใจ "สิ่งที่จะเกิดขึ้นต่อไป" จากสัญญาณภาพเหล่านี้ได้

พื้นหลังที่สะอาด พื้นหลังที่เรียบง่ายหรือเบลออย่างเป็นธรรมชาติจะช่วยให้วิดีโอที่ได้มีความลื่นไหลมากกว่าพื้นหลังที่รกและมีวัตถุขนาดเล็กจำนวนมาก

ประเภทของภาพที่อาจก่อให้เกิดปัญหา

ภาพเบลอหรือไม่อยู่ในโฟกัส. ความเบลอของข้อมูลนำเข้า, ความเบลอของข้อมูลส่งออก. AI ไม่สามารถเพิ่มความคมชัดที่ไม่มีอยู่ในภาพต้นฉบับได้.

ฉากที่ซับซ้อนเกินไป. ภาพที่มีวัตถุขนาดเล็กจำนวนมาก ลวดลายที่ซับซ้อน หรือความรกรุงรังทางสายตา อาจทำให้โมเดลการคาดการณ์การเคลื่อนไหวไม่สามารถระบุได้ว่าอะไรควรเคลื่อนไหวและอย่างไร

ข้อความหรือการจัดวางตัวอักษรจำนวนมาก แบบจำลองวิดีโอ AI ยังคงประสบปัญหาในการรักษาความชัดเจนของข้อความในแต่ละเฟรม หากภาพของคุณมีโลโก้ เครื่องหมายการค้า หรือข้อความซ้อนทับ อาจเกิดการบิดเบือนในวิดีโอที่สร้างขึ้น

ความละเอียดต่ำ (512x512 หรือต่ำกว่า). รูปภาพขนาดเล็กมีข้อมูลไม่เพียงพอ แม้จะขยายด้วย AI ก่อนนำเข้าข้อมูลก็ไร้ประโยชน์—มันเพิ่มพิกเซลแต่ไม่เพิ่มข้อมูล

การใช้ฟิลเตอร์หนักหรือการประมวลผลหลังการถ่ายทำ การปรับสีอย่างสุดขีด การประมวลผลแบบ HDR หรือการแก้ไขใน Photoshop อย่างมากอาจทำให้โมเดลเข้าใจแสงและมิติผิดพลาดได้

หลายใบหน้าที่มีขนาดแตกต่างกัน. AI จัดการกับภาพบุคคลเดี่ยวได้อย่างมีประสิทธิภาพ. ภาพกลุ่มที่มีใบหน้าหลายใบหน้าที่อยู่ห่างกันทำให้เกิดแอนิเมชั่นที่ไม่สม่ำเสมอ—บางใบหน้าดูเป็นธรรมชาติ ในขณะที่บางใบหน้ากลายเป็นบิดเบี้ยว.

รายการตรวจสอบตนเองก่อนอัปโหลด

ก่อนอัปโหลดรูปภาพ โปรดตรวจสอบจุดต่อไปนี้อย่างรวดเร็ว:

- ความละเอียดขั้นต่ำ 1024x1024 พิกเซล

- วัตถุชัดเจนและแยกออกจากพื้นหลังอย่างชัดเจน

- การเปิดรับแสงถูกต้อง (ไม่มืดหรือสว่างเกินไป)

- ไม่มีฟิลเตอร์หนัก, HDR ที่สุดขีด, หรือการประมวลผลเทียมที่มองเห็นได้

- ข้อความ, โลโก้, หรือองค์ประกอบตัวอักษรน้อยที่สุด

- ความซับซ้อนของฉากที่ควบคุมได้ (1–3 วัตถุหลัก)

- รูปแบบภาพ: JPG, PNG, หรือ WebP

เมื่อเงื่อนไขเหล่านี้ได้รับการปฏิบัติตามแล้ว การผลิตสามารถเริ่มดำเนินการได้

คู่มือทีละขั้นตอน: สร้างวิดีโอจากภาพแรกของคุณ

ทำตามขั้นตอนทั้งห้านี้เพื่อเปลี่ยนภาพนิ่งใดๆ ให้กลายเป็นวิดีโอเคลื่อนไหวด้วย AI เราจะใช้ Seedance เป็นแพลตฟอร์มสาธิตของเรา แม้ว่าหลักการเหล่านี้จะสามารถนำไปใช้กับเครื่องมือแปลงภาพเป็นวิดีโอได้ทุกประเภท

ขั้นตอนที่หนึ่ง: การเลือกภาพต้นฉบับที่เหมาะสม

ภาพต้นฉบับเป็นปัจจัยที่สำคัญที่สุดในการกำหนดคุณภาพของผลลัพธ์. ให้เลือกภาพที่สอดคล้องกับคำแนะนำที่ได้ระบุไว้ก่อนหน้านี้. สำหรับการทดลองครั้งแรกของคุณ ขอแนะนำให้เลือกภาพบุคคลที่เรียบง่ายหรือภาพทิวทัศน์ที่มีความลึกชัดเจน – สองประเภทของภาพนี้ให้ผลลัพธ์ที่สม่ำเสมอมากที่สุด.

ภาพที่แนะนำสำหรับการลองครั้งแรก:

- ภาพใบหน้าชัดเจนหรือครึ่งตัวในแสงที่ดี

- ภาพทิวทัศน์ที่มีท้องฟ้า พื้นผิวของน้ำ หรือพืชพรรณ (องค์ประกอบเหล่านี้มีความเคลื่อนไหวในตัวเอง)

- ภาพผลิตภัณฑ์ที่มีพื้นหลังเรียบ

- งานศิลปะหรือภาพวาดที่มีองค์ประกอบชัดเจน

เมื่อสร้างเป็นครั้งแรก ควรหลีกเลี่ยงการใช้ภาพผสมที่ซับซ้อน ภาพที่มีข้อความจำนวนมาก หรือภาพถ่ายที่ผ่านการแก้ไขอย่างหนัก

ขั้นตอนที่สอง: อัปโหลดไปยัง Seedance

เปิด Seedance Image-to-Video และอัปโหลดรูปภาพที่คุณเลือก Seedance รองรับไฟล์รูปแบบ JPG, PNG และ WebP แพลตฟอร์มจะวิเคราะห์รูปภาพของคุณโดยอัตโนมัติและเตรียมสำหรับการสร้าง

หากภาพมีขนาดใหญ่เป็นพิเศษ (โดยมีด้านใดด้านหนึ่งเกิน 4096 พิกเซล) ระบบจะปรับขนาดภาพโดยอัตโนมัติเพื่อคงสัดส่วนเดิมไว้ โดยไม่จำเป็นต้องปรับแต่งด้วยตนเอง

ขั้นตอนที่สาม: การสร้างคำแนะนำที่เน้นการกระทำ

ในขั้นตอนนี้ คุณแจ้งให้ AI ทราบถึงการเคลื่อนไหวที่ต้องการ คำสั่งของคุณควรอธิบายถึง การเคลื่อนไหวแบบไดนามิก มากกว่าเนื้อหาของภาพ (AI ได้เห็นภาพแล้ว) ให้เน้นที่จุดต่อไปนี้:

- การเคลื่อนไหวของตัวละคร: ตัวละครควรทำอะไร?

- การเคลื่อนไหวของกล้อง: กล้องควรเคลื่อนไหวอย่างไร?

- การเคลื่อนไหวของสิ่งแวดล้อม: ควรมีพลวัตของสิ่งแวดล้อมอย่างไร?

- จังหวะและอารมณ์: จังหวะโดยรวม – เร็วหรือช้า?

ตัวอย่างคำแนะนำสำหรับภาพถ่ายบุคคล:

The woman slowly turns her head to the right and smiles softly.

A gentle breeze moves her hair. Background slightly out of focus

with subtle bokeh movement. Camera slowly pushes in from medium

shot to a close-up. Warm, natural lighting. Cinematic film quality.ตัวอย่างคำแนะนำสำหรับภูมิทัศน์:

Gentle waves roll toward the shore in slow motion. Clouds drift

slowly across the sky from left to right. Sunlight shimmers on

the water surface. Camera slowly pans right, revealing more of

the coastline. Peaceful, serene atmosphere. 4K cinematic quality.ตัวอย่างคำแนะนำสำหรับผลิตภัณฑ์:

The camera slowly orbits around the product, rotating 45 degrees

clockwise. Soft studio lighting with subtle caustic reflections

on the surface. Clean white background with gentle gradient.

Premium commercial aesthetic. Smooth, steady camera movement.หลักการสำคัญ: อธิบายการเคลื่อนไหว ไม่ใช่ฉาก ฉากนั้นมีอยู่แล้วในภาพของคุณ

หมายเหตุ: Seedance รองรับคำสั่งทั้งภาษาจีนและภาษาอังกฤษ แม้ว่าคำสั่งภาษาอังกฤษมักจะให้การควบคุมการเคลื่อนไหวของกล้องที่แม่นยำกว่า ขอแนะนำให้ใช้ภาษาอังกฤษสำหรับคำอธิบายเกี่ยวกับการเคลื่อนไหวและกล้อง ในขณะที่ภาษาจีนอาจใช้สำหรับคำอธิบายบรรยากาศและสไตล์

ขั้นตอนที่สี่: เลือกพารามิเตอร์

กำหนดการตั้งค่าการสร้าง:

| พารามิเตอร์ | ค่าที่แนะนำ | คำอธิบาย |

|---|---|---|

| รุ่น | Seedance 2.0 | คุณภาพภาพที่ดีที่สุดสำหรับการสร้างภาพเป็นวิดีโอ |

| ระยะเวลา | 5 วินาที (สำหรับการทดลองครั้งแรก) | เริ่มสั้น ขยายภายหลังหากพอใจ |

| อัตราส่วนภาพ | ให้ตรงกับภาพ | 16:9 สำหรับแนวนอน, 9:16 สำหรับแนวตั้ง, 1:1 สำหรับสี่เหลี่ยมจัตุรัส |

| ความละเอียด | 1080p | เลือกความละเอียดสูงสุดที่มีอยู่เสมอ |

เทคนิคขั้นสูง: ขั้นแรกให้สร้างเวอร์ชันความยาว 5 วินาที หากการเคลื่อนไหวและสไตล์เป็นที่น่าพอใจ ให้ใช้คำสั่งเดิมเพื่อสร้างเวอร์ชันที่ยาวขึ้น (8–15 วินาที) วิธีนี้ช่วยประหยัดเครดิตในระหว่างขั้นตอนการสำรวจ

ขั้นตอนที่ห้า: สร้าง ตรวจสอบ และทำซ้ำ

คลิก สร้าง และรอ 1–3 นาที เมื่อผลลัพธ์ปรากฏขึ้น ให้ประเมินตามเกณฑ์ต่อไปนี้:

- การเคลื่อนไหวเป็นไปอย่างลื่นไหลและเป็นธรรมชาติหรือไม่?

- วัตถุหลักยังคงความสม่ำเสมอทางสายตาตลอดทั้งวิดีโอหรือไม่?

- การเคลื่อนไหวของกล้องสอดคล้องกับความคาดหวังของคุณหรือไม่?

- มีข้อบกพร่องทางภาพหรือไม่ (เช่น ภาพกระพริบ, การบิดเบี้ยว, การผิดรูป)?

- คุณภาพของวิดีโอตรงกับฟุตเทจต้นฉบับหรือไม่?

หากมีแง่มุมใดที่ไม่เป็นที่น่าพอใจ ให้ปรับคำแนะนำและสร้างใหม่ วิธีการปรับที่พบบ่อย ได้แก่:

- เร็วเกินไป? เพิ่ม "ช้าๆ," "เบาๆ," "ค่อยๆ" ลงในคำอธิบายการเคลื่อนไหว

- ทิศทางกล้องผิด? ** กรุณาระบุให้ชัดเจนยิ่งขึ้น: "กล้องคงที่, ไม่มีการเคลื่อนไหวของกล้อง" หรือ "เคลื่อนกล้องแบบดอลลี่เข้าอย่างช้าๆ"

- มีข้อบกพร่องบนใบหน้าหรือไม่? ลดความซับซ้อนของการเคลื่อนไหว: ลดจำนวนการกระทำที่ดำเนินการพร้อมกัน

- **ขาดความมีชีวิตชีวาหรือไม่? ** แนะนำคำกริยาที่มีความเคลื่อนไหว: "แกว่งไกว," "ไหล," "ล่องลอย," "เปลี่ยน"

หลังจากวนซ้ำสองหรือสามรอบ คุณจะได้วิดีโอคุณภาพสูงที่ทำให้ภาพของคุณมีชีวิตชีวา

เริ่มสร้างคลิปวิดีโอจากภาพแรกของคุณตอนนี้ -->

8 การประยุกต์ใช้หลักและตัวอย่างของการแปลงภาพขนาดใหญ่เป็นวิดีโอ

TuSheng Video AI ไม่ใช่แค่เครื่องมือที่มีลูกเล่นเดียวเท่านั้น มันรองรับการใช้งานที่หลากหลายทั้งในด้านความคิดสร้างสรรค์และการพาณิชย์ ด้านล่างนี้คือแปดสถานการณ์การใช้งานที่มีคุณค่าสูง พร้อมคำแนะนำที่ใช้งานได้จริงซึ่งสามารถคัดลอกและปรับใช้ได้ทันที

- การสร้างภาพเคลื่อนไหวแบบบุคคล

ทำให้ภาพถ่ายของคุณมีชีวิตชีวา. แอปพลิเคชันแอนิเมชั่นพอร์ตเทรตคือแอปยอดนิยมที่สุดในการเปลี่ยนภาพถ่ายเป็นวิดีโอ. อัปโหลดรูปโปรไฟล์ของคุณ, รูปเซลฟี่ หรือรูปภาพตัวละคร, จากนั้นเพิ่มแอนิเมชั่นที่ละเอียดอ่อนและเหมือนจริง – การหายใจ, การกะพริบตา, การหันศีรษะ, การเปลี่ยนสีหน้า และการเคลื่อนไหวของเส้นผม.

เหมาะสำหรับวิดีโอที่ระลึก, เนื้อหาบนสื่อสังคมออนไลน์, การสร้างอวาตาร์เสมือนจริง, และการเล่าเรื่องสร้างสรรค์. บน TikTok และ Xiaohongshu, เนื้อหาที่เรียกว่า 'ภาพถ่ายที่มีชีวิต' ยังคงเป็นจุดสนใจที่ได้รับความนิยมอย่างต่อเนื่อง.

ภาพนิ่งที่สงบนิ่งเปลี่ยนเป็นวิดีโอที่เหมือนจริง—การกระพริบตาอย่างเป็นธรรมชาติ การเคลื่อนไหวของศีรษะที่ละเอียดอ่อน และเส้นผมที่พลิ้วไหว ผลลัพธ์ที่ได้สมจริงอย่างน่าประหลาดใจ

ตัวอย่างข้อความเริ่มต้น:

The person looks directly at the camera with a calm, confident

expression. They slowly tilt their head slightly to the left and

give a subtle warm smile. Eyes blink naturally. A soft breeze gently

moves their hair. Shallow depth of field with softly blurred

background. Warm natural lighting. Cinematic portrait quality.- การจัดแสดงสินค้า

เปลี่ยนภาพถ่ายสินค้าให้กลายเป็นเนื้อหาเชิงพาณิชย์ที่มีชีวิตชีวา นี่คือการปฏิวัติสำหรับแบรนด์อีคอมเมิร์ซและอินฟลูเอนเซอร์ – คุณมีภาพถ่ายสินค้าหลายร้อยหรืออาจถึงหลายพันภาพอยู่แล้ว และตอนนี้แต่ละภาพสามารถกลายเป็นโฆษณาวิดีโอ ภาพเด่นสำหรับหน้ารายละเอียดสินค้า หรือภาพยนตร์สั้นสำหรับโซเชียลมีเดียได้

บนหน้าข้อมูลสินค้าของ Taobao และ JD.com ในการแนะนำสินค้าผ่านการไลฟ์สดใน Douyin และในโพสต์แนะนำสินค้าของ Xiaohongshu การแสดงสินค้าแบบไดนามิกมีอัตราการแปลงที่สูงกว่าภาพนิ่งอย่างมีนัยสำคัญ

ภาพสินค้าแบบมาตรฐานถูกยกระดับสู่ความประณีตของโฆษณาเชิงพาณิชย์ระดับพรีเมียม—ด้วยการแพนกล้อง แสงไฟที่โดดเด่น และการเคลื่อนไหวที่ลื่นไหล—ผลงานการผลิตที่อาจมีค่าใช้จ่ายหลายร้อยถึงหลายพันปอนด์หากทำด้วยวิธีดั้งเดิม

ตัวอย่างข้อความเริ่มต้น:

The camera slowly orbits 90 degrees around the product, revealing

its form from multiple angles. Soft directional studio lighting

with subtle caustic reflections on the surface. A gentle highlight

sweep moves across the product. Clean, premium commercial aesthetic.

Shallow depth of field. Ultra-smooth camera movement. 4K quality.3. ภาพทิวทัศน์แบบไทม์แลปส์

เปลี่ยนภาพถ่ายทิวทัศน์ให้กลายเป็นวิดีโอสไตล์ไทม์แลปส์ที่มีบรรยากาศน่าตื่นตาตื่นใจ เมฆลอยผ่านท้องฟ้า น้ำไหล ไฟเปลี่ยนจากสีทองเป็นสีน้ำเงิน และใบไม้ไหวตามสายลม เหมาะสำหรับเนื้อหาการเดินทาง การโชว์อสังหาริมทรัพย์ทางอากาศ และภาพบรรยากาศสำหรับใช้เป็น B-roll

ช่างภาพภูมิทัศน์และนักทำวิดีโอท่องเที่ยวบน Bilibili สามารถเปลี่ยนภาพถ่ายที่คัดสรรมาเป็นวิดีโอไทม์แลปส์ที่น่าดึงดูดได้โดยตรง ซึ่งช่วยลดต้นทุนการผลิตได้อย่างมาก

ภาพถ่ายทิวทัศน์ที่ถูกเปลี่ยนเป็นภาพยนตร์แบบไทม์แลปส์—เมฆที่ไหลผ่าน, ผิวน้ำที่สั่นไหว, แสงและเงาที่เปลี่ยนแปลง—สร้างคุณภาพที่มีชีวิตชีวาและบรรยากาศจากภาพนิ่งเพียงภาพเดียว

ตัวอย่างข้อความเริ่มต้น:

Time-lapse effect. Clouds move steadily across the sky from left

to right. Water in the foreground ripples and flows gently. Light

shifts subtly as if the sun is moving, creating slowly changing

shadows on the landscape. Trees and grass sway gently in the wind.

Camera remains static on a tripod. Serene, majestic atmosphere.

Cinematic landscape quality.4. เนื้อหาสำหรับสื่อสังคมออนไลน์

เปลี่ยนโพสต์นิ่งที่มีประสิทธิภาพดีที่สุดของคุณให้กลายเป็นคอนเทนต์วิดีโอที่ดึงดูดให้ผู้คนหยุดเลื่อนดู อัลกอริทึมบนแพลตฟอร์มอย่าง TikTok, Xiaohongshu, Bilibili และ Kuaishou ล้วนให้ความสำคัญกับคอนเทนต์วิดีโอเป็นอย่างมาก—โพสต์ภาพที่มีประสิทธิภาพสูงจะได้รับการเข้าชมที่ดีขึ้นอย่างแน่นอนเมื่อถูกแปลงเป็นวิดีโอ

สำหรับผู้สร้างเนื้อหาบน Xiaohongshu ชุดโพสต์ที่มีภาพและข้อความอาจได้รับการเปิดเผยเพิ่มขึ้น 3 ถึง 5 เท่าหากมีเวอร์ชันวิดีโอประกอบ ในขณะเดียวกัน Douyin และ Kuaishou ดำเนินการโดยใช้รูปแบบวิดีโอเป็นเนื้อหาหลักทั้งหมด

ตัวอย่างข้อความเริ่มต้น:

Dynamic, attention-grabbing motion. The subject moves confidently

toward the camera with energy and presence. Background elements

shift with parallax depth effect. Quick, punchy camera push-in

that creates impact. Vibrant colors, high contrast. Bold,

eye-catching aesthetic optimized for social media. Vertical 9:16.- การ์ตูนแอนิเมชั่นศิลปะและภาพประกอบ

นำผลงานศิลปะ ภาพประกอบ ภาพวาดดิจิทัล และการออกแบบกราฟิกของคุณให้มีชีวิตชีวาขึ้น สถานการณ์การใช้งานนี้ได้รับความนิยมอย่างมากจากศิลปิน นักออกแบบเกม และทีมสร้างสรรค์ที่ต้องการนำเสนอผลงานของตนในรูปแบบที่น่าสนใจยิ่งขึ้น

ภายในชุมชนศิลปะและอนิเมะของ Bilibili และ Xiaohongshu ภาพประกอบแบบเคลื่อนไหวถือเป็นเนื้อหาที่ดึงดูดความสนใจสูงมาก การเปลี่ยนงานศิลปะนิ่งให้กลายเป็นวิดีโอแบบ "วอลเปเปอร์มีชีวิต" มักจะได้รับการแชร์และบันทึกมากกว่าภาพต้นฉบับอย่างมีนัยสำคัญ

ตัวอย่างข้อความเริ่มต้น:

The illustrated scene comes to life with gentle, painterly motion.

Characters move subtly within their positions -- breathing, shifting

weight, small gestures. Background elements like leaves, clouds,

or particles drift slowly. The artistic style is preserved exactly

as painted. Movement is smooth and dreamlike, like a living painting.

Gentle ambient lighting shifts. Fantasy illustration quality.6. การชมทรัพย์สินเสมือนจริง

เปลี่ยนภาพถ่ายอสังหาริมทรัพย์ให้กลายเป็นวิดีโอชมเสมือนจริง ตัวแทนอสังหาริมทรัพย์สามารถสร้างตัวอย่างที่เสมือนจริงได้ด้วยการนำภาพถ่ายอสังหาริมทรัพย์ที่มีอยู่มาใช้ ทำให้ไม่จำเป็นต้องจัดทีมถ่ายภาพเฉพาะเพื่อไปถ่ายทำที่สถานที่จริง

สำหรับรายการอสังหาริมทรัพย์ที่แสดงบนแพลตฟอร์มต่างๆ เช่น Ke Holdings และ Anjuke รวมถึงการโปรโมทอสังหาริมทรัพย์ในฟีดโซเชียลมีเดียและบน Xiaohongshu วิดีโอแสดงตัวอย่างแบบไดนามิกแสดงให้เห็นอัตราการแปลงการสอบถามของลูกค้าที่สูงขึ้นอย่างมีนัยสำคัญ

ตัวอย่างข้อความเริ่มต้น:

Smooth virtual walkthrough. The camera glides forward slowly into

the room, revealing the space with a wide-angle perspective.

Natural daylight streams through the windows, casting soft shadows.

Subtle dust particles float in the sunbeams. The camera pans

gently to the left, showing the full room layout. Clean, bright,

aspirational real estate aesthetic. Steady, professional movement.- แฟชั่นและสไตล์โชว์เคส

สร้างเนื้อหาแฟชั่นที่มีชีวิตชีวาจากภาพถ่ายชุดในสตูดิโอ นางแบบเคลื่อนไหว ผ้าพลิ้วไหวอย่างเป็นธรรมชาติ ในขณะที่สไตล์ความงามระดับบรรณาธิการยังคงสมบูรณ์แบบ

บล็อกเกอร์แฟชั่นจาก Xiaohongshu และผู้ขายเสื้อผ้าบน Taobao สามารถแปลงภาพถ่ายนางแบบและภาพชุดเสื้อผ้าแบบวางแบนที่มีอยู่จำนวนมากให้กลายเป็นวิดีโอแสดงผลแบบไดนามิก สร้างความโดดเด่นสะดุดตามากยิ่งขึ้นในฟีดข้อมูล

ตัวอย่างข้อความเริ่มต้น:

The model strikes a confident pose and then slowly shifts their

weight, creating natural body movement. Fabric of the outfit

flows and catches the light with each subtle motion. Wind effect

gently moves the hair. Camera starts at full body and slowly drifts

upward to a waist-up shot. High-fashion editorial lighting with

strong directional shadows. Vogue magazine aesthetic. Cinematic

slow motion.- เนื้อหาการศึกษาและเนื้อหาที่อธิบาย

เปลี่ยนแผนภูมิแบบคงที่ อินโฟกราฟิก และภาพประกอบการศึกษาให้เป็นการนำเสนอที่มีชีวิตชีวา แนวคิดที่ซับซ้อนจะเข้าใจได้ง่ายขึ้นเมื่อถูกนำเสนอในรูปแบบเคลื่อนไหว

ผู้สร้างสรรค์บนโซนความรู้ของ Bilibili และแพลตฟอร์มการศึกษาต่าง ๆ สามารถเปลี่ยนสื่อการสอน แผนภาพ และแผนผังการทำงานให้กลายเป็นสินทรัพย์วิดีโอแอนิเมชัน ซึ่งช่วยเพิ่มประสิทธิภาพการสอนและอัตราการเก็บรักษาผู้ชมได้อย่างมีนัยสำคัญ

ตัวอย่างข้อความเริ่มต้น:

The diagram elements animate sequentially. Arrows begin to flow

in their indicated directions. Labels fade in one by one. Moving

parts of the system activate in logical order, showing the process

step by step. Smooth transitions between stages. Clean, clear

educational style. Elements highlight with subtle glow as they

become active. Professional presentation quality.คู่มือฉบับสมบูรณ์เกี่ยวกับเทคนิคการใช้คำกระตุ้นวิดีโอของ Tusheng

คำสั่งที่สร้างขึ้นอย่างดีเป็นทักษะที่ทรงพลังที่สุดในการสร้างภาพจากรูปภาพ เนื่องจาก AI ได้เห็นภาพของคุณแล้ว คำสั่งของคุณควรมุ่งเน้นไปที่การเคลื่อนไหวและความมีชีวิตชีวาเท่านั้น นี่คือเทคนิคที่ให้ผลลัพธ์ที่ดีที่สุด

คู่มืออ้างอิงด่วนคำสำคัญด้านกีฬา

ใช้คำหลักเฉพาะเหล่านี้เพื่อควบคุมการเคลื่อนไหวของวิดีโออย่างแม่นยำ

| ประเภทการเคลื่อนไหว | คำสำคัญ | ผล | |-------- -|-------|------| | ช็อต: ตรงไปข้างหน้า | เคลื่อนกล้องเข้า, ขยายเข้า, เข้าใกล้, เข้าหา | กล้องเคลื่อนเข้าหาวัตถุ | | ช็อต: ถอยหลัง | เคลื่อนกล้องออก, ถอยหลัง, ถอยห่าง, กว้างขึ้น | กล้องเคลื่อนออกห่างจากวัตถุ | | ช็อต: ซ้าย/ขวา | ปรับกล้องไปทางซ้าย, ปรับกล้องไปทางขวา, ติดตามกล้องไปทางซ้าย, ติดตามกล้องไปทางขวา | กล้องหมุนหรือเคลื่อนที่ในแนวนอน | | ช็อต: ขึ้น/ลง | เอียงกล้องขึ้น, เอียงกล้องลง, ยกกล้องขึ้น, ลดกล้องลง | กล้องหมุนหรือเคลื่อนที่ในแนวตั้ง | | **ช็อต: Orbit | หมุนรอบ, หมุนวน, หมุนรอบจุดศูนย์กลาง, โคจร | กล้องหมุนรอบวัตถุ | | กล้อง: ซูม | ซูมเข้า, ซูมออก, เปลี่ยนระยะโฟกัส | ซูม (ไม่เปลี่ยนตำแหน่ง) | | วัตถุ: การเคลื่อนไหวเล็กๆ | หายใจ, กระพริบตา, เปลี่ยนน้ำหนัก, การเคลื่อนไหวเล็กๆ | การเคลื่อนไหวที่ละเอียดอ่อนและเหมือนจริง | | หัวข้อ: ปานกลาง | หันศีรษะ, ยิ้ม, ทำท่าทาง, เดินช้า ๆ | การเคลื่อนไหวที่ชัดเจนแต่ควบคุมได้ | | หัวข้อ: พลวัต | วิ่ง, กระโดด, เต้น, หมุน, โบกมือ | การเคลื่อนไหวของร่างกายทั้งหมดที่มีพลังงานสูง | | สภาพแวดล้อม: อ่อนโยน | ลมโชย, ล่องลอย, โยกเยก, คลื่นไหว, เปล่งประกาย | การเคลื่อนไหวของสิ่งแวดล้อมที่ละเอียดอ่อน | | สิ่งแวดล้อม: เข้มข้น | พัดแรง, ไหลเชี่ยว, ชน, หมุนวน, ไหลลง | พลวัตของสิ่งแวดล้อมที่รุนแรง | | พาเร็กซัส | พาเร็กซัส, การเปลี่ยนความลึก, ชั้นเคลื่อนที่ | พื้นหน้า/พื้นหลังเคลื่อนที่ด้วยความเร็วที่แตกต่างกัน |

คำสำคัญในการเคลื่อนไหวของกล้องที่แตกต่างกันจะสร้างผลลัพธ์ที่แตกต่างกันอย่างสิ้นเชิง เลือกเทคนิคการเคลื่อนไหวของกล้องของคุณอย่างตั้งใจตามผลลัพธ์ที่ต้องการ

การควบคุมความเร็วและจังหวะ

จังหวะการเคลื่อนไหวมีผลกระทบอย่างลึกซึ้งต่อโทนอารมณ์ของวิดีโอ ใช้ตัวปรับแต่งต่อไปนี้:

- ช้ามาก: "แทบจะไม่รู้สึก," "เคลื่อนไหวช้ามาก," "ช้าเหมือนธารน้ำแข็ง" — ดราม่า, ครุ่นคิด

- ช้า: "ช้าๆ," "นุ่มนวล," "ค่อยเป็นค่อยไป," "สบายๆ" — ความสง่างาม, คุณภาพแบบภาพยนตร์

- ปานกลาง: "มั่นคง," "จังหวะธรรมชาติ," "เดินด้วยความเร็วปกติ" — ความสมจริง, สไตล์สารคดี

- เร็ว: " "อย่างรวดเร็ว," "กระฉับกระเฉง," "กระตือรือร้น," "รวดเร็ว" — มีพลัง, น่าตื่นเต้น

- รวดเร็วมาก: "รวดเร็ว," "หมุนกล้องอย่างรวดเร็ว," "ตัดภาพอย่างรวดเร็ว," "การเคลื่อนไหวอย่างรวดเร็ว" — ตึงเครียด, เต็มไปด้วยการกระทำ

เทคนิคขั้นสูง: ใช้การเคลื่อนไหวแบบสโลว์โมชั่นเป็นค่าเริ่มต้น ในวิดีโอที่สร้างโดย AI การเคลื่อนไหวแบบสโลว์โมชั่นมักจะดูดีกว่าการเคลื่อนไหวแบบเร็ว การเคลื่อนไหวที่รวดเร็วเพิ่มความเสี่ยงต่อความไม่สมบูรณ์และความไม่สอดคล้องกันทางภาพ

การควบคุมการเคลื่อนไหวอิสระของฉากหลังและวัตถุ

คุณสามารถควบคุมได้อย่างอิสระว่าอะไรจะเคลื่อนไหวและอะไรจะคงที่. นี่คือเทคนิคที่ทรงพลังสำหรับการดึงดูดความสนใจของผู้ชม.

วัตถุเคลื่อนไหว, ฉากหลังนิ่ง:

The person walks forward confidently while the background remains

perfectly still. Static camera, no camera movement. Focus entirely

on the subject's motion.พื้นหลังแบบไดนามิก วัตถุแบบคงที่:

The person stands completely still, like a statue. Behind them,

clouds drift across the sky, leaves blow in the wind, and city

lights flicker. Only the environment moves.การเคลื่อนไหวแยกกันของทั้งสองฝ่าย:

The person slowly turns their head while the camera simultaneously

dollies in. Background clouds drift in the opposite direction,

creating a sense of depth and dimension.ความแตกต่างระหว่างการเคลื่อนไหวของกล้องกับการเคลื่อนไหวของวัตถุ

การเข้าใจความแตกต่างระหว่างการเคลื่อนไหวของกล้องกับการเคลื่อนไหวของวัตถุนั้นมีความสำคัญอย่างยิ่งต่อการบรรลุผลลัพธ์ที่ต้องการ

การเคลื่อนไหวของกล้อง เปลี่ยนมุมมองและองค์ประกอบของภาพ ฉากยังคงอยู่นิ่ง ในขณะที่มุมมองเปลี่ยนไป ใช้เพื่อ: เปิดเผยฉาก สร้างบรรยากาศ และเน้นความสำคัญ

การเคลื่อนไหวของวัตถุหมายถึงการเคลื่อนไหวขององค์ประกอบภายในฉากขณะที่กล้องยังคงอยู่นิ่ง การเคลื่อนไหวนี้ถูกนำมาใช้เพื่อ: การสร้างแอนิเมชันตัวละคร, การสาธิตผลิตภัณฑ์, และการจำลองพลวัตของสภาพแวดล้อมตามธรรมชาติ

การเคลื่อนไหวแบบผสมผสาน ใช้ทั้งสองแบบพร้อมกัน นี่เป็นเทคนิคที่ดูสมจริงที่สุด แต่เป็นสิ่งที่ AI ทำได้ยากที่สุดเช่นกัน ขอแนะนำให้เชี่ยวชาญการเคลื่อนไหวแบบใดแบบหนึ่งก่อน แล้วจึงค่อยเพิ่มอีกแบบเมื่อพอใจกับผลลัพธ์แล้ว

โครงสร้างคำสั่งขั้นสูง

เพื่อให้ได้ผลลัพธ์ที่คาดการณ์ได้มากที่สุด จัดระเบียบข้อความกระตุ้นของคุณตามลำดับดังต่อไปนี้:

- การกระทำหลัก — สิ่งที่ตัวหลักทำ

- การเคลื่อนไหวของกล้อง — วิธีการเคลื่อนไหวของกล้อง

- พลวัตของสภาพแวดล้อม — สิ่งที่องค์ประกอบของสภาพแวดล้อมทำ

- ความเร็ว/จังหวะ — จังหวะของการเคลื่อนไหวทั้งหมด

- บรรยากาศ/อารมณ์ — โทนทางอารมณ์

- การเพิ่มคุณภาพทางภาพ — คำอธิบายทางเทคนิคเกี่ยวกับคุณภาพทางภาพ

ตัวอย่างการใช้โครงสร้างนี้:

[Subject] A young woman in a flowing white dress slowly raises

her hand to brush hair from her face.

[Camera] The camera executes a slow, steady dolly in from a

medium shot to a close-up.

[Environment] Cherry blossom petals drift gently through the

air. Soft golden sunlight filters through the trees.

[Speed] All motion is slow and deliberate, almost dreamlike.

[Mood] Romantic, ethereal, peaceful atmosphere.

[Quality] Cinematic shallow depth of field, anamorphic bokeh,

film grain, 4K quality.การเปรียบเทียบเครื่องมือ AI วิดีโอ Tusheng ปี 2026

การแข่งขันในภาคการสตรีมวิดีโอมีความรุนแรงมากขึ้น ด้านล่างนี้คือการวิเคราะห์เปรียบเทียบของแพลตฟอร์มหลักต่างๆ ณ เดือนกุมภาพันธ์ 2026 โดยเน้นเป็นพิเศษที่การเข้าถึงสำหรับผู้ใช้ในจีนแผ่นดินใหญ่

ผลลัพธ์การประมวลผลของภาพต้นฉบับเดียวกันบนแพลตฟอร์มการสร้างวิดีโอที่แตกต่างกันห้าแพลตฟอร์ม ความแตกต่างในคุณภาพการเคลื่อนไหว ความสม่ำเสมอทางเวลา และความสมจริงทางภาพสามารถสังเกตได้ทันที

| คุณสมบัติ | Seedance 2.0 | Runway Gen-4 | Pika 2.0 | Kling 3.0 | Luma Dream Machine | |------|-------------|-------------|---------|------ ----------|-------------------| | ความละเอียดสูงสุด | 2K (2048x1080) | 4K (ขยาย) | 1080p | 1080p | 1080p | | ระยะเวลาสูงสุด | 15 วินาที | 10 วินาที | 5 วินาที | 2 นาที | 5 วินาที | | ตัวเลือกการป้อนข้อมูล | รูปภาพ + ข้อความ + วิดีโอ + เสียง | รูปภาพ + ข้อความ + วิดีโอ | รูปภาพ + ข้อความ | รูปภาพ + ข้อความ | รูปภาพ + ข้อความ | | การป้อนข้อมูลหลายรูปภาพ | รองรับ (สูงสุด 9 รูปภาพ) | ไม่รองรับ | ไม่รองรับ | ไม่รองรับ | ไม่รองรับ | | เสียงต้นฉบับ | รองรับ (8 ภาษาพร้อมการซิงค์ริมฝีปาก) | ไม่รองรับ | รองรับบางส่วน (เอฟเฟกต์เสียง) | ไม่รองรับ | ไม่รองรับ | | การควบคุมกล้อง | แบบคำสั่ง | แปรงเคลื่อนไหว + โหมดผู้กำกับ | พื้นฐาน | พื้นฐาน | แบบคำสั่ง | | โควต้าฟรี | มีให้ใช้งาน (รวมอยู่ในการลงทะเบียน) | พร้อมใช้งาน (จำกัด) | พร้อมใช้งาน (จำกัด) | พร้อมใช้งาน (จำกัด) | พร้อมใช้งาน (จำกัด) | | ราคาเริ่มต้น | ~$9.90/เดือน | $15/เดือน | $10/เดือน | ~$6.99/เดือน | $9.99/เดือน | | การเข้าถึงจากจีนแผ่นดินใหญ่ | เข้าถึงได้โดยตรง | ต้องใช้ VPN | ต้องใช้ VPN | เข้าถึงได้โดยตรง | ต้องใช้ VPN | | เหมาะที่สุดสำหรับ | การควบคุมหลายรูปแบบ, คุณภาพของภาพ | กระบวนการทำงานระดับมืออาชีพ | ผู้เริ่มต้น, เอฟเฟกต์สนุก | วิดีโอแบบยาว, มูลค่าสูง | ความรู้สึกภาพยนตร์, ฉาก 3 มิติ |

รีวิวอย่างละเอียดของแต่ละเครื่องมือ

Seedance 2.0 โดดเด่นเหนือใครในด้านความยืดหยุ่นในการป้อนข้อมูล เป็นแพลตฟอร์มเดียวที่รองรับการอัปโหลดภาพอ้างอิงพร้อมกันได้สูงสุดถึงเก้าภาพ พร้อมการซิงค์เสียงจากอินพุตเสียงแบบลิปซิงค์ และสามารถรวมโหมดอินพุตทั้งหมดไว้ในผลลัพธ์เดียวภายในรอบเดียว หากคุณต้องการควบคุมผลลัพธ์จากภาพเป็นวิดีโอได้อย่างสูงสุด Seedance มอบชุดเครื่องมือที่ครอบคลุมที่สุดให้ ความละเอียดผลลัพธ์ระดับ 2K ยังถือเป็นความละเอียดสูงสุดที่สามารถทำได้เมื่อเทียบกับทุกเครื่องมือ (โดยไม่ต้องอาศัยการอัปสเกล) พัฒนาโดย ByteDance (บริษัทแม่ของ TikTok) Seedance สามารถเข้าถึงได้โดยตรงสำหรับผู้ใช้ในประเทศจีนแผ่นดินใหญ่ โดยไม่จำเป็นต้องใช้ VPN หรือวิธีการชำระเงินจากต่างประเทศ

Runway Gen-4 โดดเด่นในการควบคุมที่แม่นยำ Motion Brush ช่วยให้คุณสามารถ 'วาด' ส่วนที่ต้องการให้เคลื่อนไหวในภาพได้อย่างละเอียดและกำหนดทิศทางได้อย่างแม่นยำ หากคุณต้องการความแม่นยำระดับสูงเป็นพิเศษในบางพื้นที่ Runway คือตัวเลือกที่ทรงพลังที่สุด ข้อเสียคือราคาที่สูงกว่าและโควตาการสร้างภาพที่น้อยกว่า การเข้าถึงภายในประเทศจีนต้องใช้ VPN

Pika 2.0 เป็นตัวเลือกที่เข้าถึงได้ง่ายที่สุด สำหรับผู้เริ่มต้นที่ต้องการทดลองสร้างวิดีโอจากภาพโดยไม่ต้องเรียนรู้เทคนิคการสร้างคำสั่ง Pika มีเอฟเฟกต์แบบคลิกเดียวและอินเทอร์เฟซที่ใช้งานง่ายซึ่งเป็นจุดเริ่มต้นที่ต่ำที่สุด แม้ว่าระดับคุณภาพของภาพจะยังไม่เทียบเท่ากับเครื่องมือระดับพรีเมียม แต่ก็เพียงพอสำหรับเนื้อหาโซเชียลทั่วไป จำเป็นต้องใช้ VPN เพื่อเข้าถึงภายในประเทศจีนแผ่นดินใหญ่

Kling 3.0 โดดเด่นเหนือคู่แข่งทั้งในด้านระยะเวลาการทำงานและความคุ้มค่า หากคุณต้องการสร้างวิดีโอที่ยาวขึ้น—30 วินาที, 1 นาที หรือแม้กระทั่ง 2 นาที—จากภาพเดียว Kling คือตัวเลือกเดียวที่เหมาะสมอย่างแท้จริง อัตราส่วนราคาต่อคุณภาพของภาพนั้นยอดเยี่ยมเป็นพิเศษ ข้อจำกัดของมันอยู่ที่ตัวเลือกการป้อนข้อมูลที่จำกัด (ภาพเดียว + ข้อความ) ในฐานะผลิตภัณฑ์ภายใต้ Kuaishou, Kling สามารถเข้าถึงได้โดยตรงภายในประเทศจีน, มอบตัวเลือกที่ราบรื่นให้กับผู้ใช้ในประเทศอีกหนึ่งทางเลือก.

Luma Dream Machine โดดเด่นในการเข้าใจเชิงพื้นที่ สำหรับภูมิทัศน์ สถาปัตยกรรม และฉากที่ต้องการการรับรู้เชิงสามมิติ Luma สร้างภาพลวงตาและการเคลื่อนไหวของกล้องที่น่าเชื่อถือที่สุด อย่างไรก็ตาม การสร้างแอนิเมชันตัวละครยังด้อยกว่าคู่แข่ง การเข้าถึงภายในประเทศจำเป็นต้องใช้ VPN

คำแนะนำสำหรับผู้ใช้ในประเทศจีนแผ่นดินใหญ่

หากคุณอยู่ในจีนแผ่นดินใหญ่ มีเครื่องมือวิดีโอหลักสองประเภทที่สามารถใช้งานได้โดยตรงโดยไม่ต้องใช้ VPN:

- Seedance 2.0 — พัฒนาโดย ByteDance ใช้งานได้อย่างเต็มรูปแบบ พร้อมใช้งานทันที รองรับการป้อนข้อมูลหลายรูปแบบ + ความละเอียด 2K + ระบบเสียงในตัว

- Kling 3.0 — ผลิตภัณฑ์ภายใต้ Kuaishou โดดเด่นในการสร้างวิดีโอรูปแบบยาวด้วยคุณภาพคุ้มค่าเกินราคา

ในขณะที่เครื่องมือต่างประเทศเช่น Runway, Pika, และ Luma ต่างก็มีคุณสมบัติที่โดดเด่นเป็นของตัวเอง แต่ทั้งหมดนี้ต้องการการเข้าถึงผ่าน VPN และวิธีการชำระเงินต่างประเทศ ซึ่งก่อให้เกิดอุปสรรคที่สูงขึ้นในการเริ่มต้นใช้งาน

สำหรับผู้สร้างเนื้อหาบนแพลตฟอร์มในประเทศ เช่น Douyin, Xiaohongshu, Bilibili และ Kuaishou การเลือกใช้เครื่องมือที่สามารถเข้าถึงได้โดยตรงภายในประเทศจีนไม่เพียงแต่ให้ความสะดวกสบายมากขึ้นเท่านั้น แต่ยังเพิ่มความน่าเชื่อถือในแง่ของความเสถียรของเครือข่ายและความสะดวกในการชำระเงินอีกด้วย

สำหรับการเปรียบเทียบที่ครอบคลุมมากขึ้น (รวมถึงความสามารถในการสร้างวิดีโอจากข้อความ) โปรดดูที่ การจัดอันดับเครื่องมือสร้างวิดีโอ AI ปี 2026

ข้อผิดพลาดที่พบบ่อยและวิธีการแก้ไข

หลังจากทดสอบคลิปวิดีโอหลายพันคลิป นี่คือข้อผิดพลาดที่พบบ่อยที่สุดห้าข้อที่เราสังเกตเห็น พร้อมด้วยวิธีการแก้ไขเฉพาะ

- ใช้ภาพสต็อกความละเอียดต่ำ

ข้อผิดพลาดที่เกิดขึ้น: อัปโหลดภาพขนาดเล็กที่ถูกบีบอัด (เช่น ภาพขนาดย่อ 400x300 ที่บันทึกจาก WeChat หรือโซเชียลมีเดีย) ในขณะที่คาดหวังว่าจะได้วิดีโอความละเอียดสูง

สาเหตุที่ล้มเหลว: ตัวเข้ารหัสไม่สามารถดึงข้อมูลภาพที่เพียงพอจากภาพความละเอียดต่ำได้ ผลลัพธ์ที่ได้จึงมีความพร่ามัวและซ้อนทับด้วยสัญญาณรบกวนจากการเคลื่อนไหว

วิธีแก้ไข: ให้ใช้เวอร์ชันของภาพที่มีความละเอียดสูงสุดเสมอ หากมีเพียงภาพที่มีความละเอียดต่ำ ให้ใช้เครื่องมือเพิ่มคุณภาพภาพด้วย AI (เช่น Real-ESRGAN หรือ Topaz Gigapixel) เพื่อเพิ่มคุณภาพความละเอียดก่อนทำการอัปโหลด ขนาดที่แนะนำอย่างน้อยคือ 1024x1024 พิกเซล

- เขียนคำบรรยายฉากแทนการบรรยายการกระทำ

ข้อผิดพลาดที่เกิดขึ้น: การเขียนหัวข้อให้แรงบันดาลใจเช่น "ผิวน้ำทะเลในยามพระอาทิตย์ตกดิน แสงสีทองระยิบระยับบนผิวน้ำ" ซึ่งเป็นการอธิบายลักษณะของภาพ—ซึ่ง AI รู้อยู่แล้ว

สาเหตุที่ล้มเหลว: AI ได้ทำการเข้ารหัสภาพไปแล้ว การอธิบายเนื้อหาของภาพกลับไปยัง AI อีกครั้งเป็นการสิ้นเปลืองพื้นที่คำสั่งด้วยข้อมูลที่ซ้ำซ้อน และไม่ให้ทิศทางสำหรับการเคลื่อนไหว

วิธีแก้ไข: ให้เน้นข้อความทั้งหมดเกี่ยวกับการเคลื่อนไหว. เขียนใหม่เป็น: "คลื่นลูกน้อยๆ ไหลเอื่อยๆ ไปยังชายฝั่ง แสงแดดสีทองส่องประกายระยิบระยับบนผิวน้ำ เมฆลอยไปอย่างช้าๆ จากซ้ายไปขวา กล้องเลื่อนไปทางขวาอย่างช้าๆ ตามแนวชายฝั่ง"

- การเรียกร้องให้ดำเนินการหลายอย่างพร้อมกันมากเกินไป

ข้อผิดพลาดที่เกิดขึ้น: "ตัวละครหันศีรษะ, โบกมือ, เดินไปข้างหน้า, หยิบถ้วย, ยิ้ม และเต้นรำ, ในขณะที่กล้องซูมเข้า, เลื่อนไปทางซ้าย และเอียง."

สาเหตุที่ล้มเหลว: โมเดล AI ปัจจุบันไม่สามารถประสานงานการกระทำที่มากกว่าสองหรือสามอย่างพร้อมกันได้อย่างน่าเชื่อถือ คำสั่งที่มากเกินไปจะทำให้โมเดลละเลยคำสั่งส่วนใหญ่หรือสร้างผลลัพธ์ที่สับสนและมีข้อผิดพลาด

วิธีการแก้ไข: จำกัดแต่ละรอบการสร้างให้เหลือเพียงหนึ่งการกระทำหลักของตัวละครและหนึ่งการเคลื่อนไหวของกล้อง สำหรับการกระทำที่ซับซ้อนและต่อเนื่อง ให้สร้างคลิปสั้นๆ หลายคลิปแยกกันก่อน แล้วจึงนำมารวมและตัดต่อเข้าด้วยกัน

- ละเว้นความไม่ตรงกันของอัตราส่วนภาพ

ข้อผิดพลาดที่พบบ่อย: อัปโหลดรูปภาพแนวนอนในอัตราส่วน 16:9 แต่ตั้งค่าผลลัพธ์เป็นแนวตั้ง 9:16 หรือในทางกลับกัน

ทำไมจึงล้มเหลว: ปัญญาประดิษฐ์ (AI) มักจะครอบตัดภาพของคุณอย่างมากหรือจำเป็นต้องเติมพื้นที่ว่างขนาดใหญ่ ซึ่งทั้งสองวิธีนี้ไม่ได้ให้ผลลัพธ์ที่น่าพึงพอใจ—การครอบตัดทำให้การจัดองค์ประกอบภาพที่ตั้งใจไว้เสียไป ในขณะที่การเติมพื้นที่ใหม่จำนวนมากจะก่อให้เกิดความไม่สม่ำเสมอ

วิธีแก้ไข: ตรวจสอบให้แน่ใจว่าอัตราส่วนภาพของผลลัพธ์ตรงกับสัดส่วนของภาพต้นฉบับ ใช้ 16:9 สำหรับภาพแนวนอน และ 9:16 สำหรับภาพแนวตั้ง หากต้องการอัตราส่วนภาพที่แตกต่าง ให้ครอบตัดภาพต้นฉบับให้มีสัดส่วนตามที่ต้องการก่อนอัปโหลด

- การคาดหวังผลลัพธ์ที่สมจริงจากภาพประกอบ

ข้อผิดพลาดที่เกิดขึ้น: อัปโหลดภาพการ์ตูนหรือภาพออกแบบแบบแบน โดยคาดหวังให้ AI สร้างวิดีโอเคลื่อนไหวที่สมจริงเหมือนภาพถ่าย

สาเหตุที่ล้มเหลว: โมเดลพยายามตีความสไตล์ศิลปะ ซึ่งบางครั้งอาจทำให้เกิดความสมจริงที่ไม่ต้องการ ภาพวาดที่แบนราบขาดความลึกและสัญญาณการให้แสงสว่างที่โมเดลต้องพึ่งพาเพื่อการคาดการณ์การเคลื่อนไหวตามธรรมชาติ

วิธีแก้ไข: หากต้นฉบับเป็นภาพวาด ให้ระบุสไตล์อย่างชัดเจนในคำสั่ง: "รักษาสไตล์ศิลปะภาพวาดไว้อย่างเคร่งครัด แอนิเมชันในสไตล์ 2D ไม่ใช่แบบเหมือนจริง การเคลื่อนไหวควรให้ความรู้สึกเหมือนวาดด้วยมือและมีลักษณะการระบายสี" คำสั่งนี้จะบอกโมเดลให้รักษาสไตล์ศิลปะไว้แทนที่จะเพิ่มความเป็นเหมือนจริง

คำถามที่พบบ่อย

เครื่องมือ AI ตัวใดเหมาะสมที่สุดสำหรับการสร้างวิดีโอจากภาพ?

Seedance 2.0 คือคำแนะนำอันดับหนึ่งของเราสำหรับการสร้างวิดีโอจากภาพในปี 2026 รองรับการป้อนภาพหลายภาพ (สูงสุด 9 ภาพอ้างอิง) ให้ผลลัพธ์ที่ความละเอียด 2K และนำเสนอการผสมผสานที่ยืดหยุ่นที่สุดระหว่างภาพ ข้อความ วิดีโอ และเสียง นอกจากนี้ Seedance ซึ่งพัฒนาโดย ByteDance สามารถเข้าถึงได้โดยตรงภายในประเทศจีนแผ่นดินใหญ่ สำหรับผู้ใช้ที่คำนึงถึงงบประมาณ Kling 3.0 มอบคุณภาพของภาพที่ยอดเยี่ยมในราคาที่ต่ำกว่า และยังเข้าถึงได้โดยตรงในจีนแผ่นดินใหญ่ สำหรับผู้เริ่มต้น Pika 2.0 มีอินเทอร์เฟซที่ง่ายที่สุด ทางเลือกที่เหมาะสมที่สุดขึ้นอยู่กับข้อกำหนดเฉพาะของคุณ—โปรดดูที่ [ตารางเปรียบเทียบเครื่องมือ](#2026-year image-to-video AI tool comparison) ของเรา

สามารถใช้ TuSheng Video ได้ฟรีหรือไม่?

แน่นอน แพลตฟอร์มหลายแห่งมีโควตาฟรีให้ใช้งาน Seedance มอบเครดิตฟรีให้กับผู้ใช้ใหม่ทุกคน—ไม่ต้องใช้บัตรเครดิต Pika 2.0 และ Luma Dream Machine ก็มีการสร้างผลงานฟรีในจำนวนจำกัดเช่นกัน HaiLuo AI ให้บริการสร้างผลงานฟรี 10 ครั้งต่อวัน โควตาฟรีเหล่านี้เพียงพอสำหรับการทดลองใช้เทคโนโลยีและสร้างวิดีโอหลายชิ้น สำหรับการใช้งานต่อเนื่อง แผนชำระเงินจะคุ้มค่ากว่า สำหรับกลยุทธ์การใช้งานฟรีเพิ่มเติม โปรดดูที่ คู่มือการใช้งานฟรีของ Seedance

ความยาวสูงสุดของวิดีโอที่สร้างโดย AI คืออะไร?

แพลตฟอร์มต่างๆ มีขีดจำกัดที่แตกต่างกัน Kling 3.0 เป็นผู้นำในวงการ สามารถสร้างวิดีโอได้ยาวถึง 2 นาทีจากภาพเดียว Seedance 2.0 จำกัดความยาวสูงสุดที่ 15 วินาที Runway Gen-4 จำกัดเวลาสูงสุดที่ 10 วินาที Pika 2.0 และ Luma Dream Machine จำกัดวิดีโอไว้ที่ 5 วินาที สำหรับสถานการณ์บนโซเชียลมีเดียและการตลาดส่วนใหญ่ ความยาวที่เหมาะสมคือ 5–15 วินาที หากต้องการวิดีโอที่ยาวกว่านี้ สามารถสร้างคลิปสั้นหลายคลิปเพื่อตัดต่อภายหลัง หรือใช้ Kling สำหรับการสร้างวิดีโอแบบยาวในครั้งเดียว

รูปแบบภาพใดเหมาะสมที่สุดสำหรับการสร้างวิดีโอด้วย AI?

PNG เป็นตัวเลือกที่ดีที่สุดเนื่องจากเป็นรูปแบบที่ไม่สูญเสียคุณภาพ—ปราศจากข้อบกพร่องจากการบีบอัด WebP (โหมดไม่สูญเสียคุณภาพ) ให้ผลลัพธ์ที่เทียบเท่ากันแต่มีขนาดไฟล์ที่เล็กกว่า JPG ก็เหมาะในกรณีส่วนใหญ่เช่นกัน แต่ไฟล์ JPG ที่ถูกบีบอัดมากเกินไปและมีลักษณะผิดปกติที่เห็นได้ชัด จะทำให้คุณภาพของผลลัพธ์ลดลง ควรหลีกเลี่ยงการใช้ GIF, BMP หรือรูปแบบที่ไม่มาตรฐานอื่น ๆ ทุกแพลตฟอร์มหลักรองรับ JPG, PNG และ WebP ความละเอียดขั้นต่ำ: 512x512 พิกเซล แนะนำให้ใช้: 1024x1024 หรือสูงกว่า

AI สามารถทำให้ภาพทุกประเภทเคลื่อนไหวได้หรือไม่?

AI สามารถสร้างภาพเคลื่อนไหวให้กับภาพได้เกือบทุกประเภท แม้ว่าผลลัพธ์จะแตกต่างกันไปตามหัวข้อ ภาพบุคคลและภาพถ่ายใบหน้า ให้ผลลัพธ์ที่ดีที่สุด—โมเดลปัจจุบันสามารถตีความการเคลื่อนไหวของใบหน้าและเส้นผมได้อย่างแม่นยำ ภาพทิวทัศน์และฉากธรรมชาติ ก็ทำได้ดีเช่นกัน โดยมีการเคลื่อนไหวของเมฆ น้ำไหล และใบไม้ที่พลิ้วไหวอย่างสมจริง ภาพสินค้าที่มีพื้นหลังสะอาด ให้ผลลัพธ์ที่เชื่อถือได้อย่างสม่ำเสมอ ภาพวาดและงานศิลปะ สามารถทำเป็นภาพเคลื่อนไหวได้ แต่จำเป็นต้องมีคำแนะนำด้านสไตล์ที่ปรับให้เหมาะสมเพื่อหลีกเลี่ยงความสมจริงเกินจริง ฉากกลุ่มที่ซับซ้อน ภาพที่มีข้อความจำนวนมาก และภาพถ่ายคุณภาพต่ำ ให้ผลลัพธ์ที่ไม่เสถียรมากที่สุด

อะไรคือความแตกต่างระหว่างวิดีโอที่สร้างจากภาพกับวิดีโอที่สร้างจากข้อความ?

ข้อความเป็นวิดีโอ สร้างทั้งเนื้อหาภาพและการเคลื่อนไหวพร้อมกันจากคำอธิบายที่เป็นข้อความ ระบบ AI จะกำหนดลักษณะภาพทั้งหมด ทำให้มีการควบคุมรายละเอียดเฉพาะน้อยลงแต่มีความอิสระในการสร้างสรรค์มากขึ้น ภาพเป็นวิดีโอ ใช้ภาพที่มีอยู่ของคุณเป็นจุดเริ่มต้น สร้างเฉพาะการเคลื่อนไหวเท่านั้น คุณยังคงควบคุมผลลัพธ์ทางภาพได้อย่างแม่นยำเพราะคุณให้ข้อมูลอ้างอิงทางภาพ การสร้างวิดีโอจากภาพมักจะมีผลลัพธ์ที่คาดการณ์ได้และสม่ำเสมอมากกว่า เนื่องจาก AI มีจุดยึดภาพที่ชัดเจน ส่วนการสร้างวิดีโอจากข้อความจะเหมาะสมกว่าสำหรับการให้ AI สร้างเนื้อหาใหม่ทั้งหมดตั้งแต่เริ่มต้น

Tusheng Video สามารถควบคุมการเคลื่อนไหวของกล้องได้หรือไม่?

แน่นอน เครื่องมือสร้างวิดีโอแบบสมัยใหม่ส่วนใหญ่รองรับการควบคุมการเคลื่อนไหวของกล้องผ่านข้อความคำสั่ง คุณสามารถระบุการเคลื่อนไหวเช่น "dolly in", "pan left", "orbit around", "crane up", "zoom out", และ "tracking shot" Seedance 2.0 และ Luma Dream Machine ตอบสนองต่อคำสำคัญการเคลื่อนไหวเหล่านี้ได้อย่างแม่นยำเป็นพิเศษ Runway Gen-4 มอบความแม่นยำเพิ่มเติมผ่าน Motion Brush และ Director Mode ซึ่งช่วยให้สามารถวาดเส้นทางการเคลื่อนไหวได้ แนะนำให้ระบุประเภทการเคลื่อนไหวเพียงหนึ่งประเภทต่อการสร้างผลลัพธ์หนึ่งครั้ง เสริมด้วยตัวปรับความเร็ว เช่น "ช้าๆ" หรือ "คงที่"

คุณภาพของภาพในวิดีโอที่สร้างโดย AI เพียงพอสำหรับการใช้งานในระดับมืออาชีพหรือไม่?

สำหรับเนื้อหาวิดีโอแบบสั้น (5–15 วินาที) นั้นสามารถทำได้โดยสมบูรณ์ ผลลัพธ์จากแพลตฟอร์มชั้นนำอย่าง Seedance 2.0 และ Runway Gen-4 ได้ถูกนำไปใช้ในเชิงพาณิชย์อย่างมืออาชีพแล้วในด้านการตลาดบนโซเชียลมีเดีย วิดีโอสินค้าสำหรับอีคอมเมิร์ซ การนำเสนออสังหาริมทรัพย์ และงานสร้างสรรค์โฆษณา ในประเทศ, เนื้อหาเชิงพาณิชย์ที่มีปริมาณมากบน Douyin และ Xiaohongshu ได้รวมเอาสินทรัพย์วิดีโอที่สร้างโดย AI เข้าไว้ด้วยกันแล้ว อย่างไรก็ตาม ข้อจำกัดยังคงมีอยู่: ความยาวที่เพิ่มขึ้นอาจเพิ่มความเสี่ยงต่อความไม่สมบูรณ์, ฉากที่ซับซ้อนและมีหลายวัตถุอาจไม่เสถียร, และการแสดงผลข้อความภายในวิดีโออาจยังไม่สมบูรณ์แบบ สำหรับงานที่ต้องการความสมบูรณ์แบบอย่างสูงสุด เช่น การถ่ายทอดทางโทรทัศน์หรือภาพยนตร์ การถ่ายทำแบบดั้งเดิมยังคงเป็นตัวเลือกที่ปลอดภัยกว่า สำหรับการตลาดดิจิทัลและเนื้อหาทางสังคม เทคโนโลยีการสร้างวิดีโอจากภาพด้วย AI ได้มาตรฐานระดับมืออาชีพแล้ว

สรุป

TuSheng Video AI ได้พัฒนาจากอุปกรณ์แปลกใหม่กลายเป็นเครื่องมือที่จำเป็นสำหรับการสร้างเนื้อหา เทคโนโลยีได้เติบโตเต็มที่ เครื่องมือต่างๆ ใช้งานง่ายขึ้น และคุณภาพของผลลัพธ์ในปัจจุบันได้มาตรฐานระดับมืออาชีพสำหรับสถานการณ์เนื้อหาดิจิทัลส่วนใหญ่

ต่อไปนี้คือประเด็นสำคัญ:

- คุณภาพของภาพต้นฉบับมีความสำคัญสูงสุด ภาพที่คมชัด มีการจัดองค์ประกอบที่ดี และมีความละเอียดสูงจะให้ผลลัพธ์ที่เหนือกว่าอย่างมากเมื่อเทียบกับภาพที่เบลอหรือมีความละเอียดต่ำ

- เขียนการเคลื่อนไหว ไม่ใช่คำอธิบาย AI ได้เห็นภาพของคุณแล้ว ให้คำแนะนำว่าสิ่งต่างๆ ควรเคลื่อนไหวอย่างไร ไม่ใช่ควรมีลักษณะอย่างไร

- **เริ่มต้นอย่างง่าย ** การกระทำของวัตถุหนึ่งอย่างบวกกับการเคลื่อนไหวของกล้องหนึ่งครั้ง. ฝึกฝนพื้นฐานให้เชี่ยวชาญก่อนเพิ่มความซับซ้อน.

- ทำซ้ำอย่างรวดเร็ว. สร้างคลิปทดสอบสั้น ๆ ก่อน; สร้างเวอร์ชันเต็มเมื่อพอใจแล้วเท่านั้น.

- **เลือกเครื่องมือให้เหมาะกับงาน. ** Seedance ให้ความสำคัญกับความสมจริงทางภาพและการควบคุมแบบหลายรูปแบบ; KeLing โดดเด่นในการสร้างวิดีโอแบบยาวและความคุ้มค่า; Runway มุ่งเน้นการตัดต่อที่แม่นยำ; Pika เน้นความเรียบง่ายและใช้งานง่าย

- เลือกเครื่องมือที่เหมาะกับความต้องการของคุณ หากคุณอยู่ในจีนแผ่นดินใหญ่ สามารถใช้ Seedance และ KeLing ได้โดยตรงโดยไม่ต้องมีข้อจำกัดด้านเครือข่ายหรือการชำระเงินเพิ่มเติม

ช่องว่างระหว่างแบรนด์และครีเอเตอร์ที่ใช้ Tusheng Video AI กับผู้ที่ยังคงพึ่งพาภาพนิ่งยังคงกว้างขึ้นทุกเดือน ทุกภาพถ่ายในคลังสินค้าของคุณมีศักยภาพที่จะเป็นโฆษณาวิดีโอ ทุกภาพบุคคลสามารถกลายเป็นอวตารที่มีชีวิตชีวา ทุกฉากทิวทัศน์สามารถเป็นฟุตเทจ B-roll ที่เหมือนภาพยนตร์ได้

สร้างวิดีโอจากภาพแรกของคุณฟรี --> — อัปโหลดภาพใดก็ได้และดูมันมีชีวิตขึ้นมาภายในสองนาที ไม่ต้องใช้บัตรเครดิต เข้าถึงได้โดยตรงในจีนแผ่นดินใหญ่

อยากสำรวจฟีเจอร์วิดีโอ AI เพิ่มเติมหรือไม่? สัมผัสประสบการณ์ Seedance ได้ทุกแพลตฟอร์ม --> — สร้างวิดีโอจากข้อความ, แปลงวิดีโอเป็นวิดีโอ, การสร้างแบบหลายรูปแบบ: ทุกอย่างจัดการในที่เดียว

อ่านเพิ่มเติม: คู่มือผู้ใช้ Seedance Complete | คู่มือคำสั่ง Seedance พร้อมตัวอย่าง 50+ | กรณีศึกษาการใช้งานสร้างสรรค์วิดีโอด้วย AI | การจัดอันดับเครื่องมือสร้างวิดีโอ AI ที่ดีที่สุดสำหรับปี 2026 | คู่มือการตลาดวิดีโอ AI และโซเชียลมีเดีย | AI สร้างวิดีโอจากข้อความ: คู่มือฉบับสมบูรณ์*