Em resumo

A maneira mais eficaz de criar vídeos com IA não é simplesmente inserir uma descrição em ferramentas de conversão de texto em vídeo. Em vez disso, comece com uma imagem cuidadosamente preparada.

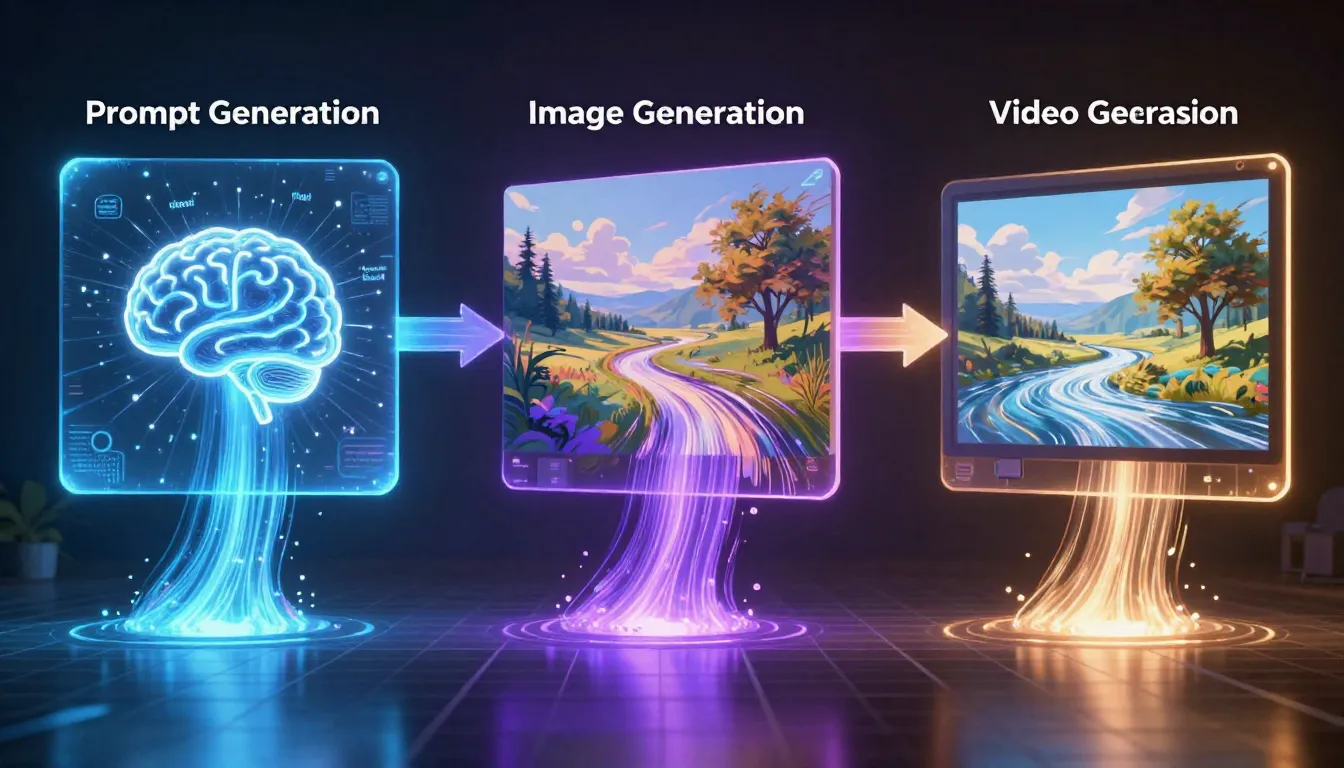

O pipeline de três etapas — prompt → imagem → vídeo — produz resultados que superam em muito a geração de texto para vídeo por si só. Primeiro, crie um prompt de nível profissional. Use esse prompt para gerar uma imagem com composição precisa. Em seguida, insira essa imagem como o primeiro quadro num gerador de vídeo. O resultado: você ganha controlo preciso sobre o conteúdo visual, a atmosfera de iluminação, os detalhes de composição e o ponto de partida do movimento.

O Seedance é a única ferramenta que integra todas as três etapas numa única plataforma: o Image Prompt Generator ajuda a criar prompts profissionais, o Text-to-Image gera imagens de referência de alta qualidade e o Image-to-Video transforma imagens em videoclipes cinematográficos. Não é necessário alternar entre ferramentas, nem fazer downloads e reenvios – da inspiração à peça finalizada, tudo é feito num fluxo contínuo.

Passo 1: Gerar prompt → | Passo 2: Gerar imagem → | Passo 3: Gerar vídeo →

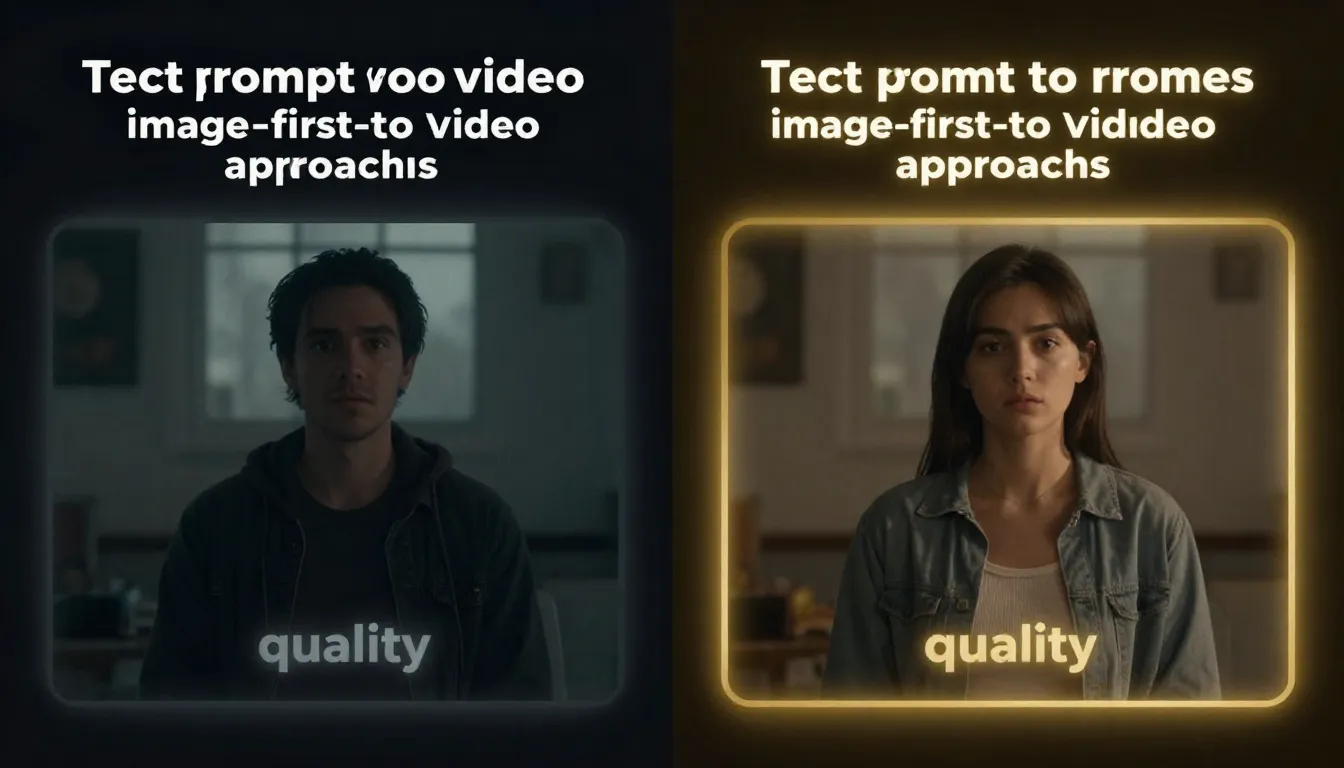

Esquerda: Geração pura de texto para vídeo — composição aleatória, visuais incontroláveis. Direita: Pipeline com prioridade para imagens — refinar primeiro os visuais e, em seguida, adicionar movimento; composição precisa, qualidade consistente.

Por que "primeiro a imagem, depois o vídeo" supera em muito a conversão de texto em vídeo

Quem já usou o Wensheng Video conhece a experiência: escreve uma descrição detalhada — cobrindo o tema, a iluminação, o ângulo da câmara e a composição —, mas as imagens geradas pela IA não têm nenhuma semelhança com a sua visão. As personagens estão viradas para o lado errado, a iluminação é plana, as composições parecem geradas aleatoriamente e os papéis não correspondem à descrição.

Isso não é uma falha de nenhuma ferramenta em particular, mas sim uma limitação estrutural inerente à abordagem de conversão de texto em vídeo.

As limitações inerentes à criação de conteúdo baseado em vídeo

O Wensheng Video exige que a IA realize duas tarefas excepcionalmente desafiadoras simultaneamente: gerar imagens e gerar movimento. O modelo deve interpretar o seu texto, determinar a aparência de cada pixel, compor a cena, definir a iluminação e as sombras, estabelecer a posição da câmara e, em seguida, gerar um movimento coerente com base em tudo isso — tudo a partir de um único texto.

O resultado é que todas as dimensões estão fora de controlo:

- Composição aleatória. Escreve «uma mulher parada no meio da rua», mas ela acaba no terço esquerdo, com metade do enquadramento dominado por edifícios desnecessários.

- **Personagens inconsistentes. ** A estrutura facial, as roupas, o penteado e as proporções corporais variam a cada geração. A IA oferece «interpretações criativas», não as suas especificações.

- **Iluminação descontrolada. ** Mesmo especificando «hora dourada, iluminação lateral quente da esquerda», os resultados são extremamente inconsistentes. A interpretação da IA das descrições de iluminação permanece fundamentalmente vaga.

- Enquadramento pouco fiável. Close-ups, planos médios, planos gerais — as ferramentas de texto para vídeo interpretam estes termos com extrema instabilidade. Peça um close-up extremo e ela entrega um plano de corpo inteiro.

Para experiências criativas exploratórias, essa incerteza pode ser parte da diversão. Mas se você precisa de resultados profissionais controlados e confiáveis, ela se torna uma falha fatal.

A principal vantagem da prioridade de imagem

O TuSheng Video inverteu completamente essa equação. Já não é necessário que a IA gere imagens e movimento simultaneamente; em vez disso, separa-se as duas tarefas:

- Comece com a imagem. Assunto, composição, iluminação, cor, enquadramento — você tem controle total, repetindo até atingir a perfeição.

- Em seguida, adicione movimento. A única tarefa da IA é animar o seu enquadramento perfeito. Ela não precisa decifrar descrições vagas ou tomar decisões de composição; em vez disso, gera movimento a partir das suas âncoras visuais concretas.

Essa separação de foco produz resultados superiores em todas as dimensões:

- Composição fixa. O objeto permanece exatamente onde foi colocado.

- Consistência dos personagens. As características faciais, vestuário e proporções permanecem idênticos à imagem original.

- **Iluminação e sombras preservadas. ** A direção da luz, a textura e a temperatura da cor são totalmente herdadas da imagem.

- Enquadramento fixo. A posição da câmara e o ponto de vista permanecem consistentes com a configuração original da imagem.

Para ilustrar: texto para vídeo é semelhante a descrever uma cena de filme ao telefone e instruir alguém a filmá-la. Imagem para vídeo, no entanto, é como mostrar uma fotografia a alguém e dizer: «Dê vida a esta imagem». A última abordagem produz resultados mais controláveis e de maior qualidade, pois a IA recebe referências visuais concretas em vez de descrições textuais abstratas.

O efeito multiplicador da qualidade

Os benefícios são cumulativos. Um quadro inicial cuidadosamente elaborado melhora todos os aspetos do vídeo:

- Maior consistência temporal — O modelo possui âncoras visuais de alta qualidade para manter a coerência ao longo da sequência.

- Melhor qualidade de movimento — O modelo extrai com precisão informações de profundidade, iluminação e espaço a partir de imagens de origem nítidas.

- Consistência estilística aprimorada — Sistemas de cores, climas e estética são incorporados diretamente nas imagens, não deixando margem para interpretação textual.

- Taxa de imperfeição reduzida — O modelo começa com dados visuais limpos e de alta resolução, em vez de sintetizar tudo a partir de ruído.

Os vídeos de alta qualidade gerados a partir do primeiro fotograma demonstram uma superioridade significativa em relação aos vídeos gerados exclusivamente a partir de texto com prompts idênticos em termos de qualidade visual, continuidade temporal e apelo estético. Esta não é uma distinção subtil — representa o fosso entre «demonstrações de IA divertidas» e «conteúdo profissionalmente utilizável».

Para uma análise aprofundada sobre como criar imagens especificamente para a geração de vídeos, consulte o Guia de Design do Primeiro e Último Quadro.

Pipeline criativo de IA em três etapas

O fluxo de trabalho completo é dividido em três etapas, cada uma baseada na anterior. Qualquer etapa tratada de forma descuidada acabará por comprometer o resultado final. Compreender a contribuição de cada etapa — e onde investir tempo — é fundamental para produzir consistentemente vídeos de IA de alta qualidade.

Fase Um: Geração de prompts

Tudo começa com o prompt. Prompts medíocres → imagens medíocres → vídeos medíocres. Prompts excelentes → imagens impressionantes → vídeos impressionantes. A qualidade do prompt é a maior variável na qualidade do resultado final e também é a etapa em que menos se investe na maioria dos fluxos de trabalho.

O problema de escrever prompts manualmente. A maioria das pessoas aborda a escrita de prompts como se fosse a criação de palavras-chave de pesquisa: breve, vaga e focada exclusivamente no assunto. «Um relógio de luxo, fundo escuro.» Isso diz à IA o que desenhar, mas não instrui como desenhar. O modelo preenche as lacunas com valores padrão — iluminação plana, composição centralizada, sem detalhes atmosféricos, sem direção estilística.

Solução: geração de prompts assistida por IA. O gerador de prompts expande as suas ideias gerais em prompts profissionais que abrangem o tema, ambiente, iluminação, cor, composição, estilo e melhorias na qualidade da imagem. A diferença na qualidade do resultado entre um prompt manual de 10 palavras e um prompt gerado de 100 palavras representa um salto qualitativo.

O Image Prompt Generator da Seedance faz exatamente isso. Insira uma breve descrição, como «comercial de relógios de luxo, dramático e sombrio», selecione um estilo (fotorrealista, cinematográfico, ilustrativo, etc.) e a IA gera instantaneamente um prompt profissional completo. Todo o processo leva apenas alguns segundos e custa 2 créditos por prompt. Para obter um guia completo sobre a geração de prompts, consulte o Guia do gerador de prompts de imagens de IA.

Por que este passo é tão crucial. O prompt é o ADN de todo o seu pipeline. Ele dita o estilo, o clima, a composição e o limite de qualidade para tudo o que se segue. Dedicar cinco minutos a refinar o seu prompt antes de gerar imagens pode poupar trinta minutos de ajustes iterativos em resultados medíocres mais tarde.

Fase dois: Geração de imagens

Após receber a sugestão profissional, o próximo passo é gerar a imagem que servirá como quadro inicial do vídeo. Aqui, você faz a transição do texto para o visual, marcando a etapa em que deve investir a maior parte do tempo de iteração.

Da solicitação à imagem. Cole a solicitação gerada na ferramenta de conversão de texto em imagem e clique em gerar. Avalie o resultado: a composição é adequada para vídeo? A iluminação tem camadas suficientes? O objeto parece correto? A cena transmite uma sensação de profundidade?

Se já tem uma imagem de referência ou deseja ajustar os resultados de geração existentes, a ferramenta image-to-image é a ideal para si. Carregue a sua imagem existente e descreva as modificações desejadas — isso é particularmente útil para iterações de composição: ajuste a iluminação, adicione efeitos atmosféricos ou altere o conteúdo da cena sem começar do zero. Para obter um guia completo sobre o fluxo de trabalho do Image-to-Image, consulte o Guia de IA do Image-to-Image.

Crie imagens para uso em vídeo. Nem todas as imagens visualmente atraentes são adequadas para o quadro inicial de um vídeo. Ao criar imagens para uso em pipeline, tenha em mente os seguintes princípios de composição:

- Deixe espaço negativo na direção do movimento. Se uma personagem estiver a mover-se da esquerda para a direita, posicione-a ligeiramente à direita do quadro.

- Inclua níveis de profundidade. Imagens com elementos distintos em primeiro plano, plano médio e fundo criam melhores efeitos de paralaxe e movimentos de câmara mais naturais no vídeo.

- **Considere a direção do movimento da câmara. ** Se pretender utilizar o movimento «push», certifique-se de que a composição fica bem tanto no recorte atual como num recorte mais apertado centrado no objeto.

- Evite grandes blocos de texto ou padrões simétricos. Esses elementos são difíceis de animar naturalmente e podem facilmente produzir artefactos.

- **Utilize iluminação direcional. ** Uma iluminação direcional forte com sombras visíveis produz um efeito de vídeo mais cinematográfico do que uma iluminação plana.

Princípio fundamental: invista tempo para obter as imagens certas. Cada minuto gasto a aperfeiçoar os seus recursos visuais economiza várias vezes esse tempo na fase de geração do vídeo. Um primeiro fotograma impecável significa que o seu vídeo está pronto a ser utilizado logo na primeira tentativa. Um primeiro fotograma imperfeito pode exigir várias regenerações (cada uma consumindo créditos e tempo) sem garantir um resultado satisfatório.

Antes de iniciar a geração do vídeo, repita as imagens 3 a 5 vezes. Isso não é perfeccionismo, é eficiência.

Para obter um guia completo sobre a geração de texto para imagem (incluindo técnicas de prompt e comparações de ferramentas), consulte O Guia Completo para IA de Texto para Imagem. Para obter uma visão geral das melhores ferramentas de geração de imagens, consulte Os Melhores Geradores de Imagens com IA para 2026.

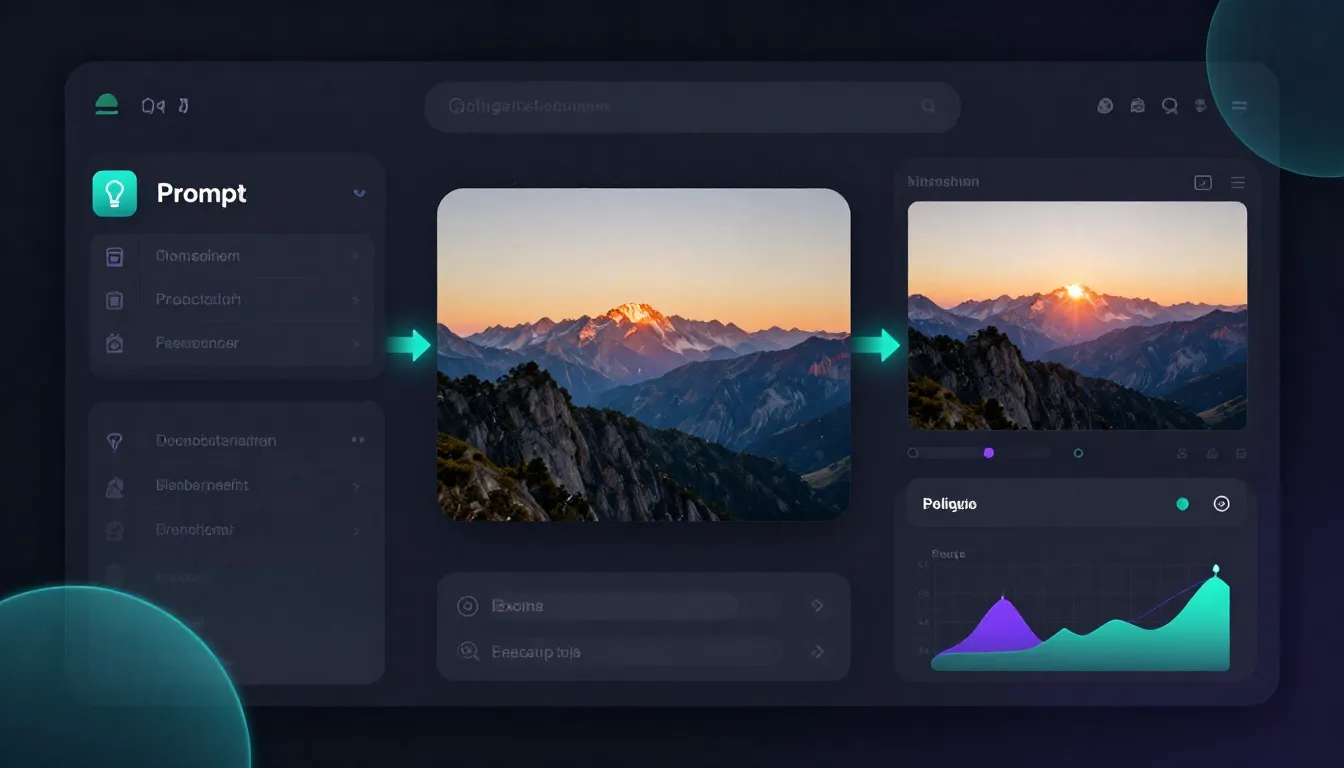

Gerar a sua imagem → | Ajustar imagem para imagem →

Fase três: Produção do vídeo

Esta é a fase em que colhe os frutos. As imagens aperfeiçoadas que refinou constituem o ponto de partida para os seus videoclipes animados.

Carregue uma imagem como o primeiro fotograma. Carregue a sua imagem gerada na ferramenta [Image-to-Video] do Seedance. A ferramenta recupera imagens diretamente do seu histórico de geração — sem necessidade de descarregar e voltar a carregar.

Guie o movimento com palavras. Escreva uma instrução descrevendo o movimento que deseja — não descreva os elementos visuais (a imagem já foi processada). Concentre-se em:

- Movimento da câmara: «dolly lento para dentro» 、panorâmica suave para a esquerda、orbitação suave em torno do objeto

- Ação do objeto: "a mulher vira a cabeça lentamente"、pétalas caem、vapor sobe da chávena

- Movimento ambiental: «nuvens movem-se lentamente», «água ondula para fora», «folhas balançam suavemente com a brisa»

- ** Atmosfera**: «atmosfera dramática», «qualidade onírica e etérea», «ritmo cinematográfico»

Gere e reveja. A IA recebe as suas instruções de imagem e movimento, produzindo segmentos de vídeo que começam precisamente a partir do seu primeiro fotograma e se desenrolam de acordo com as suas instruções de movimento. Como controla o ponto de partida visual, o resultado é previsível e consistente. A qualidade do vídeo herda a qualidade da imagem — um primeiro fotograma nítido, bem iluminado e composto com precisão traduz-se diretamente num vídeo nítido, bem iluminado e composto com precisão.

Para técnicas avançadas de controlo de movimento e emparelhamento do primeiro/último fotograma, consulte o Guia de Design do Primeiro e Último Fotograma. Para uma introdução abrangente à IA de imagem para vídeo, consulte o Guia de IA de Imagem para Vídeo.

Pipeline de três etapas em ação: Transforme descrições breves em prompts profissionais, transforme prompts em imagens de alta qualidade e converta imagens em vídeos dinâmicos. Cada etapa amplifica a qualidade da anterior.

Vantagem da Seedance: Conclusão em três etapas, num único local

Hoje, a maioria dos criadores que montam esse pipeline estão a juntar três ou quatro ferramentas. Eles usam o ChatGPT ou o Claude para escrever prompts de imagem, mudam para o Midjourney ou o Tongyi Wansheng para a geração de imagens, descarregam a imagem, abrem o Ke Ling ou o Runway e, em seguida, carregam-na para gerar vídeo. Cada mudança significa uma interface diferente, contas diferentes, sistemas de faturação diferentes e restrições diferentes.

Este fluxo de trabalho fragmentado não é apenas incómodo; compromete ativamente a qualidade.

Como a troca de ferramentas compromete a qualidade

Cada vez que uma imagem é transferida entre ferramentas, ocorre uma degradação. O ciclo de download-upload introduz artefactos de compressão. As conversões de formato (PNG para JPG, WebP para PNG) alteram os valores das cores. A resolução pode ser reamostrada. Os metadados relativos à forma como a imagem foi gerada — informações que poderiam ter ajudado o modelo de vídeo a produzir resultados superiores — são totalmente eliminados.

Além da qualidade dos dados, há também a sobrecarga cognitiva. Cada ferramenta tem a sua própria sintaxe de prompt, configurações de saída distintas e opções variadas de proporção de imagem. Você está a perder tempo a se familiarizar novamente com as interfaces, em vez de dedicá-lo a iterações criativas.

Tubagem integrada

A Seedance elimina todo esse atrito, oferecendo as três etapas em uma única plataforma:

1. Gerador de prompts de imagem (/image-prompt-generator). Introduza o seu conceito criativo, selecione entre 12 estilos e receba um prompt profissional completo. Os prompts gerados são otimizados para o modelo de geração de imagens Seedance, mas são igualmente adequados para qualquer ferramenta de pintura de IA.

2. Texto para imagem e imagem para imagem (/text-to-image | /image-to-image). Gere imagens a partir de prompts ou faça modificações específicas em imagens existentes. Produza rapidamente várias variantes. Depois de encontrar a composição certa, está tudo pronto para passar diretamente para a próxima etapa.

- Imagem para vídeo Selecione qualquer imagem pré-gerada da sua biblioteca e envie-a diretamente para o gerador de vídeo. Sem downloads, sem uploads, sem conversões de formato necessárias. As imagens em resolução total são transferidas sem perdas.

Por que a integração produz resultados superiores?

Esta não é apenas uma funcionalidade conveniente; a integração produz resultados genuinamente superiores:

- Zero perda de transmissão. As imagens são transferidas em resolução total entre as etapas, sem compressão ou reamostragem.

- Ecossistema de modelos consistente. Os modelos de geração de imagens e vídeos são calibrados para compatibilidade inerente. As imagens produzidas pelo modelo de texto para imagem da Seedance são inerentemente adequadas ao modelo de vídeo da Seedance.

- **Sistema de créditos unificado. ** Não é necessário manter três assinaturas separadas. Os seus créditos são universais nas três ferramentas, tornando a alocação do orçamento simples e transparente.

- Ciclos de iteração mais rápidos. O tempo entre «Quero editar esta imagem» e «Estou a ver o novo vídeo» diminui de minutos gastos a mudar de ferramenta para meros segundos de integração perfeita.

- **Mantenha o fluxo criativo. ** Permaneça numa única interface para preservar o contexto do seu pensamento. Concentre-se no conceito criativo em si, não na gestão de ficheiros ou na navegação pela ferramenta.

Falando francamente: pode muito bem usar o ChatGPT para escrever prompts, o Midjourney ou o Tongyi Wansheng para geração de imagens e o Keling ou o Runway para criação de vídeos para construir um pipeline de alta qualidade. Muitos profissionais fazem exatamente isso. A vantagem do Seedance não está em nenhuma etapa específica que supere amplamente os concorrentes, mas sim na sua integração, que elimina o atrito que leva a maioria dos criadores a abandonar o processo no meio do caminho. O melhor fluxo de trabalho é aquele que realmente consegue levar do início ao fim.

O Seedance integra a geração de prompts, imagens e vídeos numa única plataforma. Do conceito ao vídeo final, não há necessidade de alternar entre ferramentas, descarregar ficheiros ou gerir várias contas.

Guia prático completo: 3 estudos de caso reais

A teoria é útil, mas a prática produz resultados. Abaixo estão três exercícios completos de pipeline — cada um correspondendo a diferentes objetivos criativos, estilos distintos e proporções variadas. Siga as instruções para construir o seu primeiro pipeline completo.

Caso 1: Publicidade cinematográfica de produto

Objetivo: Produzir um anúncio de cinco segundos para um relógio de luxo para a página de apresentação do produto.

Fase Um — Geração de prompts

Abra o Gerador de sugestões de imagens e insira o seu conceito.

Entrada: «comercial de relógios de luxo, dramático e sombrio»

Selecione o estilo: Fotorrealista

Sugestão gerada:

A luxury men's wristwatch resting on a slab of dark emperador marble,

shot from a low three-quarter angle. Dramatic studio lighting: a single

hard key light from the upper left creates sharp reflections on the

polished steel case and sapphire crystal. The watch face shows 10:10

with luminous indices glowing faintly. Deep shadows pool around the

base, enhancing the sense of weight and prestige. Background is pure

black, fading to subtle charcoal gradient. Microscopic dust particles

float in the key light beam. Color palette: silver, deep charcoal,

amber highlights from the lume. Photorealistic product photography,

8K resolution, razor-sharp detail on every dial marking and link.Criar este prompt manualmente levaria pelo menos 10 a 15 minutos. Um gerador de prompts faz isso em segundos, cobrindo todas as sete dimensões dos prompts profissionais: assunto, ambiente, iluminação, cor, composição, estilo e qualidade da imagem.

Fase Dois — Geração de Imagens

Cole o prompt gerado em texto para imagem. Gere com uma proporção de 16:9 para se adequar a quadros de vídeo paisagem.

Primeira renderização: A composição geral é boa, embora a superfície de mármore reflita um pouco demais, desviando a atenção do relógio.

Iteração: Faça ajustes finos usando Image-to-Image. Carregue a imagem inicial gerada com o prompt: «Reduza a intensidade do reflexo da superfície do mármore. Aumente a nitidez dos detalhes do mostrador do relógio. Torne o gradiente do fundo ligeiramente mais profundo.»

Segunda tomada: O relógio ocupa o centro do palco, banhado por luzes e sombras dramáticas, com uma composição em camadas. Pronto para passar para a fase de vídeo.

Fase Três — Geração de Vídeo

Envie as imagens editadas para Image-to-Video.

Sugestões de exercícios:

The camera executes a slow, smooth orbiting movement around the watch,

revealing different angles of the case and bracelet. The key light

shifts subtly as the camera moves, creating dynamic reflections across

the polished surfaces. Dust particles drift slowly through the light

beam. Cinematic, premium commercial pacing. Steady, professional

camera movement.(A câmara faz uma panorâmica lenta e constante ao redor do relógio, revelando diferentes ângulos da caixa e da bracelete. À medida que a imagem se move, a fonte de luz principal muda sutilmente, criando reflexos dinâmicos nas superfícies polidas. Partículas de poeira flutuam suavemente dentro do feixe de luz. Ritmo cinematográfico e publicitário sofisticado. Movimento de câmara estável e profissional.)

Resultados esperados: Uma apresentação refinada do produto com duração de 5 segundos — começando com o seu quadro meticulosamente composto, circulando suavemente o relógio. Iluminação dramática, detalhes nítidos e texturas premium transmitem-se perfeitamente desde a imagem original até cada quadro do vídeo.

Caso 1: Publicidade de relógios de luxo. De um briefing conceitual de cinco palavras a um vídeo de produto refinado de cinco segundos — um pipeline de três etapas que entrega resultados com qualidade comercial.

Caso 2: Conteúdo de viagens nas redes sociais

Objetivo: Produzir um vídeo vertical capturando o nascer do sol num santuário japonês para o TikTok/Instagram Reels.

Fase Um — Geração de prompts

Abra o Gerador de sugestões de imagens.

Entrada: «Nascer do sol num templo japonês, manhã tranquila»

Selecione o estilo: Fotorrealista

Sugestão gerada:

A traditional Japanese wooden temple (Kiyomizu-dera style) nestled

among ancient cedar trees, photographed at dawn. Golden sunrise light

filters through morning mist, casting long warm shadows across the

temple's wooden veranda. Cherry blossom branches frame the upper

portion of the composition, with delicate pink petals catching the

first light. A stone lantern stands in the foreground left, moss-

covered and weathered. The temple roof's curved eaves are silhouetted

against a sky transitioning from deep indigo to warm peach and gold.

Subtle mist hovers at ground level among the trees. Photorealistic

landscape photography, golden hour lighting, serene and contemplative

atmosphere, high dynamic range, rich natural color palette.Fase Dois — Geração de Imagens

Cole em Texto para imagem. Configurações principais: Gerar na proporção retrato 9:16, adequada para TikTok e Instagram Reels.

Primeiro rascunho: A atmosfera é deslumbrante, mas os ramos de cerejeira em flor estão posicionados muito alto no enquadramento, deixando um espaço vazio excessivo no terço inferior.

Iteração: Após modificar ligeiramente o prompt e adicionar a descrição «ramos de cerejeira em flor estendendo-se dos cantos superior direito e esquerdo, preenchendo o terço superior do quadro vertical», a segunda geração posicionou perfeitamente as flores de cerejeira como uma moldura natural para a composição.

A composição adapta-se perfeitamente ao vídeo vertical: o santuário atrai o olhar para o centro do enquadramento, enquanto as flores de cerejeira na parte superior criam interesse visual. As lanternas de pedra e a névoa em primeiro plano conferem profundidade. Esta imagem oferece potencial para movimento em várias camadas.

Fase Três — Geração de Vídeo

Enviar para Imagem para Vídeo.

Sugestões de exercícios:

Gentle cherry blossom petals drift slowly downward through the frame.

Morning mist shifts and swirls at ground level among the trees. Two

birds fly across the sky in the background. The sunrise light gradually

intensifies, warming the scene. A subtle breeze moves the cherry

blossom branches slightly. Peaceful, meditative atmosphere. Slow,

contemplative pacing.Pétalas de cerejeira flutuam suavemente pelo enquadramento. A névoa matinal flui suavemente pelo chão entre as árvores. Dois pássaros planam pelo céu ao fundo. A luz do nascer do sol intensifica-se gradualmente, aquecendo toda a cena. Uma brisa suave agita os ramos das cerejeiras. Uma atmosfera tranquila e meditativa. Um ritmo lento e contemplativo.

Resultados: Um vídeo vertical atmosférico de 4 segundos, perfeitamente adequado para o TikTok e o Instagram Reels. As flores de cerejeira flutuam naturalmente, enquanto a névoa matinal adiciona profundidade e movimento. Os pássaros ao fundo criam pontos focais subtis. Os tons dourados e quentes da imagem original permeiam cada fotograma do vídeo.

Estudo de caso 3: Narrativa da marca – Combinando o primeiro e o último quadros

Objetivo: Produzir uma narrativa de seis segundos sobre a marca, retratando a transformação do café, desde o silêncio do início da manhã até ao seu estado movimentado e lotado.

Este caso utiliza o pipeline duas vezes, gerando um par de imagens que compreende o primeiro e o último fotogramas para fornecer ao modelo de vídeo duas âncoras visuais para definir o arco narrativo. Para uma análise aprofundada desta técnica, consulte o Guia de Design do Primeiro e Último Fotograma.

Fase Um — Duas Sugestões

Gere dois conjuntos de prompts a partir do gerador de prompts de imagem.

Primeira imagem: «Um café vazio, banhado pela luz do início da manhã, com tons âmbar quentes.»

Prompt gerado para o primeiro quadro:

Interior of an artisanal coffee shop in the early morning, before

opening. Warm amber sunlight streams through large front windows,

casting long golden rectangles across worn hardwood floors. Exposed

brick walls, a polished wooden counter with a brass espresso machine,

and empty mismatched chairs around small tables. A chalkboard menu

hangs behind the counter. Dust motes float in the sunbeams. The space

feels warm, inviting, and full of potential. Shot at eye level from

just inside the entrance. Photorealistic interior photography, warm

color palette, golden hour tones, cozy atmosphere.Entrada do quadro final: «Um café movimentado numa manhã quente, com clientes a saborear o seu café.»

Prompt do quadro final gerado:

The same artisanal coffee shop, now alive with morning activity.

Diverse customers sit at tables -- some reading, some talking, some

working on laptops. A barista behind the counter steams milk, creating

a plume of white steam. Coffee cups and pastries fill the tables. Warm

morning light still streams through the windows but is supplemented by

the warm glow of pendant lights. The atmosphere is bustling but cozy,

full of quiet energy and the warmth of community. Shot from the same

eye-level position just inside the entrance. Photorealistic interior

photography, warm tones, lively atmosphere.Fase Dois — Duas Imagens

Gere o primeiro quadro em texto para imagem com uma proporção de 16:9. Repita até que o café vazio pareça acolhedor e convidativo, banhado por uma ampla luz dourada da manhã.

O quadro final utiliza a geração [imagem para imagem]. Carregue o quadro inicial como imagem de referência e utilize o prompt do quadro final. Esta etapa é crucial — usar o quadro inicial como referência garante a consistência visual. A arquitetura, o mobiliário, a direção da iluminação e os esquemas de cores permanecem consistentes entre os quadros, com a única adição sendo a inclusão de figuras e atividades.

Repita o quadro final para garantir que o cliente pareça natural e que o barista esteja posicionado atrás do balcão. É fundamental que ambas as imagens pareçam ter sido captadas no mesmo local em momentos diferentes, e não em dois locais distintos.

Fase Três — Geração de Vídeo

Carregue o primeiro fotograma para Image-to-Video. Em plataformas que suportam referência de fotograma final, carregue o fotograma final simultaneamente.

Sugestões de exercícios:

Time-lapse style transition. The empty coffee shop gradually fills

with people arriving -- customers entering, sitting down, a barista

beginning to work. Morning light shifts slowly. The scene transitions

from quiet solitude to warm, bustling community. Smooth, cinematic

pacing. The camera position remains fixed.(Transição em estilo time-lapse. Um café vazio vai-se enchendo gradualmente com a chegada dos clientes — os clientes entram, sentam-se e o barista começa a trabalhar. A luz da manhã muda subtilmente. A cena evolui de uma solidão tranquila para uma atmosfera calorosa e animada de comunidade. Ritmo suave e cinematográfico. A câmara permanece fixa.)

Resultado: Uma história de marca de seis segundos revela um arco narrativo completo — o despertar de um café. O quadro inicial estabelece um espaço tranquilo e acolhedor. O quadro final apresenta o estado desejado. Transições geradas por IA ligam os dois: as portas se abrem, os clientes sentam-se, os baristas ativam as máquinas de café expresso e as chávenas de café aparecem nas mesas. A mensagem da marca é discreta, mas potente — este é um lugar onde nos sentimos em casa.

Caso 3: Narrativa da marca combinando os quadros de abertura e encerramento. A IA gera uma transição em lapso temporal entre dois pontos de referência visuais — do silêncio do amanhecer ao calor da comunidade.

Técnicas de otimização de pipeline

Depois de produzir centenas de vídeos através deste processo, os cinco princípios a seguir tiveram o maior impacto na qualidade do resultado final.

Dica 1: Dedique 80% do seu tempo às imagens

Esta é a otimização mais crucial. A qualidade da imagem é o gargalo em todo o pipeline. Uma imagem perfeita produzirá um vídeo utilizável na sua primeira geração. Uma imagem medíocre, por mais bem elaboradas que sejam as instruções de movimento, produzirá apenas um vídeo medíocre.

A distribuição do tempo deve ser aproximadamente a seguinte:

- Geração de prompts: 5% (o gerador leva segundos, a escrita à mão leva minutos)

- Geração e iteração de imagens: 80% (gerar, avaliar, ajustar, regenerar até que a cena fique perfeita)

- Geração de vídeo: 15% (carregar, escrever prompts de movimento, gerar)

A maioria dos novatos faz a sequência ao contrário: passa dez segundos numa imagem e, em seguida, gera vídeos um após o outro, na esperança de encontrar um bom. Os utilizadores experientes passam dez minutos numa imagem e obtêm um bom vídeo nas primeiras tentativas. A última abordagem produz resultados superiores com menos créditos e menos tempo.

Antes de iniciar a geração do vídeo, repita as imagens três a cinco vezes. Isso não é perfeccionismo, é eficiência.

Dica 2: Concebido para o movimento

Uma fotografia agradável e um bom fotograma de vídeo não são a mesma coisa. Ao gerar imagens para pipelines, imagine como a cena aparecerá quando ganhar vida.

Deixe espaço negativo na direção do movimento principal. Se uma figura estiver a mover-se da esquerda para a direita, evite centrá-la — posicione-a ligeiramente à direita para deixar espaço para o movimento. Se a câmara estiver a seguir para a esquerda, certifique-se de que o lado esquerdo do enquadramento contenha conteúdo visualmente atraente.

Componha as imagens de acordo com a direção da câmara. As imagens em movimento são mais eficazes quando o detalhe mais atraente ocupa o centro do enquadramento. As imagens panorâmicas exigem interesse visual em toda a largura do enquadramento. As imagens circulares em movimento exigem objetos tridimensionais com profundidade, em vez de objetos planos.

Evite composições simétricas complexas. Embora a simetria perfeita possa ser impressionante em fotografias, ela apresenta dificuldades para a geração de vídeos. A IA tem dificuldade em manter uma simetria precisa entre os fotogramas, resultando em tremulação que distrai. Composições assimétricas com fluxo visual natural produzem vídeos mais suaves.

Incorpore pistas de profundidade. Imagens com elementos sobrepostos em distâncias variadas — objetos em primeiro plano, temas em segundo plano e ambientes em terceiro plano — fornecem à IA informações de profundidade, resultando em efeitos de paralaxe aprimorados e movimentos de câmara mais naturais.

Para obter um guia completo sobre como criar imagens específicas para vídeo, consulte o Guia de Design do Primeiro e Último Quadro.

Técnica 3: Mantenha proporções consistentes ao longo de todo o processo

As proporções incompatíveis entre imagens e fotogramas de vídeo constituem um dos erros mais comuns no pipeline, diminuindo inevitavelmente a qualidade do resultado final.

- 16:9 para vídeos em formato paisagem (YouTube, apresentações, páginas iniciais de sites)

- 9:16 para vídeos em formato retrato (TikTok, Instagram Reels, YouTube Shorts)

- 1:1 para vídeos quadrados (Instagram Stories, determinados anúncios em redes sociais)

Defina a proporção da imagem durante a geração da imagem, em vez de deixar isso para a fase do vídeo. Se gerar uma imagem quadrada 1:1 e depois tentar criar um vídeo 16:9, o modelo de vídeo precisará preencher as laterais do zero – e a qualidade desse conteúdo gerado será inferior ao resto do quadro. Gere imagens com a proporção do vídeo final desde o início.

Dica 4: Mantenha um estilo consistente de prompts em todas as etapas

As palavras-chave estilísticas nas instruções de imagem e as pistas de movimento nas instruções de vídeo devem falar a mesma linguagem visual. Qualquer inconsistência entre as duas resultará em problemas sutis de qualidade no resultado final.

Se a sua sugestão de imagem incluir «cinematográfico, iluminação dramática, atmosfera sombria», a sugestão de movimento do vídeo deve usar linguagem compatível: «movimento de câmara cinematográfico, atmosfera dramática, ritmo sombrio». Evite combinar imagens dramáticas e cinematográficas com sugestões de movimento como «divertido, animado, enérgico» – os conflitos tonais confundirão o modelo e reduzirão a coerência.

Referência rápida — Tabela de correspondência de estilos:

| Estilo de imagem | Linguagem de movimento correspondente |

|---|---|

| Cinematográfico, dramático | «Movimento de câmara cinematográfico, ritmo dramático, lento e deliberado» |

| Brilhante, comercial, limpo | «Movimento suave e profissional, ritmo constante, transições limpas» |

| Sonhador, etéreo, suave | «Movimento suave e flutuante, atmosfera sonhadora, deriva lenta» |

| Alta energia, dinâmico | «Movimento dinâmico da câmara, ritmo enérgico, cortes rápidos» |

| Documentário, natural | «Sensação de câmara na mão, movimento natural, ritmo observacional» |

Dica 5: Guarde os seus melhores modelos de pipeline

Quando um pipeline prompt → imagem → vídeo produz resultados favoráveis, guarde o pipeline inteiro:

- Prompt de imagem (texto original)

- Definições de estilo selecionadas

- Definições de geração de imagem (proporção, modelo, número de semente, etc.)

- Prompt de movimento de vídeo

- Definições de geração de vídeo (duração, resolução)

Este pipeline serve como modelo. Precisa criar vídeos semelhantes para produtos diferentes? Substitua o assunto na imagem e gere novamente. Precisa de cenas diferentes dentro do mesmo estilo? Mantenha as palavras-chave do estilo e troque a descrição do assunto.

Com o tempo, irá construir uma biblioteca madura de pipelines adaptados a diferentes objetivos criativos: anúncios de produtos, conteúdo de redes sociais, narrativas de marca, filmagens B-roll, animação de personagens. Cada novo projeto começa a partir de uma base comprovada, em vez de partir do zero.

Comparação de ferramentas alternativas entre as etapas

O Seedance fornece um pipeline integrado, embora também seja possível construir este fluxo de trabalho utilizando ferramentas separadas. Abaixo está uma comparação sincera de cada etapa.

Fase Um: Geração de prompts

| Ferramenta | Mais adequada para | Descrição |

|---|---|---|

| Gerador de prompts de imagens Seedance | Pipeline integrado, 12 predefinições de estilo | 2 créditos por prompt. Saída direta para a ferramenta de imagens Seedance. |

| ChatGPT / GPT-4 | Engenharia de prompt personalizada | Requer copiar e colar manualmente. Sem predefinições de estilo. Mais flexível para instruções complexas. |

| Claude | Prompts refinados e detalhados | Excelente na execução de briefings criativos complexos. Sem integração com geração de imagens. |

| Tongyi Qianwen | Otimizado para contextos chineses | Compreensão mais natural de descrições em chinês. Adequado para utilizadores domésticos. Requer integração manual com ferramentas a jusante. |

Fase dois: Geração de imagens

| Ferramenta | Mais adequada para | Notas |

|---|---|---|

| Seedance Text-to-Image / Image-to-Image | Integração de pipeline, fluxo de trabalho com prioridade para vídeo | Imagens transferidas diretamente para a fase de vídeo sem perda de qualidade. |

| Midjourney | Qualidade artística, expressividade estética | Produz resultados excelentes. Requer operação via Discord ou interface web. Pode ser baixado manualmente dentro dos pipelines. |

| Tongyi Wanshang | Compatível com prompts em chinês, acesso doméstico estável | Desenvolvido pela Alibaba, excelente na compreensão de descrições em chinês. Adequado para usuários domésticos sem VPNs. |

| DALL-E 3 | Fidelidade ao prompt, renderização textual | Excelente na execução literal de prompts complexos. Controlo estilístico limitado. |

| Stable Diffusion | Controlo total, geração local | Flexibilidade máxima. Requer configuração do ambiente técnico. Adequado para trabalhos de grande volume. |

Fase três: Produção do vídeo

| Ferramenta | Mais adequada para | Descrição |

|---|---|---|

| Seedance Image-to-Video | Pipeline integrado, qualidade consistente | Transferência de imagens sem interrupções, suporte direto para entrada do primeiro fotograma. |

| Kling 3.0 | Longa duração, alta qualidade | Gera até 2 minutos por execução. Forte qualidade de movimento. Da Kuaishou, acessível na China. |

| Jimeng AI | Ecossistema chinês, fácil de usar | Da ByteDance, profundamente integrado ao ecossistema TikTok. Ideal para a criação de vídeos curtos. |

| Runway Gen-4 | Controlo de precisão, pincéis de movimento | O Modo Diretor suporta trajetórias de câmara personalizadas. Interface profissional. Preço mais elevado. |

| Pika 2.0 | Integração simples, experimentação rápida | Interface mais minimalista. Adequado para iniciantes. Controlo limitado dos detalhes do movimento. |

Falando francamente: É possível construir um pipeline de alta qualidade usando o ChatGPT para escrita rápida, o Midjourney para geração de imagens e o Keeling para produção de vídeo. Muitos profissionais fazem exatamente isso. A vantagem do Seedance não está em superar os concorrentes em qualquer etapa específica, mas sim em eliminar o atrito por meio da integração, manter a qualidade em todas as etapas e mesclar três fluxos de trabalho separados em um único. Para criadores que produzem vídeos de IA com frequência, o tempo economizado por permanecer em uma única plataforma soma várias horas por semana.

Para uma comparação detalhada das ferramentas de geração de vídeo, consulte Comparação dos melhores geradores de vídeo com IA de 2026.

Erros comuns no pipeline

Abaixo estão os cinco erros mais comuns encontrados ao configurar um pipeline prompt → imagem → vídeo. Cada um deles tem uma solução simples.

Erro 1: Ignorar completamente a etapa da imagem

Manifestação específica: Conversão direta de texto em vídeo, ignorando completamente a geração de imagens.

Por que isso é problemático: perde todo o controlo sobre a composição. O modelo de vídeo dita tudo: conteúdo visual, enquadramento da cena e pontos de partida da câmara. Os resultados são imprevisíveis, com poucas hipóteses de corresponder à sua intenção criativa na primeira tentativa.

Como resolver: Sempre gere uma imagem do primeiro quadro, mesmo que ache que o seu prompt de texto é suficientemente detalhado. Os 30 segundos gastos na geração de uma imagem podem poupar várias gerações de vídeo com falhas.

Erro 2: Utilizar imagens de arquivo sem avaliação

Manifestação específica: Transferir aleatoriamente uma imagem da Internet ou selecionar uma de uma biblioteca de imagens e, em seguida, inseri-la diretamente no processo de geração do vídeo sem avaliar a sua adequação como quadro inicial.

Por que é problemático: Muitas fotografias são concebidas para visualização estática, não em movimento. O recorte é muito apertado, não deixando espaço para o movimento da câmara. Os objetos estão centralizados, restringindo as opções de enquadramento. A iluminação é plana, resultando em efeitos de vídeo sem graça. JPEGs altamente comprimidos introduzem artefactos.

Como corrigir: Antes de usar qualquer imagem, avalie-a primeiro de acordo com o princípio de «concebido para movimento». Uma abordagem melhor é usar pipelines especificamente para gerar um fotograma-chave.

Erro 3: incompatibilidade da proporção da imagem

Manifestações específicas: Gerar imagens quadradas e, em seguida, criar vídeos 16:9, ou usar imagens panorâmicas para produzir vídeos retrato.

Por que causa danos significativos: os modelos de vídeo recortam as suas imagens (resultando na perda do seu conteúdo cuidadosamente projetado) ou preenchem a nova proporção com conteúdo gerado do zero (com as bordas adicionadas sendo de qualidade inferior).

Como corrigir: Determine a proporção final do vídeo antes de gerar as imagens. Gere as imagens de acordo com essa proporção.

Erro 4: Instruções de vídeo excessivamente descritivas

Manifestação específica: O vídeo descreve simultaneamente a cena e o seu movimento: «Um relógio de luxo sobre mármore escuro com iluminação dramática, a câmara orbita lentamente e reflexos de luz dançam pela superfície.»

Por que isso é problemático: A descrição visual pode entrar em conflito com o conteúdo da imagem. Se o relógio for representado em mármore branco, mas a instrução especificar mármore escuro, o modelo receberá sinais contraditórios. Na melhor das hipóteses, a descrição visual se torna redundante; na pior, faz com que o modelo tente modificar o seu primeiro quadro cuidadosamente projetado.

Como criar: As instruções em vídeo devem descrever apenas o movimento, os ângulos da câmara e a atmosfera. Os elementos visuais já foram renderizados como imagens. Lembre-se deste princípio: as imagens transmitem «o que é visto», enquanto as instruções em vídeo ditam «como se move».

Erro 5: Apressar-se a gerar vídeos sem iterar pelas imagens

Manifestação específica: Gerar uma imagem e inseri-la diretamente na geração de vídeo, mesmo quando ela apresenta falhas óbvias, como composição ligeiramente distorcida, pequenas imperfeições ou iluminação abaixo do ideal.

Por que o impacto é maior: O vídeo amplia todas as falhas da imagem original. Uma pequena imperfeição numa fotografia estática torna-se uma falha persistente e em movimento ao longo de 120 fotogramas. Uma composição ligeiramente descentrada torna-se visivelmente errada quando o movimento da câmara chama a atenção para o enquadramento. Todas as falhas numa fotografia tornam-se mais evidentes, e não menos, no vídeo.

Como corrigir: Trate a fase da imagem como um ponto de verificação de controlo de qualidade. Não avance para a fase do vídeo até que a imagem esteja realmente satisfatória. Repita 3 a 5 vezes. Use a geração de imagem para imagem para reparos específicos. A saída de vídeo não pode exceder a qualidade da imagem original.

Perguntas frequentes

Por que usar a intermediação de imagens em vez de converter diretamente o texto em vídeo?

A geração de texto para vídeo requer que a IA crie simultaneamente imagens e movimento a partir do texto, o que significa que você tem um controle mínimo sobre a composição, a aparência dos personagens, a iluminação e o enquadramento. A abordagem que prioriza a imagem separa essas duas tarefas: você refina os elementos visuais durante a fase de imagem e, em seguida, instrui a IA apenas a adicionar movimento. Isso produz resultados mais previsíveis e de maior qualidade, pois a IA recebe referências visuais concretas em vez de interpretar texto ambíguo. A diferença é particularmente pronunciada em cenários profissionais que exigem composições específicas, paletas de cores de marca ou design de personagens consistente.

Qual é o processo completo para criar vídeos de IA a partir do zero?

O processo completo compreende três etapas. Etapa um: Use um gerador de prompts de IA (como o Image Prompt Generator da Seedance) para expandir o seu conceito em um prompt de imagem detalhado. Etapa dois: Use esse prompt em uma ferramenta de texto para imagem (como o Text-to-Image da Seedance) para gerar imagens de referência de alta qualidade, repetindo até ficar satisfeito. Etapa três: Carregue a imagem num gerador de imagem para vídeo (como o image-to-video da Seedance), escreva um prompt descrevendo apenas o movimento (movimento da câmara e ações do objeto) e gere o vídeo. Todo o processo leva de 5 a 15 minutos, dependendo de quantas iterações são necessárias durante a fase de imagem.

Quantos créditos custa o pipeline completo no Seedance?

Os custos variam dependendo da configuração, mas um pipeline típico geralmente envolve: geração instantânea a 2 créditos, geração de imagem a 4–8 créditos por iteração (prevendo 3–5 iterações, o que equivale a 12–40 créditos) e geração de vídeo a 10–30 créditos (dependendo da duração e resolução). Do conceito ao vídeo finalizado, o custo total geralmente varia de 25 a 70 créditos. Isso representa uma economia significativa em comparação com o uso de três ferramentas separadas com três assinaturas separadas.

As imagens geradas por outras ferramentas podem ser usadas para criar vídeos no Seedance?

Certamente. A ferramenta [Image-to-Video] da Seedance aceita qualquer imagem carregada — não precisa ser gerada pela Seedance. Pode criar imagens usando Midjourney, DALL-E, Tongyi Wanshang, Stable Diffusion ou qualquer outra ferramenta e carregá-las como o primeiro fotograma. A vantagem do pipeline integrado reside na eliminação da etapa de download-upload, embora isso não seja obrigatório. Ao usar imagens externas, recomendamos o formato PNG com uma resolução de 1024x1024 ou superior para evitar que artefactos de compressão afetem a saída de vídeo.

Qual proporção de imagem deve ser usada para as imagens?

Certifique-se sempre de que a proporção da imagem corresponde à saída final do vídeo. 16:9 para vídeos paisagem (YouTube, apresentações, incorporações em sites), 9:16 para vídeos retrato (TikTok, Instagram Reels, YouTube Shorts), 1:1 para vídeos quadrados (feed do Instagram, determinados anúncios sociais). Gere imagens com a proporção correta desde o início. Não gere imagens quadradas e espere que as ferramentas de vídeo as convertam para 16:9 – isso irá cortar a sua composição ou adicionar conteúdo gerado por IA às bordas, o que compromete a qualidade.

Como criar pares de fotogramas-chave?

Gere dois quadros usando pipelines separados. O primeiro quadro segue o fluxo de trabalho padrão: gere prompts, crie imagens e repita até ficar satisfeito. O quadro final emprega imagem para imagem, carregando o primeiro quadro como imagem de referência e descrevendo as alterações no estado final. Isso garante consistência visual — mesmo local, mesma direção de iluminação, mesmo esquema de cores — enquanto alcança a mudança narrativa desejada (diferentes épocas, atividades ou humores). Carregue ambos os fotogramas num gerador de vídeo e deixe a IA criar a transição. Para um guia completo sobre esta técnica, consulte o Guia de Design do Primeiro e Último Fotograma.

Este fluxo de trabalho é adequado para conteúdo comercial?

Adequado. O pipeline de três etapas foi adotado por marcas de comércio eletrónico para vídeos de produtos, equipas de marketing para recursos publicitários, imobiliárias para apresentações de imóveis e agências de conteúdo para produção de mídias sociais. Vídeos gerados por IA com 5 a 15 segundos e frames iniciais de alta qualidade agora atendem aos padrões profissionais para conteúdo digital. A chave para o sucesso comercial está em investir tempo durante a fase de imagem — um frame inicial refinado se traduz diretamente em um vídeo refinado. Para durações mais longas ou conteúdo comercial com qualidade de transmissão, o vídeo com IA é cada vez mais utilizado para ideias criativas e visualização prévia, com a produção final ainda sendo concluída por métodos tradicionais para garantir o máximo controle.

O que se deve fazer se a imagem gerada tiver imperfeições?

Não prossiga com a geração do vídeo. As imperfeições na imagem original serão amplificadas no vídeo — uma mão ligeiramente distorcida numa imagem estática torna-se uma mão visivelmente deformada numa sequência de movimento de 120 fotogramas. Pré-processe a imagem. Use [image-to-image] para regenerar áreas problemáticas, preservando o resto da composição. Para falhas graves (figuras humanas deformadas, geometrias implausíveis), regenere completamente a imagem com um prompt modificado para contornar o problema. Os elementos propensos a falhas incluem mãos (especifique «mãos descansando ao lado do corpo» ou «mãos nos bolsos» para evitar poses complexas dos dedos), texto (evite incluir texto nas imagens geradas) e reflexos (simplifique as superfícies refletoras nos prompts). Só prossiga com a produção do vídeo quando a imagem estiver perfeita.

Comece a construir o seu pipeline criativo

O pipeline de três etapas — prompt → imagem → vídeo — continua a ser o método mais fiável para produzir vídeos de IA de alta qualidade em 2026. Ele separa o controlo criativo necessário (como a cena deve aparecer) da capacidade generativa desejada (como ela deve se mover), resultando em vídeos que se alinham com a sua visão, em vez de suposições aleatórias da IA.

Todo bom vídeo começa com uma boa imagem. Toda boa imagem começa com uma boa sugestão. Prepare bem o terreno e tudo o resto virá naturalmente.

Primeiro passo: Gerar prompts → — Transforme conceitos em prompts de imagem de nível profissional usando o gerador de prompts de IA da Seedance.

Passo dois: Gerar imagem → — Gere e refine iterativamente o quadro inicial perfeito para o seu vídeo.

Passo três: Gerar vídeo → — Transforme imagens em vídeos dinâmicos com movimento, ângulos de câmara e atmosfera.

Dominando a técnica do primeiro quadro → — Assuma o controlo da sua criação de vídeos com IA aprendendo a projetar quadros de referência.

Leitura adicional: Guia de IA de imagem para vídeo | Guia de design do primeiro e último quadro | Guia completo de IA de texto para imagem | Guia de IA de imagem para imagem | Guia do gerador de prompts de imagem com IA | Melhores geradores de imagem com IA de 2026 | Os melhores geradores de vídeo com IA para 2026*