Резюме

Image-to-Video AI использует технологию глубокого обучения, основанную на диффузионных моделях, для преобразования статических изображений в динамические видео. В отличие от чистого преобразования текста в видео, вам нужно только загрузить фотографию, чтобы ИИ сгенерировал реалистичное движение, движения камеры и временную связность кадров вокруг нее, что дает вам более точный контроль над конечным результатом. В этом руководстве будут подробно рассмотрены: технические принципы, лежащие в основе Image-to-Video AI; типы изображений, дающие оптимальные результаты; практическое руководство из пяти шагов по созданию вашего первого видео с нуля; восемь практических примеров использования с подсказками; передовые техники управления движением; а также сравнение основных инструментов 2026 года в реальных условиях (включая те, которые доступны непосредственно в Китае). Попробуйте Image-to-Video AI бесплатно -->

TuSheng Video AI берет ваши фотографии и генерирует реалистичное движение, кинематографические движения камеры и временную непрерывность, превращая один кадр в кинематографический видеоклип.

Что такое Tusheng Video AI?

Image-to-Video AI — это технология искусственного интеллекта, способная генерировать видео из статичных изображений. Вы предоставляете фотографию — будь то портрет, изображение продукта, пейзаж или произведение искусства — и модель искусственного интеллекта создает короткое видео, в котором элементы начинают двигаться, камера меняет ракурс, и вся сцена оживает.

В своей основе большинство систем генеративного видео используют модели диффузии видео. Эти нейронные сети обучаются на миллионах пар данных видеоизображений, изучая статистическую взаимосвязь между статическими кадрами и последующим естественным движением. При представлении нового изображения модель предсказывает, какое движение выглядит наиболее естественным, и генерирует непрерывную последовательность кадров, плавно переходящую от исходной фотографии.

Отличия от преобразования текста в видео

Text-to-Video создает видео полностью на основе текста. ИИ одновременно генерирует как визуальный контент, так и движение на основе вашего текстового запроса — мощно, но непредсказуемо, поскольку ИИ самостоятельно определяет внешний вид объектов, композицию сцен и все виды движения.

Tusheng Video переворачивает эту логику с ног на голову: вы предоставляете визуальную точку отсчета. ИИ уже знает, как выглядит сцена, потому что вы показали ее ему напрямую. Его единственная задача — сгенерировать правдоподобное движение. Это означает:

- Более высокий уровень контроля: ваши изображения определяют объект, композицию, цветовую палитру и стиль

- Меньше догадок: ИИ не требует интерпретации неясных текстовых описаний

- Повышенная согласованность: результаты точно соответствуют исходному изображению

- Более быстрая итерация: Настройка подсказки движения гораздо проще, чем переписывание всего описания сцены

Почему видео TuSheng так важно в 2026 году

TuSheng Video AI превратился из экспериментальной игрушки в продуктивный инструмент. Бренды электронной коммерции преобразуют изображения продуктов в анимированные рекламные ролики; блогеры-самостоятельные медиа оживляют свои самые популярные посты; агенты по недвижимости создают виртуальные видеоролики для просмотра из фотографий объектов недвижимости; а педагоги анимируют иллюстрации из учебников.

Эта технология достигла переломного момента — 5-15-секундные видеоролики, созданные на основе высококачественных исходных изображений, теперь практически неотличимы от традиционных видеозаписей в большинстве случаев. Именно поэтому преобразование изображений в видео стало самой быстрорастущей категорией в области генерации видео с помощью искусственного интеллекта.

Эта тенденция особенно заметна на китайском рынке. Алгоритмы таких платформ, как Douyin, Xiaohongshu, Bilibili и Kuaishou, отдают явное предпочтение видеоконтенту, что создает беспрецедентный спрос среди создателей контента на инструменты для быстрого преобразования фотографий в видео. Tusheng Video AI точно заполняет эту нишу на рынке.

Технические принципы Tusheng Video AI

Понимание технического процесса помогает достичь лучших результатов. Когда вы знаете, почему ИИ ведет себя определенным образом, вы можете предоставить более качественные входные данные и написать более эффективные подсказки. Вот четыре этапа процесса, которые происходят за кулисами.

Четыре этапа обработки видео с помощью искусственного интеллекта Tusheng: кодирование изображения, прогнозирование движения, генерация кадров и временное сглаживание.

Шаг первый: кодирование изображения

Сначала ИИ анализирует введенное вами изображение с помощью сети кодировщиков, сжимая его в плотное математическое представление, известное как латентный вектор. Это можно понимать как извлечение ИИ «отпечатка» вашего изображения — захват его структуры, цвета, глубины, расположения объекта, направления освещения и семантической информации.

Это скрытое представление значительно более компактно, чем исходные данные пикселей, что делает возможным последующие вычисления. Качество кодирования напрямую влияет на результаты вывода. Изображения с более высоким разрешением и большей четкостью генерируют более насыщенные скрытые представления, что в конечном итоге дает более качественный видеовывод.

Шаг второй: прогнозирование движения

Это творческое ядро всего процесса. Модель диффузии предсказывает, какое движение будет выглядеть естественно на основе исходного изображения, с учетом следующих факторов:

- Сценический контекст: фотография океана подразумевает, что волны должны бурлить; портрет предполагает тонкую динамику лица

- Информация о глубине: объекты, расположенные близко к объективу, могут демонстрировать отличные от удаленных объектов модели движения

- Физический реализм: волосы должны развеваться на ветру, вода должна течь вниз, а ткань должна естественно драпироваться

- Ваш текстовый запрос: если вы укажете «медленно панорамировать влево», модель соответствующим образом скорректирует прогноз движения.

Модель не просто искажает пиксели. Она генерирует совершенно новый визуальный контент для областей, которые стали видны в результате движения камеры или объекта. Если камера панорамирует вправо, модель «заполняет» сцену за правым краем исходного изображения.

Шаг третий: Создание рамки

На основе прогнозирования движения модель генерирует последовательность видеокадров. Каждый кадр создается посредством процесса обратной диффузии — начиная с шума, он постепенно преобразуется в четкое изображение, сохраняя при этом согласованность с предыдущим кадром и исходным изображением.

Seedance 2.0 и другие современные модели генерируют изображение с высокой частотой кадров (24–30 кадров в секунду), сохраняя при этом субпиксельную согласованность между кадрами. Это обеспечивает плавную, без мерцания картинку без проблем с дрожанием, характерных для более ранних систем.

Шаг четвертый: сглаживание во времени

Последний шаг обеспечивает плавные переходы между всеми сгенерированными кадрами. Механизм временного внимания проверяет, что яркость, цвет и движение остаются неизменными на протяжении всего видео, предотвращая появление распространенных визуальных артефактов:

- Внезапные изменения цвета между кадрами

- Неожиданное появление или исчезновение объектов

- Неестественное ускорение или замедление движения

- Мерцание текстуры поверхности

В результате получается изысканное видео, которое естественно вытекает из исходного материала.

Почему некоторые изображения выглядят лучше?

Теперь вы можете понять, почему качество входного изображения так важно. Размытое изображение с низким разрешением приводит к появлению шумов при кодировании на первом этапе, в результате чего модель прогнозирования движения (второй этап) получает меньше информации. Это приводит к менее точному движению и большему количеству визуальных артефактов в конечном результате. И наоборот, четкое, хорошо скомпонованное изображение с ясными указателями глубины предоставляет модели богатую информацию, что приводит к более естественному видео высокого качества.

Какой тип изображения дает наилучшие результаты?

Не все изображения подходят для Tusheng Video AI. Разница между хорошим исходным материалом и плохим исходным материалом может быть разницей между потрясающим видео и кучей непригодных кадров. Вот практическое руководство.

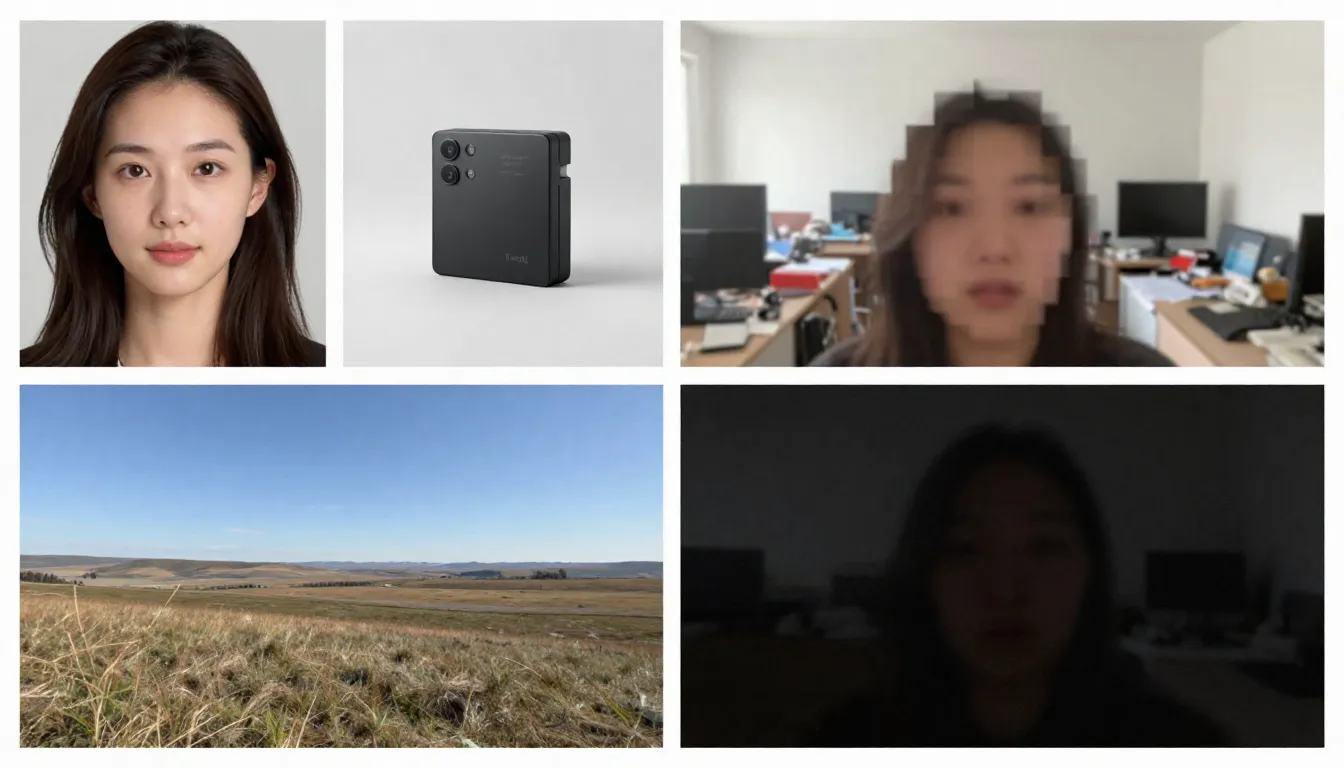

Слева отображаются подходящие исходные изображения (с высоким разрешением, хорошо скомпонованные, с естественными движениями), а справа — неподходящие исходные изображения (размытые, загроможденные, содержащие элементы, которые сложно обработать ИИ).

Подходящие типы изображений

Высокое разрешение (1024x1024 или выше). Большее количество пикселей позволяет кодировщику извлекать более детализированную информацию. Всегда используйте версию с максимально возможным разрешением. Минимальное рекомендуемое разрешение: 512x512 пикселей. Идеальное разрешение: 1024x1024 или выше.

Четко определенные объекты, резко очерченные контуры. ИИ должен различать, что должно двигаться, а что оставаться статичным. Портрет, на котором объект четко отделен от фона, дает гораздо лучшие результаты, чем сложная, хаотичная групповая сцена.

Хорошее освещение и правильная экспозиция. Изображения с хорошим освещением обеспечивают точную информацию о цвете и глубине модели. Избегайте изображений, которые сильно переэкспонированы или недоэкспонированы.

Естественное наслоение и композиция. Изображения с четко очерченным передним планом, средним планом и задним планом дают ИИ подсказки о глубине, повышая реалистичность эффектов параллакса и движений камеры.

Изображения, suggerendo movimento. Визуальные признаки движения — развевающиеся на ветру волосы, волны, готовые обрушиться на берег, фигура, шагающая вперед — дают модели мощные отправные точки для прогнозирования движения. ИИ может определить «что будет дальше» по этим визуальным индикаторам.

Чистый фон. Простой или естественно размытый фон дает более плавный видеосигнал, чем загроможденный многочисленными мелкими объектами.

Типы изображений, которые могут вызвать проблемы

Размытые или нечетко сфокусированные изображения. Размытость на входе, размытость на выходе. ИИ не может добавить резкость, которой не было в исходном изображении.

Чрезмерно сложные сцены. Изображения, содержащие множество мелких объектов, сложные узоры или визуальный беспорядок, могут перегрузить модели прогнозирования движения, в результате чего они не смогут определить, что и как должно двигаться.

Объемный текст или типографика. ИИ-видеомодели по-прежнему испытывают трудности с сохранением читаемости текста в разных кадрах. Если ваши изображения содержат логотипы, товарные знаки или наложенный текст, в видеоролике возникнут искажения.

Низкое разрешение (512x512 или ниже). Небольшие изображения содержат недостаточно информации. Даже увеличение их с помощью искусственного интеллекта перед вводом оказывается бесполезным — это добавляет пиксели, но не информацию.

Сильные фильтры или постобработка. Чрезмерная корректировка цветов, обработка HDR или обширные изменения в Photoshop могут сбить модель с толку в понимании освещения и глубины.

Несколько лиц разного размера. ИИ эффективно обрабатывает одиночные портреты. Групповые снимки с лицами, расположенными на разном расстоянии, приводят к несогласованной анимации — некоторые лица выглядят естественно, а другие искажаются.

Контрольный список для самопроверки перед загрузкой

Перед загрузкой изображений быстро проверьте следующие моменты:

- Минимальное разрешение 1024x1024 пикселей

- Четко определенный объект съемки, отчетливо выделяющийся на фоне

- Правильная экспозиция (без недоэкспонирования и переэкспонирования)

- Отсутствие сильных фильтров, экстремального HDR или следов искусственной обработки

- Минимальное количество текста, логотипов или типографских элементов

- Контролируемая сложность сцены (1–3 основных объекта)

- Формат изображения: JPG, PNG или WebP

Как только эти условия будут выполнены, можно приступать к генерации.

Пошаговое руководство: создайте свое первое видео из изображения

Выполните следующие пять шагов, чтобы преобразовать любое статическое изображение в анимированное видео с помощью искусственного интеллекта. В качестве демонстрационной платформы мы используем Seedance, но эти принципы применимы к любому инструменту для преобразования изображений в видео.

Шаг первый: выбор подходящих исходных изображений

Исходное изображение является наиболее важным фактором, определяющим качество результата. Выберите изображение, соответствующее описанным выше рекомендациям. Для первой попытки рекомендуется выбрать простой портрет или пейзаж с выраженной глубиной — эти два типа изображений дают наиболее стабильные результаты.

Рекомендуемые изображения для первых попыток: — Четкий портрет в полный рост или по пояс при хорошем освещении — Пейзажи с небом, водной гладью или растительностью (эти элементы обладают внутренним движением) — Изображения продуктов на чистом фоне — Художественные работы или иллюстрации с четко очерченными элементами

При первом создании избегайте использования сложных коллажей, изображений с большим количеством текста или сильно отредактированных фотографий.

Шаг второй: Загрузка в Seedance

Откройте Seedance Image-to-Video и загрузите выбранные изображения. Seedance поддерживает форматы JPG, PNG и WebP. Платформа автоматически проанализирует ваши изображения и подготовит их к генерации.

Если изображение имеет исключительно большие размеры (любая сторона превышает 4096 пикселей), система автоматически масштабирует его с сохранением пропорций, что исключает необходимость ручной настройки.

Шаг третий: Создание ориентированного на движение подсказки

На этом этапе вы сообщаете ИИ о желаемом движении. Ваша подсказка должна описывать динамику, а не содержание изображения (ИИ уже видел изображение). Сосредоточьтесь на следующих моментах:

- Движение объекта: что должен делать объект?

- Движение камеры: как должна двигаться камера?

- Движение окружающей среды: какая динамика окружающей среды должна присутствовать?

- Темп и настроение: общий темп — быстрый или медленный?

Примеры подсказок для портретов:

The woman slowly turns her head to the right and smiles softly.

A gentle breeze moves her hair. Background slightly out of focus

with subtle bokeh movement. Camera slowly pushes in from medium

shot to a close-up. Warm, natural lighting. Cinematic film quality.Пример подсказки для пейзажа:

Gentle waves roll toward the shore in slow motion. Clouds drift

slowly across the sky from left to right. Sunlight shimmers on

the water surface. Camera slowly pans right, revealing more of

the coastline. Peaceful, serene atmosphere. 4K cinematic quality.Пример подсказки о продукте:

The camera slowly orbits around the product, rotating 45 degrees

clockwise. Soft studio lighting with subtle caustic reflections

on the surface. Clean white background with gentle gradient.

Premium commercial aesthetic. Smooth, steady camera movement.Основной принцип: Описывайте движение, а не сцену. Сцена уже существует в вашем изображении.

Примечание: Seedance поддерживает как китайские, так и английские подсказки, хотя английские подсказки обычно обеспечивают большую точность в управлении движением камеры. Рекомендуется использовать английский язык для описаний, связанных с движением и камерой, а китайский язык можно использовать для описаний атмосферы и стиля.

Шаг четвертый: Выбор параметров

Настройте параметры генерации:

| Параметр | Рекомендуемое значение | Описание |

|---|---|---|

| Модель | Seedance 2.0 | Оптимальное качество изображения для генерации изображений в видео |

| Продолжительность | 5 секунд (для первых попыток) | Начните с короткой длительности, затем увеличьте ее; при удовлетворительном результате создайте расширенные версии |

| Соотношение сторон | Соответствие размерам изображения | 16:9 для альбомной ориентации, 9:16 для книжной ориентации, 1:1 для квадратной ориентации |

| Разрешение | 1080p | Всегда выбирайте максимально доступное разрешение |

Продвинутая техника: сначала создайте 5-секундную версию. Если движение и стиль вас устраивают, используйте тот же запрос для создания более длинной версии (8–15 секунд). Такой подход позволяет сэкономить кредиты на этапе исследования.

Шаг пятый: генерировать, проверять, повторять

Нажмите «Создать» и подождите 1–3 минуты. Когда результаты появятся, оцените их по следующим критериям:

- Движение плавное и естественное?

- Объект съемки сохраняет визуальную целостность на протяжении всего видео?

- Движение камеры соответствует вашим ожиданиям?

- Есть ли визуальные недостатки (мерцание, искажение, деформация)?

- Качество видео соответствует исходному материалу?

Если какой-либо аспект окажется неудовлетворительным, скорректируйте запрос и повторите генерацию. Распространенные методы корректировки:

- Слишком быстро? Добавьте «медленно», «плавно», «постепенно» к описанию движения

- Неправильное направление камеры? ** Уточните: «статичная камера, без движения камеры» или «медленное приближение камеры»

- Недостатки лица? Упростите движение: уменьшите количество действий, происходящих одновременно

- **Не хватает динамизма? ** Введите динамичные глаголы: «колебаться», «течь», «дрейфовать», «сдвигаться»

После двух-трех циклов итерации вы получите высококачественное видео, которое оживит ваши изображения.

Начните создавать свой первый клип из изображений прямо сейчас -->

8 основных применений и примеров преобразования больших изображений в видео

TuSheng Video AI — это не одноразовый инструмент. Он может использоваться для десятков творческих и коммерческих целей. Ниже приведены восемь высокоэффективных сценариев применения, а также практические подсказки, которые можно сразу скопировать и изменить.

- Анимация портрета

Оживите свои фотографии. Portrait Animation — самое популярное приложение для преобразования фотографий в видео. Загрузите свою фотографию из профиля, селфи или изображение персонажа, а затем добавьте едва заметные, реалистичные движения — дыхание, моргание, поворот головы, изменение выражения лица и движение волос.

Подходит для памятных видео, контента в социальных сетях, создания виртуальных аватаров и творческого повествования. В TikTok и Xiaohongshu контент «ожившие фотографии» остается стабильным источником трафика.

Статичный портрет превращается в живое видео — естественные моргания, едва заметные движения головы и развевающиеся волосы создают удивительно реалистичный эффект.

Пример подсказки:

The person looks directly at the camera with a calm, confident

expression. They slowly tilt their head slightly to the left and

give a subtle warm smile. Eyes blink naturally. A soft breeze gently

moves their hair. Shallow depth of field with softly blurred

background. Warm natural lighting. Cinematic portrait quality.- Витрина продукции

Превратите фотографии продуктов в динамичный коммерческий контент. Это революционное решение для брендов электронной коммерции и инфлюенсеров — у вас уже есть сотни или даже тысячи изображений продуктов, и теперь каждое из них может стать видеорекламой, ключевым визуальным элементом страниц с подробной информацией о продукте или короткометражным фильмом для социальных сетей.

На страницах с подробной информацией о товарах на Taobao и JD.com, в прямых трансляциях Douyin, посвященных представлению товаров, а также в постах Xiaohongshu с рекомендациями по товарам динамические отображения товаров достигают значительно более высоких коэффициентов конверсии, чем статические изображения.

Стандартное изображение продукта приобретает изысканность рекламного ролика премиум-класса — с вращением объектива, эффектным освещением и плавными движениями — традиционная постановка, которая может стоить от сотен до тысяч фунтов.

Пример подсказки:

The camera slowly orbits 90 degrees around the product, revealing

its form from multiple angles. Soft directional studio lighting

with subtle caustic reflections on the surface. A gentle highlight

sweep moves across the product. Clean, premium commercial aesthetic.

Shallow depth of field. Ultra-smooth camera movement. 4K quality.3. Ландшафт в режиме замедленной съемки

Превратите пейзажную фотографию в атмосферные видеоролики в стиле таймлапс. Облака плывут по небу, вода течет, свет меняется от золотистого до голубого, а листья колышутся на ветру. Идеально подходит для туристического контента, аэрофотосъемки недвижимости и атмосферных видеороликов.

Фотографы-пейзажисты и видеоблогеры-путешественники на Bilibili могут напрямую преобразовывать свои отборные фотографии в захватывающие таймлапс-видео, что значительно сокращает производственные затраты.

Ландшафтная фотография, преобразованная в кинематографический таймлапс — плывущие облака, колышущаяся вода, меняющиеся свет и тени — создают динамичное, атмосферное качество из одного статичного изображения.

Пример подсказки:

Time-lapse effect. Clouds move steadily across the sky from left

to right. Water in the foreground ripples and flows gently. Light

shifts subtly as if the sun is moving, creating slowly changing

shadows on the landscape. Trees and grass sway gently in the wind.

Camera remains static on a tripod. Serene, majestic atmosphere.

Cinematic landscape quality.4. Контент в социальных сетях

Превратите свои самые популярные статические посты в видеоконтент, который заставит людей остановиться и посмотреть. Алгоритмы таких платформ, как TikTok, Xiaohongshu, Bilibili и Kuaishou, отдают явное предпочтение видеоконтенту — высокоэффективный пост с изображением почти наверняка получит больше трафика, если его преобразовать в видео.

Для создателей контента Xiaohongshu пост с фотографией и текстом, сопровождаемый видеоверсией, может потенциально увеличить охват в три-пять раз. Между тем, Douyin и Kuaishou работают исключительно с видео в качестве основного формата контента.

Пример подсказки:

Dynamic, attention-grabbing motion. The subject moves confidently

toward the camera with energy and presence. Background elements

shift with parallax depth effect. Quick, punchy camera push-in

that creates impact. Vibrant colors, high contrast. Bold,

eye-catching aesthetic optimized for social media. Vertical 9:16.- Искусство и иллюстрация Анимация

Воплотите в жизнь произведения искусства, иллюстрации, цифровые картины и графические дизайны. Этот сценарий применения очень популярен среди художников, игровых дизайнеров и творческих команд, которые стремятся представить свои работы в более привлекательном виде.

В сообществах Bilibili и Xiaohongshu, посвященных искусству и аниме, анимированные иллюстрации считаются очень увлекательным контентом. Превращение статичных иллюстраций в видеоролики в стиле «живых обоев» часто приводит к значительному увеличению количества просмотров и сохранений по сравнению с исходными изображениями.

Пример подсказки:

The illustrated scene comes to life with gentle, painterly motion.

Characters move subtly within their positions -- breathing, shifting

weight, small gestures. Background elements like leaves, clouds,

or particles drift slowly. The artistic style is preserved exactly

as painted. Movement is smooth and dreamlike, like a living painting.

Gentle ambient lighting shifts. Fantasy illustration quality.6. Виртуальные просмотры недвижимости

Превратите фотографии недвижимости в виртуальные видеоролики. Агенты по недвижимости могут создавать иммерсивные превью, используя существующие изображения объектов, что избавляет от необходимости нанимать специальные команды фотографов для съемок на месте.

Для объявлений о недвижимости, размещенных на таких платформах, как Ke.com и Anjuke, а также для рекламы недвижимости в социальных сетях и на Xiaohongshu, динамические видеоролики демонстрируют значительно более высокий коэффициент конверсии запросов клиентов.

Пример подсказки:

Smooth virtual walkthrough. The camera glides forward slowly into

the room, revealing the space with a wide-angle perspective.

Natural daylight streams through the windows, casting soft shadows.

Subtle dust particles float in the sunbeams. The camera pans

gently to the left, showing the full room layout. Clean, bright,

aspirational real estate aesthetic. Steady, professional movement.- Выставка моды и стиля

Создавайте динамичный модный контент из студийных снимков нарядов. Модели двигаются, ткани естественно струятся, а эстетический стиль редактора остается неизменным.

Блогеры моды Xiaohongshu и продавцы одежды Taobao могут преобразовывать огромное количество существующих фотографий моделей и изображений нарядов в динамичные видеоролики, создавая более яркое визуальное представление в информационных лентах.

Пример подсказки:

The model strikes a confident pose and then slowly shifts their

weight, creating natural body movement. Fabric of the outfit

flows and catches the light with each subtle motion. Wind effect

gently moves the hair. Camera starts at full body and slowly drifts

upward to a waist-up shot. High-fashion editorial lighting with

strong directional shadows. Vogue magazine aesthetic. Cinematic

slow motion.- Образовательный и пояснительный контент

Превратите статичные диаграммы, инфографику и образовательные иллюстрации в динамичные презентации. Сложные концепции становятся легче для понимания, когда они приводятся в движение.

Создатели контента в зоне знаний Bilibili и на различных образовательных платформах могут преобразовывать учебные материалы, диаграммы и блок-схемы в анимированные видеоматериалы, что значительно повышает эффективность обучения и удерживает внимание зрителей.

Пример подсказки:

The diagram elements animate sequentially. Arrows begin to flow

in their indicated directions. Labels fade in one by one. Moving

parts of the system activate in logical order, showing the process

step by step. Smooth transitions between stages. Clean, clear

educational style. Elements highlight with subtle glow as they

become active. Professional presentation quality.Техники подсказок в видео Tusheng: полное руководство

Хорошо составленный запрос — это самый эффективный навык при генерации изображений из фотографий. Поскольку ИИ уже видел ваше изображение, ваш запрос должен быть полностью сосредоточен на движении и динамизме. Вот техники, которые дают наилучшие результаты.

Краткое справочное руководство по ключевым словам в спорте

Используйте эти конкретные ключевые слова для точного управления движением видео.

| Тип движения | Ключевые слова | Эффект | |-------- -|-------|------| | Объектив: вперед | приближение, сдвиг вперед, приближение, приближение | Объектив движется к объекту | | Объектив: назад | отдаление, отход назад, отступление, отдаление | Объектив удаляется от объекта | | Съемка: влево/вправо | панорамирование влево, панорамирование вправо, слежение влево, слежение вправо | Камера поворачивается или следит по горизонтали | | Съемка: вверх/вниз | наклон вверх, наклон вниз, подъем крана, опускание крана | Камера поворачивается или движется по вертикали | | Съемка: Орбита | орбита, вращение, поворот вокруг, дуга | Камера вращается вокруг объекта | | Камера: зум | увеличение, уменьшение, смещение фокусного расстояния | Зум (без смещения) | | Объект: микро-движения | дыхание, моргание, перенос веса, микро-движения | Незаметные, реалистичные движения | | Объект: умеренный | поворот головы, улыбка, жесты, медленная ходьба | Четкие, но контролируемые движения | | Объект: динамичный | бег, прыжки, танцы, вращения, махание руками | Энергичные движения всего тела | | Окружение: Мягкая | ветерок, дрейф, колебание, рябь, мерцание | Мягкое движение окружающей среды | | Окружающая среда: Интенсивная | порыв, поток, удар, вихрь, каскад | Сильная динамика окружающей среды | | Параллакс | параллакс, смещение глубины, движение слоев | Передний план/фон движутся с разной скоростью |

Различные ключевые слова для движения камеры дают совершенно разные эффекты. Выбирайте технику движения камеры в соответствии с желаемым результатом.

Контроль скорости и темпа

Темп движения оказывает глубокое влияние на эмоциональный тон видео. Используйте следующие модификаторы:

- Чрезвычайно медленный: «едва различимый», «ультра-замедленный», «ледяной темп» — драматичный, задумчивый

- Медленный: «медленно», «плавно», «постепенно», «неспешно» — элегантность, кинематографическое качество

- Умеренный: «ровный», «естественный темп», «со скоростью ходьбы» — реализм, документальный стиль

- Быстрый: « быстро», «бодро», «энергично», «стремительно» — динамично, воодушевляюще

- Чрезвычайно быстро: «стремительно», «быстрая смена камеры», «быстрый монтаж», «всплеск движения» — напряженно, насыщенно действием

Продвинутая техника: по умолчанию используйте замедленное воспроизведение. В видеороликах, созданных с помощью ИИ, замедленное воспроизведение почти всегда выглядит лучше, чем ускоренное. Быстрое движение увеличивает риск появления дефектов и визуальных несоответствий.

Независимое управление движением фона и объекта

Вы можете самостоятельно контролировать, что движется, а что остается неподвижным. Это мощный прием для привлечения внимания зрителей.

Объект в движении, фон в покое:

The person walks forward confidently while the background remains

perfectly still. Static camera, no camera movement. Focus entirely

on the subject's motion.Динамичный фон, статичный объект:

The person stands completely still, like a statue. Behind them,

clouds drift across the sky, leaves blow in the wind, and city

lights flicker. Only the environment moves.Отдельные действия обеих сторон:

The person slowly turns their head while the camera simultaneously

dollies in. Background clouds drift in the opposite direction,

creating a sense of depth and dimension.Различие между движением камеры и движением объекта

Понимание разницы между движением камеры и движением объекта имеет решающее значение для достижения желаемого эффекта.

Движение камеры изменяет перспективу и композицию. Сама сцена остается неизменной, а точка зрения смещается. Используется для: раскрытия сцены, создания обстановки и придания драматического эффекта.

Движение объектов означает перемещение элементов в пределах сцены при неподвижном положении камеры. Оно используется для: анимации персонажей, демонстрации продуктов и динамики природной среды.

Комбинированные движения используют оба типа одновременно. Это наиболее кинематографическая техника, но в то же время самая сложная для искусственного интеллекта. Рекомендуется сначала освоить один тип движения, а только после этого переходить к другому, когда результат вас устроит.

Расширенные структуры подсказок

Чтобы получить наиболее предсказуемые результаты, организуйте свои подсказки в следующем порядке:

- Основное действие — что делает главный герой

- Движение камеры — как движется камера

- Динамика окружающей среды — что делают элементы окружающей среды

- Скорость/темп — темп всех движений

- Атмосфера/настроение — эмоциональный тон

- Улучшение визуального качества — техническое описание визуального качества

Пример использования этой структуры:

[Subject] A young woman in a flowing white dress slowly raises

her hand to brush hair from her face.

[Camera] The camera executes a slow, steady dolly in from a

medium shot to a close-up.

[Environment] Cherry blossom petals drift gently through the

air. Soft golden sunlight filters through the trees.

[Speed] All motion is slow and deliberate, almost dreamlike.

[Mood] Romantic, ethereal, peaceful atmosphere.

[Quality] Cinematic shallow depth of field, anamorphic bokeh,

film grain, 4K quality.Сравнение инструментов искусственного интеллекта TuSheng Video 2026

Конкуренция в секторе потокового видео усиливается. Ниже приводится сравнительный анализ основных платформ по состоянию на февраль 2026 года с особым акцентом на доступность для пользователей в материковом Китае.

Эффекты обработки одного и того же исходного изображения на пяти различных платформах генерации видео. Различия в качестве движения, временной согласованности и визуальной точности сразу бросаются в глаза.

| Особенность | Seedance 2.0 | Runway Gen-4 | Pika 2.0 | Kling 3.0 | Luma Dream Machine | |------|-------------|-------------|---------|------ ----------|-------------------| | Максимальное разрешение | 2K (2048x1080) | 4K (увеличенное) | 1080p | 1080p | 1080p | | Максимальная продолжительность | 15 секунд | 10 секунд | 5 секунд | 2 минуты | 5 секунд | | Варианты ввода | Изображение + Текст + Видео + Аудио | Изображение + Текст + Видео | Изображение + Текст | Изображение + Текст | Изображение + Текст | | Ввод нескольких изображений | Поддерживается (до 9 изображений) | Не поддерживается | Не поддерживается | Не поддерживается | Не поддерживается | | Нативный аудио | Поддерживается (8 языков с синхронизацией губ) | Не поддерживается | Частично (звуковые эффекты) | Не поддерживается | Не поддерживается | | Управление камерой | На основе подсказок | Кисть движения + Режиссерский режим | Базовый | Базовый | На основе подсказок | | Бесплатный лимит | Доступно (Бонус за регистрацию) | Доступна (ограниченно) | Доступна (ограниченно) | Доступна (ограниченно) | Доступна (ограниченно) | | Начальная цена | ~9,90 $/месяц | 15 $/месяц | 10 $/месяц | ~6,99 $/месяц | 9,99 $/месяц | | Доступ из материкового Китая | Прямой доступ | Требуется VPN | Требуется VPN | Прямой доступ | Требуется VPN | | Наилучшее применение | Мультимодальное управление, качество изображения | Профессиональный рабочий процесс редактирования | Начинающие, забавные эффекты | Длинные видео, высокая ценность | Кинематографический эффект, 3D-сцены |

Подробные обзоры каждого инструмента

Seedance 2.0 не имеет себе равных по гибкости ввода. Это единственная платформа, поддерживающая одновременную загрузку до девяти эталонных изображений, синхронизацию звука и видео, а также объединение всех режимов ввода в одном поколении. Для максимального контроля над выводом изображения в видео Seedance предлагает самый полный набор инструментов. Его разрешение 2K также является самым высоким среди всех инструментов (без использования апсэмплинга). Разработанная ByteDance (материнской компанией TikTok), пользователи в материковом Китае могут получить к ней прямой доступ без необходимости использования VPN или зарубежных способов оплаты.

Runway Gen-4 отличается высокой точностью управления. Motion Brush позволяет вам тщательно «рисовать», какие части изображения должны двигаться и в каком направлении. Если вам требуется точное управление конкретными областями, Runway является наиболее мощным вариантом. Недостатками являются более высокая цена и более низкие квоты на генерацию. Для доступа в Китае требуется VPN.

Pika 2.0 — самый доступный вариант. Для новичков, желающих поэкспериментировать с созданием видео из изображений, не изучая инженерные навыки, эффекты Pika, доступные в один клик, и оптимизированный интерфейс предлагают минимальный входной барьер. Хотя качество изображения уступает премиальным инструментам, его вполне достаточно для повседневного контента в социальных сетях. Для доступа в Китае требуется VPN.

Kling 3.0 полностью превосходит своих конкурентов как по времени выполнения, так и по соотношению цены и качества. Если вам нужно создать длинные видеоролики — 30 секунд, 1 минуту или даже 2 минуты — из одного изображения, Kling является единственным подходящим вариантом. Соотношение цены и качества изображения у него исключительно выгодное. Его ограничение заключается в ограниченных вариантах ввода (одно изображение + текст). Как продукт под брендом Kuaishou, Kling доступен напрямую в материковом Китае, предлагая отечественным пользователям еще один удобный вариант.

Luma Dream Machine отличается превосходным пространственным восприятием. Для пейзажей, архитектуры и сцен, где трехмерное пространственное восприятие имеет решающее значение, Luma создает наиболее убедительный параллакс и движения камеры. Анимация персонажей уступает конкурентам. Для доступа из России требуется VPN.

Рекомендации для пользователей из материкового Китая

Если вы находитесь в материковом Китае, есть два основных видеоинструмента, которые можно использовать напрямую без VPN:

- Seedance 2.0 — разработан ByteDance, полностью функционален и готов к использованию, отличается мультимодальным вводом + разрешением 2K + встроенным аудио

- Kling 3.0 — продукт под брендом Kuaishou, отличается высокой эффективностью при создании длинных видеороликов и превосходным соотношением цены и качества

Хотя зарубежные инструменты, такие как Runway, Pika и Luma, обладают своими отличительными особенностями, все они требуют доступа к VPN и зарубежных способов оплаты, что создает более высокий барьер для входа на рынок.

Для создателей контента на таких отечественных платформах, как Douyin, Xiaohongshu, Bilibili и Kuaishou, выбор инструментов, доступных непосредственно в Китае, не только более удобен, но и обеспечивает большую уверенность с точки зрения стабильности сети и простоты оплаты.

Для более полного сравнения (включая возможности преобразования текста в видео) ознакомьтесь с нашим полным рейтингом генераторов видео на базе искусственного интеллекта на 2026 год.

Распространенные ошибки и способы их исправления

После тестирования тысяч видеороликов мы выделили пять наиболее распространенных ошибок, а также конкретные меры по их исправлению.

- Используйте стоковые изображения с низким разрешением

Допущенная ошибка: загрузка небольшого сжатого изображения (например, миниатюры размером 400x300, сохраненной из WeChat или социальных сетей) с ожиданием получения видео высокого разрешения.

Почему это не работает: кодировщик не может извлечь достаточную визуальную информацию из изображений с низким разрешением. Результат получается размытым, а также на него накладываются артефакты движения.

Как исправить: всегда используйте изображение с максимальным разрешением. Если доступны только изображения с низким разрешением, используйте инструмент искусственного интеллекта для повышения разрешения (например, Real-ESRGAN или Topaz Gigapixel) перед загрузкой. Минимальный рекомендуемый размер — 1024x1024 пикселей.

- Пишите описания сцен, а не действия

Допущенная ошибка: написание подсказок типа «Поверхность моря на закате, с золотистым светом, сверкающим на воде». Это описывает внешний вид изображения — то, что ИИ и так уже знает.

Почему это не сработало: ИИ уже закодировал изображение. Описание содержания изображения обратно в него тратит место на избыточную информацию и не дает никаких указаний для движения.

Как исправить: Сосредоточьтесь исключительно на движении. Перепишите так: «Волны мягко накатывают на берег. Золотистый солнечный свет мерцает на поверхности воды. Облака медленно плывут слева направо. Камера медленно панорамирует вправо, следуя за линией побережья».

- Требование выполнения слишком большого количества действий одновременно

Допущенные ошибки: «Персонаж поворачивается, машет рукой, идет вперед, берет чашку, улыбается и танцует, а камера приближается, поворачивается влево и наклоняется».

Почему это не работает: современные модели искусственного интеллекта не могут надежно координировать более двух-трех одновременных действий. Перегруженные запросы приводят к тому, что модель либо игнорирует большинство инструкций, либо генерирует путаные, полные ошибок результаты.

Как редактировать: ограничьте каждое поколение одним основным действием субъекта плюс одним движением камеры. Для сложных непрерывных действий сначала создайте несколько коротких клипов, а затем отредактируйте и соедините их вместе.

- Игнорировать несоответствие соотношения сторон

Распространенная ошибка: загрузка фотографии в формате 16:9, но установка выходного формата 9:16, или наоборот.

Почему это не работает: ИИ либо резко обрезает изображение, либо требует заполнения больших пустых областей. Ни один из этих подходов не дает удовлетворительных результатов — обрезка нарушает тщательно скомпонованную композицию, а заполнение обширных новых областей приводит к несоответствиям.

Как исправить: убедитесь, что соотношение сторон выходного изображения соответствует пропорциям исходного изображения. Используйте соотношение 16:9 для горизонтальных изображений и 9:16 для вертикальных изображений. Если требуется другое соотношение сторон, обрежьте исходное изображение до нужных пропорций перед загрузкой.

- Ожидание реалистичного эффекта от иллюстративных изображений

Допущенная ошибка: загрузка мультипликационной иллюстрации или плоского изображения с ожиданием, что ИИ сгенерирует фотореалистичное видео.

Почему это не работает: модель пытается интерпретировать художественные стили, иногда привнося нежелательный реализм. Плоские иллюстрации не имеют глубины и освещения, на которые модель опирается для прогнозирования естественных движений.

Как исправить: если исходный материал представляет собой иллюстрацию, четко укажите стиль в запросе: «Сохраните стиль иллюстраций в точности. Анимация должна быть выполнена в стиле 2D-анимации, а не фотореалистичной. Движения должны выглядеть как нарисованные от руки и живописные». Это дает модели указание сохранить художественный стиль, а не вводить фотореализм.

Часто задаваемые вопросы

Какой инструмент искусственного интеллекта лучше всего подходит для создания видео из изображений?

Seedance 2.0 — наш лучший выбор для создания видео из изображений в 2026 году. Он поддерживает несколько входных изображений (до 9 эталонных изображений), выводит изображения с разрешением 2K и предлагает наиболее гибкое сочетание изображений, текста, видео и аудио. Кроме того, Seedance разработан компанией ByteDance, что делает его доступным непосредственно на территории материкового Китая. Для экономных пользователей Kling 3.0 обеспечивает отличное качество изображения по более низкой цене, а также доступен напрямую в материковом Китае. Для начинающих Pika 2.0 предлагает самый простой интерфейс. Оптимальный выбор зависит от ваших конкретных требований — пожалуйста, ознакомьтесь с нашей [таблицей сравнения инструментов](#2026-year image-to-video AI tool comparison).

Можно ли использовать TuSheng Video бесплатно?

Конечно. Несколько платформ предлагают бесплатные квоты. Seedance предоставляет бесплатные кредиты каждому новому пользователю — кредитная карта не требуется. Pika 2.0 и Luma Dream Machine также предлагают ограниченное количество бесплатных генераций. HaiLuo AI предоставляет 10 бесплатных генераций в день. Этих бесплатных квот достаточно для тестирования технологии и создания нескольких видео. Для постоянного использования более экономичными являются платные тарифные планы. Для получения дополнительной информации о стратегиях бесплатного использования ознакомьтесь с нашим Руководством по бесплатному использованию Seedance.

Какова максимальная продолжительность видеороликов, созданных с помощью ИИ?

Различные платформы имеют разные ограничения. Kling 3.0 лидирует в этой области, генерируя видеоролики длиной до 2 минут на одно изображение. Seedance 2.0 ограничивается 15 секундами. Runway Gen-4 ограничивает длительность 10 секундами. Pika 2.0 и Luma Dream Machine ограничивают длительность видео 5 секундами. Для большинства социальных сетей и маркетинговых сценариев оптимальная длительность составляет 5–15 секунд. Если требуется более длинный ролик, можно создать несколько коротких клипов для последующего редактирования и склеивания или использовать Kling для создания длинного видео из одного кадра.

Какой формат изображения наиболее подходит для генерации видео с помощью ИИ?

PNG является оптимальным форматом, так как он не имеет потерь и не содержит артефактов сжатия. WebP (режим без потерь) дает аналогичные результаты при меньшем размере файлов. JPG также подходит в большинстве случаев, но сильно сжатые JPG-файлы с заметными артефактами сжатия ухудшают качество вывода. Избегайте использования GIF, BMP или других нестандартных форматов. Все основные платформы поддерживают JPG, PNG и WebP. Минимальное разрешение: 512x512 пикселей. Рекомендуемое: 1024x1024 или выше.

Может ли ИИ анимировать любой тип изображения?

ИИ может анимировать большинство типов изображений, хотя результаты варьируются в зависимости от объекта. Портреты и фотографии головы дают лучшие результаты — современные модели умело передают естественные выражения лица и движение волос. Пейзажи и природные сцены также получаются исключительно хорошо, с убедительным изображением движения облаков, текущей воды и колышущейся листвы. Изображения продуктов с чистым фоном дают стабильно надежные результаты. Иллюстрации и художественные работы можно анимировать, хотя для этого может потребоваться индивидуальная настройка стиля, чтобы избежать нежелательного фотореализма. Сложные групповые сцены, изображения, содержащие значительный объем текста, и фотографии низкого качества дают наименее стабильные результаты.

В чем разница между видео, созданным на основе изображений, и видео, созданным на основе текста?

Text-to-Video одновременно генерирует визуальный контент и движение на основе текстовых описаний. ИИ определяет весь визуальный облик, предлагая меньший контроль над конкретными деталями, но большую творческую свободу. Image-to-Video использует ваши существующие изображения в качестве отправной точки, генерируя только движение. Вы сохраняете точный контроль над визуальным обликом, поскольку предоставляете визуальную ссылку. Image-to-Video обычно дает более предсказуемые и последовательные результаты, поскольку ИИ имеет конкретную визуальную основу. Text-to-Video лучше подходит для создания ИИ совершенно нового контента с нуля.

Может ли Tusheng Video контролировать движение камеры?

Конечно. Большинство современных инструментов для генерации видео поддерживают управление движениями камеры с помощью текстовых команд. Вы можете указать такие движения, как «долли в», «панорамирование влево», «орбита вокруг», «кран вверх», «уменьшение масштаба» и «следящий снимок». Seedance 2.0 и Luma Dream Machine особенно точно реагируют на эти ключевые слова, обозначающие движения. Runway Gen-4 предлагает дополнительную точность благодаря режимам Motion Brush и Director Mode, позволяющим визуально рисовать траектории движения камеры. Рекомендуется указывать только один тип движения на каждое поколение, дополняя его модификаторами скорости, такими как «медленно» или «равномерно».

Достаточно ли качество изображения видеороликов, созданных с помощью ИИ, для профессионального использования?

Для коротких видеороликов (5–15 секунд) это вполне возможно. Результаты работы таких ведущих платформ, как Seedance 2.0 и Runway Gen-4, уже профессионально используются в маркетинге в социальных сетях, видеороликах о товарах для электронной коммерции, презентациях недвижимости и рекламных концепциях. На внутреннем рынке значительная часть коммерческого контента на Douyin и Xiaohongshu теперь включает в себя видеоматериалы, созданные с помощью ИИ. Однако ограничения остаются: длительная продолжительность увеличивает риск дефектов; сложные сцены с несколькими объектами остаются нестабильными; а рендеринг текста в видео все еще далек от совершенства. Для телевизионных или кинематографических работ, требующих абсолютного совершенства, традиционная съемка остается более безопасным вариантом. Для цифрового маркетинга и социального контента технология преобразования изображений в видео с помощью ИИ достигла профессиональных стандартов.

Резюме

TuSheng Video AI превратился из новинки в незаменимый инструмент для создания контента. Технология созрела, инструменты стали удобными для пользователя, а качество результатов теперь соответствует профессиональным стандартам для подавляющего большинства сценариев использования цифрового контента.

Ниже приведены основные моменты:

- Качество исходных изображений решает все. Четкие, хорошо скомпонованные изображения с высоким разрешением дают гораздо лучшие результаты по сравнению с размытыми или низкоразрешающими.

- Описывайте движение, а не изображение. ИИ уже видел ваше изображение. Расскажите ему, как должны двигаться объекты, а не как они выглядят.

- **Начните с простого. ** Одно действие объекта плюс одно движение камеры. Освойте основы, прежде чем добавлять сложность.

- Быстро повторяйте. Сначала создайте короткие тестовые клипы; полную версию создавайте только тогда, когда будете удовлетворены.

- **Подбирайте инструменты под задачи. ** Seedance уделяет приоритетное внимание визуальной точности и мультимодальному управлению; KeLing превосходит другие программы в создании длинных видеороликов и экономичности; Runway фокусируется на точном монтаже; Pika делает акцент на простоте и удобстве использования.

- Выберите инструмент, который соответствует вашим потребностям. Если вы находитесь в материковом Китае, Seedance и KeLing можно использовать напрямую, без дополнительных сетевых или платежных барьеров.

Разрыв между брендами и создателями, использующими Tusheng Video AI, и их коллегами, которые по-прежнему полагаются на статичные изображения, с каждым месяцем увеличивается. Каждая фотография в вашей библиотеке продуктов имеет потенциал для использования в качестве видеорекламы. Каждый портрет может стать динамичным аватаром. Каждый пейзаж может служить кинематографическим материалом для B-roll.

Создайте свое первое видео из изображения бесплатно --> — загрузите любое изображение и посмотрите, как оно оживает в течение двух минут. Не требуется кредитная карта, доступно напрямую в материковом Китае.

Хотите узнать больше о функциях AI-видео? Попробуйте Seedance на всех платформах --> — преобразование текста в видео, преобразование видео в видео, мультимодальное генерирование: все в одном месте.

Дополнительная информация: Полное руководство пользователя Seedance | Руководство по Seedance Prompt с более чем 50 примерами | Примеры использования AI Video Creative | Рейтинг лучших генераторов видео с ИИ на 2026 год | Руководство по маркетингу и социальным сетям с использованием видео с ИИ | ИИ «Текст в видео»: полное руководство*