要約

図生動画AI(Image-to-Video AI)は、拡散モデルに基づく深層学習技術を活用し、静止画像を動的動画に変換します。純粋なテキスト生成動画とは異なり、写真を1枚アップロードするだけで、AIがその写真を中心にリアルな動き、カメラワーク、時間的連続性のある映像を生成。最終的な効果をより精密に制御できます。本ガイドでは以下を詳細に解説:・画像動画生成AIの技術原理・最適な効果を得る画像の種類・ゼロから最初の動画を生成する5ステップ実践チュートリアル・8つの実用シーンとプロンプト例・高度な動き制御プロンプトのテクニック・2026年主流ツールの実践比較(国内で直接利用可能なツールを含む)画像動画生成を無料体験 -->

図生動画AIは静止画を受け取り、リアルな動き、カメラワーク、時間的連続性を生成します——静止画を一コマから映画のような動画クリップに変えます。

図生動画AIとは何か?

図生動画AI(Image-to-Video AI)は、静止画から動画を生成する人工知能技術です。人物写真、製品画像、風景、芸術作品など、一枚の写真を提供すると、AIモデルが短い動画を生成します。画面内の要素が動き出し、カメラアングルが変化し、シーン全体が生き生きと動き出します。

基盤技術としては、ほとんどの生成動画システムが**動画拡散モデル(Video Diffusion Model)**を採用している。この種のニューラルネットワークは、数百万組の動画-画像データペアで訓練され、静止画とそれに続く自然な動きの間の統計的関係を学習する。新しい画像を入力すると、モデルはどのような動きが最も自然に見えるかを予測し、元の写真から滑らかに移行する連続フレームシーケンスを生成する。

Text-to-Videoとの違い

文生動画(Text-to-Video)は完全にテキストから始まります。AIはあなたのテキストプロンプトに基づいて、画面の内容と動きを同時に生成します——強力ですが予測不能です。なぜならAIが主体(被写体)の外観、シーンの構成、そしてあらゆる動きの方法を独自に決定するからです。

図生動画はこのロジックを逆転させる:あなたが視覚的なアンカーを提供する。AIはシーンがどう見えるか既に知っている——あなたが直接見せているからだ。AIの唯一の任務は、合理的な動きを生成することだ。これはつまり:

- より強力な制御力:画像が主題・構図・色彩・スタイルを定義

- 推測の削減:AIが曖昧なテキスト説明を解釈する必要なし

- 高い一貫性:出力と元画像の高度な一致

- 迅速な反復:運動プロンプトの調整は、シーン全体の記述を書き直すよりもはるかに簡単です

なぜ2026年の図生動画がそれほど重要なのか

図生動画AIは実験的なおもちゃから生産性ツールへと進化した。ECブランドは商品画像を動的広告に変え、インフルエンサーは人気投稿を動画化し、不動産仲介は物件写真でバーチャル内見動画を作成し、教育者は教科書イラストを生き生きと動かす。

この技術は転換点に到達した——高品質な静止画から生成される5~15秒の動画は、ほとんどのシーンで従来の実写とほぼ見分けがつかない。これが画像から動画を生成する技術がAI動画生成分野で最も急速に成長しているカテゴリーとなった理由である。

中国市場では、この傾向が特に顕著である。TikTok、Xiaohongshu、Bilibili、Kuaishouなどのプラットフォームのアルゴリズムは動画コンテンツを強く優先しており、クリエイターによる「写真を素早く動画に変換する」ニーズがかつてないほど高まっている。図生動画AIはまさにこの需要のギャップを埋める存在である。

图生動画AIの技術原理

技術的なプロセスを理解することは、より良い結果を得るのに役立ちます。AIがなぜ特定の行動を示すのかを理解すれば、より適切な入力や効果的なプロンプトを作成できます。以下に、その背後で起こる4つのステップを説明します。

図生動画AI処理パイプラインの4段階:画像符号化、運動予測、フレーム生成、時間平滑化。

第一步:画像エンコーディング

AIはまずエンコーダネットワークを通じて入力画像を分析し、それを**潜在ベクトル(Latent Vector)**と呼ばれる高密度な数学的表現に圧縮します。これはAIが画像の「指紋」を抽出するものと理解できます——構造、色彩、深度、主体の位置、光の向き、意味情報を捉えるのです。

この潜在表現は元のピクセルデータよりもはるかにコンパクトであり、後続の計算を可能にします。符号化品質は出力効果に直接影響します。解像度が高くシャープな入力画像ほど、より豊かな潜在表現が生成され、最終的に優れた動画出力が得られます。

第二步:運動予測

これはプロセス全体の創造的な核心です。拡散モデルは元の画像に基づいて、どのような動きが自然かを予測します。その際、以下の要素を考慮します:

- シーンの文脈:海の写真では波がうねるべきであり、人物写真では顔に微妙な動きが暗示される

- 深度情報:カメラに近い物体は遠くの物体とは異なる動き方をしてもよい

- 物理的合理性:髪は風に揺れるべき、水は下へ流れるべき、布地は自然に垂れ下がるべき

- あなたのテキストプロンプト:もし「ゆっくりと左へ平行移動」と指定すれば、モデルはそれに応じて運動予測を調整する

モデルは単純にピクセルを歪めるだけではない。レンズ移動や物体の動きによって新たに露出した領域に対して全く新しい視覚コンテンツを生成する。レンズが右方向にパンした場合、モデルは元の画像の右端の外側にあるシーンを「補完」する。

第三ステップ:フレーム生成

運動予測に基づき、モデルは一連の動画フレームを生成する。各フレームは逆拡散プロセスを通じて生成される——ノイズから始まり、前フレームおよび元の画像との一貫性を保ちながら、徐々に鮮明な画像へと精緻化される。

Seedance 2.0などの現代モデルは高フレームレート(24~30fps)で生成され、フレーム間のサブピクセルレベルの一貫性を維持します。これにより、出力は滑らかでちらつきがなく、初期システムでよく見られたブレの問題が発生しません。

第四步:時間平滑化

最後のステップでは、生成されたすべてのフレーム間の遷移が滑らかであることを保証します。時間注意機構は動画全体の輝度、色彩、動きの一貫性をチェックし、一般的な視覚的欠陥を防ぎます:

- フレーム間の突然の色ずれ

- オブジェクトの予期せぬ出現または消失

- 不自然な加速または減速

- 表面テクスチャのちらつき

最終的な結果は、元の画像から自然に流れ出る洗練された動画である。

なぜ一部の画像はより効果的なのか

これで、入力画像の品質がなぜそれほど重要なのかが理解できるでしょう。ぼやけて解像度の低い画像は、最初の段階でノイズの多い潜在符号を生成します。これにより、運動予測モデル(第二段階)に提供される情報が少なくなり、運動の精度が低下し、最終的な出力映像の画質劣化につながります。逆に、シャープで構図が良く、明確な深度手がかりを持つ画像は、モデルに豊富な情報を提供し、より自然で高品質な動画へと変換されます。

どのような画像効果が最も良いですか?

すべての画像が図生動画AIに適しているわけではありません。優れた素材画像と劣った素材画像の差は、まさに素晴らしい動画と使い物にならない映像の差となる可能性があります。以下に実用的なガイドを示します。

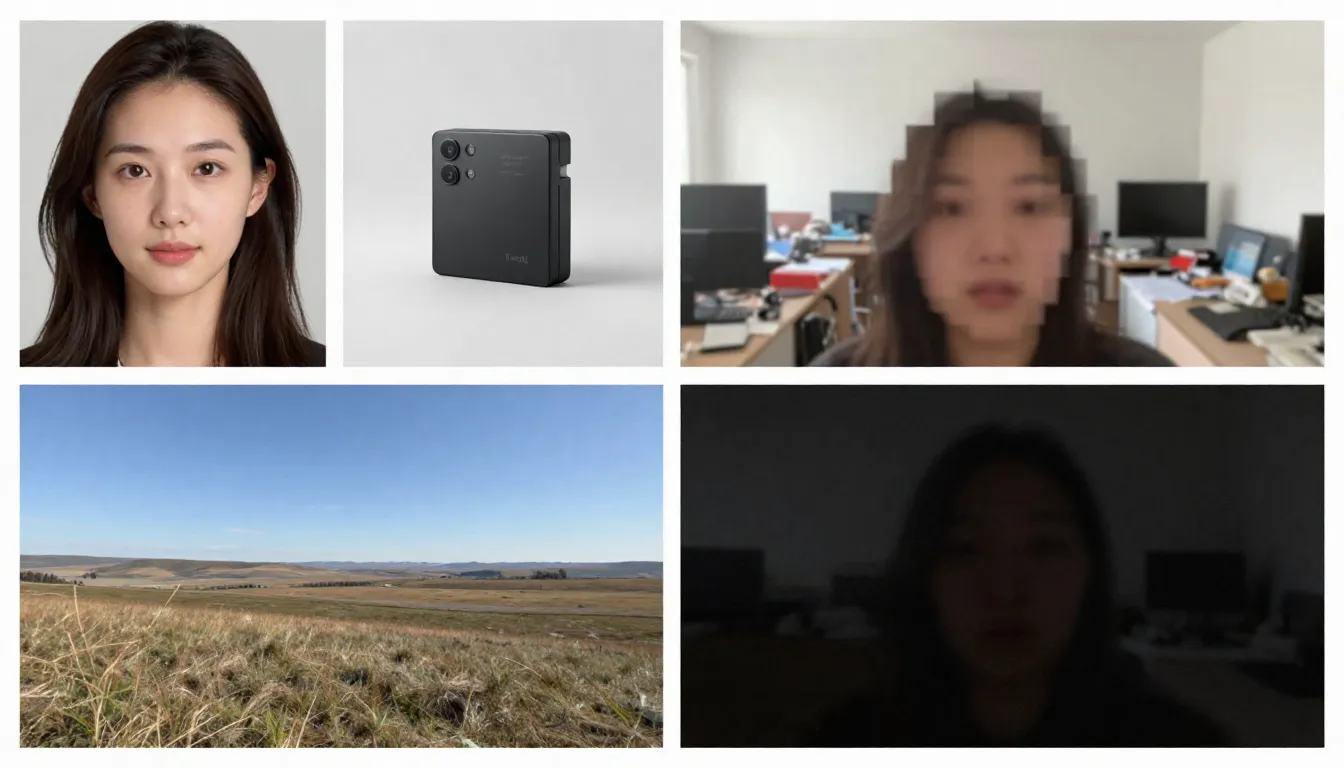

左側は適した素材画像(高解像度、構図が良く、自然な動きを暗示している)、右側は不適な素材画像(ぼやけている、雑然としている、AIが処理しにくい要素を含む)。

適切な画像タイプ

高解像度(1024x1024 以上)。ピクセル数が多いほど、エンコーダーが抽出できる情報量が増えます。入手可能な最高解像度のバージョンを常に使用してください。最低推奨:512x512 ピクセル。理想:1024x1024 以上。

主体が明確で輪郭がはっきりしている。AIは、何が動くべきで何が静止すべきかを識別する必要がある。主体と背景が明確に分離された人物写真は、複雑で混乱した集団シーンよりもはるかに効果的である。

十分な光量と適切な露出。光量が十分な画像は、モデルに正確な色彩と深度情報を提供します。深刻な露出オーバーやアンダーの写真は避けてください。

自然の階層と構図。前景、中景、背景が明確に区別された画像は、AIに深度の手がかりを提供し、視差効果やカメラワークのリアリティを向上させます。

動きを暗示する映像。動きを暗示する画像——風に吹かれる髪、岸に打ち寄せようとする波、歩みを進める人物——はモデルに強力な運動予測の起点を提供する。AIはこれらの視覚的手がかりから「次に何が起こるか」を理解できる。

クリーンな背景。シンプルまたは自然にボケた背景は、大量の小物が散らばった雑然とした背景よりも滑らかな動画出力を生み出します。

問題が発生する可能性のある画像タイプ

ぼやけた画像。入力がぼやけていれば、出力もぼやけます。AIは元の画像に存在しない鮮明さを追加することはできません。

過度に複雑なシーン。多数の小さな被写体、精密な模様、または視覚的に雑然とした画像を含む画像は、運動予測モデルに過負荷をかけ、何が動くべきか、どのように動くべきかを判断できなくなる。

大量のテキストやレイアウト。AI動画モデルは、フレーム間でテキストの可読性を維持する点で依然として課題を抱えています。画像にロゴやテキストオーバーレイが含まれる場合、動画出力で歪みが生じます。

低解像度(512x512以下)。小さな画像には十分な情報が含まれていません。AIで拡大してから入力しても効果はありません——ピクセル数は増えますが、情報は増えません。

過度なフィルターや後処理。極端な色補正、HDR処理、または大量のPhotoshop修正は、モデルの光と深度に対する理解を混乱させます。

複数の異なるサイズの顔。AIは単一の人物像をうまく処理できる。異なる距離にある複数の顔が写った集合写真は不均一なアニメーションを生む——一部の顔は自然に見える一方、他の顔は歪みが生じる。

アップロード前の自己チェックリスト

画像をアップロードする前に、以下の点を素早く確認してください:

- 解像度は少なくとも1024x1024ピクセル

- 被写体が鮮明で、背景と明確に分離されている

- 露出が適切(暗すぎず明るすぎない)

- 過度なフィルター、極端なHDR処理、人工的な加工の痕跡がない

- 文字、ロゴ、レイアウト要素は最小限

- シーンの複雑さが管理可能(主要被写体1~3つ)

- 画像形式はJPG、PNG、またはWebP

これらの条件を満たせば、生成を開始できます。

ステップバイステップガイド:初めての図生成動画を作成する

以下の5つの手順に従って、任意の静止画像を動的なAI動画に変換します。ここではSeedanceをデモプラットフォームとして使用しますが、これらの原則はあらゆる画像から動画を生成するツールに適用できます。

第一步:適切な素材画像を選ぶ

素材画像は出力品質を決定する最も重要な要素です。前述のガイドラインに合致する画像を選択してください。初めての試みでは、シンプルな人物写真や明瞭な奥行きのある風景写真をお勧めします——この2種類の画像は最も安定した効果を発揮します。

初めての方におすすめの画像:

- 照明の良いクリアな顔写真または上半身写真

- 空、水面、植生を含む風景(これらの要素は自然な動きを表現)

- シンプルな背景の製品写真

- 明確な要素が区別されたアート作品やイラスト

最初の生成時には、複雑な合成写真、大量のテキストを含む画像、または過度なレタッチを施した写真の使用を避けてください。

第二步:Seedanceにアップロードする

Seedance 図生動画を開き、選択した画像をアップロードしてください。SeedanceはJPG、PNG、WebP形式に対応しています。プラットフォームが自動的に画像を分析し、生成の準備を行います。

画像サイズが非常に大きい場合(いずれかの辺が4096ピクセルを超える)、システムは比率を維持したまま自動的に拡大縮小するため、手動での調整は不要です。

第三ステップ:運動指向のプロンプトを作成する

このステップでは、AIにどのような動きを求めているかを伝えます。プロンプトは画像の内容ではなく動きを記述してください(AIは既に画像を確認しています)。以下の点に焦点を当ててください:

- 主体の動き:主体は何をすべきか?

- カメラの動き:カメラはどう移動すべきか?

- 環境の動き:どのような環境の動的要素が必要か?

- リズムと情緒:全体のテンポは速いのか遅いのか?

人物写真プロンプト例:

The woman slowly turns her head to the right and smiles softly.

A gentle breeze moves her hair. Background slightly out of focus

with subtle bokeh movement. Camera slowly pushes in from medium

shot to a close-up. Warm, natural lighting. Cinematic film quality.風景プロンプト例:

Gentle waves roll toward the shore in slow motion. Clouds drift

slowly across the sky from left to right. Sunlight shimmers on

the water surface. Camera slowly pans right, revealing more of

the coastline. Peaceful, serene atmosphere. 4K cinematic quality.製品プロンプトの例:

The camera slowly orbits around the product, rotating 45 degrees

clockwise. Soft studio lighting with subtle caustic reflections

on the surface. Clean white background with gentle gradient.

Premium commercial aesthetic. Smooth, steady camera movement.核心原則:動作を記述し、場面を記述しない。場面はすでにあなたの画像の中に存在している。

ヒント:Seedanceは中国語と英語のプロンプトに対応していますが、英語のプロンプトはカメラワークの制御において通常より正確です。動きやカメラ関連の記述は英語で、雰囲気やスタイルの記述は中国語で行うことをお勧めします。

第四步:パラメータの選択

設定生成設定:

| パラメータ | 推奨値 | 説明 |

|---|---|---|

| モデル | Seedance 2.0 | 画像から動画生成の最高画質 |

| 再生時間 | 5秒(初回試行) | 短めから始めて、満足したら長いバージョンを生成 |

| 画面比率 | 画像に合わせる | 横画面は16:9、縦画面は9:16、正方形は1:1 |

| 解像度 | 1080p | 常に利用可能な最高解像度を選択 |

上級テクニック:まず5秒バージョンを生成します。動きやスタイルが満足できるものであれば、同じプロンプトでより長いバージョン(8~15秒)を生成します。これにより探索段階でポイントを節約できます。

第五ステップ:生成、検証、反復

生成をクリックし、1~3分間待ちます。結果が表示されたら、以下の基準で評価してください:

- 動きは自然で滑らかですか?

- 被写体は全編を通じて視覚的に一貫していますか?

- カメラワークは期待通りですか?

- 視覚的な欠陥(ちらつき、歪み、変形)はありませんか?

- 動画画質は元の画質レベルを維持していますか?

不満な点がある場合は、プロンプトを調整して再生成してください。一般的な調整方法:

- 速すぎる? 動作説明に「ゆっくり」、「優しく」、「徐々に」を追加

- カメラ方向が間違っている? より明確に指定:「静止カメラ、カメラ移動なし」または「スローなドリーイン」

- 顔に欠陥がある? 動きを簡素化:同時に行う動作の数を減らす

- 動きが足りない? 動的な表現を追加:「揺れ動く」、「流れるように」、「漂う」、「移り変わる」

2~3回の反復を経て、画像に命を吹き込む高品質な動画が完成します。

8 大図生動画の応用シーンと事例

図生動画AIは単なる一芸に秀でたツールではありません。数十種類のクリエイティブやビジネス用途に対応しています。以下に8つの高価値な応用シーンと、直接コピー・編集可能な実用的なプロンプトを掲載します。

- 人物アニメーション

写真を生き生きとさせよう。ポートレートアニメーションは最も人気のある写真動画アプリです。プロフィール写真、自撮り、またはキャラクター画像をアップロードし、繊細な生命感あふれる動き——呼吸、まばたき、首振り、表情の変化、髪の揺れ——を追加しましょう。

記念動画、SNSコンテンツ、バーチャルキャラクター制作、クリエイティブなストーリーテリングに最適です。TikTokやXiaohongshuでは、「写真が生き返る」タイプのコンテンツが持続的なトラフィックのホットスポットとなっています。

静止した人物写真が生き生きとした動画に——自然なまばたき、微妙な頭の動き、揺れる髪が、驚くほどリアルな効果を生み出す。

例 prompt:

The person looks directly at the camera with a calm, confident

expression. They slowly tilt their head slightly to the left and

give a subtle warm smile. Eyes blink naturally. A soft breeze gently

moves their hair. Shallow depth of field with softly blurred

background. Warm natural lighting. Cinematic portrait quality.- 製品展示

製品写真を動的な商業コンテンツに変える。これはECブランドやインフルエンサーにとって革命的だ——すでに何百もの製品画像を持っているなら、今やそれらすべてが動画広告、商品詳細ページのメイン画像、またはSNS用ショート動画に生まれ変わる。

淘宝や京東の商品詳細ページ、TikTokライブ配信の商品紹介、そして小紅書の商品レビューノートにおいて、動画による商品展示のコンバージョン率は静止画を大幅に上回っている。

標準的な製品写真に高級商業広告の雰囲気を付与——カメラのパン、ドラマチックな照明、滑らかな動き。従来の手法では数百から数千ドルの費用がかかる可能性がある。

例 prompt:

The camera slowly orbits 90 degrees around the product, revealing

its form from multiple angles. Soft directional studio lighting

with subtle caustic reflections on the surface. A gentle highlight

sweep moves across the product. Clean, premium commercial aesthetic.

Shallow depth of field. Ultra-smooth camera movement. 4K quality.3. 風景タイムラプス

風景写真を大気感のあるタイムラプス動画に変換。雲が空を流れ、水がうねるように動き、光が金色から青みがかったトーンへ変化し、葉が風に揺れる。旅行コンテンツ、不動産プロジェクトの鳥瞰展示、雰囲気を演出するBロールに最適。

Bilibiliの風景系クリエイターや旅行ブロガーは、厳選した写真を直接魅力的なタイムラプス動画に変換でき、制作コストを大幅に削減できる。

一枚の風景写真が映画のようなタイムラプスに——流れる雲、うねる水面、移り変わる光と影が、静止画からダイナミックな大気感を創り出す。

例 prompt:

Time-lapse effect. Clouds move steadily across the sky from left

to right. Water in the foreground ripples and flows gently. Light

shifts subtly as if the sun is moving, creating slowly changing

shadows on the landscape. Trees and grass sway gently in the wind.

Camera remains static on a tripod. Serene, majestic atmosphere.

Cinematic landscape quality.4. ソーシャルメディアコンテンツ

最もパフォーマンスの高い静止画投稿を、ユーザーのスクロールを止める動画コンテンツに変えましょう。TikTok、小红书、Bilibili、Kuaishouなどのプラットフォームのアルゴリズムは動画コンテンツを強く優先します——優れた静止画投稿も動画化すれば、ほぼ確実に高いトラフィックを獲得できます。

小红书のブロガーにとって、同じ画像付きノートに動画バージョンがあると、露出量が3~5倍に増加する可能性がある。一方、抖音と快手は完全に動画をコアコンテンツ形態としている。

例 prompt:

Dynamic, attention-grabbing motion. The subject moves confidently

toward the camera with energy and presence. Background elements

shift with parallax depth effect. Quick, punchy camera push-in

that creates impact. Vibrant colors, high contrast. Bold,

eye-catching aesthetic optimized for social media. Vertical 9:16.- アートとイラストレーションアニメーション

アート作品、イラスト、デジタルペインティング、グラフィックデザインに命を吹き込みます。このアプリケーションは、作品をより魅力的な方法で展示したいと考えるアーティスト、ゲームデザイナー、クリエイティブチームに広く支持されています。

Bilibiliや小红书の絵画・二次元コミュニティでは、アニメーションイラストが最もインタラクティブなコンテンツタイプだ。静止画を「動く壁紙」のような動画に変換すると、シェア数や保存数が原画を大きく上回る傾向がある。

例 prompt:

The illustrated scene comes to life with gentle, painterly motion.

Characters move subtly within their positions -- breathing, shifting

weight, small gestures. Background elements like leaves, clouds,

or particles drift slowly. The artistic style is preserved exactly

as painted. Movement is smooth and dreamlike, like a living painting.

Gentle ambient lighting shifts. Fantasy illustration quality.6. 不動産バーチャル内見

物件写真をバーチャル内見動画に変換。不動産仲介業者は既存の物件写真で没入型プレビューを作成でき、専門の撮影チームを手配する必要がありません。

貝殻找房や安居客などのプラットフォームにおける物件展示、およびSNSの友達圏や小红书での不動産プロモーションにおいて、動画による内見体験は顧客の問い合わせ転換率が明らかに高い。

例 prompt:

Smooth virtual walkthrough. The camera glides forward slowly into

the room, revealing the space with a wide-angle perspective.

Natural daylight streams through the windows, casting soft shadows.

Subtle dust particles float in the sunbeams. The camera pans

gently to the left, showing the full room layout. Clean, bright,

aspirational real estate aesthetic. Steady, professional movement.- ファッションとコーディネート展示

スタジオ撮影のコーディネート写真で動的なファッションコンテンツを作成。モデルが動き出すと、生地が自然に流れるように動き、編集レベルの美的スタイルが保たれます。

小红書のファッションブロガーや淘宝の衣料品販売者は、既存のモデル写真やコーディネート写真を大量に動画に変換し、情報フィードでより強い視覚的インパクトを生み出せる。

例 prompt:

The model strikes a confident pose and then slowly shifts their

weight, creating natural body movement. Fabric of the outfit

flows and catches the light with each subtle motion. Wind effect

gently moves the hair. Camera starts at full body and slowly drifts

upward to a waist-up shot. High-fashion editorial lighting with

strong directional shadows. Vogue magazine aesthetic. Cinematic

slow motion.- 教育と解説内容

静的なチャート、インフォグラフィック、教育用イラストを動的なプレゼンテーションに変換します。複雑な概念も動きの中でより理解しやすくなります。

Bilibili知識エリアのUP主や各種教育プラットフォームのコンテンツ制作者は、教材、図解、フローチャートを動的な動画素材に変換でき、教育効果と視聴者定着率を大幅に向上させることができます。

例 prompt:

The diagram elements animate sequentially. Arrows begin to flow

in their indicated directions. Labels fade in one by one. Moving

parts of the system activate in logical order, showing the process

step by step. Smooth transitions between stages. Clean, clear

educational style. Elements highlight with subtle glow as they

become active. Professional presentation quality.图生動画 プロンプト活用テクニック大全

優れたプロンプトは、図生動画において最も効果的なスキルです。AIが既に画像を確認している以上、プロンプトは完全に動きとダイナミズムに焦点を当てるべきです。以下は最高の結果を生み出すためのテクニックです。

スポーツキーワード速查表

これらの特定のキーワードを使用して動画の動きを精密に制御する。

| 運動タイプ | キーワード | 効果 |

|---|---|---|

| カメラ:前進 | ドリーイン、プッシュイン、接近、アプローチ | 被写体にカメラを近づける |

| カメラ:後退 | ドリーアウト、プルバック、後退、引き | 被写体からカメラを遠ざける |

| レンズ:左右 | パン左、パン右、トラック左、トラック右 | レンズが水平に回転または移動 |

| レンズ:上下 | ティルトアップ、ティルトダウン、クレーンアップ、クレーンダウン | レンズが垂直に回転または昇降 |

| レンズ:周回 | 軌道、旋回、周回、弧を描く | カメラが被写体の周りを回る |

| カメラ:ズーム | ズームイン、ズームアウト、焦点距離シフト | カメラのズーム(位置移動なし) |

| 被写体:微動 | 呼吸、まばたき、体重移動、微細な動き | 微細な生命感の動き |

| 被写体:中程度 | 頭部回転、微笑み、ジェスチャー、ゆっくり歩行 | 明確だが制御された動き |

| 被写体:ダイナミック | 走、跳躍、ダンス、回転、手振り | 高エネルギー全身運動 |

| 環境:穏やか | そよ風、漂い、揺れ、さざ波、きらめき | 柔らかな環境の動き |

| 環境:強烈 | 吹き荒れる、突進、激突、渦巻く、滝のように流れ落ちる | 強烈な環境のダイナミクス |

| 視差 | パララックス、深度シフト、レイヤー移動 | 前景/背景が異なる速度で動く |

異なるカメラワークのキーワードは全く異なる効果を生み出す。望む効果に応じて、意識的にカメラワークの方法を選択する。

速度とリズムの制御

運動の速さは動画の感情に大きな影響を与える。以下の修飾語を使用する:

- 極遅:「ほとんど感知できない」、「超スローモーション」、「氷河のような速度」— ドラマティックで思索的な

- 遅速:「ゆっくり」、「優しく」、「徐々に」、「のんびりと」 — 優雅さ、映画的

- 中速:「安定して」、「自然なペース」、「歩行速度で」 — 写実的、ドキュメンタリー風

- 高速:「素早く」、「活発に」、「精力的に」、「迅速に」— ダイナミックさ、興奮感

- 超高速:「急速に」、「ウィップパン」、「クイックカット」、「動きの爆発」— 緊張感、アクション感

上級テクニック:デフォルトでスローモーションを使用する。AI生成動画では、高速動作よりもスローモーションの方がほぼ常に良好な視覚効果をもたらす。高速動作は欠陥や視覚的不整合のリスクを高める。

背景と主体の独立した運動制御

何が動くか、何が動かないかを自由に制御できる。これは観客の注意を誘導する強力なテクニックだ。

主体が動き、背景が静止している:

The person walks forward confidently while the background remains

perfectly still. Static camera, no camera movement. Focus entirely

on the subject's motion.背景は動き、主体は静止:

The person stands completely still, like a statue. Behind them,

clouds drift across the sky, leaves blow in the wind, and city

lights flicker. Only the environment moves.双方の独立運動:

The person slowly turns their head while the camera simultaneously

dollies in. Background clouds drift in the opposite direction,

creating a sense of depth and dimension.カメラワークと物体の動きの違い

レンズの動きと物体の動きの違いを理解することは、望む効果を得るために極めて重要です。

カメラワークは視点と構図を変える。シーン自体は動かず、観察角度が変化する。用途:画面の提示、シーンの構築、劇的な強調。

物体の運動はシーン内の要素の移動であり、カメラは固定されたままです。用途:キャラクターアニメーション、製品展示、自然環境の動的表現。

複合動作は両方を同時に使用します。これは最も映画的な手法ですが、AIに正確に実行させるのが最も難しいものです。まず単一の動作タイプを習得し、満足できるようになったら別のタイプを重ねることをお勧めします。

高度なプロンプト構造

最も予測可能な結果を得るために、プロンプトを以下の順序で構成してください:

- 主体の動作 — 主要な主体が何をするか

- カメラワーク — カメラがどのように動くか

- 環境の動態 — 環境要素が何をするか

- 速度/リズム — あらゆる動きの速さ

- 雰囲気/情緒 — 感情の基調

- 画質修飾 — 技術的な画質描写

この構造の使用例:

[Subject] A young woman in a flowing white dress slowly raises

her hand to brush hair from her face.

[Camera] The camera executes a slow, steady dolly in from a

medium shot to a close-up.

[Environment] Cherry blossom petals drift gently through the

air. Soft golden sunlight filters through the trees.

[Speed] All motion is slow and deliberate, almost dreamlike.

[Mood] Romantic, ethereal, peaceful atmosphere.

[Quality] Cinematic shallow depth of field, anamorphic bokeh,

film grain, 4K quality.2026年図生動画AIツール比較

動画配信分野の競争は日増しに激化している。以下は2026年2月時点の主要プラットフォームの実態比較であり、特に中国本土ユーザーのアクセス可能性を明記した。

同一素材画像が5つの異なる動画生成プラットフォームで処理された結果。動画の品質、時間的一貫性、および画像の忠実度の差異が一目瞭然である。

| 特性 | Seedance 2.0 | Runway Gen-4 | Pika 2.0 | 可灵(Kling)3.0 | Luma Dream Machine |

|---|---|---|---|---|---|

| 最高解像度 | 2K(2048x1080) | 4K(アップサンプリング) | 1080p | 1080p | 1080p |

| 最長再生時間 | 15 秒 | 10 秒 | 5 秒 | 2 分 | 5 秒 |

| 入力オプション | 画像+テキスト+動画+音声 | 画像+テキスト+動画 | 画像+テキスト | 画像+テキスト | 画像+テキスト |

| 複数画像入力 | 対応(最大9枚) | 非対応 | 非対応 | 非対応 | 非対応 |

| ネイティブ音声 | 対応(8言語リップシンク) | 非対応 | 一部(効果音) | 非対応 | 非対応 |

| カメラ制御 | プロンプトベース | モーションブラシ + ディレクターモード | 基本 | 基本 | プロンプトベース |

| 無料利用枠 | あり(登録で即時付与) | あり(制限あり) | あり(制限あり) | あり(制限あり) | あり(制限あり) |

| 導入価格 | ~$9.90/月 | $15/月 | $10/月 | ~$6.99/月 | $9.99/月 |

| 中国本土からのアクセス | 直接利用可能 | VPN必要 | VPN必要 | 直接利用可能 | VPN必要 |

| 最適用途 | マルチモード制御・画質 | プロ向け編集ワークフロー | 初心者・趣味的エフェクト | 長尺動画・コストパフォーマンス | 映画的質感・3Dシーン |

各ツールの詳細な評価

Seedance 2.0は入力の柔軟性において他を圧倒しています。最大9枚の参照画像を同時にアップロードでき、音声入力と口型同期をサポートし、全ての入力モードを単一生成に統合できる唯一のプラットフォームです。画像から動画を生成する際に最大限の制御を求めるなら、Seedanceが最も包括的なツールキットを提供します。2K解像度出力は(アップサンプリングに依存しない)全ツール中最高峰です。Seedanceはバイトダンス(ByteDance/TikTok親会社)が開発。中国本土ユーザーは直接アクセス可能で、VPNや海外決済は不要です。

Runway Gen-4 は精密な制御に優れています。Motion Brush 機能により、画像のどの部分をどのように動かすかを正確に「描画」できます。特定領域を外科手術のように精密に制御する必要がある場合、Runway は最強の選択肢です。欠点は価格が高く、生成クォータが少ないことです。国内からはVPN経由でのアクセスが必要です。

Pika 2.0 は最も簡単に始められます。プロンプトエンジニアリングを学ばずに画像生成動画に挑戦したい初心者にとって、Pikaのワンクリックエフェクトとシンプルなインターフェースは最も敷居の低い選択肢です。画質はハイエンドツールには及びませんが、カジュアルなソーシャルコンテンツには十分です。国内ではVPN接続が必要です。

可灵(Kling)3.0 は再生時間とコストパフォーマンスで競合を圧倒する。単一画像から長尺動画(30秒、1分、さらには2分)を生成する必要がある場合、可灵が唯一の現実的な選択肢となる。価格と画質の見返りは極めて優れている。制限点は入力オプションが限定的(単一画像+テキスト)であること。快手傘下の製品として、可灵は中国本土で直接利用可能であり、国内ユーザーにとってもう一つの障壁のない選択肢となっている。

Luma Dream Machine は空間認識において卓越した性能を発揮する。風景、建築物、そして立体感の重要なシーンにおいて、Lumaは最も説得力のある視差効果とカメラワークを生成する。キャラクターアニメーションは競合製品に劣る。国内からのアクセスにはVPNが必要。

中国大陸ユーザーの選択に関する提案

中国本土にいる場合、VPNなしで直接利用できる動画ツールは主に2つあります:

- Seedance 2.0 — ByteDance提供、フル機能即利用可能、マルチモーダル入力 + 2K画質 + 内蔵音声

- 可灵(Kling)3.0 — Kuaishou傘下製品、長尺動画生成に強み、コストパフォーマンスに優れる

Runway、Pika、Lumaなどの海外ツールはそれぞれ特徴があるものの、いずれもVPN経由でのアクセスと海外決済が必要で、利用のハードルが高い。

TikTok、Xiaohongshu、Bilibili、Kuaishouなどの国内プラットフォームのコンテンツクリエイターにとって、国内で直接利用可能なツールを選択することは、利便性が高いだけでなく、ネットワークの安定性や決済の簡便性においてもより確実です。

より包括的な比較(テキストから動画生成機能を含む)については、当社の2026年AI動画生成ツール完全ランキングをご参照ください。

よくあるエラーと修正方法

数千本の動画を生成テストした結果、以下の5つの最も一般的なエラーと具体的な修正方法を観察しました。

- 低解像度の素材画像を使用する

犯した間違い:小さなサイズで圧縮された画像(例えばWeChatやSNSから保存した400x300のサムネイル)をアップロードしながら、高精細な動画の出力を期待すること。

失敗の原因:エンコーダーが低解像度の画像から十分な視覚情報を抽出できない。出力はぼやけた質感を継承し、さらにモーションアーティファクトが重なる。

修正方法:常に最高解像度の画像を使用してください。低解像度画像しかない場合は、AI拡大ツール(Real-ESRGANやTopaz Gigapixelなど)で解像度を向上させてからアップロードしてください。最低でも1024x1024ピクセルを推奨します。

- 動作描写ではなく情景描写を書く

犯した間違い:「夕陽に照らされた海面、金色の光が水面にきらめく」のようなプロンプトを書くこと。これは画像の様子を説明している——AIはすでにそれを知っている。

失敗理由:AIは既に画像をコード化している。画像の内容を説明して返すことは、プロンプトスペースを冗長な情報に浪費し、動きの方向性を一切示していない。

修正方法:プロンプトを完全に動きに集中させる。書き換え例:「波が岸に向かって穏やかに打ち寄せる。黄金色の日光が水面にきらめく。雲が左から右へゆっくりと流れる。カメラが海岸線に沿って右へゆっくりパンする。」

- 同時に行う動作が多すぎる

犯したミス:「人物が振り返り、手を振り、歩き出し、カップを手に取り、微笑みながら踊る。同時にカメラが前進し、左に移動し、パンする。」

失敗の理由:現在のAIモデルは、2~3個を超える同時進行の動作を確実に調整することができません。プロンプトの過負荷により、モデルは指示の大部分を無視するか、混乱した欠陥の多い出力を生成します。

修正方法:毎回、主要な主体動作1つとカメラワーク1つに制限する。複雑な連続動作が必要な場合は、複数の短い動画を個別に生成した後、編集してつなぎ合わせる。

- 画面比率の不一致を無視する

犯した間違い:16:9の横長風景写真をアップロードしたのに、出力設定を9:16の縦長に設定した、あるいはその逆。

失敗する理由:AIは画像を大幅にトリミングするか、広範囲の空白領域を埋めなければなりません。どちらの方法も効果的ではありません——トリミングは入念に設計された構図を損ない、広範囲の新しい領域を埋めると不一致が生じます。

修正方法:出力比率を素材画像の比率に合わせる。横画面用は16:9、縦画面用は9:16を使用。異なる比率が必要な場合は、素材画像を目標比率にトリミングしてからアップロードしてください。

- イラスト画像で写実的な効果を期待する

犯した過ち:カートゥーンイラストやフラットデザインの画像をアップロードし、AIが写真のようにリアルな動画生成を期待した。

失敗の理由:モデルが芸術的スタイルを解釈しようとする際、意図しない写実性が加わる場合がある。フラットイラストには、自然な動きを予測するための深度や照明の手がかりが不足している。

修正方法:素材がイラストの場合、プロンプトでスタイルを明確に指定します:「イラストの芸術的スタイルを厳密に維持してください。フォトリアリスティックではなく、2Dアニメーションスタイルでアニメーション化してください。動きは手描きで絵画的な感覚であるべきです。」これにより、モデルに写実感を加えず芸術的スタイルを維持するよう指示します。

よくある質問

どのAIツールが画像生成動画に最適ですか?

Seedance 2.0 は、2026年における生成動画作成ツールのトップ推奨製品です。複数画像入力(最大9枚の参照画像)、2K解像度出力に対応し、画像・テキスト・動画・音声の最も柔軟な組み合わせを提供します。さらにSeedanceはバイトダンスが開発したため、中国本土で直接利用可能です。予算が限られているユーザーには、可灵(Kling)3.0が低価格で優れた画質を提供し、同様に中国国内で直接利用可能です。初心者には、Pika 2.0のインターフェースが最もシンプルです。最適な選択は具体的なニーズによります——当社のツール比較表をご参照ください。

图生视频は無料で作成できますか?

はい。複数のプラットフォームが無料枠を提供しています。Seedanceは新規ユーザー全員に無料クレジットを提供します——クレジットカード不要です。Pika 2.0とLuma Dream Machineも限定的な無料生成を提供しています。HaiLuo AIは毎日10回の無料生成を提供します。無料枠は技術をテストし、数本の動画を作成するのに十分です。継続的な使用が必要な場合は、有料プランの方が経済的です。その他の無料戦略については、当社のSeedance無料利用ガイドをご参照ください。

AI画像から動画を生成する場合、最長でどのくらいの長さまで作成できますか?

プラットフォームごとに上限が異なります。Kling 3.0が最長で、1枚の画像から最大2分間の動画を生成可能です。Seedance 2.0は最大15秒です。Runway Gen-4は最大10秒。Pika 2.0とLuma Dream Machineは最大5秒。ほとんどのSNSやマーケティング用途では、5~15秒が最適な長さです。より長い動画が必要な場合は、複数の短い動画を生成して編集・結合するか、Klingで長尺動画のワンカット生成を行う方法があります。

AI動画生成に最適な画像形式はどれですか?

PNG が最適です。ロスレス形式であるため、圧縮による劣化がありません。WebP(ロスレスモード)も同様の効果があり、ファイルサイズがさらに小さくなります。JPG は多くの場合使用可能ですが、圧縮が過度で明らかな圧縮ノイズがあるJPGは出力品質を低下させます。GIF、BMP、その他の非主流フォーマットの使用は避けてください。すべての主要プラットフォームはJPG、PNG、WebPに対応しています。最低解像度:512x512ピクセル。推奨:1024x1024ピクセル以上。

AIはあらゆる種類の画像を動かせますか?

AIはほとんどの種類の画像を動かせますが、効果は画像の種類によって異なります。人物写真やポートレートが最も効果的です——現在のモデルは自然な顔の動きや髪の揺れを適切に理解しています。風景や自然のシーンも非常に効果的で、雲の動き、水の流れ、植物の揺れが説得力を持っています。背景がシンプルな製品写真は安定した結果が得られます。イラストやアート作品はアニメーション化可能ですが、望ましくない写実感を避けるためにスタイルに特化したプロンプトが必要になる場合があります。複雑な群衆シーン、大量のテキストを含む画像、低品質な写真は最も不安定な結果となります。

画像生成動画とテキスト生成動画の違いは何ですか?

**テキストから動画生成(Text-to-Video)**は、文字記述から画面内容と動きを同時に生成します。AIが視覚的外観を決定するため、細部の制御は限定されますが、創作の自由度は高くなります。**画像から動画生成(Image-to-Video)**は、既存の画像を起点に動きのみを生成します。視覚的参照を提供するため、画面の外観を精密に制御できます。画像から動画生成は通常、予測可能性が高く一貫した結果が得られます。AIが具体的な視覚的アンカーを持つためです。テキストから動画生成は、AIがゼロから全く新しいコンテンツを創作するのに適しています。

图生视频はカメラの動きを制御できますか?

はい。ほとんどの現代的な動画生成ツールは、テキストプロンプトによるカメラワークの制御をサポートしています。「dolly in」(ドリーイン)、「pan left」(パン左)、「orbit around」(オービット)、「crane up」(クレーンアップ)、「zoom out」(ズームアウト)、「tracking shot」(トラッキングショット)などの動きを指定できます。Seedance 2.0とLuma Dream Machineはこれらの撮影キーワードに特に正確に応答します。Runway Gen-4はMotion BrushとDirector Modeにより追加の精密制御を提供し、撮影経路を視覚的に描画できます。生成時には1回につき1種類の撮影動作のみを指定し、「slowly(ゆっくり)」や「steadily(着実に)」などの速度修飾語を付加することを推奨します。

AI画像生成動画の画質はプロフェッショナルな場面で使用するのに十分か?

ショート動画コンテンツ(5~15秒)については、完全に可能です。Seedance 2.0やRunway Gen-4などのトッププラットフォームの出力は、すでにソーシャルメディアマーケティング、EC商品動画、不動産展示、広告クリエイティブに専門的に活用されています。国内では、TikTokや小红书の商業コンテンツの多くがAI生成動画素材を採用している。ただし、長尺化による欠陥リスクの増加、複雑な複数人物シーンでの不安定さ、動画内テキストのレンダリング不完全さといった課題が残る。放送品質や映画品質の完璧さが求められる作品では、従来撮影が依然として安全な選択肢だ。デジタルマーケティングやソーシャルコンテンツにおいては、AI画像生成動画はすでにプロフェッショナルレベルの水準に達している。

まとめ

図生動画AIは、もはや目新しさだけの玩具ではなく、コンテンツ制作に欠かせないツールへと進化した。技術は成熟し、ツールは使いやすく、出力品質はほとんどのデジタルコンテンツシーンの専門基準を満たすことができる。

以下が核心的なポイントです:

- 素材画像の品質が全てを決める。 シャープで構図が良く、高解像度の画像は、ぼやけたものや低解像度のものよりはるかに優れた効果を生む。

- プロンプトは動きを記述し、見た目を記述しない。 AIは既に画像を見ている。物体の見た目ではなく、どう動くべきかを指示する。

- シンプルに始める。 1つの主動作と1つのカメラワークから始めましょう。基礎をマスターしてから複雑さを追加してください。

- 迅速に反復しましょう。 まず短いテストクリップを生成し、満足してからフルバージョンを作成してください。

- **ツールはタスクに合わせましょう。**Seedanceは画質とマルチモーダル制御を追求、可霊は長尺動画とコストパフォーマンスを追求、Runwayは精密編集を追求、Pikaはシンプル操作を追求。

- **自分に合ったツールを選ぼう。**中国本土にいる場合、Seedanceと可霊は追加のネットワークや決済の障壁なしに直接利用可能。

図生動画AIを利用するブランドやクリエイターと、依然として静止画に依存する競合との差は、月を追うごとに拡大している。製品ギャラリー内の1枚1枚の写真が潜在的な動画広告となり、人物写真は動的アバターに、風景写真は映画用Bロール素材へと変貌する。

無料で初めての画像動画を作成 --> — 任意の画像をアップロードするだけで、2分以内に動き出す様子を確認できます。クレジットカード不要、中国本土から直接利用可能。

AI動画機能をもっと探求したい?Seedance全プラットフォームを体験 --> — 文から動画生成、動画から動画変換、マルチモーダル生成をワンストップで実現。

関連記事:Seedance 完全ガイド | Seedance プロンプトガイドと50以上の例 | AI動画クリエイティブ活用事例 | 2026年ベストAI動画生成ツール比較ランキング | AI動画マーケティング&SNS活用ガイド | テキストから動画生成AI:完全ガイド